基于NSST和Tetrolet能量特征的指关节纹识别  下载: 722次

下载: 722次

1 引言

随着生物学信息与科技的快速发展,当今社会对于身份认证的需求显著增加,生物特征识别技术是一种有效的解决方法。相比指静脉、掌静脉,指关节纹的采集设备更简易;相比指纹[1],指关节纹的采集环境具有非侵犯性;相比掌纹[2],指关节纹接触刚性物体少,不易被磨损[3];相比人脸图像[4-5],指关节纹的纹理特征更稳定。因此,利用指关节纹进行身份认证具有一定的优势,可用于对人们真实身份的辨别,且安全性较高。

目前,基于指关节纹进行识别的方法较多,Yang等[6]提出了基于图形嵌入学习和费舍尔鉴别分析框架的特征提取方法,用得到的最优映射特征进行匹配识别;Chlaoua等[7]提出了一种基于主成分分析网络(PCANet)提取指关节纹图像特征的多模态生物特征识别系统;冯媛[8]提出了一种用ImageNet数据集预训练的网络模型,并在指关节纹数据集上进行参数微调,得到最优模型;Chen等[9]提出了基于稀疏表示和线性回归的分类规则,在特征提取时可最大化近邻子空间的边缘;Kong等[10]提出基于分数级融合的识别方法,将Gabor特征作为识别的基本特征,根据阈值的判定规则进行匹配识别;Kumar等[11]提出利用细节点进行指关节纹图像的恢复和匹配,通过提取细节特征提高指关节纹模式匹配的性能;Nigam等[12]提出融合多纹理特征的指关节纹认证系统,利用曲率Gabor滤波器提取感兴趣区域(ROI),通过不同的相似性度量进行匹配识别。

综上所述,传统识别方法在特征提取时注重指关节纹的局部特征,在实际应用中易被伪造,抗仿冒性较差;基于深度学习对手指组合图像的识别效果更好,但存在数据样本量较小等问题。指关节纹具有丰富的纹理信息,考虑到其主线与褶皱周围空间复杂的能量值分布,本文提出了一种基于非下采样的Shearlet变换(NSST)和Tetrolet能量特征的识别方法。首先,利用直方图均衡化扩大指关节纹图像的灰度范围,并对处理后的图像进行NSST分解与重构,滤除其噪声分量;然后,对图像进行Tetrolet变换,获取变换后的低频图像,在特征提取时,利用处理后图像形成的能量曲面作为特征,根据曲面呈现的空间形态进行识别,伪造难度更大。曲面的变化趋势可直观反映指关节纹纹理信息的强弱,若两幅图像匹配,则其在三维空间形成曲面的凹凸程度和位置也非常相似;否则,特征差异较大,从而快速、准确地识别指关节纹。在三个标准图库及其噪声图库中的实验结果表明,本方法在指关节纹识别领域具有明显的优势和可行性,且准确性和鲁棒性较好。

2 NSST和Tetrolet变换原理

2.1 非下采样的Shearlet变换

指关节纹图像经NSST分解后可获得具有冗余性的系数,包含大量的方向性信息。Shearlet变换的定义中,ψ∈L2(R2)为输入函数,其中,L2(·)为平方函数空间,R为实数,L2(R2)为平方可积二元函数空间,满足以下条件。

1)

2) ψ1为ζ1的连续小波,

3)

式中,ψast(x)为剪切波,Aa和Bs分别为各向异性膨胀矩阵和剪切矩阵,a为尺度、s为剪切、t为平移。剪切波可对各个尺度、方向的图像信息进行处理。在实际应用中[13]

式中,Z为整数。NSST是Shearlet变换的位移不变形式,变换时,指关节纹图像经一层非下采样拉普拉斯金字塔滤波器组(NSPFB)分解为高通滤波的图像和低通滤波的图像。在低频系数上进行下一层非下采样金字塔(NSP)分解,每层分解都在上一层分解所得的低频系数上进行迭代,从而得到图像信息的多尺度分解;然后通过剪切波滤波器组(SF)对高频子带图像进行方向局部化分解[13]。在图像的分解和重构过程中,NSST消除了向下采样步骤,具有多尺度、多方向扩展以及完全的平移不变性[14],从而抑制了图像中的伪吉布斯现象[15]。

图像的噪声主要包含在高频部分中,因此还需进一步处理高频系数。定义高频子带图像区域I的中心像素点为(i,j),则

式中,I的大小为K×K,M为取中值操作,Imean为I的均值,Imedian为I的中值,b为子带中的初始系数。根据文献[ 16]可知,阈值L为

式中,σp,q为对应NSST中尺度p、方向q子带的噪声方差估计值,Imean(i,j)和Imedian(i,j)分别为中心像素点(i,j)系数的均值和中值,去噪后的高频系数可表示为

式中,b(m,n)为去噪前的子带系统、b*(m,n)为去噪后的子带系统。最后,对处理后的子带系数进行NSST的逆变换。

2.2 Tetrolet变换

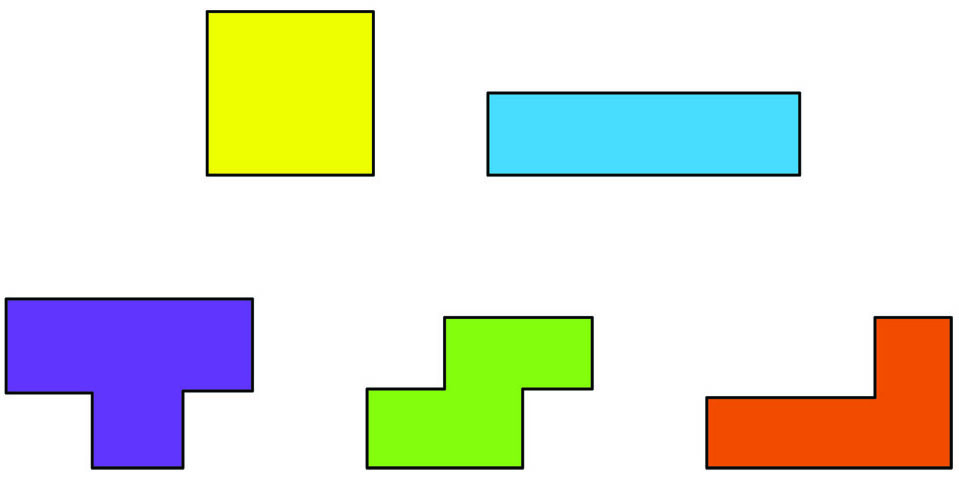

Tetrolet变换对指关节纹图像进行四格拼版(Tetromino)划分[17],可以表达出更精确、丰富的图像信息。Tetromino是由四个单位正方形通过边连接起来的图形,共有五种基础的拼版形式,如

用四个不相交的Tetrominos覆盖4×4的区域,共有22种基本排列形式[17]。考虑到旋转与对称,共有117种方法,由于这些方法具有相似性,实际应用中可简化排列方式[17]。Tetrolet变换的具体过程如下。

1) 输入去噪后的指关节纹图像d0=

2) 将指关节纹的低通图像dr-1划分成尺寸为4×4的图像块Qi,j,i,j=0,1,…,N/2r+1-1。

3) 对每个块Qi,j进行拼版划分,共有117(c=1,2,3,…,117)种组合方案。

式中,系数ε

式中,c*为最佳排列方式。每个分块Qi,j进行Tetrolet变换后的子带为

将子带

4) 存储低通子带矩阵dr=

分解结束时,最优的Tetrolet子带产生的拼版方式最接近该4×4图像块的边缘和纹理,能较好地保留图像的纹理特征,得到原指关节纹图像的最优稀疏逼近。

3 基于NSST与Tetrolet的指关节纹特征提取与匹配识别

本方法结合NSST与Tetrolet变换,先将指关节纹图像经NSST分解为低频、高频子带图像,其中,低频图像中包含主要的能量信息,高频图像的灰度值变化较快,包含图像的边缘、细节及噪声信息。由于低频系数较大且分布均匀,因此不对其进行处理。而高频系数中包含的噪声会对匹配识别产生影响,需根据文献[ 16]中的方法确定阈值,得到去噪后的高频系数。低频子带与去噪后的高频子带进行NSST逆变换得到去除噪声的指关节纹图像。将去噪后的指关节纹图像进行Tetrolet变换得到最优稀疏表示的图像,有效增强了纹理特征,进而建立Tetrolet变换低频图像的能量曲面,根据曲面间的差值进行匹配识别,具体步骤:

1) 对指关节纹图像f进行NSST分解,得到低频子带图像fL和高频子带图像fH;

2) 通过阈值处理确定去噪后的高频图像fh,将fh与fL进行NSST逆变换得到重构的去噪指关节纹图像fA;

3) 将fA通过Tetrolet变换后的低频图像形成能量曲面,并将NSST和Tetrolet能量曲面(NTES)作为指关节纹特征;

4) 利用不同图像形成能量曲面之间的差异进行匹配识别。本方法的识别流程如

经本方法处理后的指关节纹图像形成的能量曲面如

图 3. 本方法处理后的结果。 (a) 本方法处理后的图像; (b) 能量特征曲面

Fig. 3. Result processed by our method. (a) Image processed by our method; (b) energy characteristic surface

用不同NTES之间的差异值对指关节纹图像进行识别,设曲面上任意点为(x,y),两个图像矩阵的NTES分别为Z1=E1(x,y)和Z2=E2(x,y),Z1与Z2的能量差曲面为Z12=S(x,y)=E1(x,y)-E2(x,y)。匹配时,当差曲面的变化程度较小,即方差较小时,认为两个手指关节纹的图像匹配;方差较大则表示两个指关节纹图像不匹配,图像来自两个不同的手指。将差曲面的方差作为指关节纹的匹配距离,并根据该距离的大小判定图像是否来自同一手指。方差S和均值E可表示为

式中,M、N分别为差曲面的宽度和高度。根据两幅图像差曲面的方差形成的曲线选取阈值[18],当方差S小于该阈值时认为两个指关节纹来自同一手指;否则,来自不同手指。

图 4. 不同情况下的能量差曲面。 (a)同一个人的图片1; (b)同一个人的图片2; (c)不同人的图片; (d)匹配的能量差曲面; (e)不匹配的能量差曲面

Fig. 4. Energy difference surfaces under different conditions. (a) Image1 of the same person; (b) image2 of the same person (c) image of the different person; (d) matching energy difference surface; (e) mismatching energy difference surface

4 实验结果及分析

4.1 评价指标及实验环境

识别率WCRR可表示为

式中,VC为正确识别的样本数,VS为测试样本总数。WCRR的值越大,表明方法的识别性能越好;反之,方法的性能越差。在坐标系内以错误接受率WFAR为横坐标,错误拒绝率WFRR为纵坐标绘制接受者操作特征曲线(ROC),WFRR与WFAR的交点即为等误率(EER),WEER的值越小,表明方法的性能越好。WFRR和WFAR可表示为

式中,VNFR为错误拒绝次数,VNEA为类内测试总次数,VNFA为错误接受次数,VNIA为类间测试总次数。

本方法的实验环境:系统为Windows10,中央处理器为酷睿i5 7200U,内存为12 G。实验所用测试集为香港理工大学接触式指关节纹库(HKPU-FKP)、非接触式指关节纹图库(HKPU-CFK)、印度理工学院德里分校指关节纹图库(IIT Delhi-FK)及其噪声图库。

4.2 香港理工大学接触式图库测试

HKPU-FKP包含165个人、660根手指的指关节纹图像,且图像已经过ROI的提取。实验选取100个人的左手中指指关节纹图像,每人6幅,共600幅指关节纹图像,图像大小为110 pixel×220 pixel。为检验本方法的抗噪性及鲁棒性,在图像中加入高斯噪声后进行识别率的计算和类内、类间匹配实验,HKPU-FKP原图库及加入噪声的图库示例如

图 5. HKPU-FKP图库ROI示例。 (a)原图库; (b)噪声图库

Fig. 5. Example of HKPU-FKP database ROI. (a) Original database; (b) noise database

为了降低光照对匹配造成的影响,对ROI图像进行直方图均衡化处理后再执行本方法。均衡化前后的像素分布如

图 6. 直方图均衡化对比图。 (a)均衡化前的图像; (b)均衡化前的直方图; (c)均衡化后的图像; (d)均衡化后的直方图

Fig. 6. Histogram equalization contrast. (a) Image before equalization; (b) histogram before equalization; (c) image after equalization; (d) histogram after equalization

实验进行1500次类内匹配,178200次类间匹配,原图库、噪声图库的类内、类间匹配曲线及ROC如

图 7. 匹配曲线及ROC(HKPU-FKP及噪声图库)。(a)匹配曲线;(b)ROC

Fig. 7. Matching curve and ROC (HKPU-FKP and noise database). (a) Matching curve;(b) ROC

为进一步验证本方法的优越性,将NTES与其他方法在HKPU-FKP图库及其噪声图库上的识别结果进行对比,包括主成分分析(PCA)、局部二值模式(LBP)、基于小波变换的灰度曲面、二维PCA(2DPCA)、 基于Surfacelet、 Tetrolet的灰度曲面、Gabor+线性判别分析法(Gabor+LDA)。不同方法在原图库及噪声图库中的识别率及识别时间如

表 1. 识别率与识别时间(HKPU-FKP原图库)

Table 1. Recognition rate and matching time (HKPU-FKP original database)

|

表 2. 识别率与识别时间(HKPU-FKP噪声图库)

Table 2. Recognition rate and matching time (HKPU-FKP noise database)

|

表 3. 等误率与识别时间(HKPU-FKP图库)

Table 3. Equal error rate and matching time (HKPU-FKP database)

|

4.3 印度理工学院德里分校指关节纹图库

印度理工学院德里分校指关节纹图库包含158名志愿者的图像,选取其中100个人的指关节纹图像,每人5幅,共500幅图像。ROI图像的大小为80 pixel×100 pixel,IIT Delhi-FK图库原图像及加入高斯噪声的图库如

图 8. IIT Delhi-FK图库示例。 (a)原图库; (b)噪声图库

Fig. 8. Example of IIT Delhi-FK database. (a) Original database; (b) noise database

实验共进行1000次类内匹配,123750次类间匹配,得到的类内、类间匹配曲线及ROC如

图 9. 匹配曲线及ROC(IIT Delhi-FK及噪声图库)。(a)匹配曲线;(b)ROC

Fig. 9. Matching curve and ROC (IIT Delhi-FK and noise database). (a) Matching curve; (b) ROC

表 4. 识别率与识别时间 (IIT Delhi-FK原图库)

Table 4. Recognition rate and matching time (IIT Delhi-FK original database)

|

表 5. 识别率与识别时间(IIT Delhi-FK噪声图库)

Table 5. Recognition rate and matching time (IIT Delhi-FK noise database)

|

4.4 香港理工大学非接触式指关节纹图库

香港理工大学非接触式指关节纹图库中的图像通过手机等手持设备采集, 包含503名志愿者的右手中指指关节纹图像。选取其中100人,每人5幅图像,共500幅图像进行实验。ROI图像的大小为160 pixel×180 pixel。原图库及加入高斯噪声的ROI图像如

图 10. HKPU-CFK图库ROI示例。 (a)原图库; (b)噪声图库

Fig. 10. Example of HKPU-CFK ROI database. (a) Original database; (b) noise database

在原图库及噪声图库进行类内类间匹配实验,得到的匹配曲线及ROC如

图 11. 匹配曲线及ROC(HKPU-CFK及噪声图库)。 (a) 匹配曲线; (b) ROC

Fig. 11. Matching curve and ROC (HKPU-CFK and noise database). (a) Matching curve; (b) ROC

表 6. 识别率与识别时间 (HKPU-CFK原图库)

Table 6. Recognition rate and matching time(HKPU-CFK original database)

|

表 7. 识别率与识别时间 (HKPU-CFK噪声图库)

Table 7. Recognition rate and matching time(HKPU-CFK noise database)

|

图 12. 正确识别率和识别时间。 (a) 正确识别率; (b) 识别时间

Fig. 12. Correct recognition rate and matching time. (a) Correct recognition rate; (b) matching time

4.5 实验分析

综上所述,相比其他方法,本方法在识别率上有明显提升,最高可达98.0392%,且识别时间最短,为0.0497 s,EER最低,为2.5646%,这也验证了本方法的有效性和优越性。在噪声图库的对比实验中,本方法的性能优于其他方法,表现出良好的抗噪性能。其中,PCA、2DPCA等方法在进行特征提取时运算过程比较复杂,降维运算导致运行时间较长;基于Haar小波灰度曲面的方法虽然缩短了计算时间,但识别率不高;Surfacelet、Tetrolet方法在识别率、抗噪性能方面均不理想;LGIC、LGIC2方法将局部特征与全局特征融合,EER优于本方法,但识别效率不及本方法。本方法抛弃了传统方法在匹配之前进行大量的局部特征提取、编码等复杂操作,通过NSST进行去噪处理,提升了本方法的鲁棒性;并结合具有稀疏能力的Tetrolet变换对指关节纹图像进行变换,得到原图像的最优表示图像,建立能量曲面并进行匹配,有效提升了正确识别率。匹配时,用整个特征曲面构建待匹配图像,具有抗仿冒性,不易被伪造。此外,本方法提供了更显著的区分判别信息,有效提高了识别性能,缩短了匹配时间。

5 结论

针对指关节纹的纹理特点,提出一种基于NSST和Tetrolet能量特征的指关节纹识别方法。利用NSST分解和Tetrolet变换获取待匹配图像,建立能量曲面进行匹配识别。在三个图库及其噪声图库上的实验结果表明,本方法能有效提高识别系统的准确性,识别率最高为98.0392%,且运行时间较短,EER最低,为2.5646%。这表明本方法在提升识别准确率方面具有优势,且抗仿冒性强。但本方法的准确性仍有较大上升空间,原因是进行图像的去噪及稀疏处理时,图像边缘不能完全被表示。今后可采用对边缘处理能力较强的超小波变换或基于深度学习的多模态融合识别提高系统的识别率和抗伪造性,并致力于建立更大的样本库。

[1] 曹燕平, 李晓记, 胡云云. 基于可见光指纹的室内高精度定位方法[J]. 激光与光电子学进展, 2019, 56(16): 160601.

[2] 钟德星, 朱劲松, 杜学峰. 掌纹识别研究进展综述[J]. 模式识别与人工智能, 2019, 32(5): 436-445.

[3] 徐颖, 翟懿奎, 甘俊英. 面向指背关节纹识别的图像集与凸壳优化算法[J]. 信号处理, 2014, 30(8): 930-936.

Xu Y, Zhai Y K, Gan J Y. Finger-knuckle-print recognition based on image sets and convex optimization[J]. Journal of Signal Processing, 2014, 30(8): 930-936.

[4] 杨恢先, 陈凡, 甘伟发. 基于多任务学习的深层人脸识别算法[J]. 激光与光电子学进展, 2019, 56(18): 181005.

[5] 吴晓萍, 管业鹏. 基于人脸关键点与增量聚类的多姿态人脸识别[J]. 激光与光电子学进展, 2019, 56(14): 141002.

[6] Yang W K, Sun C Y, Zhang L. A multi-manifold discriminant analysis method for image feature extraction[J]. Pattern Recognition, 2011, 44(8): 1649-1657.

[8] 冯媛. 融合指静脉及指关节纹的身份识别方法[D]. 阜新: 辽宁工程技术大学, 2019.

FengY. Recognition method based on finger vein and finger knuckleprint[D]. Fuxin: Liaoning Technical University, 2019.

[10] Kong T, Yang G, Yang L. A hierarchical classification method for finger knuckle print recognition[J]. Eurasip Journal on Advances in Signal Processing, 2014, 2014(1): 44.

[11] Kumar A, Wang B C. Recovering and matching minutiae patterns from finger knuckle images[J]. Pattern Recognition Letters, 2015, 68: 361-367.

[12] Nigam A, Tiwari K, Gupta P. Multiple texture information fusion for finger-knuckle-print authentication system[J]. Neurocomputing, 2016, 188: 190-205.

[13] 刘益含, 闫德勤, 王洪东. 一种基于非下采样剪切波变换的医学图像配准方法[J]. 计算机应用研究, 2015, 32(5): 1586-1588.

Liu Y H, Yan D Q, Wang H D. Medical image registration method based on non-subsampled shearlet transform[J]. Application Research of Computers, 2015, 32(5): 1586-1588.

[14] 于津强, 段锦, 陈伟民, 等. 基于NSST与自适应SPCNN的水下偏振图像融合[J]. 激光与光电子学进展, 2020, 57(6): 061006.

[15] 张兰花. 基于NSST和Tetrolet变换的图像增强算法的研究[D]. 乌鲁木齐: 新疆大学, 2018.

Zhang LH. The research on image enhancement algorithm based on NSST and Tetrolet transform[D]. Urumqi: Xinjiang University, 2018.

[16] 张耀军, 吴海燕. 基于NSST的自适应阈值图像去噪方法[J]. 信息与电脑(理论版), 2015( 16): 12- 15.

Zhang YJ, Wu HY. A NSST based adaptive threshold image denoising method[J]. China Computer & Communication, 2015( 16): 12- 15.

[18] 林森, 徐天扬, 汤永华, 等. 基于改进S变换的手掌静脉身份识别[J]. 光电子·激光, 2015, 26(9): 1776-1782.

[19] Zhang L, Zhang L, Zhang D, et al. Ensemble of local and global information for finger-knuckle-print recognition[J]. Pattern Recognition, 2011, 44(9): 1990-1998.

[20] Zhang L, Zhang L, Zhang D, et al. Phase congruency induced local features for finger-knuckle-print recognition[J]. Pattern Recognition, 2012, 45(7): 2522-2531.

Article Outline

王媛, 林森. 基于NSST和Tetrolet能量特征的指关节纹识别[J]. 激光与光电子学进展, 2021, 58(2): 0210019. Yuan Wang, Sen Lin. Finger-Knuckle-Print Recognition Based on NSST and Tetrolet Energy Features[J]. Laser & Optoelectronics Progress, 2021, 58(2): 0210019.