基于热红外光谱的人脸特征提取算法  下载: 1165次

下载: 1165次

1 引言

当前,人脸识别技术已经广泛应用到公共安全监测与身份认证领域,极大地提高了司法机关案件取证、罪犯追逃、身份认证和公共安全管理的效率。然而,当前的可见光人脸识别系统无法应对实际非控制环境的各种挑战,如光线变化、人脸表情变化、姿态变化、妆容变化和用照片代替人脸欺诈等 [1-2]。

使用红外热像仪拍摄的热红外人脸图像比可见光人脸图像具有更高的稳定性,可以弥补可见光图像的诸多缺陷。热红外人脸图像的特征是由人的脸部肌肉组织和血管分布等固有因素所决定,以较强稳健性的解剖学细节作为主要特征,由人的遗传基因结构决定,不同的人脸具有完全不同的热辐射模式,不可复制,更不受环境光照等因素的影响,在夜间监测、相似人脸识别(双胞胎)、易容化妆、局部遮挡和照片欺诈等应用条件下具有较强的稳健性,在夜间公共安全监测与身份认证领域具有广泛的应用前景[3]。

光照变化是影响人脸识别系统精度的主要因素,热红外人脸识别技术成为光照问题的稳健解决方案。热红外成像技术是利用8~14 μm人体辐射的长波红外光谱来成像,取决于辐射率和温度,不需要外部光源来反射可见光谱,它的识别性能对外部环境光照的依赖很小,所以可以将热红外人脸识别技术应用于夜视环境下的人脸识别[4]。

近几年,热红外人脸识别已经成为生物特征识别领域的一个具有挑战性的研究方向,大多数研究可以通过使用以下两种途径来改善人脸识别的性能:

1) 仅使用红外光谱成像。此类方法可以分为基于外观和基于特征的方法。基于外观的方法使用主成分分析(PCA) [5]、线性判别分析(LDA)[6]、独立分量分析(ICA)[7]和广义高斯混合方法[8]等技术来处理人脸热图像;基于特征的方法使用局部二值模式(LBP)[9]、Weber局部描述符[10]、局部导数模式(LDP) [11]、定向梯度直方图(HOG) [12]和Gabor描述符(GJD)[13]等方法来提取人脸热特征。

2) 使用可见光谱和红外光谱结合的多光谱成像。可见光谱和红外光谱的融合方法需要解决一些问题,这是因为如眼镜阻挡红外光谱问题、可见光不足的照明问题等会影响识别性能。这些技术方案在良好的室内采集条件下可呈现令人满意的结果,但是在不受控制的室外条件下性能不佳[14-15]。

本文仅使用热红外光谱成像技术,并引入一个新的概念,即高斯混合模型等温特征。通过极大化数据模型的似然度将热红外人脸图像调整到高斯混合模型,然后提取等温特征,实现人脸热特征图像的重建,用概率邻近指数度量不同个体间的相似度,给出精确的识别结果。

2 热红外人脸特征提取算法设计

2.1 热红外人脸图像数据建模

将热红外人脸图像尺度归一化为125 pixel×225 pixel(共28125个特征点)的测试图像,计算热红外人脸图像每个像素的概率密度函数和整个数据模型的联合概率。

设

混合模型参数

式中:

随机矩阵

整个测试图像数据模型的联合概率可表示为

2.2 热红外高斯混合人脸图像重建

为了使热红外人脸图像的像素分布更均匀,通过极大化数据模型的似然度获取混合模型参数,然后执行类拟合算法计算极大化数据模型的熵和高斯度,将数据模型调整到高斯混合模型(高斯度

1) 计算测试图像每个像素属于区域

2) 计算每个像素8个邻域隶属概率的加权平均

(1) 计算像素

式中:

(2) 更新概率矩阵

(3) 利用更新后的概率矩阵

3) 极大化数据模型的似然度获取混合模型参数

式中:

利用估计

4) 执行类拟合算法将模型调整到高斯混合模型(高斯度

(1) 计算区域像素集

式中:

(2) 计算区域像素集

式中:

(3) 计算出极大化数据模型的高斯度

如果高斯度

2.3 热红外人脸图像等温特征的提取

在重建的热红外高斯混合人脸图像中选择区域特征点(由区域像素

式中:在像素

由提取的等温特征集

式中:

2.4 热特征图像相似度的判决

通过计算一对重建人脸热特征图像间的概率近邻指数来实现相似度的判决。

设

式中:

式中:条件期望

3 实验及分析

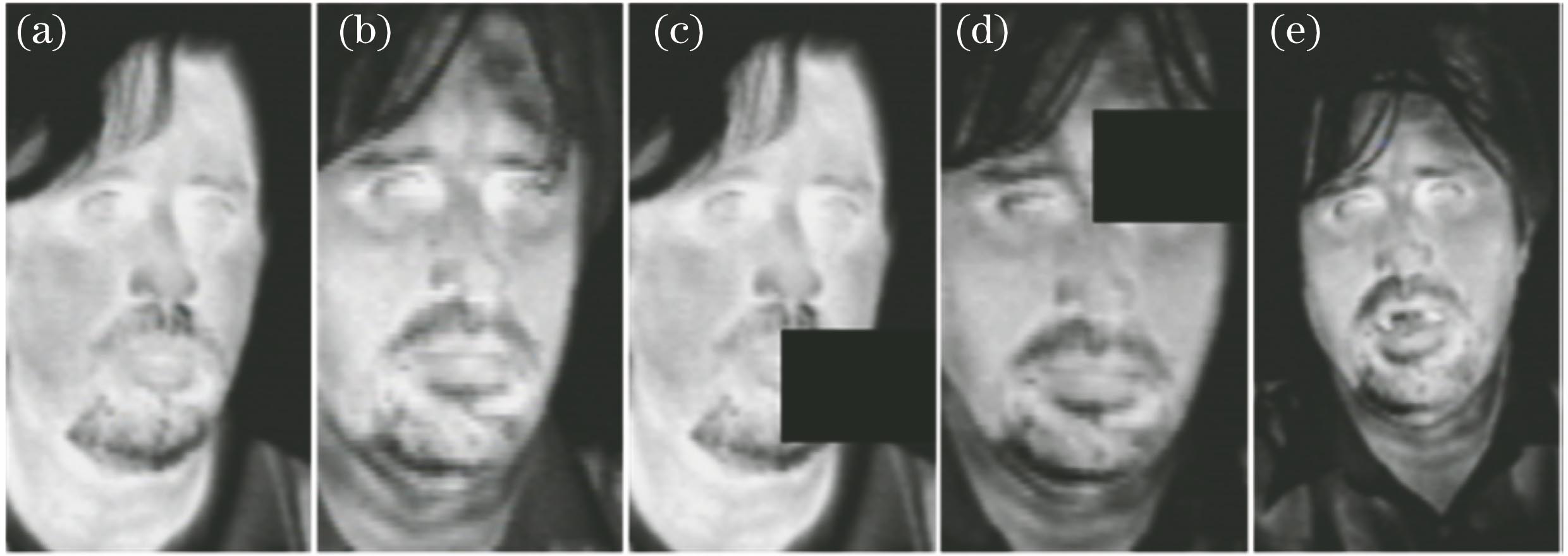

为了评估所提出方法的识别精度和稳健性,选取UCHThermalFace数据库进行多姿态样本的特征变化实验和随机遮挡与眼部噪声实验。

UCHThermalFace数据库的姿态集(

图 1. UCHThermalFace数据库样本图像。(a)室内;(b)室外;(c)室内遮挡;(d)室外遮挡;(e)室外讲话

Fig. 1. Sample images in UCHThermalFace database. (a) Indoor; (b) outdoor; (c) indoor occlusion; (d) outdoor occlusion; (e) outdoor speech

3.1 实验参数的设置

3.1.1 高斯度

通过极大化高斯混合模型的似然度来寻找合适的模型参数,如果样本足够多,高斯混合模型能够以任意精度逼近任意的连续分布。但是,高斯混合模型的收敛性较差,可通过设置最大重复迭代次数和高斯度

在本次实验中,选取UCHThermalFace数据库100个训练对象的10类样本(姿态样本5类、噪声样本3类、表情样本2类),共计1000个训练数据进行高斯混合模型的参数估计和算法的收敛性分析。执行(8)式、(9)式和(10)式进行模型参数的迭代更新,每次迭代完成后计算当前迭代的似然度

式中:

由

执行类拟合算法计算模型的高斯度,如果

3.1.2 概率近邻指数

概率近邻指数

为了评估噪声大小对概率近邻指数

在

当使用无噪声图像(

3.2 多姿态样本的特征变化实验

实验选取UCHThermalFace数据库6个姿态集(

原始热红外人脸图像如

图 4. 高斯混合模型等温特征的提取过程。(a)原始图像;(b)高斯混合图像;(c)特征点图像;(d)等温特征图像

Fig. 4. Extraction process of isothermal features in Gaussian mixture model. (a) Original image; (b) Gaussian mixture image; (c) feature point image; (d) isothermal feature image

选取UCHThermalFace数据库6个姿态集(

由

表 1. 多姿态样本特征数变化的实验数据

Table 1. Experimental data for different feature numbers of multi-pose samples

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

本文算法与其他方法如:独立分量分析(ICA)[7]、局部二值模式(LBP)[9]、局部导数模式(LDP) [11]和Gabor描述符(GJD)[13]在应对多姿态样本(

图 5. 不同方法特征变化的识别率对比

Fig. 5. Recognition rate comparison of feature changes by different methods

由

3.3 随机遮挡与眼部噪声实验

本实验选取UCHThermalFace数据库随机遮挡比例为10%的遮挡数据集和在眼睛区域分别添加2.5%、5%和10%的噪声数据集进行识别实验,来验证本文算法应对夜视环境下随机遮挡样本时的优越性和人眼检测的准确性。

选取UCHThermalFace数据库中佩戴墨镜的测试样本再进行10%随机遮挡的热红外图像,执行本文算法的实验过程,如

如

夜视环境下眼睛检测的准确性直接影响人脸对准与否,决定人脸识别的精度,选用3种眼部噪声比例2.5%、5%和10%的噪声子集样本来检验本文算法的稳健性。测试图像在室内采集,测试对象到红外热像仪(FLIR,TAU 320)距离固定为120 cm,室内温度为22 ℃,尺寸为100 pixel×185 pixel,最大特征数为18500。遮挡子集样本是将图像分为10个不同区域,随机选取一个区域作为遮挡块,并将其像素值设置为0来模拟10%的随机遮挡,选取53个对象的5类热红外图像(正常、10%遮挡、2.5%噪声、5%噪声、10%噪声)共计265个测试样本,随机遮挡与添加眼部噪声的热红外图像如

本文算法与其他方法在应对随机遮挡和眼部噪声样本时的性能对比如

图 6. 随机遮挡样本的等温特征提取过程。(a)原始图像;(b) 10%遮挡图像;(c)特征点图像;(d)等温特征图像

Fig. 6. Isothermal feature extraction process for random occlusion samples. (a) Original image; (b) 10% occlusion image; (c) feature point image; (d) isothermal feature image

图 7. 随机遮挡与眼部噪声样本图像。(a)正常;(b) 10%遮挡;(c) 2.5%噪声;(d) 5%噪声;(e) 10%噪声

Fig. 7. Images of random occlusion and eye noise samples. (a) Original image; (b) 10% occlusion image; (c) 2.5% noise; (d) 5% noise; (e) 10% noise

图 8. 随机遮挡与眼部噪声样本识别率对比

Fig. 8. Recognition rate comparison among random occlusion and eye noise samples

在

尽管遮挡和眼部噪声的影响使本文算法的识别精度有所降低,但是提取等温特征后计算一对热特征图像间的概率近邻指数,足以完成人脸分类过程,这是因为等温特征向量以较强稳健性的解剖学细节作为主要特征,受环境光照及局部遮挡和噪声的影响较小,所以,基于高斯混合模型等温特征的热红外人脸识别技术特别适用于夜间公共安全监控与身份认证。

4 结论

为了解决当前可见光识别技术难题,通过提取热红外光谱下人脸图像的高斯混合模型等温特征,实现人脸热特征图像的重建,并通过计算一对热特征图像间的概率邻近指数得出识别结果。在UCHThermalFace数据库上进行了夜视环境下的多姿态、特征变化、局部遮挡和眼部噪声样本的实验,获得了有竞争力的性能。

1) 在多姿态样本的特征变化实验中,本文算法仅需要全部特征集1.8%的特征数就能达到与全尺寸特征相当的识别率,平均识别率可以稳定达到95%以上;全尺寸特征的平均识别时间为1.642 s,

2) 在随机遮挡与眼部噪声实验中,10%随机遮挡样本的平均识别率达到92.59%,即使添加10%的眼部噪声,识别率也达到了90.17%,精度均高于其他4种红外光谱识别方法。

因此,基于热红外光谱的人脸特征提取算法可以广泛应用于夜视环境下的安全监控和身份认证,具有极大的市场前景。

[1] 夏军, 裴东, 王全州, 等. 融合Gabor特征的局部自适应三值微分模式的人脸识别[J]. 激光与光电子学进展, 2016, 53(11): 111004.

[2] 李雅倩, 李颖杰, 李海滨, 等. 融合全局和局部多样性特征的人脸表情识别[J]. 光学学报, 2014, 34(5): 0515001.

[3] 陈木生, 蔡植善. 基于NSCT的红外与可见光图像融合方法研究[J]. 激光与光电子学进展, 2015, 52(6): 061002.

[4] Hermosilla G. Ruiz-del-Solar J, Verschae R. A comparative study of thermal face recognition methods in unconstrained environments[J]. Pattern Recognition, 2012, 45(7): 2445-2459.

[5] ChenX, Flynn PJ, Bowyer KW. PCA-based face recognition in infrared imagery: Baseline and comparative studies[C]∥2003 IEEE International SOI Conference. Proceedings, October 17, 2003, Nice, France, France. New York: IEEE, 2003: 127- 134.

[8] Akhloufi M A, Bendada A. Infrared face recognition using distance transforms[J]. International Journal of Computer, Electrical, Automation, Control and Information Engineering, 2008, 2(4): 1002-1005.

[11] Chen X, Hu F Y, Liu Z L, et al. Multi-resolution elongated CS-LDP with Gabor feature for face recognition[J]. International Journal of Biometrics, 2016, 8(1): 19-32.

[12] Xie ZH, JiangP, ZhangS. Fusion of LBP and HOG using multiple kernel learning for infrared face recognition[C]∥2017 IEEE/ACIS 16th International Conference on Computer and Information Science, May 24-26, 2017, Wuhan, China. New York: IEEE, 2017: 81- 84.

[15] Fonnegra RD, MolinaA, Pérez-Zapata A F, et al. MSpecFace: A dataset for facial recognition in the visible, ultra violet and infrared spectra[C]∥Botto-Tobar M, Esparza-Cruz N, León-Acurio J, et al. International Conference on Technology Trends 2017: Communications in Computer and Information Science, Cham: Springer, 2017, 798: 160- 170.

Article Outline

栗科峰, 黄全振, 卢金燕. 基于热红外光谱的人脸特征提取算法[J]. 激光与光电子学进展, 2019, 56(2): 023001. Kefeng Li, Quanzhen Huang, Jinyan Lu. Extraction Algorithm of Face Features Based on Thermal Infrared Spectra[J]. Laser & Optoelectronics Progress, 2019, 56(2): 023001.