基于多视角低秩表征的短视频多标签学习模型  下载: 886次

下载: 886次

1 引言

现如今,短视频作为一种新型的媒体形式出现在大众面前,因各大网络、社交平台允许用户录制、加工、上传自己的短视频,故大量短视频原始数据会周期性出现,且这些数据作为多媒体内容常常携带有多个标签,如“美妆”和“女生自拍”经常出现在同一短视频中。在大量数据源背景下,对短视频数据进行有效的多标签学习逐渐体现出其必要性。

多标签学习一直是机器学习领域的热门话题,其基本任务就是将多个标签分配到每一个未知的数据样本中[1]。二元关联算法[2]是最早解决多标签学习的方法之一,但这种方法忽略了标签与标签之间的相关性。建模时如果没有利用标签之间的依赖性和独立性,则无法实现最佳的预测性能。受此思想影响,文献[ 3]提出了一种分类器链,即将多标签问题转化为一串二元分类问题来对标签之间的相关性进行建模;文献[ 4]提出了一种采用特征诱导的标签信息增强的多标签学习方法,其将多标签样本的类别信息通过特征空间的结构化信息加以增强。然而以上方法由于未将特征表征和预测模型纳入同一框架下,学习过程整体性欠缺,较容易因为特征表征和模型的不匹配而产生次优的学习结果。

同时,由于多媒体环境的特点,在处理短视频的相关问题时,通常会提取多个不同视角的特征来描述其内容[5]。现有的研究成果针对多视角问题的处理往往是将各个视角串联起来,这样会造成视角之间影响的不确定性、串联后特征的冗余性以及特征维度过大等问题,因此在处理短视频多视角特征时需要考虑一种更有效的特征表征方法。

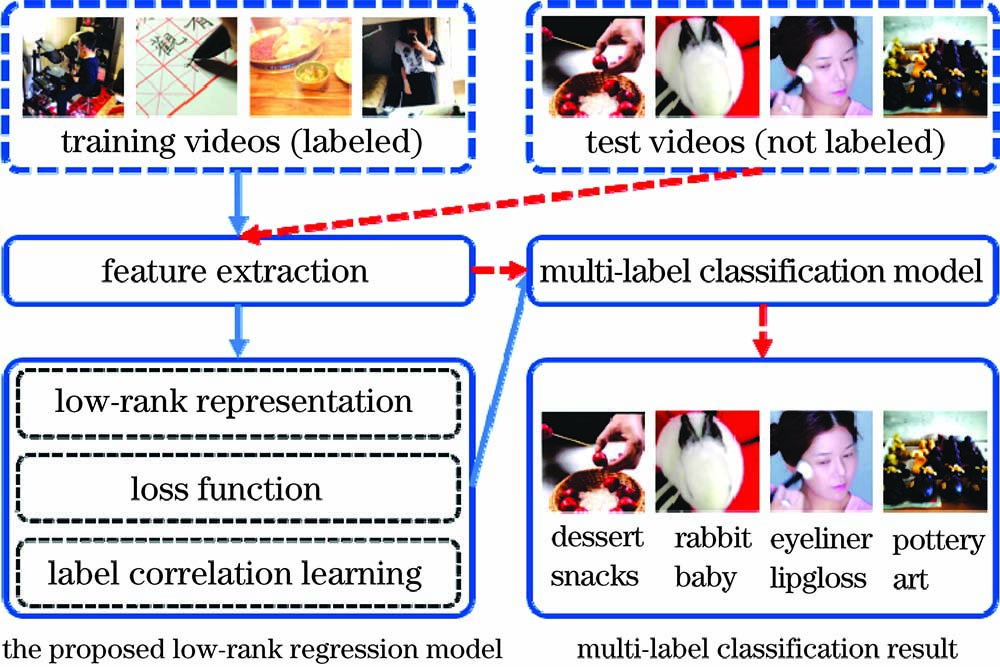

为解决上述问题,本文从短视频本身的特点出发,将多视角低秩表征和多标签学习整合到同一个框架下,利用多视角特征的一致性和低秩表征对于多媒体内容理解的优势训练得到本征稳定的低秩表示;同时通过矩阵正态分布原理构造标签相关性学习项,得到标签相关性矩阵,以此进一步适应多标签学习的需求。此外,模型通过低秩表示到标签空间的映射构造损失函数项,将低秩表示与模型本身加以匹配。本文模型保证了学习过程的整体性,提高了最终结果的准确性和对数据噪声的鲁棒性。

2 低秩表征

低秩表征由压缩感知理论[6]衍生而来,是指将原有的特征矩阵变化为字典集和一个新的特征表示的乘积,同时要求该特征表示的秩尽量小,从而避免了特征的冗余性;由于其对于多媒体内容的理解能力和在数据噪声存在情况下的稳健能力,低秩表征被广泛应用于图像处理[7-8]、机器学习[9]、计算机视觉[10-12]等诸多领域。

假设给定一组数据集X=[x1,x2,...,xN]∈RD×N,其中R为实数集,D为特征维数,N为样本个数;低秩表示的中心思想就是找到一个合适的字典集U∈RD×d,使得原始数据矩阵X通过该字典集可以映射到一个最低秩的线性组合解;假设用Z∈Rd×N来表示该最低秩表征的系数矩阵,则有X=UZ,其中d表示最低秩表征的维数。由于在实际求解过程中矩阵的秩不方便优化,常常用矩阵核范数代替矩阵的秩进行求解;另外,为了提高最终结果的鲁棒性,低秩模型常常引入稀疏噪声,由此得到低秩表示的基本模型为

其中E∈RD×N为稀疏噪声项;‖·‖*为矩阵的核范数,代表了矩阵奇异值的和;λ1为平衡参数;‖·‖1为矩阵的l1范数,对稀疏噪声数据进行规范化。

3 基于多视角低秩表征的短视频多标签学习模型

在处理诸如短视频等多媒体内容的相关问题时,往往需要提取多种特征来描述同一内容。但在提取过程中无法保证不同特征维度之间的不相关性,例如一个关于“美妆”的短视频中不仅包含与人脸相关的属性特征,还可能包含人脸中的其他信息。由此就会产生大量的特征冗余的情况,造成模型复杂度增加和预测结果准确性降低。由于低秩表征本身存在消除特征冗余的特性,本文利用其内在规律,同时为了适应多标签学习的需求,提出了一种基于多视角低秩表征的短视频多标签学习模型。该模型使得多视角低秩表征和多标签学习在同一个框架下进行,包含多视角低秩表征、损失函数和标签相关性学习三个部分,进而保证了学习过程的整体性。本文模型如

3.1 算法模型

假设一组用多视角表示的短视频数据集:

1) 多视角低秩表征:其将原本不同视角的特征矩阵Xi通过各自的字典集Ui∈RD×d映射到公共的低秩表示Z∈Rd×N上,同时要求Z的秩最小,即

其中d为公共低秩表示的特征维度,Ei∈

2) 损失函数:为了建立低秩表示和标签空间之间的联系,同时使实验结果和真实的标签矩阵更为接近,模型利用已标注短视频数据的监督信息,引入了损失函数项来确保最终结果的鲁棒性,损失函数为

其中‖·‖F为矩阵的F范数,W∈Rd×C为权重矩阵,同时也是低秩表示到标签空间的映射,由此构成损失函数项。其将低秩表示Z通过权重矩阵W映射到标签空间中,是建立从输入特征到输出结果的重要组成部分,其通过最小化ZTW与Y的差,使特征表示更能贴合输出需求,进而提高输出结果的鲁棒性。

3) 标签相关性学习:为了研究标签之间的相关性,使最终结果更符合多标签分类的要求,模型引入了标签相关性矩阵S∈RC×C来表示标签与标签之间的关系。在权重矩阵W固定的前提下,S可由矩阵正态分布的原理进行优化,权重矩阵W的概率密度函数为

将(4)式取对数后转化为

其中tr(·)为矩阵的迹,(·)-1为矩阵的逆,log(·)为对数函数。与单标签学习问题不同,多标签学习模型需要将单个特征映射到多个标签,即达到一对多的输出目的。标签相关性学习通过最大化W的概率密度函数,使得其列向量对应的类别信息更加明显,进而实现对于潜在标签相关性矩阵S的求解,并在迭代过程中利用S使得W能够更好地实现从低秩表示到多个标签的映射,从而使模型更加符合多标签学习问题的需求。同时为了保证获取足够的标签相关性,需要最小化其逆矩阵的l1范数,由此得到标签相关性学习项,即

其中λ3,λ4,λ5为调节参数。

综合上述三个函数可得整体目标函数为

由此将多视角低秩表征和多标签学习整合到同一个框架下,二者在求解迭代过程中互相约束,从而保证了学习过程的整体性。

3.2 模型求解

根据模型本身的数学特点,目标函数采用增广拉格朗日乘子法的线性交替方向法进行求解,在目标函数中引入

L

其中,μ为惩罚参数,<·>为矩阵内积算子。由此可以通过固定其他矩阵变量的迭代过程求解上述增广拉格朗日乘子式,主要矩阵变量的求解式为

其中g为迭代次数,

4 实验和结果分析

4.1 实验数据及设置

本文使用的数据集为美拍MLSV-2018短视频数据集,该数据集从官方后台数据库中筛选出12万个短视频用作训练样本并进行人工多标签标注,主要标注原则为短视频中出现的主体、场景和动作三个部分,每个短视频标注1~3个标签,数据集样例如

4.2 结果分析

4.2.1 算法收敛性

为证明本文算法的可行性和求解方式的合理性,收敛性验证以低秩表示迭代前后的绝对差值为第一指标,公式为:Zdiff=

图 3. 收敛性验证图。(a) Zdiff随模型迭代的变化;(b)平均精度随模型迭代的变化

Fig. 3. Convergence verification graphs. (a) Variation of Zdiff with model iteration; (b) variation of average precision with model iteration

4.2.2 参数对比实验

为了研究模型最佳参数,本研究在迭代过程中改变其中一个参数同时固定其他参数,直到模型最终收敛并观察结果,找到对应最佳参数后再将此参数固定改变其他参数,从而找到全部最佳参数。

根据实验结果,可知λ2和λ4在模型迭代过程中敏感性较高,其中λ2为损失函数项参数,λ4为标签相关性学习项参数。

图 4. 不同参数对于平均精度的影响。(a) λ2对于平均精度的影响;(b) λ4对于平均精度的影响

Fig. 4. Effect of different parameters on average precision. (a) Effect of λ2 on average precision; (b) effect of λ4 on average precision

4.2.3 消融实验

为验证多视角低秩表征、损失函数和标签相关性学习的作用,在实验过程中控制其他变量不变,将三者相对应的参数分别置0,即无多视角低秩表征(No LR)、无损失函数(No LF)和无标签相关性学习(No LC),并列出3种不同情况下的结果与原整体模型的差距,可得到如

表 1. 消融实验结果

Table 1. Ablation experiment results

|

通过消融实验可以发现:多视角低秩表征与标签相关性学习二者通过消除特征冗余性和提取标签相关性的特性达到了优化最终实验结果的目的;损失函数项的缺失对于最终的结果有较大影响,导致低秩表征的的结果不能更好地映射到其原有标签。由此证明将其融合进整体模型中能够使得低秩表征更大程度地贴合标签空间的分布,进而提高了最终结果的鲁棒性。

4.2.4 不同算法的对比实验

为证明本文所提模型的有效性和优越性,同时论证低秩表征和多标签学习整体性的重要性,本研究利用相同数据集数据和特征将本文方法与其他文献中的方法进行比较,对比结果如

综合来看,本文所提模型能够结合短视频本身的特点,充分利用低秩表征的优势,将多视角低秩表征与多标签学习整合在同一框架下,实现较好的学习结果。

表 2. 不同算法的性能对比

Table 2. Performance comparison of different algorithms

|

4.2.5 标签相关性对比实验

通过对原始数据多标签数量的统计,可以得到数据集中的真实标签相关性矩阵,

图 5. 标签相关性矩阵对比。(a)归一化真实标签相关性矩阵;(b)归一化相关性矩阵

Fig. 5. Label correlation matrix comparison. (a) Normalized correlation matrix for true label; (b) normalized correlation matrix

5 结论

针对目前短视频多标签学习中遇到的主要问题,提出了一种基于多视角低秩分解的短视频多标签学习模型,并将多视角低秩表征和多标签学习整合到了同一个框架下。该框架利用低秩表征挖掘特征维度之间的相关性,学习更稳健的低秩特征表示,结合损失函数和标签相关性学习增强了模型的整体学习能力。采用基于增广拉格朗日乘子法的线性交替方向法对整体模型进行了求解。在公开数据集上的大量实验表明,模型可以在多视角特征融合的情况下通过去除特征冗余性和学习标签相关性来提高多标签学习的最终效果。

[4] Zhang QW, ZhongY, Zhang ML. Feature-induced labeling information enrichment for multi-label learning[C]∥ 32th AAAI Conference on Artificial Intelligence, February 2-7, 2018, New Orleans, Louisiana, USA. Reston,VA: AIAA Press, 2018: 4446- 4453.

[5] Nie LQ, WangX, Zhang JL, et al.Enhancing micro-video understanding by harnessing external sounds[C]∥Proceedings of the 2017 ACM on Multimedia Conference-MM ’17, October 19-27, 2017. Mountain View, California, USA.New York: ACM Press, 2017: 1192- 1200.

[6] 练秋生, 夏长城. 基于双树复数小波局部高斯模型的彩色图像压缩感知[J]. 激光与光电子学进展, 2011, 48(10): 101001.

[7] 杨鹏, 刘德儿, 李瑞雪, 等. 结合信息熵与低秩张量分析的金属零件破损检测[J]. 激光与光电子学进展, 2019, 56(21): 211006.

[8] 牛强, 陈秀宏. 基于隐式低秩表示的联合投影学习算法及图像识别[J]. 激光与光电子学进展, 2019, 56(14): 141006.

[9] 张静, 付建鹏, 李新慧. 基于低秩正则化异构张量分解的子空间聚类算法[J]. 激光与光电子学进展, 2018, 55(7): 071003.

[10] 杨鹏, 刘德儿, 李瑞雪, 等. 结合信息熵与低秩张量分析的金属零件破损检测[J]. 激光与光电子学进展, 2019, 56(21): 211006.

[11] 张晓慧, 郝润芳, 李廷鱼. 基于低秩稀疏矩阵分解和稀疏字典表达的高光谱异常目标检测[J]. 激光与光电子学进展, 2019, 56(4): 042801.

[12] HassannejadH, MatrellaG, CiampoliniP, et al.Food image recognition using very deep convolutional networks[C]∥Proceedings of the 2nd International Workshop on Multimedia Assisted Dietary Management-MADiMa ’16, October 16, 2016, Amsterdam, The Netherlands.New York: ACM Press, 2016: 41- 49.

[13] Wang LM, QiaoY, Tang XO. Action recognition with trajectory-pooled deep-convolutional descriptors[C]∥2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA.New York: IEEE Press, 2015: 4305- 4314.

[14] Jia Z L, Zhang X, Guan N Y, et al. Gene ranking of RNA-seq data via discriminant non-negative matrix factorization[J]. PLoS One, 2015, 10(9): e0137782.

[15] Liu GC, Yan SC. Latent Low-Rank Representation for subspace segmentation and feature extraction[C]∥2011 International Conference on Computer Vision, November 6-13, 2011, Barcelona, Spain.New York: IEEE Press, 2011: 1615- 1622.

[16] Zhu Y, Kwok J T, Zhou Z H. Multi-label learning with global and local label correlation[J]. IEEE Transactions on Knowledge and Data Engineering, 2018, 30(6): 1081-1094.

[18] SzegedyC, LiuW, JiaY, et al.Going deeper with convolutions[C]∥2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA.New York: IEEE Press, 2015: 1- 9.

[19] TranD, BourdevL, FergusR, et al.Learning spatiotemporal features with 3D convolutional networks[C]∥2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile.New York: IEEE Press, 2015: 4489- 4497.

[20] Yeh CK, Wu WC, Ko WJ, et al.Learning deep latent spaces for multi-label classification[C]. 31th AAAI Conference on Artificial Intelligence, February 4-9, 2017, San Francisco, California. Reston,VA: AIAA Press, 2017: 2838- 2844.

吕卫, 李德盛, 谭浪, 井佩光, 苏育挺. 基于多视角低秩表征的短视频多标签学习模型[J]. 激光与光电子学进展, 2020, 57(22): 221012. Wei Lü, Desheng Li, Lang Tan, Peiguang Jing, Yuting Su. Microvideo Multilabel Learning Model Based on Multiview Low-Rank Representation[J]. Laser & Optoelectronics Progress, 2020, 57(22): 221012.