自适应特征选择的相关滤波跟踪算法  下载: 1038次

下载: 1038次

1 引言

目标跟踪是国内外计算机视觉领域的一个研究热点[1-5],广泛应用于**领域、民用领域等。现实场景的复杂性(光照变化、形状变化、运动模糊等),使得目标跟踪的效果不太理想,因此如何在复杂背景下提高算法的跟踪准确率是目标跟踪领域的热点问题。

根据目标建模方式的不同,目前跟踪方法主要分为生成式方法和判别式方法两种。生成式方法主要是计算候选目标与目标模型的相似度,以相似度最高的候选目标作为目标进行跟踪。生成式方法仅针对目标本身的外观特征,导致其在处理目标外观快速变化和遇到遮挡时,跟踪效果并不好。判别式方法则是把跟踪看作一个二分类问题,旨在构建一个有效的分类器以区分目标及其背景,从而实现对目标的跟踪。相比于生成式方法,判别式方法在建模时将目标与背景进行区分,因此在目标跟踪时的效果通常表现得更为稳健,目前已成为目标跟踪的主流跟踪方式。

近年来,基于相关滤波的判别式方法已广泛应用于目标跟踪领域,并取得了显著的效果。2010年Bolme等[6]提出将相关滤波(CF)应用于目标跟踪领域,该算法基于输出结果的最小均方误差(MOSSE)训练相关滤波器,通过响应图像的值判断候选位置与初始化目标的相关性。响应值越大,则相关性越大,从而提高了滤波器的准确度。同时该算法的计算从时域转换到频域,跟踪速率超过了600 frame/s。此后,很多算法都在其基础上进行改进。Henriques等[7]于2012年提出核循环结构(CSK)算法,该算法针对相关滤波中样本数量不足对滤波器的影响,使用循环密集采样的方法,有效地利用了整张图片的特征。为了提升算法性能,Henriques等[8]在相关滤波中引入核空间,提出了核相关滤波算法(KCF),在算法中采用多通道梯度方向直方图(HOG)特征,通过核函数将线性空间的岭回归问题映射到非线性空间,提高了高维特征空间中样本分类的速度。Danelljan等[9]针对尺度变化问题,基于MOSSE跟踪方法提出了多尺度空间滤波跟踪算法(DSST),该算法分为位置滤波器(TF)和尺度滤波器(SF)两部分,采用判别相关滤波器来确定位置,同时在文中提出一种精准的尺度估计方法以确定尺度信息。利用该算法进行跟踪的过程中,两个滤波器独立工作,分别进行目标定位和尺度评估,取得了优异的表现。Bertinetto等[10]从特征融合入手,提出一种特征互补的跟踪方法,将HOG特征与颜色特征相融合,有效地解决了变形情况下HOG特征稳健性较差和光照变化下颜色特征表现效果较差的问题,提高了跟踪的准确度,但两种特征融合增加了计算复杂度。除融合特征外,针对人为选择的核函数未必是最优函数的问题,Tang等[11]提出了多核相关滤波器(MKCF),即在核化滤波器(KCF)基础上引入多个核函数,并提出了优化求解的方法。Zhang等[12]将多个特征进行融合,同时在计算时引入多个核函数,再将多个滤波器进行整合,并通过最后的跟踪结果调整核的权重,从而使得核有自适应选择的能力。

虽然相关滤波算法凭借其速度的优势和良好的精度得到广泛应用,但也存在不足之处:1)相关滤波方法属于模板类方法,对于快速变形和快速运动的情况跟踪效果较差,易发生跟踪漂移现象;2)在提取目标特征的过程中,提取单一特征或固定权重融合特征不能够全面地描述目标,导致跟踪的准确率较低;3)为了提高跟踪的准确率,一些跟踪方法采用多个滤波器相互融合来确定目标位置,时间复杂度较高。

针对以上问题,本文在相关滤波跟踪的基础上,提出一种自适应特征选择的相关滤波跟踪算法。该方法对HOG特征相关滤波器的响应值与颜色统计特征的响应值分配不同的权重,进行线性加权运算,得到多个具有不同偏向性的融合特征,通过对融合特征进行可信度判定,选取得分最高的融合特征作为跟踪特征,保证了对目标特征描述的准确性。然后对确定的目标位置进行尺度估计和模型更新,实现对目标的稳定跟踪。在OTB50和OTB100的标准数据序列上进行实验,实验结果验证了所提方法的有效性和稳定性。

2 总体框架设计

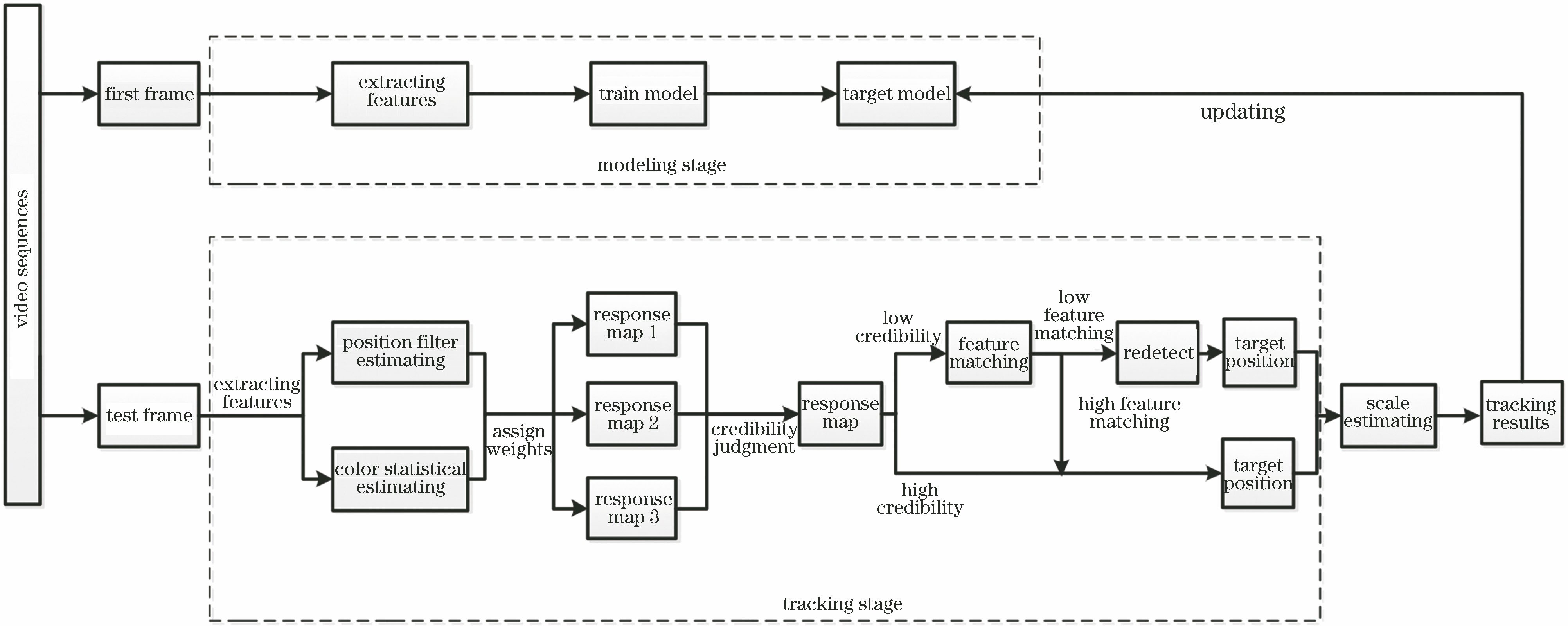

快速多尺度空间滤波跟踪(fDSST)算法[13]在跟踪效果和速度上都表现得较好,因此本文算法采用fDSST算法作为基本框架,同时为了更有效、全面地描述目标以及方便后续与其余跟踪算法的比较,采用判别能力较强的HOG特征与颜色统计特征作为基础特征进行融合。跟踪框架主要分为建模、跟踪和更新三个阶段,整体框架如

1) 建模阶段。根据手动标定的第一帧目标位置信息,训练用来估计目标位置的相关滤波器,同时训练颜色概率模型和用来估计目标尺度的相关滤波器,最终建立目标模型。

2) 跟踪阶段。首先在当前帧的候选区域提取HOG特征和颜色特征[14],使用前一帧确定的目标模型对两种基础特征进行计算。然后对计算结果分配不同的权重并进行融合,对融合结果进行可信度判断,选取可信度最高的融合特征作为当前帧的跟踪特征,并根据该特征估计出目标的候选位置。对于最高可信度仍低于阈值的情况,根据两帧之间特征点的匹配结果,判断是否启动检测器。若匹配程度较低,启动检测器重新检测和定位目标的位置,否则候选位置即为目标最终位置。最后使用尺度滤波器对目标的尺度进行估计,从而完成跟踪过程。

3) 更新阶段。利用每帧跟踪阶段确定的目标位置,对位置滤波器、颜色概率模型和尺度滤波器进行更新。

3 自适应特征选择的跟踪算法

相关滤波方法最早在文献[ 6]中提出,可应用在跟踪领域,是近年来跟踪领域的主流方法。其基本思想是:越是相似的两个目标,其相关值越大,即图片中的目标与初始化目标越相似,滤波器得到的响应值越大,因此将滤波器响应最大的位置作为目标的位置,从而实现跟踪。该类方法属于模板类方法,并受边界效应的影响,对于快速运动与快速变形的目标,效果并不好。文献[ 10]提出融合两种互补特征的方法,一定程度上改善了相关滤波方法对快速运动和快速变形目标跟踪的情况,同时对光照变化的情况也能表现出较好的跟踪效果。但是该方法采用固定等权重分配特征的方式融合互补的两个特征,对不断变化的目标以及背景没有选择适应能力,且未对跟踪结果进行可靠性判定。在文献[ 6]和文献[ 10]的基础上,本文提出一种自适应特征选择的跟踪算法,通过融合不同权重的特征,不仅有效解决了相关滤波器对于快速运动和快速变形目标效果不好的问题,而且增强了跟踪框架对于变化的目标与背景的适应能力。同时对跟踪效果进行可信度判断,可信度较低时启动检测器进行重新检测,重新定位目标的位置,从而有效地提高了跟踪的准确率。

在本文中,位置滤波器和颜色概率模型用于提取样本特征,得到相对应的响应图。然后通过对两个响应图以线性加权的方式进行组合,得到最终的目标位置响应图。其组合公式为

式中:

通过使用不同的权重分配因子

表 1. 融合特征多权重分配方式

Table 1. Multi-weight distribution of fusion features

|

通过融合不同权重的特征得到不同的融合特征响应图,对融合后得到的响应图的可信度进行判断,取可信度最大的特征作为当前帧的跟踪特征。采用文献[ 15]提出的平均峰值相关能量(APCE)计算跟踪的可信度,计算公式为

式中:

由于

3.1 位置滤波器与颜色概率模型

位置滤波器与颜色概率模型主要是用来提取特征,以获取相应的响应图。其中位置滤波器主要用于提取HOG特征,颜色概率模型主要用于统计搜索区域内的颜色特征。HOG特征用于快速运动和快速变形的情况时效果不好,但用于运动模糊光照变化等情况时比较好;而颜色统计特征不属于相关滤波框架,不受边界效应的影响,用于快速运动和快速变形的情况时效果较好,但光照变化对其影响较大。因此,选择这两种互补的特征作为融合特征的基础特征。

3.1.1 位置滤波器

位置滤波器主要通过使用fDSST算法提取搜索区域中的HOG特征,并使用相关滤波器将其转化为响应图。在响应图中,峰值代表该位置的响应分数最高,表示该位置是目标位置的可能性最大。fDSST算法是对DSST算法的改进,本文借鉴该算法对目标进行HOG特征的提取。针对目标区域提取

式中:★表示循环相关;

为减少卷积计算耗费的时间,基于Parseval公式将(3)式转换到傅里叶域进行计算,得到最优化滤波器为

式中:

式中:

在第

式中:

式中:F-1表示傅里叶逆变换。

3.1.2 颜色概率模型

颜色概率模型主要用于将目标的前景与背景分开,通过统计前景目标和背景区域的颜色直方图并进行归一化,判别每个像素属于前景和背景的概率,得到像素级的前景概率响应图,前景响应分数越高的位置,越有可能是目标的位置。响应图的得分计算式为

式中:

式中:

式中:

跟踪第

式中:

3.2 基于GMS的目标检测器

在可信度策略的基础上,针对最高可信度仍然较低的情况,提出了一种基于GMS特征点匹配[16]的目标检测器。检测器首先通过特征点匹配判断是否进行重检测,在重检测时将利用当前帧计算得出的目标位置与前一帧目标的预测位置进行比较,选择可信度最高的位置作为当前帧目标的最终位置,实现对目标的跟踪。以序列DragonBaby中的第5帧为例,目标重检测过程示意图如

GMS特征点匹配是文献[

16]提出的一种基于网格运动统计的快速、超稳健的特征匹配算法,其主要思想是:首先进行ORB (Oriented FAST and Rotated BRIEF)特征匹配,得到特征匹配点,然后使用GMS方法对匹配结果进行过滤,消除错误的特征匹配点对,保留匹配成功的特征点。为了减少邻域之间像素的干扰,增加特征匹配结果的差异,构建了一种基本平滑运动核,其大小为3×3,每个网格的匹配统计值

式中:

式中:T表示成功匹配;F表示错误匹配。

通过对当前帧可信度较高的目标区域与前一帧的目标区域进行特征点匹配,得到匹配成功的特征点对数,匹配成功点越多,表示两帧之间的目标区域越相似,匹配程度越高;反之,则匹配程度越低。实验中设定特征点总数为

使用当前帧的融合特征组合方式导致可信度较低,因此在对预测区域进行检测时,采用的融合特征融合方式中不包括当前帧已经使用过的融合方式,增强了检测器对偶然因素形成的可信度较高的特征的抗干扰能力。对于每个预测区域, 使用位置滤波器与颜色概率模型进行特征提取,通过分配不同的权重得到融合特征,选取最大的可信度作为该预测区域的可信度。预测区域可信度集合表示为

对序列DragonBaby的前10帧的位置数据进行采集,结果如

表 2. 目标中心位置比较

Table 2. Comparison of central positions of targets

|

3.3 多尺度滤波

针对目标跟踪过程中的尺度变化问题,在确定目标位置后,使用尺度相关滤波器对目标的尺度变换进行估计,构建目标尺度金字塔。尺度滤波器模型的期望响应函数是高斯函数,使用相关滤波器对尺度池中不同的尺度进行评估,响应分数最大的尺度即为目标当前帧的最佳尺度,构建尺度池的方法为

式中:

尺度滤波器与位置滤波器的滤波过程相似,采用一维高斯函数作为期望函数,将尺度滤波器

表 3. 估计尺度与实际尺度信息表

Table 3. Estimated scale and actual scale information

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

4 算法步骤

自适应特征选择的相关滤波跟踪算法步骤如下:

1) 建立模型。使用已知的首帧目标位置信息,选取首帧中的目标区域和搜索区域,分别训练2维位置滤波器、颜色概率模型以及1维尺度滤波器。

2) 融合特征。取

3) 可信度判断。通过(2)式对步骤2)中分配不同的权重

4) 特征点匹配和重检测。对于步骤3)中最大可信度仍较低的情况,根据(15)式和(16)式,使用特征点匹配的方法比较该可信度下

5) 尺度估计。以当前帧确定的目标位置为中心位置,使用(17)式提取不同的候选样本以构建尺度金字塔,根据(7)式和(8)式计算尺度滤波器的响应值,最大响应尺度即为第

6) 模型更新。对于步骤 4)中重新检测过程得到的预测区域中最大可信度仍不超过阈值

7) 输出跟踪结果。将跟踪窗口进行可视化输出,继续执行步骤2)。

5 实验结果及分析

5.1 实验参数设置及数据

所有实验均在CPU为Intel Core i7-6700,3.4 GHz主频和16 GB内存的计算机上完成,测试开发平台为:MATLAB R2016a。在位置滤波器模型中,初始提取的特征维度

为了便于与其他主流算法进行对比,实验选取的标准测试数据集为OTB50[17]和OTB100[18]。OTB50数据集包含50组视频序列,涵盖11种不同视觉跟踪挑战的属性,如光照变化(IV)、尺度变换(SV)、运动模糊(MB)等,每段序列可能有多个属性。OTB100是在OTB50的基础上新增了50组测试视频序列,背景属性更加复杂,跟踪挑战性更大。

实验采用一次性通过评估(OPE)评价准则来计算跟踪准确率和成功率,将准确率、成功率以及跟踪速度作为跟踪性能的评价标准。跟踪准确率(DP)为跟踪中心点位置误差小于阈值的帧数占整个序列帧数的比例,跟踪成功率(OP)则表示跟踪重叠率(交并比)大于阈值的帧数占总体序列帧数的比例,跟踪速度(FPS)为跟踪器每秒读取视频序列中图片的个数,其中准确率阈值设定为20 pixel,成功率阈值设定为0.5。

5.2 对比实验分析

为了验证本文跟踪算法的有效性,选取7种近几年出现的跟踪效果较好的跟踪算法进行对比,分别为fDSST[13],SAMF[19],SRDCF[20],BACF[21],STRCF[22],STAPLE[10],ECO[23]。这些算法涵盖基于相关滤波的算法、相关滤波改进的算法以及深度学习的算法,本节将从跟踪的准确性与时效性两个方面进行跟踪效果的对比。

5.2.1 准确性分析

在OTB50与OTB100数据集的不同属性下测试了8种算法,得到8种算法的距离精确度和跟踪重叠率见

表 4. 8种跟踪算法平均跟踪性能比较

Table 4. Average tracking performance comparison among eight tracking algorithms

| ||||||||||||||||||||||||||||||||||||||||||||||||||

图 6. 8种跟踪算法在OTB50上的精确率和成功率。(a)精确率对比曲线;(b)成功率对比曲线

Fig. 6. Precisions and success rates for 8 tracking algorithms on OTB50. (a) Precision comparison; (b) success rate comparison

图 7. 8种跟踪算法在OTB100上的精确率和成功率。(a)精确率对比曲线;(b)成功率对比曲线

Fig. 7. Precisions and success rates of 8 tracking algorithms on OTB100. (a) Precision comparison; (b) success rate comparison

结合

图 8. 8种跟踪方法在部分序列上的跟踪结果

Fig. 8. Tracking results of 8 tracking algorithms in partial sequences

BlurOwl序列中目标具有运动模糊以及快速运动的属性,在第10帧到第388帧的跟踪过程中,目标在平面内快速运动,部分跟踪算法逐渐漂移,尤其在第156帧时,只有ECO算法、STRCF算法以及本文算法能精确地跟踪到目标位置,经历运动模糊过程后(第470帧、第631帧),仅有STRCF算法与本文算法在尺度和位置上可精确地定位目标,其中STRCF算法在第470帧时发生了轻度漂移,表明本文算法对于快速运动和运动模糊的情形具有稳健性。

在Couple序列对目标跟踪的过程中(第10帧、第140帧),目标所处的背景比较杂乱且目标的姿态不断变化,导致跟踪器跟丢目标或无法准确跟踪目标。在第47帧和第108帧中,STAPLE、SAMF以及fDSST算法因背景干扰未能正确跟踪目标,ECO算法因为目标尺度的不断变化,不能精确地定位目标的尺度。在第140帧中,STRCF算法被相似目标吸引导致错误地跟踪了目标,只有BACF算法与本文算法成功地跟踪了目标,表明本文算法在背景杂乱与尺度变化时具有稳定性,有效地实现了对目标的跟踪。

Skiing序列中显示的是目标在光照变化和变形的情况下,8种跟踪算法的跟踪效果。从第2帧到第81帧的跟踪过程中,除了ECO算法与本文算法外,其余算法均在第16帧时发生了漂移且无法再次跟踪到目标。在第33帧时,由于目标发生了变形,ECO算法未能精确定位目标的位置,仅本文算法准确地跟踪到目标,表明本文选择特征的方法对光照变化以及变形具有较强的适应能力,跟踪较为稳定。

Bird2序列中的目标存在遮挡与平面外旋转的情况,在第49帧时,只有本文算法准确地跟踪到目标,其他跟踪算法由于部分遮挡发生了不同程度的漂移,除ECO算法外,其他方法由于在漂移过程中学习了大量的背景信息,导致跟丢目标(第61帧、第83帧)。在第98帧时,STRCF、SAMF以及fDSST跟踪算法丢失目标后无法重新检测跟踪到目标,本文算法通过在跟踪过程中采用特征点匹配机制,一定程度上克服了部分遮挡的影响,准确地跟踪到了目标。

Bolt2序列与Football1序列中目标背景比较复杂,同时目标在平面内快速运动并存在大量相似目标的干扰。其中Bolt2序列中,由于在目标的快速运动过程中,SAMF算法与fDSST算法中的跟踪器对于错误的跟踪结果没有可靠性判定,导致目标逐渐跟踪错误(第25帧、第88帧)。STRCF算法由于相似目标的干扰,在第182帧时错误地跟踪了目标。在对Football1序列的跟踪过程中,目标还存在平面内旋转的属性。跟踪过程中目标经过快速运动和旋转后,在第74帧时,只有本文跟踪算法能长期、稳定地跟踪到目标。本文通过在跟踪过程中引入可信度策略,对每帧的跟踪结果进行可靠性判定,增强了跟踪器对于错误跟踪结果的判别能力,从而提高了跟踪的准确性。

5.2.2 时效性分析

8种算法在OTB50和OTB100数据集上的平均运行速度见

表 5. 8种跟踪算法平均跟踪速度比较

Table 5. Average tracking speed comparison among 8 tracking algorithms

| ||||||||||||||||||||||||||||||

6 结论

本文算法使用不同的权重分配方式融合两种基础特征,从多样化的融合特征中选择可信度最大的特征,将其作为目标的跟踪特征对目标进行跟踪,同时提出了一个基于GMS特征点匹配的检测器,用于重新检测。通过将多样的特征融合方式与高置信度选择策略相结合,增强了模型对于目标以及背景变化的适应能力;当选择的特征可信度较低时,根据特征点匹配的结果对目标进行重新检测,实现对目标稳定、准确的跟踪。上述实验结果表明,本文跟踪算法的跟踪速度基本满足实时性的要求,有效地提高了目标跟踪的准确性和稳健性,尤其对于快速运动、运动模糊、光照变化等场景具有良好的性能。本文算法没有更多地考虑大面积遮挡对模型的影响,因此下一步的工作重点是将遮挡考虑在内,以进一步提高目标跟踪效果。

[1] Zhang TZ, Xu CS, Yang MH. Multi-task correlation particle filter for robust object tracking[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 4819- 4827.

Zhang TZ, Xu CS, Yang MH. Multi-task correlation particle filter for robust object tracking[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 4819- 4827.

[2] 赵高鹏, 沈玉鹏, 王建宇. 基于核循环结构的自适应特征融合目标跟踪[J]. 光学学报, 2017, 37(8): 0815001.

赵高鹏, 沈玉鹏, 王建宇. 基于核循环结构的自适应特征融合目标跟踪[J]. 光学学报, 2017, 37(8): 0815001.

[3] 张哲, 孙瑾, 杨刘涛. 融合相关滤波与关键点匹配的跟踪算法[J]. 光学学报, 2019, 39(2): 0215001.

张哲, 孙瑾, 杨刘涛. 融合相关滤波与关键点匹配的跟踪算法[J]. 光学学报, 2019, 39(2): 0215001.

[4] 葛宝义, 左宪章, 胡永江. 基于特征融合的长时目标跟踪算法[J]. 光学学报, 2018, 38(11): 1115002.

葛宝义, 左宪章, 胡永江. 基于特征融合的长时目标跟踪算法[J]. 光学学报, 2018, 38(11): 1115002.

[5] 卢湖川, 李佩霞, 王栋. 目标跟踪算法综述[J]. 模式识别与人工智能, 2018, 31(1): 61-76.

卢湖川, 李佩霞, 王栋. 目标跟踪算法综述[J]. 模式识别与人工智能, 2018, 31(1): 61-76.

Lu H C, Li P X, Wang D. Visual object tracking: a survey[J]. Pattern Recognition and Artificial Intelligence, 2018, 31(1): 61-76.

Lu H C, Li P X, Wang D. Visual object tracking: a survey[J]. Pattern Recognition and Artificial Intelligence, 2018, 31(1): 61-76.

[6] Bolme DS, Beveridge JR, Draper BA, et al. Visual object tracking using adaptive correlation filters[C]//2010 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, June 13-18, 2010, San Francisco, CA, USA. New York: IEEE, 2010: 2544- 2550.

Bolme DS, Beveridge JR, Draper BA, et al. Visual object tracking using adaptive correlation filters[C]//2010 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, June 13-18, 2010, San Francisco, CA, USA. New York: IEEE, 2010: 2544- 2550.

[7] Henriques JF, CaseiroR, MartinsP, et al. Exploiting the circulant structure of tracking by detection with kernels[M] //Fitzgibbon A, Lazebnik S, Perona P, et al. Computer Vision-ECCV 2012. Berlin, Heidelberg: Springer, 2012, 7575: 702- 715.

Henriques JF, CaseiroR, MartinsP, et al. Exploiting the circulant structure of tracking by detection with kernels[M] //Fitzgibbon A, Lazebnik S, Perona P, et al. Computer Vision-ECCV 2012. Berlin, Heidelberg: Springer, 2012, 7575: 702- 715.

[9] DanelljanM, HägerG, KhanF, et al.Accurate scale estimation for robust visual tracking[C]//British Machine Vision Conference 2014, September 1-5, 2014, Nottingham. Durham, England,UK: BMVA Press, 2014: 65.

DanelljanM, HägerG, KhanF, et al.Accurate scale estimation for robust visual tracking[C]//British Machine Vision Conference 2014, September 1-5, 2014, Nottingham. Durham, England,UK: BMVA Press, 2014: 65.

[10] BertinettoL, ValmadreJ, GolodetzS, et al. Staple: complementary learners for real-time tracking[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 1401- 1409.

BertinettoL, ValmadreJ, GolodetzS, et al. Staple: complementary learners for real-time tracking[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 1401- 1409.

[11] TangM, Feng JY. Multi-kernel correlation filter for visual tracking[C]//2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 3038- 3046.

TangM, Feng JY. Multi-kernel correlation filter for visual tracking[C]//2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 3038- 3046.

[13] Danelljan M, Häger G, Khan F S, et al. Discriminative scale space tracking[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(8): 1561-1575.

Danelljan M, Häger G, Khan F S, et al. Discriminative scale space tracking[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(8): 1561-1575.

[14] PosseggerH, MauthnerT, BischofH. In defense of color-based model-free tracking[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA. New York: IEEE, 2015: 2113- 2120.

PosseggerH, MauthnerT, BischofH. In defense of color-based model-free tracking[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA. New York: IEEE, 2015: 2113- 2120.

[15] Wang MM, LiuY, Huang ZY. Large margin object tracking with circulant feature maps[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 4800- 4808.

Wang MM, LiuY, Huang ZY. Large margin object tracking with circulant feature maps[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 4800- 4808.

[16] Bian JW, Lin WY, MatsushitaY, et al. GMS: grid-based motion statistics for fast, ultra-robust feature correspondence[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 2828- 2837.

Bian JW, Lin WY, MatsushitaY, et al. GMS: grid-based motion statistics for fast, ultra-robust feature correspondence[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 2828- 2837.

[17] WuY, LimJ, Yang MH. Online object tracking: a benchmark[C]//2013 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2013, Portland, OR, USA. New York: IEEE, 2013: 2411- 2418.

WuY, LimJ, Yang MH. Online object tracking: a benchmark[C]//2013 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2013, Portland, OR, USA. New York: IEEE, 2013: 2411- 2418.

[18] Wu Y, Lim J, Yang M H. Object tracking benchmark[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(9): 1834-1848.

Wu Y, Lim J, Yang M H. Object tracking benchmark[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(9): 1834-1848.

[19] LiY, Zhu JK. A scale adaptive kernel correlation filter tracker with feature integration[M] //Agapito L, Bronstein M, Rother C. Computer Vision-ECCV 2014 Workshops. Cham: Springer, 2015, 8693: 254- 265.

LiY, Zhu JK. A scale adaptive kernel correlation filter tracker with feature integration[M] //Agapito L, Bronstein M, Rother C. Computer Vision-ECCV 2014 Workshops. Cham: Springer, 2015, 8693: 254- 265.

[20] DanelljanM, HägerG, Khan FS, et al. Learning spatially regularized correlation filters for visual tracking[C]//2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 4310- 4318.

DanelljanM, HägerG, Khan FS, et al. Learning spatially regularized correlation filters for visual tracking[C]//2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 4310- 4318.

[21] Galoogahi HK, FaggA, LuceyS. Learning background-aware correlation filters for visual tracking[C]//2017 IEEE International Conference on Computer Vision (ICCV), October 22-29, 2017, Venice, Italy. New York: IEEE, 2017: 1144- 1152.

Galoogahi HK, FaggA, LuceyS. Learning background-aware correlation filters for visual tracking[C]//2017 IEEE International Conference on Computer Vision (ICCV), October 22-29, 2017, Venice, Italy. New York: IEEE, 2017: 1144- 1152.

[22] LiF, TianC, Zuo WM, et al. Learning spatial-temporal regularized correlation filters for visual tracking[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, June 18-23, 2018, Salt Lake City, UT, USA. New York: IEEE, 2018: 4904- 4913.

LiF, TianC, Zuo WM, et al. Learning spatial-temporal regularized correlation filters for visual tracking[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, June 18-23, 2018, Salt Lake City, UT, USA. New York: IEEE, 2018: 4904- 4913.

[23] DanelljanM, BhatG, Khan FS, et al. ECO: efficient convolution operators for tracking[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 6931- 6939.

DanelljanM, BhatG, Khan FS, et al. ECO: efficient convolution operators for tracking[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 6931- 6939.

Article Outline

刘万军, 孙虎, 姜文涛. 自适应特征选择的相关滤波跟踪算法[J]. 光学学报, 2019, 39(6): 0615004. Wanjun Liu, Hu Sun, Wentao Jiang. Correlation Filter Tracking Algorithm for Adaptive Feature Selection[J]. Acta Optica Sinica, 2019, 39(6): 0615004.