基于候选区域定位与HOG-CLBP特征组合的行人检测  下载: 878次

下载: 878次

1 引言

行人检测是计算机视觉领域中的一项关键技术,在视频监控、基于内容的图像(视频)检索、辅助驾驶[1]与运动分析等领域有重要的应用价值。由于行人属于非刚性目标,其姿态和外表多变,因此在图像和视频中检测人体是一项具有挑战性的工作。目前,基于统计学习的检测方法是主流的研究方法之一,其主要任务集中在特征提取和分类检测两个方面。文献[ 2]提出的方向梯度直方图(HOG)特征是构建人体检测模型的最佳特征之一,此后多数行人检测算法[3-5]都是以HOG特征为基础进行改进。文献[ 6]提出了HOG特征与局部二值模式(LBP)[7]相融合的方法,并采用支持向量机(SVM)对特征进行分类检测,该方法可以提高检测精度,但融合后的特征维数过多且检测耗时。针对文献[ 6]的问题,文献[ 8-9]采用主成分分析(PCA)法对HOG-LBP特征进行降维,该过程只是提高了分类预测的速度,但特征提取的时间不变,说明检测速度没有明显改善。上述方法均采用了滑动窗口搜索策略在整幅图像上进行扫描,这会造成复杂度太高,而且会产生很多冗余区域,说明减少检测窗口的数量是提高检测效率的关键。文献[ 10-11]采用了二值化梯度规范特征(BING)方法[12]中的目标候选区域算法对候选区域进行提取,该算法的计算速度很快,但随着交并比阈值的增大,召回率急剧下降,平均召回率很低。选择性搜索算法[13]先基于区域的图像分割算法[14]得到一些原始区域,采用多种特征相似度策略进行分层分组搜索,最终得到的检测率和召回率都很高。

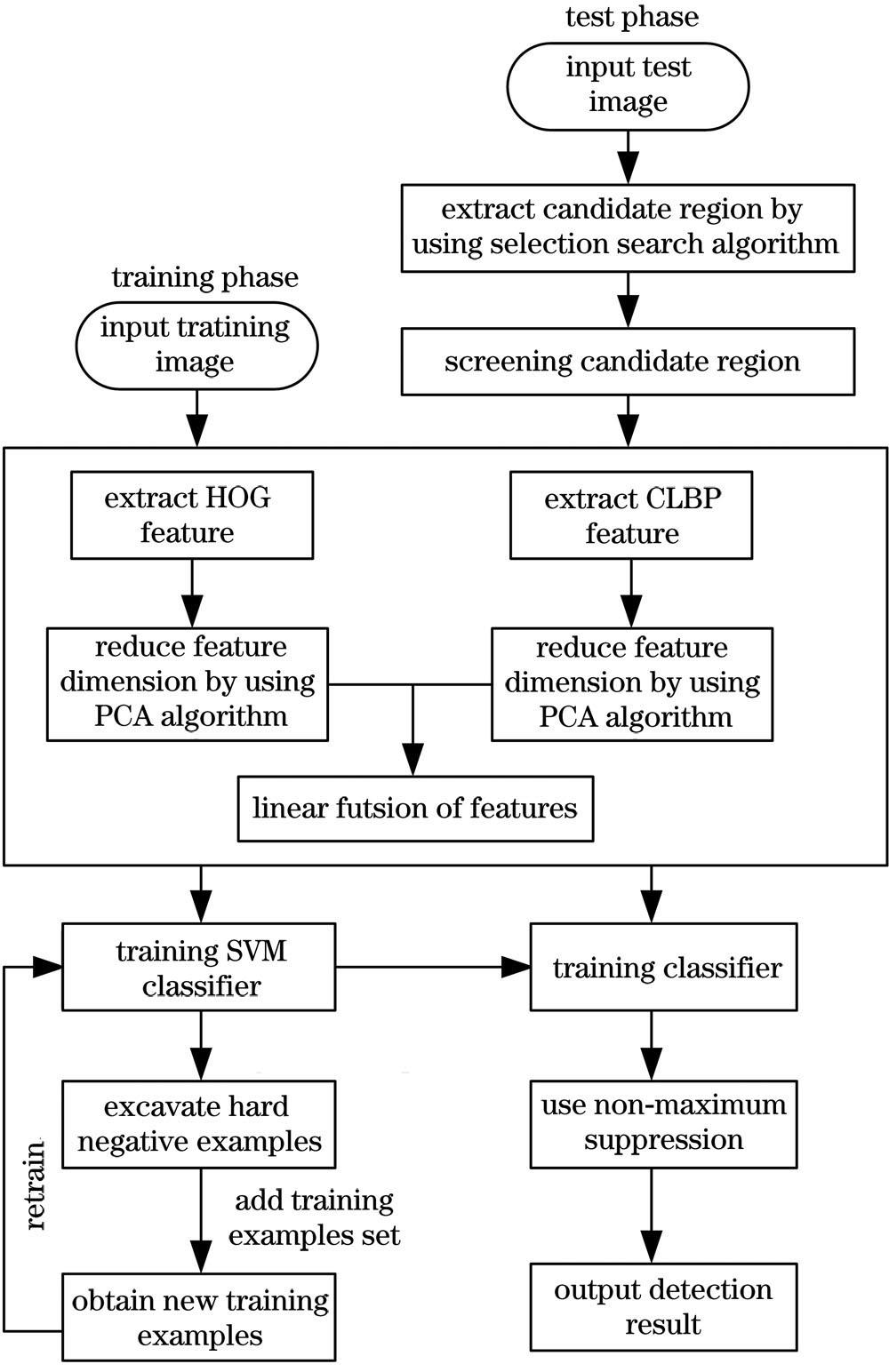

基于以上分析,本文以文献[ 6]的行人检测算法为框架,提出一种基于候选区域定位与HOG-CLBP特征组合的行人检测算法,其中CLBP为完备的局部二值模式。首先采用选择性搜索策略定位图像中可能存在行人的候选区域并对其进行筛选,然后提取目标候选区域的HOG特征与CLBP特征[15],最后采用PCA方法对特征进行降维,降维后串联融合特征并输入训练好的分类器中进行分类。采用所提算法对图像中可能存在目标的窗口进行检测,得到所提算法在保证识别率的基础上可以达到加速的目的。

2 基本原理

2.1 选择性搜索算法提取目标候选区域

选择性搜索算法提取目标候选区域的过程:在不同的颜色空间中,首先采用选择性搜索算法[13]对图像进行超像素分割以创建初始区域;然后利用多种特征相似度策略对超像素进行贪婪融合,计算所有相邻区域的相似度;最后合并相似度最大的两个子区域,并计算结果区域和相邻区域之间的新相似度。重复对最相似区域进行分组的过程,直到整个图像变为单个区域。

采用基于区域的图像分割算法[14]将图像用加权图的形式抽象化表示,相邻像素间的欧氏距离即为加权的欧氏距离,以最小生成树作为依据连接,确定初始分割区域即可获取具有相似特性的区域,但初始分割区域过于精细,难以获取完整目标。通过计算两两相邻区域在颜色、纹理、大小以及吻合度之间的相似度,并利用这些相似度对初始分割区域进行合并。各相似度的计算公式为

式中:i和j表示两个区域的序号;scolor(ri,rj)、stexture(ri,rj)、ssize(ri,rj)和sfill(ri,rj)分别表示相邻区域的颜色、纹理、大小和吻合度的相似度;ri和rj表示图像中的不同区域;nc表示颜色直方图的个数;

式中:Ct表示合并后区域的颜色向量;Ci和Cj分别表示区域ri和区域rj的颜色向量。各区域间的相似度可表示为

式中:a表示相似度度量,此时a值均为1。

2.2 候选区域筛选

针对行人目标的检测,由行人的外观形状特点可知,包含行人的候选区域的高度和宽度具有固定的比例关系,因此不必考虑高宽比的变化。通过将候选区域的高宽比限制在一定的范围内来筛选候选窗口,可以进一步减少无效窗口的数量,表达式为

式中:h和w分别表示候选窗口的高度和宽度;μ1和μ2分别表示高宽比的下限和上限,此时μ1=2.13,μ2=3.80。

2.3 HOG特征提取

HOG特征[2]是一种基于形状边缘特征的描述算子,广泛用于行人检测,其构建过程主要分为以下几个步骤。

1) 对检测窗口进行颜色空间归一化,以减少由光照及背景带来的影响。

2) 使用一维离散微分模板[-1 0 1]和[-1 0 1]T对图像进行水平和垂直方向上的梯度运算,可以得到梯度幅值和梯度方向,表达式为

式中:G、θ和H分别表示梯度幅值、梯度方向和像素值;(x,y)表示图像中的像素点坐标。

3) 将目标窗口分成互不重叠且大小相同的细胞单元,然后计算每个细胞单元的梯度信息,将像素的梯度方向在0°~180°的角度范围内平均分为9个区间并对其进行直方图统计。

4) 将几个细胞单元组合成块,对组合成块的梯度直方图采用L2常规范数进行归一化处理,表达式为

式中:V1和V分别表示归一化后和未经归一化的描述子向量;‖V‖2表示V的2范数;ε表示无穷小的常数。

2.4 CLBP特征提取

当图像背景较为复杂时,仅描述梯度信息的HOG特征,而且分类器的稳健性较差,不能得到较好的检测效果,而CLBP算子[15]与HOG特征融合后可以显著提高检测性能。CLBP算子的局部区域由其中心像素和局部差分符号幅度变换来表示。中心像素在全局阈值化后,即CLBP_Center(CLBP_C),采用二进制字符串对其进行编码。将局部差分符号幅度变换分解为差值符号和差值幅度两个互补的结构成分,即CLBP-Sign(CLBP_S)和CLBP-Magnitude(CLBP_M),并对其进行编码。对于图像上的某个像素点(xc,yc),则

式中:P表示中心点像素邻域内的采样点个数;R表示邻域半径;gc表示中心点的像素灰度值;gp表示第p个与中心点相邻像素点的灰度值;N表示窗口数;gN表示在中心点不断移动时关于gc的灰度均值,

旋转不变的均匀模式用

2.5 SVM分类器训练

行人检测可以看作一个二分类问题,使用SVM[17]对图像进行分类以判断图像中是否存在行人。为了提升分类效果,训练过程中挑选困难负样本来降低误检率,表达式为

式中:xm表示第m个样本的特征向量;ym表示第m个样本的标签;M表示总样本数;β(xm)表示xm的判别模型;H(β,M)表示被错误分类或离分界面近的样本。在初始样本集上生成初始模型以挖掘困难负样本,将错误分类后的样本加入初始样本集中并对模型进行更新,可以得到更好的判别模型。

3 算法实现步骤

基于候选区域定位与HOG-CLBP特征组合的行人检测算法流程如

算法的具体实现步骤如下。

1) 输入训练图像,将图像的尺寸归一化为64 pixel×128 pixel,采用(5)式和(6)式在水平和垂直方向上计算HOG特征。选取尺寸为8 pixel×8 pixel作为一个细胞单元,每2×2个细胞单元组成一个区间块,窗口移动步长为8 pixel,则梯度方向分为9个区间。采用(7)式归一化区域块内的HOG特征向量,可以提取到3780维特征,采用PCA算法[9]来获取低维特征,特征维数由实验确定。

2) 设置P=8,R=1,采用(8)式计算得到200维CLBP特征向量,采用PCA[9]算法来获取低维特征,特征维数由实验确定。

3) 将分别降维后的HOG特征和CLBP特征串联融合,并输入SVM中得到初始模型。进入再训练阶段,采用(10)式以迭代的方式挖掘困难负样本并添加到训练样本集中更新模型。

4) 输入测试图像,采用选择性搜索策略中基于区域的图像分割算法生成初始区域,采用(3)式计算各区域的相似度,合并相似度最大的区域以生成目标候选窗口。

5) 将目标候选窗口的高宽比限制在2.13~3.80之间,进一步排除无用窗口,从而得到最终的行人候选区域。

6) 在行人候选区域中提取HOG特征和CLBP特征,分别降维后对其进行串联融合。

7) 利用训练好的分类器对候选区域进行检测以获取行人的位置,并使用外接矩形框来标记。

8) 窗口按照分类器的分数进行排序,使用非极大值抑制将重复率超过70%的窗口删除。

4 实验结果与分析

4.1 候选区域生成

实验运行平台为Inter(R) Core(TM) i5-3320M CPU @2.60 GHz,4.00 GB的RAM,64位操作平台,使用的软件为MATLAB R2017a。为了测试所提算法的性能,在INRIA行人图像数据库中进行实验,该数据库中覆盖不同环境下姿态各异的行人,其是行人检测领域中公认的标准数据库之一。采用选择性搜索算法提取行人候选区域的参数,确定初始分割区域K=50,合并策略为“C+T+S+F”,使用HSV(Hue, Saturation, Value)颜色空间对目标与背景进行有效区分,其中C为颜色、T为纹理、S为大小以及F为吻合度。

图 2. 不同方法生成的候选区域窗口。(a)选择性搜索策略;(b)限制高宽比

Fig. 2. Candidate region windows generated by different methods. (a) Selective search strategy; (b) restriction of aspect ratio

从

4.2 特征维数选取

高维的HOG特征向量和CLBP算子中存在大量的冗余信息,直接串联融合不仅给分类速度带来极大的负担,甚至降低识别率。利用文献[

9]的主成分分析法分别对HOG特征和CLBP算子进行降维,降维后的HOG特征和CLBP算子分别表示为PCA-HOG和PCA-CLBP,降维后的结果如

表 1. PCA-HOG在不同的维度下的识别率和识别速度

Table 1. Recognition rate and recognition speed of PCA-HOG in different dimensions

|

表 2. PCA-CLBP在不同维度下的识别率和识别速度

Table 2. Recognition rate and recognition speed of PCA-CLBP in different dimensions

|

图 3. PCA-HOG在不同维度下的识别率和时间。(a)识别率;(b)时间

Fig. 3. Recognition rate and time of PCA-HOG in different dimensions. (a) Identification rate; (b) time

图 4. PCA-CLBP在不同维度下的识别率和时间。(a)识别率;(b)时间

Fig. 4. Recognition rate and time of PCA-CLBP in different dimensions. (a) Identification rate; (b) time

4.3 性能评价

评价指标采用DET(Detection Error Tradeoff)曲线来评价行人目标的检测结果[19]。

为了对所提算法进行量化分析,

其中:I表示算法识别率;xTP表示判断为正样本实际为正样本的个数;xFN表示判断为负样本实际为正样本的个数。xTP与xFN的和为样本总数。

表 3. 不同算法的识别率和识别速度

Table 3. Recognition rate and recognition speed of different algorithms

|

从

5 结论

基于HOG-LBP特征的行人检测算法在整幅图像上利用滑动窗口进行穷举搜索,这会产生大量的冗余区域,并且检测速度慢。鉴于此,引入选择性搜索策略快速生成行人目标候选区域,并根据行人具有的固定高宽比这一特点,可以有效地降低无效窗口的数量,为后续的行人检测识别工作提供基础。与通过改变窗口的尺寸来适应图像中不同尺度行人的方式相比,选择性搜索算法中基于图的区域分割算法和合并策略可以有效地适应图像中多个尺度行人的检测识别。为了弥补LBP算子在纹理表达上的缺陷,采用CLBP算子提取纹理特征,相比LBP在表达纹理结构时只考虑差值符号的特点,CLBP算子可以同时考虑差值幅度和中心像素,而且纹理表达得更充分。采用PCA算法获取低维的HOG特征和CLBP特征,在保证准确性的前提下可以减少SVM的分类负担,提高算法的识别速度,训练SVM的过程中引入困难负样本的挖掘过程优化模型以降低误检率。实验结果表明,在保证识别率的基础上,所提算法在识别速度上有明显的提升。所提算法针对遮挡情况的行人检测问题,仍需要进一步研究。

[1] 诸葛琳娜, 张磊. 基于移动平台热成像的行人检测随机蕨分类器[J]. 激光与光电子学进展, 2018, 55(1): 013301.

[2] DalalN, TriggsB. Histograms of oriented gradients for human detection[C]∥2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR'05), June 20-25, 2005, San Diego, CA, USA. New York: IEEE, 2005: 886- 893.

[3] 黄炎, 范赐恩, 朱秋平, 等. 联合梯度直方图和局部二值模式特征的人体检测[J]. 光学精密工程, 2013, 21(4): 1047-1053.

[4] Watanabe T, Ito S, Yokoi K. Co-occurrence histograms of oriented gradients for human detection[J]. IPSJ Transactions on Computer Vision and Applications, 2010, 2: 39-47.

[5] 杨萌, 张葆, 宋玉龙. 基于优化核函数支持向量机在行人检测中的应用[J]. 激光与光电子学进展, 2018, 55(4): 041001.

[6] Wang XY, Han TX, Yan SC. An HOG-LBP human detector with partial occlusion handling[C]∥2009 IEEE 12th International Conference on Computer Vision, September 29-October 2, 2009, Kyoto, Japan. New York: IEEE, 2009: 32- 39.

[7] MuY, YanS, LiuY, et al. Discriminative local binary patterns for human detection in personal album[C]∥2008 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2008, Anchorage, AK, USA. New York: IEEE, 2008: 10140104.

[8] Zeng CB, Ma HD. Robust head-shoulder detection by PCA-based multilevel HOG-LBP detector for people counting[C]∥2010 20th International Conference on Pattern Recognition, August 23-26, 2010, Istanbul, Turkey. New York: IEEE, 2010: 2069- 2072.

[9] Wold S, Esbensen K, Geladi P. Principal component analysis[J]. Chemometrics and Intelligent Laboratory Systems, 1987, 2(1/2/3): 37-52.

[10] 郭晓鹏, 杜劲松, 白珈郡, 等. 基于BING似物性检测的行人快速检测算法[J]. 计算机应用研究, 2018, 35(11): 3458-3461.

Guo X P, Du J S, Bai J J, et al. Fast human detection algorithm based on BING objectness[J]. Application Research of Computers, 2018, 35(11): 3458-3461.

[11] 刘倩, 李策, 杨峰, 等. 基于似物目标的快速行人检测算法[J]. 计算机应用研究, 2019, 36(7): 2219-2222.

Liu Q, Li C, Yang F, et al. Rapid pedestrian detection based on generic object generation[J]. Application Research of Computers, 2019, 36(7): 2219-2222.

[12] Cheng M M, Liu Y, Lin W Y, et al. BING: binarized normed gradients for objectness estimation at 300 fps[J]. Computational Visual Media, 2019, 5(1): 3-20.

[14] Felzenszwalb PF, Huttenlocher DP. Efficient graph-based image segmentation[M]. New York: ACM, 2004.

[15] Guo Z H, Zhang L, Zhang D. A completed modeling of local binary pattern operator for texture classification[J]. IEEE Transactions on Image Processing, 2010, 19(6): 1657-1663.

[16] LiuC, SharanL, Adelson EH, et al. Exploring features in a Bayesian framework for material recognition[C]∥2010 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, June 13-18, 2010, San Francisco, CA, USA. New York: IEEE, 2010: 239- 246.

[17] MajiS, Berg AC, MalikJ. Classification using intersection kernel support vector machines is efficient[C]∥2008 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2008, Anchorage, AK, USA. New York: IEEE, 2008: 10139935.

[18] 赵斌, 王春平, 付强, 等. 基于深度注意力机制的多尺度红外行人检测[J]. 光学学报, 2020, 40(5): 0504001.

[20] Schwartz WR, KembhaviA, HarwoodD, et al. Human detection using partial least squares analysis[C]∥2009 IEEE 12th International Conference on Computer Vision, September 29-October 2, 2009, Kyoto, Japan. New York: IEEE, 2009: 24- 31.

[21] PaisitkriangkraiS, Shen CH, Hengel A V D. Efficient pedestrian detection by directly optimizing the partial area under the ROC curve[C]∥2013 IEEE International Conference on Computer Vision, December 1-8, 2013, Sydney, NSW, Australia. New York: IEEE, 2013: 1057- 1064.

[22] FelzenszwalbP, McAllester D, Ramanan D. A discriminatively trained, multiscale, deformable part model[C]∥2008 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2008, Anchorage, AK, USA. New York: IEEE, 2008: 10139902.

[23] 张亚须, 龙晖, 云利军. 基于改进DPM模型的行人检测方法研究[J]. 大理大学学报, 2018, 17(6): 13-18.

Zhang Y X, Long H, Yun L J. Research on pedestrian detection method based on improved DPM model[J]. Journal of Dali University, 2018, 17(6): 13-18.

Article Outline

尧佼, 于凤芹. 基于候选区域定位与HOG-CLBP特征组合的行人检测[J]. 激光与光电子学进展, 2021, 58(2): 0210015. Jiao Yao, Fengqin Yu. Pedestrian Detection Based on Combination of Candidate Region Location and HOG-CLBP Features[J]. Laser & Optoelectronics Progress, 2021, 58(2): 0210015.