基于多特征的彩色唐卡修复图像无参考质量评价方法  下载: 970次

下载: 970次

1 引言

唐卡即卷轴画,是藏传佛教独具特色的一种艺术表达形式,由于其自身包含丰富的历史底蕴与民族特色,在2006年被联合国列入非物质文化遗产名录中。考虑到唐卡绘制的主要原材料为矿石、珊瑚和草药等易被腐蚀的纯天然物质,风化氧化均会使唐卡卷轴表面出现大面积色彩块的脱落与结构线条的断裂,如何保存其完整性成为近代学者们需要解决的难题之一[1]。随着国内外博物馆和收藏者对唐卡的青睐程度的不断上升,唐卡保护与修复研究的重要性也更加凸显[2]。至今为止,计算机技术的不断发展使得数字图像修复技术逐渐取代传统手工修复方法,成为保护古代书籍、帛画等文物的主要手段[3-9]。虽然现存的唐卡图像修复方法在算法种类、效果和运行时间上都有很大的提升,例如全变分(TV)模型和样本块模型[4]。但是修复后的唐卡图像具有不可逆转性,如果修复出现错误可能造成无法挽回的损失[3]。所以修复后唐卡图像的质量仍是文物保护学者考虑的首要因素之一。

近年来,图像质量评价方法(IQA)主要分为依靠人眼视觉感知的主观评价方法和利用计算机模拟人类视觉系统(HVS)的客观评价方法,其中客观方法又根据算法依赖原始图像信息的程度分为全参考、半参考和无参考三种类型。考虑到主观评价方法耗时长、花费多且会受到观察者心理和生活背景等因素影响而导致评价分数起伏不定,客观评价算法逐渐成为获取图像质量分数的主要途径。由于人眼对于修复图像与破损图像中纹理结构的兴趣点并不相同,例如修复图像质量并不局限于修复区域的复原效果,同时还要考虑全局视觉因素,导致现存的传统方法并不适用于修复图像质量评价工作[10]。为解决此类问题,Qureshi等[11]提出一种针对修复图像质量的评价方法(IIQA),其主要界定了修复图像质量评价工作的整体框架,为IIQA的发展奠定了基础。此后,文献[ 12]提出一种基于机器视觉统计的修复图像质量评价方法,结合LAB颜色空间与机器视觉模拟数据,并利用统计学的方法计算修复后图像质量分数。文献[ 13]在已有的图像质量评价方法上加入卷积神经网络模型,其效果比原方法更加明显。考虑到大部分目标图像存在缺少或没有原始信息的情况,文献[ 14]主要分析修复图像与原始图像之间的特征显著图差异,提出了两种针对修复图像的无参考评价算法:视觉特征均方差(ASVS)和视觉兴趣差异(DN)。其中ASVS利用修复与原始区域的视觉相关性之间的差异对修复图像质量进行评分;DN则主要观察修复区域与原始区域之间特征变化的差值,结合特征显著图预测质量分数[10]。图像修复质量评价工作已经取得了很大的进展,然而上述方法主要针对自然修复图像。考虑到与自然图像相比,唐卡边缘和色彩特征更加复杂,而且很多情况下并没有原始图像作为参考,文献[ 15]及文献[ 16]分别提出了基于结构或色彩等单一特征的彩色唐卡图像质量评价算法。目前,该类方法已经表现出了较好的效果,但其主要针对单一特征,很难反映图像的全局纹理特性。为了避免单一特征的局限性,本文提出一种基于多特征的彩色唐卡修复图像质量评价方法。

本文算法主要解决如何充分利用唐卡图像丰富的边缘和色彩特征的问题,结合唐卡线描图及色彩熵特征进行修复后的图像质量预测。具体工作思路为:首先利用高斯差分(DOG)算子得到唐卡线描特征图[17];然后考虑到唐卡图像的对称特性,例如佛像、坛城等,本文将提取出的线描图进行自动分割并利用图像融合算法将未损区域与修复区域结合,从而解决了在缺少原始信息的情况下,如何预测无损图像的问题;其次通过提取色彩熵特征[18],力图感知图像修复前后的色彩变化差异;最后利用拉普拉斯金字塔将修复图像下采样[19],将提取出的边缘和色彩熵分解为10维特征,并结合自适应增强神经网络BP-AdaBoost进行回归预测[20]。所提出的模型在唐卡修复图像数据库上进行实验,结果表明,本文算法与主观评价方法预测值一致,其皮尔逊相关系数(PLCC)与斯皮尔曼相关系数(SROCC)值均在0.94左右。

2 面向修复后唐卡图像的特征提取研究

2.1 结构特征

考虑到人眼是图像的最终接受者,且破损图像和修复图像的视觉敏感点有很大的差异,如何寻找更加符合修复图像质量评价的特征就成为了当代学者研究的重点[11]。分析现存图像修复方法可知,不同算法对于结构及高频信息的复原效果差异较大。其次在修复过程中,部分算法通常采用平滑和滤波等方法,对于低频信息的保护具有有效性,但可能导致高频信息的“二次破坏”。结合唐卡图像结构信息丰富的特点,本文选取DOG算子提取线描图,并利用唐卡对称性结合拉普拉斯金字塔融合预测原始图像,以期获得与人眼视觉特性一致的唐卡修复图像结构特征。

2.1.1 基于DOG算子的唐卡线描图提取

线描是藏族传统绘画的基本手段和主要特色,藏族传统美术无论建筑、雕塑、绘画、工艺都紧密的结合着线的应用,尤其是唐卡绘画艺术[21]。虽然唐卡图像在修复过程中通常采用平滑和滤波等模糊手段,对于部分大面积破损具有较好的修复效果,但却会导致图像线描细节部分的模糊[3]。考虑到唐卡图像丰富的结构特征,本文选取的DOG算子能够很好地提取出修复图像中细微的边缘结构差异,因此适用于很多线描图提取方法中[22],其过程如下。

首先将一幅图像利用高斯函数进行卷积低通滤波,公式为

式中:(x,y)为当前像素点坐标;σ是正态分布的标准偏差, 取值范围[0,1]。

其次对两个相邻高斯尺度空间σ1和σ2的图像进行相减,公式为

唐卡在绘制过程中通常利用刷子、毛笔等工具进行上色,因此在背景区域可能出现上色不均匀导致的假性边缘,如果利用普通的阈值法并不能将其与真实线描边缘区分。为解决该问题,本文采用一种更加复杂的风格化阈值函数E来区分边缘值与非边缘值[23],公式为

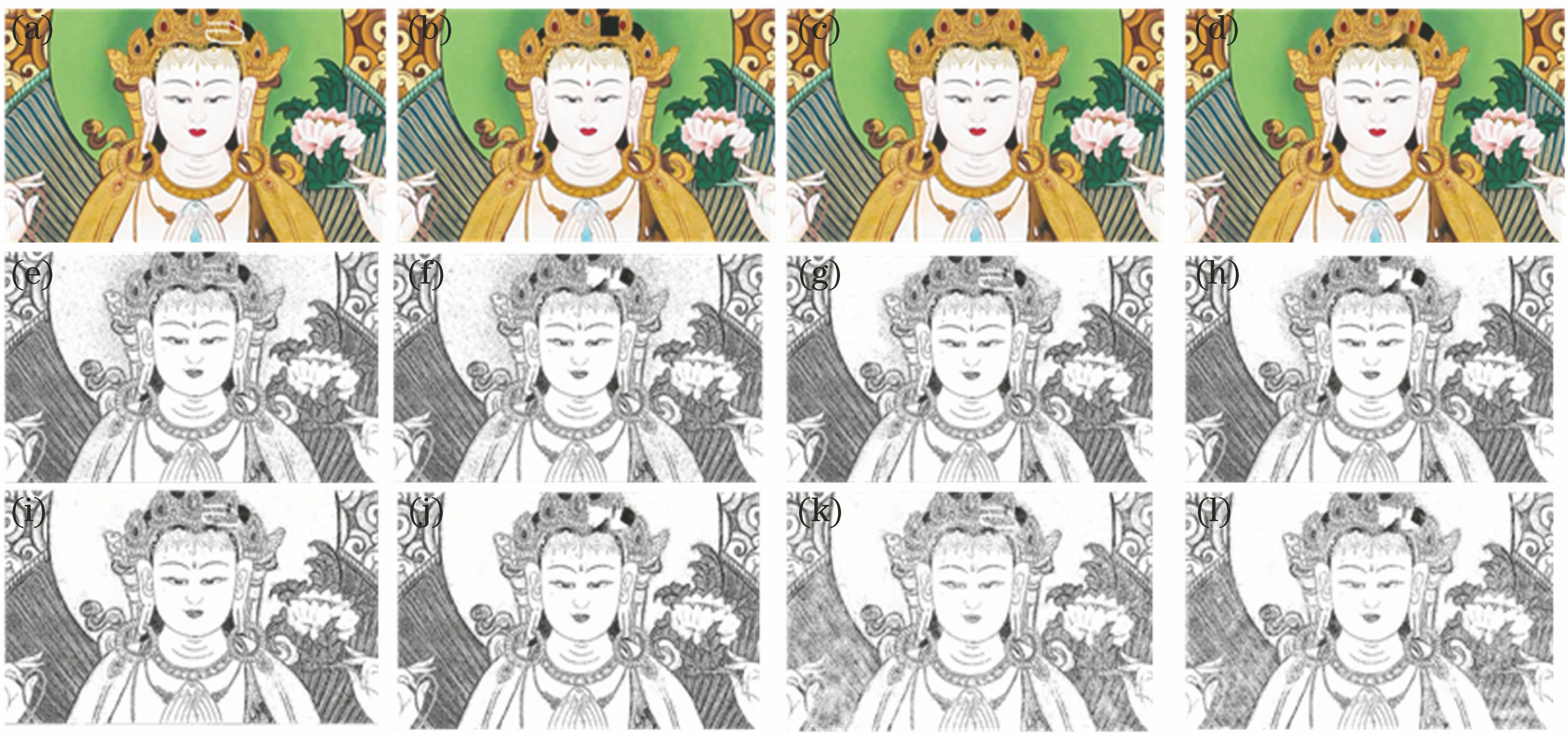

式中:tanh(x)为双曲正切函数;φ为风格化阈值参数,通过实验对比一般取1.6。效果如

图 1. 唐卡修复图像线描图提取及风格化阈值效果图。(a)唐卡划痕破损图像;(b)唐卡块状破损图像;(c)样本块修复效果图;(d)TV修复效果图;(e)(f)普通DOG算子线描效果图;(g)(h),(i)(j),(k)(l)风格化阈值线描效果图,其中φ值依次为1.2, 1.6和2.0

Fig. 1. Line drawing of inpainting Thangka image and threshold effect images. (a) Scratch damaged of Thangka image; (b) massive damaged of Thangka image; (c) inpainting image based on sample block-based model; (d) inpainting image based on TV model ; (e)(f)line drawing of DOG operator; (g)(h), (i)(j), (k)(l) threshold effect image, φ=1.2, 1.6, and 2.0,respectively

2.1.2 对称特性分析

唐卡图像的种类主要分为佛像、坛城和历算天文图等。与自然图像不同,唐卡的绘制严格遵循古法流传下来的规则,例如构图的整一律、佛像对称及黄金律。据统计,符合此绘制方法的图像大约占据现存唐卡的80%以上[24]。考虑到唐卡图像的对称特性,本文利用文献[ 25]提出的图像对称轴检测方法将2.1.1节提取出的唐卡修复线描图进行对称分割。最后利用图像融合方法预测原始图像,从而解决破损唐卡没有原始真迹的问题。过程如下。

1)多尺度模板。设置一个长为3a,宽为b的矩形模板AGHB,其中心点坐标与唐卡图像中点一致。然后旋转中线分别得到与水平线呈30°、60°和90°的3个大小相等的矩形,并将其逐个分割为长a宽b的3个矩形ACDB、CEFD和EGHF。通过设计覆盖多角度唐卡图像的模板,从而实现不同尺度下计算图像特征的作用。

2)对称点检测。计算出矩形ACDB,CEFD和EGHF底层描述算子的直方图R1、R2和R3。最后采用χ2-distance函数计算出它们的底层描述子的直方图之间的距离,具体计算如下,

式中:s代表不同的尺度。对照唐卡图像的特征主要选择亮度L、颜色C及纹理T三种尺度,角度θ采用矩形旋转的30°、60°和90°进行对称轴的检测。

3)利用拉普拉斯图像融合将左右对称两幅图像进行融合。考虑到拉普拉斯图像融合方法可以有效的重建图像高频信息,首先将左右对称分割后的两幅图像A、B进行五层金字塔分解,其次依次进行对应层融合,顶层N融合公式为

式中:G为以A、B图像内像素(x,y)为中心,区域大小为M×N的区域平均梯度,且M,N<3。Ix与Iy分别为像素(x,y)在x与y方向上的一阶差分。其余4层融合公式为

式中:L为分解层数;EARE与EBRE分别为左右对称图像的区域能量函数;p=1,q=1,ω=

2.1.3 量化结构差异

最后为了量化结构特征与修复图像质量之间的关系,分别统计出修复线描图像与预测线描图像中表征结构特征信息的像素点个数Ni和Np,利用其比例关系预测图像质量,公式为

式中:Nstructure为基于结构特征的评价指标。即Nstructure越大,修复图像与预测图像中轮廓的相似度越高,则其质量越高;反之,则线描区域的连贯性越不完整,图像质量越差。

2.2 色彩特征

在唐卡图像中,色彩的运用是画师表现其情感与灵魂的重要工具之一。因此,针对颜色细节丢失的复原效果评价同样是数字化保护工作的重要课题之一。考虑到唐卡图像色彩均匀,且不同色彩之间呈块状分布,文献[ 15]提出一种基于超像素的彩色唐卡图像质量评价方法。其主要利用简单线性迭代聚类(SILC)超像素将唐卡色彩相似像素进行区域分割,同时结合色彩熵计算不同超像素之间的熵值变化。熵值越大,相邻区域间的色彩相似性越小,图像色彩存在降质的可能性就越大。其过程分为以下步骤。

1)超像素分割。考虑到LAB色彩空间更加符合人眼视觉特性,本文利用SILC将目标图像进行超像素分割,并计算每个超像素区域的色彩特征值,公式为

式中:(g,h)为超像素中心坐标;v为每个超像素中包含的像素个数;D'为上文中颜色距离与空间距离归一化之后的距离度量。

2)初始色彩熵计算。通过k个超像素区域的特征值计算一维色彩熵,公式为

式中:

3)信息熵均值滤波。像素的一维信息熵只能表示图像的色彩分布特征,仅对图像求其一维色彩熵并不能准确表示图像质量,为此,本文利用均值滤波器对一维色彩熵进行均值滤波从而提取图像的结构特征值。公式为

利用超像素邻域间色彩熵计算均值来表示此像素的特征值,这样该像素的色彩熵值就是由邻域像素决定,包含了图像的结构信息。

4)初始化指标。综合色彩分布特征与结构特征得出图像质量评价指标Ef。计算公式为

5)指标均衡化。为了使色彩指标与人类视觉更加一致,结合对抗生成网络生成m张相似图像对色彩特征进行训练,公式为

式中:Ef_avg为色彩评价指标。

为了更好地描述色彩熵与唐卡修复图像之间的线性关系,本文选取TV和基于样本块的修复模型分别对划痕和块状破损图像进行修复,对比结果如

图 3. 色彩熵与不同修复图像之间的线性关系图。 (a)块状破损色彩熵变化图;(b)划痕破损色彩熵变化图

Fig. 3. Linear diagram between color entropy and different inpainting image. (a) Color entropy diagram of massive damage; (b) color entropy diagram of scratch damage

对于块状失真,该方法利用超像素将图像进行基于色彩特征的分割,能够很快地将修复块与其他未损区域区分。从

3 一种基于多特征的彩色唐卡修复图像质量评价方法

为了解决2.1及2.2节方法存在的问题,本文采用自适应增强神经网络BP-AdaBoost进行唐卡图像质量分数回归预测,如

考虑到人类视觉系统对图像的感知是多尺度的,因此在评价模型中引入多尺度信息往往能够改善算法的性能[26]。利用拉普拉斯金字塔能够保留图像高频信息的特点,将修复后图像进行5层下采样分解,公式为

式中:i为下采样层数;G为其每层高斯滤波后图像;UP为上采样函数,l5×5为5×5的高斯滤波核。

然后分别提取唐卡分解图像的结构特征和色彩特征,得到10维特征并输入BP-AdaBoost神经网络中,其中fN是利用拉普拉斯金字塔分别对结构与色彩特征下采样后得到的10维特征,并将其作为反向传播(BP)神经网络的输入。该回归方法主要利用m个BP神经网络作为弱分类器,每个BP神经网络分别采用sigmoid函数和径向基函数作为隐藏层。

最后将输出的参数通过联合函数加权处理后,得到最终的强分类器并输出预测分数。设

式中:K为样本个数;f(x)为阈值函数;ε参数设为0.1。m个BP神经网络分类器误差累计相加得到最终误差Ei,

并计算每个BP神经网络的权值αm,

式中:b、c为常数,设为1和0.5。最终联合函数公式为

式中:

4 实验结果

4.1 实验数据库准备

为了验证本文算法的性能,本文从学校美术学院唐卡研究教研组处选取250幅唐卡图像,并生成划痕和块状两种不同的失真图像。利用TV修复模型和样本块修复模型针对每幅破损图像进行修复,通过设定不同的参数得到1000幅不同结果的修复图像如

图 5. 破损唐卡修复效果。(a)划痕失真图像;(b)块状失真图像;(c) TV模型修复图像;(d)样本块修复图像

Fig. 5. Image restoration of damaged Thangka. (a) Scratch damaged of Thangka image; (b) massive damaged of Thangkaimage; (c) repaired image based on TV model; (d) repaired image based on sample block-based model

表 1. 唐卡数据库组成

Table 1. Composition of Thangka database

|

![唐卡数据库中,不同评价算法与其对应的DMOS值的散点图。(a)文献[15]方法;(b)文献[26]方法;(c)文献[16]方法;(d)本文方法](/richHtml/lop/2020/57/8/081105/img_6.jpg)

图 6. 唐卡数据库中,不同评价算法与其对应的DMOS值的散点图。(a)文献[ 15]方法;(b)文献[ 26]方法;(c)文献[ 16]方法;(d)本文方法

Fig. 6. Scatter plots of different evaluation algorithms and corresponding DMOS values on Thangka database. (a) Method in Ref. [15]; (b) method in Ref. [26]; (c) method in Ref. [16]; (d) proposed method

为了保证实验的可观性,将数据库中所有唐卡修复图像随机分成80%的训练样本和20%的测试样本,且两部分没有重合图像。

4.2 算法性能分析

考虑到本文算法与其他同类型修复质量评价方法之间的差异,选取文献[

15]、文献[

16]及文献[

26]算法进行对比。根据4种方法预测的质量评价分数与DMOS评价分数之间的线性相关性计算其与人类视觉系统的一致性,如

从

为了进一步验证本文算法与其他无参考图像质量评价方法针对不同修复类型图像Scratch-TV mode、Massive-Sample block-based model、Scratch-Sample block-based model和Massive-TV mode所表现出的性能优势,选取SROCC和 PLCC迭代1000次后的中值作为性能评价指标,并计算其均值作为综合评价指标All。其数值越接近于1,则表示与主观评价分数的相关性越高。将本文算法与全参考评价方法峰值信噪比(PSNR)、结构相似性(SSIM)以及现有的无参考修复图像质量算法结果进行比较,且性能最好的三个分数加粗表示,结果如

表 2. 唐卡数据库中各种类型修复图像迭代1000次SROCC中值

Table 2. SROCC median of different types of repaired images in Thangka database iterate 1000 times

|

表 3. 唐卡数据库中各种类型修复图像迭代1000次PLCC中值

Table 3. PLCC median of different types of repaired images in Thangka database iterate 1000 times

|

4.3 算法的鲁棒性

为了说明在不同比例的训练样本与测试样本集上本文算法评价效果的差异,在唐卡数据库上随机挑选4组图像,其中训练样本与测试样本的比例分别为80%~20%,60%~40%,40%~60%,20%~80%。考虑到实验的有效性和对比多样性,选择

4.4 复杂度分析

算法的复杂程度同样是影响其性能的一大因素。

表 4. 不同算法在唐卡数据库上处理一张图片的平均用时

Table 4. Average time to process an image by different algorithms on Thangka database

|

从

4 结论

本文提出了一种针对唐卡修复图像的无参考图像质量评价算法。考虑到唐卡图像纹理结构丰富且原始遗留信息较少,利用DOG算子和色彩熵分别提取结构特征和色彩特征,能够有效量化图像修复程度差异。其次为了解决如何构建多尺度评价框架的问题,将唐卡修复图像利用拉普拉斯金字塔分解进行5层下采样,利用上述提取方法获得10维图像特征,并输入到自适应增强神经网络BP-AdaBoost中训练得到最终无参考评价指标模型。在自建唐卡修复图像数据库中测试表明,本文算法针对不同破损修复类型的唐卡图像都表现出了良好的效果,与主观评价分数一致。相比其他同类型无参考图像质量评价算法具有更好的鲁棒性,算法复杂度也略有下降,为以后的图像质量评价模型设计工作提供了一定的参考意义。

[1] 李娜, 周蓬勃, 耿国华, 等. 色彩复原图像的质量评价方法[J]. 计算机应用, 2016, 36(6): 1673-1676.

Li N, Zhou P B, Geng G H, et al. Quality evaluation method for color restoration image[J]. Journal of Computer Applications, 2016, 36(6): 1673-1676.

[2] 方小济. 唐卡的科学化保护与修复研究综述[C]∥中国文物保护技术协会第七次学术年会论文集. 北京: 科学出版社, 2012: 191- 198.

Fang XJ. Scientific protection and restoration of thangka[C]∥ Proceedings of the seventh annual conference of China association for the protection of cultural relics.Beijing: Science Press, 2012: 191- 198.

[3] 唐守亮, 刘晓静, 刘志强. 唐卡图像修复综述[J]. 软件导刊, 2018, 17(9): 4-8.

Tang S L, Liu X J, Liu Z Q. Summary of Thangka image inpainting[J]. Software Guide, 2018, 17(9): 4-8.

[4] 王维兰, 唐仕喜. 唐卡图像复杂破损区域的修复[J]. 计算机工程与设计, 2007, 28(3): 703-705.

Wang W L, Tang S X. Tibetan Tangka image inpainting in intricate disrepaired region[J]. Computer Engineering and Design, 2007, 28(3): 703-705.

[5] 王一卜, 白艳萍. 基于样块改进的图像修复算法[J]. 火力与指挥控制, 2017, 42(3): 55-58, 63.

Wang Y B, Bai Y P. Image restoration algorithm based on sample block[J]. Fire Control & Command Control, 2017, 42(3): 55-58, 63.

[6] CriminisiA, PérezP, ToyamaK. Object removal by exemplar-based inpainting[C]∥2003 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2003. Proceedings., June 18-20, 2003, Madison, WI, USA. New York: IEEE, 2003: 7770168.

[7] 卢小宝. 综合偏微分方程的唐卡图像修复研究[D]. 兰州: 西北民族大学, 2011.

Lu XB. Research on Thangka image inpainting of comprehensive partial differential equations[D]. Lanzhou: Northwest Minzu University, 2011.

[8] 周宁, 朱昭昭. 基于粗糙数据推理的Criminisi图像修复算法[J]. 激光与光电子学进展, 2019, 56(2): 021005.

[9] 杜闪闪, 韩超. 基于总变分模型的改进图像修复算法[J]. 激光与光电子学进展, 2018, 55(7): 071005.

[10] Dang TT, BeghdadiA, Larabi MC. Inpainted image quality assessment[C]∥European Workshop on Visual Information Processing (EUVIP), June 10-12, 2013, Paris, France. New York: IEEE, 2013: 13838803.

[11] Qureshi M A, Deriche M, Beghdadi A, et al. A critical survey of state-of-the-art image inpainting quality assessment metrics[J]. Journal of Visual Communication and Image Representation, 2017, 49: 177-191.

[12] Vijay VenkateshM, Cheung S C S. Eye tracking based perceptual image inpainting quality analysis[C]∥2010 IEEE International Conference on Image Processing, September 26-29, 2010, Hong Kong, China. New York: IEEE, 2010: 1109- 1112.

[13] 陈寅栋, 李朝锋, 桑庆兵. 卷积神经网络结合深度森林的无参考图像质量评价[J]. 激光与光电子学进展, 2019, 56(11): 111003.

[14] Ardis P A, Singhal A. Visual salience metrics for image inpainting[J]. Proceedings of SPIE, 2009, 7257: 72571W.

[15] Hu W J, Ye Y Q, Meng J H, et al. No reference quality assessment for Thangka color image based on superpixel[J]. Journal of Visual Communication and Image Representation, 2019, 59: 407-414.

[16] Hu W J, Ye Y Q, Zeng F L, et al. A new method of Thangka image inpainting quality assessment[J]. Journal of Visual Communication and Image Representation, 2019, 59: 292-299.

[17] Birch P, Mitra B, Bangalore N M, et al. Approximate bandpass and frequency response models of the difference of Gaussian filter[J]. Optics Communications, 2010, 283(24): 4942-4948.

[18] 徐琳, 陈强, 汪青. 色彩熵在图像质量评价中的应用[J]. 中国图象图形学报, 2015, 20(12): 1583-1592.

Xu L, Chen Q, Wang Q. Application of color entropy to image quality assessment[J]. Journal of Image and Graphics, 2015, 20(12): 1583-1592.

[19] 彭延军, 王瑾瑾, 王元红. 基于拉普拉斯金字塔改进的图像融合方法[J]. 软件导刊, 2016, 15(1): 167-170.

Peng Y J, Wang J J, Wang Y H. Improved image fusion method based on Laplacian pyramid transform[J]. Software Guide, 2016, 15(1): 167-170.

[20] Schapire R E, Singer Y. Improved boosting algorithms using confidence-rated predictions[J]. Machine Learning, 1999, 37(3): 297-336.

[21] 鲍丽丽. 藏传唐卡线描艺术浅论[J]. 康定民族师范高等专科学校学报, 2009, 18(1): 11-16.

Bao L L. On line drawing art of Tibetan Thangka[J]. Journal of Kangding Nationality Teachers College, 2009, 18(1): 11-16.

[22] 夏梦, 张荣, 彭韧, 等. 用线描图生成唐卡浮雕[J]. 中国科学:信息科学, 2019, 49(2): 216-228.

Xia M, Zhang R, Peng R, et al. Generation of Thangka relief from line drawings[J]. Scientia Sinica Informationis, 2019, 49(2): 216-228.

[23] 李阳. 基于高斯差分的风格化方法[D]. 昆明: 云南大学, 2014.

LiY. A stylistic method using extended DOG operator[D]. Kunming: Yunnan University, 2014.

[24] 丘宁. 藏族唐卡艺术特色分析[D]. 北京: 首都师范大学, 2005.

QiuN. Analysis on Tibetan Thangka characteristic art[D]. Beijing: Capital Normal University, 2005.

[25] 沈为, 程小青, 曾丹. 基于边缘特征学习的自然图像对称轴检测[J]. 上海大学学报(自然科学版), 2014, 20(6): 715-725.

Shen W, Cheng X Q, Zeng D. Symmetry detection in natural images via edge feature learning[J]. Journal of Shanghai University(Natural Science Edition), 2014, 20(6): 715-725.

[26] 沈丽丽, 杭宁. 联合多种边缘检测算子的无参考质量评价算法[J]. 工程科学学报, 2018, 40(8): 996-1004.

Shen L L, Hang N. No-reference image qua1ity assessment using joint mu1tip1e edge detection[J]. Chinese Journal of Engineering, 2018, 40(8): 996-1004.

Article Outline

叶雨琪, 胡文瑾. 基于多特征的彩色唐卡修复图像无参考质量评价方法[J]. 激光与光电子学进展, 2020, 57(8): 081105. Yuqi Ye, Wenjin Hu. No-Reference Quality Assessment Method for Inpainting Thangka Image Based on Multiple Features[J]. Laser & Optoelectronics Progress, 2020, 57(8): 081105.