复杂光照条件下的交通标志检测与识别  下载: 1017次

下载: 1017次

1 引言

随着智能驾驶技术的发展,驾驶辅助系统受到了越来越多学者的广泛关注,其中交通标志的准确检测与识别对智能车的行车导航和驾驶决策提供了有效信息,对提高车辆的行驶安全,保障道路交通顺畅起到了至关重要的作用[1-3]。因此对交通标志检测和识别方法的研究具有重要的意义。

交通标志的检测识别系统一般分为两部分,首先需要对图像空间中交通标志的候选区域进行准确提取,之后对检测到的交通标志进行识别和分类[4]。然而,受自然场景中不同天气、光照强度等因素的影响,交通标志的准确检测面临巨大挑战。目前,交通标志的检测主要分为基于颜色或形状信息的检测和基于深度学习的检测[5]。基于颜色的检测主要包括RGB空间和HSV空间下的交通标志检测,通过分割特定的颜色创建显著性映射,可快速高效地对候选区域进行检测,但极易受到光照影响,无法满足恶劣天气条件下的检测需求[6]。而基于形状的检测利用交通标志在形状上的特殊性对其边缘进行检测,但当交通标志发生运动模糊或遮挡等情况时,算法精度会下降。随着深度学习的快速发展,基于神经网络的图像检测与识别算法逐渐受到学者们的广泛关注[7]。Cireşan等[8]使用深度网络对交通标志进行检测识别,取得了较好的效果,但由于使用梯度下降法,训练过程中需不断对所有参数进行调整,训练时间过长,实用性较差。徐岩等[9]通过将极限学习机和主成分分析法相结合实现了目标准确分类,但该算法对噪声等干扰因素的稳健性较差,且对夜间等低亮度目标检测时性能不足。Froba等[10]提出基于统计变换的Adaboost人脸检测算法,通过对每个像素点构建弱分类器进行集成训练,可对图像相似区域进行有效分割,但由于需要对所有像素进行训练,因此,随着输入图像分辨率的增大,算法训练时间急剧增加,无法对高清图像进行实时检测,且当输入图像的背景发生突变时,算法精度会降低。

本文提出一种改进后的基于图像关键点统计变换(MCT)特征的Adaboost交通标志检测算法。以真实驾驶场景为输入图像,通过提取图像MCT特征增加算法对光照变化的稳健性,实现不良光照下交通标志的精准检测。同时,提取图像关键点构建Adaboost集成分类器,在提高算法抗遮挡能力的前提下有效缩短算法训练时间,满足了检测实时性需求。最终通过多尺度神经网络对目标的整体和局部特征进行提取融合,实现了交通标志准确识别。

2 交通标志检测算法

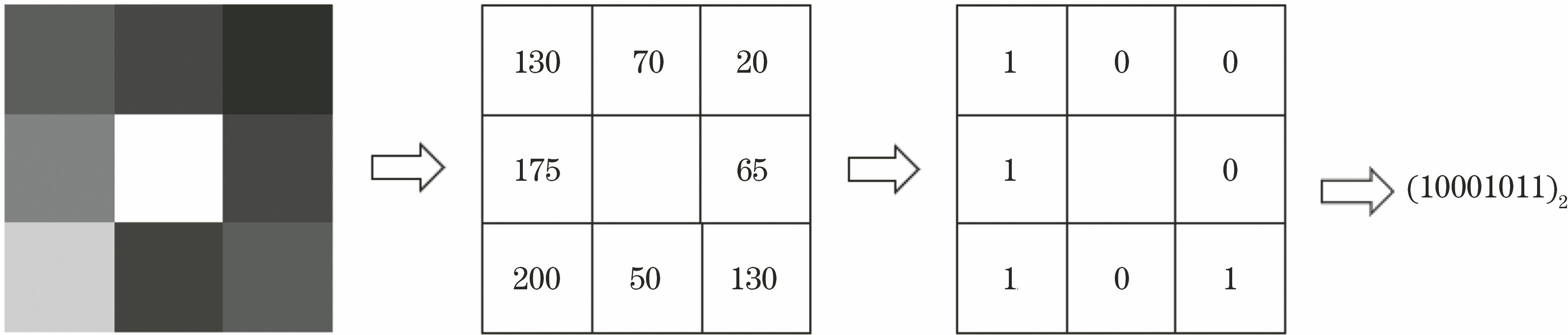

2.1 基于光照不变性的MCT特征提取

对于不同光照条件下的图像样本,其像素点

式中:

式中:

对于3×3的像素窗口,MCT将中心像素点的8个相邻像素与区域平均像素灰度值进行对比,若该像素灰度值大于平均灰度值,将其设置为比特1,反之设置为比特0;之后将任意相邻排序转换为二进制,建立图像局部块之间的一致性。不同于传统统计变换(CT)算法,MCT能将每个像素值与局部区域的像素平均值进行对比,并不会受整体图像的光照影响,同时由于只考虑局部区域内8个相邻像素间的差异及其平均值,因此可降低中心像素点

式中:

2.2 基于关键点Adaboost集成的交通标志检测

Adaboost集成算法通过对训练样本进行多次迭代学习,将每轮迭代生成的弱分类器分类结果与标注进行对比,再根据样本分类准确率进行样本分布更新,并将更新后的样本作为下一轮分类器的输入进行弱分类器再学习,依据弱分类器误差确定每个弱分类器的权重,最后通过加权组合生成高性能分类器[11]。

不同于传统Adaboost算法对每个像素点建立分类器模型,本文利用基于图像关键点MCT特征的Adaboost检测算法,采用尺度不变特征变换(SIFT)[12]对图像关键点进行提取,并基于MCT特征对其建立弱分类器,再对图像候选区域进行检测,这样不仅保留了样本图像的轮廓特征,同时采用滑动窗口进行并行搜索运算,有效缩短训练时间,进一步提升了算法的检测效率,其具体的算法流程如

图 2. 部分样本效果。(a)原图像;(b)变换后图像

Fig. 2. Partial sample effects. (a) Original images; (b) transformed images

SIFT是一种高效、准确的关键点检测算法,因具有良好的旋转、光照不变性,被广泛应用于图像处理领域。

对于二维图像

式中:

同时SIFT指出,对于某一尺度的关键点,可通过相邻尺度空间

式中:

式中:

最终,通过对其求导使得

3 基于多尺度卷积神经网络的交通标志识别

基于检测到的交通标志候选区域,提出一种多尺度特征提取的卷积神经网络识别框架,通过对不同尺度交通标志进行卷积运算,将其整体和局部轮廓特征进行提取融合,提高算法识别精度和泛化能力,其网络结构如

首先,将检测到的候选区域缩放为16×16、32×32、64×64三种不同尺寸的图片以作为神经网络的输入,通过卷积运算对各候选区域内的样本特征进行提取,由于训练过程中不同尺寸样本的感受野占比不同,因此,通过对不同尺寸样本进行特征提取可更好地反映出样本的全局特征和局部特性,提高算法的识别精度。本文共设置三层卷积网络结构,其中,conv1和conv2均使用32个大小为5×5的卷积核,其深度和步长均为1,且使用ReLU激活函数,conv3包含64个大小为5×5的卷积核。通过最大池化层将各尺寸的特征进行合并,构成输入样本的特征向量。最终,选用softmax分类器对不同类别交通标志进行识别。

4 实验数据集

4.1 GTSDB数据集

德国交通标志检测数据集(GTSDB)[13]包含43类共900张真实车辆驾驶环境下的高清交通标志场景图像,分为训练样本600张(包含846个交通标志)及测试样本300张(包含360个交通标志)。其中含有大量低分辨率、不良光照、遮挡、运动模糊等不利条件下的交通标志样本,每幅图像分辨率为1360 pixel×800 pixel,交通标志尺寸为16 pixel×16 pixel~128 pixel×128 pixel,部分样本如

4.2 自建数据集

为检验算法在不同光照条件下的检测性能及算法的泛化能力,本文采集重庆市不同天气(晴天、阴天、雨天等)、不同光照及遮挡模糊等条件下的车辆真实驾驶图像以构建交通标志数据集,由重庆白天(CQD)和重庆夜间(CQN)两个子集构成,包含23类共450幅车辆驾驶图像,并对其中的交通标志进行标注,每幅图像中分别包含0~5个交通标志,图像分辨率为1984 pixel×1488 pixel。部分样本如

5 实验结果及分析

本实验是在Linux-16.04环境中基于TensorFlow深度学习框架完成,硬件配置为Inter Core i7-8700K,8G内存,2T硬盘,GPU为NVIDIA GTX 1080Ti。

5.1 算法检测性能

为验证本文算法在复杂光照条件下对交通标志检测的有效性,在GTSDB数据集和自建数据集下,将本文算法与基于全像素点MCT特征的Adaboost集成算法(MCT-Adaboost)和在GTSDB数据集中检测性能排名较高的HOG+SVM算法[14]进行对比,统计结果如

表 1. 各算法检测性能

Table 1. Detection performance of each algorithm

|

图 7. 本文算法检测效果图。(a) GTSDB数据集检测结果;(b) CQD数据集检测结果;(c) CQN数据集检测结果

Fig. 7. Detection results of proposed algorithm. (a) Detection results of GTSDB dataset; (b) detection results of CQD dataset; (c) detection results of CQN dataset

由

5.2 算法识别精度

为进一步验证本文基于多尺度特征融合的神经网络对不同光照条件下交通标志的识别性能,选取GTSRB交通标志数据集和自建数据集对本文算法识别性能进行验证。将自建数据集中交通标志进行截取,并通过翻转、平移、缩放等方式对其进行扩样,其中,白天数据集(CQD)共包含2000幅训练样本和800幅测试样本;夜间数据集(CQN)共包括1500幅训练样本和800幅测试样本。选取本文算法与Multi-scale CNN、Random forests和LDA on HOG算法进行对比,设置网络学习率为0.02,训练迭代次数为30000。识别准确率统计结果如

表 2. 各算法识别准确率

Table 2. Recognition accuracy of each algorithm%

| ||||||||||||||||||||||||

5.3 算法耗时

时间效率是衡量算法可行性的重要指标,本文选取GTSDB数据集,将输入图像尺寸归一化至1080 pixel×720 pixel,基于相同测试环境对算法的检测效率进行对比分析,各算法时间成本统计结果如

表 3. 各算法运行的时间成本

Table 3. Running time cost of each algorithmms

|

由

6 结论

针对复杂光照条件下的高分辨率输入图像,提出一种基于图像关键点MCT特征的交通标志检测算法,在降低光照影响的前提下提升算法性能。同时,采用多尺度图像特征提取和融合实现交通标志准确识别。实验基于GTSDB数据集和自建数据集,对算法检测性能进行对比分析,结果表明,本文算法在两类数据集中均展现出最佳的检测精确率。针对光线昏暗的极端情况,本文算法召回率为93.16%,高于HOG+SVM算法3.59%,表明本文算法具有良好的光照不变性和抗干扰能力,可很好地适应复杂光照条件下的交通标志检测任务。同时,采用多尺度特征融合提升算法在复杂环境下对交通标志的识别能力。如何在确保检测和识别性能的前提下进一步提升算法性能,以实现智能车辆辅助系统的实际应用将会是下一步研究的主要内容。

[1] 张新钰, 高洪波, 赵建辉, 等. 基于深度学习的自动驾驶技术综述[J]. 清华大学学报(自然科学版), 2018, 58(4): 438-444.

Zhang X Y, Gao H B, Zhao J H, et al. Overview of deep learning intelligent driving methods[J]. Journal of Tsinghua University(Science and Technology), 2018, 58(4): 438-444.

[2] 刘华平, 李建民, 胡晓林, 等. 动态场景下的交通标识检测与识别研究进展[J]. 中国图象图形学报, 2013, 18(5): 493-503.

Liu H P, Li J M, Hu X L, et al. Recent progress in detection and recognition of the traffic signs in dynamic scenes[J]. Journal of Image and Graphics, 2013, 18(5): 493-503.

[3] 张淑芳, 朱彤. 一种基于HDR技术的交通标志牌检测和识别方法[J]. 激光与光电子学进展, 2018, 55(9): 091006.

[4] Mogelmose A, Trivedi M M, Moeslund T B. Vision-based traffic sign detection and analysis for intelligent driver assistance systems: perspectives and survey[J]. IEEE Transactions on Intelligent Transportation Systems, 2012, 13(4): 1484-1497.

[5] 童英, 杨会成. 基于改进卷积神经网络的实时交通标志检测方法[J]. 激光与光电子学进展, 2019, 56(7): 071003.

[6] 李厚杰, 邱天爽, 宋海玉, 等. 基于曲率尺度空间角点检测的交通标志分离算法[J]. 光学学报, 2015, 35(1): 0115002.

[7] 刘占文, 赵祥模, 李强, 等. 基于图模型与卷积神经网络的交通标志识别方法[J]. 交通运输工程学报, 2016, 16(5): 122-131.

Liu Z W, Zhao X M, Li Q, et al. Traffic sign recognition method based on graphical model and convolutional neural network[J]. Journal of Traffic and Transportation Engineering, 2016, 16(5): 122-131.

[8] Cireşan D, Meier U, Masci J, et al. Multi-column deep neural network for traffic sign classification[J]. Neural Networks, 2012, 32: 333-338.

[9] 徐岩, 韦镇余. 一种改进的交通标志图像识别算法[J]. 激光与光电子学进展, 2017, 54(2): 021001.

[10] FrobaB, ErnstA. Face detection with the modified census transform[C]∥Sixth IEEE International Conference on Automatic Face and Gesture Recognition, 2004. Proceedings., May 19-19, 2004, Seoul, Korea. New York: IEEE, 2004: 8152121.

[11] 袁双, 吕赐兴. 基于PCA改进的快速Adaboost算法研究[J]. 科学技术与工程, 2015, 15(29): 62-66.

Yuan S, Lü C X. Fast Adaboost algorithm based on improved PCA[J]. Science Technology and Engineering, 2015, 15(29): 62-66.

[12] Lowe DG. Object recognition from local scale-invariant features[C]∥Proceedings of the Seventh IEEE International Conference on Computer Vision, September 20-27, 1999, Kerkyra, Greece. New York: IEEE, 1999: 6365386.

[13] HoubenS, StallkampJ, SalmenJ, et al. Detection of traffic signs in real-world images: the German traffic sign detection benchmark[C]∥The 2013 International Joint Conference on Neural Networks (IJCNN), August 4-9, 2013, Dallas, TX, USA. New York: IEEE, 2013: 14027444.

[14] Ellahyani A, Ansari M E, Jaafari I E. Traffic sign detection and recognition based on random forests[J]. Applied Soft Computing, 2016, 46: 805-815.

[15] SermanetP, LeCun Y. Traffic sign recognition with multi-scale Convolutional Networks[C]∥The 2011 International Joint Conference on Neural Networks, July 31-August 5, 2011, San Jose, CA, USA. New York: IEEE, 2011: 2809- 2813.

[16] ZakloutaF, StanciulescuB, HamdounO. Traffic sign classification using K-d trees and Random Forests[C]∥The 2011 International Joint Conference on Neural Networks, July 31-August 5, 2011, San Jose, CA, USA. New York: IEEE, 2011: 2151- 2155.

[17] Lowe D G. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004, 60(2): 91-110.

Article Outline

屈治华, 邵毅明, 邓天民, 朱杰, 宋晓华. 复杂光照条件下的交通标志检测与识别[J]. 激光与光电子学进展, 2019, 56(23): 231009. Zhihua Qu, Yiming Shao, Tianmin Deng, Jie Zhu, Xiaohua Song. Traffic Sign Detection and Recognition Under Complicated Lighting Conditions[J]. Laser & Optoelectronics Progress, 2019, 56(23): 231009.