基于光场成像的三点式光笔测量方法  下载: 1243次

下载: 1243次

1 引言

工业以及测量技术的迅速发展对三维坐标测量系统的便携性、实用性的要求越来越苛刻[1]。然而,传统的三坐标测量机体积较大,不易携带[2],无法满足当今制造业现场实时精确测量的要求,于是在测量领域中,便携式的光笔三坐标测量技术[3-4]迅速发展起来。由于测量时摄像机只需采集到光笔标志点的图像,因此该系统可以完成测量孔、洞、复杂被测表面等现有测量系统无法完成的任务,在现场在线测量、微变量测量、汽车车身的整体误差测量等领域有着得天独厚的优势[4]。

国内高校如天津大学、中南大学、中国海洋大学等在光笔测量领域开展了深入研究,取得了一定的成果。针对光笔测量系统,基于双目测量的研究较多。中国海洋大学的解则晓等[4]提出了基于双目视觉的九点式直线光笔,其只考虑了径向畸变,且光笔模型较难加工。中南大学的刘一宇[5]基于双目视觉,以迈卓诺五点式光笔为基础,将迈卓诺五点式光笔改进为对称性的七点式光笔,提高了测量精度,然而其多孔式光笔设计也加大了制造难度。双目相机需要高精度标定,且体积大,不利于光笔系统的小型化。基于单摄像机的光笔测量,可以有效简化测量系统。天津大学的黄风山[6]基于单目视觉测量,提出了“共线三点透视问题(P3CP)”的光笔数学模型,但是光笔构造要求较为苛刻。因此,光笔结构急需简单化,以减小加工误差。同时,为减小光笔体积、提高光笔的便携性,需尽可能地减少光笔的点光源数量。然而,对于现有光笔测量系统采用的多点透视模型,当点光源数量为3时,运用透视三点(P3P)算法求解光笔到摄像机的位姿变换矩阵时会出现多解的情况,如何选取正解是三点式光笔具备实用性的难点之一。

近年来,随着光场成像技术的不断发展,其先拍照后聚集的特性被逐渐引入视觉测量领域[7]。光场成像系统由于在成像传感器前安装了微透镜阵列,与传统相机相比,可实现空间光线的追踪,在成像后采用重聚焦算法[8-9]即可实现空间点的深度信息。

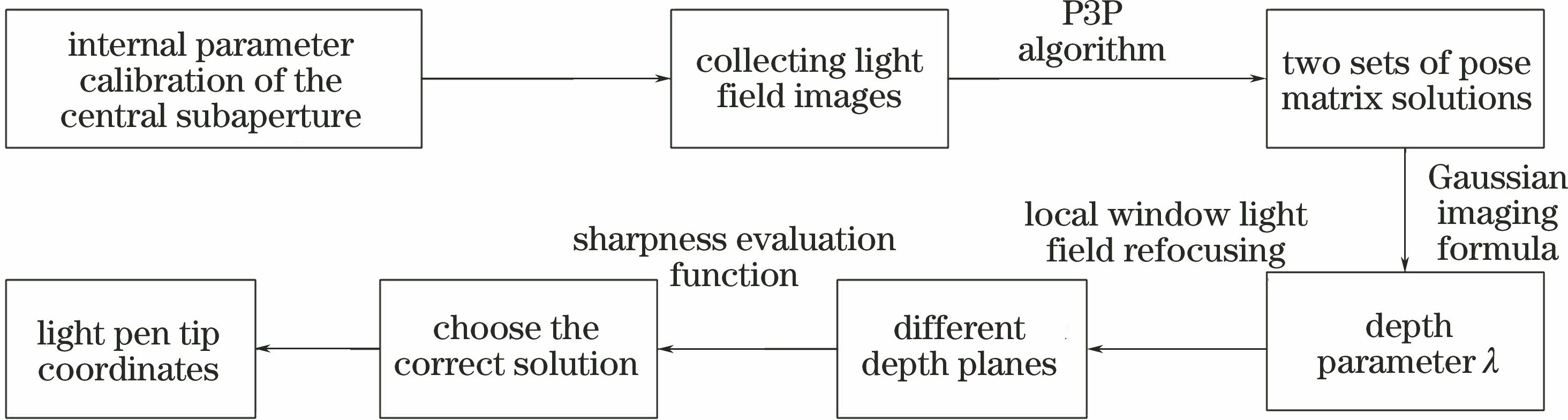

基于此,本文将光场成像与三点式光笔结合起来,提出了一种基于光场成像的三点式光笔测量系统。系统通过光场相机采集光场图像,运用区域窗口光场重聚焦并以基于索贝尔算子[10]的Tenengrad 灰度梯度函数作为清晰度评价方法,获得正确的光笔位姿矩阵,进而获得笔尖的三维坐标,解决了三点式光笔透视模型求解过程中正解选择的问题,极大地增加了三点式光笔的实用性。

2 光笔测量系统原理

光笔的三个标志点的世界坐标已知,通过高精度标定中心子孔径内参的光场相机采集图像,运用P3P算法求解出两组标志点摄像机坐标,利用数字重聚焦以及高斯公式将采集的光场图像局域重聚焦到两组深度平面,通过比较清晰度确定正解,进而得到光笔的位姿矩阵以及笔尖的三维坐标。本文方法的流程图如

2.1 P3P求解算法

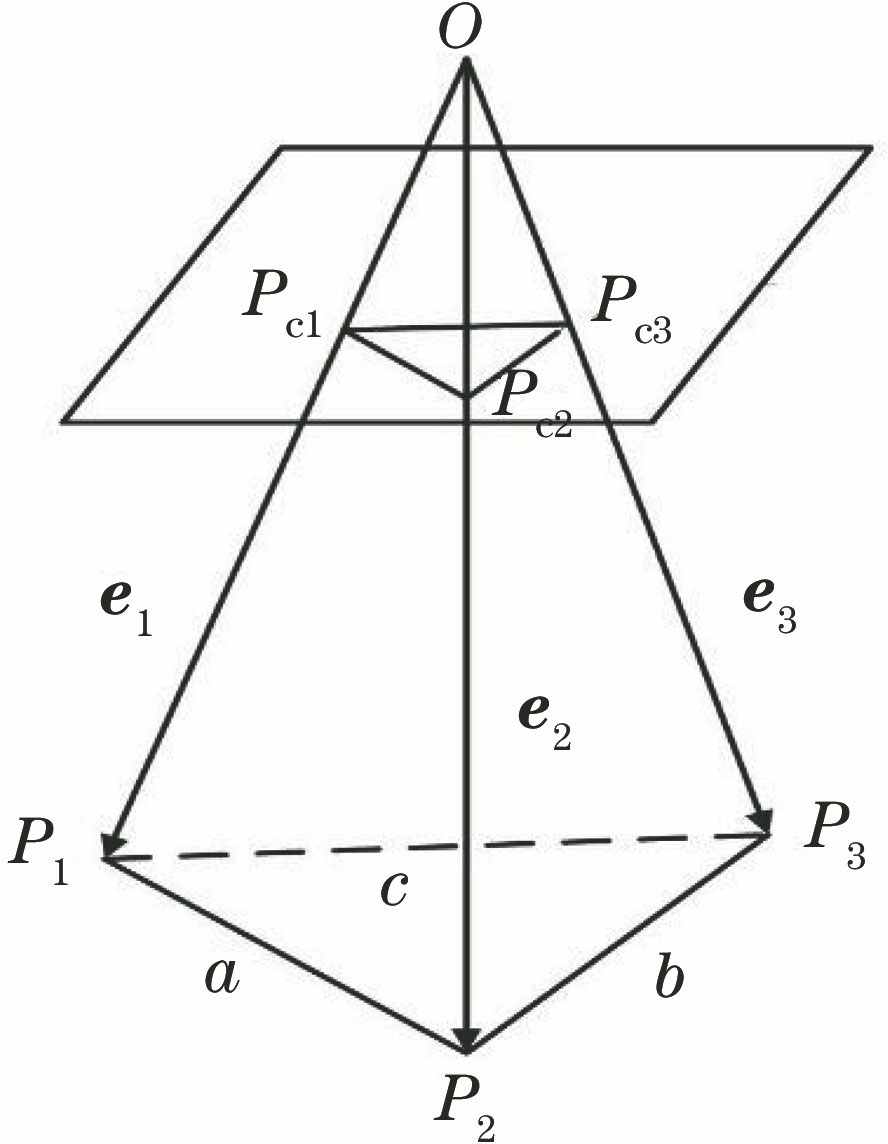

PNP(Perspective N Points)问题是由Fischler等[11]在1981年首先提出的。PNP 问题即下述的物体定位问题:假设坐标系下N个控制点的3D坐标和图像坐标系下的2D坐标已知,求解N个控制点在摄像机坐标系下的坐标。当N=3时,即经典的P3P求解问题。

如

将e2与e3间的夹角记为α,e1与e3间的夹角记为β,e1与e2间的夹角记为γ。根据ei和ej,可以计算出两个向量间夹角的余弦值:

将P1、P2和P3与O之间的距离记为d1、d2和d3。根据三角余弦公式,有

假设

由(3)式和(4)式可得

其中

由(6)式可解得实数解l,代入(5)式可得j。然后将j和l代入(3)式和(4)式可以求出d1、d2和d3。则各个特征点在摄像机坐标系中的坐标为

N=3构成了PNP问题的最小单位,由一元四次方程[(6)式]可知,该方程最多有4个满足已知条件的解,当三个特征点不共线时,其最少有两组解[12]。采用传统摄影成像方式,虽然P3P算法有唯一解的情况,但是对摄像机与目标的约束条件较为苛刻,必须在特定条件与视场环境下才能实现,并不具有普适性。本文将光场成像与P3P算法结合起来,仅需使用光场相机进行单次拍摄,对光笔上的三点无任何约束条件,即可得到相机的正确位姿,该方法增加了三点式光笔测量系统的便携性和适用性,为P3P问题正解的求取提供了一种正确有效的新方法。

本文利用P3P方法求解光笔的位姿矩阵。将光场相机中心子孔径作为求解P3P问题的子孔径相机,事先通过张正友标定算法[13]进行高精度标定,得到子孔径相机的内参矩阵以及畸变系数。利用光场相机采集图像,经解码校正等得到光笔的中心子孔径图像,运用椭圆重心定位算法[14]得到三个激光标志点的畸变的二维像素坐标,对提取的二维像素坐标进行去畸变处理,得到未畸变的像素坐标。根据三组世界坐标和图像坐标的位姿转化关系,求得世界坐标系相对于摄像机坐标系的位姿矩阵M:

式中:R=

2.2 光场成像及其数字重聚焦

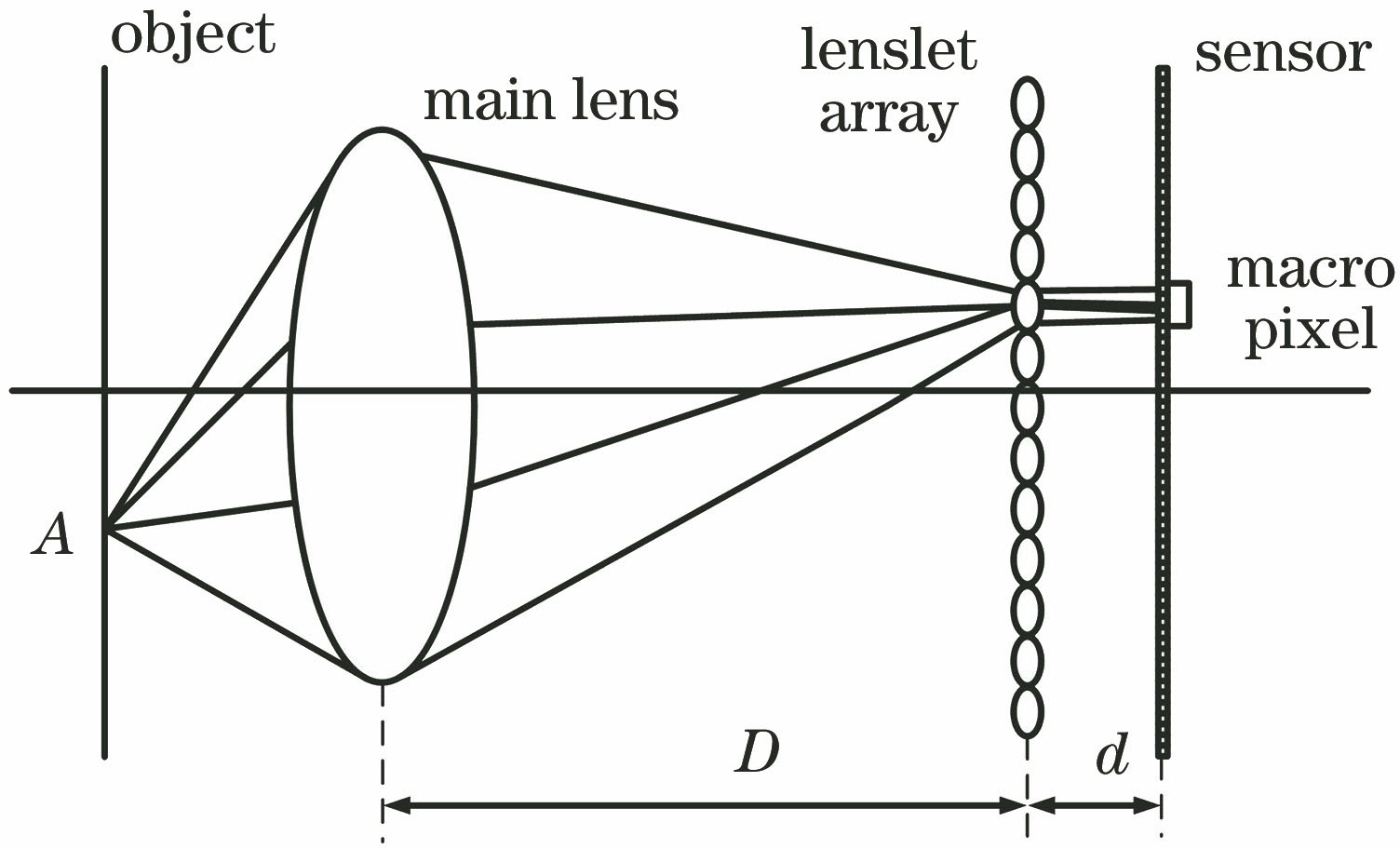

光场是空间中所有光线的光辐射函数的总体[15],它同时包含被测物体的位置信息(x,y)以及角度信息(u,v)。光场的概念最早用于描述光在三维空间中的辐射传输特性。Adelson[16]在1991年根据人眼对外部光线的视觉感知,提出了用七维函数表征空间分布的几何光线,该函数被称为全光函数。假设只考虑光线在自由空间的传输,它的波长一般不会发生变化,则任一时刻的光线可以由五维坐标表示。更进一步地,Levoy等[17]忽略了光线在传输过程中的衰减,将五维的全光函数降到四维,并且提出用两个相互平行的平面参数化表示四维光场。

由于微透镜阵列的存在,光场相机可以同时捕获光线的位置信息和角度信息,成像原理如

光场相机采集目标的光场数据后,需要经过后续特殊的图像计算处理才能得到最终的四维光场数据。宏像素下所覆盖的子像素实际来自于同一位置不同方向的光线信息,通过(9)式可以得到通过主透镜的所有光线的总和,即场景的四维光场信息:

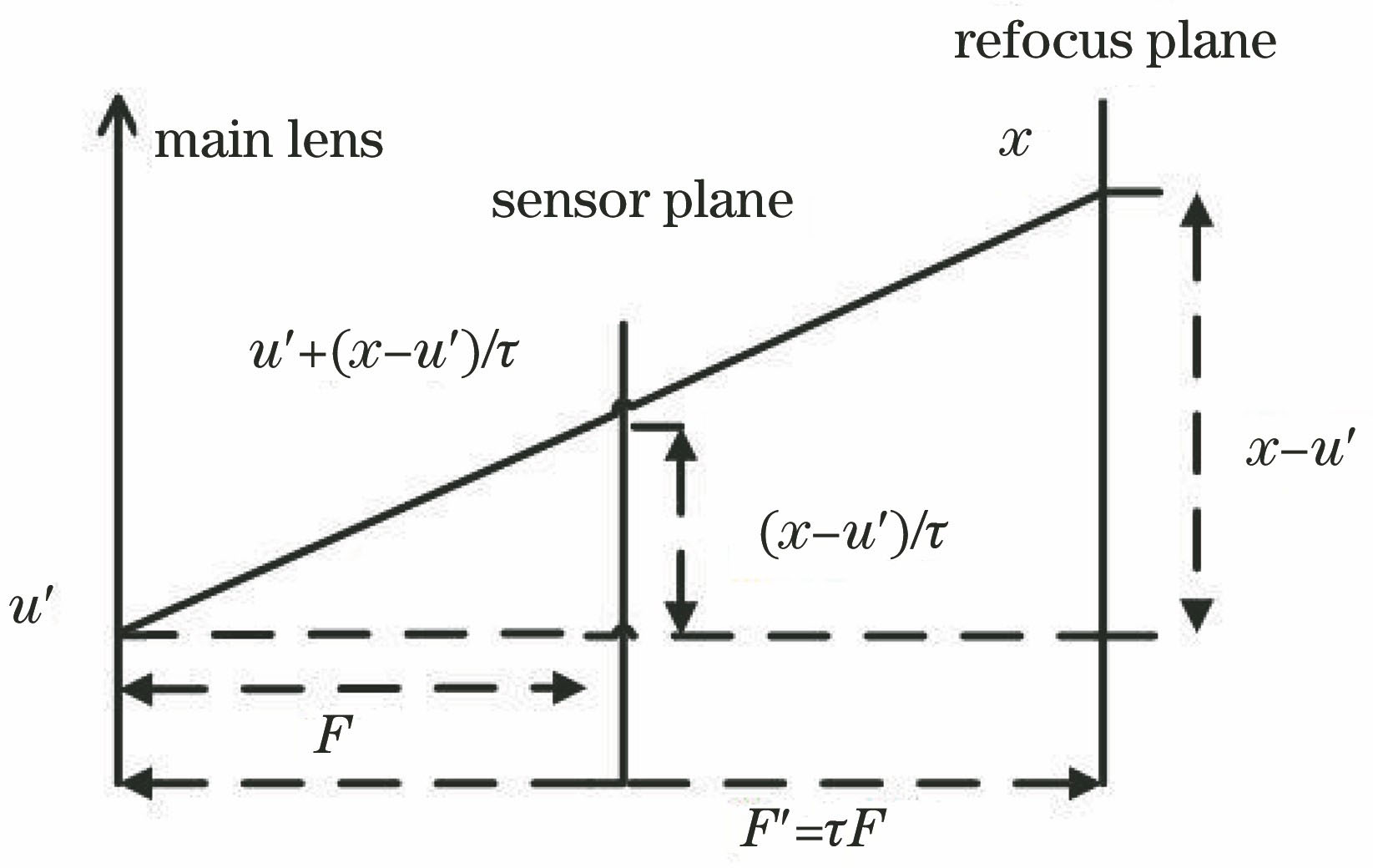

光场成像是一种计算成像方式,可以采用光线追踪的方式对采集的原四维光场信息进行重采样和适当计算处理,以得到聚焦于某一深度平面的清晰图像[19],原理图如

式中:(u',v')是光线通过主透镜平面时的交点坐标。基于(9)式和(10)式并经过重采样,可得新的成像面的图像场景信息为

可以看到,重聚焦就是对光场在位置维度进行平移并在方向维度进行积分的过程。(11)式中τ代表不同的成像平面,即不同的像距,通过设置不同的τ值,可以得到同一目标场景下的聚焦在不同深度处的图像序列。

2.3 局域窗口重聚焦选取P3P正解

通过P3P算法得到两组光笔特征点的摄像机三维坐标。光场相机依然遵循高斯成像,即

成像最清晰处是在理想景深范围内,如果被测物体偏离理想像面,就会出现散焦模糊[20]。采集图像时要保证光场相机的标称焦距f不变,即相机的f是已知的,另外,将P3P方法测得的两组解的深度值作为物距s,由(12)式计算此时的像距c。进一步地,利用F'=τF计算两组深度参数值τ。

由于光场四维数据较大,对全部光场数据进行数字重聚焦,计算量过大,效率不高,本文运用一种局域窗口的数字重聚焦,在保证正确度的前提下,仅对特征点所在目标区域窗口进行数字重聚焦,在简化计算量的同时,也在一定程度上消除了非目标区域的干扰。当原始光场数据大小为15×15×625×434时,选取5×5窗口的数字重聚焦在Matlab上的运行时间仅为0.253466 s。

根据(11)式,通过局域重聚焦可得到两幅聚焦于不同深度参数值τ的重聚焦图像。目前,对图像清晰度的评价方式主要有三种:1)基于灰度差值的函数评价;2)基于边缘锐利程度的函数评价;3)信息论指标的函数评价[21]。本实验是对重聚焦图像清晰度进行测量比较,具有小范围调焦、高稳定性、高灵敏性的特点,以适用于小范围内精确聚焦的 Tenengrad 灰度梯度函数作为评价函数。首先对重聚焦图像进行灰度化,将其转化为灰度图,重聚焦图像的清晰度F(τ)为

式中:Gx、Gy为像素点水平方向和垂直方向的梯度值,其所用的卷积模板为

Tenengrad 函数先对重聚焦图像进行加权平均,再计算其微分值,并采用模板分别对其垂直和水平方向进行卷积运算,从而在一定程度上抑制噪声。根据(14)式比较两幅图像的清晰度,清晰度大的重聚焦图像的参数τ所对应的三维坐标解即为最终的正解。

3 实验结果及分析

本文实验所用采集设备为Illum二代光场相机,其空间分辨率为625 pixel×434 pixel,角度分辨率为15 pixel×15 pixel,重构的光场图像大小为9375×6510×3,固定35 mm等效焦距为70 mm,等效转换系数为3.19,即标称焦距f=21.944 mm,传感器像元尺寸为17.312 μm。重聚焦图像与合成孔径成像相等,所以有极浅的景深,可以消除相机自身景深带来的测量误差影响。红外LED激光光源具有体积小、波长固定、亮度稳定、发光点小、后续提取像素点精确等诸多优点,可作为光笔上的主动发光标志点。

采用张氏棋盘格标定法对中心子孔径进行精确标定,标定参数包括起始像距c、等效焦距fc、主点坐标cc、畸变量kc、像素误差err,标定结果如

表 4. 沿Z轴方向对比实验的结果

Table 4. Results of contrast experiments along Z-axis directionmm

| ||||||||||||||||||||||||||||||||||||||||||||||||

表 1. 标定结果

Table 1. Calibration results

|

表 2. 沿X轴方向对比实验的结果

Table 2. Results of contrast experiments along X-axis directionmm

| ||||||||||||||||||||||||||||||||||||||||||||||||

表 3. 沿Y轴方向对比实验的结果

Table 3. Results of contrast experiments along Y-axis directionmm

| ||||||||||||||||||||||||||||||||||||||||||||||||

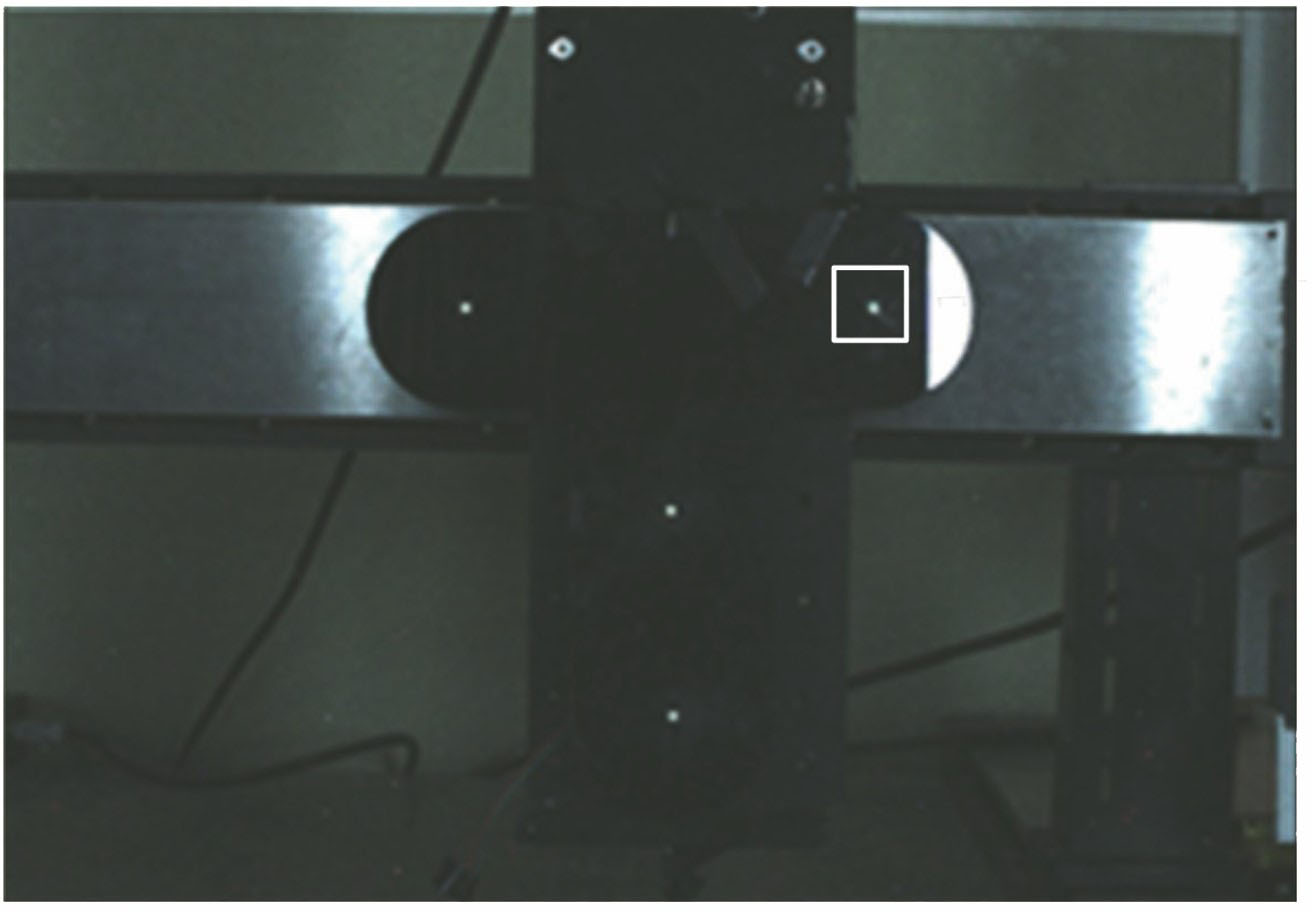

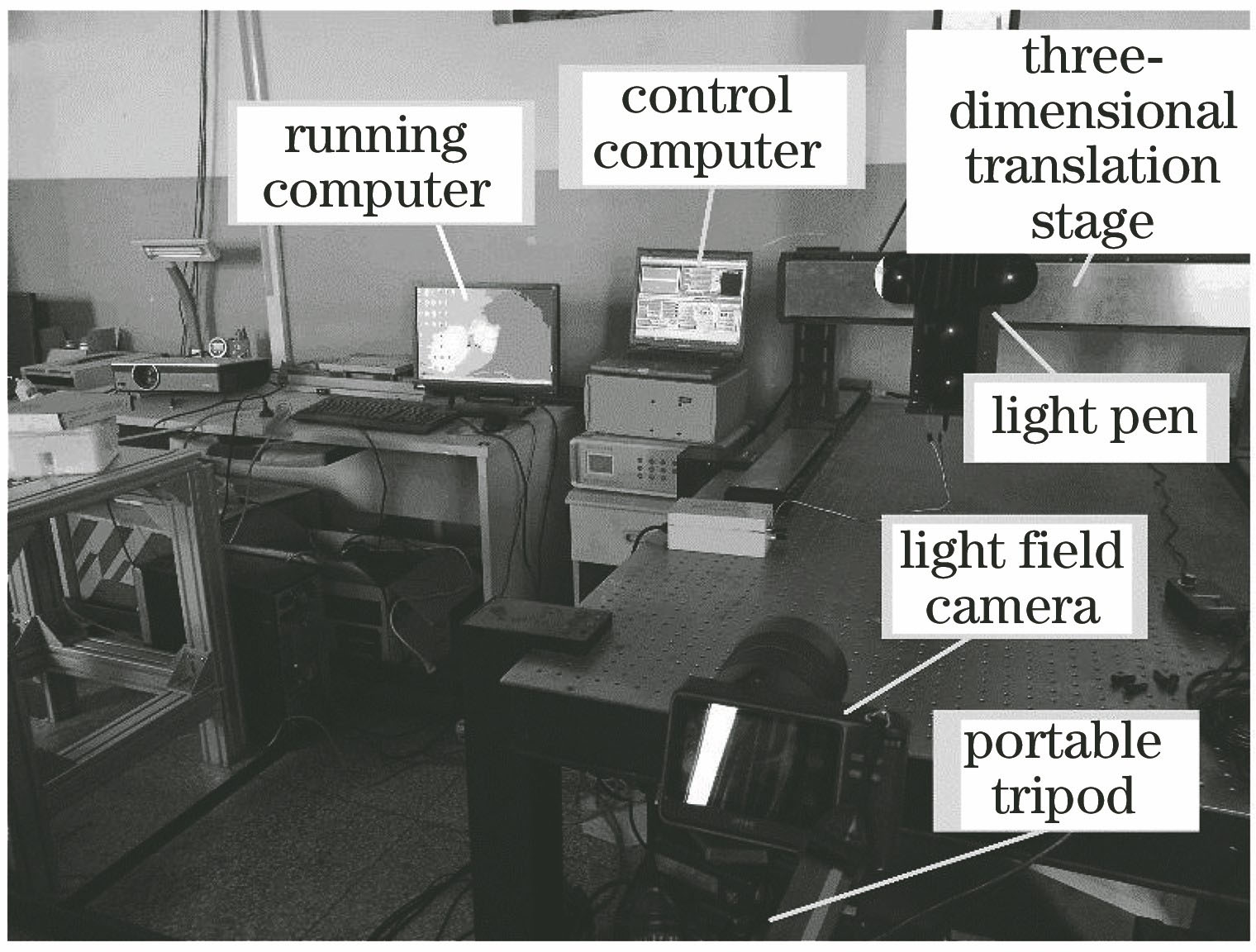

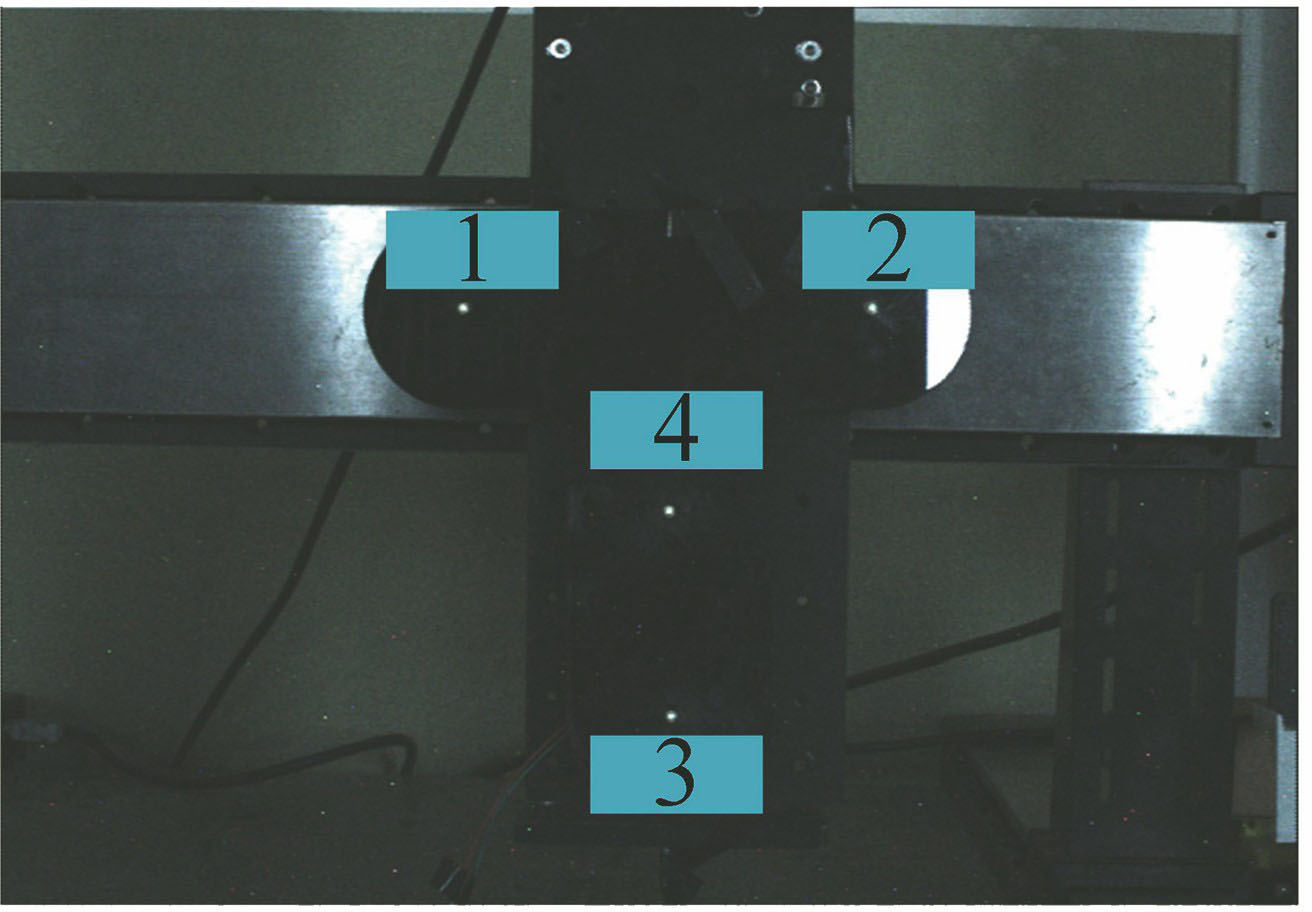

选用精密三坐标平移台进行对比实验。光笔设计时采用4个激光点,采用重投影以验证选取正解的正确率,对比测量系统如

实验时,将光笔固定在三坐标平移台的Z轴,并以一定的步长依次沿三坐标平移台的X、Y、Z轴方向移动,将三坐标平移台的移动距离作为基准数据,严格固定光场相机,并采集图像,同时用测量系统以及四点重投影计算出每个位置的光笔笔尖坐标,进而通过计算得出测量距离。每组实验重复5次,其平均值、最大值和最小值分别记录在

通过分析比较

1) 光场相机的空间分辨率不高[22]。本实验采用的二代光场相机空间分辨率为625 pixel×434 pixel,而P3P算法求解位姿与其分辨率有关,若提高光场相机的空间分辨率,则会进一步提高测量精度。

2) 图像坐标提取误差。本实验中,像素坐标提取采用椭圆重心定位算法,有一定的测量误差。后续可改进像素坐标提取算法,以提高测量精度。

3) 光笔制造误差。虽然在设计时严格控制光笔的世界坐标,但是在制造装配时仍然有一定的制造误差。

本实验确保光场相机的内参数不变,即保证其焦距等不变,这也是保证后续测量精度的关键部分。

4 结论

针对光笔测量系统采用P3P算法求解出现多解的问题,提出一种基于光场成像的三点式光笔多解排除算法。对光场相机中心子孔径进行高精度标定,建立光场相机采集系统,对中心子孔径图像运用P3P算法获得两组光笔上三个激光点的摄像机坐标。最终应用高斯成像公式、区域窗口光场重聚焦并将基于索贝尔算子的Tenengrad 灰度梯度函数作为清晰度评价方法,获得最终的光笔位姿矩阵,进而获得笔尖的三维坐标。测量系统结构简单,易操作,便于携带。选用精密三坐标平移台进行对比实验,实验结果表明:本实验测量系统与三坐标平移台在X、Y、Z方向的最大差值分别为0.35,0.40,0.54 mm,该结果与运用四点重投影选取正解的结果相同,证明了本文方法的有效性和准确性。

[1] 张国雄. 三坐标测量机的发展趋势[J]. 中国机械工程, 2000, 11(1): 222-226.

Zhang G X. The development tendency of coordinate measuring machines[J]. China Mechanical Engineering, 2000, 11(1): 222-226.

[2] 冯萍, 魏振忠. 光笔式大视场三维视觉测量系统[J]. 光学精密工程, 2013, 21(9): 2217-2224.

[3] 张望先, 仲思东, 隋莉斌, 等. 基于三坐标测量机的大尺寸非接触测量[J]. 武汉大学学报(工学版), 2004, 37(5): 112-115.

Zhang W X, Zhong S D, Sui L B, et al. Noncontact measurement of big dimension object based on coordinate measuring machine[J]. Journal of Wuhan University of Hydraulic and Electric Engineering, 2004, 37(5): 112-115.

[4] 解则晓, 金明, 辛悦向. 基于双目立体视觉的光笔式三坐标测量系统[J]. 中国机械工程, 2008, 19(8): 896-899.

Xie Z X, Jin M, Xin Y X. Study on 3D-coordinate measurement technology using light-pen based on binocular stereoscopic vision system[J]. China Mechanical Engineering, 2008, 19(8): 896-899.

[5] 刘一宇. 光笔双目视觉测量系统的研究[D]. 长沙: 中南大学, 2010: 15- 54.

Liu YY. Research on binocular vision measurement system using light pen[D]. Changsha: Central South University, 2010: 15- 54.

[6] 黄风山. 光笔式单摄像机三维坐标视觉测量系统关键技术的研究[D]. 天津: 天津大学, 2005.

Huang FS. Study on the key technique of single camera 3D coordinate vision measurement system using a light pen[D]. Tianjin: Tianjin University, 2005.

[7] 孙试翼, 匡翠方, 刘旭. 基于光场成像的表面三维重构[J]. 应用光学, 2017, 38(2): 210-214.

[8] Adelson E H. Wang J Y A. Single lens stereo with a plenoptic camera[J]. IEEE Transactions on Pattern Analysis & Machine Intelligence, 1992, 14(2): 99-106.

[9] 陈琦, 徐熙平, 姜肇国, 等. 基于光场相机的四维光场图像水印及质量评价[J]. 光学学报, 2018, 38(4): 0411003.

[10] 化春键, 熊雪梅, 陈莹. 基于Sobel算子的工件圆弧轮廓特征提取[J]. 激光与光电子学进展, 2018, 55(2): 021011.

[11] Fischler M A, Bolles R C. Random sample consensus: a paradigm for model fitting with applications to image analysis and automated cartography[J]. Communications of the ACM, 1981, 24(6): 381-395.

[12] KrausS, Arkin RC. Strategic negotiation in multiagent environments[M]. Massachusetts: MIT Press, 2001.

[13] 朱嘉, 李醒飞, 徐颖欣. 摄像机的一种主动视觉标定方法[J]. 光学学报, 2010, 30(5): 1297-1303.

[14] 陈家凤, 陈海清. 智能化红外成像光斑测试仪的研究[J]. 光电工程, 2004, 31(9): 37-40.

[15] 聂云峰, 相里斌, 周志良. 光场成像技术进展[J]. 中国科学院研究生院学报, 2011, 28(5): 563-572.

Nie Y F, Xiangli B, Zhou Z L. Advances in light field photography technique[J]. Journal of the Graduate School of the Chinese Academy of Sciences, 2011, 28(5): 563-572.

[16] Adelson E H. The plenoptic function and the elements of early vision[J]. Computational Models of Visual Processing, 1991: 3-20.

[17] LevoyM, HanrahanP. Light field rendering[C]∥Proceedings of the 23rd annual conference on Computer Graphics and Interactive Techniques, August 4-9, 1996, New Orleans, LA, USA. New York: ACM, 1996: 31- 42.

[18] 周志良. 光场成像技术研究[D]. 合肥: 中国科学技术大学, 2012: 25- 39.

Zhou ZL. Research on light field imaging technology[D]. Hefei: University of Science and Technology of China, 2012: 25- 39.

[19] 周宇, 袁艳, 胡煌华, 等. 数字对焦光场成像清晰度评价方法研究[J]. 光子学报, 2010, 39(6): 1094-1098.

[20] 肖相国, 王忠厚, 孙传东, 等. 基于光场摄像技术的对焦测距方法的研究[J]. 光子学报, 2008, 37(12): 2539-2543.

Xiao X G, Wang Z H, Sun C D, et al. A range focusing measurement technology based on light field photography[J]. Acta Photonica Sinica, 2008, 37(12): 2539-2543.

[21] 郑馨, 艾列富, 刘奎, 等. 结合全局和局部灰度变化的显微图像自动聚焦函数[J]. 激光与光电子学进展, 2017, 54(8): 081801.

[22] 汪义志, 张旭东, 熊伟, 等. 光场相机视觉测量误差分析[J]. 光子学报, 2017, 46(11): 1112004.

于之靖, 郑建文, 陶永奎, 吴军. 基于光场成像的三点式光笔测量方法[J]. 激光与光电子学进展, 2020, 57(3): 032001. Zhijing Yu, Jianwen Zheng, Yongkui Tao, Jun Wu. Three-Point Light Pen Measurement Method Based on Light Field Imaging[J]. Laser & Optoelectronics Progress, 2020, 57(3): 032001.