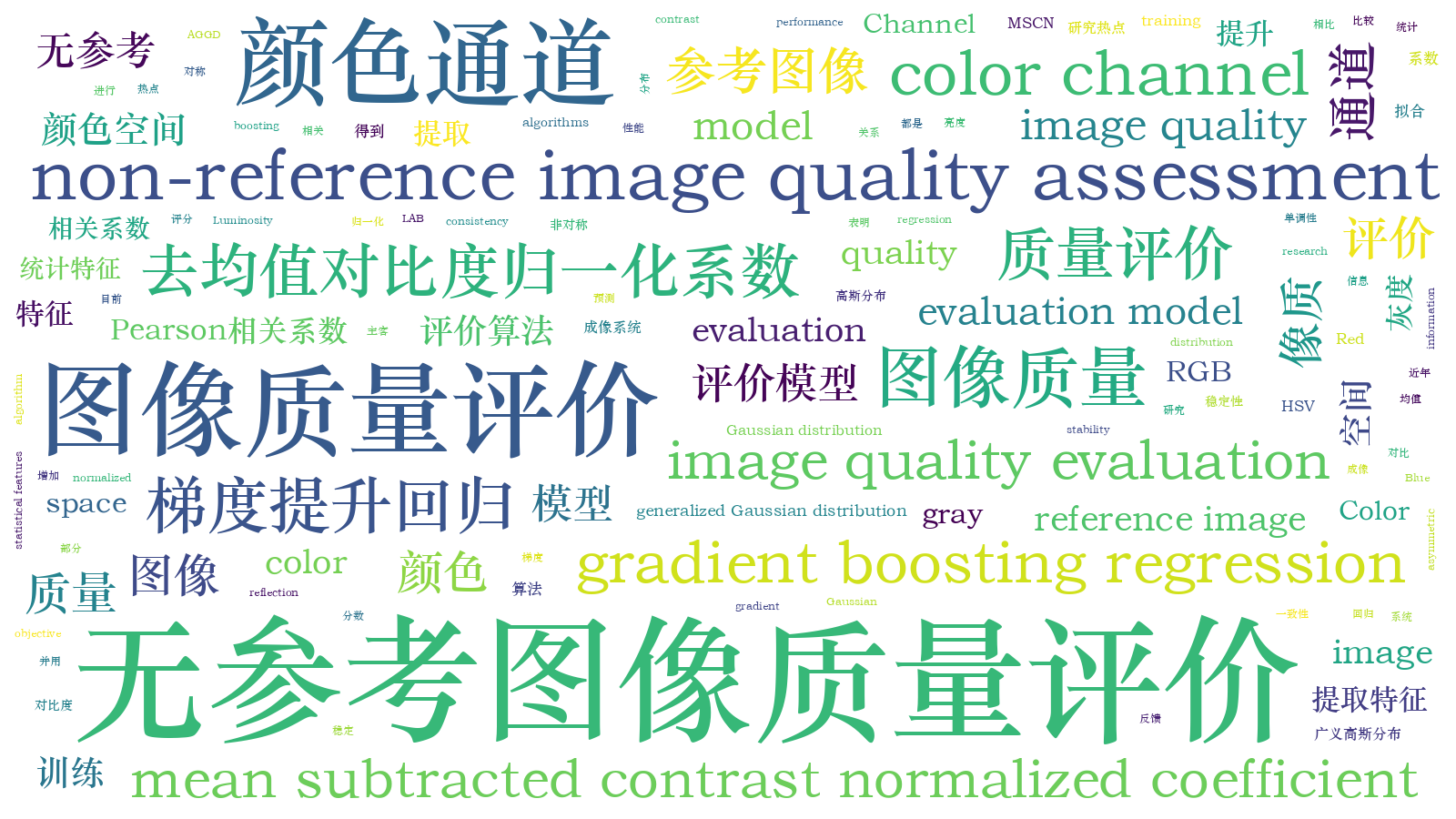

颜色通道下的无参考图像质量评价  下载: 1327次

下载: 1327次

1 引言

随着信息技术的发展,数字图像的应用越来越广泛,对图像质量评价的研究也逐渐增多[1]。现有的图像质量评价算法可分为全参考(FR)、部分参考(RR)和无参考(NR)评价算法,传统的FR和RR评价算法,需要确定原始图像信息,应用范围较小。而NR评价算法不需要以原始图像作为参考,应用较为广泛。现有的NR图像质量评价算法主要分为针对特定失真类型的评价算法和通用型评价算法。针对特定失真类型的图像质量评价算法,如针对块效应、高斯白噪声[2]、JPEG/JPEG2000[3]、对比度[4]、高斯模糊[5]算法,实用性较低。在实际拍摄中,由于图像的失真类型不能事先确定,而通用型NR图像质量评价算法对失真类型没有限制,因此在相关领域得到了广泛应用。

通用型NR图像质量评价算法,主要是基于自然场景统计特征(NSS)的算法。Moorthy等[6]提出了无参考图像质量指标(BIQI)算法,利用图像中的NSS判断图像包含的失真类别和相应的概率,然后针对不同失真类别的评价算法计算图像分数。Moorthy等[7]在BIQI算法的基础上提出了基于失真识别的图像真实性和完整性评价(DIIVINE)算法,利用可控金字塔[8]进行小波分解,提取图像的归一化小波系数统计特征[9],然后利用支持向量机(SVR)建立特征模型。Li等[10]使用四元数小波变换分解立体图像的左右视图,获得去均值对比度归一化(MSCN)系数,并对图像质量进行评价。Huang等[11]利用小波变换分解重构立体图像的左右视图,提出了一种基于图像融合的NR立体图像质量评价算法。Saad等[12]提出了基于离散余弦变换域统计特性的图像完整性评价(BLIINDS)算法,以及改进的BLIINDS-II算法[13]。Mittal等[14]提出了盲/无参考图像空间质量评价(BRISQUE)算法,提取图像的空域特征,通过计算灰度空间像素的归一化亮度[15],利用其统计特性进行建模,对图像的整体质量进行评价。Mittal等[16]还在BRISQUE算法的基础上,提出了自然图像质量评价算法(NIQE),假设无失真的自然图像满足某种统计特性,利用人眼对对比度较高的区域更敏感的特点,在图像中对比度显著区域建立模型。该算法不需要图像的主观评价分数,利用多元高斯模型(MVG)评价图像质量。Zhu等[17]基于清晰度和噪声,建立了一种图像质量评价模型,给出了一套图像质量评价指标。Hou等[18]提出了一种从语言描述方面进行NR图像质量评价的算法。随着神经网络的发展,结合神经网络的图像质量评价算法也越来越多[19-22],同时开始了一些针对图像美学性的评价研究,美学分析方法主要将图像粗略地分为好和坏,Kong等[23]建立了美学属性数据库(AADB),通过卷积神经网络(CNN)训练发现,统一模型可以产生更符合人类评级的美学排名;Talebi等[24]利用深度CNN,提出了基于图像分类器的图像质量和美学预测架构,用预测的平均分对图像进行排名。Xue等[25]提出了基于3类图像特征向量的高光谱超分图像质量评价算法。

传统的通用型NR图像质量评价算法,大都是在灰度空间中提取图像的统计特征,而人眼看到的图像是彩色的。因此本文将BRISQUE算法在灰度空间中提取MSCN系数统计特征的方法应用到RGB(Red,Green,Blue)、HSV(Hue,Saturation,Value)、LAB(Luminosity,A,B)颜色空间中,提取各颜色通道的MSCN系数统计特征,并通过梯度提升回归(GBR)算法训练得到图像质量评价模型,取得了理想的效果。实验结果表明,与灰度空间图像质量评价模型相比,RGB空间蓝色通道(RGB_B)图像质量评价模型在稳定性和主客观一致性的提升较大,Pearson相关系数从0.63提升到0.70,可对传统图像质量评价算法进行补充和提升。

2 特征提取、图像质量评价模型和模型评价

2.1 各颜色通道的MSCN系数统计特征提取

Ruderman等[15]认为图像的失真会改变归一化亮度高斯系数的某些统计特性,可提取归一化亮度利用统计系数特征预测图像质量。Mittal等[14]将图像亮度系数进行归一化,假设图像的尺寸为W×V,亮度为I(i,j),则MSCN系数

式中,i∈{1,2,…,W},j∈{1,2,…,V},μ(i,j)为高斯滤波的结果,σ(i,j)为标准差,C为防止图像平坦时分母接近0取值不稳定的常数,实验取C=1。

式中,Ik,l(i,j)为高斯滤波前的图像亮度。

式中,ω=

采用非对称广义高斯分布(AGGD)模型拟合

式中,Γ为Gamma函数,α为形状参数,σ2为方差。

由于人眼视觉具有多尺度特性,因此在两个尺度下分别提取18维MSCN系数统计特征更为合理。将图像缩小一半提取MSCN系数统计特征,一共提取36维度特征。Mittal等[14]是在灰度空间提取的MSCN系数统计特征,没有研究图像彩色信息对人眼的影响,而实验提取了RGB、HSV、LAB三种颜色空间中不同颜色通道下的MSCN系数统计特征。

2.2 基于GBR训练得到无参考图像质量评价模型

Valiant[26]提出了强可学习和弱可学习的概念,Freund等[27]证明了弱可学习和强可学习是等价的,即可通过集成学习的方法将一组弱可学习转化为一个强可学习。实验采用GBR算法产生的强学习器是一组弱学习器的线性组合,采用最速下降法(SDM)寻找最优解,通过迭代的方式减小误差,使预测值和样本真实值最为接近。GBR算法的步骤如下[28]。

给定训练集为

式中,h为给定结构的弱学习类型,am为弱学习器的方向参数,βm为弱学习器的权重,M为弱学习器个数。

初始化模型为

式中,N为训练样本个数,L为损失函数,argminρ为使F0(x)最小时ρ的取值。

梯度函数为

前进方向为

式中,argmina,β为使am最小时a,β的取值。最优前进步长为

得到新的Fm为

第M步得到的FM(x)函数就是最终的强学习器,即图像质量的评价模型,将提取的36维MSCN系数统计特征代入该模型,预测图像得分。

2.3 图像质量评价性能标准

通过对比各个颜色通道训练模型预测的图像分数,结合Pearson相关系数,分析各个颜色通道图像质量评价模型的优劣。Pearson相关系数用来衡量预测分数与主观分数的一致性,记为r,取值范围为[-1,1],当r>0时,表明预测分数和主观分数正相关;当r<0时,表明预测分数和主观分数负相关,r的绝对值越大表明相关性越强。

式中,sv、

3 实验

3.1 颜色通道下的MSCN系数分布特性

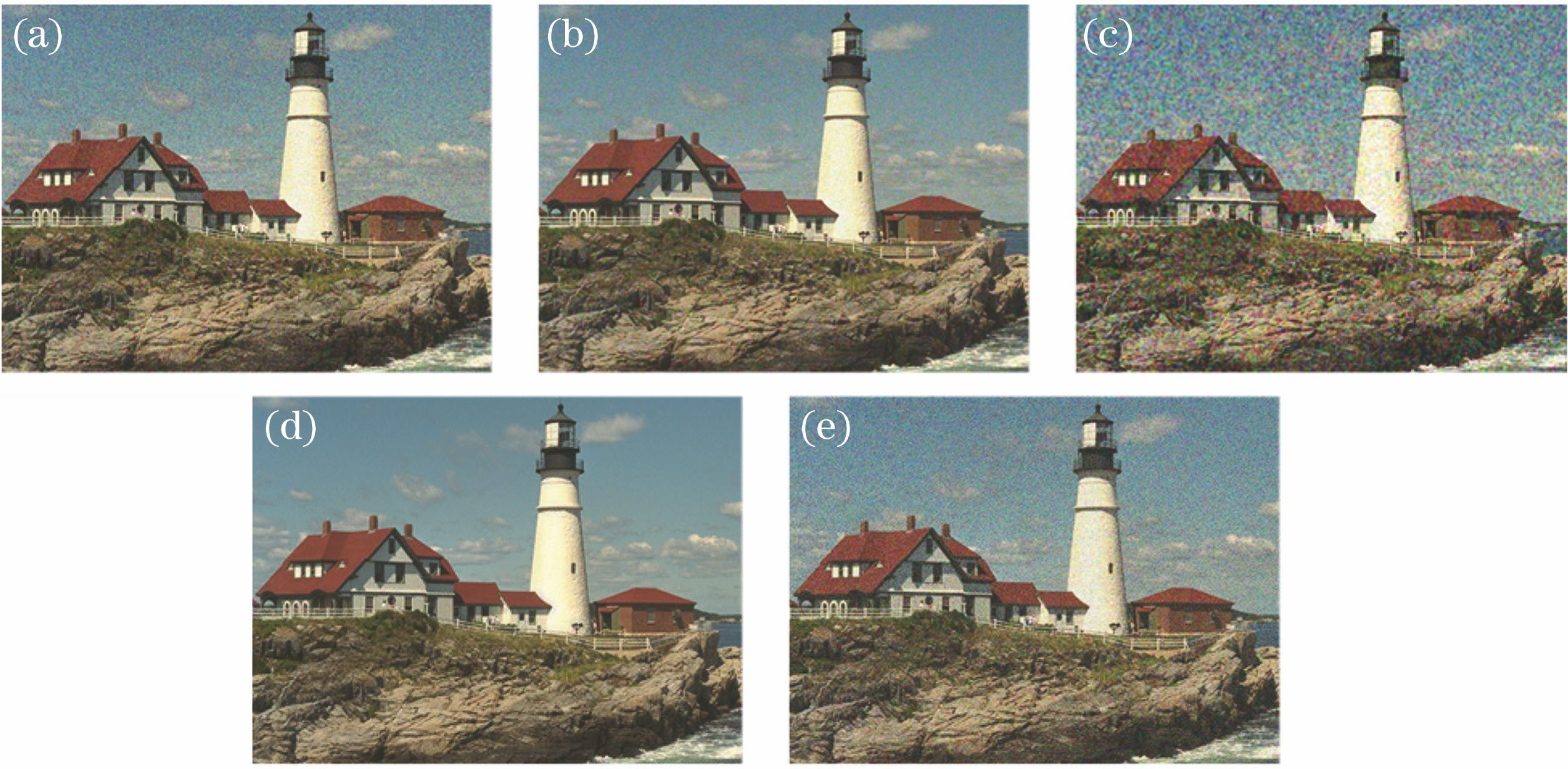

图像失真会使图像在灰度空间的MSCN系数统计特征发生改变,可通过计算MSCN系数变化量对图像质量进行评价。为验证图像的失真在颜色空间中对MSCN系数的影响,从TID2013数据集中选取同一场景下5幅不同失真类型的图像(如

综上所述,在颜色空间各个通道中,失真会导致各通道提取的MSCN系数分布发生变化,因此可以利用颜色通道提取的MSCN系数特征评价图像质量。

图 1. 5幅不同失真类型的图像。(a)加性高斯噪声;(b)色彩分量上的加性噪声;(c)空间相关噪声;(d)掩蔽噪声;(e)高频噪声

Fig. 1. Five images of different distortion types. (a) Additive Gaussian noise; (b) additive noise in colorcomponent; (c) spatially correlated noise; (d) masked noise; (e) high frequency noise

图 2. 5幅不同失真级别的加性高斯噪声图像。(a)~(e) 1~5级

Fig. 2. Five additive Gaussian noise images of different distortion levels. (a)-(e) Level 1-5

图 3. 5幅不同失真类型图像的MSCN系数分布。(a) HSV_H通道;(b) HSV_S通道;(c) HSV_V通道;(d)灰度空间

Fig. 3. MSCN coefficient distribution of 5 images with different distortion types. (a) HSV_H channel; (b) HSV_S channel; (c) HSV_V channel; (d) gray space

图 4. 5幅不同失真级别图像的MSCN系数分布。(a) HSV_H通道;(b) HSV_S通道;(c) HSV_V通道;(d)灰度空间

Fig. 4. MSCN coefficient distribution of 5 images with different distortion levels. (a) HSV_H channel; (b) HSV_S channel; (c) HSV_V channel; (d) gray space

3.2 颜色通道下提取图像特征构建图像质量评价模型

为改善传统算法中缺少对图像彩色信息提取的问题,分别提取了RGB、HSV、LAB等颜色空间中各颜色通道下的MSCN系数特征,并用机器学习GBR算法训练的各颜色通道对应的图像质量评价模型。以RGB_R颜色通道为例,提取该通道的MSCN系数统计特征训练得到图像质量评价模型,并预测图像质量,如

图 5. RGB_R通道图像质量评价模型流程图

Fig. 5. Flow chart of RGB_R channel image quality evaluation model

TID2013数据集中包含3000幅失真图像,由25幅参考图像的24种不同失真类型组成,每种失真类型有5个级别的失真强度,且每张失真图像都有对应的主观评分。将这些图像按4∶1划分为两组,2400幅作为训练集用于机器学习的训练,剩余600幅作为测试集,用于评估算法训练模型的性能,保证两个集合中没有重复或者相似的图像,有利于评价算法性能的准确性。

将测试集图像按场景和失真类型分组,将同一场景同一失真类型的图像作为一组,每组5幅图像,图像失真等级从1至5,表示图像失真由弱到强。用RGB_B通道训练模型的预测分数,计算其Pearson相关系数,并与灰度空间训练模型进行比较,分析不同颜色通道下图像质量评价模型的优劣,结果如

从

表 1. 灰度空间模型和RGB_B通道模型对24幅失真图像评分的Pearson相关系数

Table 1. Pearson coefficients of gray space model and RGB_B channel model for 24 distorted images

|

从

为验证算法的整体效果,用各颜色通道下训练好的模型对600幅测试图像打分,并与图像的主观分数进行对比,得到的Pearson相关系数如

可以看出,从灰度空间提取MSCN系数统计特征的方法在颜色通道也得到了很好的效果,其中性能最好的是RGB_B通道,相比灰度空间的Pearson相关系数(0.63),RGB_B通道的Pearson相关系数达到了0.70,主客观一致性更好。且部分颜色通道采用MSCN特征提取方法,训练得到的整体效果比灰度空间有较大提升。

图 6. 各颜色通道训练模型对第11类失真图像评分

Fig. 6. Scores of the 11th type of distorted images for each color channel training model

图 7. 各颜色通道训练模型对第20类失真图像评分

Fig. 7. Scores of the 20th type of distorted images for each color channel training model

表 2. 不同颜色通道图像质量评价模型的Pearson相关系数

Table 2. Pearson coefficients obtained by image quality evaluation model of different color channels

|

用灰度空间下提取的图像MSCN系数统计特征训练得到的图像质量评价模型,主观评分无法准确判断失真强弱时,会对灰度空间模型产生负面影响。而用颜色通道提取的图像MSCN系数统计特征训练得到的图像质量评价模型时,预测分数能很好地判断图像的失真情况,对灰度空间提取特征有一定补充和提升。实验结果表明,RGB_B通道训练模型相较于灰度空间训练模型提升最大,这说明在RGB_B通道下,特别是在失真等级较低时,模型预测图像分数比灰度空间的主客观一致性更高,且性能更加稳定。

1) 对RGB颜色空间的结果分析

从

式中,R、G、B分别为RGB中红色通道、绿色通道和蓝色通道的亮度。可以发现,RGB三通道中,RGB_G通道加权最多,RGB_R通道加权次之,RGB_B通道加权最小。单独对三通道进行图像特征提取时,得到的Pearson相关系数却是RGB_B通道最大,RGB_G通道次之,RGB_R通道最小。

2) 对HSV颜色空间的结果分析

从

式中,H为色调,S为饱和度,V为明度。可以发现,不管变量如何变化,(17)式中分数部分的绝对值不会大于60,R,G,B三个数值越相近,得到的H反映图像的色调组成准确性越低,这可能是导致HSV_H通道训练模型Pearson相关系数最低的原因。

3) 对LAB颜色空间的结果分析

将R、G、B转换到LAB空间的公式为

其中

式中,Xn,Yn,Zn默认取值为95.047,100.000,108.883,L为亮度,A为红绿通道,取正数表示红色,取负数表示绿色,取值范围为[127,-128],B为黄蓝通道,取正数表示黄色,取表示代表蓝色,取值范围为[127,-128]。可以发现,LAB颜色空间对于自然场景的图像来说,具有各通道相关性最小的特点,从

4 结论

通过研究HSV、RGB、LAB颜色空间中颜色通道的MSCN系数分布特性,发现失真会使各个颜色通道的图像MSCN系数统计特征发生变化。提取了各颜色通道的MSCN系数统计特征,通过GBR算法训练,得到对图像混合失真的通用NR图像质量评价模型,相比灰度空间,模型的单调性、主客观一致性、稳定性都得到了提升。实验结果表明,相比灰度空间,在RGB_B通道下提取特征训练得到的Pearson相关系数提升最大,从0.63提升到0.70,进一步表明图像彩色信息和人眼视觉特征之间的特殊规律具有很大的研究价值。

[1] 王志明. 无参考图像质量评价综述[J]. 自动化学报, 2015, 41(6): 1062-1079.

Wang Z M. Review of No-reference image quality assessment[J]. Acta Automatica Sinica, 2015, 41(6): 1062-1079.

[2] ZhuT, KaramL. A no-reference objective image quality metric based on perceptually weighted local noise[J]. EURASIP Journal on Image and Video Processing, 2014( 1): 5.

[3] HoritaY, ArataS, MuraiT. No-reference image quality assessment for JPEG/JPEG2000 coding[C]∥2004 12th European Signal Processing Conference, September 6-10, 2004, Vienna, Austria. New York: IEEE, 2004: 1301- 1304.

[4] Fang Y M, Ma K D, Wang Z, et al. No-reference quality assessment of contrast-distorted images based on natural scene statistics[J]. IEEE Signal Processing Letters, 2014, 22(7): 838-842.

[6] Moorthy A K, Bovik A C. A two-step framework for constructing blind image quality indices[J]. IEEE Signal Processing Letters, 2010, 17(5): 513-516.

[9] Rao R, Olshausen B, Lewicki M, et al. Natural image statistics and divisive normalization: modeling nonlinearities and adaptation in cortical neurons[J]. Statistical Theories of the Brain, 2001: 203-222.

[10] 李一凡, 李朝锋, 桑庆兵. 四元数小波变换优化单目图的无参考立体图像质量评价[J]. 激光与光电子学进展, 2019, 56(18): 181006.

[11] 黄姝钰, 桑庆兵. 基于图像融合的无参考立体图像质量评价[J]. 激光与光电子学进展, 2019, 56(7): 071004.

[12] Saad M A, Bovik A C, Charrier C. A DCT statistics-based blind image quality index[J]. IEEE Signal Processing Letters, 2010, 17(6): 583-586.

[13] Saad MA, Bovik AC, CharrierC. DCT statistics model-based blind image quality assessment[C]∥2011 18th IEEE International Conference on Image Processing, September 11-14, 2011, Brussels, Belgium. New York: IEEE, 2011: 3154- 3157.

[15] Ruderman D L. The statistics of natural images[J]. Network Computation in Neural Systems, 2009, 5(4): 517-548.

[17] Zhu YC, Zhai GT, GuK, et al. No-reference image quality assessment for photographic images of consumer device[C]∥2016 IEEE International Conference on Acoustics, Speech and Signal Processing, March 20-25, 2016, Shanghai, China. New York: IEEE, 2016: 1085- 1089

[18] Hou W, Gao X, Tao D, et al. Blind image quality assessment via deep learning[J]. IEEE Transactions on Neural Networks & Learning Systems, 2017, 26(6): 1275-1286.

[19] 顾婷婷, 刘新会, 桑庆兵, 等. 基于双树复小波的无参考立体图像质量评价[J]. 计算机工程与应用, 2019, 55(2): 154-161.

Gu T T, Liu X H, Sang Q B, et al. No-reference image quality assessment algorithm for stereoscopic images via dual-tree complex wavelet transform[J]. Computer Engineering and Applications, 2019, 55(2): 154-161.

[20] Yan J, Bai X, Zhang W, et al. No-reference image quality assessment based on AdaBoost BP neural network in wavelet domain[J]. Journal of Systems Engineering and Electronics, 2019, 30(2): 5-19.

[21] 刘迪, 李迎春. 基于深度学习和人眼视觉系统的遥感图像质量评价[J]. 激光与光电子学进展, 2019, 56(6): 061101.

[22] 陈寅栋, 李朝锋, 桑庆兵. 卷积神经网络结合深度森林的无参考图像质量评价[J]. 激光与光电子学进展, 2019, 56(11): 111003.

[23] KongS, ShenX, LinZ, et al. Photo aesthetics ranking network with attributes and content adaptation[M] ∥Leibe B, Matas J, Sebe N, et al. Computer Vision-ECCV 2016. Lecture Notes in Computer Science. Cham: Springer, 2016, 9905: 662- 679.

[24] Talebi H, Milanfar P. NIMA: neural image assessment[J]. IEEE Transactions on Image Processing, 2018, 27(8): 3998-4011.

[25] 薛松, 张思雨, 刘永峰. 高光谱超分图像质量评价[J]. 激光与光电子学进展, 2019, 56(4): 041001.

[26] Valiant L G. A theory of the learnable[J]. Communications of the ACM, 1984, 27(11): 1134-1142.

[27] FreundY, Iyer RD, Schapire RE, et al. An efficient boosting algorithm for combining preferences[C]∥Proceedings of the Fifteenth International Conference on Machine Learning, July 24-27, 1998, Madison, Wisconsin, USA.1998, 4( 6): 170- 178.

[28] Natekin A, Knoll A. Gradient boosting machines, a tutorial[J]. Frontiers in Neurorobotics, 2013, 7: 21.

Article Outline

乔子昂, 刘涛. 颜色通道下的无参考图像质量评价[J]. 激光与光电子学进展, 2020, 57(12): 121101. Ziang Qiao, Tao Liu. Non-Reference Image Quality Evaluation in Color Channel[J]. Laser & Optoelectronics Progress, 2020, 57(12): 121101.