基于并行深度残差网络的堆场烟雾检测方法  下载: 1314次

下载: 1314次

1 引言

堆场的安全问题,尤其是火灾预警一直是消防安全领域的一个重要课题。据公安部消防局统计,2015年,全国共接报火灾33.8万起,造成1742人死亡、1112人受伤,直接财产损失达39.5亿元[1]。火灾发生前期通常会产生烟雾,如果能够及时地检测到烟雾,则可以提供更早的火灾预警,减少人员伤亡和财产损失[2]。现有的烟雾检测方法通常基于颜色、纹理、形状、运动等特征。Yu等[3]基于颜色和运动特征的烟雾检测方法,首先通过背景提取和颜色确定候选烟雾区域,然后计算Lucas-Kanade光流将烟雾与其他候选区域区分开来,最后采用反向传播神经网络完成分类识别。Yuan[4]通过构造三层多尺度的图像金字塔,然后利用基于变量的局部二值模式检测纹理。Ho[5]利用烟雾区域的周长和面积之比来表达烟雾形状的复杂性,然后综合颜色规则、运动检测,利用模糊逻辑对烟雾进行识别。

尽管现有的方法在烟雾检测方面取得了一定的成果,但在堆场环境的实际应用中仍然存在一些问题,主要原因在于烟雾的静态特征如颜色、纹理等受天气、光照、时间等影响变化范围太大,而动态特征如背景建模或者帧间差分通常基于阈值,阈值对检测结果影响较大。烟雾检测目前所使用的方法对某些特定场合可能非常有效,而对其他场合效果不佳,没有提取出烟雾的本质特征[6]。

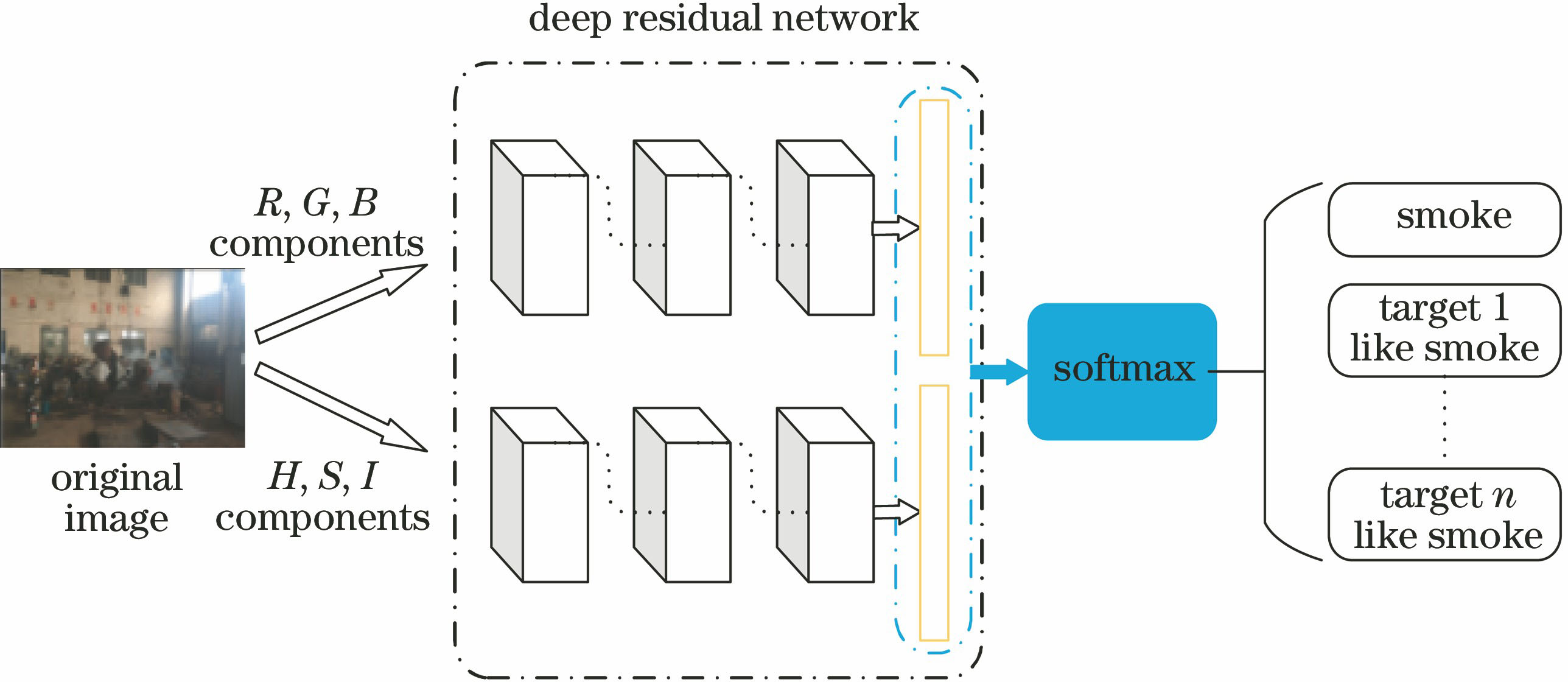

近年来,深度卷积神经网络在人脸识别、图像分类等方面取得了突破性进展。深度卷积神经网络能以原始图像作为输入,通过组合浅层特征形成更加抽象的高层特征,以发现数据的更深层次分布式特征表示,避免人工提取特征工作的繁复冗杂[7-8]。但常规的深度卷积神经网络在训练更高层的网络时,易性能退化导致精度下降,深度残差网络(ResNet)的出现解决了这一问题。本文将在深度卷积神经网络基础上发展而来的深度残差网络引入到烟雾纹理特征提取,提出一种基于并行深度残差网络的烟雾检测方法,将图像的不同表达形式通过深度残差网络进行特征提取并合并的方式,以更全面地表达图像信息。实验结果显示,本文方法在烟雾识别的检出率、准确率,以及误检率上均表现良好。

2 面向堆场烟雾检测的并行深度残差网络

由于烟雾在不同环境、不同时间的变化差异很大,导致现有的检测方法误报率偏高,且通用性不好,对训练集中未出现的烟雾样本检出率偏低。为降低烟雾检测的误报率,提升对未知场景烟雾的检出率,本文从网络输入输出、样本构造,以及分类等方面进行改进,同时引入深度残差网络。本文方法的整体框架如

2.1 并行深度残差网络的输入及输出

现有的烟雾检测方法通常采用RGB图像,考虑到烟雾具有一定的与颜色相关的视觉特征,比如人眼区分烟雾与非烟雾物体通常会用到色调、亮度等信息,因此本文将图像的不同编码方式作为网络的输入,将网络学习到的特征结合,更全面地表达烟雾信息。Krstinic等[9]通过实验发现RGB和HSI颜色空间是区别烟与非烟效果较好的颜色空间。因此本文选择RGB和HSI图像作为并行深度残差网络的输入,具体做法是将RGB和HSI图像分别输入到单路深度残差网络中,训练得到深度残差网络模型,并将两个单路深度残差网络模型获得的特征结合,作为Softmax分类器的输入特征进行训练,得到烟雾识别结果。

传统的烟雾识别仅考虑烟雾和非烟雾两种类别(即网络的输出只有两类)。当检测环境存在天空中的云、静止的白色物体等类烟物体,网络通常会误报,如

2.2 深度残差网络的结构及学习算法

深度卷积神经网络的深度与训练样本数量存在着互相适应的关系,当训练样本数量增加时,网络的深度也需要增加,而常规的深度卷积神经网络通常采用平原网络,训练层数更多的网络易产生性能退化问题,即网络的准确度在达到饱和后迅速下降[10-12]。研究结果表明,网络性能的退化并不是由过度拟合造成的[13-14],其原因在于常规的深度卷积神经网络难以通过多层网络拟合出所需的同等函数。深度残差网络的出现,在保留深度卷积神经网络自适应提取特征优点的同时,较好地解决了网络性能退化问题,该网络通过增加一个近似同等函数层,减小拟合的难度,减少计算量[15]。

2.2.1 深度残差网络的结构

采用ResNet 50作为网络的基本结构,其各层参数配置如

表 1. ResNet 50网络结构

Table 1. Network structure of ResNet 50

|

2.2.2 深度残差网络的学习算法

残差概念的引入基于如下假设:如果能够以恒等映射的方式来构建所增加的层,那么一个深层网络则退化为浅层网络,至少深层网络的训练误差不会大于它所基于的较浅模型。如

而在残差网络中,

残差网络学习的是残差函数

式中

2.3 样本构造

为进一步提高网络的性能,减少对负样本的误报率,本文从样本扩边以及类烟负样本强化学习两个方面进行改进。

1) 样本扩边。烟雾具有模糊背景的特性,即烟雾与背景的交界不明显。常规的深度卷积神经网络通常忽视这一点,本文为了有效利用这一特征,将训练集中所有正负样本标注的真实框采取1.2倍的扩边操作后进行训练,使网络能够学习烟雾边缘模糊的特征,增强模型的判别能力。

2) 类烟负样本强化学习。在训练过程中,用于训练的类烟负样本数量往往偏少,导致网络对这类样本的识别能力不够。本文通过复制该类负样本以及仿射变换制作负样本的方式,扩充训练集,加强网络对这些负样本的学习。

通过上述方法,网络能有效地区分烟雾与类烟物体,误报率明显降低。

3 实验及分析

3.1 样本选取及实验环境

本实验所用视频来源于网络及实验拍摄,选取的视频为各种场景下的烟雾视频及非烟雾视频,部分实验视频如

测试集从29个不同场景挑选1243张图像进行测试,包含1124张含烟雾图像和119张无烟雾图像,其中22个场景用于验证实验,7个用于测试实验。验证实验为已知场景(场景部分样本参与网络训练),从22个验证场景中挑选1032张未参与网络训练的图片进行测试,比较并行网络与单路网络的检测效果。测试实验为未知场景(场景所有样本均未参与网络训练),从7个测试场景挑选211张图片进行测试,比较并行网络与单路网络的稳健性以及漏报、误报情况,更全面地评估模型性能。现有的烟雾检测方法通常采用RGB图像,因此本文中单路深度残差网络除输入RGB图像外,其余设置与并行网络一致。每帧图像的平均检测时间为200 ms,基本满足堆场实时烟雾检测的需求。

3.2 置信值及评价指标

对检测到的目标,分类器会给出目标类别以及是这个类别的概率,这个概率称之为置信值。鉴于堆场火灾预防的重要性,即使置信值较低的检测目标也可能是真实烟雾,因此需要考虑在内。本文将置信值分为以下几级:0.1、0.2、0.3、0.4、0.5、0.6、0.7、0.8、0.9、0.95、0.98。

实验的指标为检出率、误报率,以及受试者工作特征(ROC)曲线,由于实际检测中仅考虑真实烟雾是否检出,不需要True Negative值,所以检出率与漏报率之和为1。模型的漏报率和误报率越低越好,故ROC曲线图改为不同置信值下漏报率与误报率的变化情况,曲线越接近坐标原点说明模型的性能越好。烟雾检出率、误报率和漏报率公式分别为

式中

3.3 实验结果

部分检测结果如

3.3.1 验证实验

将本文方法与单路深度残差网络在22个验证场景下进行实验比对,结果如

表 2. 验证场景单路网络与并行网络的检出率和误报率

Table 2. Detection rate and false positive rate of validation scenarios with single and parallel network%

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

图 7. 验证场景并行网络与单路网络的ROC曲线图

Fig. 7. ROC curves of validation scenarios with parallel and single network

3.3.2 测试实验

将本文方法与单路深度残差网络在7个测试场景下进行实验比对,结果如

综上所述,在训练样本完全一致的情况下,改进后的并行网络模型的训练效果比单路网络好,同时模型性能远优于单路网络,尤其是在未知场景下,大幅度提升检出率的同时降低了误报率。从数据可以看出,无论是并行网络还是单路网络,在未知场景下检出率并不是十分理想,说明基于深度卷积神经网络的方法同样具有缺陷,模型的深度与训练样本数量为匹配关系,存在着欠拟合、过拟合等问题,本文网络模型的训练还有提升的空间。

表 3. 测试场景单路网络与并行网络的检出率和误报率

Table 3. Detection rate and false positive rate of test scenarios with single and parallel network%

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

图 8. 测试场景并行网络与单路网络的ROC曲线图

Fig. 8. ROC curves of test scenarios with parallel and single network

4 结论

深度学习在人工智能领域取得重要的突破,尤其在语音识别、自然语言处理、计算机视觉、图像与视频分析等领域均取得了巨大成功。为此提出了一种基于并行深度残差网络的堆场烟雾检测方法,通过多形式输入构建并行深度残差网络模型,自适应得到烟雾特征,同时对网络输入、样本构造及分类等方面进行了改进。实验结果验证了本文方法的可行性和实时性,不仅提升了烟雾检出率,而且降低了误报率,提升了模型的稳健性。

[1] 黄祖华. 浅议单位消防安全培训[J]. 水上消防, 2016, 37(5): 15-17.

Huang Z H. Brief discussion unit fire safety training[J]. Marine Fire, 2016, 37(5): 15-17.

[2] 姜明新, 王洪玉, 蔡兴洋. 基于码本模型和多特征的早期烟雾检测[J]. 中国图象图形学报, 2012, 17(9): 1102-1108.

Jiang M X, Wang H Y, Cai X Y. Early smoke detection based on codebook model and multiple features[J]. Journal of Image and Graphics, 2012, 17(9): 1102-1108.

[6] 罗胜, Jiang Yuzheng. 视频检测烟雾的研究现状[J]. 中国图象图形学报, 2013, 18(10): 1225-1236.

Luo S, Jiang Y Z. State-of-art of video based smoke detection algorithms[J]. Journal of Image and Graphics, 2013, 18(10): 1225-1236.

[7] 刘帆, 刘鹏远, 李兵, 等. TensorFlow平台下的视频目标跟踪深度学习模型设计[J]. 激光与光电子学进展, 2017, 54(9): 091501.

[8] 叶国林, 孙韶媛, 高凯珺, 等. 基于加速区域卷积神经网络的夜间行人检测研究[J]. 激光与光电子学进展, 2017, 54(8): 081003.

[12] He KM, Zhang XY, Ren SQ, et al. Delving deep into rectifiers: surpassing human-level performance on ImageNet classification[C]. 2015 IEEE International Conference on Computer Vision (ICCV), 2015: 1026- 1034.

[13] LeCun Y A, Bottou L, Orr G B, et al. . Efficient backprop[J]. Neural Networks: Tricks of the Trade, 2012: 9-48.

[14] He KM, SunJ. Convolutional neural networks at constrained time cost[C]. 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2015: 5353- 5360.

[15] He KM, Zhang XY, Ren SQ, et al. Deep residual learning for image recognition[C]. 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2016: 770- 778.

Article Outline

王正来, 黄敏, 朱启兵, 蒋胜. 基于并行深度残差网络的堆场烟雾检测方法[J]. 激光与光电子学进展, 2018, 55(5): 051008. Zhenglai Wang, Min Huang, Qibing Zhu, Sheng Jiang. Smoke Detection in Storage Yard Based on Parallel Deep Residual Network[J]. Laser & Optoelectronics Progress, 2018, 55(5): 051008.