基于优化区域卷积神经网络的机场区域检测  下载: 1375次

下载: 1375次

1 引言

近年来遥感成像[1]技术得到了快速发展,其成像分辨率越来越高,获取信息的能力也逐渐增强,因此如何对遥感图像进行充分挖掘利用成为了目前计算机视觉和遥感研究的一个热点话题[2]。机场作为军用和民用的重点建设目标,目前已经成为了目标检测领域的“宠儿”[3]。

许多研究人员对这一问题进行了相关研究并在文献中发表了有价值的研究结果。Zhao等[4]结合Hough变换和基于图形的视觉显著性(GBVS)方法结合进行机场检测,Tao等[5]结合了分割区域和尺度不变特征变换(SIFT)特征结合统计方法进行机场检测,大大加速了机场目标的检测速度但同时都存在人工设计特征的局限性。Zhu等[6]从几何显著性和局部熵结合的显著图上得到感兴趣区域(ROIs),再利用AlexNet识别网络迁移学习来进行机场识别,Zhang等[7]在先验知识的基础上提出了一种机场呈线性特征的区域建议方法,并结合 卷积神经网络(CNN)来进行机场的检测,发挥了CNN强大的分类能力,在一定程度上提高了检测率,但是对于区域建议(region proposal)的选取依然都存在传统方法的局限性。Chen等[8]将深度置信网络(DBN)用于飞机检测,发挥了DBN很强的分类能力,但检测性能较低且时间成本较高。戴陈卡等[9]将Faster R-CNN和多部件结合方法用于机场飞机检测,大大提高了检测性能且降低了时间成本,但由于数据集等条件限制,对小目标飞机特征提取不足,检测不理想。朱明明等[10]在卷积神经网络的基础上应用特征融合和软判决的方式对其进行了改进,有效地提高了对小目标的检测率和遮挡问题。单倩文等[11]基于改进的多尺度特征图算法对网络提取的特征图进行了融合、降维以及与注意力机制的结合,较为有效地提高了检测精度。张超等[12]基于困难样本挖掘与残差网络结合的方式进行目标检测,在一定程度上提高了检测精度且未增加较大检测时间。但是众实验多是建立在自然图像基础上或相似拍摄距离和固定的垂直视角下的单目标或者目标种类、数量较少且背景较为简单的遥感图像基础上,对不同拍摄距离、不同视角和较为复杂背景下的目标数据集较少,而不同高度,不同视角等得到的同一目标图像差别很大[13-14],这也是造成遥感图像检测鲁棒性不足的原因。

针对机场、民航飞机、战斗机、运输机、直升机、油罐以及桥梁的不同高度,尤其是超高空下的机场快速搜索检测和远距离下的其余目标精确检测,以及多视角下的检测问题,本文基于目前应用广泛的深度学习技术,提出了一种通过自主构建包含更多尺度、视角的目标数据库和优化区域卷积神经网络进行自学习地特征提取并训练出相应权重模型来对不同距离、不同视角、复杂背景下目标进行精确的分类和定位的方法。最后通过实验以及与其他算法和原网络的对比,证明了本文算法的有效性和有意义性。

2 区域卷积神经网络的特点与优化

2.1 区域卷积神经网络的特点及其局限性

2.1.1 网络的构成特点以及实现机场区域检测的原理

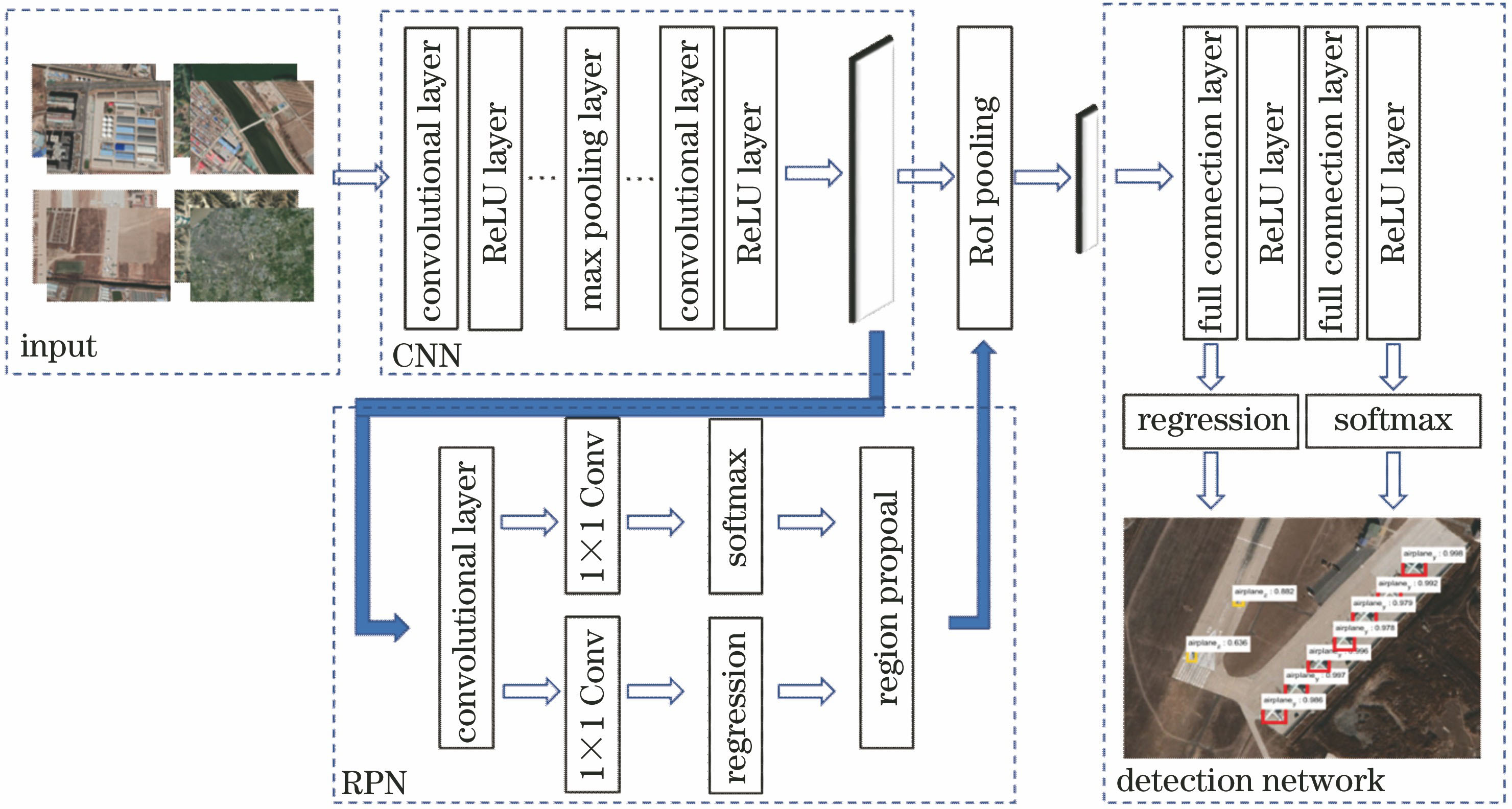

区域卷积神经网络是目标检测中使用最多的神经网络,其中Faster R-CNN[15]是该类网络的集大成者,其检测步骤主要分为两步:区域建议和检测。其检测步骤的主要流程如

1) 网络引入高容量卷积神经网络提取深层特征

现在的目标检测任务中无论是目标的本身复杂特性,如旋转、尺度变换、视角变换,还是背景的复杂特性,如相似物干扰、对比度变换、噪声干扰等,传统的人工设计特征以及一般的特征提取方法想要获得鲁棒性强的特征困难重重。而高容量卷积神经网络具有强大的特征提取能力,它依靠机器大量运算而获得更加鲁棒的特征,避免了由人工设计特征的经验局限性。其主要包括卷积层、激活函数层以及池化层。

卷积层对输入图片进行卷积操作。相关参数为Skernelsize代表卷积核尺寸;Lpad代表扩边处理的长度(如Lpad=1即在矩阵周边填充了一圈0);Sstride代表步长(即每次卷积核移动的长度)。卷积尺寸变换公式为

式中:Soutputsize代表输出图像尺寸;Sinputsize代表输入图像尺寸。

激活函数层主要作用为增加神经网络模型的非线性,让神经网络不仅局限于矩阵的线性运算。

池化层主要对经过卷积操作的矩阵进行降维处理。

2) 区域建议网络(RPN)用于更快地进行区域建议

区域建议网络使得建议区域的提取过程放在特征图上,显而易见,更低分辨率的特征图代表了更小的计算量,因此大大降低了由网络在原图上滑动窗口以及建议框重叠部分被多次重复提取特征所带来的时间和存储空间上的消耗,在很大程度上改善了模型设计的检测速度性能。

区域建议网络主要用于建议区域的生成,首先会依据不同的比例以及面积对每个锚点来生成9个锚框(anchor),在原算法中取值为1282、2562、5122像素点三个面积以及1∶1、1∶2、2∶1三个长宽比,共9个尺度。然后通过一定的规则对其进行过滤,只剩下符合要求的锚框,再通过分类函数(softmax)判断是目标还是背景,即只进行是或不是目标的二分类判断;同时定位回归函数用来修正锚框的位置坐标,进而较为精确地建议区域。

其中区域建议网络的权重更新以达到能够预测框的能力是通过对比真实目标标注框(ground truth)与锚框之间的偏移量来学习的。相关公式为

式中:x*、y*、w*、h*分别为真实目标标注框的中心点位置坐标、宽和高;xa、ya、wa、ha分别为锚框的中心点位置坐标、宽和高。

3) 感兴趣池化(RoI Pooling)层以及全连接层构成最终的检测网络

感兴趣池化层主要对区域建议网络生成的建议区域和由模型构建的卷积网络上得来的特征图生成区域特征图,然后进行尺度统一化处理,即假设最后输入全连接层的尺寸要求为h×w,则池化层会把特征图分为h×w个网格,对每个网格元素进行取最大值处理,得到统一的h×w的特征图尺寸。

全连接层主要进行目标的具体分类以及目标区域位置的进一步精确定位,最终得到需要的输出信息。RoI Pooling层和全连接层在算法框架中的位置如

4) 网络实现机场区域检测的原理

本文所检测的机场区域目标均以光学遥感图像为检测对象的源,以上述区域卷积神经网络为检测手段,以最终输出带有定位框和置信度的检测图像为输出。当输入一张待检测的图片后,网络首先将会对图片进行批处理成固定尺寸(网络支持输入任意大小的图片,此项操作是由于全连接层对尺寸有要求),然后进入特征提取网络进行自主特征提取得到一组特征图(VGG16中每组特征图数量为512)。此后,特征图将分为两步:①进入区域建议网络进行建议区域提取;②进入感兴趣池化层与区域建议网络提取的建议区域一起形成池化后的特征图。最后,对感兴趣池化后的特征图进行全连接操作,利用分类损失和定位损失函数完成目标的精确分类和定位并输出最终的检测结果图,完成对机场区域目标的检测。

2.1.2 网络的局限性

合理的区域建议是取得良好目标分类以及定位的基础之一。从上述网络特点可以看出,锚框是进行区域建议的关键,而传统的锚框为1282、2562、5122 像素点三个面积以及1∶1、1∶2、2∶1三个长宽比组合成的9个固定尺度,无法很好地适应多类、多尺度的目标。

网络在训练过程中容易出现正负样本失衡问题,尤其是对复杂背景下的目标检测。在复杂背景目标检测任务中,背景的数量是目标数量的几倍甚至几十倍,若不进行良好的均衡控制会导致训练对负样本(背景)敏感而对正样本(目标)不敏感,从而大大降低检测性能甚至网络失效。

传统的遥感目标检测通常为单类目标的检测,针对多类遥感目标检测(即一张图像上可能具有多类目标)时,网络缺乏类间共存合理性判断,当区域卷积神经网络在进行多类目标检测时,检测的重点放在一个特征分属于各个目标种类的概率大小,所以可能存在不符合先验经验的误检出现,比如在一张图上检测到飞机的同时检测到机场,这是不可能的,因为当检测到飞机时,卫星拍摄高度会降的很低,这时是不可能在图像中出现一个完整机场的。

2.2 网络的改进优化与仿真

1) 基于差异值的锚框生成规则的改进

在锚框的生成规则的改进中,传统且最普遍的方法为人工制定锚框的面积与比例,简便易行且通常可以达到较好的效果,但是由于本文所构建的数据集较复杂,目标尺度众多,甚至同类目标可能存在几十种尺度,因此在考虑算法复杂度的基础上人工制定出几种尺度来符合大部分目标的尺度是很难的。若制定的尺度太小则提取不到目标的全局特征,不利于分类;若制定的尺度太大则不利于获得目标的精确位置信息且会增加卷积等计算量,拖慢检测效率。在此,本文使用差异值算法得到更为精确的锚框尺度。其步骤如

表 1. 差异值算法生成锚框步骤示意

Table 1. Schematic of difference value algorithm generates anchor step

|

在进行差异值计算函数设计时,考虑以机器生成的锚框与真实目标标注框的重合度作为自变量,重合度越大其差异值应该越小。定义差异值的取值范围是(0,¥),当差异值为0时,代表锚框与真实目标标注框完全重合,差异值越大代表锚框与真实目标标注框重合度越小。此外当重合度从0递增时,差异值开始快速衰减以对其敏感而后衰减速度越来越慢,当重合度接近1时有变化不大的差异值。综合考虑,差异值函数定义为

式中:D为差异值;C为重合度;

以机场目标为例,差异值算法生成的锚框以及传统锚框的对比如

图 3. 差异值算法生成的锚框以及传统锚框

Fig. 3. Anchor generated based on the difference value algorithm and traditional anchors

仿真结果如

表 2. T1改进算法与原算法性能对比表

Table 2. Comparison of T1 improved algorithm and original algorithm performance

|

通过

2) 筛选复杂负样本以改善训练样本平衡问题

传统的定义正样本的方法为:在一组框中得分最高的框以及与真实目标标注框的交并比(IoU)大于0.7的框。定义负样本的方法为:在一组框中与真实目标标注框的交并比小于0.3的框。而其余样本框对于训练是没有贡献的。本文所研究的对象具有多尺度特性且多数为较小尺度,因此负样本会很多,很容易引起训练中的正负样本比例失衡问题,进而导致训练对负样本(背景)敏感而对正样本(目标)不敏感。在此,建立筛选网络用于从区域建议网络的非极大值抑制(NMS)算法计算的交并比中选取值在(0,0.15)间的复杂负样本进行训练,以减少可选负样本的量来改善正负样本失衡问题,并通过仿真实验证明了复杂负样本选取的合理性。

图 4. 加入T2的改进算法与原算法P-R曲线对比图

Fig. 4. Comparison of the improved algorithm of adding T2 and the original algorithm P-R curve

仿真结果如

表 3. 加入T2的改进算法与原算法性能对比表

Table 3. Comparison of improved algorithm and original algorithm performance of adding T2

|

通过P-R曲线以及结果对比表可知,筛选网络的加入使得可选负样本控制在交并比值在(0,0.15)之间的负样本而正样本的选取不进行约束,从而在训练过程中正负样本比例得到了一定改善,并且网络可以从复杂负样本中学到更多的区分性特征信息。通过抽取部分数据集进行仿真发现,网络拥有更好的检测曲线特征,相比原算法在多类平均检测精度方面有一定提升,同时筛选网络应用于区域建议网络之中,贯穿于训练和检测的全过程,因此对检测时间会有一定影响。但是计算机读取交并比的值以及进行排序筛选的速度是很快的,因此从仿真结果来看,筛选网络的加入仅增加了非常少的检测时间,可以证明筛选网络以非常小的代价换取了较大的性能提升。

3) 加入先验判决网络来进行类间共存合理性判断

在对Faster R-CNN进行训练测试时,得到了一些不符合常规的检测结果如

通过论证分析可以发现,出现此类误检时通常误检目标置信度较低(一般低于0.7)。因此,本文在检测网络给出类别信息以及置信度之后,在输出最后检测结果之前加入先验判决用来消除这种误检。具体步骤如

表 4. 先验判决算法步骤

Table 4. Prior judgment algorithm steps

|

算法的核心思想为消除在较低的卫星视角进行飞机类目标、桥梁以及油罐目标的检测时可能出现的将其他背景检测为机场的误检,此外也消除在进行机场目标检测时可能出现的将其他背景检测为飞机类目标、桥梁以及油罐目标的误检。并以T3代表本文先验判决算法。

通过抽取部分数据集进行仿真得到平均检测时间如下:Faster R-CNN为0.142 s;Faster R-CNN+T3为0.143 s。

图 6. T3改进算法与原算法的ROC曲线对比图

Fig. 6. Comparison of ROC curve between T3 improved algorithm and original algorithm

工作特性曲线(ROC)如

3 基于优化算法的机场区域目标检测

3.1 数据集的构建及优化

3.1.1 数据集的构建

本文实验用到的数据集为VOC2007[16]格式,具体流程如

本文主要面向的目标检测图像为遥感图像,而且已有文献说明Google map上获取的遥感图像应用于其他传感器时依然有良好的泛化能力[17]。因此应用Google Earth Pro软件提供的遥感图像作为图像截取搜集工作的源,在其中截取不同高度、不同视角以及不同背景下的目标遥感图片。使得神经网络能自主学习多尺度、多视角以及不同背景下的目标。通过这种方式对200多个机场以及场内的飞机、油罐和众多桥梁进行了图像的截取,得到4235张原始图像。所得图像集的目标拥有多尺度、多视角、多类别以及简单/复杂背景特性,图像集的完备性较好。其中,共有机场图像1081张、民航飞机图像1130张、战斗机图像363张、直升机图像413张、运输机图像402张、桥梁图像380张以及油罐图像466张。与传统数据集的特色对比如

表 5. 实验数据集与传统数据集特色对比

Table 5. Comparison of experimental data sets and traditional data sets

|

部分数据集示意如

针对各类目标制定的标签如

表 6. 标签及其对应目标对照表

Table 6. Label and its corresponding target comparison table

|

3.1.2 对数据集的优化处理

1) 数据增强处理

为了使神经网络学习到更多的目标信息,同时也为了减小因数据集容量较小而可能带来的过拟合问题,本文应用翻转、旋转、亮度变换以及增加噪声的常规方式进行了数据增强,使得网络能够学习更多的目标信息,增强目标检测的鲁棒性。考虑到硬件性能的限制,数据集不能过大,因此采用随机扩充的方法使得每张图片随机地被某种方法处理,图像数据量扩充一倍。

2) 对标注信息的快速纠错处理

使用的标签数量为7,且涉及未进行数据增强前多达几千幅的原始遥感图片,因此在进行人工标注时,由于误操作、疲劳等因素会不可避免地会出现错误标记。错误标记包括漏标以及误标,漏标需要人工反复核对才能消除,但是误标是可以规划更快的定位方法的。误标的原因是在进行标注,尤其是小目标的标注时,大量注意力放在更好地调整矩形框尽量准确与其相切,且大量标注软件的标签信息是显示在目标标注框内的,当标注框本身较小时,就容易造成标签的不可完全视化。

在此本文提出如下方式进行误标信息的快速纠正:首先,每类目标的图片放在单独的文件夹中,对一张图上包含多类目标时,按

3.2 仿真环境以及参数设置

1) 平台环境:处理器为Intel(R) Core(TM1) i7-7700 CPU@3.60 GHz 3.60 GHz,安装内存为16.0 GB,操作系统为Windows 64位,显卡为 NVIDIA GeForce GTX 1060 6 GB,实验框架为Caffe,Matlab。

2) 参数设置:采用深度学习的Caffe框架,全连接层和卷积层权重选取VGG16[18]预训练网络初始化,其余新层采用均值为0、标准差为0.01的高斯分布随机初始化;初始学习率设置为0.001,动量设置为0.9,权重衰减设置为0.0005;阈值设置为0.7;训练次数为40000。

3.3 模型的训练及结果分析

3.3.1 模型的训练

共享卷积层可以避免多卷积层重复训练而产生大量计算冗余进而大大提高训练和检测效率,在此采用交替优化策略训练网络实现卷积层共享。训练步骤如

表 7. 算法步骤

Table 7. Algorithm steps

|

3.3.2 本文算法的整体检测结果与分析

通过训练得到的测试结果如

可视化各类目标部分检测结果示意与分析如

表 8. 各目标测试结果汇总表

Table 8. Summary of each target test results

|

通过对以上实验结果分析,证明了改进的区域卷积神经网络同一模型对多类别、多尺度、多视角以及较为复杂背景下检测的可行性。针对大部分目标的检测效果良好,拥有了较高的精确度,同时也暴露了复杂背景下小目标以及小样本目标的检测效果不强的问题,如图中存在超高空较为复杂背景下机场的误检问题,不过较好的结果是通常误检测的目标置信度分数较低,再结合进一步的人工审阅,大多可以进行剔除。但是如

3.4 对比仿真分析

使用高度一致的仿真环境以及网上公开的代码对原算法以及已有的飞机类和机场的检测方法进行对比实验。因为网上对其他目标的检测文献较少且公开代码较少,在此未进行对比。检测结果如

由

表 12. 改进方法与原算法的各类目标检测结果对比

Table 12. Comparison of various target detection results between improved method and original algorithm

| |||||||||||||||||||||||||||||||||||

表 13. 不同检测方法的结果对比

Table 13. Comparison of results of different detection methods

|

4 结论

本文构建了完备性更好、特点更加鲜明的数据集并对Faster R-CNN算法的局限性方面做出了相应改进优化,结果表明,优化算法在仅增加少许检测时间的基础上较大地提高了检测精度,在一定程度上改善了传统遥感图像检测方法对机场区域多种状态下多类目标检测鲁棒性不强的问题。此外,通过仿真得到的区域卷积神经网络目前对数据集的依赖性较强,对数据集中相应图像较少的目标进行尽可能的扩充,以及对模型进行更深层次的改进,以进一步提高检测效果将是下一步研究的主要工作。

[1] Schott JR. Remote sensing[M]. Oxford: Oxford University Press, 2007: 13- 24.

[2] Richards J A. Analysis of remotely sensed data: the formative decades and the future[J]. IEEE Transactions on Geoscience and Remote Sensing, 2005, 43(3): 422-432.

[3] YaoJ, Zhang ZF. Semi-supervised learning based object detection in aerial imagery[C]∥2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR'05), San Diego, CA, USA. IEEE, 2005: 1011- 1016.

[4] Zhao D P, Ma Y Y, Jiang Z G, et al. Multiresolution airport detection via hierarchical reinforcement learning saliency model[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2017, 10(6): 2855-2866.

[6] Zhu TH, Li YH, Ye QK, et al. Integrating saliency and ResNet for airport detection in large-size remote sensing images[C]∥2017 2nd International Conference on Image, Vision and Computing (ICIVC), June 2-4, 2017. Chengdu. IEEE, 2017: 20- 25.

[7] Zhang P, Niu X, Dou Y, et al. Airport detection on optical satellite images using deep convolutional neural networks[J]. IEEE Geoscience and Remote Sensing Letters, 2017, 14(8): 1183-1187.

[8] Chen XY, Xiang SM, Liu CL, et al. Aircraft detection by deep belief nets[C]∥2013 2nd IAPR Asian Conference on Pattern Recognition, November 5-8, 2013. Naha, Japan. IEEE, 2013: 54- 58.

[9] 戴陈卡, 李毅. 基于Faster RCNN以及多部件结合的机场场面静态飞机检测[J]. 计算机应用, 2017, 37(z2): 85-88.

Dai C K, Li Y. Aeroplane detection in static aerodrome based on Faster RCNN and multi-part model[J]. Journal of Computer Applications, 2017, 37(z2): 85-88.

[10] 朱明明, 许悦雷, 马时平, 等. 基于特征融合与软判决的遥感图像飞机检测[J]. 光学学报, 2019, 39(2): 0210001.

[11] 单倩文, 郑新波, 何小海, 等. 基于改进多尺度特征图的目标快速检测与识别算法[J]. 激光与光电子学进展, 2019, 56(2): 021002.

[12] 张超, 陈莹. 残差网络下基于困难样本挖掘的目标检测[J]. 激光与光电子学进展, 2018, 55(10): 101003.

[13] 孙显, 付琨, 王宏琦. 高分辨率遥感图像理解[M]. 北京: 科学出版社, 2011: 13- 25.

SunX, FuK, Wang HQ. High resolution remote sensing image understanding[M]. Beijing: Science Press, 2011: 13- 25.

[14] Richards JA, Jia XP. Remote sensing digital image analysis[M]. Berlin, Heidelberg: Springer Berlin Heidelberg, 1999: 15- 27.

[15] Ren S Q, He K M, Girshick R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[16] VicenteS, CarreiraJ, AgapitoL, et al. Reconstructing PASCAL VOC[C]∥2014 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2014. Columbus, OH, USA. IEEE, 2014: 320- 327.

[17] Chen F. Ren R L, van de Voorde T, et al. Fast automatic airport detection in remote sensing images using convolutional neural networks[J]. Remote Sensing, 2018, 10(3): 443.

[18] QassimH, VermaA, FeinzimerD. Compressed residual-VGG16 CNN model for big data places image recognition[C]∥2018 IEEE 8th Annual Computing and Communication Workshop and Conference (CCWC), January 8-10, 2018. Las Vegas, NV. IEEE, 2018: 440- 446.

[19] WuH, ZhangH, Zhang JF, et al. Fast aircraft detection in satellite images based on convolutional neural networks[C]∥2015 IEEE International Conference on Image Processing (ICIP), September 27-30, 2015. Quebec City, QC, Canada. IEEE, 2015: 4210- 4214.

Article Outline

韩永赛, 马时平, 李帅, 何林远, 朱明明. 基于优化区域卷积神经网络的机场区域检测[J]. 激光与光电子学进展, 2020, 57(10): 101021. Yongsai Han, Shiping Ma, Shuai Li, Linyuan He, Mingming Zhu. Airport Area Detection Based on Optimized Regional Convolutional Neural Network[J]. Laser & Optoelectronics Progress, 2020, 57(10): 101021.