基于离散余弦变换的活性污泥显微图像融合  下载: 879次

下载: 879次

1 引言

图像处理技术和显微成像系统在分析活性污泥图像方面得到了广泛的关注,并广泛应用于污水处理厂污泥体积指数的预测以及污泥膨胀的早期检测和诊断[1]。随着数字图像处理技术的飞速发展,活性污泥显微图像的分析方法从定性分析发展到定量自动化分析。从活性污泥显微图像中提取絮体和细丝的形态学信息,并测量污泥体积指数等化学参数,可以有效观测污水处理厂的运行状态,因此活性污泥显微镜检查是控制和稳定工厂运行的必要途径之一[2-3]。

Costa等[4]研究了活性污泥絮体形态与污泥沉降性能的相关性,并利用了图像分析技术估算活性污泥的沉降性能。Mesquita等[5]分割了丝状细菌相位对比图像以计算形态参数,并使用所得参数来预测污泥体积指数。图像处理技术和显微成像系统是预测沉降性能的潜在监测技术和工具,但要求污泥显微图像有足够大的分辨率及景深。使用显微成像系统获取活性污泥显微图像的过程中,只有在焦平面很小的深度方向上才可以生成清晰的显微图像,景深越小,焦平面深度方向的图像分辨率越高[6]。在同一位置处,除了聚焦良好的图像外,其余位置尤其是边缘部分的图像均会出现模糊的现象,这受限于成像系统的聚焦景深,只有在特定景深处的图像是聚焦的,其余景深处的图像将呈现不同程度的模糊。为了能够得到清晰的显微图像,往往使成像系统先聚焦在场景的其中一部分上,然后再聚焦在场景的另外一部分上,最后将这两幅各自清晰的图像进行融合,最终得到同一场景下各部分都清晰的图像[7-8]。

近年来,基于多尺度分解的算法在图像融合领域十分受欢迎,其主要原理是对每个输入的图像进行多尺度变换,在同一标准下将变换后的系数进行计算及组合,从而得到最佳质量的融合图像。这一标准主要是通过活动水平参数来衡量原图像质量,最终通过活动级别系数的大小来组合原图像[9]。使用这一原理的方法有拉普拉斯金字塔(LP)[10]和梯度金字塔(GP)[11]、基于小波变换的离散小波变换(DWT)[12]和双树复小波变换(DTCWT)[13]以及基于多尺度几何的曲波变换(CVT)[14]和非下采样轮廓波变换(NSCT)[15]。基于小波变换的方法,张肃等[16]对多个偏振特征图像进行融合,可以提高识别效率。基于拉普拉斯金字塔的方法,李清灵等[17]对紫外偏振图像进行融合,可以提高对目标的识别能力。

目前,离散余弦变换(DCT)主要应用于图像压缩领域,其原理是将图像内容转换为另一种信号,在新的信号空间中进行编码压缩,而且不需要大量复杂的计算操作。但DCT较少应用于图像融合领域,应用于图像融合领域的优点是消耗的时间和内存较少,因此处理更为快速。聂敏[18]提出了一种DCT与小波变换相结合的改进算法,该算法的缺点是计算操作复杂。Tang[19]提出了基于局部对比度的图像融合方法,该方法计算方式复杂,使得计算效率降低,处理过程较慢,容易出现图像受损的现象。

Nooshyar等[20]提出了一种基于方差融合准则的方法,虽然该方法可以提高效率以及避免图像模糊,但图像边缘部分不够清晰。为了减小活性污泥显微图像的复杂度以及提高输出图像的质量,本文基于上述方法,首先对图像进行预处理以锐化图像,然后将图像块系数的方差作为活动水平测量的对比标准,使用一致性验证(CV)方法提高输出图像的质量,最后使用双边滤波器进行CV处理。实验结果表明,该方法在融合图像边缘部分以及降低计算复杂度方面都有比较明显的提高。

2 基于DCT图像融合算法

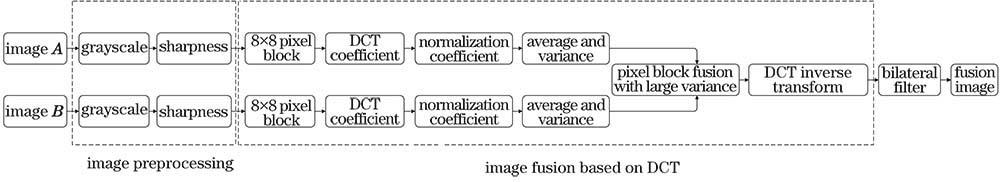

融合算法的框架如

1)假设融合两张图像。

2)将两张待融合图像进行预处理,先对图像进行灰度化的预处理,使用Sobel算子对图像进行边缘增强处理,再采用“原图+增强后图像”的方法来锐化图像。

3)将输入图像分成8×8个块,计算每个块的DCT系数并进行归一化处理,计算子块的系数均值及方差,其中系数方差大的子块作为融合图像的子块。

4)对所有子块重复步骤3)。

5)对融合后的图像块进行DCT逆变换,得到融合后的子图像。

6)重复上述步骤,直到处理完整个图像中的所有子图像。

7)使用双边滤波器进行CV处理以修改不正确的决策映射,最终得到融合后的图像。

2.1 图像预处理

由于活性污泥显微图像的内容具有复杂性,先对由电荷耦合元件(CCD)获取的活性污泥数字显微图像进行预处理,预处理过程包括图像灰度化和图像边缘锐化两部分。

图像灰度化处理是将输入的彩色活性污泥显微三通道图像转换成灰度单通道图像的过程。彩色图像中每个像素点的颜色由三个通道来决定,每个像素点对应着红色、绿色和蓝色三个颜色矩阵,而每个通道有0~255的颜色变化范围[21]。灰度化处理是使三通道灰度值相等的过程,灰度值的最大值为255,代表白色,最小值为0,代表黑色。将彩色图像转换成灰度图像,随着矩阵维数的减少,后期计算量随之减小,处理更方便效率,转换后的灰度图像特征信息并未缺失,仍能反映整个图像的信息。

图像锐化的主要作用是使图像不清晰的部分,如边缘和轮廓变得更清晰,这种锐化方法能够处理目标物体的边缘部分与其周围像素灰度突变的地方,因此也称为边缘增强处理。其中常用于边缘检测的方法是Sobel算子,其是一种离散微分算子,主要计算图像的一阶梯度,优点是具有方向性,而且水平或者垂直方向都可以,两个方向上的核大小也可以指定。该算子对图像的噪声可以起到抑制的作用,所以在抗噪能力方面具有很大的优势,能够提供精确的边缘信息。

卷积核的大小在不指定的情况下,默认Sobel算子卷积模板的尺寸为3×3,其中第一组为水平检测模板,第二组为垂直检测模板。将原始输入图像的每个像素点与水平检测模板和垂直检测模板分别进行卷积计算,即可得到两个方向上的梯度矩阵,表达式为

式中:*为卷积符号。

最后采用“原图+增强后图像”的方法来锐化图像,则图像的每一个像素为

2.2 基于DCT变换的图像融合

DCT方法是图像处理过程中一种常用的正交线性变换方法,其变换核为余弦函数,具有正交变换的性质,因此对称可分离的二维DCT可看作行和列的两次一维变换[22-23]。DCT可以在空间上转换信号,使其具有独立相关性。对图像进行DCT处理,得到的变换系数矩阵从左上角到右下角分别为低频分量(图像变化平缓的区域)、中频分量和高频分量(图像变化较快的区域),系数值逐渐减小。原图像的信息主要集中在左上角的低频分量中,通常包含大量的原图像特征信息,高频分量包含细节部分的信息[24]。

一幅N×N像素图像的二维DCT可表示为

式中:u=0,1,…,N-1;v=0,1,…,N-1;F(u,v)为图像DCT处理后的结果;N为灰度图像的点数;C为补偿系数;f(x,y)为二维融合图像的DCT逆变换结果,其中(x,y)为坐标点位置。

对变换后的系数进行归一化处理,表达式为

将系数方差大的子块作为融合图像的子块,方差σ2的计算公式为

式中:F

二维融合图像的DCT逆变换公式为

2.3 CV处理

图像融合的过程中,若分块区域中包含几个完全属于A图像的子块,那么这个区域中的所有子块都必须从图像A中选择,但是选择过程中受到噪声或图像本身复杂性的影响可能导致融合结果错误,所以从图像B中选择一些子块,并采用CV方法来解决这个问题。通常使用滤波器对图像进行CV处理,如果中心块来自原图像A,而周围大部分像素块来自原图像B,则会将中心块由图像A更改为图像B,最后根据修改后的决策图得到新的融合图像。

目前,CV处理使用的是线性滤波器,具有计算简单和处理数据效率高的优点,但缺点是其当平均运算时可能模糊掉部分图像的特征信息,因此不能精确地找到错误融合的像素块。与之相比,双边滤波器具有更大的优势,在去除噪声的同时,能够使图像的边缘信息完整,即使处理分辨率较大的图像,运行速度也很快。双边滤波器是一种非线性滤波器,其结合高斯低通滤波器的优点,原理是将图像的空间距离和像素差值进行结合,不仅考虑到空间域,还能考虑到值域的差别,最终达到保持边缘平滑去噪的目的[25]。双边滤波器的核由空间域核和值域核构成。

空间域核是由像素点位置的欧氏距离来计算权值Wd,表达式为

式中:(i,j)为当前点的坐标;(k,l)为中心点坐标;σd为高斯函数计算的标准差。(10)式中滤波器使用的模板是高斯滤波器的模板。

值域核是由像素点的差值来计算权值Wr,表达式为

式中:p(i,j)为图像在当前点(i,j)处的像素值;p(k,l)为图像在中心坐标点(k,l)的像素值;σr为高斯函数计算的标准差。

将(10)式和(11)式相乘可以得到双边滤波器新的权值,表达式为

为了减少噪声所带来的影响,对决策图像R进行CV处理,通过决策图的大小来判断输入的图像是原图像A还是原图像B,F为最终的融合图像,可表示为

3 分析与讨论

3.1 评价标准

为了对不同算法进行分析比较,实验采用三类评价指标来评价融合后的图像。第一类评价指标是将原始图像作为评价标准,主要用来评价融合后的图像保留原图像特征信息的多少,获取的特征信息越多说明融合效果越好,如文献[ 26]提出了一种边缘信息的指标,主要用来评价融合图像从输入原图像获得边缘信息的多少。第二类评价指标不需要原始图像,基于融合后图像本身的指标,如平均梯度等来评价融合后图像的清晰度,这类指标具有重要的参考意义。第三类评价指标为运行时间,主要用来评价算法的复杂程度。

第一类评价指标主要有互信息(MI)、特征的互信息(FMI)和边缘信息,具体情况如下。

1)MI是用来评价融合图像从原图像中获取特征信息的多少,其值越大说明融合图像保留原图像的信息越多,融合的效果越好。MI表达式为

式中:PAF为A和F的联合分布概率;PBF为B和F的联合分布概率;PA和PB为各自的独立分布概率;xMI,AF为A和F的MI;xMI,BF为B和F的MI。

2)FMI是一种标准化的指标,可以用来评价图像的相似性,在[0,1]范围内取值,值越大说明融合图像保留原图像的信息越多,效果越好。FMI表达式为

式中:H为图像基于直方图的熵,可表示为

式中:PG为灰度级出现的概率;L为灰度级数。

3)边缘信息是评价融合图像从原图像中保留边缘信息的多少,在[0,1]范围内取值,值越大说明融合后的图像保留边缘部分的信息越多,融合的质量越好。边缘信息的表达式为

其中

式中:C为一个常数;gA和gB为图像A和图像B的边缘强度。QAF可表示为

式中:

第二类评价指标主要有平均梯度(MG)和空间频率(SF),具体情况如下。

1) 评价融合图像的清晰程度,值越大说明图像清晰度越好,融合后的效果越好。MG表达式为

2) SF是用来评价融合图像在空间域的总体活跃程度,值越大说明图像质量越好,融合后的效果越好。SF表达式为

其中:xRF和xCF分别为行空间频率和列空间频率。因此SF可表示为

3.2 结果分析

实验主要对某污水处理厂采集的活性污泥进行图像融合研究,通过CCD设备在同一位置、不同景深处来获取活性污泥数字显微图像,仿真环境为MATLAB 2013b。

实验主要分为4组实验,第一组实验主要是对所提算法进行DCT分块实验,分析不同分块方式对图像融合效果的影响,总结最佳分块的尺寸;其他组实验是对不同算法进行对比,实验条件相同,均以8×8分块方式划分图像并对其进行DCT处理,其输入为三组不同景深的活性污泥显微图像。使用不同评价指标来评价算法的性能。其中前两组实验使用的是相同的活性污泥显微输入图像,后两组实验是对其他两组活性污泥显微图像进行验证。

由于图像的不同分块方式对数据处理速度和图像融合效果有较大的影响,因此找到最佳的分块方式对实验具有重要意义[27]。当图像分块的尺寸较小时,会出现许多融合图像小面积的块效应,且数据运行速度较慢;当图像分块的尺寸较大时,会出现许多融合图像大面积的块效应,但处理数据速度较快[28]。首先分析不同的分块方式对活性污泥显微图像融合效果的影响,总结最佳的分块尺寸,实验结果如

从

表 1. 所提算法在不同的分块方式下的融合效果

Table 1. Fusion effect of proposed algorithm under different block methods

|

实验选择DWT、DTCWT、CVT和NSCT算法与所提算法进行比较,采用方差融合准则进行均值滤波CV处理的方法记为“DCT+Variance+CV”,结果如

从

图 2. 第二组实验的融合图像。(a)原图1 ;(b)原图2 ;(c) DWT;(d) DTCWT;(e) CVT;(f) NSCT;(g) DCT+Variance+CV;(h)所提算法

Fig. 2. Fusion images of 2nd group of experiment. (a) Original image 1; (b) original image 2; (c) DWT; (d) DTCWT; (e) CVT; (f) NSCT; (g) DCT+Variance+CV; (h) proposed algorithm

图 3. 第三组实验的融合图像。(a)原图1 ; (b)原图2 ; (c) DWT; (d) DTCWT; (e) CVT; (f) NSCT; (g) DCT+Variance+CV; (h) 所提算法

Fig. 3. Fusion images of 3rd group of experiments. (a) Original image 1; (b) original image 2; (c) DWT; (d) DTCWT; (e) CVT; (f) NSCT; (g) DCT+Variance+CV; (h) proposed algorithm

图 4. 第四组实验的融合图像。(a)原图1 ; (b)原图2 ; (c) DWT; (d) DTCWT; (e) CVT; (f) NSCT; (g) DCT+Variance+CV; (h)所提算法

Fig. 4. Fusion images of 4th group of experiment. (a) Original image 1; (b) original image 2; (c) DWT; (d) DTCWT; (e) CVT; (f) NSCT; (g) DCT+Variance+CV; (h) proposed algorithm

表 2. 第二组实验的融合效果

Table 2. Fusion effect of 2nd group of experiment

|

表 3. 第三组实验的融合效果

Table 3. Fusion effect of 3rd group of experiment

|

表 4. 第四组实验的融合效果

Table 4. Fusion effect of 4th group of experiment

|

总的来说,所提算法能够较好地描述图像,融合效果更清晰,计算效率也有所提升。

4 结论

本课题组提出一种基于DCT的多焦点图像融合算法,采用该算法对活性污泥显微图像进行预处理,通过计算图像的最佳分块方式来选择方差较大的分块以实现图像融合,并使用双边滤波器进行CV处理,最终该算法能够得到较清晰的活性污泥显微融合图像,而且图像边缘部分更清晰,对后期研究污泥膨胀的早期检测和故障诊断具有重要的应用价值。实验结果表明,所提算法可以使融合图像保留较多的原图像特征信息,边缘部分的清晰度也有所提高,计算效率明显提升。

[3] Ciresan DC, Gambardella LM, GiustiA, et al. Deep neural networks segment neuronal membranes in electron microscopy images[C]∥Advances in Neural Information Processing Systems, December 3-6, 2012, Lake Tahoe, Nevada, United States. New York: Curran Associates, 2012: 2852- 2860.

[5] Mesquita D P, Amaral A L, Ferreira E C. Activated sludge characterization through microscopy:a review on quantitative image analysis and chemometric techniques[J]. Analytica Chimica Acta, 2013, 802: 14-28.

[6] 史艳琼, 尹秋霞, 卢荣胜. 变焦显微成像三维测量算法性能分析[J]. 激光与光电子学进展, 2019, 56(7): 071202.

[7] Shreyamsha Kumar B K. Multifocus and multispectral image fusion based on pixel significance using discrete cosine harmonic wavelet transform[J]. Signal, Image and Video Processing, 2013, 7(6): 1125-1143.

[8] 高颖, 王阿敏, 王凤华, 等. 改进的小波变换算法在图像融合中的应用[J]. 激光技术, 2013, 37(5): 690-695.

[9] Tian J, Chen L. Adaptive multi-focus image fusion using a wavelet-based statistical sharpness measure[J]. Signal Processing, 2012, 92(9): 2137-2146.

[10] Burt P, Adelson E. The Laplacian pyramid as a compact image code[J]. IEEE Transactions on Communications, 1983, 31(4): 532-540.

[11] Petrovic V S, Xydeas C S. Gradient-based multiresolution image fusion[J]. IEEE Transactions on Image Processing, 2004, 13(2): 228-237.

[12] RockingerO. Image sequence fusion using a shift-invariant wavelet transform[C]∥Proceedings of International Conference on Image Processing, October 26-29, 1997, Santa Barbara, CA, USA. New York: IEEE, 1997: 288- 291.

[13] Lewis J J. O’Callaghan R J, Nikolov S G, et al. Pixel-and region-based image fusion with complex wavelets[J]. Information Fusion, 2007, 8(2): 119-130.

[14] Nencini F, Garzelli A, Baronti S, et al. Remote sensing image fusion using the curvelet transform[J]. Information Fusion, 2007, 8(2): 143-156.

[15] Zhang Q, Guo B L. Multifocus image fusion using the nonsubsampled contourlet transform[J]. Signal Processing, 2009, 89(7): 1334-1346.

[16] 张肃, 战俊彤, 付强, 等. 基于多小波融合的偏振探测去雾技术[J]. 激光与光电子学进展, 2018, 55(12): 122602.

[17] 李清灵, 尹达一, 庾金涛, 等. 高分辨大视场紫外-可见光偏振成像融合处理技术[J]. 光学学报, 2019, 39(6): 0611001.

[18] 聂敏. 一种改进的DCT变换图像融合技术[J]. 科技通报, 2012, 28(4): 178-179, 205.

Nie M. An improved DCT transform image fusion technology[J]. Bulletin of Science and Technology, 2012, 28(4): 178-179, 205.

[20] NooshyarM, AbdipourM, KhajueeM. Multi-focus image fusion for visual sensor networks in wavelet domain[M] ∥Movaghar A, Jamzad M, Asadi H. Artificial intelligence and signal processing. Communications in computer and information science. Cham: Springer, 2014, 427: 23- 31.

[21] 周彦平, 谢小龙, 刘洋, 等. CMOS图像传感器电子辐照实验的研究[J]. 红外与激光工程, 2016, 45(5): 0520006.

[22] Haghighat M B A, Aghagolzadeh A, Seyedarabi H. Multi-focus image fusion for visual sensor networks in DCT domain[J]. Computers & Electrical Engineering, 2011, 37(5): 789-797.

[23] Desale RP, Verma SV. Study and analysis of PCA, DCT & DWT based image fusion techniques[C]∥2013 International Conference on Signal Processing, Image Processing & Pattern Recognition, February 7-8, 2013, Coimbatore, India. New York: IEEE, 2013: 66- 69.

[24] Li H, Manjunath B S, Mitra S K. Multisensor image fusion using the wavelet transform[J]. Graphical Models and Image Processing, 1995, 57(3): 235-245.

[25] 周兵, 韩媛媛, 徐明亮, 等. 快速非局部均值图像去噪算法[J]. 计算机辅助设计与图形学学报, 2016, 28(8): 1260-1268.

Zhou B, Han Y Y, Xu M L, et al. A fast non-local means image denoising algorithm[J]. Journal of Computer-Aided Design & Computer Graphics, 2016, 28(8): 1260-1268.

[26] 李雄飞, 张小利, 刘兆军, 等. 医学图像融合质量评价模型[J]. 小型微型计算机系统, 2012, 33(7): 1608-1612.

Li X F, Zhang X L, Liu Z J, et al. Model for evaluating quality of medical image fusion[J]. Journal of Chinese Computer Systems, 2012, 33(7): 1608-1612.

[27] Mahbubur Rahman S M, Omair Ahmad M, Swamy M N S. Contrast-based fusion of noisy images using discrete wavelet transform[J]. IET Image Processing, 2010, 4(5): 374.

[28] 张宝华, 吕晓琪. 一种复合型PCNN的NSCT域多聚焦图像融合方法[J]. 小型微型计算机系统, 2014, 35(2): 393-396.

Zhang B H, Lv X Q. Multi-focus image fusion algorithm based on compound PCNN in NSCT domain[J]. Journal of Chinese Computer Systems, 2014, 35(2): 393-396.

赵立杰, 左越, 黄明忠. 基于离散余弦变换的活性污泥显微图像融合[J]. 激光与光电子学进展, 2020, 57(24): 241103. Lijie Zhao, Yue Zuo, Mingzhong Huang. Activated Sludge Microscopic Image Fusion Based on Discrete Cosine Transform[J]. Laser & Optoelectronics Progress, 2020, 57(24): 241103.