基于颜色恒常性的图像背景虚化算法  下载: 1318次

下载: 1318次

1 引言

图像背景虚化又称为浅景深技术[1],在摄影美学领域内一直备受关注,是专业摄影师常用的图像处理方法。近年来,消费者对智能手机拍摄效果的要求越来越高,而智能手机的拍摄性能又远不及专业摄像机,因此必须依赖图像处理算法以达到相近的效果。

图像背景虚化算法的关键在于如何获取图像中物体的深度信息。1994年,Subbarao等[2]利用散焦深度恢复算法,确定了相机与对象的距离以及相机的快速自动对焦系统,但该算法得到的深度信息不连续,边缘信息不准确。2011年,Zhuo等[3]通过估计边缘位置的散焦模糊量,实现了从边缘扩散到图像以获取深度信息,但该算法要求图像具有一定的模糊度,计算量较大。

在提取图像深度信息的过程中,需要分别对单幅图像、双幅图像以及多幅图像进行处理。其中从单幅图像中提取准确的图像深度信息难度较大,但对设备和成本的要求较低,因此得到了广泛关注。2013年,Google公司的Kriener等[4]实现了对单幅图像散焦放大技术的加速;2013年,Wu等[5]搭建了透镜色散模型,通过渲染色散部分,获得了图像的景深信息;2015年,肖进胜等[1]利用多聚焦完成了对单幅图像深度信息的提取;2019年,苏超然等[6]提出了针对肖像的背景虚化处理。但是这些方法都存在计算复杂、边缘虚化敏感的问题。

本文提出了一种基于颜色恒常性的图像背景虚化算法,可获取单幅图像的景深信息,该算法计算量小,且获取的景深信息准确,对硬件配置的依赖低。相比其他方法,具有一定优越性。

2 基本原理

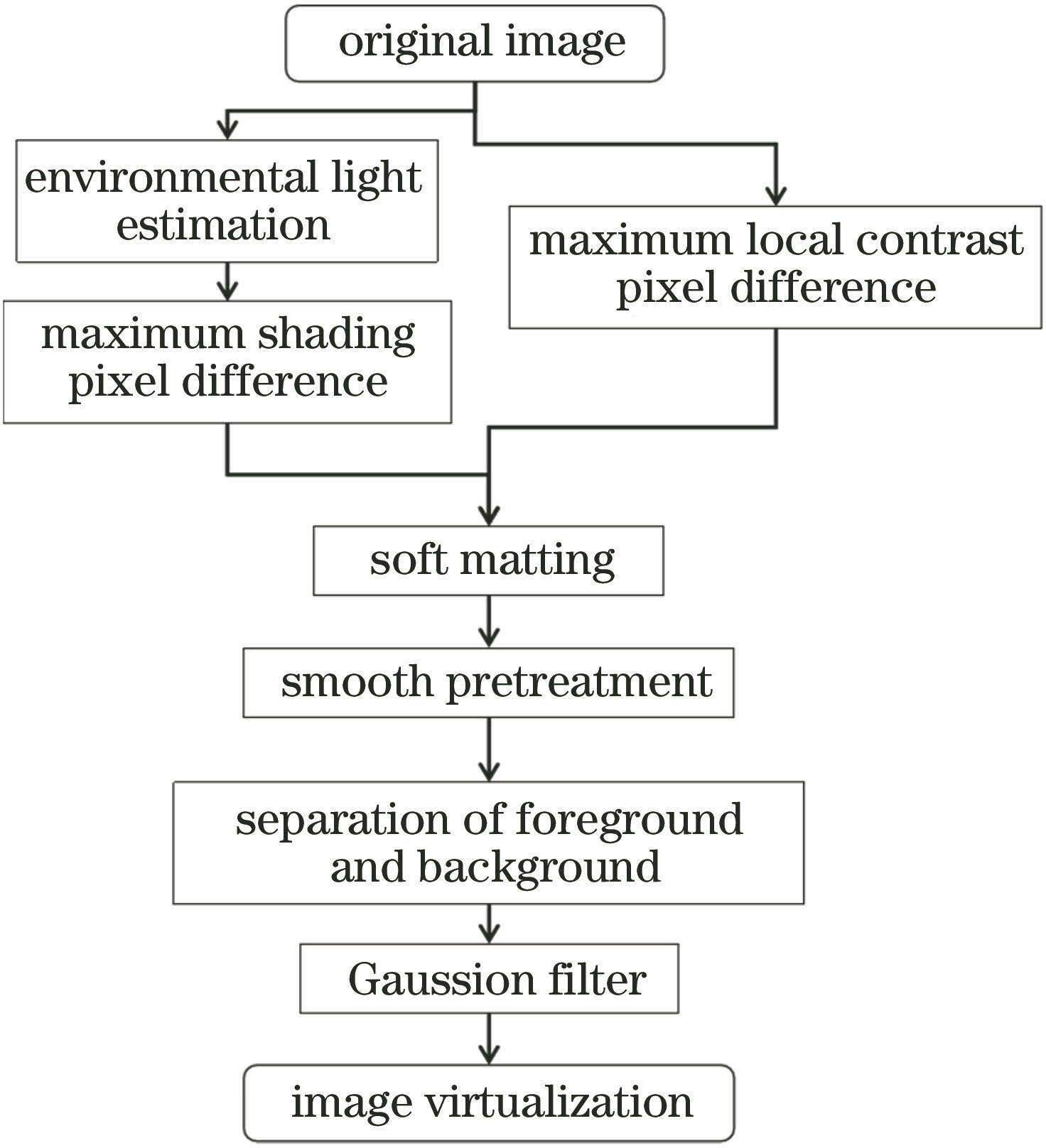

基于颜色恒常性的图像背景虚化算法主要分为两大块:图像深度信息获取和图像背景虚化,流程框图如

图 1. 基于颜色恒常的图像背景虚化流程框图

Fig. 1. Flow diagram of image background blurring based on color constancy

2.1 图像深度信息获取

颜色恒常性是计算机实现视觉颜色校正和保证机器对颜色识别稳定性的重要因素[7]。根据成像原理,基于颜色恒常性对图像整体环境的光强度进行估计,为获取单幅图像的深度信息做准备。颜色恒常算法即构建朗伯表面模型,计算环境光估计[8-9]。首先根据环境光强度构造一个光照模型,即朗伯表面(Lambertian surface)模型[10-12]。一般辐射光源射在各个方向的辐射亮度是不同的,具有方向性。而朗伯表面在任意发射(漫射、透射)方向上的辐射亮度不变,可表示为

式中,f=[R(x), G(x), B(x)]T为从三个通道按不同比例输出图像上某点的颜色,R(x),G(x),B(x)分别代表红、绿、蓝三个颜色,x为图像上某点的位置信息,ω为某点的可见光谱,e(λ)为光源分布,λ为光谱的波长,s(λ)为朗伯表面某点波长为λ的反射率,c(λ)为感光函数,即[R(λ),G(λ),B(λ)](其中R(λ)、G(λ)、B(λ)分别为光源在三基色上的光源分布分量),用朗伯表面公式可表示为

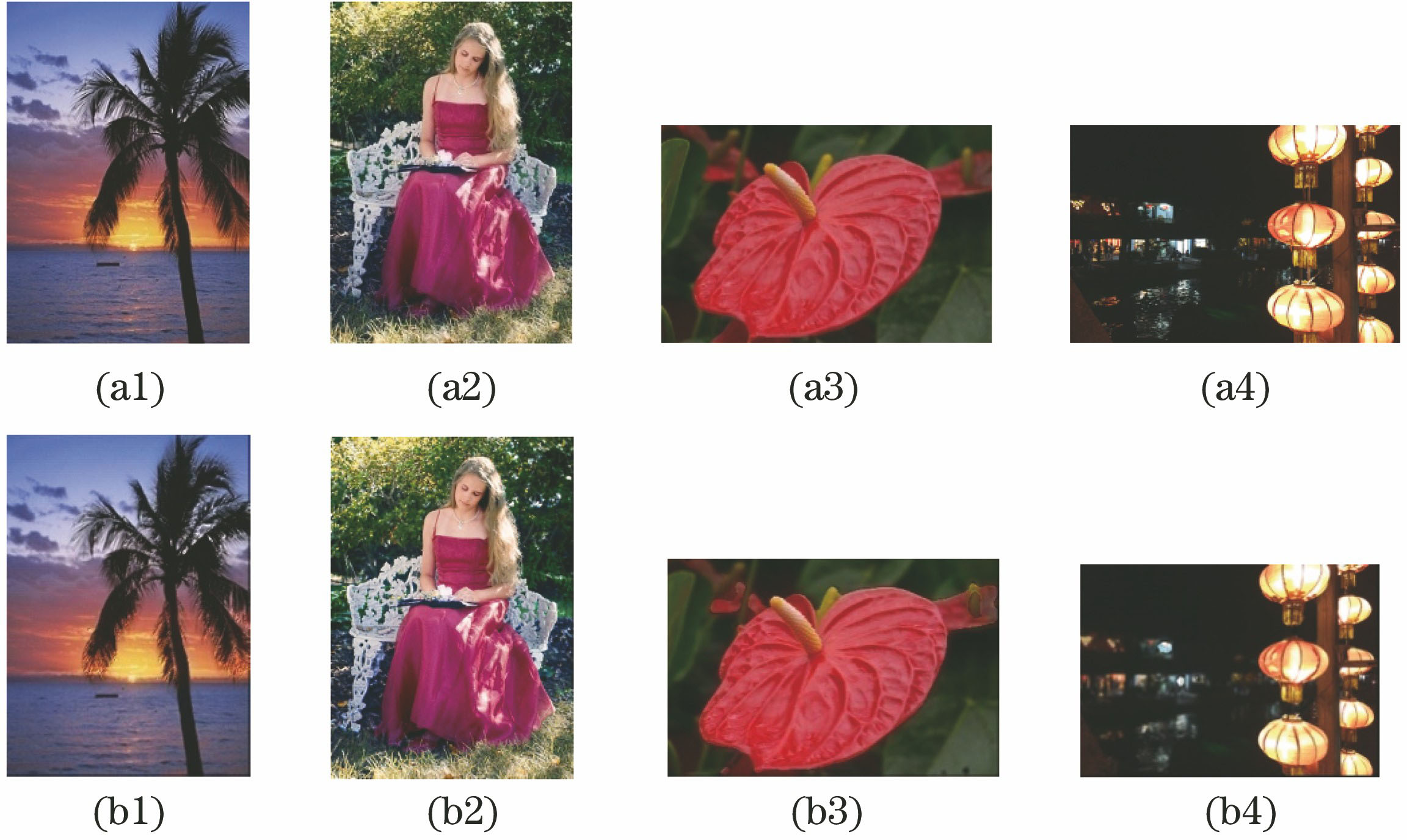

基于颜色恒常性分析的目的是估计光源的颜色,即e(λ)的值。为了方便理解,e(λ)在下文和代码中均用Aω代替。原始图像经颜色恒常性分析后的结果如

图 2. 图像对比。(a)原始图像;(b)颜色恒常性处理后的图像

Fig. 2. Image comparison. (a) Original image; (b) image after color constancy processing

利用颜色恒常性算法分析了图像中的环境光照情况,得到图片的环境光估计Aω(光估计信息),可用于后续获取图像深度信息的过程。例如

获得图像的环境光估计Aω后,将其作为计算单幅图像深度信息的一个参数。深度估计的计算过程:利用深度图中的局部最大值代替此像素块的所有像素值,得到最大遮蔽物像素差值的深度图,利用图像三通道上最大局部对比度像素差值的深度图判断光照在传输过程中的损失大小。

最大局部对比度像素差值的深度图tc(x)可表示为

式中,Iλ(y)为图像中某一局部区域中任意一点的像素值,(5)式实现的过程:对比该区域中像素值的差值,并把最大的差值赋予tc(x),作为图像深度信息获取的参数之一。

最大遮蔽物像素差值的深度图tv(x)可表示为

(6)式实现了局部最大值代替该像素块中所有点像素值的过程。(5)式和(6)式得到的是不连续且深度变化不光滑的灰度图,因此需要利用软抠图算法处理图像,以得到较为连续且光滑的深度图。得到tc和tv如

图 3. 两种估计深度图比对图。(a) tc;(b) tv

Fig. 3. Comparison of two estimation depth maps. (a) tc; (b) tv

从

式中,Cp为任一张图像,Fp为图像的前景部分,Sp为图像的背景部分,αp为图像的未知部分。根据不同像素值划分界限,划分出图像前景和背景部分,从而起到抠图的效果。

在软抠图算法(Soft matting)[12,14]中,定义一个αp映射,用t表示传输系数图,得到最小化的损失函数[12]

式中,L表示拉普拉斯矩阵 (Laplacian matrix),λ1是一个正则化的参数。

式中,

软抠图算法结合了边缘结构和对应物体的深度信息,提高了深度图中物体边缘位置的保边性。如

图 4. 软抠图算法处理后的图片。(a)对图3 (a1)的处理;(b)对图3 (a2)的处理;(c)对图3 (a3)的处理;(d)对图3 (a4)的处理

Fig. 4. Image processed by soft matting algorithm.(a)Processing of Fig. 3 (a1); (b) processing of Fig.3 (a2); (c) processing of Fig.3 (a3); (d) processing of Fig.3 (a4)

2.2 图像背景虚化处理

获得图像的深度信息之后,准确分离软抠图图像的前景与背景部分对后续的图像背景虚化效果起到关键作用[15-16]。可利用灰度图中各物体对应的灰度值分离图像的前景与背景,深度图[14]的灰度值tx(i,j)大小为0~1范围的自然数,令

式中,k为任意值,用来自适应地选择图像的前景与背景的范围;Tx(i,j)为扩大后深度图的灰度值。若Tx(i,j)>1,将其分为前景部分,否则将其分为背景部分,用灰度值0、1明确标注出图像的前景与背景区域,提取出图像的前景与背景部分,如

图 5. 获取图像的前景与背景图。(a)前景图;(b)背景图

Fig. 5. Foreground and background of the image.(a) Foreground image; ( b) background image

此时得到的前景与背景存在部分干扰区域,如

利用高斯滤波实现图像虚化处理[19]的过程可表示为

式中,Ibokeh(i,j)为虚化[20]后的图像,σ(i,j)为图中某一点的像素值,Im(i,j)为虚化前的原图,f

图 7. 图像背景虚化处理前后对比图。(a)虚化处理前;(b)虚化处理后

Fig. 7. Contrast image before and after image background blurring processing. (a) Before blurring processing; (b) after blurring processing

从

3 实验结果与分析

3.1 图像虚化算法所需摄像头数量分析

市面上的手机在完成图像虚化操作的过程中多使用双镜头:一个是主摄像头,一个是虚化摄像头。原因是在获取图像的深度信息时利用了双目深度估计的方法[24]。而本算法基于颜色恒常性获取单幅图像的深度信息。

从

表 1. 不同型号手机做图像虚化使用的算法和摄像头数

Table 1. Image blurring algorithm and number of cameras for different type of telephones

|

3.2 本算法与几种其他算法的比较

将所提出的算法与几种其他算法进行比较,结果如

表 2. 几种算法性能的比较

Table 2. Comparison of performance of several algorithms

|

3.3 背景虚化效果评价

由于关于图像背景虚化的文献较少,无法用客观指标来评价虚化效果[1],因此进行了主观视觉调查。就

从

表 3. 背景虚化效果评价调查结果

Table 3. Results of the investigation on the effect evaluation of background blurring

|

4 结论

提出了一种基于颜色恒常性的图像背景虚化算法,相比其他单目图像获取深度信息的算法,背景虚化效果明显;因为本算法处理的是单幅图片,降低了在生产过程中对硬件配置的要求。但在细节处理方面和对高像素处理的运算时间还有进一步研究的必要,因此未来的工作中将针对处理中的细节部分和高像素的运算时间进行研究,以提高虚化处理后图像的质量。

[1] 肖进胜, 杜康华, 涂超平, 等. 基于多聚焦图像深度信息提取的背景虚化显示[J]. 自动化学报, 2015, 41(2): 304-311.

Xiao J S, Du K H, Tu C P, et al. Bokeh display based on depth information extraction of multi-focus images[J]. Acta Automatica Sinica, 2015, 41(2): 304-311.

[2] Subbarao M, Surya G. Depth from defocus:a spatial domain approach[J]. International Journal of Computer Vision, 1994, 13(3): 271-294.

[3] Zhuo S J, Sim T. Defocus map estimation from a single image[J]. Pattern Recognition, 2011, 44(9): 1852-1858.

[4] Kriener F, Binder T, Wille M. Accelerating defocus blur magnification[J]. Proceedings of SPIE, 2013, 8667: 86671Q.

[5] Wu J Z, Zheng C W, Hu X H, et al. Rendering realistic spectral bokeh due to lens stops and aberrations[J]. The Visual Computer, 2013, 29(1): 41-52.

[6] 苏超然, 陈羽中. 一种结合显著性检测的肖像照片自动背景虚化算法[J]. 小型微型计算机系统, 2019, 40(2): 427-431.

Su C R, Chen Y Z. Saliency detection based background defocus algorithm for portrait image[J]. Journal of Chinese Computer Systems, 2019, 40(2): 427-431.

[7] 范珮, 张霞, 徐诗惠. 基于遗传神经网络的颜色恒常感知计算模型[J]. 计算机系统应用, 2018, 27(8): 1-9.

Fan P, Zhang X, Xu S H. Computing model of color constancy perception based on genetic neural network[J]. Computer Systems & Applications, 2018, 27(8): 1-9.

[8] Finlayson GD, TrezziE. Shades of gray and colour constancy[C]∥Color Science and Engineering Systems, Technologies, Applications, CIC 2004, Nov. 9, 2004, Scottsdale, Arizona, USA. Salt Lake, USA: Society for Imaging Science and Technology, 2004: 37- 41.

[9] van de WeijerJ, Gevers T, Gijsenij A. Edge-based color constancy[J]. IEEE Transactions on Image Processing, 2007, 16(9): 2207-2214.

[10] Takashima T. Evaluation of the internal radiation field in a composite planetary atmosphere with the Lambert surface calculated by matrix method[J]. Astrophysics and Space Science, 1974, 30(2): 309-313.

[11] Daykin D E, Eliezer C J. Generalization of Hölder's and Minkowski's inequalities[J]. Mathematical Proceedings of the Cambridge Philosophical Society, 1968, 64(4): 1023-1027.

[13] Chen X, He F Z, Yu H P. A matting method based on full feature coverage[J]. Multimedia Tools and Applications, 2019, 78(9): 11173-11201.

[14] 李贤阳, 阳建中, 杨竣辉, 等. 基于改进的直方图均衡化与边缘保持平滑滤波的红外图像增强算法[J]. 计算机应用与软件, 2019, 36(3): 96-103.

Li X Y, Yang J Z, Yang J H, et al. Infrared image enhancement algorithm based on improved histogram equalization and edge preserving smoothing filtering[J]. Computer Applications and Software, 2019, 36(3): 96-103.

[15] 邵美云, 常岐海. 基于软抠图指导性滤波的雾天图像复原技术[J]. 科技通报, 2015, 31(10): 109-111.

Shao M Y, Chang Q H. Fog image recovery technology based on soft matting guiding filter[J]. Bulletin of Science and Technology, 2015, 31(10): 109-111.

[16] Razzaghi M. A computational solution for the matrix Riccati equation using Laplace transforms[J]. International Journal of Computer Mathematics, 1982, 11(3/4): 297-304.

[17] Lai P K, Liang W Z, Laganière R. Additive depth maps, a compact approach for shape completion of single view depth maps[J]. Graphical Models, 2019, 104: 101030.

[18] 潘波, 范祺红, 曹雪玮, 等. 基于超像素的深度图修复算法[J/OL].计算机应用研究, 2020, 37(6). [2019-06-03]. http:∥www.arocmag.com/article/02-2020-06-058.html.

PanB, Fan QH, Cao XW, et al., 2020, 37(6). [ 2019-06-03]. http:∥www.arocmag.com/article/02-2020-06-058.html.

[19] 郑红波, 石豪, 杜轶诚, 等. 光照不均匀的结构光图像的条纹快速提取方法[J]. 计算机科学, 2019, 46(5): 272-278.

Zheng H B, Shi H, Du Y C, et al. Fast stripe extraction method for structured light images with uneven illumination[J]. Computer Science, 2019, 46(5): 272-278.

[20] 肖进胜, 杜康华, 涂超平, 等. 基于相控高斯核的多聚焦图像景深模拟[J]. 光学学报, 2014, 34(10): 1011006.

[21] Rahman Z. PuY F, Aamir M, et al. A framework for fast automatic image cropping based on deep saliency map detection and Gaussian filter[J]. International Journal of Computers and Applications, 2019, 41(3): 207-217.

[22] 吴晨琛, 杨杰, 冷冰, 等. 基于边缘检测的图像背景虚化方法[J]. 信息通信, 2018( 4): 128- 129.

Wu CC, YangJ, LengB, et al. Image background visualization method based on edge detection[J]. Information Communication, 2018( 4): 128- 129.

[23] 王振阳. 基于视频图像序列的背景虚化[D]. 杭州: 浙江大学, 2016.

Wang ZY. Research on image bokeh based on video image sequence[D]. Hangzhou: Zhejiang University, 2016.

[24] 肖进胜, 田红, 邹文涛, 等. 基于深度卷积神经网络的双目立体视觉匹配算法[J]. 光学学报, 2018, 38(8): 0815017.

Article Outline

李晓颖, 杨恒杰, 闫铮, 连方, 巫梅琴. 基于颜色恒常性的图像背景虚化算法[J]. 激光与光电子学进展, 2020, 57(8): 081001. Xiaoying Li, Hengjie Yang, Zheng Yan, Fang Lian, Meiqin Wu. Image Background Blurring Algorithm Based on Color Constancy[J]. Laser & Optoelectronics Progress, 2020, 57(8): 081001.