改进区域卷积神经网络的机场检测方法  下载: 967次

下载: 967次

1 引言

遥感图像中典型目标检测是当前图像处理领域的研究热点之一[1],机场作为**和民用基础设施,在飞机起降、交通运输、能量补给等方面发挥着重要作用。然而,机场检测也面临着许多问题和挑战,比如机场所处背景十分复杂,机场的形状和大小也不尽相同等。因此,遥感图像机场检测方法的研究具有十分重要的应用意义。

迄今为止,国内外学者提出并研究了多种机场检测方法,主要可以分为基于边缘和基于区域分割两类方法[2]。前者专注于边缘直线特征,通过检测跑道来实现机场检测。这种方法速度快,复杂度低,但易受其他具备长直线特征的非机场目标干扰。后者专注于机场的显著性结构特征,但由于滑动窗口重叠问题,该方法效率低。上述方法存在的主要问题表现在:一是区域选择中采用的滑动窗口策略无针对性,时间复杂度高且窗口冗余;二是对于机场多样性的变化,手工设计的特征稳健性不强。

近来,深度学习的兴起引领了工业界和学术界的潮流[3],也为机场检测提供了一种新的思路。Zhang等[4]基于平行线特征,利用卷积神经网络(CNN)的迁移学习能力来识别机场跑道, 随后又利用CNN的迁移学习能力直接识别机场[5]。Xiao等[6]利用CNN来提取图像的多尺度深度融合特征,再用支持向量机进行分类。辛鹏等[7]借鉴深度CNN架构,提出了一种机场快速检测方法。然而,这些方法大多只是利用CNN强大的分类识别能力,机场建议框的提取还是基于边缘或区域分割的手工方法,仍然存在局限性。因此,本文基于区域的CNN架构,抛弃以往的滑动窗口固定模式,对网络模型进行改进和优化,提出了一种结合级联区域建议网络和检测网络的机场检测方法。

2 改进区域CNN的机场检测方法

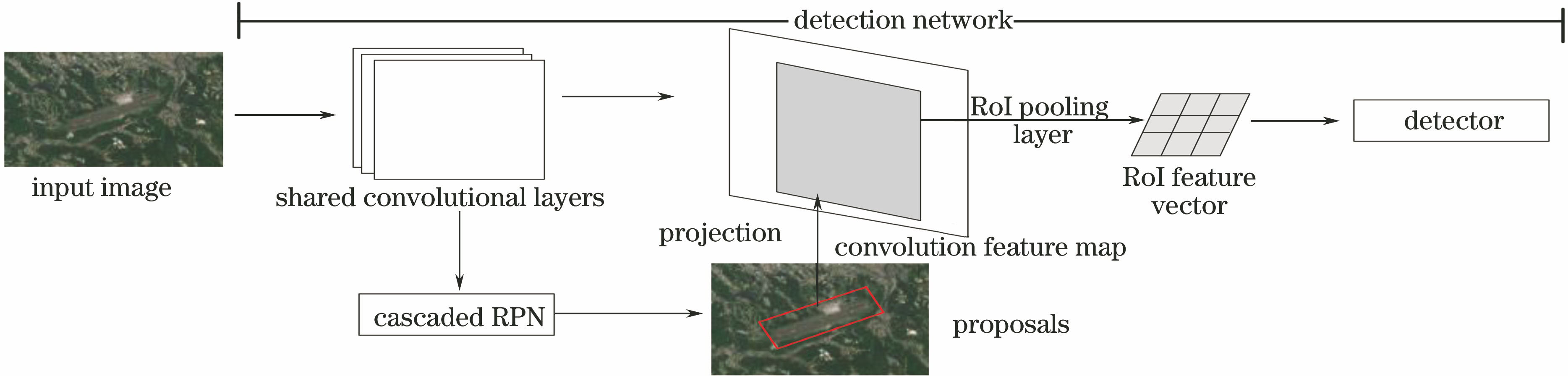

区域CNN检测方法通常由两个子任务组成[8],这里将两个子任务进行进一步优化和改进,以实现机场的快速准确检测。所提方法主要由级联的区域建议网络(RPN)[9]和检测网络组成,两个网络间共享卷积层,整体结构如

2.1 级联的区域建议网络

RPN将建议框的生成整合到网络中,并与后续的检测网络共享卷积层,大大降低了计算成本且建议框的质量更高,建议框是指可能含有目标的区域包围框。

2.1.1 区域建议网络

经共享卷积层输出的卷积特征图由RPN处理后,输出

RPN使用一个3×3的滑动窗口在特征图上进行卷积运算,每个滑动窗口映射到一个低维向量。经过1×1的卷积核卷积后输入到分类层(cls layer)和回归层(reg layer),同时进行目标分类和建议框的定位回归。特别需要指出的是,这里的分类只是判断建议框中是不是目标,并不是具体的类别。建议框的参数化表示称为anchor,即每个anchor以滑动窗口的中心为中心对应一组尺寸大小和长宽比。对于卷积特征图上的每个位置,这里考虑三种尺寸大小和三种长宽比的anchor,以应对遥感图像中的多尺度机场目标。

2.1.2 多任务损失函数

为了训练RPN,每个anchor都被赋予一个二进制标签。正标签被赋予两类anchors:与某一个人工标定框的交集并集之比(IoU)最高的anchors;与任意人工标定框的IoU大于0.7的anchors。负标签被赋予与所有人工标定框的IoU都小于0.3的anchors。

由于RPN要完成目标分类和建议框的回归两个任务,因此遵循多任务损失原则[10],定义RPN损失函数为

式中

2.1.3 级联的区域建议网络

理想的区域建议方法是尽可能生成少的建议框,同时能覆盖图像中的每个目标。但是,RPN生成的机场建议框中依旧存在大量的背景区域。Yan等[11]通过减少由聚类产生的候选框数量,实现了性能的提高;Kuo等[12]用CNN重新排序候选框,提高了候选框的质量;辛鹏等[7]引入一个二分类器,筛除掉许多较差的候选框。受此启发,提出

采用两个标准的RPN进行前后连接。第一个RPN依然利用滑动窗口和anchor的对应关系来生成建议框,第二个RPN利用输入的建议框与anchor在特征图上的对应关系来生成新的建议框。根据建议框的分类得分,在每个RPN的后面使用NMS进一步减少冗余。NMS可以通过设置IoU阈值来进一步减少建议框的数量,但不会影响最终检测准确率,具体细节可参考文献[ 13]。所提方法简单,额外增加的计算成本非常小,能够在提升机场建议框质量的基础上,实现机场检测性能的提高。

2.2 建议框检测网络

2.2.1 感兴趣区域池化层

同一幅图像生成的几千个建议框之间的重叠率很高,如果重复提取建议框特征,将导致网络的计算成本很高。由于建议框对应特征图与图像完整特征图间的固定映射关系,因此,利用感兴趣区域池化层[10],可以从完整特征图上直接得到不同建议框对应的特征矢量,从而实现建议框的特征提取共享,如

2.2.2 改进的损失函数

建议框对应的特征图被输入到全连接层,最终从两个同级输出层输出。其中一个输出为对背景和

式中

(4)式所示的分类损失简单地将所有检测框分成两类,无区别地处理IoU大于阈值的所有检测框,导致机场最终定位准确性不高。实际上,IoU较大的建议框应该优于IoU较小的建议框。机场检测不单单追求高的识别率,机场定位的准确性同样重要,且定位准确性的提升也能够提高最终的机场检测率。因此,这里对分类损失进行改进,将分类损失定义为

式中

式中

3 交叉优化策略

为了解决小样本难以训练甚至过拟合等问题,共享卷积层的权重用预训练网络VGG16进行初始化,其余层的权重用均值为0、标准差为0.01的高斯分布函数进行随机初始化。网络的基本学习率为0.001,动量为0.9,权重衰减为0.0005。为了实现级联的RPN和检测网络共享卷积层,采用交替优化策略来训练整个网络,具体分为四步。

第一步,训练级联的RPN和输出机场建议框集合。利用预训练网络VGG16初始化建议框生成网络权重后,进行端到端微调训练,训练结束后输出机场建议框集合。

第二步,训练建议框检测网络。利用VGG16网络初始化建议框检测网络权重后,利用第一步生成的机场建议框来训练检测网络,此时两个网络没有共享卷积层。

第三步,再次微调级联的RPN和输出机场建议框集合。用第二步检测网络的最终权值初始化级联的RPN,固定共享卷积层权重,仅微调训练级联的RPN独有的层,训练结束后再次输出机场建议框集合。这个过程中两个网络共享卷积层。

第四步,再次微调训练网络模型。保持共享的卷积层和级联的RPN权重参数固定,用第三步输出的机场建议框微调检测网络的全连接层,最终得到卷积层共享的机场检测网络。

4 实验与结果分析

所提机场检测方法在1000 pixel×600 pixel遥感图像数据集上进行仿真实验,实验数据均来自Google Earth软件。数据集总量为600张,其中有400张存在机场区域的图像,剩余图像主要为铁路、公路、桥梁、建筑物等背景场景。随机选取240张机场图像和120张非机场图像组成训练集,其余图像组成测试集。为了防止过拟合,训练时图像以0.5的概率水平翻转。图像测试时IoU阈值设定为0.5,采用检测率(DR)、虚警率(FAR)和平均运行时间作为实验评价指标,具体计算公式参照文献[ 2]。实验中的所有数据结果均取多次随机实验的平均值。

4.1 参数分析

为了确定(1)式中

表 1. 不同λ值下的机场检测率

Table 1. Airport detection rates under different λ

|

实验中采用检测率作为评价指标,结果表明:

4.2 结果分析

为了证明级联RPN和改进损失函数的有效性,采用控制变量法进行对比实验,结果见

表 2. 区域建议方法的对比

Table 2. Comparison among regional proposal methods

|

区域建议方法的对比实验采用检测率和每张测试图像平均运行时间为评价指标。

损失函数的实验对比结果如

4.3 方法比较

为了证明所提方法的优越性,选取已有的机场检测方法进行对比实验。根据对比方法的网上公开代码,在本文实验环境下进行仿真实验,将每种方法在测试集上的检测率、虚警率和平均运行时间进行记录和比较,结果见

表 3. 不同机场检测方法的对比

Table 3. Comparison among different airport detection methods

|

由

5 结论

抛弃了以往的滑动窗口模式,以区域卷积神经网络为基本框架,提出了一种结合级联的区域建议网络和检测网络的遥感图像机场检测方法。级联的区域建议网络通过进一步筛选和优化建议框,提高了建议框的质量;在充分考虑IoU训练阈值对定位精度的影响下,对检测网络的损失函数进行了改进,最终提高了机场检测率;两个网络间共享卷积层,大大提高了机场检测的效率。实验结果表明,所提方法在复杂背景下能准确地检测出不同类型的机场,优于现有的其他机场检测方法的,但处理速度距实时处理还有一定差距,这也是下一步研究的方向。

[1] 宋明珠, 曲宏松, 金光. 含噪光学遥感图像海面弱小舰船目标检测[J]. 光学学报, 2017, 37(10): 1011004.

宋明珠, 曲宏松, 金光. 含噪光学遥感图像海面弱小舰船目标检测[J]. 光学学报, 2017, 37(10): 1011004.

[3] 曲磊, 王康如, 陈利利, 等. 基于RGBD图像和卷积神经网络的快速道路检测[J]. 光学学报, 2017, 37(10): 1010003.

曲磊, 王康如, 陈利利, 等. 基于RGBD图像和卷积神经网络的快速道路检测[J]. 光学学报, 2017, 37(10): 1010003.

[4] ZhangP, NiuX, DouY, et al. Airport detection from remote sensing images using transferable convolutional neural networks[C]. International Joint Conference on Neural Network, 2016: 2590- 2595.

ZhangP, NiuX, DouY, et al. Airport detection from remote sensing images using transferable convolutional neural networks[C]. International Joint Conference on Neural Network, 2016: 2590- 2595.

[7] 辛鹏, 许悦雷, 马时平, 等. 区域提取网络结合自适应池化网络的机场检测[J]. 西安电子科技大学学报, 2018( 3): 121- 127.

辛鹏, 许悦雷, 马时平, 等. 区域提取网络结合自适应池化网络的机场检测[J]. 西安电子科技大学学报, 2018( 3): 121- 127.

XinP, Xu YL, Ma SP, et al. Airport detection combining region proposal networks and adaptive pooling networks[J]. Journal of Xidian University, 2018( 3): 121- 127.

XinP, Xu YL, Ma SP, et al. Airport detection combining region proposal networks and adaptive pooling networks[J]. Journal of Xidian University, 2018( 3): 121- 127.

[8] 叶国林, 孙韶媛, 高凯珺, 等. 基于加速区域卷积神经网络的夜间行人检测研究[J]. 激光与光电子学进展, 2017, 54(8): 081003.

叶国林, 孙韶媛, 高凯珺, 等. 基于加速区域卷积神经网络的夜间行人检测研究[J]. 激光与光电子学进展, 2017, 54(8): 081003.

[10] Girshick RB. Fast R-CNN[C]. International Conference on Computer Vision, 2015: 1440- 1448.

Girshick RB. Fast R-CNN[C]. International Conference on Computer Vision, 2015: 1440- 1448.

[11] YanJ, YuY, ZhuX, et al. Object detection by labeling superpixels[C]. Computer Vision and Pattern Recognition, 2015: 5107- 5116.

YanJ, YuY, ZhuX, et al. Object detection by labeling superpixels[C]. Computer Vision and Pattern Recognition, 2015: 5107- 5116.

[12] KuoW, HariharanB, MalikJ, et al. DeepBox: Learning objectness with convolutional network[C]. International Conference On Computer Vision, 2015: 2479- 2487.

KuoW, HariharanB, MalikJ, et al. DeepBox: Learning objectness with convolutional network[C]. International Conference On Computer Vision, 2015: 2479- 2487.

[13] RotheR, GuillauminM, Van GoolL, et al. Non-maximum suppression for object detection by passing messages between windows[C]. Asian Conference on Computer Vision, 2014: 290- 306.

RotheR, GuillauminM, Van GoolL, et al. Non-maximum suppression for object detection by passing messages between windows[C]. Asian Conference on Computer Vision, 2014: 290- 306.

[14] QuY, LiC, ZhengN, et al. Airport detection base on support vector machine from a single image[C]. International Conference on Signal Processing, 2005: 546- 549.

QuY, LiC, ZhengN, et al. Airport detection base on support vector machine from a single image[C]. International Conference on Signal Processing, 2005: 546- 549.

Article Outline

朱明明, 许悦雷, 马时平, 唐红, 辛鹏, 马红强. 改进区域卷积神经网络的机场检测方法[J]. 光学学报, 2018, 38(7): 0728001. Mingming Zhu, Yuelei Xu, Shiping Ma, Hong Tang, Peng Xin, Hongqiang Ma. Airport Detection Method with Improved Region-Based Convolutional Neural Network[J]. Acta Optica Sinica, 2018, 38(7): 0728001.