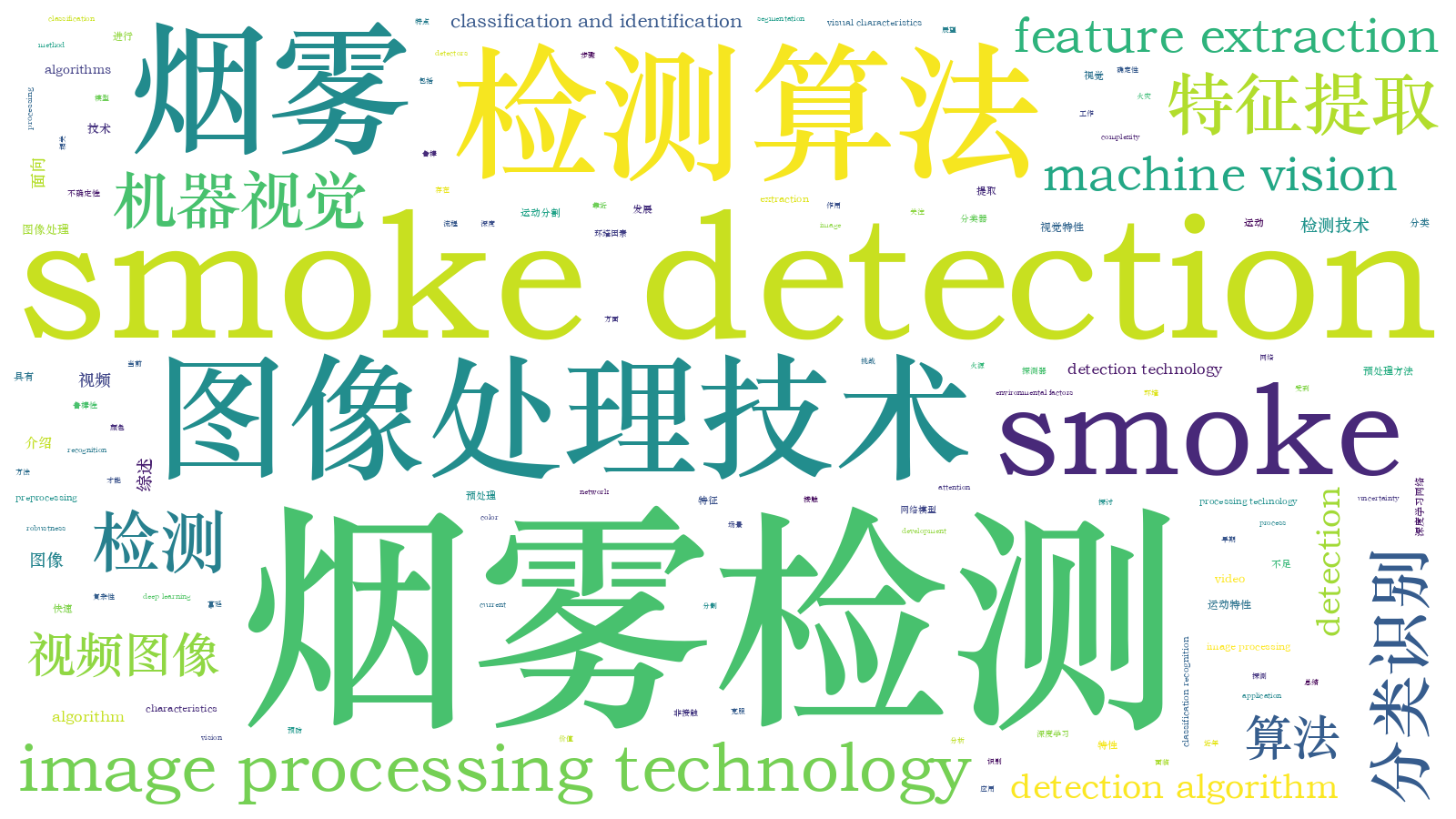

面向视频图像的烟雾检测算法综述  下载: 1851次

下载: 1851次

1 引言

火的出现促进了人类文明的进步,在服务于人类的同时也对人类的生命财产安全构成了严重威胁。近年来,世界各地频繁发生火灾,造成了巨大的资源损失和大量的人员伤亡。火灾的早期预防和检测一直以来都是一项具有重大研究意义的课题,准确、有效和及时的火灾检测是控制火势蔓延的重要手段。传统的火灾探测器通常是基于感温、感烟和感光等探测设备进行火灾的检测,只能对特定的某个信息特征进行判断,容易受到环境和空间的影响[1]。在空旷的场景中或恶劣的环境下,受温度、烟雾浓度等影响,传感器信号的传送速度较慢且信号强度变弱甚至失效,因此识别效果差、误报率高[2]。近年来随着机器视觉与图像处理技术的不断发展,基于视频图像的火灾检测技术引起了人们的关注。这种新型火灾检测技术不仅适用于复杂、广阔的室外环境,还极大改善了传统火灾检测的高误报率、低检测率等问题,同时提供了丰富的早期火灾视觉信息。

关于视频火灾检测的实际应用已取得了一些研究成果,Uğur TÖreyin等 [3]提出了基于小波变换的视频烟雾实时检测。Zhou等 [4]提出了一种结合动态和静态特征的视频烟雾检测算法,该算法能够快速、准确检测火灾烟雾,但是当存在与烟雾类似的非烟雾物体时会产生误报,不易区分烟雾与伪烟雾。 Wang等[5]提出了一种基于视频烟雾多特征融合的火灾烟雾早期识别方法,首先利用高斯混合模型和背景差法提取前景中的烟雾可疑区域,然后运用数字图像处理技术提取可疑区域的颜色、背景模糊、轮廓不规则性和运动等特征,最后形成的特征向量作为支持向量机(Support Vector Machine, SVM)分类器的输入,同时采用粒子群算法优化SVM分类器以提高烟雾的检测精度。 Hu等[6]提出了基于时空特征的火灾烟雾识别方法,通过卷积神经网络自动提取烟雾目标区域的深层特征并进行分类,实现了火灾烟雾的识别。关于早期火灾检测方面的研究已有综述文章。文献[ 7]对基于视频火焰的检测算法进行了综述,火焰和烟雾同是火灾发生时最为重要的视觉信息,因此可以根据检测对象的不同将火灾检测化分为烟雾检测和火焰检测,火焰检测和烟雾检测对于早期火灾的预防都具有不可替代的作用。本文在其基础上进行了补充,并结合一些最新研究进展,介绍了面向视频图像的烟雾检测算法,并进行了理论探讨,对其应用发展进行了展望。

2 火灾烟雾检测

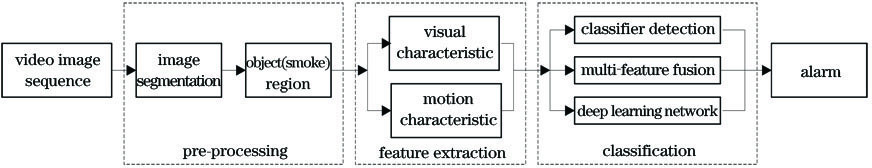

在火灾发生的初期,烟雾的出现早于火焰,因此烟雾的探测是一种更为有效的早期火灾报警的视觉信息。基于计算机视觉图像的烟雾检测大致可分为五个步骤:火灾烟雾视频的获取(Smoke Video Acquisition, SVA)、预处理阶段(Pre-Processing Stage, PPS)、特征提取(Feature Extraction, FE)、分类(Classification )和报警(Alarm)。烟雾检测的流程图如

火灾视频图像主要通过摄像头、相机等设备进行采集,然后将其输入到计算机进行处理,通常计算机不能直接处理可见图像,需要进行数字化处理以将可见图像变为数字图像。图像预处理阶段是指通过利用数字图像处理技术和相关算法提取疑似火灾烟雾区域,预处理是烟雾检测最为关键的一个阶段,准确分割并提取烟雾候选区域有利于火灾的成功检测。特征提取基于预处理阶段,对候选烟雾区的视觉特性和动态特性进行分析并提取相关特征。最后,将提取的特征向量作为分类器的输入并进行烟雾和非烟雾的识别,若检测到烟雾就会触发烟雾报警器。

3 预处理阶段

预处理阶段是确定输入视频帧的感兴趣区域(Region Of Interest, ROI),可通过识别烟雾像素并分析符合条件的区域来实现[8]。为了减小分析符合条件区域时的计算难度,通常需要对视频图像进行分割处理,将图像分割成多个对象和区域,将对象与背景分离。在现有的各种图像分割方法中,阈值分割技术是一种高效的技术[9-10],在图像分割中扮演着非常重要的作用。根据设置的特征阈值其可被分为单阈值分割和多阈值分割两类[11],常用的阈值分割技术主要有基于图像颜色的分割技术和基于运动的分割技术。

3.1 基于颜色的分割技术

烟雾的颜色信息通常与类似烟雾的颜色信息之间存在明显的区别,即描述该目标区域的像素信息存在差异,因此在不同的场景,可以根据烟雾图像在不同颜色空间上的分布,区分烟雾与类似烟雾干扰物。常用的颜色空间模型有RGB、HSV、YCbCr、YUV和HSI等,并且RGB颜色空间模型与其他颜色空间模型存在一定的线性或非线性关系,可以通过相应的关系,将RGB颜色空间转换为其他颜色空间并进行图像分割,从而实现目标区域的获取。

HSV颜色空间与HSI颜色空间非常相近,着重描述景物的色度(Hue)、饱和度(Saturation)、亮度(Value)和强度(Intensity)的分布情况,其颜色分布特点与人的视觉特性比较相符,因此易于实现分割处理[12]。在大多数火灾事故中,烟雾的饱和度、亮度以及强度等可表征烟雾颜色。Chmelar等[13]提出了基于高斯混合模型的火焰检测,实验结果表明,HSV颜色空间模型能有效实现火焰的检测且其颜色分布优于RGB颜色模型的颜色分布。Appana等[14]将RGB颜色空间转换为HSV颜色空间,并在HSV颜色空间中对饱和度和亮度进行了阈值化处理,实现了烟雾区域的分割。YCbCr颜色空间与YUV颜色空间对亮度的改变不敏感,即不易受照明亮度变化的影响,因此被广泛应用于图像分割。Emmy Prema等[15]通过研究分析烟雾和非烟雾的颜色特性,发现在YUV颜色空间中,烟雾区烟雾像素的色度U通道分量以及U通道分量和V通道分量的比值与类似烟雾物体之间存在很大差异,提出了利用YUV颜色空间模型来实现烟雾的识别。文献[ 16]将RGB颜色模型与改进的YCbCr颜色空间融合,实现了火焰图像的分割。文献[ 17]采用模糊均值C聚类 (FCM)算法实现了图像分割。在图像分割中,FCM算法基于像素信息进行聚类,因此可以利用FCM算法实现火灾烟雾区域的分割。

3.2 基于运动的分割技术

单幅静止图像无法描述物体的运动,火灾烟雾具有运动特性,其纹理、形状都呈无规则的变化,因此为了获取视频烟雾图像中的运动目标,可以通过分析视频图像的序列,采用运动分割技术获取目标区域的运动参数以及更多的视觉特征。通常基于运动分割技术的方法有背景差值法[18]、图像差分法[19]和光流分割方法[20]。其中,背景差值法的原理相对比较简单,只需要将每一帧的图像分别与背景图像相减即可得到一个差值图像,从而实现运动目标的分割。很多情况下图像背景不是静止的,此时无法用背景差值进行运动目标的检测和分割,需要采用图像差分法。图像差分法不仅可以检测视频图像序列中相邻两帧之间的变化,还可以检测整个图像序列的变化,又叫累计差分图像方法(Accumulatine Difference Picture, ADP),能更好地实现图像中缓慢运动或者微小运动物体的检测,同时可以估计物体移动速度的大小和方向以及物体的尺度大小。而光流分割方法相对比较复杂,需要计算图像中像素点或者块的运动,且光流分割方法不适用于目标只有几个像素的情况,其主要是根据光流的不连续性来分割运动图像,抗噪能力差,不同的光流区域对应着不同的运动目标。

对于运动目标的检测,背景差值法的应用较为广泛,其核心思想是对背景进行建模。该算法通常包括高斯混合模型算法[21]、码本算法[22]和ViBe算法[23]。不少研究将高斯混合模型算法与图像差分法相结合,实现了运动区域的获取[24]。而ViBe算法以其计算量小和速度快等特点在运动检测方面深受研究者的青睐。文献[ 25]利用改进的ViBe算法,实现了运动目标输出、背景更新以及前景检测,并对比了传统的ViBe算法和帧差法,结果表明,ViBe算法可以有效消除鬼影对目标检测的影响。

4 烟雾特征提取

燃烧使得烟雾同样具有颜色、模糊(半透明)、运动、轮廓和纹理等特征,随着燃烧的进行,烟雾颜色、纹理、形状等发生变化,烟雾的静态特征与动态特征表征了烟雾的变化,因此可以通过提取烟雾的不同特征实现烟雾的检测。

4.1 颜色特征

在基于视频图像的烟雾检测中,颜色信息是烟雾最为重要的视觉信息之一,烟雾作为火灾发生的早期现象,其特性取决于燃烧的温度、材料/燃料的化学稳定性和氧气的供应量。随着温度的升高,烟雾颜色可由浅灰色变成黑色,并且烟雾颜色具有显著的视觉特征,因此,国内外不少研究者常采用烟雾或者火焰颜色来检测火灾。Pundir等[26]通过结合RGB和YCbCr两种颜色模型的属性,得到了不同颜色空间中的烟雾特征,同时在RGB颜色空间中,通过大量实验获得了烟雾颜色特征的表示方法,即烟雾颜色特征检测规则,在该规则下通过计算获得了YCbCr颜色空间中的烟雾亮度值和色度值并将其作为颜色特征。文献[ 24,27]在RGB颜色空间中,通过对大量烟雾视频图像进行实验,提取了烟雾区域红(R)、绿(G)和蓝(B)通道的颜色信息和相关特征并进行了烟雾检测。不同颜色空间模型的颜色分布不同,因此HSV[13]、HSI[20,28]以及YUV[15,29]等颜色空间中的各通道颜色信息也常被用于不同场景下的烟雾检测。文献[ 30]展示了一些烟雾检测方法所使用的静态与动态特性,统计发现最为常用是颜色与动态特征,但是在一些复杂的环境中,烟雾的颜色容易受到大雾、运动物体的干扰,简单使用颜色特征难以准确检测烟雾。除此之外,颜色特征的提取与表达方法主要有颜色矩、颜色直方图、颜色集、颜色聚合向量和颜色相关图等[31]。其中,颜色矩是一种简单有效的颜色特征,三阶中心颜色矩分别为

式中:Mi为一阶颜色矩;σi为二阶颜色矩;Si为三阶颜色矩;pi,j为彩色图像通道i中j像素值出现的概率;N为像素个数。

4.2 纹理特征

纹理分析是一种有效的烟雾检测方法,通常通过空间统计度量和图像频谱来精确表征纹理,常用的纹理描述方法有两种,即统计法和频谱法[32]。文献[

14]利用二维的Gabor滤波器对烟雾图像进行滤波处理,得到不同方向的滤波图像,计算每个过滤后的图像的统计参数并将其作为特征,计算公式如

表 1. 纹理特征的统计度量参数计算公式

Table 1. Formulas for calculating statistical metric parameters of texture features

|

除了上述纹理特征的统计参数外,灰度共生矩阵(Gray-level Co-occurrence matrix, GLCM) [33]也是通过灰度的空间相关特性来描述纹理,GLCM描述纹理的情况可以通过相关统计参数进行表征,其统计参数如

表 2. 表征GLCM的统计参数[32]

Table 2. Statistical parameters for characterizing GLCM[32]

|

当前也有不少研究者采用LBP算子以及改进的LBP算子分析烟雾纹理特征,Yuan [34]计算了局部二值模式(LBP)与基于方差的局部二值模式(LBPV)金字塔直方图,并将所有直方图拼接成增强的特征向量,该方法对旋转和光照不敏感,能够快速检测烟雾。李巨虎等[35]利用LBP、局部相位量化(LPQ),分别从空域、频域提取纹理, 将图像空域和频域的特性结合起来,使得纹理特征的提取更加全面。Zhao等[36-37]改进的LBP算子可更加准确地描述烟雾的纹理特征。

4.3 HOG特征

方向梯度直方图(HOG)利用直方图描述图像局部区域的梯度强度,HOG特征对光照具有不敏感特性,可以很好排除烟雾识别过程中光照和树叶等干扰,因此被广泛应用于计算机视觉与图像处理领域[38-39]。为了更进一步获取局部的烟雾细节信息,计算每个像素的横纵坐标梯度,其计算方法[40]表示为

式中:H(x,y)为像素点(x,y)处的像素值;Gx(x,y)和Gy(x,y)分别为像素点(x,y)的横纵坐标方向的梯度。像素点(x,y)处的梯度大小和方向分别为

4.4 形状不规则特性

火灾烟雾在扩散过程中具有无规则的形状,而且烟雾的形状随气流或者风向的变化而变化,其不规则特征可以表示为

式中:γ为烟雾不规则判据,可以区分烟雾和其他类似烟雾的规则物体;C为烟雾候选区域的周长;S为烟雾候选区域的面积。 Peng等[41]通过提取图像中各运动区域的轮廓,得到了各运动区域轮廓的垂直边界的最小外接矩形,进而利用最小外接矩形的长宽比以及矩形度实现了烟雾检测。最小外接矩形的矩形度和长宽比的计算公式为

式中:Rd、Ar分别为矩形度和长宽比;Sarea为运动区域的面积;Srect为运动区域中最小外接矩形的面积;Wrect 与Hrect分别为运动区域的最小外接矩形的宽度和高度。无论是采用烟雾视觉特征还是采用动态特性,烟雾的检测仍然存困难,容易受大雾或者行动车辆等的干扰。为了提高检测效率,文献[ 42]对烟雾视频进行压缩,发现烟雾的运动轨迹具有低频、流线平滑和直线右倾等特点,利用这些特征可以区分与烟雾相似的目标,并且在各种视频上验证了该方法的有效性。

4.5 扩散性

烟雾的运动具有不规则特性,在火灾发生的初期,随着火势的蔓延,烟雾的扩散性表现为运动目标的面积变化,因此可以通过检测连续视频帧中运动区域面积的增长率来判断烟雾的扩散性[43]。假设St为t时刻运动区域的面积,且满足st≤st+1,则t时刻运动区域的面积增长率为

式中:

式中:w、h分别为疑似烟雾区域在主运动方向上的外接矩形的宽与长;m为t时刻像素点的横坐标;n为t时刻像素点的纵坐标;Df(w,h,t)为某一个区域的平均高频衰减系数;w×h为区域面积;F(m,n,t)为单个像素点的高频衰减量,F(m,n,t)计算公式为

式中:Bh为经过高斯滤波后的视频图像;Vh为经过高斯滤波后的背景图像。

4.6 能量分析

火焰与烟雾具有完全不同的行为,当火灾烟雾覆盖到一个背景区域时,背景的细节会随着时间的推移而消失,这一现象使得图像边缘平滑,在频域上表现为高频信息的减少[48]。因此,可以将图像能量作为判断烟雾是否存在的一个重要特征。离散小波变换( Discrete Wavelet Transform, DWT)是评价强度图像能量变化的一种有效方法,将有烟雾的视频图像进行离散小波分解,通过计算不同频带的频率变化来确定小波能量[49-50]。其空间小波能量为

式中:HHL 、LLH、HHH分别为小波分解中包含水平方向(HL)、垂直方向(LH)、对角方向(HH)纹理信息的三个子图像;i',j'分别为行数和列数。将每个候选块的空间小波能量作为块中每个像素的能量的平均值[51],即

式中:M',N' 分别为候选区域的长和宽。

4.7 运动方向特征

运动是烟雾的一个重要特征,在视频烟雾检测中具有重要的作用。由于烟雾的运动具有无序性,因此烟雾运动特征的提取是十分困难的。文献[

43,52]提出了一种烟雾运动方向估计算法,其将烟雾运动方向离散为0°、45°、90°、135°、180°、225°、270°、315°等8个方向,离散方向依次编码为1,2,3,4,5,6,7,8,具体如

式中: c(i',j')为t时刻i'行j'列的块;c'(i',j') 为(t-Δt)时刻的块;ddis,θ分别为位移和方向编码;f(x,y)为图像序列。利用三像素位移进行搜索,对于每个方向位移对应有三个误差值,其中最小误差定义为方向误差,即

假设烟雾向误差最小方向运动,故烟雾运动方向估计可表示为

通过对比分析最小误差与运动方向的关系,发现运动方向与实际烟雾运动方向正好相反。因此需要对方向编码进行修改,其方向编码修改公式为

式中:mod(·)为取余函数。如果某一个块没有运动,则该运动方向不需要估计且该方向将会被编码为0。

文献[

30]通过计算连续三帧的烟雾图像质心,构造了运动方向方向向量,检测运动区域B从A移动到C, A、B、C分别代表连续帧的质心,运动方向可以用向量

式中:fx-AB、fy-AB分别为水平方向和垂直方向分量。在通常情况下,烟雾运动比较缓慢,相邻两帧之间的变化不明显,运动方向的估计不是很精确,为了提高估计方向的精度,块的运动方向需要累积一段时间,以入口最大的方向作为块的运动方向。

5 分类识别

5.1 分类器识别

分类器识别是指通过提取烟雾的相关特征并融合多特征以形成特征数据集,将特征数据集按照一定方法分为训练集和测试集两个部分,训练集用于训练分类器,测试集用于测试已训练好的分类器,根据测试结果可判断分类器的输出是否为烟雾。目前,面向视频图像的烟雾检测常用到的分类器有神经网络[53]、支持向量机[54]和AdaBoost[55]等。

5.1.1 神经网络

神经网络是一种学习模型,基本结构由输入层、隐含层、输出层构成[56],其思想是使用快速下降法,通过不断更新各层的权重来不断学习,从而不断优化网络直到网络输出与期望输出的误差在某个允许的范围内[57]。Tung等[58]使用神经网络对烟雾和非烟雾进行分类,虽然能有效识别烟雾,但是烟雾检测的准确性会受输入特征样本容量的影响,通常神经网络需要在大样本容量下进行学习。

5.1.2支持向量机

支持向量机是一种最为常用的有监督机器学习分类器,被广泛应用于许多分类和回归分析领域,特别是在模式识别领域中深受专家学者的青睐。支持向量机也是一种较好实现结构风险最小化思想的方法,不仅能够在高维空间进行学习,还解决了小样本学习的问题,即能够在有限的训练数据集上提高分类器的性能,同时有效避免了局部极值问题[59-60]。Ye 等[61]采用网络搜索法获取的最佳参数,训练了基于SVM的烟雾识别模型,提高了烟雾检测的鲁棒性,并通过核函数的选择以及相关优化算法(粒子群优化算法、遗传算法等),优化了SVM分类器,提高了烟雾检测精度[5,52]。

5.1.3 AdaBoost算法

AdaBoost算法是一种由 Freund等[62]提出的迭代算法,其核心思想是通过训练多个弱分类器来不断更新训练权值,然后将这些弱分类器集合成强分类器[63]。Maruta等[64]将AdaBoost用于烟雾特征分类,虽然可以有效识别烟雾,但AdaBoost分类器的输出值存在局限性。Zhao等[65]提出了一种基于CS Adaboost算法的森林火灾视频早期烟雾检测方法,该方法以提取到的烟雾的运动特征、颜色以及烟雾图像能量特征作为特征向量,将其输入到CS AdaBoost分类器中,输出结果能有效区分烟雾和类似烟雾等。 Yuan [52]改进了AdaBoost算法,实现了烟雾的检测并取得了较好的检测效果。

为了更加直观展现烟雾检测效果,

5.2 多特征融合检测

研究表明,在复杂的环境中,利用单一的特征是无法完成烟雾检测的。通过对视频图像进行多特征分析,并将提取的烟雾特征进行有机的结合,可以有效提高烟雾的识别率。基于多特征融合的烟雾检测技术如

式中:Wb为不同烟雾特征分析结果在综合判据中所占的比重;Ub为一个检测周期中判别为有烟雾的视频帧数;b为烟雾特征的数量。若P' 大于预设的阈值,则发出报警信号,否则进入下一个检测周期。

5.3 不同检测算法的对比

对常用的烟雾检测算法以及改进的优化算法进行对比分析,结果如

从

表 3. 面向视频图像的烟雾检测算法

Table 3. Smoke detection algorithm for video images

|

5.4 深度学习网络模型

近年来,随着深度学习的不断发展,深度学习方法已经在计算机视觉上取得了很好的表现性能,以卷积神经网络(Convolutional Neural Network ,CNN)为代表的深度学习网络成为当前的一大研究热点,相比于传统的手工提取烟雾特征,卷积神经网络能自动提取,提取结果更好地表征了烟雾的本质特征[68]。卷积神经网络主要由输入层、卷积层、池化层、全连接层和输出层组成,各组成部分所扮演的角色不同,其中卷积层是在深层网络中提取输入图像的特征信息;池化层对输入的像素空间进行池化处理,即特征处理,可以有效降低特征维度和计算量;全连接层则是连接所有特征,并将其送给分类器,最后输出分类结果[69]。但是,网络的优化问题一直制约着人工神经网络的发展,人们提出了许多方法来解决这个问题,并不断提高网络训练的性能[70]。Krizhevsky等[71]设计了一个AlexNet[72]网络学习模型,并在多个图像分类与识别任务中取得了优异成绩。在此基础上,不少研究者提出了其他改进的方法,出现了ZFNet[73],Googlenet[74],VGG[75]和ResNet[76]等模型。

相比传统烟雾检测算法,基于深度学习网络的烟雾检测方法无需图像分割和人工提取特征等复杂过程,在本身的框架下通过配置网络结构,自动完成图像特征提取、特征处理等,从而有效避免了人工提取图像特征带来的误差并降低了目标检测的复杂度。通常深度学习的目标检测网络主要分为基于区域提取的目标检测网络和基于回归的目标检测网络。

5.4.1 基于区域提取的目标检测网络

基于区域提取的目标检测网络首先产生候选区域,其次利用CNN进行分类,具有高准确率和高稳定性。Xu等[77]提出了基于深度显著性网络的视频烟雾检测算法,视觉显著性检测的目的是突出图像中最重要的目标区域,在循环卷积神经网络(Recurrent Convolutional Neural Network ,RCNN) [78]整体框架下,采用深度特征图与显著性图相结合的方法,进行烟雾存在性预测。冯路佳等[79]提出了基于目标区域的卷积神经网络火灾烟雾识别方法,构建了基于运动检测的卷积神经网络模型(Motion Detection Convolutional Neural Network Model,MD_CNN),该模型通过运动检测算法将无关特征区域去除, 获取了烟雾的目标区域,将烟雾目标区域输入到卷积神经网络中进行识别,检测率高达97.25%,误检率为6.28%。基于区域提取的目标检测网络还包括Fast R-CNN[80]、Faster R-CNN[81]等模型。

5.4.2 基于回归的目标检测网络

YOLO算法是当前应用比较广泛的目标检测算法,具有速度快、结构简单等特点,仅采用一个单独的CNN模型就能实现端对端的目标检测[82]。 YOLO算法的发展非常迅速,许多研究者在YOLO算法的基础上进行了改进,相继涌现了YOLO9000[83]、YOLOv2[84-85]、YOLOv3[86]等改进算法。程淑红等[87]提出了融合改进的高斯混合模型和YOLOv2烟雾检测算法,对于森林火灾烟雾的检测率高达98.1%,误检率仅为0.8%。也有不少研究者利用改进的YOLOv3算法以及SSD[88]算法进行目标检测,取得了很好的结果。

深度学习网络模型在目标检测和图像分类领域取得了很好的研究成果,

表 4. 不同深度学习网络模型的视频图像烟雾检测结果

Table 4. Smoke detection results for video images based on different deep learning network models

|

6 存在的不足与展望

6.1 存在的不足

传统的烟雾检测主要是基于烟雾的物理特性来实现的,通过感烟探测设备实现烟雾的检测,在室内或者小空间均能取得很好的检测效果,但是将其应用到室外或者大型空间场景下则不具有时效性。随着计算机视觉与机器学习的不断发展,面向视频图像的烟雾检测算法解决了传统烟雾检测存在的问题,其烟雾检测算法的表现性能可以通过准确率(Accuracy)、精确率(Precision)以及召回率(Recall)等评价指标来进行评判。对于火灾的探测,大多数研究关注的是算法的准确率和时效性,即准确、快速实现火灾的探测。由于环境的复杂性与多样性,现有的烟雾检测方法仍然存在一些问题,主要体现两个方面:一方面,为了实现快速的烟雾检测,烟雾识别率相对较低;另一方面,为了提高烟雾的识别率,需增加算法的计算难度,从而导致实时性很差。

烟雾作为火灾开始阶段的重要视觉特征,快速、准确检测烟雾对遏制火灾是至关重要的,特别是大型商场、工厂以及人口相对密集的场所对烟雾的检测速率要求更高。由于这些场景相对比较复杂,存在大量与烟雾类似的干扰物,因此在烟雾特征提取、选择与检测方面相对难度较大,无法在短时间内完成烟雾的检测,存在检测速率不达标的问题。

目前,现有的面向视频图像的烟雾检测算法都有一定程度的漏报率和误报率,特别是在一些复杂的场景下,烟雾检测的漏报率与误报率相对较高。常采用的检测算法有基于烟雾视觉特征和基于运动特征以及多特征融合的检测算法。针对某些特定的场景,基于特定烟雾特征的检测算法具有很好的识别效果,当将其运用到其他的场景中时,识别率相对较低。这是因为在其他一些场景下,特定的烟雾特征与存在的干扰物极其相似,此时烟雾特征不能准确表征烟雾,导致算法无法识别烟雾与非烟雾,从而存在一定的漏报率和误报率。

6.2 展望

面向视频图像的烟雾检测算法虽然已取得一系列的重大成果,但存在不足。针对这些不足,可以从数据库的完备、特征工程的构建、预处理方法的改进以及深度学习网络的应用等方面进行解决,其展望总结如下。

1)完备数据库的建立。对于火灾烟雾视频,目前还没有统一的标准测试数据库。国内外有一些实验室在网络上上传了视频数据,大多数研究者都是基于这些数据或者自身拍摄的一些视频片段来检测自己的算法,虽然得到了很好的检测结果,但是这些数据库并不完备,因此这些算法不具备普适性,仅仅适用于特定场景。完备视频数据库的建立尤为重要,数据库的建立还应考虑环境、地理位置以及领域等因素的影响。

2)改进预处理方法。在视频序列的预处理过程中,通常采用基于颜色分割与运动分割的技术选择出感兴趣的候选区域。其中,基于颜色分割的技术通常是在RGB、HSV等常用颜色空间中,通过大量实验得到一些规则,进而实现候选区域的分割。目前,有些研究者改进了一些颜色空间模型[94-95],并在改进的新颜色空间中实现了火焰的识别,其中一些思想对于新颜色空间中的视频序列预处理具有借鉴意义。

3)构建特征工程。对于烟雾特征的提取,现有的检测算法通常是基于烟雾的视觉特性与运动特性,通过提取烟雾的颜色、纹理和运动及图像能量等特征来进行烟雾识别,但没有进一步深入分析烟雾特征,因此检测结果存在一定的误报率和漏报率。特征工程包括特征提取、特征选择以及特征学习等一系列步骤,特征工程的构建不仅有利于选择出能有效表征烟雾的特征,还能去除冗余特征,有效降低数据维度,从而大大减小算法的计算难度,使得烟雾检测的速率得到进一步提高。

4) 深度学习网络的应用。深度学习网络模型具有超强的特征学习能力,在目标检测、追踪以及图像分类等方面取得了突破性的进展,并且在大样本条件下获得了良好的效果。但是,当前基于深度学习网络的烟雾检测研究大多是在原始的框架下基于烟雾图像进行学习,而火灾发生的场景复杂多变,视频图像更能记录并表征火灾发生的整个过程,因此,基于视频和深度学习网络的烟雾检测仍然是今后重要的研究方向之一。

7 结束语

面向视频图像的烟雾检测算法一直都是具有重大研究意义的课题。现有的一些技术具有较好的检测精度,但是计算成本很高。特别是近年来深度学习网络的快速发展,使得烟雾检测避免了繁琐的手工提取图像特征等过程。面向视频图像的烟雾检测算法适用于不同场景下的烟雾检测,但是对硬件设备要求比较高,实时的烟雾检测面临着巨大的挑战。

[1] 相徐斌. 基于视频的烟雾检测算法研究[D]. 杭州:浙江大学, 2017.

Xiang XB. Research on smoke detection algorithm based on video[D]. Hangzhou: Zhejiang University, 2017.

[2] 肖潇, 孔凡芝, 刘金华. 基于动静态特征的监控视频火灾检测算法[J]. 计算机科学, 2019, 46(S1): 284-286, 299.

[3] Uğur TÖreyinB, DedeoğluY, Enis Çetin A. Wavelet based real-time smoke detection in video[C] ∥ 2005 13th European Signal Processing Conference, September 4-8, 2005,Antalya, Turkey. New York: IEEE, 2005: 15037050.

[4] 周泊龙, 宋英磊, 俞孟蕻. 基于图像处理的火灾烟雾检测算法研究[J]. 消防科学与技术, 2016, 35(3): 390-393.

[5] WangL, Li AG. Early fire recognition based on multi-feature fusion of video smoke[C]∥2017 36th Chinese Control Conference (CCC), July 26-28, 2017, Dalian, China. New York: IEEE, 2017: 5318- 5323.

[6] Hu Y C, Lu X B. Real-time video fire smoke detection by utilizing spatial-temporal ConvNet features[J]. Multimedia Tools and Applications, 2018, 77(22): 29283-29301.

[7] 曹江涛, 秦跃雁, 姬晓飞. 基于视频的火焰检测算法综述[J]. 数据采集与处理, 2020, 35(1): 35-52.

[9] Agrawal S, Panda R, Bhuyan S, et al. Tsallis entropy based optimal multilevel thresholding using cuckoo search algorithm[J]. Swarm and Evolutionary Computation, 2013, 11: 16-30.

[12] 章三妹, 唐正明. 基于HIS颜色空间的彩色图像分割算法研究[J]. 西华师范大学学报(自然科学版), 2012, 33(3): 304-307.

[13] ChmelarP, BenkridA. Efficiency of HSV over RGB Gaussian mixture model for fire detection[C]∥2014 24th International Conference Radioelektronika, April 15-16, 2014, Bratislava, Slovakia. New York: IEEE, 2014: 1- 4.

[14] Appana DK, IslamR, Khan SA, et al. and spatial-temporal energy analyses for alarm systems[J]. Information Sciences, 2017, 418/419: 91- 101.

[15] Emmy Prema C, Vinsley S S, Suresh S. Multi feature analysis of smoke in YUV color space for early forest fire detection[J]. Fire Technology, 2016, 52(5): 1319-1342.

[16] 张丹丹, 章光, 陈西江, 等. 改进YCbCr和区域生长的多特征融合的火焰精准识别算法[J]. 激光与光电子学进展, 2020, 57(6): 061022.

[17] 赵战民, 朱占龙, 刘永军, 等. 对类大小不敏感的图像分割模糊C均值聚类方法[J]. 激光与光电子学进展, 2020, 57(2): 021001.

[18] Tian HD, Li WQ, WangL, et al. A novel video-based smoke detection method using image separation[C]∥2012 IEEE International Conference on Multimedia and Expo, July 9-13, 2012, Melbourne, VIC, Australia. New York: IEEE, 2012: 532- 537.

[19] 魏玮, 吴琪. 三帧差结合改进高斯建模的运动目标检测算法[J]. 计算机工程与设计, 2014, 35(3): 949-952.

[22] MurgiaJ, MeurieC, RuichekY. An improved colorimetric invariants and RGB-depth-based codebook model for background subtraction using Kinect[M] ∥ Gelbukh A, Espinoza F C, Galicia-Haro S N. Human-inspired computing and its applications. MICAI 2014. Lecture notes in computer science. Cham: Springer, 2014, 8856: 380- 392.

[23] Huang W, Liu L, Yue C, et al. The moving target detection algorithm based on the improved visual background extraction[J]. Infrared Physics & Technology, 2015, 71: 518-525.

[24] 阳婷, 官洪运. 基于帧间高频能量和相关性的烟雾检测算法研究[J]. 微型机与应用, 2015, 34(17): 32-35.

[25] 马永杰, 陈梦利, 刘培培, 等. ViBe算法鬼影抑制方法研究[J]. 激光与光电子学进展, 2020, 57(2): 021007.

[27] Cheng YH, Wang J. A motion image detection method based on the inter-frame difference method[J]. Applied Mechanics and Materials, 2014, 490/491: 1283- 1286.

[29] 刘恺, 刘湘, 常丽萍, 等. 基于YUV颜色空间和多特征融合的视频烟雾检测[J]. 传感技术学报, 2019, 32(2): 237-243.

[31] 胡学龙. 数字图像处理[M]. 2版. 北京: 电子工业出版社, 2011.

Hu XL. Digital image processing[M]. 2nd ed. Beijing: Publishing House of Electronics industry, 2011.

[32] 张德丰著. 数字图像处理(MATLAB版)[M]. 第二版.北京: 人民邮电出版社, 2015.

Zhang DF. Digital image processing(MATLAB edition)[M]. 2nd ed. Beijing: Posts and Telecom Press, 2015.

[33] Chiranjeevi P, Sengupta S. Moving object detection in the presence of dynamic backgrounds using intensity and textural features[J]. Journal of Electronic Imaging, 2011, 20(4): 043009.

[35] 李巨虎, 范睿先, 陈志泊. 基于颜色和纹理特征的森林火灾图像识别[J]. 华南理工大学学报(自然科学版), 2020, 48(1): 70-83.

Li J H, Fan R X, Chen Z B. Forest fire recognition based on color and texture features[J]. Journal of South China University of Technology (Natural Science Edition), 2020, 48(1): 70-83.

[38] 刘操, 郑宏, 黎曦, 等. 基于多通道融合HOG特征的全天候运动车辆检测方法[J]. 武汉大学学报·信息科学版, 2015, 40(8): 1048-1053.

Liu C, Zheng H, Li X, et al. A method of moving vehicle detection in all-weather based on melted multi-channel HOG feature[J]. Geomatics and Information Science of Wuhan University, 2015, 40(8): 1048-1053.

[39] Wang Y, Li M, Zhang C X, et al. Weighted-fusion feature of MB-LBPUH and HOG for facial expression recognition[J]. Soft Computing, 2020, 24(8): 5859-5875.

[40] 岳姣姣. 基于多特征融合的林火烟雾检测算法研究[D]. 秦皇岛: 燕山大学, 2016.

Qiu JJ. The research on forest fire smoke detection algorithm based on feature fusion[D]. Qinhuangdao: Yanshan University, 2016.

[42] Luo S, Yan C W, Wu K L, et al. Smoke detection based on condensed image[J]. Fire Safety Journal, 2015, 75: 23-35.

[43] 殷梦霞, 王理, 孙连营. 基于多特征融合的自适应烟雾检测算法[J]. 建筑科学, 2019, 35(9): 26-31.

[44] CaiM, Lu XB, Wu XH, et al. Intelligent video analysis-based forest fires smoke detection algorithms[C]∥2016 12th International Conference on Natural Computation, Fuzzy Systems and Knowledge Discovery (ICNC-FSKD), August 13-15, 2016, Changsha, China. New York: IEEE, 2016: 1504- 1508.

[47] 邓林. 视频烟雾检测算法研究[D]. 成都:电子科技大学, 2015.

DengL. Study on video smoke detection algorithm[D]. Chengdu: University of Electronic Science and Technology of China, 2015.

[48] Lee C, Lin C, Hong C, et al. Smoke detection using spatial and temporal analyses[J]. International Journal of Innovative Computing Information and Control, 2012, 8: 4749.

[50] Wang T, Liu Y, Xie Z P. A new video smoke detection method based on wave analysis[J]. Electronics and Information Journal, 2011, 33(5): 1024-1029.

[53] Hu Y C, Lu X B. Real-time video fire smoke detection by utilizing spatial-temporal ConvNet features[J]. Multimedia Tools and Applications, 2018, 77(22): 29283-29301.

[55] Xu ZG, Xu JL. Automatic fire smoke detection based on image visual features[C]∥2007 International Conference on Computational Intelligence and Security Workshops (CISW 2007), December 15-19, 2007, Heilongjiang, China. New York: IEEE, 2007: 316- 319.

[56] CuiY, DongH, Zhou EZ. An early fire detection method based on smoke texture analysis and discrimination[C]∥2008 Congress on Image and Signal Processing, May 27-30, 2008, Sanya, Hainan, China. New York: IEEE, 2008: 95- 99.

[57] Srisuwan T, Ruchanurucks M. Smoke detection using GLCM, wavelet, and motion[J]. Proceedings of SPIE, 2014, 9069: 90691H.

[59] Chen JZ, You Y. Early fire detection using HEP and space-timeanalysis[EB/OL].( 2013-10-07)[2020-05-13]. https:∥arxiv.org/abs/1310. 1855.

[60] Wang YB. Smoke recognition based on machine vision[C]∥2016 International Symposium on Computer, Consumer and Control (IS3C), July 4-6, 2016, Xi'an, China. New York: IEEE, 2016: 668- 671.

[61] Ye W, Zhao JH, Wang S, et al. Dynamic texture based smoke detection using surfacelet transform and HMT model[J]. Fire Safety Journal, 2015, 73: 91-101.

[63] Yuan F N. A double mapping framework for extraction of shape-invariant features based on multi-scale partitions with AdaBoost for video smoke detection[J]. Pattern Recognition, 2012, 45(12): 4326-4336.

[64] MarutaH, IidaY, KurokawaF. Smoke detection method using Local Binary Patterns and AdaBoost[C]∥2013 IEEE International Symposium on Industrial Electronics, May 28-31, 2013, Taipei, Taiwan, China. New York: IEEE, 2013: 1- 6.

[65] Zhao Y Q, Li Q J, Gu Z. Early smoke detection of forest fire video using CS Adaboost algorithm[J]. Optik - International Journal for Light and Electron Optics, 2015, 126(19): 2121-2124.

[66] 谢振平, 王涛, 刘渊. 一种集成贝叶斯决策的视频烟雾检测新方法[J]. 计算机工程与应用, 2014, 50(3): 173-176.

Xie Z P, Wang T, Liu Y. New video smoke detection method using Bayesian decision[J]. Computer Engineering and Applications, 2014, 50(3): 173-176.

[67] 陈康, 李耀华, 游峰, 等. 基于串并行处理的多特征交通视频烟雾检测算法[J]. 计算机与现代化, 2017( 4): 1- 6, 22.

ChenK, Li YH, YouF, et al. Smoke detection algorithm about video image with multiple features based on serial and parallel processing model[J]. Computer and Modernization, 2017( 4): 1- 6, 22.

[69] 姚丽莎, 徐国明, 赵凤. 基于卷积神经网络局部特征融合的人脸表情识别[J]. 激光与光电子学进展, 2020, 57(4): 041513.

[70] 赵亮. 基于视频的火灾烟雾检测算法的研究[D]. 泉州: 华侨大学, 2017.

ZhaoL. Research of fire smoke detection algorithm based on video[D]. Quanzhou: Huaqiao University, 2017.

[71] KrizhevskyA, HintonG. Convolutional deep belief networks on cifar-10[EB/OL]. [2020-05-13].https:∥www.cs.toronto.edu/~kriz/conv-cifar10-aug2010.pdf.

[72] Krizhevsky A, Sutskever I, Hinton G E. ImageNet classification with deep convolutional neural networks[J]. Communications of the ACM, 2017, 60(6): 84-90.

[73] Zeiler MD, FergusR. Visualizing and understanding convolutional networks[M] ∥ Fleet D, Pajdla T, Schiele B, et al. Computer Vision - ECCV 2014. Lecture Notes in Computer Science.Cham: Springer, 2014, 8689: 818- 833.

[74] SzegedyC, LiuW, JiaY, et al. Going deeper with convolutions[C]∥2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA. New York: IEEE, 2015: 1- 9.

[75] SimonyanK, Zisserman A. Very deep convolutional networks for large-scale image recognition[EB/OL].( 2014-09-04)[2020-05-13]. https:∥arxiv.org/abs/1409. 1556.

[76] He KM, Zhang XY, Ren SQ, et al. Deep residual learning for image recognition[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 770- 778.

[78] LiangM, Hu XL. Recurrent convolutional neural network for object recognition[C]∥2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA. New York: IEEE, 2015: 3367- 3375.

[79] 冯路佳, 王慧琴, 王可, 等. 基于目标区域的卷积神经网络火灾烟雾识别[J]. 激光与光电子学进展, 2020, 57(16): 161004.

[80] 曹诗雨, 刘跃虎, 李辛昭. 基于Fast R-CNN的车辆目标检测[J]. 中国图象图形学报, 2017, 22(5): 671-677.

[81] Ren S Q, He K M, Girshick R, et al. Faster R-CNN:towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[82] 李珣, 时斌斌, 刘洋, 等. 基于改进YOLOv2模型的多目标识别方法[J]. 激光与光电子学进展, 2020, 57(10): 101010.

[83] RedmonJ, Farhadi A.YOLO9000:better, faster, stronger[EB/OL].( 2016-12-25)[2020-05-13]. https:∥arxiv.org/abs/1612. 08242.

[84] RedmonJ, DivvalaS, GirshickR, et al. You only look once: unified, real-time object detection[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 779- 788.

[85] 杜晨锡, 严云洋, 刘以安, 等. 基于YOLOv2的视频火焰检测方法[J]. 计算机科学, 2019, 46(6): 301-304.

Du C X, Yan Y Y, Liu Y A, et al. Video fire detection method based on YOLOv2[J]. Computer Science, 2019, 46(6): 301-304.

[86] 刘学平, 李玙乾, 刘励, 等. 嵌入SENet结构的改进YOLOV3目标识别算法[J]. 计算机工程, 2019, 45(11): 243-248.

[87] 程淑红, 马继勇, 张仕军, 等. 改进的混合高斯与YOLOv2融合烟雾检测算法[J]. 计量学报, 2019( 5): 798- 803.

Cheng SH, Ma JY, Zhang SJ, et al. Smoke detection algorithm combined with improved Gaussian mixture and YOLOv2[J]. Acta Metrologica Sinica, 2019( 5): 798- 803.

[88] 谭威, 周斌, 张辉, 等. 基于SSD的实时车辆检测算法研究[J]. 计算机与数字工程, 2019, 47(11): 2763-2766.

[91] Tao CY, ZhangJ, WangP. Smoke detection based on deep convolutional neural networks[C]∥2016 International Conference on Industrial Informatics - Computing Technology, Intelligent Technology, Industrial Information Integration (ICIICII), December 3-4, 2016, Wuhan, China. New York: IEEE, 2016: 150- 153.

[93] 万博洋. 基于深度学习的烟雾检测算法研究[D]. 南昌:江西科技师范大学, 2018.

Wan BY. Study on smoke detection algorithm based on deep learning[D]. Nanchang: Jiangxi Science and Technology Normal University, 2018.

[94] 冯建新, 李慧, 刘治国. 新型火焰颜色空间: IFCS[J]. 计算机工程与应用, 2019, 55(5): 203-210, 264.

Feng J X, Li H, Liu Z G. New flame color space: IFCS[J]. Computer Engineering and Applications, 2019, 55(5): 203-210, 264.

Article Outline

陈长友, 杨健晟. 面向视频图像的烟雾检测算法综述[J]. 激光与光电子学进展, 2021, 58(4): 0400003. Changyou Chen, Jiansheng Yang. Review on Smoke Detection Algorithms for Video Images[J]. Laser & Optoelectronics Progress, 2021, 58(4): 0400003.

![烟雾运动方向估计的离散示意图[52]](/richHtml/lop/2021/58/4/0400003/img_2.jpg)

![不同场景下的烟雾检测例子[15]](/richHtml/lop/2021/58/4/0400003/img_3.jpg)