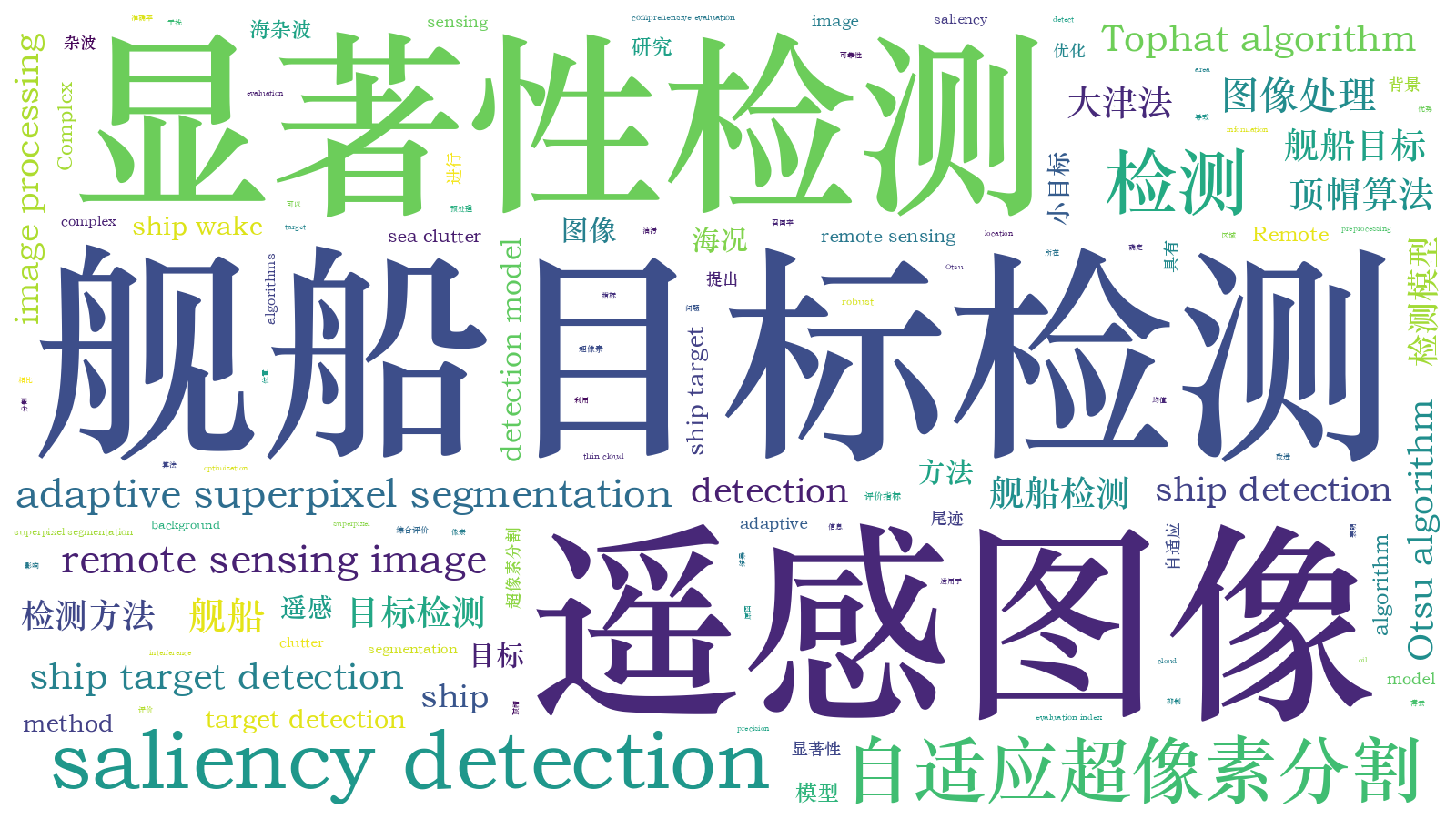

复杂海况下遥感图像舰船目标检测方法研究  下载: 1255次

下载: 1255次

1 引言

近年来,随着遥感技术的飞速发展,遥感卫星为海面舰船检测与识别提供了大量的高分辨率遥感图像数据,高分辨率遥感图像包含目标更多的特征信息,可以使舰船目标检测的精度得到大幅提升。中国海洋资源丰富,基于遥感图像的舰船检测广泛应用于军用、民用领域。例如,在特定海域或港口内,遥感技术可以实现对非法捕鱼、走私船舶的监测与管理;在恶劣天气状况下,舰船遇险失联事件时有发生,快速准确检测遇难舰船位置有利于救援工作展开。

现阶段针对遥感图像海面舰船检测的主要方法有:1)基于边缘信息的检测方法[1-3],根据舰船的边缘信息,结合形状特征获取舰船目标候选区域。2)基于灰度统计的检测方法[4],主要利用海域和舰船的灰度差异进行图像分割,但这两种方法在海况复杂时检测效果较差。3)基于分形模型的检测方法[5-6],根据舰船目标和背景是否具有明显的分形特征进行自动检测,但在有云雾干扰时,分形模型的拟合误差较大。4)基于显著性视觉的检测方法[7-9]模拟人类视觉感知机制,可以快速检测图像中感兴趣的区域,相比于其他方法,其检测速度较快,且在复杂海况下检测目标效果较好,其中ITTI模型[10]最经典,但耗时长,检测效果一般。近年来,随着显著性视觉检测方法的不断发展,很多经典算法相继出现,如CA(Context Aware)[11]模型、COV(Covariances)[12]模型、AIM(Attention Based on Information Maximization)[13]模型等,遥感图像中检测目标相对较小,且易受天气等干扰,上述方法对背景抑制能力较弱、耗时较长。因此,Hou等[14]提出了基于频域的光谱残差模型,算法运行速度大幅提升,但从频域进行分析时,检测到的显著图会丢失部分细节信息,存在图像边界不清晰的现象;此外,Wang等[15]提出的基于卷积神经网络的显著性检测方法精度大幅提升,但只适用于具有目标数据集的图像检测,不适用于复杂的遥感图像检测。

利用背景先验信息进行检测是一种有效的方式,目前大多数方法基于图像区域是否与图像边缘关联判断当前区域是否可以作为背景,但该方法易引入前景噪声。其中RBD(Robust Background Detection)[16]模型利用边界连通性代替假设图片边界背景,具有直观和清晰的几何解释,其稳健性特别适用于高精度背景检测和显著性估计,且运行速度快,对遥感图像中目标的检测效果较好。但RBD模型依然存在一些问题,例如,易检测出某些干扰区域、小目标易漏检、海杂波等干扰易造成误判等。针对上述问题,本文提出自适应稳健背景的显著性优化(self-adaption RBD)算法,可以实现复杂海况下遥感图像舰船目标检测。

2 RBD模型原理

RBD模型通过衡量区域

首先,通过背景测量将具有相同边界特性的像素点相连,定义相连的像素点所组成的区域为边界连通区域,公式表示为

式中:

为计算方便,模型使用SLIC(simple linear iterative clustering)[17]超像素分割方法,将图像抽象为一组近似规则的超像素,连接所有相邻超像素,利用最短路径构造一个相似度。

然后,根据相似度量结果,计算区域面积,公式表示为

式中:

同样地,根据相似度量结果,计算连通区域的边界长度,则有

当超像素在图像边界时,

最后,利用边界区域面积及长度,计算边界连通值,可得

通常,图像中目标与背景的边界连通值区别明显:目标的连通值接近于0,而背景的连通值大于1,所以设定一个阈值即可分离目标与背景,进而得到显著性区域。

3 复杂海况下遥感图像小目标舰船检测模型

在复杂海况下的遥感图像中,目标相对较小,检测易受舰船尾迹、海杂波、薄云、油污等影响,传统的显著性检测方法耗时长、检测虚警率高。RBD模型可以有效抑制部分海况的影响,但虚警率仍然较高。本研究对RBD模型进行改进,利用顶帽算法(Tophat)对遥感图像进行预处理,抑制舰船尾迹、海杂波等干扰;对模型实现自适应超像素分割,检测小目标舰船,并抑制薄云、油污等影响,防止漏检;改进大津法(Otsu),从而提取目标。

3.1 顶帽算法预处理

舰船检测受环境影响较大,当存在海杂波时,海杂波的纹理影响舰船检测的精度,增加了虚警率。舰船在海上行驶时,船体后方会形成一段距离的尾迹,导致检测结果不精确。为了削弱海杂波、舰船尾迹等对舰船检测结果的影响,利用顶帽算法抑制海杂波和舰船尾迹,该算法很好地保留了舰船目标的细节特征,可以有效去除局部不均匀,从而得到目标和背景对比度较大的图像,提高检测性能,顶帽算法流程如下。

设输入图像为

式中:Θ为灰度腐蚀。顶帽变换就是从原图中减去开运算,假设

图 2. 顶帽算法预处理前后对比图。(a)原图;(b)顶帽算法预处理后

Fig. 2. Comparison of images before and after Tophat-algorithm preprocessing. (a) Original image; (b) after Tophat-algorithm preprocessing

3.2 基于自适应超像素分割的RBD模型

在RBD模型中,采用SLIC算法对遥感图像进行超像素分割。对于传统的SLIC分割算法,首先,找到初始化聚类中心,假设有

上述方法存在分割数目固定的缺陷,其分割数量

首先,定义吸引函数

式中:

然后,定义归属函数

式中:

式中:

改进算法利用吸引函数与归属函数传递消息,吸引函数和归属函数的迭代关系如(11)式、(12)式所示。吸引函数与归属函数之和越大,说明

图 3. 固定K值与自适应K值的分割舰船对比图。(a)原图;(b)固定K值;(c)自适应K值

Fig. 3. Comparison of segmented ships with fixed K value and adaptive K value. (a) Original image; (b) fixed K value; (c) adaptive K value

图 4. RBD模型与改进后的RBD模型舰船检测对比。(a)原图;(b) RBD;(c)改进后的RBD模型

Fig. 4. Comparison of ship detection from RBD model and improved RBD model. (a) Original image; (b) RBD model; (c) improved RBD model

3.3 基于Sobel边缘检测的Otsu分割算法

得到舰船显著图后,采用分割算法对图片进行分割,即可得到舰船所在位置。传统的Otsu算法[18]利用最优阈值将原图像分为前景与背景两部分,这两部分的类间方差越大或类内方差越小,说明差别越大,最优阈值为目标与背景离图像中心最远时对应的灰度值。而在遥感图像的舰船检测中,同一目标内部的灰度值变化微弱,不同目标之间的灰度值变化明显,传统的Otsu算法最佳阈值判别准则函数已经不再适用。而且,舰船检测通常存在海杂波影响,图像不均匀,而Otsu算法仅适用于目标与背景分布均匀的图像。因此,在传统的Otsu算法基础上,结合遥感图像的特点,对算法进行改进,提出基于Sobel边缘检测的Otsu分割算法。传统的Otsu分割算法公式为

式中:

由于海面舰船目标较小,目标与背景之间的边界不清晰,计算图像中所有灰度值并不准确,传统的Otsu分割算法在背景中分割目标时效果较差。因此,利用Sobel边缘算子进行边缘检测,与其他算子相比,Sobel算子具有更好的抗噪能力,边缘错误少且质量高。本文算法主要包括两个步骤:1)利用Sobel算子提取图片中边缘的灰度信息,得到边缘区域;2)对边缘区域进行Otsu分割。改进算法的步骤如下。

假设原始图像为

对边缘图像中像素值不为0的区域进行Otsu分割,选取合适的

本文算法采用局部代表性像素而非原始图像中的所有像素计算阈值

图 5. 改进前后Otsu分割算法对比。(a)原图;(b) Otsu算法;(c)改进后Otsu算法

Fig. 5. Comparison of Otsu segmentation algorithms before and after improvement. (a) Original image; (b) Otsu algorithm; (c) improved Otsu algorithm

4 实验结果与分析

为验证本文算法的优越性,对复杂海况下遥感图像舰船目标进行检测,并与其他显著性检测算法进行对比。实验选用45幅图片,均来源于Google Earth和美国Digital Globe公司的Quick Bird卫星,分辨率为0.61 m,所用软件平台为Matlab 2014a和Visual Studio 2010,计算机配置为Intel 3.10 GHz CPU,4 GB内存。

4.1 显著性检测

对比存在海杂波、油污、薄云情况的海面以及简单海面下,CA、COV、GS[19](Geodesic Saliency)、MR[20](Manifold Ranking)、SF[21](Saliency Filters)、RBD和本文算法对遥感图像舰船的检测结果,同时对小目标舰船进行检测,结果如

由

由

图 6. 简单海面下无尾迹各种算法显著图。(a)原图;(b) CA;(c) COV;(d) GS;(e) MR;(f) SF;(g) RBD;(h)本文算法

Fig. 6. Saliency images without wakes of detections by various algorithms on simple sea surface. (a) Original image; (b) CA algorithm; (c) COV algorithm; (d) GS algorithm; (e) MR algorithm; (f) SF algorithm; (g) RBD algorithm; (h) proposed algorithm

图 7. 海杂波下有尾迹各种算法显著图。(a)原图;(b) CA;(c) COV;(d) GS;(e) MR;(f) SF;(g) RBD;(h)本文算法

Fig. 7. Saliency images with wakes of detections by various algorithms on sea clutter. (a) Original image; (b) CA algorithm; (c) COV algorithm; (d) GS algorithm; (e) MR algorithm; (f) SF algorithm; (g) RBD algorithm; (h) proposed algorithm

图 8. 油污海面上各种算法显著图。(a)原图;(b) CA;(c) COV;(d) GS;(e) MR;(f) SF;(g) RBD;(h)本文算法

Fig. 8. Saliency images of detections by various algorithms on oily sea surface. (a) Original image; (b) CA algorithm; (c) COV algorithm; (d) GS algorithm; (e) MR algorithm; (f) SF algorithm; (g) RBD algorithm; (h) proposed algorithm

图 9. 薄云情况下各种算法检测图。(a)原图;(b) CA;(c) COV;(d) GS;(e) MR;(f) SF;(g) RBD;(h)本文算法

Fig. 9. Saliency images of detections by various algorithms under thin clouds. (a) Original image; (b) CA algorithm; (c) COV algorithm; (d) GS algorithm; (e) MR algorithm; (f) SF algorithm; (g) RBD algorithm; (h) proposed algorithm

图 10. 小目标舰船各种算法检测图。(a)原图;(b) CA;(c) COV;(d) GS;(e) MR;(f) SF;(g) RBD;(h)本文算法

Fig. 10. Saliency images of small ship detection by various algorithms. (a) Original image; (b) CA algorithm; (c) COV algorithm; (d) GS algorithm; (e) MR algorithm; (f) SF algorithm; (g) RBD algorithm; (h) proposed algorithm

由

如

通过实验分析可知,无论是在简单海况下,还是在存在海杂波、薄云等情况下,本文算法效果均优于其他模型,适用于复杂海况下遥感图像小目标舰船检测。

4.2 显著性检测评价实验

通过上述实验结果可知,本文模型优于其他模型,但还需对目标鉴别后的检测性能进行测试。选择45张图片,共238只舰船,利用准确率

准确率为正确检测的舰船数与检测总数之比,表示正确预测的正样本数与所有预测正样本之比;

式中:

图 11. 不同方法的显著性检测结果对比

Fig. 11. Comparison of saliency detection results by different algorithms

4.3 显著性检测耗时实验

在复杂海况下,能否快速检测也是研究的重点之一,各种模型的检测时间如

表 1. 不同模型的运行时间

Table 1. Running time of different modelss

|

从

5 结论

通过预处理遥感图像,利用改进RBD模型实现自适应超像素分割,并在Otsu分割算法中,融入Sobel算子边缘检测,实现了快速提取目标和复杂海况下遥感图像舰船目标检测。实验结果表明,本文模型具有良好的检测效果,遥感图像舰船检测准确率为91.20%,召回率为79.31%,综合评价指标为84%。但该模型在运行效率上仍有待提高,下一步研究重点为模型的加速优化。

[2] 刘进, 杨洁, 庞瑞帆, 等. 一种基于多尺度特征簇的舰船目标快速定位与识别方法[J]. 武汉大学学报(信息科学版), 2016, 41(1): 111-116.

[3] 孙熊伟, 徐青山, 蔡熠, 等. 基于边缘相位编码的复杂背景下海天线检测[J]. 光学学报, 2017, 37(11): 1110002.

[5] 刘宁波, 丁昊, 田永华, 等. 基于组合分形特征的海杂波中目标检测方法[J]. 航空兵器, 2018( 2): 38- 42.

Liu NB, DingH, Tian YH, et al. Target detection method in sea clutter based on combined fractal characteristics[J]. Aero Weaponry, 2018( 2): 38- 42.

[7] Borji A, Cheng M M, Jiang H Z, et al. Salient object detection: a benchmark[J]. IEEE Transactions on Image Processing, 2015, 24(12): 5706-5722.

[8] 王士一, 王双, 张立保. 一种结合显著性分析的高分辨率遥感图像道路提取算法[J]. 光学学报, 2015, 35(s2): s210001.

[9] 张立保, 章珏. 基于显著性分析的自适应遥感图像融合[J]. 中国激光, 2015, 42(1): 0114001.

[13] Bruce N DB, Tsotsos JK. Saliency based on information maximization[C]∥Proceedings of the 18th International Conference on Neural Information Processing Systems, December 5-8, 2005, Vancouver, British Columbia, Canada.Cambridge: MIT Press, 2005: 155- 162.

[14] Hou XD, Zhang LQ. Saliency detection: a spectral residual approach[C]∥2007 IEEE Conference on Computer Vision and Pattern Recognition, June 17-22, 2007, Minneapolis, MN, USA. New York: IEEE, 2007.

[15] Wang LZ, Wang LJ, Lu HC, et al. Saliency detection with recurrent fully convolutional networks[M] ∥Leibe B, Matas J, Sebe N, et al. Computer vision-ECCV 2016. Lecture notes in computer science. Cham: Springer, 2016, 9908: 825- 841.

[16] Zhu WJ, LiangS, Wei YC, et al. Saliency optimization from robust background detection[C]∥2014 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2014, Columbus, OH, USA. New York: IEEE, 2014: 2814- 2821.

[17] 郝刚涛, 杜小平, 宋建军, 等. 基于权值优化分块自适应灰度-距离Markov随机场的无扫描3D激光雷达距离图像重构[J]. 光学学报, 2015, 35(8): 0811001.

[18] SehgalS, KumarS, Bindu MH. Remotely sensed image thresholding using OTSU & differential evolution approach[C]∥2017 7th International Conference on Cloud Computing, Data Science & Engineering - Confluence, January 12-13, 2017, Noida, India. New York: IEEE, 2017: 138- 142.

[19] Wei YC, WenF, Zhu WJ, et al. Geodesic saliency using background priors[M] ∥Fitzgibbon A, Lazebnik S, Perona P, et al. Computer vision-ECCV 2012. Lecture notes in computer science. Berlin, Heidelberg: Springer, 2012, 7574: 29- 42.

[20] YangC, Zhang LH, Lu HC, et al. Saliency detection via graph-based manifold ranking[C]∥2013 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2013, Portland, OR, USA. New York: IEEE, 2013: 3166- 3173.

[21] PerazziF, KrähenbühlP, PritchY, et al. Saliency filters: contrast based filtering for salient region detection[C]∥2012 IEEE Conference on Computer Vision and Pattern Recognition, June 16-21, 2012, Providence, RI, USA. New York: IEEE, 2012: 733- 740.

Article Outline

陈彦彤, 李雨阳, 姚婷婷. 复杂海况下遥感图像舰船目标检测方法研究[J]. 激光与光电子学进展, 2019, 56(18): 181007. Yantong Chen, Yuyang Li, Tingting Yao. Ship Detection from Remote Sensing Image Under Complex Sea Conditions[J]. Laser & Optoelectronics Progress, 2019, 56(18): 181007.