基于图像复原的衍射望远镜暗弱目标成像  下载: 1063次

下载: 1063次

1 引言

衍射望远镜为设计大口径、轻量化的望远镜提供了新思路[1]。对其主镜衍射元件进行台阶化加工能引起多级次衍射现象[2],进而降低了成像光能利用率。为校正色差,在衍射望远镜中加入衍射次镜[3],但这使得成像光能利用率进一步下降,非成像衍射级次光干扰增强,成像对比度降低,对噪声敏感。菲涅耳衍射元件可等效于由具有不同焦距的透镜叠加组成的器件,其产生的不同级次光所对应的等效透镜焦距是不同的。非设计级次杂散光到达设计级次光对应的焦平面后无法成像,会发散或者会聚,在成像面上形成干扰,进而导致成像质量退化。这种成像退化可通过点扩展函数表征。基于这一理念,之前的研究将包含多级次衍射现象的点扩展函数代入自适应维纳滤波(Awn)算法中,复原出了衍射望远镜高对比度图像[4]。但是,相机噪声水平与成像系统的能量利用率高低有关。衍射望远镜系统仅有设计级次光,系统成像的能量利用率比传统系统的低,而输出图像的噪声水平高。Awn算法没有对图像细节和噪声这两种高频信息进行区别处理,抗噪性差,导致对暗弱目标图像无法复原出高对比度清晰图像。

依据图像先验模型的不同,图像去噪算法主要分为局部平滑、非局部自相似、稀疏表示三类。经典的总变分正则化模型[5-6]利用图像局部平滑特性,在保持边缘和复原平坦区域方面表现出良好的性能,但是其通常会使图像的精细纹理部分变得平滑,从而损失了图像细节。非局部均值模型利用图像的非局部自相似性可以有效地去除噪声并保留自然图像的纹理和细节。近年来,基于稀疏性的正则化方案[7]作为替代方案在各种图像复原问题上有良好的结果。块匹配三维协同滤波(BM3D)算法将非局部自相似思想和小波域稀疏表示结合,是目前去噪能力最好的算法之一[8-10]。该算法假设噪声水平是已知的,但是在实际光学成像系统成像时,输出图像的噪声水平随光源强度变化而变化,例如自然光强随四季、天气等的变化而不同,噪声水平也不同。一般的图像复原算法(包括BM3D算法)无法在实际系统中直接使用。

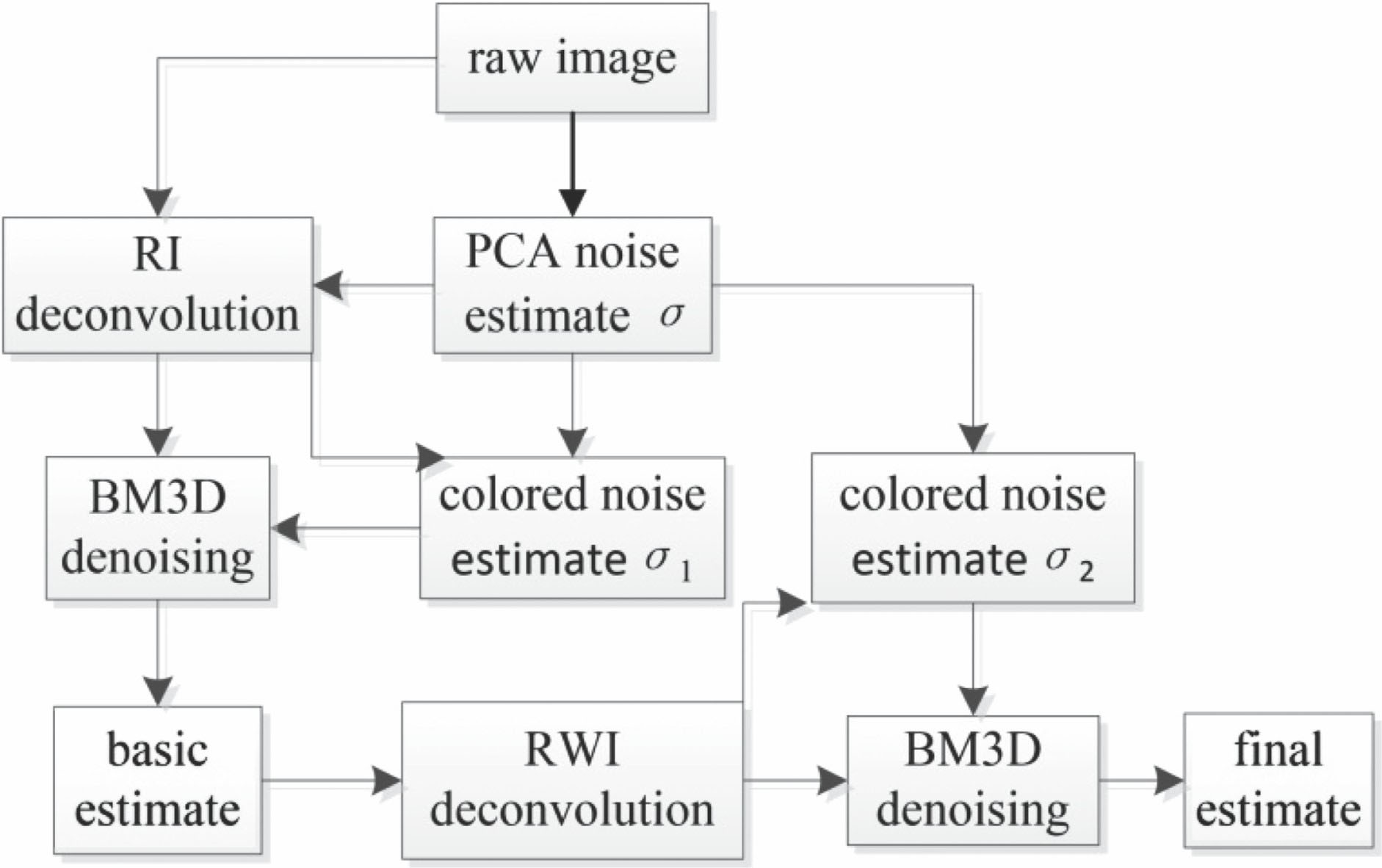

为此,本文提出了一种基于主成分分析(PCA)的噪声自适应估计BM3D图像复原(ABM3D)算法。通过主成分分析法,自适应地对图像噪声进行估计;然后通过Tikhonov正则化去卷积算法提高图像对比度,采用BM3D算法降低图像噪声影响。最终衍射望远镜系统实现了暗弱目标的高对比度成像。在不同噪声水平下,仿真对比ABM3D算法与Awn算法的图像复原能力,并通过两种不同光照条件下的衍射望远镜系统成像实验,验证了ABM3D算法能够有效地提高衍射成像系统的图像复原质量。ABM3D算法是一种通用的白噪声抑制算法,在所有对高斯白噪声敏感的线性移不变光学成像系统中均适用。

2 衍射成像系统中噪声影响分析

假设衍射成像系统是线性移不变的,则相应的成像退化模型可以表示为

式中:(x,y)为像平面空间坐标;g(x,y)和o(x,y)分别为退化图像和原始清晰图像;h(x,y)为退化函数;为卷积算符;n(x,y)为加性噪声。对于非相干光学成像系统,h(x,y)表示点扩展函数(PSF)。则衍射成像系统的PSF计算公式[4]为

式中:(x0,y0)为光瞳平面空间坐标;F{·}为傅里叶变换操作;(u,v)为像平面频域空间坐标;λ为波长;f为成像系统的等效焦距。衍射成像系统的广义光瞳函数[4]表示为

式中:a为衍射系统口径的半径;周期τ=2λf;N为衍射透镜的台阶数;circ(·)为圆形孔径函数;Cn为衍射元件第n级衍射光的系数,Cn的平方为对应级次的衍射效率。一般而言,衍射效率是指用于成像的-1级光的衍射效率。这表明衍射成像系统除了存在因传统成像系统中折射、反射及光光吸收等引起的能量损失外,还存在非设计级次衍射形成的杂散光能量。

在图像传感器中,电荷耦合器件(CCD)具有动态范围大、尺寸小、量子转换效率高、工作可靠等优点,被认为是可见光成像、空间光学、微光夜视等领域最有前途的探测器件之一[11],选用CCD作为成像器件。当照明强度恒定、均匀时,噪声主要包括暗电流散粒噪声、读出噪声及光子散粒噪声。前两种噪声可分别通过致冷和相机电路设计方式抑制。光子散粒噪声分布近似满足高斯分布,通常又被称为高斯白噪声,它是CCD相机所固有的噪声,不能被后续电路抑制或抵消。因此,在图像复原过程中,主要抑制白噪声对衍射系统成像的影响。

太阳折、反射光经衍射望远镜系统后,自然界的目标图像最终被图像传感器接收。目标信号的强弱取决于光强大小、成像系统的能量利用率、图像传感器的转换效率等。在相同的光源强度下,衍射成像系统得到的图像的噪声水平高,图像细节清晰度差。信号与噪声的相对值能更好地反映目标能量。为了定量评估噪声水平,对不同光照水平下的输出图像进行归一化,然后采用图像噪声的归一化标准差σ描述图像的噪声水平。σ值越大,噪声影响越明显,图像质量越差。将σ≥0.03的目标图像定义为暗弱目标。

3 自适应去噪BM3D算法

根据衍射成像系统的退化模型,高对比度清晰图像的表达式为

式中:

目前许多基于高斯噪声模型的图像噪声标准差估计算法的准确性取决于图像平坦区域的丰富度[13-14]。无论图像是否具有丰富的纹理,PCA噪声估计法都可以对噪声进行良好的估计[15-16],是一种有效的统计方法。通过滑动将图像分成s个图像块,每个块包含r个元素,则这些图像块的协方差矩阵表示为

式中:m为图像块个数变量;μ为图像块灰度值的均值;xm为第m个图像块的灰度值。将该矩阵的特征值降序排列为λ1,λ2,…,λr。低维子空间描述了自然图像的信号信息。冗余维度包含噪声信息,其特征值服从高斯分布。当冗余维度中的特征值均值等于中值时,该特征值均值即为该图像噪声的方差。通过迭代计算,选择协方差矩阵的r-j+1个最小特征值,以满足

此时σ=

通过正则化逆去卷积算法计算初级去卷积图像,表达式为

式中:转换函数T1(u,v)由标准Tikhonov正则化模型计算得出;H(u,v)为光学传递函数,是PSF的频域表达;γ1为对应的正则化系数。根据T1(u,v)和σ,得到初级去卷积后的有色噪声标准差σ1。通过BM3D去噪算法,首先对噪声图

终极估计图像的流程与初级估计图像基本相似。正则化维纳逆算法去卷积,BM3D算法去噪。不同之处在于,去卷积算法中的转换函数是由标准a-la-Tikhonov正则化模型得出的,表达式为

式中:γ2为对应的正则化系数。

4 算法验证

4.1 仿真验证

为了验证所提算法的有效性,首先仿真分析不同噪声水平下两种算法的复原效果。由原始图像与PSF的卷积加不同水平的高斯白噪声得到仿真过程的退化图像。仿真图选用美国空军(USAF)制定的USAF1951分辨率板[17],如

图 2. 分辨率板和仿真MTF曲线。(a)原始图;(b)仿真MTF曲线

Fig. 2. Resolution board and simulated MTF curve. (a) Original image; (b) simulated MTF curve

为了直观地观察两种图像复原算法的复原效果,

图 3. 分辨率板仿真图像复原结果比较。(a)退化图; (b) Awn复原图; (c) ABM3D复原图

Fig. 3. Comparison of simulation restoration results of resolution boards. (a) Raw images; (b) restored images by Awn algorithm; (c) restored images by ABM3D algorithm

为了验证算法的鲁棒性,

图 4. 不同噪声水平下图像复原前后的参数结果。(a) PSNR; (b) SSIM

Fig. 4. Parameter results for images with and without restoration under different noise levels. (a) PSNR; (b) SSIM

4.2 实验验证

系统实验装置和相应的光路如

式中:Imax和Imin分别为某对黑白条状棒光强灰度值的最大值和最小值。一般通过光学系统输出的像的对比度比输入像的对比度要差,对比度的变化量与空间频率特性有密切的关系。调制度表示物的对比情况,输出像与输入像的调制度之比为对应频率处MTF值。为了排除噪声的影响,在一组中选取多对条状棒的调制度并取平均值。

图 5. 衍射望远镜成像系统的实验装置和对应的光路示意图

Fig. 5. Experimental setup and light path diagram of diffractive telescope imaging system

在目标位置放置针孔,测量衍射成像系统的MTF,结果如

在目标位置处采用是否添加衰减片的方式来模拟不同光源强度。为了更好地量化不同光照强度,对获取的图像进行归一化处理后,通过PCA噪声估计法得出噪声标准差。归一化噪声方差值越大,表示光源强度越弱。将不同光照下的归一化图像与测量得到的MTF结合,计算出两种算法下的复原图像。

图 7. 分辨率板实验图像复原结果比较。(a)输出图; (b) Awn复原图; (c) ABM3D 复原图

Fig. 7. Comparison of experimental restoration results of resolution boards. (a) Output images; (b) restored images by Awn algorithm; (c) restored images by ABM3D algorithm

为了更清晰地评价复原效果,

从仿真和实验上验证了ABM3D算法在衍射空间望远镜成像中的优势。值得注意的是,该算法是针对噪声满足高斯随机分布的图像提出的,并没有对衍射望远镜的特点进行特殊的改进,即该算法在满足线性移不变条件的其他光学成像系统中也是有效的。

5 结论

针对衍射成像系统图像噪声水平高、细节清晰度差的问题,提出了ABM3D图像复原算法。在不同的噪声水平下,利用实际衍射望远镜系统样机对ABM3D算法的复原效果进行了仿真和实验验证。从定量评价和视觉观察两个角度验证ABM3D算法的有效性和鲁棒性,图像对比度得到了进一步提高。ABM3D算法复原前后,图像调制度值至少提高了3.58倍。该研究为衍射望远镜系统对暗弱目标进行高对比成像提供了一种新的技术路线。

[1] Atcheson P, Domber J, Whiteaker K, et al. MOIRE: ground demonstration of a large aperture diffractive transmissive telescope[J]. Proceedings of SPIE, 2014, 9143: 91431W.

[2] O'Shea DC, Suleski T J, Kathman A D, et al. Diffractive optics: design, fabrication, and test[M]. Washington: SPIE, 2003: 57- 75.

[3] Hyde R, Dixit S, Weisberg A, et al. Eyeglass: a very large aperture diffractive space telescope[J]. Proceedings of SPIE, 2002, 4849: 28-39.

[4] Yang J J, Wang S, Wen L H, et al. Experimental study on imaging and image deconvolution of a diffractive telescope system[J]. Applied Optics, 2019, 58(33): 9059-9068.

[6] 乔凯, 智喜洋, 江世凯, 等. 空间大口径衍射成像系统的图像反演恢复与增强[J]. 光学精密工程, 2019, 27(7): 1465-1472.

[7] Dong W S, Zhang L, Shi G M, et al. Nonlocally centralized sparse representation for image restoration[J]. IEEE Transactions on Image Processing, 2013, 22(4): 1620-1630.

[8] Javaran T A, Hassanpour H, Abolghasemi V. Non-blind image deconvolution using a regularization based on re-blurring process[J]. Computer Vision and Image Understanding, 2017, 154: 16-34.

[9] PlotzT, RothS. Benchmarking denoising algorithms with real photographs[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI. New York: IEEE, 2017: 2750- 2759.

[10] SonH, LeeS. Fast non-blind deconvolution via regularized residual networks with long/short skip-connections[C]∥2017 IEEE International Conference on Computational Photography (ICCP), May 12-14, 2017, Stanford, CA, USA. New York: IEEE, 2017.

[11] HausJ. Optical sensors: basics and applications[M]. Weinheim: Wiley-VCH, 2010: 33- 37.

[12] Dabov K, Foi A, Katkovnik V, et al. Image denoising by sparse 3-D transform-domain collaborative filtering[J]. IEEE Transactions on Image Processing, 2007, 16(8): 2080-2095.

[13] Immerkær J. Fast noise variance estimation[J]. Computer Vision and Image Understanding, 1996, 64(2): 300-302.

[14] Meer P, Jolion J M, Rosenfeld A. A fast parallel algorithm for blind estimation of noise variance[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1990, 12(2): 216-223.

[15] Chen GY, Zhu FY, Heng PA. An efficient statistical method for image noise level estimation[C]∥2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 477- 485.

[17] British StandardsInstitution. Photography: electronic still picture imaging: resolution and spatial frequency responses: BS ISO 12233: 2017[S]. Switzerland: BSI Standards, 2017.

[18] Xia YT, Chen ZZ. Quality assessment for remote sensing images: approaches and applications[C]∥2015 IEEE International Conference on Systems, Man, and Cybernetics, October 9-12, 2015, Kowloon Tong, Hong Kong, China. New York: IEEE, 2015: 1029- 1034.

[19] Wang Z, Bovik A C. A universal image quality index[J]. IEEE Signal Processing Letters, 2002, 9(3): 81-84.

[20] Young SS, Driggers RG, Jacobs EL. Signal processing and performance analysis for imaging systems[M]. London: Artech House, 2008: 41- 61.

Article Outline

杨静静, 王帅, 文良华, 杨平, 杨伟, 官春林, 许冰. 基于图像复原的衍射望远镜暗弱目标成像[J]. 光学学报, 2020, 40(14): 1411005. Jingjing Yang, Shuai Wang, Lianghua Wen, Ping Yang, Wei Yang, Chunlin Guan, Bing Xu. Faint-Object Imaging of Diffractive Telescopes Based on Image Restoration[J]. Acta Optica Sinica, 2020, 40(14): 1411005.