基于局部重构Fisher分析的高光谱遥感影像分类  下载: 877次

下载: 877次

1 引言

高光谱图像(HSI)因具有光谱分辨率高、图谱合一的优势而在生态环境监测、矿产资源勘探、病虫害预防、地面物体识别、生物医学等领域得到了广泛应用[1-3]。但是波段数多、数据量大的特点,也使得其光谱冗余信息较多,“同物异谱”和“异物同谱”现象严重,增加了地物分类的难度。因此,降低数据维度、提取有效特征成为高光谱图像分类的研究热点[4-9]。

研究人员提出了一系列降低高维数据维数的方法。主成分分析法(PCA)[10]通过使投影后样本的方差最大化来实现样本点的可分性,已被广泛应用于高维数据的特征提取。然而,PCA是一种无监督学习方法,在用于高光谱图像的特征提取时没有利用高光谱数据中的类别标签信息,分类效果有限。为了提升所提取特征的判别性,研究人员提出了一些监督学习方法,如线性判别分析(LDA)[11]方法。LDA是一种传统的有监督降维算法,它通过最小化同类样本投影的协方差,以及最大化不同类样本投影中心的距离,来实现高维数据在低维空间中的可分性。然而LDA存在“小样本类别”问题,会导致信息丢失。为了解决这一问题,研究人员提出了最大间距准则(MMC)[12]和局部Fisher判别分析(LFDA)[13]等方法。然而这些方法都是基于统计理论提出的,没有考虑存在于高维数据中的几何信息。

近年来,人们注意到流形学习方法可以发现嵌在高维空间中的低维流形,在降维的同时可以利用样本在高维空间中的几何信息来提高高光谱图像的分类精度。常用的流形学习方法包括等度量映射(ISOMAP)[14]、局部线性嵌入(LLE)[15]及其线性近似方法邻域保持嵌入(NPE)[16]、拉普拉斯特征映射(LE)[17]及其线性近似方法局部保持嵌入(LPP)[18]。然而NPE和LPP为无监督学习方法,在提升高光谱图像分类精度的效果上依然受到限制。Yan等[19]提出了一种图嵌入框架,该框架可以将上述方法统一起来,每个算法都可以看作是直接图嵌入或者其线性、核、张量等的扩展。在该框架下,Yan等[19]提出了边界Fisher分析(MFA)。MFA使用本征图表征样本与其类内近邻点间的紧凑性,使用惩罚图来表示不同类边界点间的离散关系。然而,MFA算法只考虑了相邻点间的结构关系,并不能有效表征高光谱图像中同质区域地物的几何结构关系。为了解决这一问题,Luo等[20]提出了局部几何结构Fisher分析(LGSFA)方法。该方法首先利用同类近邻重构各数据点,然后利用各数据点的邻域以及邻域点对应的重构点来构建本征图和惩罚图,在低维空间中保持本征图的结构关系,同时抑制惩罚图的结构关系,最终得到了样本由高维空间到低维空间的投影矩阵,并提取出了判别特征。但是,在构建本征图和惩罚图时,由于同时使用了原始点和重构点,因此不能有效保持流形的整体结构,且构图方式较为复杂,降低了算法的运行效率,影响了对高光谱图像的分类效果。

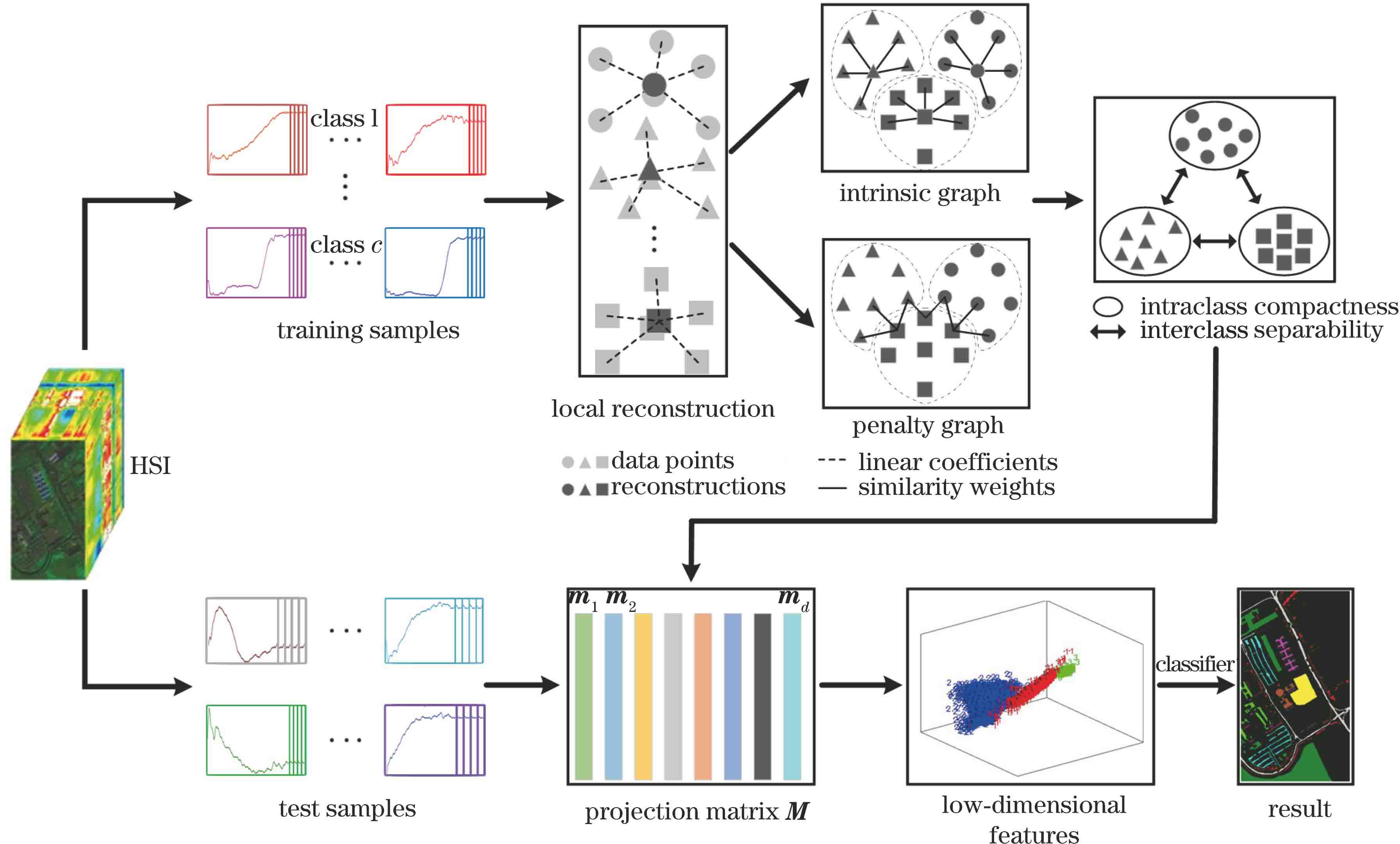

针对上述问题,本文提出一种局部重构Fisher分析(LRFA)方法。该方法首先利用类内近邻样本对原始样本进行重构,然后使用重构后的类内近邻样本点构建本征图,并使用非同类近邻点构建惩罚图。在低维空间中,所提方法通过减小类内样本间的距离使类内样本更加紧凑,通过增大类间样本间的距离使非同类样本更为离散,从而得到更好的判别特征,提高了高光谱图像的分类精度。

2 基本原理与算法

假设X=[x1,x2,…,xN]∈RD×N表示高光谱图像数据集,其中xi为样本点,D为光谱波段数,N为样本数。样本标签ci={1,2,…,c},c为地物类别数。低维嵌入特征Y=MTX,其中Y=[y1,y2,…,yN]∈Rd×N,d(d≪D)为嵌入特征维度,M=[m1,m2,…,md]∈RD×d为投影矩阵。

2.1 图嵌入

图嵌入框架定义了用本征图G={X,W}与惩罚图Gp={X,Wp}来表征数据集的某些统计或几何性质,其中:W和WP为相似矩阵,其元素表示样本对间的相似性关系。矩阵W对应期望在低维空间中保持的相似性特征,矩阵WP对应需要在低维空间中抑制的相似性特征。图嵌入方法通过减小具有正相似性关系的两个样本(同类样本)在低维空间中的距离,以及增大具有负相似性关系的两个样本(非同类样本)在低维空间中的距离,来提高特征的判别能力。图嵌入方法的目标函数为

式中:a为常量;L为本征图的拉普拉斯矩阵(L=D-W,D为本征图的对角矩阵,Dii=

2.2 LRFA方法

本文的LRFA方法主要通过表征嵌入在高维空间中的低维流形结构来提取低维判别特征,进而改善高光谱图像的分类效果。该算法首先利用原始样本的类内近邻样本进行重构,在表征同质区域结构关系的同时保持了流形结构的完整性;然后利用重构后的样本点构造本征图和惩罚图,在低维空间减小本征图中样本点间的距离,增大惩罚图中样本点间的距离,达到同类样本尽可能聚集,不同类样本尽可能离散的目的,使获取的低维特征更有判别性,从而提高高光谱图像的地物分类性能。

高维空间中位于流形结构上的样本在局部呈线性分布。当将样本投影到低维空间时,保持其在高维空间中与其类内近邻样本间的局部线性关系,就可以提高算法对同类地物结构的表征能力,进而提高特征的判别性。采用最小化重构误差来得到线性重构系数,以表征这种结构关系,即

式中:k为选取的类内近邻个数;

采用拉格朗日乘子法求解(2)式的最优解,可得线性重构系数为

式中:

在本征图中,如果样本点xj属于xi的同类地物的k近邻,则用一条边连接,否则不连接。本征图的相似矩阵W中的元素可以表示为

式中:ti=

在惩罚图中,如果样本点xj为xi的非同类地物的kp近邻,则用一条边连接,否则不连接。惩罚图的相似矩阵WP中的元素定义为

式中tp,i=

在低维空间中,为了尽可能减小同类样本间的距离,使同一类地物更加聚集,将本征图对应的目标函数表示为

式中:V=[v1,v2,…,vN]。

同样,在低维空间中,为了增大不同类别地物之间的离散性,提高地物的可分性,将惩罚图对应的目标函数表示为

根据式(6)~(7),可将LRFA算法的目标函数优化为

采用拉格朗日乘子法求解式(8)的最优解,可得

式中:λ为拉格朗日系数。

求解(9)式的特征值,然后将特征值按从小到大排序,取前d个特征值对应的特征向量作为投影矩阵M=[m1,m2,…,md]。最后,低维嵌入特征可以表示为Y=MTX∈Rd×N。

本文算法的具体实现步骤如下。

输入:高光谱图像数据集X=[x1,x2,…,xN]∈RD×N,样本标签ci={1,2,…,c},类内近邻数k,非同类近邻数kp,嵌入特征维度d(d≪D)。

输出:投影矩阵M=[m1,m2,…,md]∈RD×d。

步骤1:对于样本xi的同类近邻点,采用(3)式计算线性系数vi=

步骤2:构建本征图,根据(4)式计算相似权值wij,得到相似矩阵W。

步骤3:构建惩罚图,根据(5)式计算相似权值

步骤4:计算本征图G的拉普拉斯矩阵L=D-W,其中Dii=

步骤5:计算惩罚图Gp的拉普拉斯矩阵Lp=Dp-Wp,其中

步骤6:计算(9)式的特征值及特征向量,选取前d个特征值对应的特征向量组成投影矩阵M=[m1,m2,…,md],即得低维嵌入特征Y=MTX∈Rd×N。

通过投影矩阵获得样本的低维特征后,使用相关的分类器对低维特征进行分类处理,最终得到算法对高光谱图像的分类结果。

LRFA算法的流程图如

3 实验分析与讨论

3.1 实验数据集

1) Pavia University数据集

该遥感影像数据集由ROSIS传感器在意大利北部Pavia上空采集而成。丢弃不包含任何信息的样本后,该数据集的像素为610×340,空间分辨率为1.3 m,由0.43~0.86 μm范围内的115个波段组成。剔除受噪声影响的12个波段,将剩余的103个波段用于实验。该数据集包含草地、树木、土壤等9类地物。

2) Urban数据集

该数据集是由高光谱数字图像采集仪获取的美国Copperas Cove区域的遥感影像,其像素为307×307,光谱分辨率为10 nm,空间分辨率为4 m。去除受噪声影响的第1~4、第76、第87、第101~111、第136~153、第198~210波段,将剩余的162个波段用于分析研究。该数据集主要包括道路、树木、草地等6类地物。

图 2. Pavia University数据集的遥感影像。(a)假彩色图;(b)真实地物标记图

Fig. 2. Pavia University hyperspectral image. (a) False-color image; (b) ground-truth map

图 3. Urban数据集遥感影像。(a)假彩色图;(b)真实地物标记图

Fig. 3. Urban hyperspectral image. (a) False-color image; (b) ground-truth map

3.2 实验设置

实验时,高光谱数据集被随机划分为训练集和测试集,其中:训练集用来对算法进行训练,得到最佳投影矩阵;测试集用于测试算法的分类精度。采用总体分类精度(OA)、平均分类精度(AA)及Kappa系数三个指标评价算法的分类性能。

为了检验LRFA算法的有效性,选取RAW、PCA、LPP、NPE、LDA、MMC、MFA和LGSFA算法作为对比。其中,RAW表示对原始数据不作任何处理,直接进行分类。为了使各算法达到最优的分类效果,采用交叉验证法得到各算法的参数。其中:LPP和NPE的近邻数设置为9;MFA和LGSFA的类内近邻k设置为9,类间近邻kp为180。LDA算法的嵌入维度设置为c-1,c为地物类别数;其余算法的嵌入维度d为30。采用k近邻分类器(KNN)对提取的低维特征进行分类。

3.3 在Pavia University数据集上的实验结果

为了研究不同的类内近邻数和非同类近邻数对算法分类精度的影响,从Pavia University数据集的每类地物中随机选取70个样本作为训练集,其余样本作为测试集,进行实验。每种条件下重复10次实验,得到算法的平均总体分类精度。类内近邻数的选取范围为k={3,5,…,25},非同类近邻数的选取范围为kp={20,60,…,500}。

在Pavia University数据集上,本文算法在不同参数k和kp下的总体分类精度如

图 4. 在Pavia University数据集上,本文算法在不同参数k和kp下的总体分类精度

Fig. 4. Overall accuracy of LRFA at different parameters (k and kp) in Pavia University dataset

由

为了研究不同的嵌入维度对算法分类结果的影响,依然从该数据集的每类地物中随机选取70个样本用于训练,剩余样本用于测试算法的分类精度。

图 5. 在Pavia University数据集上,各算法在不同嵌入维度下的总体分类精度

Fig. 5. Overall accuracy of each algorithm at different dimensions in Pavia University dataset

为了验证各算法在不同训练样本量下的分类性能,分别从Pavia University数据集的每类地物中随机选取20、40、60、100及200个样本用于训练,剩余的样本用于测试,进行实验。每种条件下重复10次实验,取10次结果的平均值作为最后的分类精度。

表 1. 不同训练样本下各算法在Pavia University数据集上的分类结果

Table 1. Classification results of each algorithm at different training sample sizes in Pavia University dataset

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

从

为了比较算法在每类地物上的分类性能,从Pavia University数据集中随机选取1%的样本用于训练,其余样本用于测试,进行实验。

表 2. 各算法在Pavia University数据集每类地物上的分类性能

Table 2. Classification performance of each algorithm on class samples in Pavia University dataset

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

图 6. 各算法在Pavia University数据集上的地物分类图。(a)真实地物;(b) RAW(OA:78.95%);(c) PCA(OA:78.98%);(d) LPP(OA:80.55%);(e) NPE(OA:80.98%);(f) LDA(OA:76.50%);(g) MMC(OA:75.11%);(h) MFA(OA: 82.62%);(i) LGSFA(OA:78.23%);(j) LRFA(OA:86.07%)

Fig. 6. Classification maps of each algorithm on Pavia University dataset. (a) Ground-truth map; (b) RAW(OA:78.95%); (c) PCA(OA:78.98%); (d) LPP(OA:80.55%); (e) NPE(OA:80.98%); (f) LDA(OA:76.50%); (g) MMC(OA:75.11%); (h) MFA(OA:82.62%); (i) LGSFA(OA:78.23%); (j) LRFA(OA:86.07%)

从

3.4 在Urban数据集上的实验

为了分析不同的类内近邻数和非同类近邻数对算法分类结果的影响,从Urban数据集中的每类地物上随机选取70个样本作为训练集,其余样本作为测试集,进行实验。为了使结果更具说服力,每种条件下的实验重复10次,取10次结果的平均值作为最终的总体分类精度。类内近邻数的选取范围为k={3,5,…,25},非同类近邻数的选取范围为kp={20,60,…,500}。

在Urban数据集上,本文算法在不同参数k和kp下的总体分类精度如

图 7. 本文算法在Urban数据集上不同参数k和kp下的总体分类精度

Fig. 7. Overall accuracy of LRFA at different parameters (k and kp) in Urban dataset

由

为了研究嵌入维度对算法分类精度的影响,从Urban数据集的每类地物中随机选取70个样本作为训练样本,剩余样本作为测试样本,进行实验。

图 8. 在Urban数据集上,各算法在不同嵌入维度下的总体分类精度

Fig. 8. Overall accuracy of LRFA at different dimensions in Urban dataset

为了验证算法在不同样本条件下的分类精度,分别从Urban数据集每类地物中随机选取20、40、60、100及200个样本作为训练集,剩余样本作为测试集,进行实验。为了增加实验结果的有效性,每种条件下重复10次实验,将平均值作为最终的分类结果。

从

为了比较各算法对各类别地物的分类性能,从Urban数据集的每类地物中随机选取1%的样本作为训练集,剩余样本作为测试集,进行实验。

表 3. 不同训练样本量下各算法在Urban数据集上的分类结果

Table 3. Classification results of each algorithm at different training sample sizes in Urban dataset

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

表 4. 各算法在Urban数据集每类地物上的分类性能

Table 4. Classification results of each algorithm on class samples in Urban dataset

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

图 9. 各算法在Urban数据集上的地物分类图。(a)真实地物;(b)RAW(OA:80.86%);(c) PCA(OA:80.79%);(d) LPP(OA:80.66%);(e) NPE(OA:81.89%);(f) LDA(OA:82.60%);(g) MMC(OA:81.40%);(h) MFA(OA:82.32%); (i) LGSFA(OA:82.50%);(j) LRFA(OA:83.77%)

Fig. 9. Classification maps of each algorithm on Urban dataset. (a) Ground-truth image; (b) RAW(OA:80.86%); (c) PCA(OA:80.79%); (d) LPP(OA:80.66%); (e) NPE(OA:81.89%); (f) LDA(OA:82.60%); (g) MMC(OA: 81.40%); (h) MFA(OA:82.32%); (i) LGSFA(OA:82.50%); (j) LRFA(OA:83.77%)

从

3.5 二维嵌入分析

二维嵌入一般是指在利用算法对高维数据进行特征提取时,将要提取的嵌入特征维度设置为二维,得到样本的二维嵌入特征的过程。二维嵌入是为了便于观察算法得到的嵌入特征在空间的分布状态,即嵌入特征的聚集性和离散性,为算法的性能评价提供过程展示。

为了验证各算法得到的低维特征判别性的强弱,从Pavia University数据集中选取asphalt、soil和shadows这三类地物进行二维嵌入。每类地物中随机选取100个样本进行训练,剩余样本用于测试,得到测试样本的二维嵌入特征,最后绘制出二维空间中特征点的分布情况。

图 10. 各算法在Pavia University数据集上的二维嵌入特征分布。(a) PCA;(b) LPP;(c) NPE;(d) LDA;(e) MMC;(f) MFA;(g) LGSFA;(h) LRFA

Fig. 10. Two-dimensional embedding distribution of each algorithm on Pavia University dataset. (a) PCA; (b) LPP; (c) NPE; (d) LDA; (e) MMC; (f) MFA; (g) LGSFA; (h) LRFA

由

4 结论

本文提出了一种局部重构Fisher分析方法,并将该方法用于高光谱图像的地物分类。该方法使用高维空间中样本点的类内近邻样本重构原始样本,然后利用重构点构建本征图和惩罚图,使得样本在低维特征空间中也能够保持其在高维空间中的流形结构,同时同类样本间更为紧凑,不同类别的样本更为离散,增加了低维特征的判别性,得到了良好的分类性能。与LGSFA方法相比,本文方法不仅能保持嵌入在高维空间中的流形的整体结构,提高分类精度,而且构图方式简单,运行时间明显减少。在Pavia University和Urban数据集上的实验表明,与其他流形学习方法相比,LRFA对高光谱图像的分类效果更好。在Pavia University和Urban数据集中随机选取1%的训练样本进行实验,实验结果表明,LRFA的总体分类精度相比LGSFA分别提升了7.84个百分点和1.27个百分点,运行时间分别减少了0.176 s和0.265 s,更具有实用价值。

[1] 朱梦远, 杨红兵, 李志伟. 高光谱图像和叶绿素含量的水稻纹枯病早期检测识别[J]. 光谱学与光谱分析, 2019, 39(6): 1898-1904.

[2] 王晓飞, 张钧萍, 阎秋静, 等. 基于支持向量数据描述的高光谱图像目标检测[J]. 中国激光, 2014, 41(增刊1): s114003.

Wang X F, Zhang J P, Yan Q J, et al. Target detection for hyperspectral image based on support vector data description[J]. Chinese Journal of Lasers, 2014, 41(s1): s114003.

[3] 刘立新, 李梦珠, 赵志刚, 等. 高光谱成像技术在生物医学中的应用进展[J]. 中国激光, 2018, 45(2): 0207017.

[4] Huang H, Shi G Y, He H B, et al. Dimensionality reduction of hyperspectral imagery based on spatial-spectral manifold learning[J]. IEEE Transactions on Cybernetics, 2020, 50(6): 2604-2616.

[5] Li X Y, Zhang L F, You J. Locally weighted discriminant analysis for hyperspectral image classification[J]. Remote Sensing, 2019, 11(2): 109.

[6] Huang H, Duan Y L, He H B, et al. Spatial-spectral local discriminant projection for dimensionality reduction of hyperspectral image[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2019, 156: 77-93.

[7] Luo F L, Du B, Zhang L P, et al. Feature learning using spatial-spectral hypergraph discriminant analysis for hyperspectral image[J]. IEEE Transactions on Cybernetics, 2019, 49(7): 2406-2419.

[8] Luo FL, Zhang LP, DuB, et al. Discriminant spatial-spectral hypergraph learning for hyperspectral image classification[C]∥IGARSS 2018 - 2018 IEEE International Geoscience and Remote Sensing Symposium, July 22-27, 2018. Valencia. New York: IEEE, 2018: 8480- 8483.

[9] Xu Y H, Zhang L P, Du B, et al. Spectral-spatial unified networks for hyperspectral image classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(10): 5893-5909.

[10] Arsa D MS, Sanabila HR, Rachmadi MF, et al. Improving principal component analysis performance for reducing spectral dimension in hyperspectral image classification[C]∥2018 International Workshop on Big Data and Information Security (IWBIS), May 12-13, 2018. Jakarta. New York: IEEE, 2018: 123- 128.

[11] Wen J, Fang X Z, Cui J R, et al. Robust sparse linear discriminant analysis[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2019, 29(2): 390-403.

[12] Li H, Jiang T, Zhang K. Efficient and robust feature extraction by maximum margin criterion[J]. IEEE Transactions on Neural Networks, 2006, 17(1): 157-165.

[13] Shao Z F, Zhang L. Sparse dimensionality reduction of hyperspectral image based on semi-supervised local Fisher discriminant analysis[J]. International Journal of Applied Earth Observation and Geoinformation, 2014, 31: 122-129.

[14] Fan MY, QiaoH, ZhangB, et al. Isometric multi-manifold learning for feature extraction[C]∥2012 IEEE 12th International Conference on Data Mining, December 10-13, 2012. Brussels, Belgium. New York: IEEE, 2012: 241- 250.

[15] Roweis S T. Nonlinear dimensionality reduction by locally linear embedding[J]. Science, 2000, 290(5500): 2323-2326.

[16] He XF, CaiD, Yan SC, et al. Neighborhood preserving embedding[C]∥Tenth IEEE International Conference on Computer Vision (ICCV'05) Volume 1, October 17-21, 2005. Beijing, China. New York: IEEE, 2005: 1208- 1213.

[17] Belkin M, Niyogi P. Laplacian eigenmaps for dimensionality reduction and data representation[J]. Neural Computation, 2003, 15(6): 1373-1396.

[18] He XF, NiyogiP. Locality preserving projections[C]∥17th Annual Conference on Neural Information Processing Systems (NIPS), Dec. 08, 2003, Canada. Massachusetts: NIPS, 2004: 153- 160.

[19] Yan S C, Xu D, Zhang B, et al. Graph embedding and extensions: a general framework for dimensionality reduction[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2007, 29(1): 40-51.

[20] Luo F L, Huang H, Duan Y L, et al. Local geometric structure feature for dimensionality reduction of hyperspectral imagery[J]. Remote Sensing, 2017, 9(8): 790.

Article Outline

刘嘉敏, 杨松, 黄鸿. 基于局部重构Fisher分析的高光谱遥感影像分类[J]. 中国激光, 2020, 47(7): 0710001. Liu Jiamin, Yang Song, Huang Hong. Hyperspectral Remote Sensing Image Classification Based on Local Reconstruction Fisher Analysis[J]. Chinese Journal of Lasers, 2020, 47(7): 0710001.