基于多幅图像的陶瓷碗表面缺陷的局部点云重建  下载: 1111次

下载: 1111次

1 引言

基于Kirsch和Canny算子的陶瓷碗表面缺陷的检测方法可以实现表面缺陷的提取[1]。为获知该缺陷的位置、方向及形状等三维空间信息,本文采用基于多幅图像的局部点云重建方法。

目前国际上较为成熟的三维重建系统主要有:Faugeras等[2]提出的利用经典的分层重建、自标定方法直接从图像序列中重建建筑物的三维重建系统;比利时的Pollefeys等[3]开发的物体三维表面自动生成系统,利用了可变参数下的摄像机自标定技术;英国剑桥大学计算机视觉研究组的Cipolla等[4]开发的PhotoBuilder三维重建系统。在国内,目前研究的三维重建系统大致可分为两类:一类是利用激光扫描仪、结构光、深度扫描仪等精密的硬件设备,直接获取物体表面点的三维坐标信息及RGB颜色信息;另一类是通过摄像机成像模型,从二维图像中计算出物体的三维结构。第一类方法是直接对三维物体的空间信息进行处理,精度高,但涉及硬件设备多,操作复杂,成本高,不适合进行研究。第二类方法成本低,操作简单,过程中易提出新的算法对其进行改进,适合研究。因此,本文对第二类方法进行讨论。

2 双目摄像机标定

摄像机标定是三维重建的关键环节。目前,摄像机标定方法有传统的摄像机标定法、自标定法及基于主动视觉的标定法等[5-7]。综合考虑各因素,采用介于传统的摄像机标定和自标定之间的张正友标定法,该方法主要针对存在径向畸变的情况求解摄像机内外参数的标定,具有较强的稳健性和较高的精度。由于摄像机参数精度高低直接影响重建效果好坏,因此采用遗传算法对其进行优化,提高标定参数的准确度。

式中(

表 1. 张正友标定法和遗传算法优化后参数的三维坐标计算结果

Table 1. Calculations of three-dimensional coordinates optimized by Zhang’s calibration and genetic algorithm

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

3 图像特征点提取及匹配

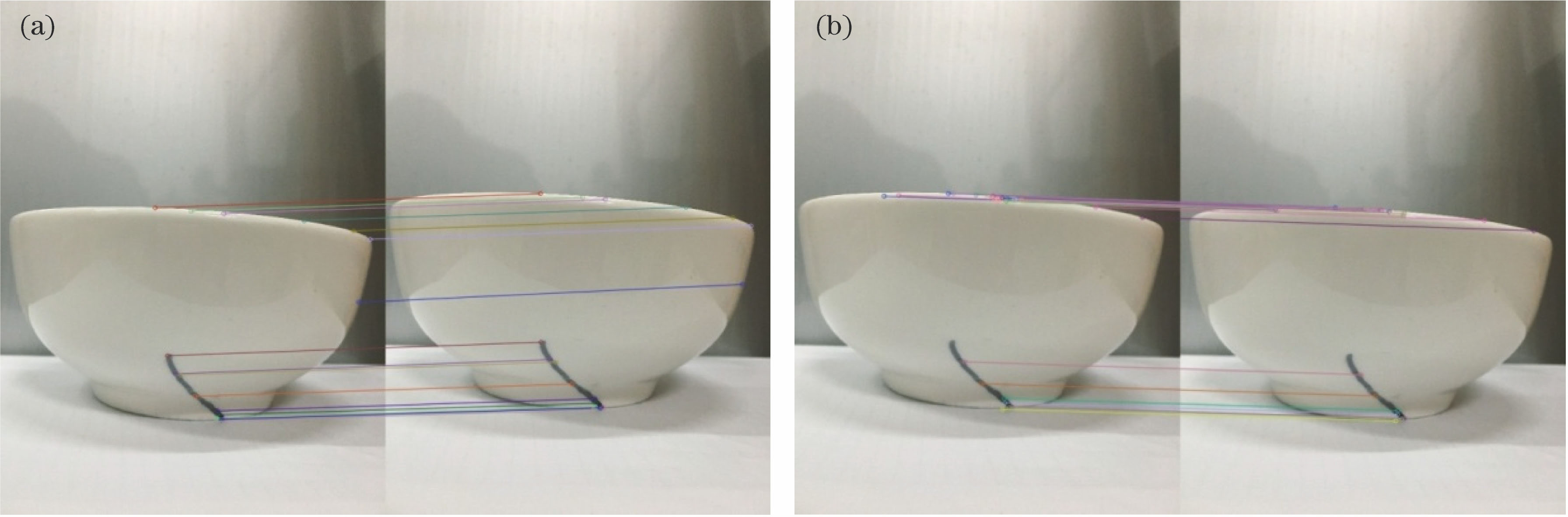

图像特征点提取及匹配是重建技术的重要部分。基于速度及精度的要求,将FAST(Features From Accelerated Segment Test)角点检测算法、加速稳健特征(SURF)点描述子及FLANN(Fast Library for Approximate Nearest Neighbors )匹配算子相结合完成特征点的提取及匹配。FAST算法[8-9]是一种快速、有效的特征点检测算法,与尺度不变特征变换(SIFT)、SURF特征检测算法相比,该算法速度快、细节点多、精度高。SURF算子[10-11]首先确定特征点主方向,然后生成特征点描述符,速度快、准确度高、计算简单。FLANN可实现一系列的查找算法[12],且具备自动选择最快算法的功能,但其单向的匹配准确度不理想,为提高其准确度,采用双向匹配代替单向匹配。

FAST+SURF+FLANN双向匹配效果如

图 1. 基于FAST+SURF+FLANN的双向匹配效果图。(a)图像I1到图像I2匹配效果图;(b)图像I2到图像I1匹配效果图

Fig. 1. Bidirectional matching results based on FAST+SURF+FLANN. (a) Matching result from I1 to I2; (b) matching result from I2 to I1

4 点云重建

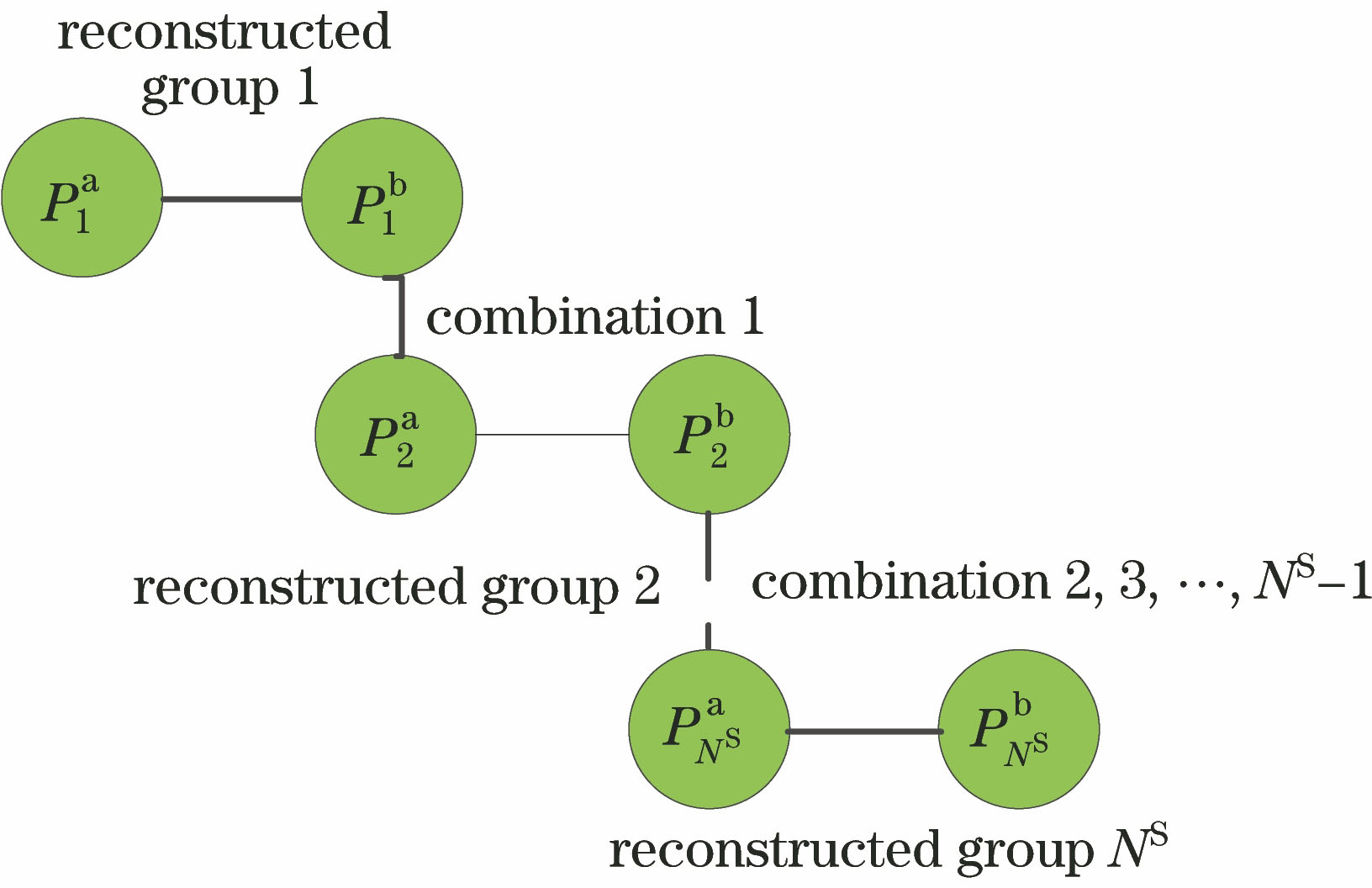

4.1 基于运动恢复结构(SFM)算法的稀疏点云重建

SFM是一种从图像中恢复三维模型的算法[13-14]。该算法是从不同角度观察三维世界中的同一个点,通过相机标定计算得到投影矩阵,从而恢复点的三维坐标。该算法由三角定位、迭代计算、集束调整[15-16]3个步骤完成。

三角定位的目的是通过投影关系从图像匹配中恢复出匹配点的三维信息点。利用图像特征点匹配法得到基础矩阵

对

式中对角矩阵

将第一个摄像机坐标系作为世界坐标系,则左右摄像机的投影矩阵为

式中

同理,投影矩阵

联立(5)式和(6)式,可得

令

根据下式得到最优化的

式中

4.2 基于面片的多视角立体(PMVS)重建算法的稠密点云重建

稀疏点云不能很好地描述物体表面三维信息,需将稀疏点云扩展为稠密点云。PMVS算法是常用的稠密点云重建方法[17],该方法主要针对已标定的多幅视图,通常仅需估计点的深度和法向。PMVS算法准确、简单、高效,能自动检测并忽略外部点及障碍点,最后输出带方向的小矩形面片集合。该算法的最大优势是对纹理覆盖不足、凹陷和高曲率区域有较好的重建效果,因此为实验的首选。PMVS算法由建立面片模型、定义光度差异函数、重建面片3步完成,其中光度差异函数的定义是核心。

光度差异函数为

式中

式中

式中

5 实验结果与分析

选用C-STYLE CCD双目摄像头,像素为640 pixel×480 pixel,焦距为2.8~12 mm,接口为CS。为提高重建速度,在VS2010+OpenCV2.4.8+PCL1.7.0环境下开发软件。

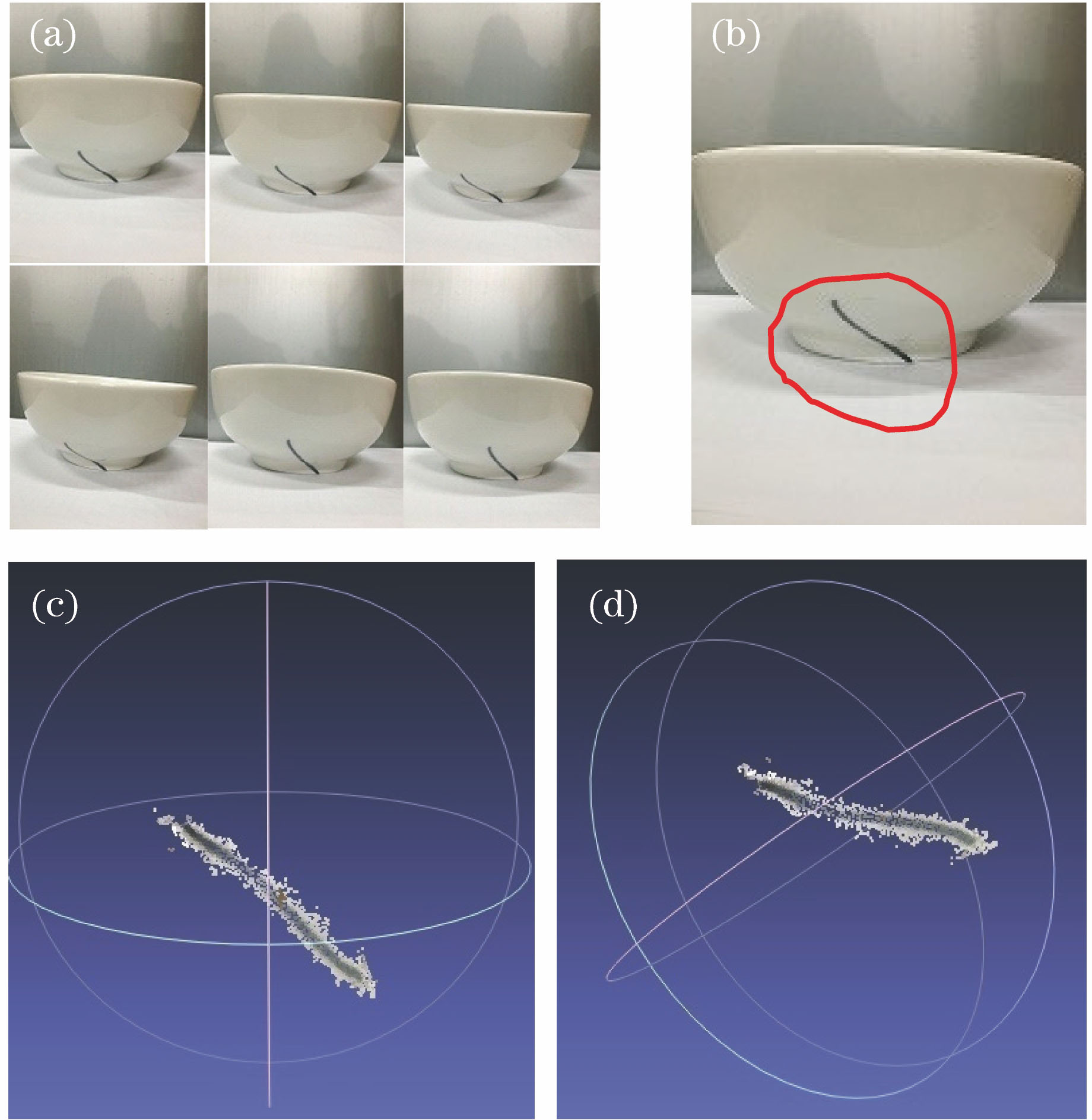

图 3. 局部点云重建效果图。(a)原图;(b)表面缺陷标注;(c)缺陷正面图;(d)缺陷侧面图

Fig. 3. Reconstruction images of local point cloud. (a) Original images; (b) surface defect marking; (c) front image of defect; (d) side image of defect

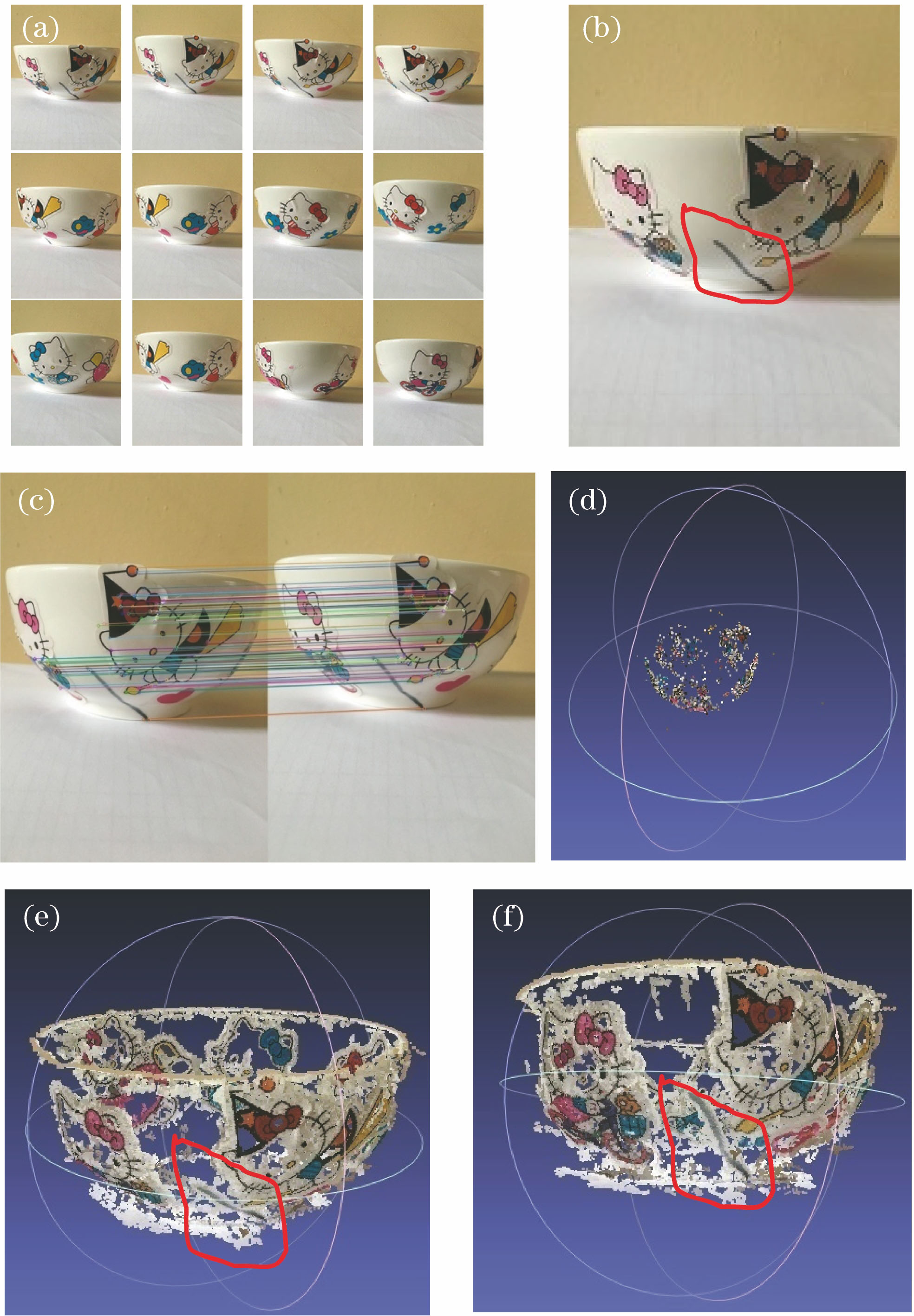

为得到缺陷位置和方向信息,进一步采用手工贴图增加特征点的方法,实现物体表面的全局重建,得到陶瓷碗表面缺陷重建效果如

图 4. 陶瓷碗表面缺陷重建效果图。(a)原图;(b)表面缺陷标注;(c)双向匹配效果图;(d)SFM稀疏点云重建结果;(e)PMVS稠密点云正面重建结果;(f)PMVS稠密点云侧面重建结果

Fig. 4. Images of complete reconstruction of defect on ceramic bowl surface. (a) Original images; (b) surface defect marking; (c) bidirectional matching effect image; (d) sparse point cloud reconstruction based on SFM; (e) dense point cloud reconstruction of front image based on PMVS; (f) dense point cloud reconstruction of side image based on PMVS

6 结论

提出了一种陶瓷碗表面缺陷的三维重建新方法。该方法首先将张正友标定和遗传算法相结合求解摄像机内外参数,然后采用FAST+SURF+FLANN算法完成图像双向匹配,最后采用SFM稀疏点云重建算法和PMVS稠密点云重建算法实现缺陷局部点云重建。实验结果表明,该算法效果理想,重建结果所得划痕完整清晰。针对不连续区域的重建,在后续的研究中可通过提高摄像机精度、增加点云的方法进行处理。

[1] 郭萌, 胡辽林, 赵江涛. 基于Kirsch和Canny算子的陶瓷碗表面缺陷检测方法[J]. 光学学报, 2016, 36(9): 0904001.

郭萌, 胡辽林, 赵江涛. 基于Kirsch和Canny算子的陶瓷碗表面缺陷检测方法[J]. 光学学报, 2016, 36(9): 0904001.

[2] Faugeras OD, Luong QT, Maybank SJ. Camera self-calibration: theory and experiments[C]. European Conference on Computer Vision, 1992: 321- 334.

Faugeras OD, Luong QT, Maybank SJ. Camera self-calibration: theory and experiments[C]. European Conference on Computer Vision, 1992: 321- 334.

[4] CipollaR, RobertsonD, BoyerE. PhotoBuilder-3D models of architectural scenes from uncalibrated images[C]. IEEE International Conference on Multimedia Computing and Systems, 1999, 2: 9025.

CipollaR, RobertsonD, BoyerE. PhotoBuilder-3D models of architectural scenes from uncalibrated images[C]. IEEE International Conference on Multimedia Computing and Systems, 1999, 2: 9025.

[5] 黄风山, 钱惠芬. 三坐标测量机驱动的摄像机标定技术[J]. 光学精密工程, 2010, 18(4): 952-957.

黄风山, 钱惠芬. 三坐标测量机驱动的摄像机标定技术[J]. 光学精密工程, 2010, 18(4): 952-957.

[6] 蔡健荣, 赵杰文. 双目立体视觉系统摄像机标定[J]. 江苏大学学报(自然科学版), 2006, 27(1): 6-9.

蔡健荣, 赵杰文. 双目立体视觉系统摄像机标定[J]. 江苏大学学报(自然科学版), 2006, 27(1): 6-9.

Cai Jianrong, Zhao Jiewen. Stereovision system calibration based on dual-camera[J]. Journal of Jiangsu University (Natural Science Edition), 2006, 27(1): 6-9.

[7] 刘书桂, 陈超. 基于改进遗传算法的三坐标测量机光学测头的标定[J]. 天津大学学报, 2005, 38(8): 695-700.

刘书桂, 陈超. 基于改进遗传算法的三坐标测量机光学测头的标定[J]. 天津大学学报, 2005, 38(8): 695-700.

Liu Shugui, Chen Chao. Calibration of CMM optical probe based on improved genetic algorithm[J]. Journal of Tianjin University, 2005, 38(8): 695-700.

[8] 燕鹏, 安如. 基于FAST改进的快速角点探测算法[J]. 红外与激光工程, 2009, 38(6): 1104-1115.

燕鹏, 安如. 基于FAST改进的快速角点探测算法[J]. 红外与激光工程, 2009, 38(6): 1104-1115.

Yan Peng, An Ru. Improved fast corner detection algorithm based on FAST[J]. Infrared and Laser Engineering, 2009, 38(6): 1104-1115.

[9] 王蒙, 戴亚平. 基于FAST角点检测的局部鲁棒特征[J]. 北京理工大学学报, 2013, 33(10): 1045-1054.

王蒙, 戴亚平. 基于FAST角点检测的局部鲁棒特征[J]. 北京理工大学学报, 2013, 33(10): 1045-1054.

Wang Meng, Dai Yaping. Local robust feature based on FAST corner detection[J]. Transactions of Beijing Institute of Technology, 2013, 33(10): 1045-1054.

[10] 张华俊, 李桂华, 刘程, 等. 基于SURF特征匹配的数字图像相关变形初值可靠估计[J]. 光学学报, 2013, 33(11): 1112005.

张华俊, 李桂华, 刘程, 等. 基于SURF特征匹配的数字图像相关变形初值可靠估计[J]. 光学学报, 2013, 33(11): 1112005.

[11] 朱奇光, 王佳, 张朋珍, 等. 基于高斯矩改进SURF算法的移动机器人定位研究[J]. 仪器仪表学报, 2015, 36(11): 2451-2457.

朱奇光, 王佳, 张朋珍, 等. 基于高斯矩改进SURF算法的移动机器人定位研究[J]. 仪器仪表学报, 2015, 36(11): 2451-2457.

Zhu Qiguang, Wang Jia, Zhang Pengzhen, et al. Research on mobile robot localization based on Gaussian moment improved SURF algorithm[J]. Chinese Journal of Scientific Instrument, 2015, 36(11): 2451-2457.

[12] 冯亦东, 孙跃. 基于SURF特征提取和FLANN 搜索的图像匹配算法[J]. 图学学报, 2015, 36(4): 650-657.

冯亦东, 孙跃. 基于SURF特征提取和FLANN 搜索的图像匹配算法[J]. 图学学报, 2015, 36(4): 650-657.

Feng Yidong, Sun Yue. Image matching algorithm based on SURF feature extraction and FLANN search[J]. Journal of Graphics, 2015, 36(4): 650-657.

[13] 缪君, 储珺, 张桂梅, 等. 基于稀疏点云的多平面场景稠密重建[J]. 自动化学报, 2015, 41(4): 813-820.

缪君, 储珺, 张桂梅, 等. 基于稀疏点云的多平面场景稠密重建[J]. 自动化学报, 2015, 41(4): 813-820.

Miao Jun, Chu Jun, Zhang Guimei, et al. Dense multi-planar scene reconstruction from sparse point cloud[J]. Acta Automatica Sinica, 2015, 41(4): 813-820.

[14] 陈辉, 马世伟, Andreas Nuechter. 基于激光扫描和SFM的非同步点云三维重构方法[J]. 仪器仪表学报, 2016, 37(5): 1148-1156.

陈辉, 马世伟, Andreas Nuechter. 基于激光扫描和SFM的非同步点云三维重构方法[J]. 仪器仪表学报, 2016, 37(5): 1148-1156.

Chen Hui, Ma Shiwei, Andreas Nuechter. Non-synchronous point cloud algorithm for 3D reconstruction based on laser scanning and SFM[J]. Chinese Journal of Scientific Instrument, 2016, 37(5): 1148-1156.

[15] Furukawa Y, Ponce J. Accurate, dense, and robust multiview stereopsis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2010, 32(8): 1362-1376.

Furukawa Y, Ponce J. Accurate, dense, and robust multiview stereopsis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2010, 32(8): 1362-1376.

[16] 张剑. 融合SFM和动态纹理映射的视频流三维表情重建[J]. 计算机辅助设计与图形学学报, 2010, 22(6): 949-957.

张剑. 融合SFM和动态纹理映射的视频流三维表情重建[J]. 计算机辅助设计与图形学学报, 2010, 22(6): 949-957.

Zhang Jian. 3D facial expression reconstruction from video via SFM and dynamic texture mapping[J]. Journal of Computer-Aided Design & Computer Graphics, 2010, 22(6): 949-957.

[17] 史利民, 郭复胜, 胡占义. 利用空间几何信息的改进PMVS算法[J]. 自动化学报, 2011, 37(5): 560-568.

史利民, 郭复胜, 胡占义. 利用空间几何信息的改进PMVS算法[J]. 自动化学报, 2011, 37(5): 560-568.

Shi Limin, Guo Fusheng, Hu Zhanyi. An improved PMVS through scene geometric information[J]. Acta Automatica Sinica, 2011, 37(5): 560-568.

Article Outline

郭萌, 胡辽林, 李捷. 基于多幅图像的陶瓷碗表面缺陷的局部点云重建[J]. 光学学报, 2017, 37(12): 1215002. Meng Guo, Liaolin Hu, Jie Li. Local Point Cloud Reconstruction of Ceramic-Bowl-Surface Defect Based on Multi-Image Sequences[J]. Acta Optica Sinica, 2017, 37(12): 1215002.