PFWG改进的CNN多光谱遥感图像分类  下载: 1186次

下载: 1186次

1 引言

遥感图像分类本质是通过不同地物类型的电磁波辐射差异来判别地物的基本属性,进而使用模式识别的方法来进行属性特征分类。遥感图像分类是根据分类方法在遥感空间划分出不同类型的特征区域,并确定待分类的像素落入特征类型地物的相应区域。实质上,该过程是将图像中的每个区域或像素点分类为多个特征因素中的一种,或者是若干个特征之一,从而完成图像数据从遥感空间到目标模式空间的转换[1]。

如何对内容丰富的遥感图像进行准确的分类提取一直是遥感图像分类的研究热点。王振武等[2]客观地分析了关于基于支持向量机的遥感图像分类方法的优劣,从侧面对比说明了每类方法的适用场景,极大地推广了分类方法的应用,具有较好的泛化能力;Banerjee等[3]提出了基于模糊聚类的遥感图像无监督分类方法,能够较为准确地提取到图像的有效特征,但在处理包含大量地物信息的多光谱遥感图像时,时耗较长,无法做到高效识别提取;卜晓波等[4]通过遗传算法改进反向传播(BP)神经网络,一定程度克服了网络缺陷,提高了运行速率,但在处理纹理特征时,分类精度不高;赵爽等[5]总结了常用分类方法在处理遥感图像上的优缺点,对比BP神经网络和支持向量机,验证了卷积神经网络(CNN)在分类精度和运算速率等方面对遥感图像进行分类所具备的优势,但由于网络性质的局限性,分类线条不够细腻,表达效果不理想。

本文将直觉模糊集作为神经网络的预处理单元与卷积神经网络进行结合,通过图片模糊加权平均(PFWG)算子优先对样本特征进行了整合,进而避免了CNN对局部特征处理不够细腻的缺点,增强了算法的泛化能力,提高了分类精度。文中给出了陕西汉中地区遥感图像分类的实验结果,相较先前的算法取得了较好的分类效果。

2 卷积神经网络

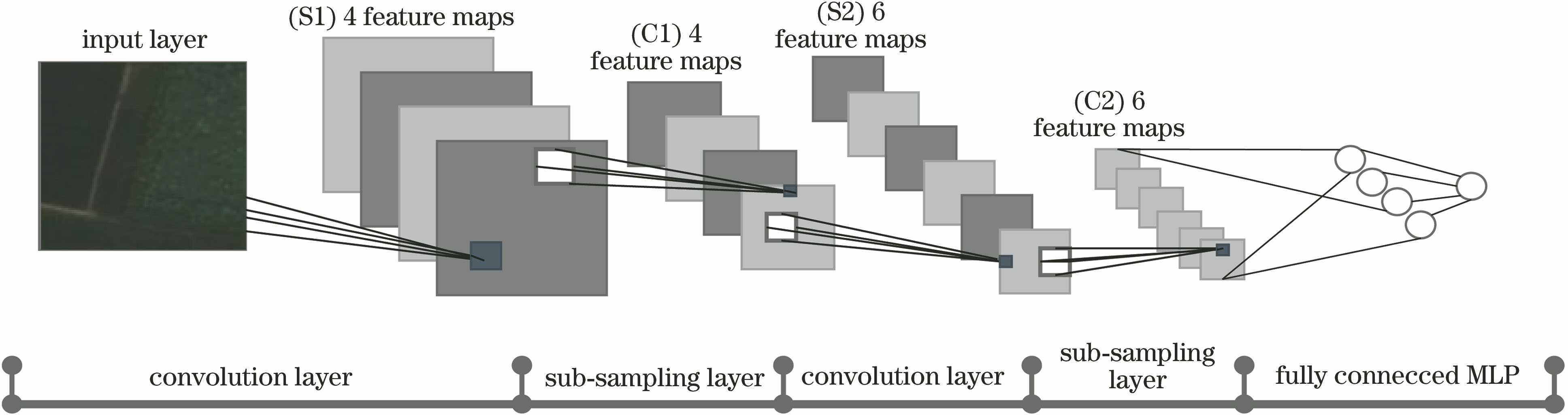

CNN作为深度学习中的典型模型,是具有多层结构的学习算法。CNN是对BP神经网络的一种改进,采用前向传播计算输出值,反向传播调整权重和偏置,包含由卷积层和池化层构成的特征抽取器[6],如

CNN主要通过分类算法来实现,训练算法的目的是在前向传播阶段完成对输入遥感图像信息属性特征的分类采集和提取,在后向传播阶段利用反馈网络完成误差更新[7]。

CNN训练算法分为前向传播和后向传播两个阶段完成。前向传播阶段:

1) 选取样本(

2) 输出对应的实际值

前向传播阶段是实现信号在不同网络层级的传输,训练过程完成输入样本信息在网络中的逐级变换,最终得到样本对应的实际值,公式为

后向根据输出信号与真实值的误差来进行反馈更新,根据计算出的误差值逐层地改变相应各层网络的相应权值,通过调整权值偏置量来进行误差更新[8]。

每个训练样本(

其主要是通过梯度下降不断减小

权值和偏置的变化量为

CNN使用空间关系来减少需要学习的参数数量,在训练结束后,得到较为稳定的网络结构分类器。训练过程无需重复初始化,具有一定记忆能力。

CNN模型较好地满足了最小化数据的预处理要求,图像的局部信息能够在网络结构中通过特征分类器提取,做到快速筛选,通过图像的局部感受区域允许处理单访问传入的基础特征,极大地简化了神经网络的网络结构,具有更好的泛化能力及适应性[9]。CNN模型也存在很大改进空间,网络层数、卷积核数量与大小都对网络模型的训练过程和分类识别效果有较大影响,同时卷积层中的特征还包含丰富的信息,例如局部描述信息等,在遥感图像分类中很少对此类信息进行有效分析,本文通过引入含PFWG算子的模糊几何聚类算法,实现了CNN对特征信息以及地物属性的优化,体现了较好的分类效果。

3 模糊几何聚类算法

3.1 直觉模糊集

假设一个集合

式中0≤

隶属度和非隶属度的构建是直觉模糊图像处理过程中的关键环节,本文将隶属度函数的构建方法作为一个优化问题,同时设计犹豫度函数,通过最大信息熵来确定参数并构建直觉模糊集[10]。为此本文构建直觉模糊图像作为地物类型的样本。

把大小为

式中

式中

直觉模糊处理后可分别得到相关隶属度图像、非隶属度图像和犹豫度图像,本次实验选择隶属度图像作为实验地物遥感样本进行后续处理。

3.2 基于模糊几何聚类的多重决策方法

设

式中

这里的权值代表的是图像属性的权重,相对于对偶犹豫模糊集下提出的加权几何算子或混合几何算子[12],PFWG算子通过平均的思想建立了属性值之间的联系,在体现个体属性差别的同时反映权值的隶属度强弱,体现了其在实际中对不同互联、重叠区域进行处理的优越性。

通过引入Picture模糊几何聚集算子进而提出基于特征值为模糊数的多属性决策方法改进CNN。根据模糊几何聚集算子的相似性质进行细化分析,假设

评估矩阵

式中

若

式中

最后计算得到样本的总权值

本次实验通过Picture模糊数来反映样本信息,利用模糊几何聚类算法控制CNN的输入层权重,通过直觉模糊集与最大熵特性细化输入CNN网络层样本信息,保证样本完整性的同时通过PFWG算子控制特征梯度,使Picture模糊集可以挖掘出更多的实验区信息,弥补了CNN分类不够细腻的缺点。

4 实验结果分析

4.1 研究区概况

实验选用的图像数据为汉中市2017年的城市遥感图像,该图像由运8-C和运8试飞微软UCXP拍摄,图像分辨率为40 cm,所获得遥感图像的比例尺为1∶5000,图像的波段范围为380~780 nm。研究区影像如

图 2. 研究区影像。(a)研究区1;(b)研究区2

Fig. 2. Research area image. (a) Study area 1; (b) study area 2

4.2 遥感图像预处理

本文以ENVI软件为平台,在个人PC下Matlab R2014a操作完成。操作系统为Window 8, CPU为InterCORE i5,内存为4 GB。

实验通过辐射校正,最小噪声分离(MNF)[14]等方法对陕西汉中市土地调查下发的遥感影像进行预处理,放大了实验样本的属性特征,细化了图像的纹理轮廓,相对缩小了训练区范围,有助于进一步提高分类模型对遥感图像的解译能力。

实验首先对实验区进辐射校正,以研究区1为实验样本。辐射校正的目的是消除环境因素的影响,通过对实验区波段进行处理,得到较为均衡的地表反射数据,进而减小实验误差。本次实验采用跨轨道光照法和内部相对平均(IAR)反射率校正结合的方式[15],实验结果如

在得到校正结果后,对图像进行MNF,MNF是通过两次层叠的主成分变换克服噪声对影像质量的影响。1) 通过高斯滤波模块对影像数据块进行滤波处理,得到噪音协方差矩阵,用于分离和调节特征中可能含有的噪声;2) 对噪声数据进行标准的主成分分析变换,通过在噪声中引入单位方差可以做到对白噪声部分的有效分离,波段间的不相关性使MNF较主成分分析法(PCA)等更加优越[16]。对实验区进行MNF变换的结果如

遥感图像成像需要信号在远距离传输过程中保证地表辐射值真实可靠,但地表辐射信号在信息传递过程中会有一定程度的削弱,辐射信号在环境因素的干扰下在被遥感器接收时会存在实验误差。预处理操作的目的是为了降低噪声干扰,减少误差,保证真实地物信息的有效传递[17]。

4.3 分类结果

本次实验区域属于城市地区,以城市建筑群、裸地、水体及绿地为主要研究目标。道路在实验区所占像素比例较低,不利于提取,因此a作为干扰因素在本次实验中不列为被识别的地物类型。本次实验区的地物类型及其影像特征如

表 1. 实验区土地覆盖类型及特征解译

Table 1. Land cover classification system and interpretation marks in the study area

|

表 2. BP神经网络分类结果混淆矩阵

Table 2. BP neural network classification result confusion matrix%

|

混淆矩阵在此用于表示被分为某一地物类型的像元数量与地面检测为该地物类型数量的比例矩阵[18]。混淆矩阵为一种特定的可视化效果,反映算法性能,矩阵中的列代表地物类型的实际分类,数值等于被正确实现分类的实际像元的数量。

表 3. CNN分类结果混淆矩阵

Table 3. CNN classification result confusion matrix%

|

表 4. PFWG改进CNN分类结果混淆矩阵

Table 4. PFWG improved CNN classification result confusion matrix%

|

图 10. 分类结果对比图。 (a) BP神经网络分类结果;(b) CNN分类结果;(c) PFWG改进的CNN分类结果

Fig. 10. Classification result comparison graph. (a) BP neural network classification result; (b) CNN classification result; (c) PFWG improved CNN classification result

4.4 精度评价

总体分类精度是一种常用的分类精度评价指标[19],其值为被正确分类的像元总和除以实验区总像元数。混淆矩阵中的对角线数值即为被正确分类的像元总数,总像元数等于真实实验区的像元总数。

Kappa系数也是一种较为成熟的遥感分类精度评价方法[20],定义为

式中

分类最终结果如

结果表明,利用PFWG改进的CNN的分类结果精度较高,模糊几何算子对样本特征进行梯度优化,使CNN在处理大量样本局部特征时用时较短,并且得到较为细腻的遥感纹理轮廓信息,直觉模糊集通过构建隶属度函数图像保证了实验样本信息的完整性,一定程度上节约了分类用时,使改进算法能够高效地完成多光谱遥感图像的分类任务。

表 5. 分类精度评价矩阵

Table 5. Classification accuracy evaluation matrix

|

5 结论

通过模糊几何聚类算法对CNN进行改进,降低了分类过程中环境因素的影响,直觉模糊集对样本特征优化能更全面地把握地物信息,保证局部信息的完整性,同时PFWG算法加强了地物样本的物理特性,弥补了CNN的不足,兼具良好的抗噪能力,有效地保障了分类精度。实验结果表明,PFWG改进的CNN可以大幅缩短多光谱遥感图像的训练时长,其中所有的参数信息在迭代更新的过程中使损失函数降到最小,从而实现总体分类精度的提高,做到精确提取地物特征信息,模糊集处理降低了算法的运行复杂度,缩短了提取用时,具有较高的使用价值。

[1] 邹瑞雪. 基于多特征的面向对象高分辨率遥感图像分类[D]. 成都: 电子科技大学, 2017: 17- 25.

Zou RX. Object-oriented high spatial resolution remote sensing image classification using multi-feature[D]. Chengdu: University of Electronic Science and Technology of China, 2017: 17- 25.

[2] 王振武, 孙佳骏, 于忠义, 等. 基于支持向量机的遥感图像分类研究综述[J]. 计算机科学, 2016, 43(9): 11-17, 31.

[3] BanerjeeB, Krishna Moohan B. A novel graph based fuzzy clustering technique for unsupervised classification of remote sensing images[J]. ISPRS Annals of Photogrammetry, RemoteSensing and Spatial InformationSciences, 2014, II-8: 165- 170.

[4] 卜晓波, 龚珍, 黎华. 基于遗传算法改进BP神经网络的遥感影像分类研究[J]. 安徽农业科学, 2013, 41(33): 13056-13058, 13079.

[5] 赵爽. 基于卷积神经网络的遥感图像分类方法研究[D]. 北京: 中国地质大学, 2015: 14- 27.

ZhaoS. Remote sensing image classification method based on convolutional neural networks[D]. Beijing: China University of Geosciences, 2015: 14- 27.

[6] 付秀丽, 黎玲萍, 毛克彪, 等. 基于卷积神经网络模型的遥感图像分类[J]. 高技术通讯, 2017( 3): 203- 212.

Fu XL, Li LP, Mao KB, et al. Remote sensing image classification based on CNN model[J]. Chinese High Technology Letters, 2017( 3): 203- 212.

[7] 刘大伟, 韩玲, 韩晓勇. 基于深度学习的高分辨率遥感影像分类研究[J]. 光学学报, 2016, 36(4): 0428001.

[9] 王孟文. 遥感图像识别分类技术研究[D]. 北京: 北京邮电大学, 2017: 11- 14.

Wang MW. Image recognition by multiple classifer[D]. Beijing: Beijing University of Posts and Telecommunications, 2017: 11- 14.

[10] 王春勇. 犹豫模糊集和Picture模糊集理论与应用研究[D]. 长沙: 湖南大学, 2015: 15- 24.

Wang CY. Hesitant fuzzy set and picture fuzzy set with their application research[D]. Changsha: Hunan University, 2015: 15- 24.

[11] Torra V. Hesitant fuzzy sets[J]. International Journal of Intelligent Systems, 2010, 25(6): 529-539.

[12] SinghP. Correlation coefficients for picture fuzzy sets[J]. Journal of Intelligent & Fuzzy Systems: Applications in Engineering and Technology, 2015( 2): 591- 604.

[13] 吴正文. 卷积神经网络在图像分类中的应用研究[D]. 成都: 电子科技大学, 2015: 12- 15.

Wu ZW. Application research of convolution neural network in image classification[D]. Chengdu: University of Electronic Science and Technology, 2015: 12- 15.

[15] 韩泽, 蔺素珍, 赵竞超, 等. 基于直觉模糊集的多波段图像融合[J]. 红外技术, 2018, 40(3): 253-258.

[16] 张康, 黑保琴, 周壮, 等. 变异系数降维的CNN高光谱遥感图像分类[J]. 遥感学报, 2018, 22(1): 87-96.

[17] 闫琦, 李慧, 荆林海, 等. 一种超像素区域相似性度量的遥感信息提取算法[J]. 激光与光电子学进展, 2017, 54(8): 081004.

[18] 利拉桑德, 基弗, 奇普曼. 遥感与图像解译[M]. 彭望琭, 余先川, 贺辉, 等译. 北京: 电子工业出版社, 2015: 366- 383.

Lillesand TM, Kiefer RW, Chipman JW. Remote sensing and image interpretation[M]. Peng W L, Yu X C, He H, et al. Transl. Beijing: Electronic Industry Press, 2015: 366- 383.

[19] 陈洋, 范荣双, 王竞雪, 等. 结合最小噪声分离变换和卷积神经网络的高分辨影像分类方法[J]. 激光与光电子学进展, 2017, 54(10): 102801.

Article Outline

王民, 樊潭飞, 贠卫国, 王稚慧. PFWG改进的CNN多光谱遥感图像分类[J]. 激光与光电子学进展, 2019, 56(3): 031003. Min Wang, Tanfei Fan, Weiguo Yun, Zhihui Wang. PFWG Improved CNN Multispectra Remote Sensing Image Classification[J]. Laser & Optoelectronics Progress, 2019, 56(3): 031003.