条纹投影相位高度转换映射模型及其标定方法  下载: 1313次

下载: 1313次

1 引言

条纹投影轮廓术具有信息处理容易、测量准确度高、速度快以及像素级的分辨率等优点,因此得到广泛的应用[1-6]。典型的条纹投影三维(3D)测量系统包括一台投射器和一台相机,前者用于投射一系列正弦条纹,后者用于拍摄被条纹照射的被测物的图像,然后利用一系列算法处理这些图像以实现三维测量。条纹投影轮廓术的关键技术包括两部分:相位解包裹算法[7-11]和标定技术[12-21],其中后者对于条纹投影三维测量系统的准确度、速度和系统组成有很大的影响,所以受到了很多研究人员的关注。现有的标定技术可以分为两种:基于立体视觉的标定技术和相位高度转换技术。

受双目视觉系统启发,许多研究人员研究并改进了基于立体视觉的标定技术。为了实现三维测量,标定时投射器和相机的内部参数以及二者之间的旋转矩阵、平移向量均需要被标定计算出来。Zhang等[12]提出了一种标定方法,其中投射器可以像相机一样“拍摄”图像,这种方法通过投射一系列的水平和竖直条纹来标定投射器并建立投射器和相机的空间关系。Li等[13]利用预畸变投射条纹的方法消除了投射器镜头畸变造成的影响。为了进一步提高测量准确度,Li等[14]提出了一种算法估计投射器的最佳投射角。最近,Chen等[15]提出一种自标定方法实现了条纹投影测量系统的在线标定。由于需要投射各种图案以标定投射器并计算投射器和相机的空间关系,基于立体视觉的标定技术仅适用于投射器是液晶显示器(LCD)或者数字微透镜阵列(DMD)的情况。然而,在某些情况下,如莫尔条纹投影系统[4]、光纤干涉投影系统[5]和扫描频闪条纹投影系统[6],这种技术不再适用,因为这些系统中的投射器不能被看作“反向”的相机。

另一个分支是相位高度转换标定技术。这种技术不考虑标定投射器,而是通过数学模型直接建立相位和高度的关系,因此不受投射器种类的约束。受插值法的启发,Léandry等[16]提出了一种多项式映射的模型建立相位和高度映射关系。为了达到较高的测量准确度,多项式的次数需要不小于4,因此该测量过程费时,不适合用于高速测量系统中。Lu等[17]提出了一种基于条纹几何约束的相位高度转换方法,这种方法具有高测量准确度和强稳健性,但是同样存在计算量大的问题。Du等[18]利用相机针孔模型结合光线追迹理论建立了相位和高度的映射关系,Huang等[19]通过考虑相机镜头的畸变提高了这种模型的准确度。对应的标定方法需要不同高度的量块和参考面,因此限制了它们的应用范围。此外,文献[ 19]中的模型参数有34个,计算量大。Tavares等[20]利用实验经验提出了相位差和高度的映射关系。Zhang等[21]通过多项式映射的方法建立世界坐标和相位差的一对一映射公式。文献[ 20-21]中的方法本质上是用查表法(LUT)的像素级标定方法。这些方法依赖于相位图中每个像素精确的相位值,为了保证每个点标定结果的准确度,需要标定板移动足够的位置,因此标定过程费时。另外,这两种模型都需要参考平面来计算相位差,会产生误差累积。

本文通过建立虚拟相机坐标系(CCS)以及分析条纹信息在相机坐标系和投射器坐标系(PCS)之间的转换关系,提出了一种针对条纹投影三维测量系统的改进的相位高度转换映射模型及标定方法,它们具有以下特点:1)在标定模型中校正了相机镜头畸变,减少了误差累积,提高了测量准确度;2)模型结构简单,适用于结合LUT法使用,使用LUT法后,算法复杂度极低,可以实现高速测量;3)标定过程操作容易、效率高;4)适用于所有条纹投影三维测量系统,对投射器和相机的空间相对位姿没有严格要求。

2 测量系统标定模型

2.1 相机透视成像模型及逆向投影优化过程(BPP)

根据小孔成像原理[22],相机透视成像模型公式为:

式中[

实际中必须考虑镜头畸变的影响,为了在相位高度转换过程中校正畸变,采用畸变校正模型:

式中[

相机参数优化过程通常分为两种:BPP[23]和正向成像优化过程(FIP)[24]。相比于后者,前者更适用于三维测量,尤其针对畸变较大和图像噪声等级较高的相机[23]。基于BPP的这些优点,本研究在标定过程中采用BPP对相机参数进行优化。

2.2 三维测量模型

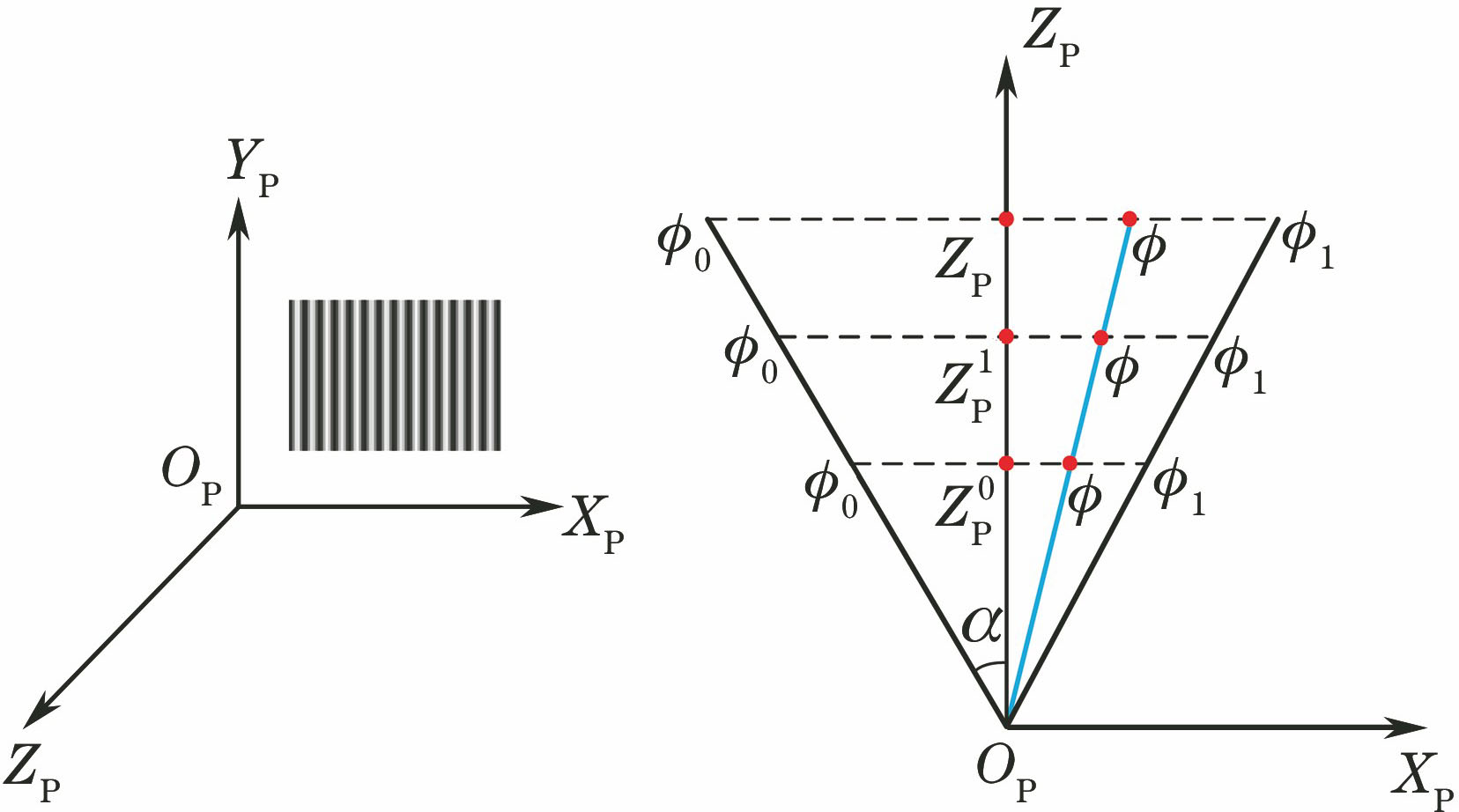

如

由

式中

相机坐标系到投射器坐标系的坐标变换公式为:

式中

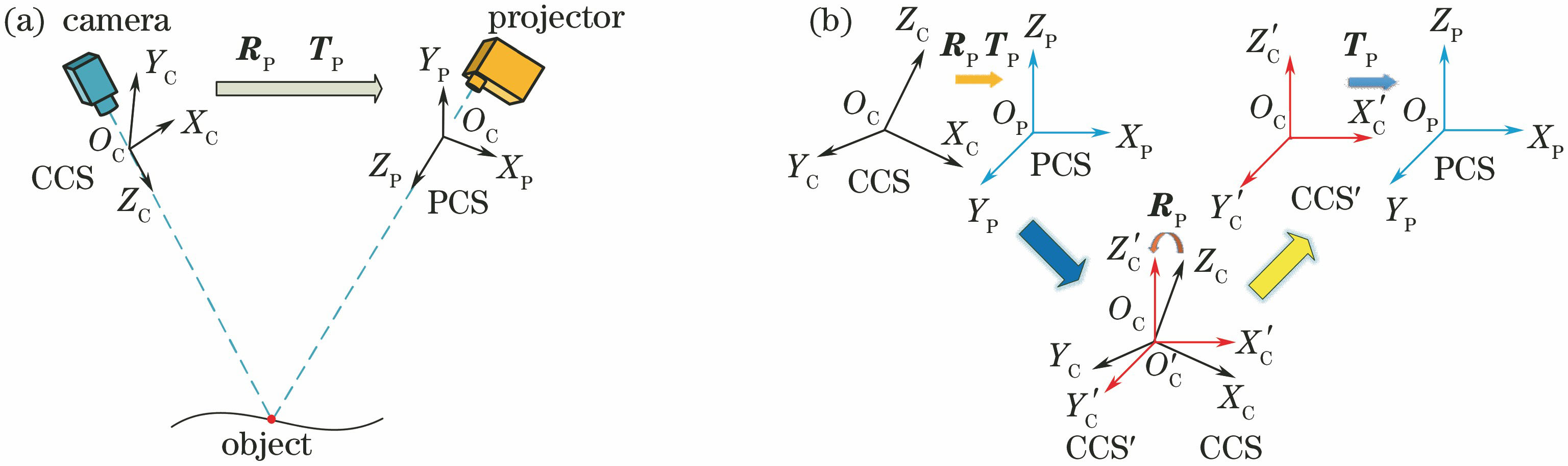

这里,定义一个虚拟相机坐标系(CCS'),使其与投射器坐标系具有相同的姿态,与相机坐标系具有相同的位置,如

图 2. 坐标转换关系。(a)条纹投影三维测量系统;(b)具体的坐标系变换过程

Fig. 2. Coordinate transformation relation. (a) Fringe projection 3D measurement system; (b) detailed coordinate transformation process

将(7)式代入(4)式,可得:

通过(1)式可得虚拟相机坐标系中图像坐标(

将(9)式代入(8)式,可得:

式中

展开(7)式并且令

和(9)式的变换相似,可以从(11)式推导得出:

式中

利用泰勒级数将(12)式展开:

对相机镜头的畸变进行校正,为了避免寻找图像中心坐标[

式中[

式中

(15)式中的参数为:

式中

为了获得(16)式的初始值,将(15)式中的非线性参数设为0,所以(15)式可化为:

式中

将

式中

因此,(16)式中各参数的初始值可以表示为:

得出

为了降低算法复杂度,实现高速测量,这里考虑LUT法,定义为

预先计算出每个像素点的

3 实验

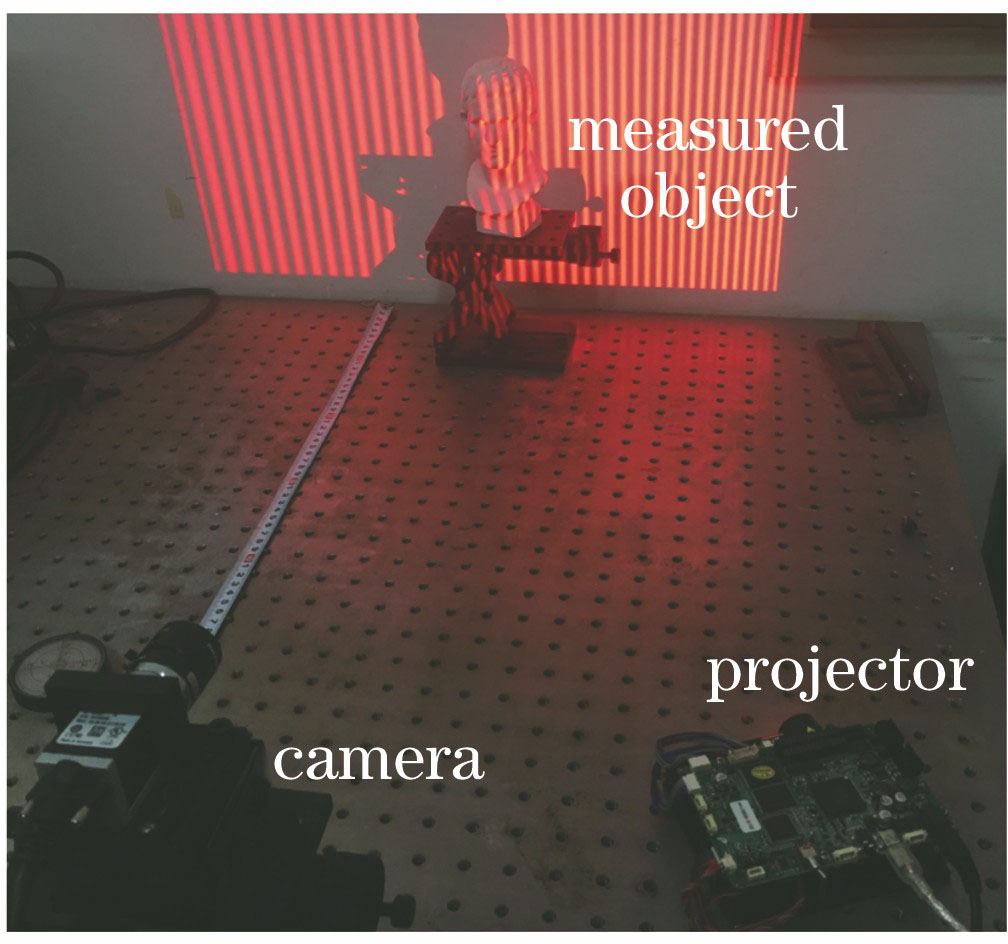

3.1 系统组成及条纹投影算法

实验系统包括一台互补金属氧化物半导体(CMOS)黑白相机(Basler Monochrome GigE Camera,分辨率为1626 pixel×1236 pixel,镜头焦距为16 mm)和一台DMD投影仪(TI DLP Lightcrafer Pro4500 Series DMD projector,分辨率为912 pixel×1140 pixel),相机和投影仪的相对位姿没有严格要求。相机的工作距大约是600 mm,视场大小约为350 mm×260 mm。此外,利用一台商用电脑(Lenovo,主频3.4 GHz)处理数据,使用一个二维圆靶标进行标定。

系统使用四步相移结合差频解相位的算法[7]获得被测物的绝对相位值,每次测量需要获取12幅图像计算绝对相位。

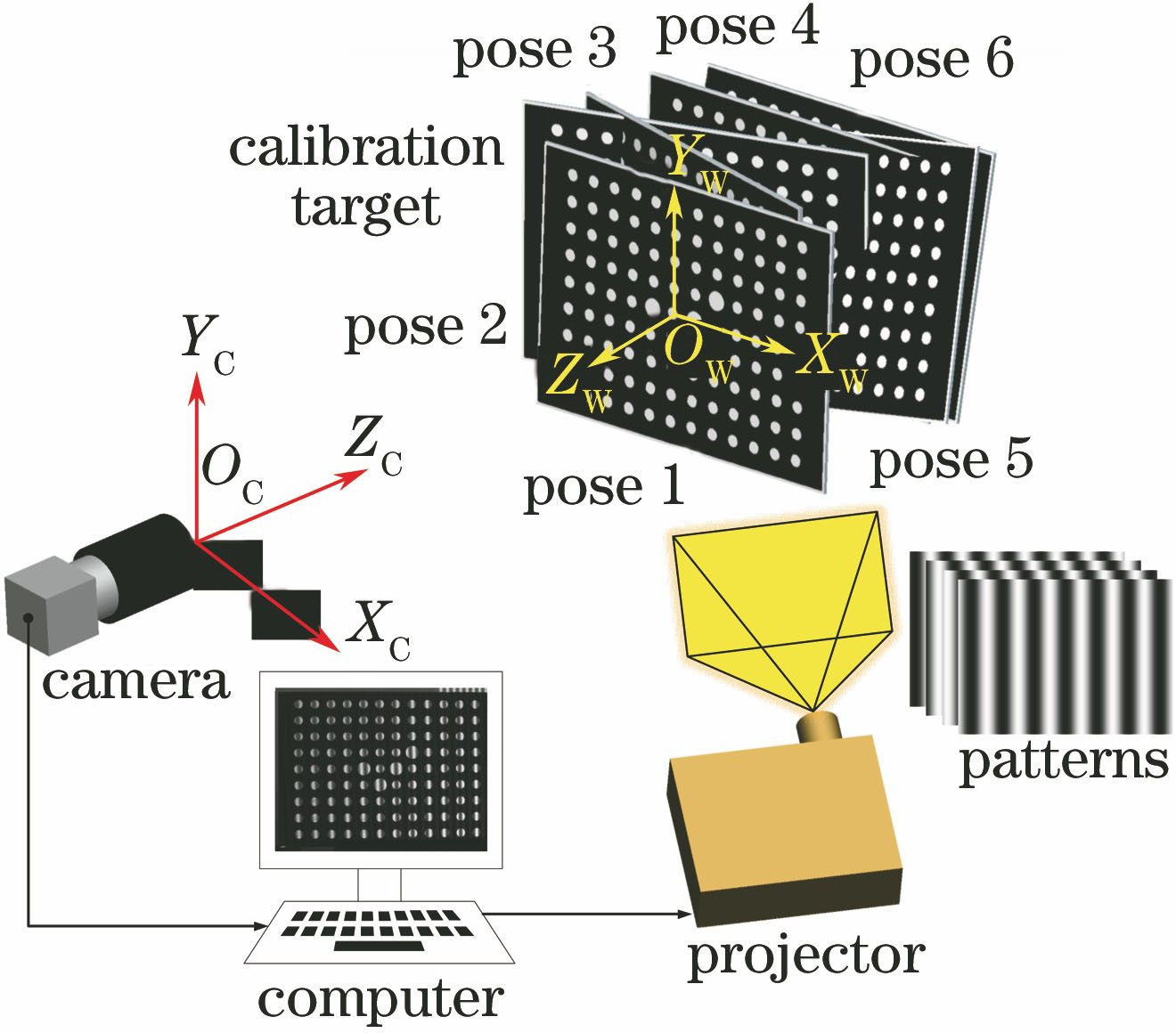

3.2 标定实验步骤

在标定相机时使用文献[

23]提出的BPP方法。与文献[

24]所提出的方法相似,标定靶标需要被放置在几个不同的位置,并保证各个位置的靶标互相之间保持不同的姿态。具体的标定过程示意图如

步骤1:将标定靶标放在相机视场和投影仪投影区域交界处的任意区域。首先,不需要投射任何条纹,拍摄靶标图像用于提取靶标上的特征点;然后,投射3.1节中提及的条纹并拍摄图像用于获取特征点的绝对相位。

步骤2:将靶标放置在另一个位置并保证它与之前的姿态不同,重复步骤1。

步骤3:重复步骤2直到采集到足够图像。实际上,只用两组图像就可以将所有的参数计算出来。尽管如此,通常至少需要5组图像以保证达到足够的准确度。

步骤4:提取特征点信息,并利用插值法计算对应特征点的绝对相位值。

步骤5:标定相机,将所有特征点的坐标值转换到相机坐标系下,并利用每个特征点的信息(

在本标定实验中,靶标被放置在10个位置。

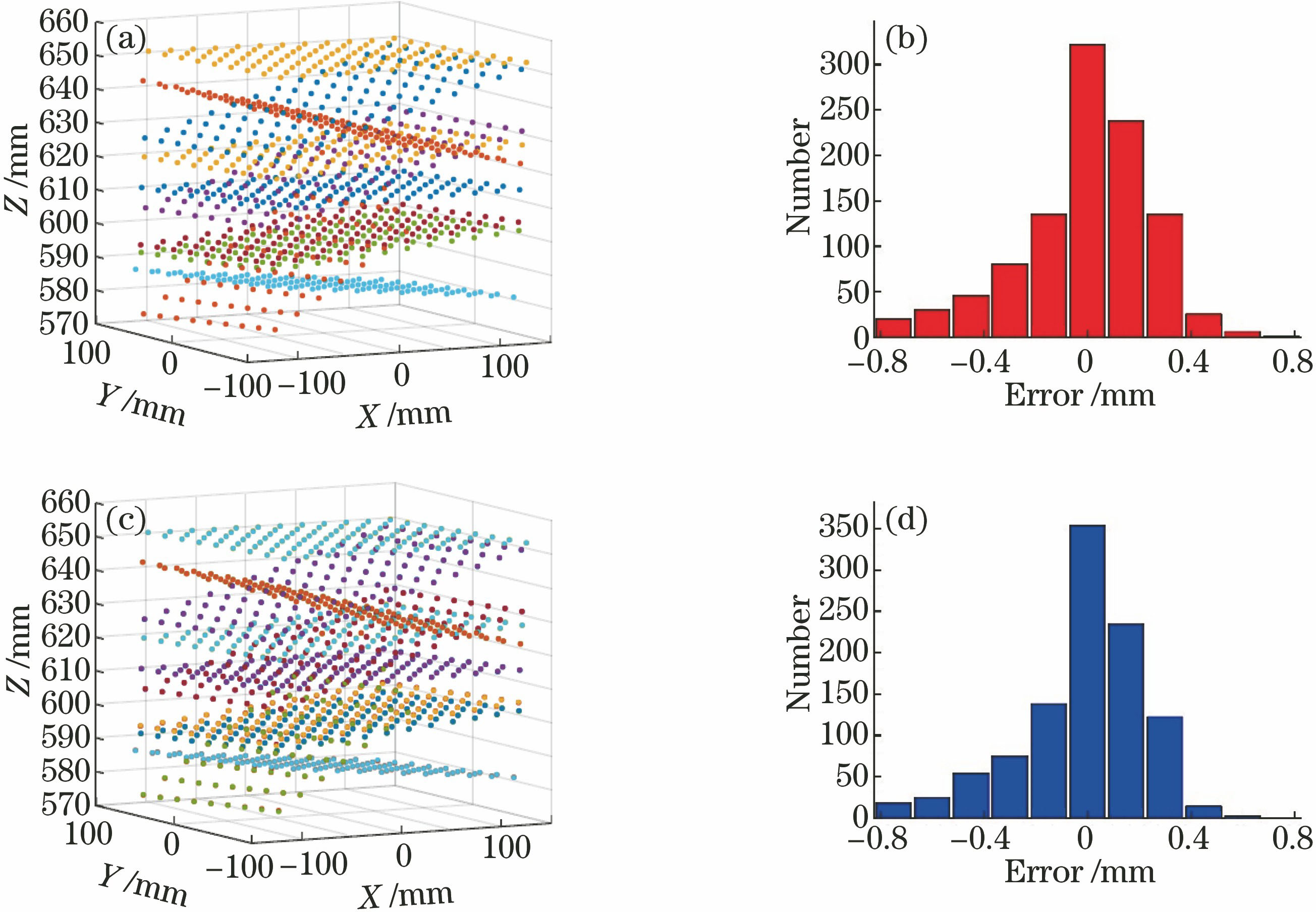

图 5. 标定评价。(a) n=3、(c) n=4时的特征点三维重建结果;(b) n=3、(d) n=4时的特征点误差分布

Fig. 5. Calibration evaluation. 3D reconstruction result of the feature points while (a) n=3, (c) n=4; error distribution of the feature points while (b) n=3, (d) n=4

3.3 误差评价

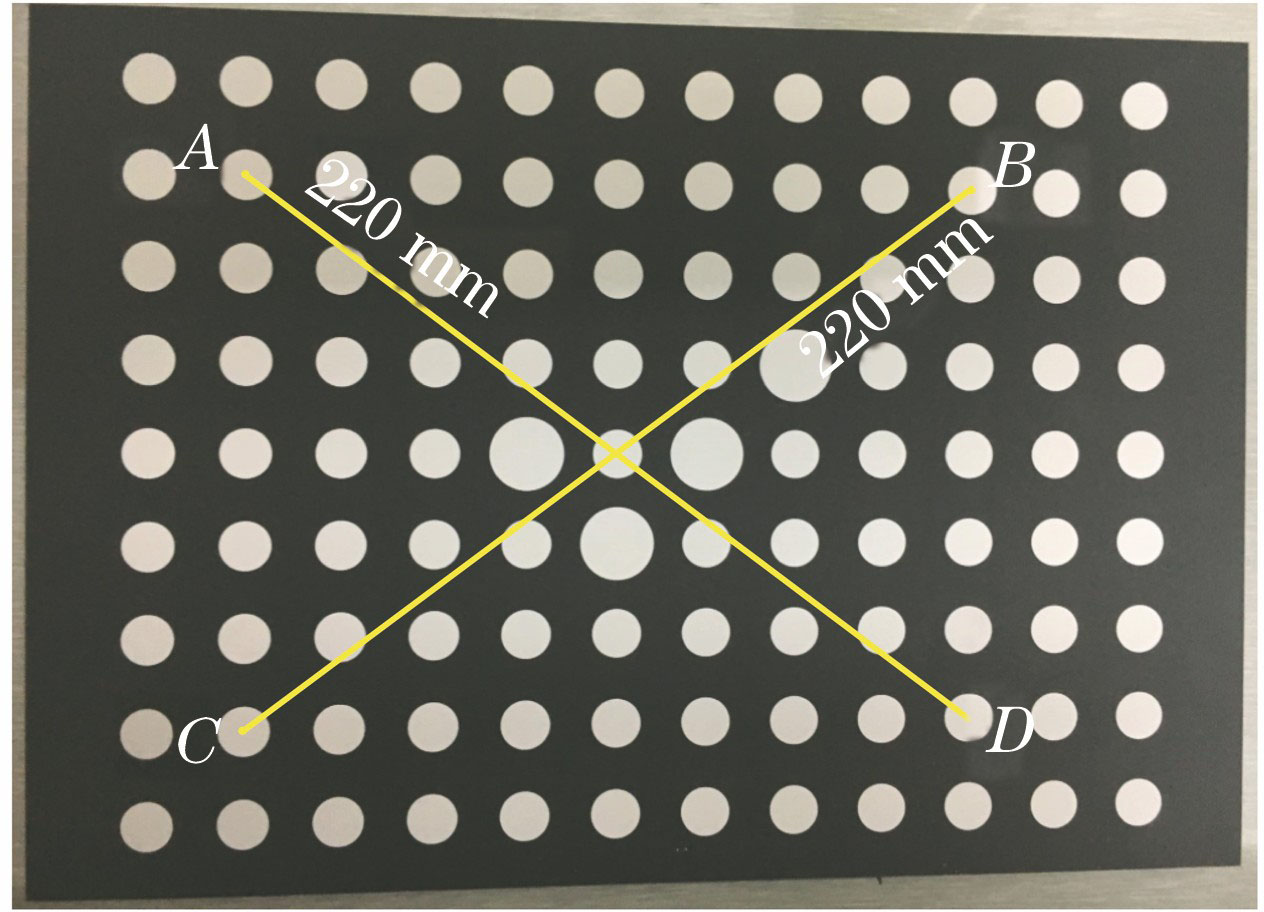

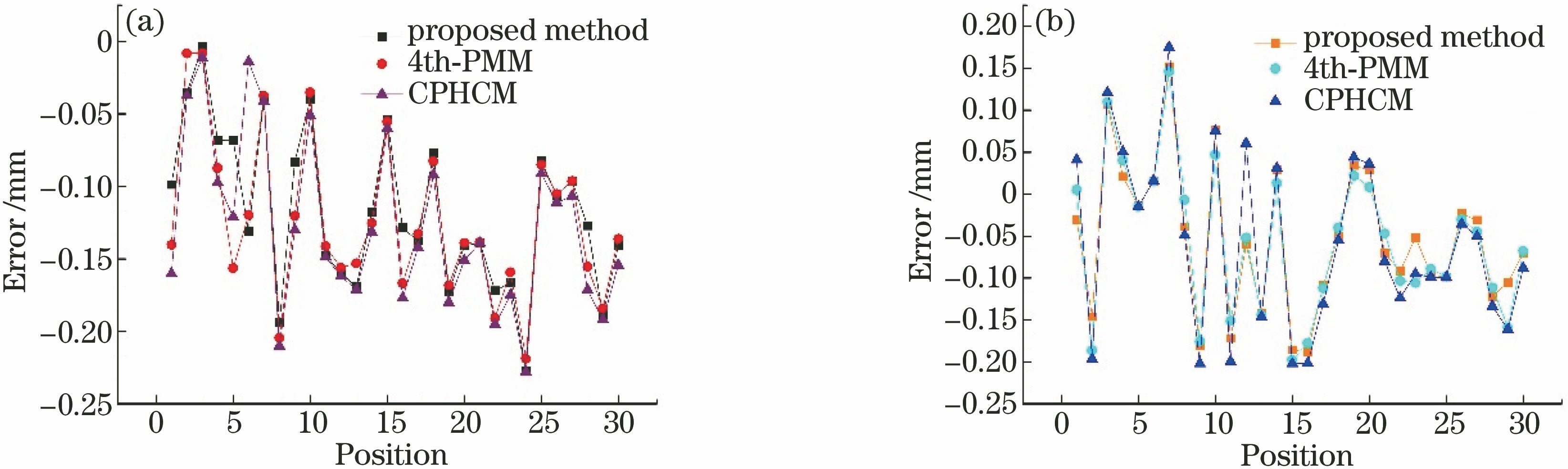

利用标定靶标上4个圆的圆心检测系统测量准确度,如

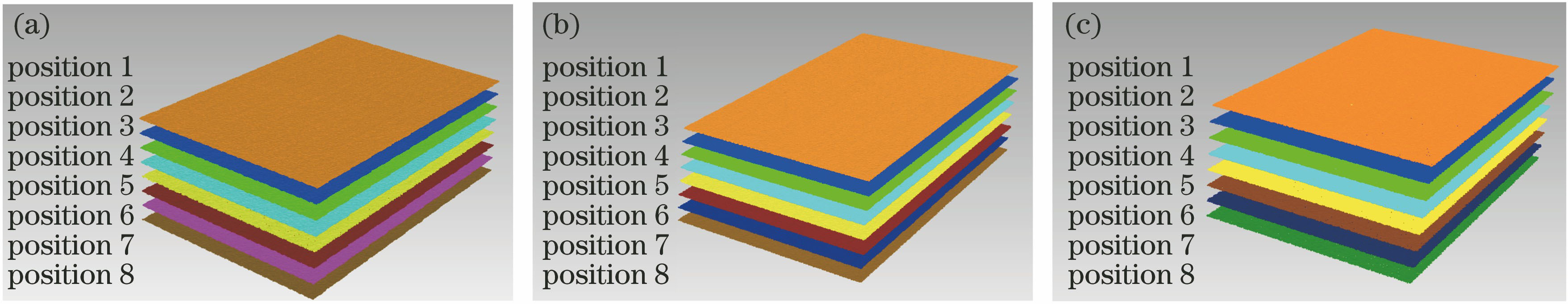

利用另一组实验进一步检测所提模型的测量准确度。将一个白色平板固定在精密平移台上,并保证其法线方向平行于平移台的移动方向。将平板移动到8个位置,步长为5 mm。在每个位置上,分别利用所提模型、4th-PMM和CPHCM模型对平板表面进行三维测量。然后,利用最小二乘法拟合所得点云,结果如

图 8. 拟合平面。(a)所提模型;(b) 4th-PMM;(c) CPHCM

Fig. 8. Fitting planes. (a) Proposed method; (b) 4th-PMM; (c) CPHCM

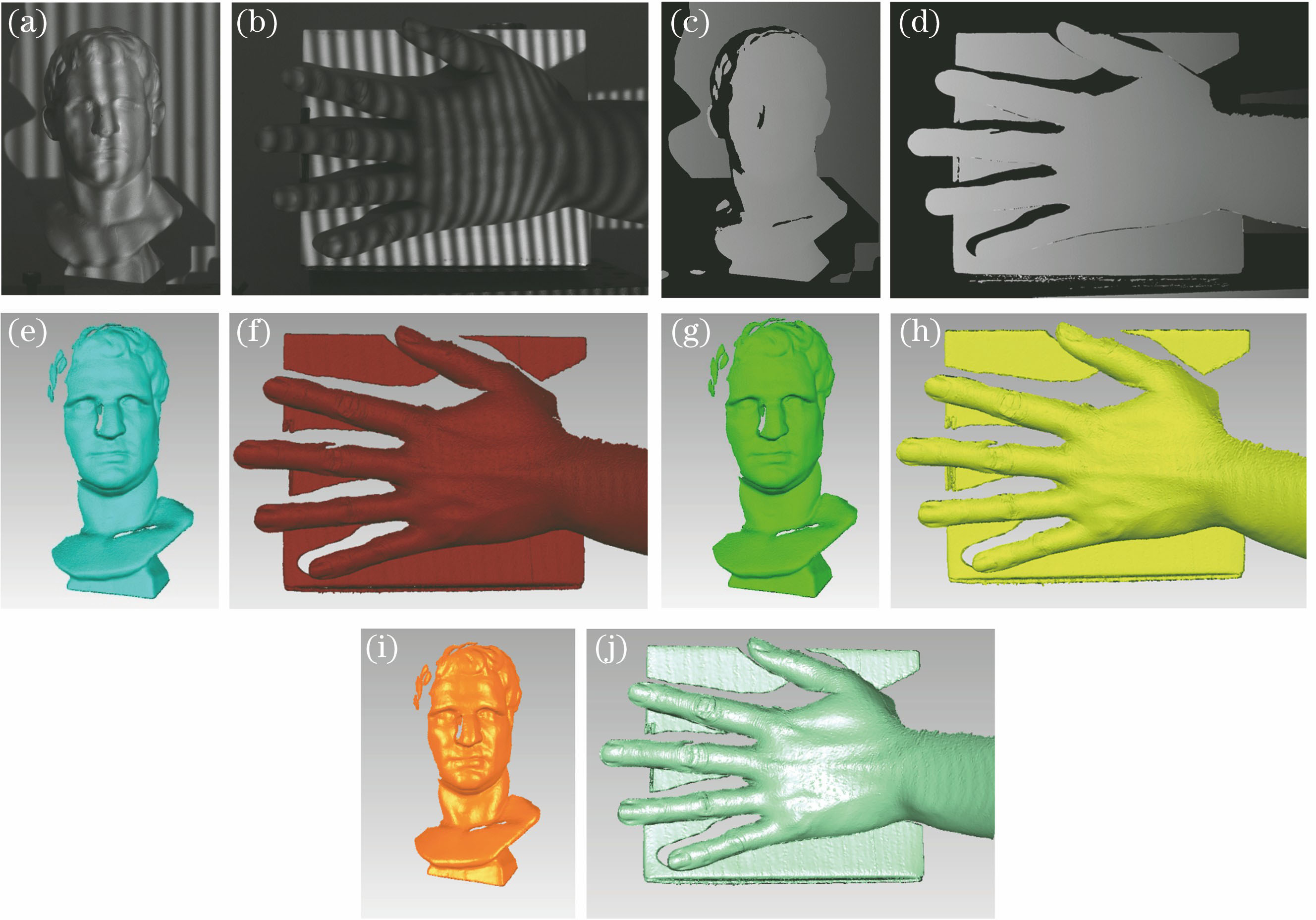

3.4 复杂物体的三维测量

最后利用条纹投影测量系统对复杂物体进行三维测量。被测物包括雕塑和手,如

表 1. 拟合结果评价

Table 1. Fitting results evaluationmm

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

图 9. 雕塑和手的三维测量结果。(a),(b)条纹图像;(c),(d)绝对相位图;(e),(f)利用所提模型得到的三维重建结果;(g),(h)利用4th-PMM模型得到的三维重建结果;(i),(j)利用CPHCM模型得到的三维重建结果

Fig. 9. 3D shape measurement results of a sculpture and a hand. (a),(b) Fringe patterns; (c),(d) absolute phase map; (e),(f) 3D reconstruction results obtained by proposed method; (g),(h) 3D reconstruction results obtained by 4th-PMM model; (i),(j) 3D reconstruction results obtained by CPHCM model

4 分析与讨论

根据上面的原理和实验,所提出的针对条纹投影测量系统的相位高度转换映射模型及其标定方法具有以下优点:

1) 准确度高。本研究在相位高度转换过程中校正了镜头畸变,减少了误差累积,标定相机时所用的BPP方法相比于FIP方法更适用于三维测量。同时,由于本模型建立在相机坐标系中,应用绝对相位而非相位差计算高度值,也避免了一部分误差累积。从误差评价实验结果可知本模型的测量准确度比4th-PMM和CPHCM模型更高,这是因为本模型在经典的相位高度转换模型基础上将相机畸变考虑地更加全面,而4th-PMM基于拟合的思想,在拟合范围的边缘处测量准确度会略微受到影响,CPHCM模型只考虑了径向畸变的低次项,没有考虑径向畸变的高次项以及切向畸变。

2) 算法复杂度低。同4th-PMM、CPHCM模型相比,所提出的模型算法复杂度更低。由于本模型建立在相机坐标系中,同时由于投射器和相机之间的旋转关系以及相机畸变模型均用(14)式表示,因而(15)式表达简单,测量时只需要在内存中建立一个查找表即可,适合与LUT法结合。如(20)式所示,当和LUT法结合后,相位高度转换过程只需要一次乘法、两次加法和一次除法,非常适合应用在高速测量系统中。此外,利用图形处理器(GPU)加速,本模型可以实现超高速测量。

3) 操作简易。首先,标定过程不需要高精度量块和精密平移台的辅助,且不需要参考平面。其次,虽然利用LUT方法后,(20)式与文献[ 20]中的模型相似,但是后者的模型需要先标定相机,再标定系统参数,而本模型相应的标定方法可以实现相机和系统的同步标定。同时,如引言中所述,文献[ 20]中的标定方法是对每个像素单独进行标定,利用标定结果建立查找表,因而为了保证标定结果准确,必须将标定靶标移动足够多的位置。本模型虽然也应用了LUT的思想,但是却是先用(15)式计算系统参数,再用(20)式和标定结果计算查找表中每个像素对应的值。因此只需将一个二维靶标随意放置于几个位置(5~10个位置足够),相机和系统参数就可以被同时快速准确标定。总之,本模型具有和文献[ 20]中模型一样适合高速测量的特点,但是标定过程更简单高效。

4) 适用性强。本模型适用于所有条纹投影测量系统,包括莫尔条纹投影系统、光纤干涉投影系统以及扫描频闪条纹投影系统。这是因为该模型不是建立在基于立体视觉的模型上,不需要标定投射器的内部参数。同时,根据本模型推导过程可知,其对相机和投射器之间的空间相对位姿没有严格要求。所以,标定时只要投射器的投影区域在相机的视场内,它们就可以被随意放置,实验结果验证了这一原则。

5 结论

提出了一种针对条纹投影三维测量系统的改进的相位高度转换映射模型及其标定方法,通过建立虚拟相机坐标系以及分析条纹信息在相机坐标系和投射器坐标系之间的关系,在相机坐标系中建立了高度与条纹信息的一一映射关系。通过展开相机畸变校正模型和使用泰勒级数,在相位高度转换模型中用多项式校正了相机透镜畸变并实现了条纹信息从投射器坐标系到相机坐标系的旋转变换。阐述了模型中参数的求解方法:首先求解出模型的线性参数,再利用Levenberg-Marquardt算法求解出所有参数。结合LUT方法,降低了算法复杂度。利用BPP方法在标定过程中优化相机参数并提出了针对映射模型的简洁高效的标定方法。标定实验表明,模型中当参数

[3] 苏显渝, 张启灿, 陈文静. 结构光三维成像技术[J]. 中国激光, 2014, 41(2): 0209001.

苏显渝, 张启灿, 陈文静. 结构光三维成像技术[J]. 中国激光, 2014, 41(2): 0209001.

[6] 杨国威, 孙长库, 王鹏. 频闪激光光栅条纹实时投射系统[J]. 光学学报, 2014, 34(11): 1112002.

杨国威, 孙长库, 王鹏. 频闪激光光栅条纹实时投射系统[J]. 光学学报, 2014, 34(11): 1112002.

[7] 陈松林, 赵吉宾, 夏仁波. 多频外差原理相位解包裹方法的改进[J]. 光学学报, 2016, 36(4): 0412004.

陈松林, 赵吉宾, 夏仁波. 多频外差原理相位解包裹方法的改进[J]. 光学学报, 2016, 36(4): 0412004.

[9] 雷志辉, 李健兵. 基于双频投影条纹的全自动相位解包裹方法[J]. 光学学报, 2006, 26(1): 39-42.

雷志辉, 李健兵. 基于双频投影条纹的全自动相位解包裹方法[J]. 光学学报, 2006, 26(1): 39-42.

[22] 孙长库, 何明霞, 王鹏. 激光测量技术[M]. 天津: 天津大学出版社, 2008: 144- 149.

孙长库, 何明霞, 王鹏. 激光测量技术[M]. 天津: 天津大学出版社, 2008: 144- 149.

Sun CK, He MX, WangP. Laser measurement technology[M]. Tianjin: Tianjin University Press, 2008: 144- 149.

Sun CK, He MX, WangP. Laser measurement technology[M]. Tianjin: Tianjin University Press, 2008: 144- 149.

Article Outline

陆鹏, 孙长库, 王鹏. 条纹投影相位高度转换映射模型及其标定方法[J]. 光学学报, 2018, 38(2): 0212004. Peng Lu, Changku Sun, Peng Wang. Fringe Projection Phase-to-Height Mapping Model and Its Calibration Method[J]. Acta Optica Sinica, 2018, 38(2): 0212004.