用于多光谱语义分割的LBP特征增强神经网络  下载: 549次

下载: 549次

1 引言

语义分割是计算机视觉中非常重要的研究方向,通过对图像中信息的分类,从像素级将图像划分成不同区域,每个区域分别代表一种特定的语义,进而让机器理解一张图像中所包含的内容。语义分割在自动驾驶[1]、智能医学图像处理[2]、大范围行人检测[3-4]、遥感[5]等领域有着十分广泛的应用[6]。

语义分割是一个有挑战性的研究方向[7]。首先,传感器获得的图像在光照、角度等方面均存在非理想现象,易产生遮挡;其次,多种物体之间存在相似性,会导致误判。近年来,基于卷积神经网络的图像语义分割受到了越来越多研究者的重视[8]。2017年,Lin等[9]提出RefineNet,该网络在下采样过程中充分提取有效信息,达到了非常好的效果。2018年,郭呈呈等[10]提出了一种基于卷积神经网络特征和改进超像素匹配的图像语义分割算法,采用图像检索的方式提升了稀少类目标的分割精度。2020年程晓悦等[11]重点研究了膨胀卷积平滑和轻型上采样,有效压缩了神经网络的体量,实现了实时语义分割。上述针对可见光图像的语义分割方法,并不能直接用于多光谱语义分割问题。

在光照强度较低或存在较多干扰的环境下,普通相机很难获得清晰的图像,而红外图像传感器可以提供与可见光强度无关的稳定图像,但红外图像传感器不能捕获丰富的色彩信息。所以,基于红外和RGB图像的多光谱图像语义分割更适用于复杂环境,在自动驾驶、安防监测等方面有很强的研究价值。2017年Hazirbas等[12]提出FuseNet用以解决室内场景的多模态语义标注问题,并在相关数据集上获得了有竞争力的结果,但该方法仅在室内环境下表现优秀,应用场景单一。2017年,Ha等[13]在研究自动驾驶问题时提出一种多光谱图像分割的卷积神经网络结构(MFNet),提高了分割精度,并公开了RGB-Thermal数据集,但是该方法只是机械地将红外图像和RGB图像输入神经网络,在图像特征学习方面仍有提升的余地。2019年Sun等[14]提出了RTFNet,利用残差网络提取特征并设计了全新的解码器。该方法在利用50层及更多层残差网络作为特征提取模块时表现出色,但该模型体量庞大,实时性受限。

为了提升多光谱语义分割精度,拓展至室外场景,并通过特征增强减小神经网络体量大小,本文提出了一种用于RGB-红外多光谱语义分割的局部二值模式(LBP)[15]特征增强神经网络。利用LBP特征提取算子来提取红外图像的边缘特征,并结合34层的残差网络[16]设计语义分割网络,有效保障了语义分割的精度。

2 基本原理与本文工作

2.1 LBP

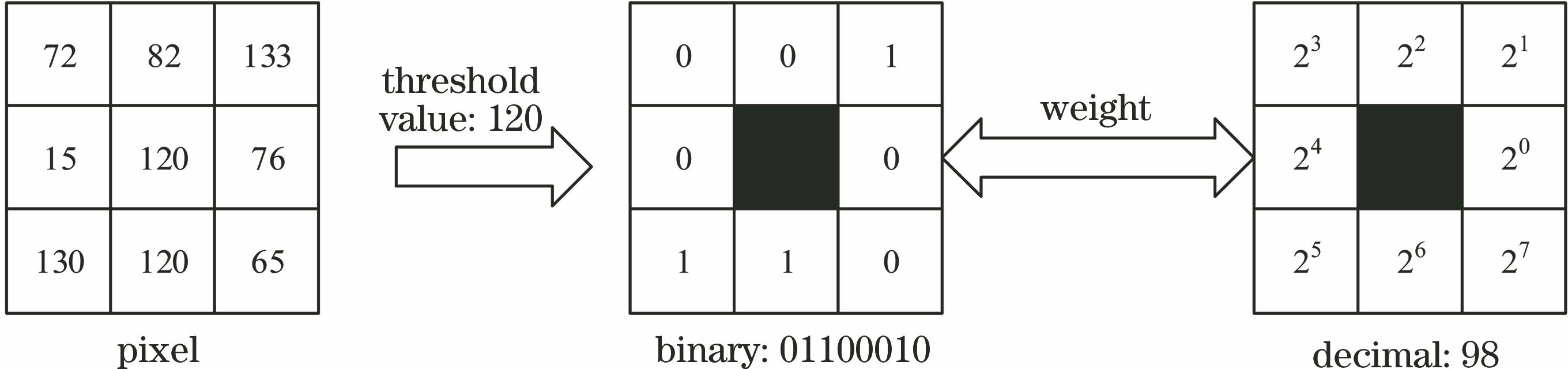

LBP是Ojala等[15]于1996年提出的经典的特征提取算子。LBP通过比较中心点与其周围八个点像素值的大小关系反映出当前中心点的特征,是一种计算量小,对像素变化非常灵敏的特征值提取算法。典型的LBP计算方式如

图 2. LBP算法效果示意图。(a)原图;(b) LBP特征图

Fig. 2. Effect diagram of LBP algorithm. (a) Original image; (b) LBP feature image

其计算公式可以表示为

式中:xλ代表当前像素点;xn代表在当前像素点周围的8个点的像素值;s(k)的作用是将差值大于0的情况取1,差值小于0的情况取0。

2.2 LBP卷积实现方法

随着近几年神经网络的飞速发展,有不少学者也在研究将LBP与卷积神经网络结合,但是这些结合的实质多数是独立的[17],没有将LBP处理和神经网络真正融合在一起。例如,先使用LBP算法处理图像再将图像输入到神经网络中。而本文则将LBP算法融入到卷积网络之中,通过卷积滤波核的形式实现了LBP算法。

当前神经网络多数基于张量搭建,想要对张量中的每一个元素进行操作是一件非常困难的事情,而LBP算法却需要对每一个像素进行操作,使得LBP在神经网络中的应用变得十分困难。本文根据LBP算法的原理和张量操作的特性设计了一种基于卷积滤波核的解决方案,如

如

基于上述内容,可以采用卷积滤波核的方式将LBP算法搭建入卷积神经网络中,使得整个系统更加流畅。

2.3 LBP特征增强的神经网络

本文根据LBP在特征提取方面的优势,设计了一个包含LBP特征增强的神经网络模型,实现RGB-红外多光谱语义分割。该网络结构如

该模型主要包含三个部分:红外图像的LBP特征增强过程、残差网络[16]的特征提取过程和上采样重建图像过程。在LBP特征增强过程中,本文通过一次LBP算法和一次LBPplus算法,获得两张红外图像边缘信息的特征图。在输入残差网络之前将两张特征图与原始红外图像在通道维度上拼接,获得一个三通道的张量。而RGB图像已经是三个通道,色彩细节丰富,所以本文在设计时仅将LBP算法应用到红外图像中。

在该过程中,LBP算法与2.2中所述内容一致,即采用8个3×3的卷积滤波核完成8次大小比较,并计算激活后的加权和。而LBPplus算法则是对普通LBP的改进。

特征提取过程中通过迁移学习,将一个经过预训练的34层残差网络(Res34)作为特征提取模块,基于此,本文将搭建的神经网络命名为LBP34。在LBP34的训练过程中,用于红外图像和RGB图像特征提取的两个残差网络各自独立优化,不会共享参数。

上采样重建图像过程中采用双线性插值的方式扩大特征图尺寸,每次插值操作后都将特征图的长和宽扩大一倍。双线性插值是一种常用的一阶插值方案,利用原图中相邻四个点的像素值确定插值后目标点的像素值。将扩大后的特征图用3×3卷积进行处理。并从残差网络中引出尺寸相同的特征图与上采样结果相加,将初始提取的特征传递到上采样过程中,以便于上采样过程中可以关注到原始图像的特征。

语义分割本质上是像素点的分类问题,所以在损失函数的选择上,本文采用交叉熵损失作为训练过程中的优化目标函数。

3 实验内容与分析

为了验证LBP特征增强的神经网络在多光谱语义分割中的有效性,本文选择了Ha等[13]在MFNet中公布的RGB-Thermal数据集来训练和测试所提出的网络结构,并与在引言中提出的三种先进的多光谱或多模态语义分割网络进行比较。

3.1 数据集与训练细节

RGB-Thermal数据集中包括1569对红外与可见光图像,其中有820对采集于白天,749对采集于夜晚。该数据集通过InfReC R500摄像机采集,所有图片的分辨率均为640 pixel×480 pixel。由于RGB-Thermal数据集面向的是自动驾驶任务,所以该数据集中的图片均为街景图像,内容包括自行车、路障、行人、机动车等,并将其他物体统一标注为背景。遵循MFNet的数据集划分方式,本文的实验设置中,训练集的一半是日间图像,另一半是夜间图像,在验证集中,日间图像与夜间图像同样各占一半,其余的图像为测试集。训练集、验证集、测试集的比例约为2∶1∶1。

训练中,本文采用了图像翻转的数据增强方式,在输入神经网络之前,图像中有50%的几率进行一次翻转,进而提升了数据多样性。所采用的Res34是在ImageNet[18]上经过预训练的网络,已经具备很强的特征提取能力,可以在RGB-Thermal数据集上直接开展训练。

本文提出的神经网络基于PyTorch搭建。神经网络的训练、验证和测试都是在一张NVIDIA 1080 Ti GPU上完成的。在训练过程中,根据GPU显存和训练优化考虑,批处理大小(Batchsize)为4,总训练共计70次全局迭代(Epoch)以达到神经网络的收敛。在最优化算法方面,本文依据RTFNet[14]中的超参数设计,采用包含动量的随机梯度下降(SGD)方法寻找最优解,初始的学习率为0.01,动量与权重衰减分别为0.9与0.0005,这也是神经网络领域相关文献中经常采用的参数设置方式。

3.2 实验结果分析

3.2.1 定量分析

基于上一节的训练集、验证集、测试集的比例,本文选择引言中介绍的FuseNet[12],MFNet[13]和RTFNet[14]三种研究多光谱和多模态语义分割的算法作为对比算法,并根据原始论文中的设置复现了MFNet与RTFNet50以及FuseNet。其中,MFNet与RTFNet50是针对RGB-红外语义分割问题的算法,RTFNet50采用了一个50层的残差网络作为特征提取模块。FuseNet关注的是RGB-D,即可见光与深度信息的多模态图像的语义分割。在复现FuseNet的过程中,用红外图像代替了原始的深度信息作为输入,在最大程度上保障了FuseNet实验结果的有效性。

表 1. RGB-Thermal数据集测试结果

Table 1. Test results on RGB-Thermal dataset%

|

在具体分类上,LBP34在Bike、Guardrail、Color cone、Bump这四个类别上取得了最优结果。这四个类别中的待检测物体多数为在大环境下很容易被忽略小尺寸目标。实验结果验证了通过LBP提取边缘特征,加强了边缘信息,使得神经网络在进行语义分割的过程中更容易注意到尺寸相对较小的目标,这与LBP算法的原理一致。同时,虽然在另外四个类别上,LBP34的分割结果略低于RTFNet50,但是RTFNet50在下采样过程中采用了一个50层残差网络块用以特征提取,而LBP34仅采用了一个34层的残差网络块,体量上明显小于RTFNet50。相对于其他两组对比实验,LBP34的结果也有非常明显的优势。

根据数据集的采集环境,本文还对比了白天和夜晚四种不同方法的语义分割精度和交并比的平均值,实验结果见

表 2. RGB-Thermal数据集白天和夜晚图像测试结果

Table 2. Test results on day and night images of RGB-Thermal dataset

|

3.2.2 可视化分析

在夜间图像的分割结果中,对于

图 6. RGB-Thermal数据集测试集部分可视化实验结果

Fig. 6. Some visual results of the testset from RGB-Thermal dataset

从日间图像的语义分割结果中不难看出,由于白天RGB图像中包含更多复杂的自然环境,同时红外图像中存在的干扰也更多,语义分割时较容易出现误检、漏检等问题。例如

为了更详细地描述LBP34在小尺度目标物体的识别和分割上的有效性,同时提供更多的可视化结果展示,

在

定量分析和可视化分析都验证了LBP34在多光谱语义分割任务上的优势。更进一步的分析证明,LBP34能够对尺度较小,但是在红外图像中具有比较清晰边界的物体实现更加精确的检测,这与LBP算法可以实现边缘特征提取的特性相匹配。

4 结论

本文提出了一种基于LBP算法的特征增强方法,基于此方法搭建了神经网络并用于多光谱语义分割。LBP算法被应用于增强红外图像的边界特征,并拓宽了红外图像通道数。LBP特征增强的神经网络在特征提取模块仅采用了34层残差网络,所达到的效果优于该研究领域的相关算法。本文从准确度和交并比的定量比较以及语义分割结果可视化的定性分析两方面验证了LBP34在语义分割方面的优越性。

[1] 郭继舜. 面向自动驾驶的语义分割和目标检测技术[D]. 成都: 电子科技大学, 2018: 1- 5.

Guo JS. Semantic image segmentation and object detection in autonomous-driving system[D]. Chengdu: University of Electronic Science and Technology of China, 2018: 1- 5.

[2] 黄星奕, 丘子明, 许燕. 基于深度监督全卷积神经网络的MRI脑图像语义分割算法[J]. 北京生物医学工程, 2019, 38(3): 277-282.

Huang X Y, Qiu Z M, Xu Y. Semantic segmentation algorithm for MRI brain image based on deeply supervised fully convolutional network[J]. Beijing Biomedical Engineering, 2019, 38(3): 277-282.

[3] 刘丹, 马同伟. 结合语义信息的行人检测方法[J]. 电子测量与仪器学报, 2019, 33(1): 54-60.

Liu D, Ma T W. Pedestrian detection method based on semantic information[J]. Journal of Electronic Measurement and Instrumentation, 2019, 33(1): 54-60.

[4] 伍鹏瑛. 基于卷积神经网络的真实场景下行人检测研究[D]. 长沙: 长沙理工大学, 2018: 5- 8.

Wu PY. Research on pedestrian detection in real scene based on convolutional neural network[D]. Changsha: Changsha University of Science & Technology, 2018: 5- 8.

[5] 朱天佑, 董峰, 龚惠兴. 基于二值语义分割网络的遥感建筑物检测[J]. 光学学报, 2019, 39(12): 1228002.

[6] 张祥甫, 刘健, 石章松, 等. 基于深度学习的语义分割问题研究综述[J]. 激光与光电子学进展, 2019, 56(15): 150003.

[7] 王嫣然, 陈清亮, 吴俊君. 面向复杂环境的图像语义分割方法综述[J]. 计算机科学, 2019, 46(9): 36-46.

Wang Y R, Chen Q L, Wu J J. Research on image semantic segmentation for complex environments[J]. Computer Science, 2019, 46(9): 36-46.

[8] 王恩德, 齐凯, 李学鹏, 等. 基于神经网络的遥感图像语义分割方法[J]. 光学学报, 2019, 39(12): 1210001.

[9] Lin GS, MilanA, Shen CH, et al. RefineNet: multi-path refinement networks for high-resolution semantic segmentation[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017. Honolulu, HI. IEEE, 2017: 1925- 1934.

[10] 郭呈呈, 于凤芹, 陈莹. 基于卷积神经网络特征和改进超像素匹配的图像语义分割[J]. 激光与光电子学进展, 2018, 55(8): 081005.

[11] 程晓悦, 赵龙章, 胡穹, 等. 基于膨胀卷积平滑及轻型上采样的实时语义分割[J]. 激光与光电子学进展, 2020, 57(2): 021017.

[12] HazirbasC, Ma LN, DomokosC, et al.FuseNet: incorporating depth into semantic segmentation via fusion-based CNN architecture[M] ∥Computer Vision-ACCV 2016. Cham: Springer International Publishing, 2017: 213- 228.

[13] Ha QS, WatanabeK, KarasawaT, et al. MFNet: towards real-time semantic segmentation for autonomous vehicles with multi-spectral scenes[C]∥2017 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), September 24-28, 2017. Vancouver, BC. IEEE, 2017: 5108- 5115.

[14] Sun Y X, Zuo W X, Liu M. RTFNet: RGB-thermal fusion network for semantic segmentation of urban scenes[J]. IEEE Robotics and Automation Letters, 2019, 4(3): 2576-2583.

[15] Ojala T, Pietikäinen M, Harwood D. A comparative study of texture measures with classification based on featured distributions[J]. Pattern Recognition, 1996, 29(1): 51-59.

[16] He KM, Zhang XY, Ren SQ, et al. Deep residual learning for image recognition[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016. Las Vegas, NV, USA. IEEE, 2016: 770- 778.

[17] 徐杰, 孙超, 郭春赫. 实时系统下LBP与CNN结合的人脸识别方法[J]. 黑龙江科技大学学报, 2018, 28(6): 692-696.

Xu J, Sun C, Guo C H. Face recognition based on combination of LBP and CNN in real-time system[J]. Journal of Heilongjiang University of Science and Technology, 2018, 28(6): 692-696.

[18] DengJ, DongW, SocherR, et al. ImageNet: a large-scale hierarchical image database[C]∥2009 IEEE Conference on Computer Vision and Pattern Recognition, June 20-25, 2009. Miami, FL. IEEE, 2009: 248- 255.

Article Outline

史兴萍, 徐江涛, 蒋永唐, 秦书臻, 路凯歌. 用于多光谱语义分割的LBP特征增强神经网络[J]. 激光与光电子学进展, 2020, 57(14): 141004. Xingping Shi, Jiangtao Xu, Yongtang Jiang, Shuzhen Qin, Kaige Lu. A Neural Network for Multi-Spectral Semantic Segmentation Based on LBP Feature Enhancement[J]. Laser & Optoelectronics Progress, 2020, 57(14): 141004.