基于激光雷达的运动补偿方法  下载: 1877次

下载: 1877次

1 引言

随着各种环境感知传感器的不断发展,智能车辆感知环境信息的效率得到了有效提升。对于无人驾驶汽车来说,运用激光雷达检测环境的感知和动态背景下的运动目标已成为该领域的研究热点。在计算机视觉和模式识别领域中,基于视觉的静态背景下的运动目标检测研究已较为成熟,而主要处理传感器姿态变化的动态背景下的目标检测仍然是研究的重点和难点。相比传统传感器,激光雷达受天气影响小且可精确测得参考点点云坐标信息,将激光雷达应用到智能车动态背景目标检测中时必须要考虑其运动补偿的问题。

运动补偿主要是通过处理前一帧数据来预测、补偿当前的信息。传感器的各自数据类型不一致,导致解决运动目标检测问题的方法不一样。文献[ 1-2]基于差分的方法利用静止的相机获取图像序列中的运动目标,相机运动时无法检测到运动目标;针对移动相机运动目标的检测,文献[ 3]提出直接估计相机运动参数的方法,直接测量相机运动参数是消除视觉背景运动的最佳方法,但有的时候无法直接测量这些参数;文献[ 4]提出一种几何变换的方法,这种方法计算量较小,适合实时计算;文献[ 5-7]主要基于视觉的方法,利用颜色特征进行背景运动估计,解决了相机运动引起的动态背景问题;文献[ 6]基于仿射变换对相机运动进行建模,利用背景运动补偿帧检测运动目标,而对于激光雷达是通过计算当前帧与前一帧的差值来进行运动补偿,该方法计算量太大,不适合在三维距离数据中完成;文献[ 8-10]针对三维点云数据进行运动目标检测,根据目标识别及跟踪的结果对目标的动态特性进行研究,但算法的主要功能是对目标进行识别;文献[ 11]基于八叉树的占用网格来模拟车辆周围的动态环境,通过比较扫描前后帧数据的不一致来检测移动物体,但是该方法需要较高计算成本且不适用前后帧彼此改变的情况;文献[ 12]提出一种生成对象检测算法,可提取不同大小和形状的对象,但无法在动态背景下工作。

基于以上问题,本文提出一种基于激光雷达的运动补偿算法。根据静态背景场景的特点以及历史激光雷达数据帧生成的数据包,利用高斯混合模型对时间T坐标系下的背景进行建模。高斯混合模型在静态背景场景下具有良好的性能,但在动态场景下容易失效。因此,通过运动补偿将动态背景转换为静态背景,再用高斯混合模型对时间T列表中所有历史帧进行处理,得到T时刻运动目标的原点特征点,将特征点与当前帧中符合的点相匹配,进一步细化点在当前帧中的新位置。实验结果表明,该方法在大多数情况下是可靠的,可以成功地对背景运动进行估计和补偿,适合应用于三维环境下运动目标的检测。

2 激光雷达运动补偿问题

激光雷达作为一种通过自身发出激光束感知周围环境且受外界环境影响较小的主动传感器,主要应用于无人驾驶汽车环境感知、机器人环境感知、无人机测绘等领域。激光雷达较相机等其他可见光的传感器而言,具有两点优势。其一,激光雷达获得的激光束回波数据中包含准确的三维场景中参考点的距离及点云坐标信息,并且受恶劣天气的影响较小,该优势随着工业水平的快速发展而应用更加广泛;其二,激光雷达获取的是连续的数据,主要通过水平方向360°旋转获取回波数据,不同于相机,相机获取的图像帧是瞬时的。

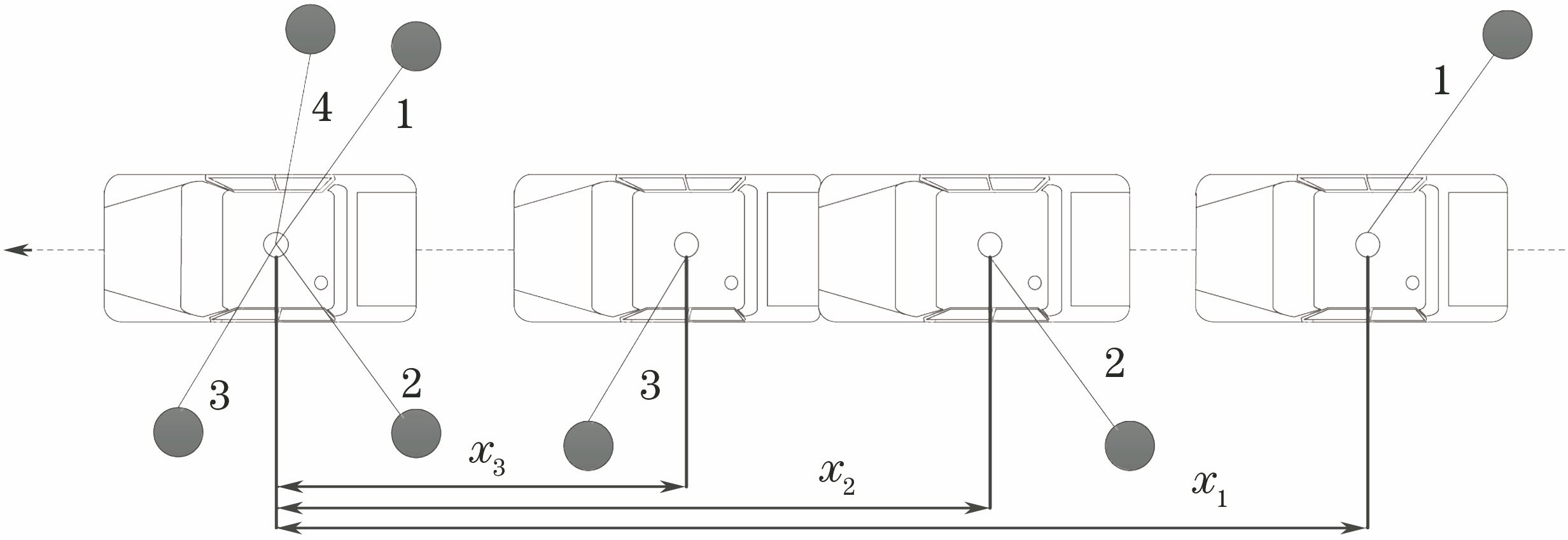

将RS-LiDAR-16激光雷达安装在车顶上,机械式的激光雷达绕轴扫射,转速为10 Hz·s-1,扫一圈需要0.1 s。RS-LiDAR-16采用混合固态激光雷达,快速旋转16个激光发射组件,同时发射高频率激光束,对外界环境进行持续性扫描,测量距离高达150 m,测量精度在±2 cm以内,出点数高达 320000 spot·s-1,水平测角为360°、垂直测角为-15°~15°,根据测距算法提供三维空间点云数据及物体反射率。在绝大多数自主车感知的场景下,道路可行驶区域中的车辆、行人及道路两旁的树木、路沿、电线杆等都是呈垂直方向的结构特性,因此在相对平坦的地面上可以近似忽略车体垂直方向的运动,主要考虑激光雷达水平方向的运动补偿。假设车行驶速度为36 km·h-1,即10 m·s-1,则在0.1 s时车子已行驶1 m的路程。因为激光雷达是通过不停的360°旋转扫描获取回波数据,即在雷达扫完一圈时将这一圈所扫描到的点云数据发送出来,所以此时车在行驶过程中会不可避免地存在一定的数据偏差,故需要补偿消除自我运动的影响。

假设

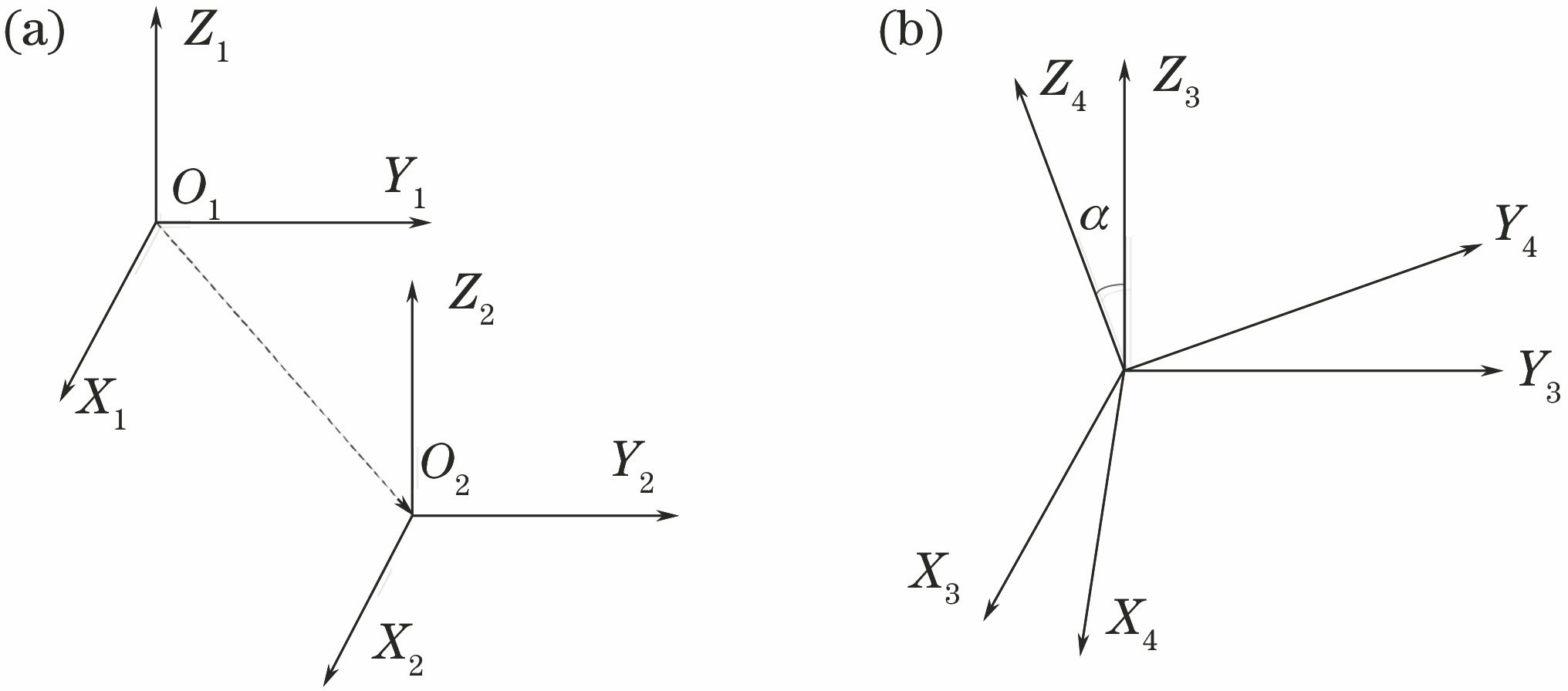

图 2. 车体坐标变换示意图。(a)车体平移运动;(b)车体旋转运动

Fig. 2. Schematics of vehicle body coordinate transformation. (a) Translational motion of vehicle body; (b) rotation motion of vehicle body

3 激光雷达运动补偿算法

激光雷达运动补偿问题涉及到车体位姿在平移与旋转方面的变化,在求解方程时需要将旋转矩阵参数化。常用的方法有以下三种,如

表 1. 转换矩阵参数化方法优缺点比较

Table 1. Comparison of advantages and disadvantages of transformation matrix parameterization methods

|

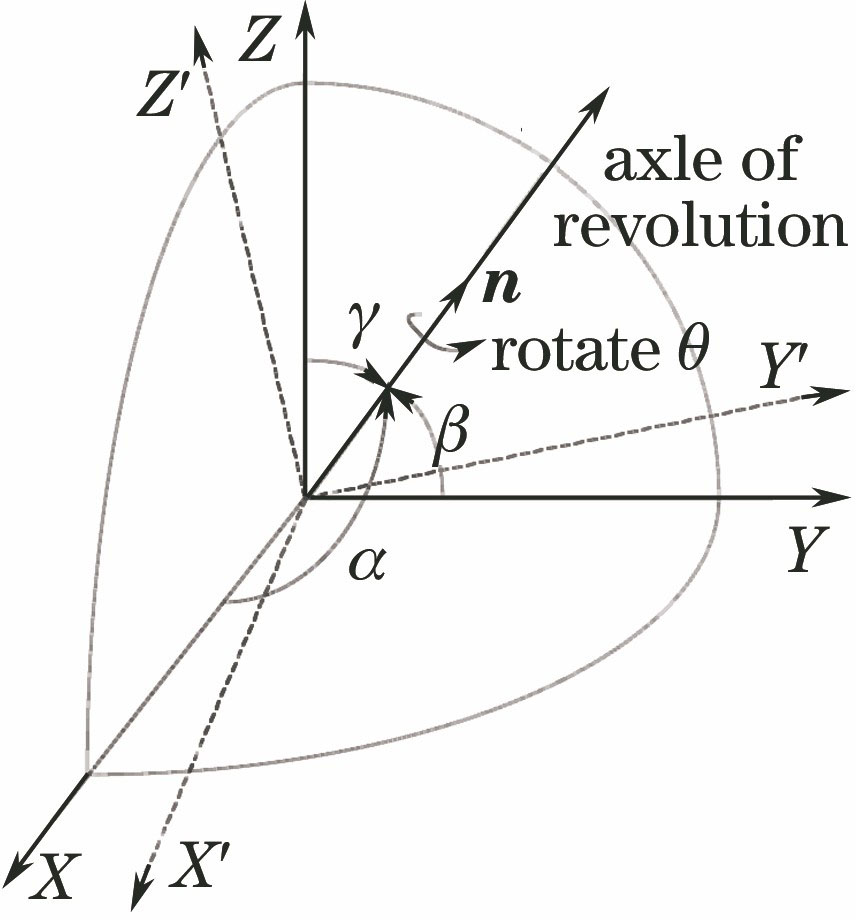

3.1 四元数法

欧拉定理指出,刚体即载体坐标系相对于参考坐标系XYZ的旋转可以由绕固定轴旋转的方向角θ表示,并且用旋转角的方向余弦定义了旋转方向。

图 3. 相对于参考坐标系的四元数的空间描述

Fig. 3. Spatial description of quaternion relative to reference coordinate system

四元数法是用4个参数表示旋转矩阵的[13],定义为

式中:θ=

式中:

式中:ω=

如果某时刻的四元数已知,旋转矩阵R就可以由以下的关系式直接得到:

在由一系列过程得到的姿态角确定初始矩阵之后,四元数的初始值的计算式可表示为

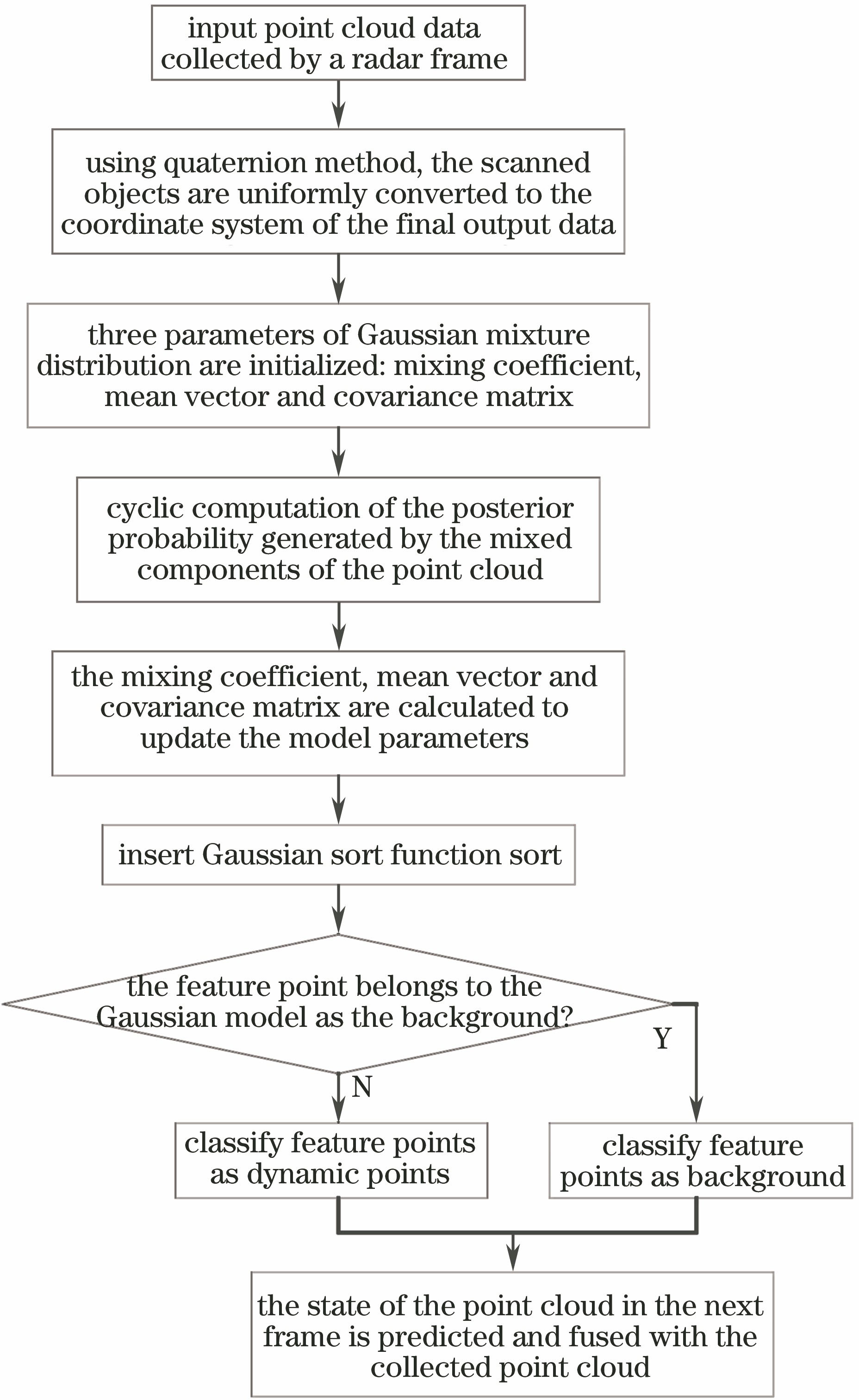

3.2 基于高斯混合模型改进的运动补偿算法

自主车运动时激光雷达采集的数据参考坐标系不一致,时间与运动距离的不同使得不接近的数据集间的空间关联性较小。高斯混合模型在动态场景下工作性能差但在静态场景下建模性能良好,所以首先通过运动补偿将动态背景转换为静态背景,再用高斯混合模型对时间列表中所有历史帧进行处理。

运动补偿重点是利用历史帧点云数据预测下一帧数据,实现对下一帧点云数据的补偿。改进的运动补偿算法流程图如

图 5. 基于高斯混合模型改进的激光雷达运动补偿伪代码

Fig. 5. Improved lidar motion compensation pseudo-code based on Gaussian mixture model

4 实验结果及分析

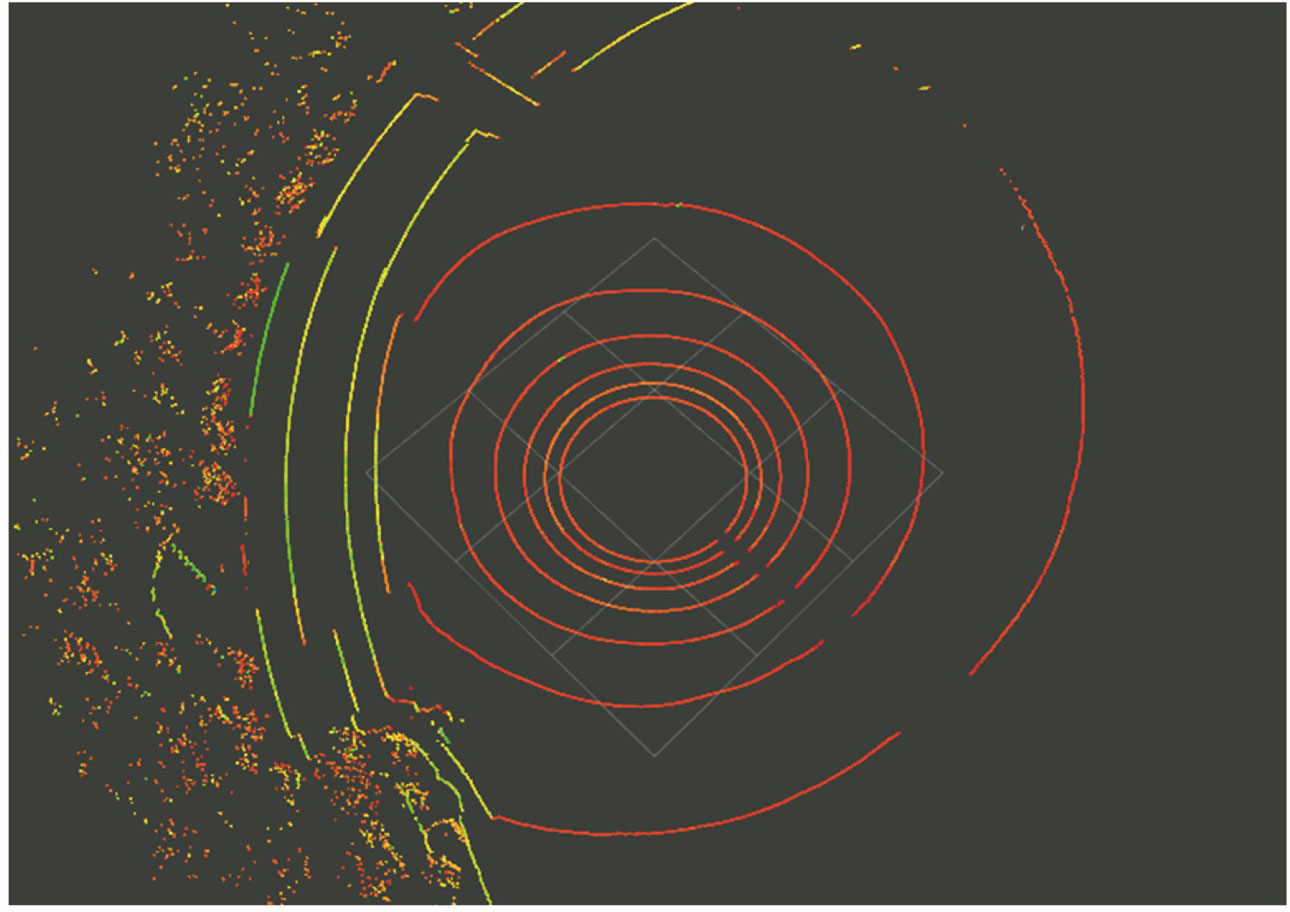

为了证明所提方法的有效性,对户外数据集进行了实验验证。激光雷达及GPS安装在特定的支架上,如

汽车以10~15 km·h-1的速度行驶在上海司南卫星导航技术股份有限公司附近的道路上,基于此,进行实验数据采集,选取车流量较少的时间满足城市交通道路的环境。

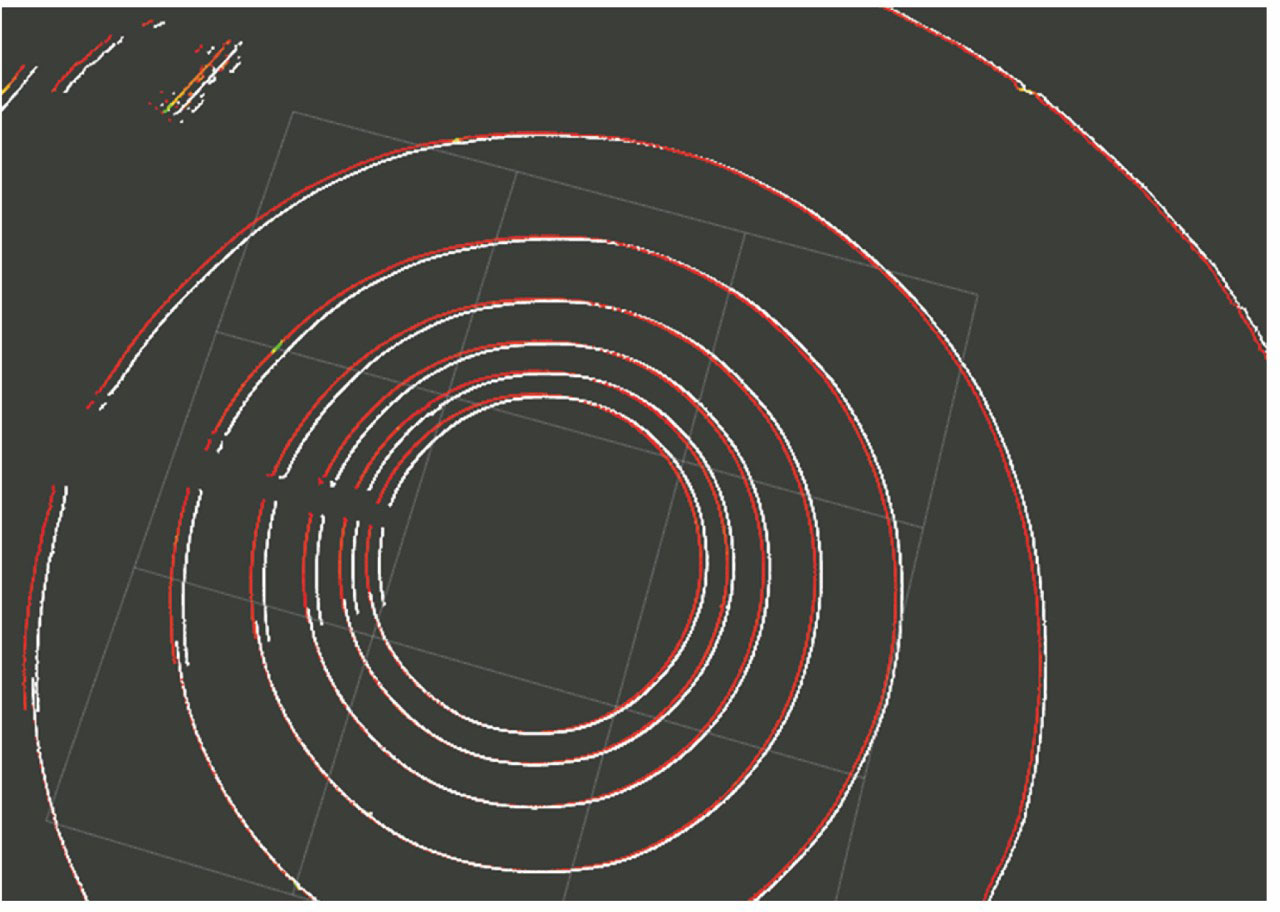

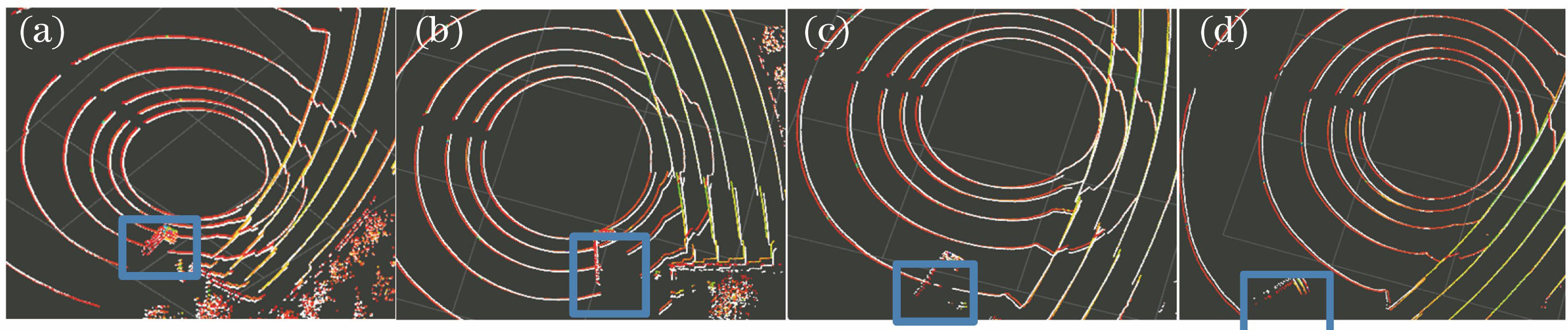

图 9. 汽车交通路口转弯时的运动补偿结果

Fig. 9. Motion compensation results when vehicle turns at traffic intersection

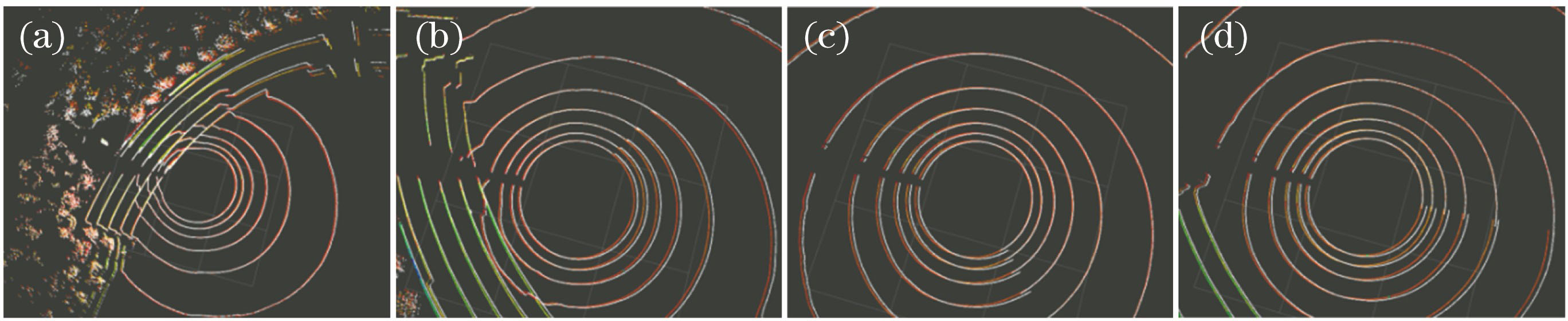

图 10. 有汽车进入运动补偿区域时的运动补偿结果

Fig. 10. Motion compensation results when vehicle enters the motion compensation area

5 结论

本文基于激光雷达提出一种基于高斯混合模型改进的运动补偿算法,由于高斯混合模型容易在动态场景下失效,因此首先通过四元数法将激光雷达扫描到的一帧数据统一转换到最终输出点云的那个坐标系下,再利用高斯混合模型对时间T列表中所有历史帧进行处理,将特征点与当前帧中符合的点相匹配进一步细化点在当前帧中的新位置,根据特征点预测出下一帧点云的状态实现运动补偿。实验结果表明,该方法具有良好的运动补偿性能,可以应用在运动目标的实时检测中。但是行驶速度过快时,检测到的物体的轮廓容易模糊,因此仍需要进一步优化。

[1] Lipton AJ, FujiyoshiH, Patil RS. Moving target classification and tracking from real-time video[C]∥Proceedings of the 4th IEEE Workshop on Applications of Computer Vision (WACV'98), October 19-21, 1998, Princeton, NJ, USA. New York: IEEE, 1998: 8- 14.

[2] HwangJ, OoiY, OzawaS. A visual feedback control system for tracking and zooming a target[C]∥Proceedings of the 1992 International Conference on Industrial Electronics, Control, Instrumentation, and Automation, November 13-13, 1992, San Diego, CA, USA. New York: IEEE, 1992: 740- 745.

[3] Murray D, Basu A. Motion tracking with an active camera[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1994, 16(5): 449-459.

[4] Odobez JM, BouthemyP. Detection of multiple moving objects using multiscale MRF with camera motion compensation[C]∥Proceedings of 1st International Conference on Image Processing, November 13-16, 1994, Austin, TX, USA. New York: IEEE, 1994: 257- 261.

[5] Cucchiara R, Grana C, Piccardi M, et al. Detecting moving objects, ghosts, and shadows in video streams[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25(10): 1337-1342.

[6] BehradA, ShahrokniA, Motamedi SA, et al. A robust vision-based moving target detection and tracking system[C]∥The Proceeding of Image and Vision Computing Conference, July 7-14, 2001, Vancouver, British Columbia, Canada. New York: IEEE, 2001.

[7] Elhabian S Y. El-Sayed K M, Ahmed S H. Moving object detection in spatial domain using background removal techniques-state-of-art[J]. Recent Patents on Computer Science, 2008, 1(1): 32-34.

[8] IlasC. Electronic sensing technologies for autonomous ground vehicles: a review[C]∥2013 8th International Symposium on Advanced Topics in Electrical Engineering(ATEE), May 23-25, 2013, Bucharest, Romania. New York: IEEE, 2013: 13778638.

[9] TeichmanA, LevinsonJ, ThrunS. Towards 3D object recognition via classification of arbitrary object tracks[C]∥2011 IEEE International Conference on Robotics and Automation, May 9-13, 2011, Shanghai, China. New York: IEEE, 2011: 4034- 4041.

[10] HeldD, LevinsonJ, ThrunS. A probabilistic framework for car detection in images using context and scale[C]∥2012 IEEE International Conference on Robotics and Automation, May 14-18, 2012, Saint Paul, MN, USA. New York: IEEE, 2012: 1628- 1634.

[11] AzimA, AycardO. Detection, classification and tracking of moving objects in a 3D environment[C]∥2012 IEEE Intelligent Vehicles Symposium, June 3-7, 2012, Alcala de Henares, Spain. New York: IEEE, 2012: 802- 807.

[12] KaestnerR, MayeJ, PilatY, et al. Generative object detection and tracking in 3D range data[C]∥2012 IEEE International Conference on Robotics and Automation, May 14-18, 2012, Saint Paul, MN, USA. New York: IEEE, 2012: 3075- 3081.

[13] 埃博尔梅德·纽若丁, 塔什芬·卡拉麦特, 雅克·乔治. 惯性导航、卫星定位及其组合的基本原理[M]. 黄卫权, 赵琳, 译. 北京: 国防工业出版社, 2017.

NoureldinA, Karamat TB, GeorgyJ. Fundamentals of inertial navigation, satellite-based positioning and their integration[M]. Huang W Q, Zhao L, Transl. Beijing: National Defense Industry Press, 2017.

庞正雅, 周志峰, 王立端, 叶珏磊. 基于激光雷达的运动补偿方法[J]. 激光与光电子学进展, 2020, 57(2): 021106. Pang Zhengya, Zhou Zhifeng, Wang Liduan, Ye Juelei. Motion Compensation Method Based on Lidar[J]. Laser & Optoelectronics Progress, 2020, 57(2): 021106.