基于分层墨卡托投影的激光雷达点云数据局部特征描述  下载: 885次

下载: 885次

1 引言

激光雷达通过采集反射点的距离获取三维(3D)目标的表面形状、邻域、结构等信息,利用激光雷达点云数据进行目标检测、识别、匹配的关键是提取点云的特征描述。对点云的特征描述可以分为全局特征描述和局部特征描述两类,全局特征描述是用一组特征向量描述整体点云的几何特性[1-3];局部特征描述则是通过一组向量对关键点周围的邻域关系、结构信息[3]、统计信息[4]进行特征描述。相比全局特征描述,点云的局部特征描述不需要将目标点云从场景中分割出来,对杂乱和被遮挡的点云数据鲁棒性更好,得到了广泛应用。

局部特征描述的优劣取决于局部特征描述子的选取,现有的局部特征描述子可分为手工提取的特征描述子和基于学习的特征描述子。基于学习的特征描述子,通过海量点云数据和标签对神经网络的权值进行训练。Simo-Serra等[8]提出了基于多个视角图像训练网络的方法,但由于三维模型的视角太多,网络不能获得所有视角下的方位信息。Charles等[9-10]提出的PointNet和PointNet++直接将点云作为神经网络的输入。随后人们提出的3DMatch[11]、紧凑几何特征(CGF)[12]、FoldNet[13]、和3Dfeat-Net[14]等都借助PointNet[9]模块,直接将点云作为数据输入,从而实现特征提取、模型匹配、目标检测与识别等工作,但这些基于神经网络提取的特征也存在不足,如特征向量的可解释性不强、关键点周围的邻域结构信息和邻域点内部的相关性被破坏、需要大量有标签的训练样本。

手工特征描述子通过提取局部点云的几何结构特征完成特征描述,如Spin image[3]、点特征直方图(PFH)[2]、旋转投影统计量描述子[4]以及局部特征统计直方图[13]。无论是点云的体素化方法还是局部坐标投影方法,都会使局部点的相对关系和结构信息发生畸变。因此,本文提出了一种基于分层墨卡托投影的局部点云特征描述子,可在有效提取邻域局部结构信息的同时,将特征点附近的相对几何关系较小失真地投影到墨卡托特征平面上,以获得特征点附近的结构信息。

2 分层墨卡托投影方法

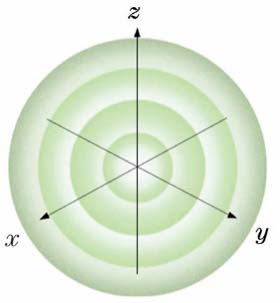

通常采用体素栅格化或多视角平面投影的方式[4]提取激光雷达的点云数据局部特征,但这些方法会损失邻近点之间的相对关系和结构信息。墨卡托投影方法是一种等角正轴圆柱形投影,该方法假设地球被一个中空的圆柱包裹,且圆柱与地球赤道相切。在地球中心放置一个无向光源,可将地球上的任意位置投影到圆柱体上,形成一个圆柱体表面空间,再将该表面展开成二维平面坐标系。该方法通过坐标变换实现三维坐标向二维坐标的转换,能保证点与点之间的角度关系。

2.1 墨卡托投影

墨卡托投影只对球内和球表面各点对于球心的经纬度进行投影,损失了径向距离信息,墨卡托投影的正解可表示为

式中,a为椭圆长轴,b为椭圆短轴,e为椭圆偏心率,ϕ0为初始纬度,λ0为初始经度,ϕ为纬度,λ为经度,XM、YM为球经过墨卡托投影后的横、纵坐标,K为卯酉圈曲率半径。

若将待投影面看作标准的球面,即a=b=1,e=0,ϕ0=λ0=0,则墨卡托平面坐标与标准球内点的经纬度关系可表示为

2.2 局部参考坐标系

局部参考坐标系位于三维表面,且独立于三维视觉中的原始坐标系,广泛应用于三维局部特征的描述,可得到旋转不变的三维空间信息。性能好的局部参考坐标必须具备的两个性质:1)基于该局部参考坐标下的特征描述具有刚体旋转不变性,即该局部参考坐标系独立于全局坐标系;2)在支撑域内能保证空间关系和几何信息无损失。实验使用文献[ 16]提出的局部参考系构建方法,通过分解K近邻的相对距离互相关矩阵M的特征值,对局部法向量进行总体最小二乘(TLS)估计,M可表示为

式中,k为邻域点的个数,pi为第i个邻域点的位置,

式中,p为特征点坐标,R为局部邻域半径,di=

特征向量法虽然能解决局部参考坐标的尺度问题,但其符号的可重复性仍需要进一步讨论。为了消除符号模糊,实现局部参考坐标的可重复性,通过对比x轴和z轴上的两个统计量定义,得到去模糊的x轴为

式中,x+为特征值分解得到的正向特征向量坐标,∧为并逻辑运算,x-为其对应的相反向量坐标,

2.3 分层墨卡托投影

由(2)式可知,传统的墨卡托投影将邻域内的点根据其经纬度投影到同一墨卡托平面上,但忽略了邻域内各点与特征点之间的径向结构关系。投影后得到的是经纬度相近但径向距离差较大的关键点,直接对特征点邻域进行墨卡托投影难以区分这两个关键点,因此需按照相对径向距离进行分层墨卡托投影,如

可将(2)式重新定义为

式中,r为邻域内某点与特征点的径向距离。第i个邻域点的墨卡托坐标(

式中,N为分层墨卡托投影的总层数,R0为局部球形邻域的半径,n为当前投影面的层数,λi为第i个邻域点的方位角,其值域为[-π,π],ϕi为第i个邻域点的俯仰角,其值域为[-π/2,π/2],ri为第i个邻域点与邻域中心的径向距离。

2.4 局部特征参数化

经N层墨卡托投影后的局部点云具有N个特征平面,每个特征平面上都有一组点分布,点云的局部特征参数化,就是将N个特征平面上的点进行参数化表示。将每个特征平面划分成尺寸为l×l的网格,统计每个网格中落入的邻域点数。根据每层落到墨卡托平面上点的总数对每次统计量进行归一化,得到N×l×l的特征分布直方图,

3 实验结果

为了验证基于分层墨卡托投影的激光雷达点云局部特征描述子的鉴别力及对噪声的鲁棒性,分别在斯坦福Bologna数据集[19]和3DMatch数据集[11]上进行了5组实验。用精确率与召回率曲线(PRC)作为局部特征描述子鉴别力的评价标准,其平均精度可通过计算PRC的曲线线下面积(AUC)[4]得到,PRC的绘制过程如下。

1) 从场景和模型中提取关键点,并按照所选特征提取所有关键点的特征。

2) 在模型关键点的特征中找到与每个场景的关键点特征

式中,τ为给定的特征相似度门限,如果两个特征满足(8)式,则认为两组特征点匹配[20]。

3) 考察

式中,Ncm为正确匹配点的个数,Nmf为特征匹配点的个数,Ncf为模型场景之间对应特征点的个数,

Bologna数据集包含六个来自Stanford 3D Scanning Repository[19]的模型和45个由原始模型进行旋转、平移等刚性变换后得到的场景;3DMatch数据集包含8组由RGB-D(Red, Green, Blue-depth)相机重建的场景模型。Bologna数据集和3DMatch数据集[11]都包含多个不同角度观测的同一场景和物体数据。为了验证特征描述子的准确性,应对同一目标的不同角度进行测试实验。

以两个数据集为基础,测试分层墨卡托投影的投影层数对分辨性能的影响,并将20层分层墨卡托投影得到的局部特征描述子(HMec-20)与方向直方图签名(SHOT)[16]、旋转投影统计(RoPS)[4]、多属性统计直方图(MaSH)[8]、三重正交局部深度图(Toldi)[13]等手工局部几何特征描述子进行对比,分析了不同特征描述子对噪声和点云稀疏程度的鲁棒性。实验环境:CPU为2.2 GHz的Core i7-8750H, RAM为8 GB, 计算机系统为64-bit Microsoft Windows10,软件为Matlab。

3.1 分层墨卡托投影特征层数对识别性能的影响

理论上,局部特征的精细度和识别性能随层数的增加而增加,但随着分层投影面的增加,对邻域的划分越细致,算法对噪声的鲁棒性会逐渐下降,导致算法的分辨力减弱。实验数据的噪声方差为0.3倍点云分辨率,局部邻域的支撑半径为50倍点云分辨率,每层划分成尺寸为3×3的直方图网格,根据本算法分别绘制了层数为1、3、5、10、20、30、50、100的PRC,如

图 4. 墨卡托投影层数对算法识别性能的影响(Bologna数据集)

Fig. 4. Influence of the number of Mercator projection layers on the recognition performance of the algorithm (Bologna dataset)

表 1. 分层墨卡托特征提取的运算时间和平均精度(Bologna数据集)

Table 1. Runtime and average precision of hierarchical Mercator projection (Bologna dataset)

|

由

在3DMatch数据集上再次进行上述实验,得到1,3,5,10,20,30层的分层墨卡托投影特征的PCR如

图 5. 墨卡托投影层数对算法识别性能的影响(3DMatch数据集)

Fig. 5. Influence of the number of Mercator projection layers on the recognition performance of the algorithm (3DMatch dataset)

表 2. 分层墨卡托特征提取的运算时间和平均精度(3DMatch数据集)

Table 2. Runtime and average precision of hierarchical Mercator projection (3DMatch dataset)

|

3.2 分层墨卡托投影特征对噪声的鲁棒性

为分析该算法对噪声的鲁棒性,在Bologna数据集点云模型上分别添加方差为0.3、0.5、0.8、1.5倍点云分辨率的高斯白噪声,并计算MaSH[8]、局部特征统计量直方图(LFSH)[3]、SDASS(Statistic of deviation angles on subdivided space)[12]、DLFS(Divisional local feature statistics)[15]、SHOT[16]、RoPS[4]、TriSI(Tri-Spin-Image)[20]、Toldi[13]、Sgh1(Spatial and geometric histogram)[18]以及HMec-20特征描述子的PRC,如

图 6. 不同特征提取算法的PRC。(a)噪声方差为0.3倍点云分辨率;(b) 噪声方差为0.5倍点云分辨率;(c) 噪声方差为0.8倍点云分辨率;(d) 噪声方差为1.5倍点云分辨率

Fig. 6. PRC of different feature extraction algorithms. (a) Noise variance is 0.3 times point cloud resolution; (b) noise variance is 0.5 times point cloud resolution; (c) noise variance is 0.8 times point cloud resolution; (d) noise variance is 1.5 times point cloud resolution rate

表 3. 不同特征提取算法的平均精度和运算时间

Table 3. Average accuracy and operation time of different feature extraction algorithms

| ||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

由

4 结论

使用分层墨卡托投影提取激光雷达点云数据的局部特征和几何特征,并对点云进行具有鲁棒性的特征描述。在斯坦福Bologna和3DMatch数据集上的实验结果表明,本算法能充分保留并提取点云数据的局部邻域结构信息和几何信息,特征描述性能更优异,为三维点云配准、模型重建、目标识别提供了一种有效的局部特征描述方法。

[1] AldomaA, VinczeM, BlodowN, et al. CAD-model recognition and 6DOF pose estimation using 3D cues[C]∥2011 IEEE International Conference on Computer Vision Workshops (ICCV Workshops), November 6-13, 2011, Barcelona, Spain. New York: IEEE, 2011: 585- 592.

[2] Rusu RB, BradskiG, ThibauxR, et al. Fast 3D recognition and pose using the viewpoint feature histogram[C]∥2010 IEEE/RSJ International Conference on Intelligent Robots and Systems, October 18-22, 2010, Taipei, Taiwan, China. New York: IEEE, 2010: 2155- 2162.

[5] 胡佳贝, 刘喆, 张鹏飞, 等. 基于离散Morse理论的散乱点云特征提取[J]. 光学学报, 2019, 39(6): 0615002.

[6] 刘剑, 白迪. 基于特征匹配的三维点云配准算法[J]. 光学学报, 2018, 38(12): 1215005.

[7] 任前程. 一种点云特征线提取方法[J]. 激光与光电子学进展, 2019, 56(6): 062803.

[8] Simo-SerraE, TrullsE, FerrazL, et al. Discriminative learning of deep convolutional feature point descriptors[C]∥2015 IEEE International Conference on Computer Vision (ICCV), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 118- 126.

[9] Charles RQ, SuH, KaichunM, et al. PointNet: deep learning on point sets for 3D classification and segmentation[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 77- 85.

[10] Qi CR, YiL, SuH, et al. PointNet++: deep hierarchical feature learning on point sets in a metric space[EB/OL]. [2020-04-20].https: ∥arxiv.org/abs/1706. 02413.

[11] ZengA, Song SR, NießnerM, et al. 3DMatch: learning local geometric descriptors from RGB-D reconstructions[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 199- 208.

[12] KhouryM, Zhou QY, KoltunV. Learning compact geometric features[C]∥2017 IEEE International Conference on Computer Vision (ICCV), October 22-29, 2017, Venice, Italy. New York: IEEE, 2017: 153- 161.

[13] Yang YQ, FengC, Shen YR, et al. FoldingNet: point cloud auto-encoder via deep grid deformation[C]∥2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition, June 18-23, 2018, Salt Lake City, UT, USA. New York: IEEE, 2018: 206- 215.

[14] Yew ZJ, Lee GH. 3DFeat-Net: weakly supervised local 3D features for point cloud registration[M] ∥Ferrari V, Hebert M, Sminchisescu C, et al. Computer Vision-ECCV 2018. Lecture Notes in Computer Science. Cham: Springer, 2016, 11219: 630- 646.

[15] Zhao B, Xi J T. Efficient and accurate 3D modeling based on a novel local feature descriptor[J]. Information Sciences, 2020, 512: 295-314.

[16] TombariF, SaltiS, StefanoL. Unique signatures of histograms for local surface description[M] ∥Daniilidis K, Maragos P, Paragios N, et al. Computer Vision-ECCV 2010. Lecture Notes in Computer Science. Berlin, Heidelberg: Springer, 2010, 6313: 356- 369.

[17] NovatnackJ, NishinoK. Scale-dependent/invariant local 3D shape descriptors for fully automatic registration of multiple sets of range images[M] ∥Forsyth D, Torr P, Zisserman A, et al. Computer Vision-ECCV 2008. Lecture Notes in Computer Science. Berlin, Heidelberg: Springer, 2008, 5304: 440- 453.

[18] SunY, Abidi MA. Surface matching by 3D point's fingerprint[C]∥Proceedings Eighth IEEE International Conference on Computer Vision, ICCV 2001, July 7-14, 2001, Vancouver, BC, Canada. New York: IEEE, 2001: 263- 269.

[19] LevoyM, GerthJ, CurlessB, et al. ( 2005-05-07)[2020-04-25]. http: ∥graphics.stanford.edu/data/3Dscanrep/.

[20] GuoY, Sohel FA, BennamounM, et al. TriSI: a distinctive local surface descriptor for 3D modeling and object recognition[C]∥Conference 8th International Joint Conference on Computer Vision, Imaging and Computer Graphics Theory and Applications, February 21-24, 2013, Barcelona, Spain. Barcelona, Spain: Scitepress, 2013, 1: 86- 93.

Article Outline

顾尚泰, 王玲, 马燕新, 马超. 基于分层墨卡托投影的激光雷达点云数据局部特征描述[J]. 光学学报, 2020, 40(20): 2015001. Shangtai Gu, ling Wang, Yanxin Ma, Chao Ma. Local Feature Description of LiDAR Point Cloud Data Based on Hierarchical Mercator Projection[J]. Acta Optica Sinica, 2020, 40(20): 2015001.