变焦显微成像三维测量算法性能分析  下载: 1034次

下载: 1034次

1 引言

复杂物体三维轮廓测量一直是几何量测量中的一个难题,具有代表性的机械探针轮廓仪适合测量相对平坦的大结构,对于复杂结构的微加工零件适应性差,同时,机械探针与被测表面接触时,存在一定的应力,针尖容易划伤被测表面,或被硬质表面磨损。当测头探针直径大于0.5 mm时,广泛使用的三坐标测量(CMM)也不适合用于微型器件测量,而且测量力大,容易造成被测件变形[1]。微纳米级分辨率且体积微型化的三维坐标测量机(Nano-CMM)非常适合微小器件外形的测量,但其不是最优的选择,因为一般的Nano-CMM测头大多基于传统的CMM测头小型化得到,其性能在很大程度上决定了Nano-CMM的测量精度,特别是当零件具有陡峭的侧壁、很窄的沟槽以及微米级曲率半径形状和棱边时,Nano-CMM测头受到机械干涉所产生的限制就变得非常明显[2],另外,细小的测杆刚度也是影响测量精度的主要瓶颈[3]。

利用超短显微焦深成像的测量技术,在复杂器件三维测量方面具有很大的优势。利用超短显微焦深实现复杂轮廓测量的仪器有自动聚焦扫描显微镜、共焦扫描显微镜、光学夸焦显微镜和光学变焦显微镜等。其中变焦显微技术不仅可以实现超大景深复杂几何结构微器件的三维测量,而且可以实现真彩色三维重构,用于物体外形轮廓(如生物样本、昆虫等)的高清晰真彩色可视化,因此,在复杂结构物体三维测量中具有很好的应用前景。

超景深变焦显微测量技术利用大数值孔径光学系统的有限景深和垂直扫描方法,实现复杂器件三维形貌真彩色测量。具体而言,其通过寻找被测样品各个测量点的最佳焦点位置得到每个测量点的深度和色彩信息,从而得到被测物体的真彩色三维表面形貌。变焦测量技术起源于shape from focus(SFF)[4],2008年,Sahay等[5]把SFF方法扩展应用到聚焦图像并获取深度剖面图,但该方法易受表面纹理的影响,在光滑区域易产生错误的深度估计[6],主要原因是聚焦评价与焦点位置估计精度易受光照和表面特性的影响;2010年,Muhammad等[7]通过修正特定帧数的像素强度值,计算初始深度图,提出了贝塞尔曲面逼近法,获得了较好的重复性和精度;同年,Alicona公司(奥地利)推出了一款全自动变焦三维表面测量仪(http://www.alicona.com/),其在深度方向连续垂直扫描并采用先进的图像处理技术,能够重构出被测物体完整的三维形貌,并实现对物体的粗糙度、倾斜度等几何参数的测量[8]。近十来年,计算机技术和图像处理技术发展迅速,基于该方法的复杂三维轮廓测量展现出巨大潜力。

超景深变焦显微三维测量方法中的主要关键技术有超短景深变焦光学成像方法,成像中的位移焦点的评价方法与准确快速并行搜索算法,真彩色三维形貌数据建模、显示、分析与评价方法等。近年来,学者们在这些关键技术与算法方面开展了深入研究。本文系统总结了超景深变焦显微三维测量方法的工作过程,重点对聚焦评价函数、焦点搜索方法和图像序列融合与三维重构方法的性能进行了比较分析和研究,并进行了实验验证,给出了在不同表面情况下算法上的注意事项。

2 变焦超景深显微三维测量原理

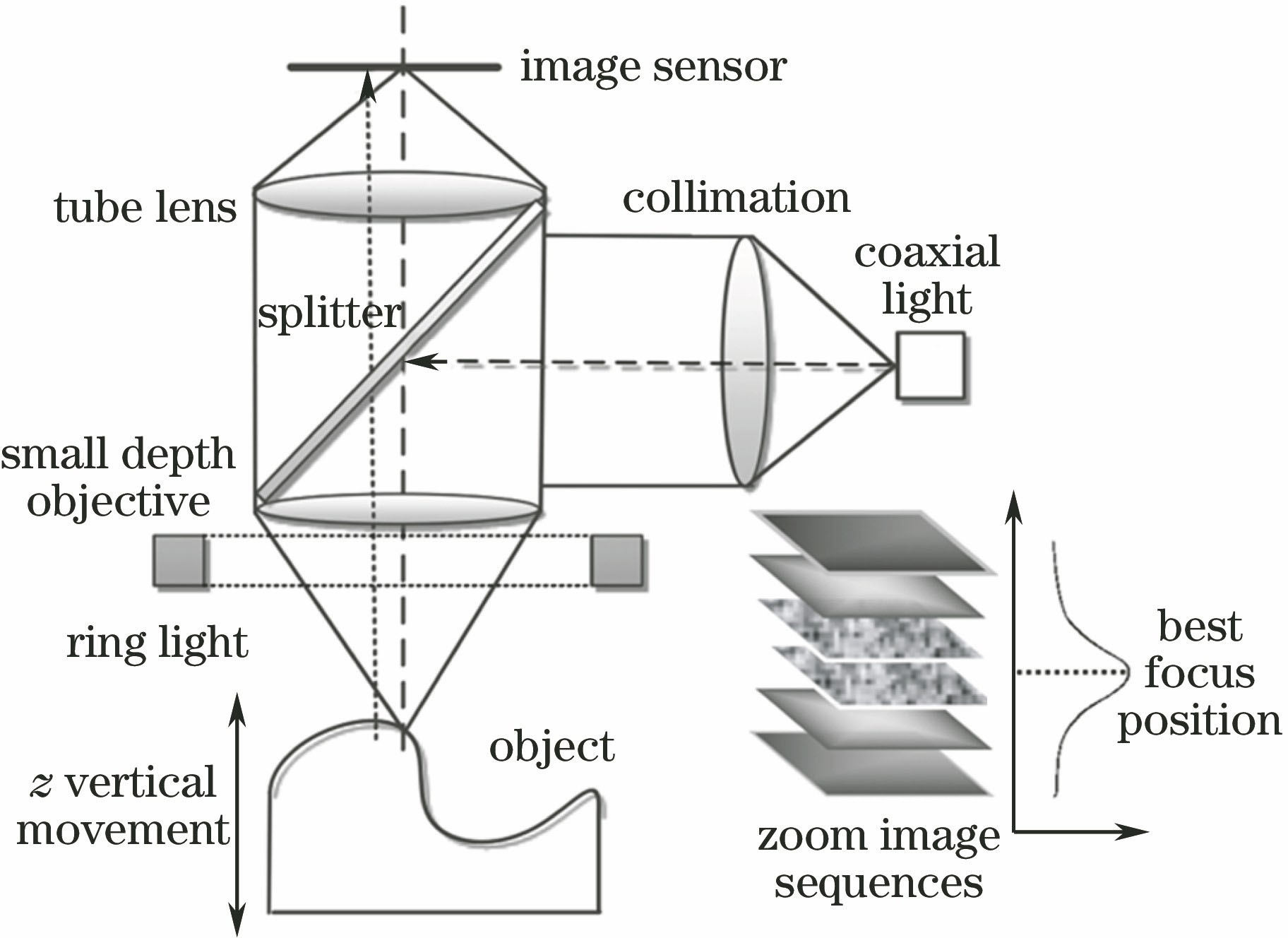

通过变焦扫描成像实现三维测量的基本原理如

所以在每次移动位置后,只有一部分表面点,即焦平面与不透明物体轮廓的交线(类似于等高线)微小区域处于聚焦位置时,能在图像传感器上聚焦清晰,其他表面点根据离聚焦平面的距离呈现为不同程度的离焦状态,具有不同的清晰度。在一次完整的测量过程中,使

3 评价方法

3.1 聚焦评价方法

从

聚焦评价的对象是被测物体经物镜后在传感器上所成的像,被测物体可以看成许多点光源的集合,其所成的像可以看作点光源成像的线性叠加,把相机对点光源的响应称为相机的点扩展函数(PSF)。对于被测物点(

当物体处于离焦状态时,其所成像为弥散圆(半径

式中

由于存在衍射和光学系统畸变,常使用二维高斯PSF表示弥散斑大小,即

式中

式中

式中:

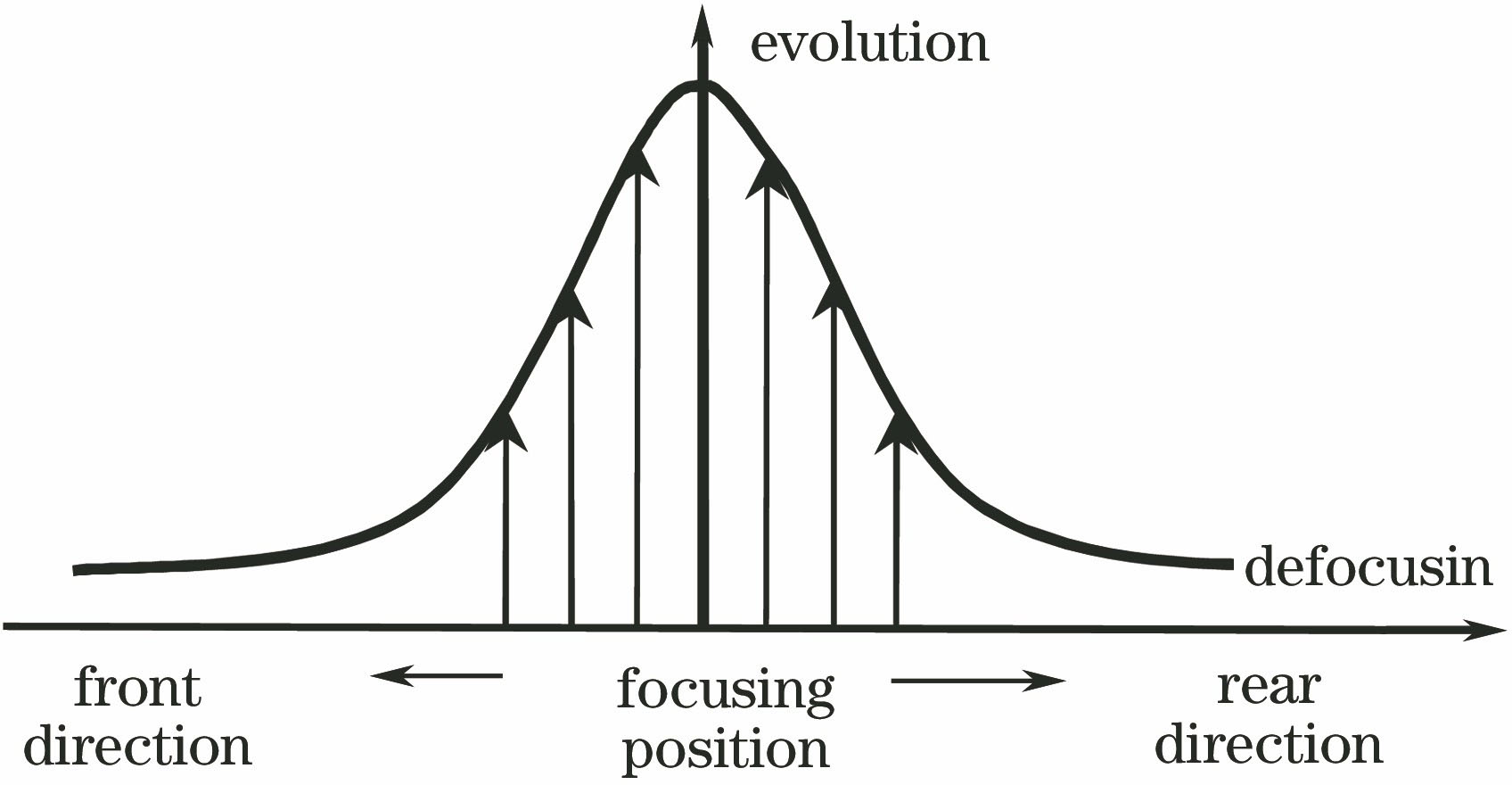

聚焦评价的准则是评价函数-对图像清晰度的一个量化评价依据,判断物体是否精确对焦,聚焦评价函数的好坏直接影响三维重建的效果。当物体精确对焦时,图像边缘非常清晰,图像灰度对比度强,可以看到很多细节部分,反映到频域中就是图像高频分量很多。如

常用的聚焦评价函数可分为空域聚焦评价函数、频域聚焦评价函数、信息学评价函数和统计学评价函数等[11]。

1) 空域评价函数。空域评价函数对图像灰度进行直接处理,当图像清晰聚焦时,图像细节丰富,具有十分清晰的边缘和轮廓,对比度较大;而图像模糊时,细节损失严重,对比度较小。而梯度算子具有旋转不变性和各向同性,可以突出图像中的边缘和各个方向的细节,因此可以把图像灰度的梯度幅值作为是否聚焦的判据。常用的梯度聚焦评价函数有Brenner函数、Roberts函数、Laplace函数、扩展的八方向Sobel函数、Tenengrad函数、梯度平方函数和SMD函数等。

2) 频域评价函数。频域评价函数将所采集图像变换到频域进行处理,图像聚焦程度越大,图像越清晰,所含的高频分量越多;反之,图像离焦程度越大,图像越模糊,所含的高频分量越少,故通过变换后,由高频分量可以判断图像聚焦程度。常用的聚焦评价函数有离散傅里叶变换(DFT)、离散余弦变换(DCT)和离散小波变换(DWT)等。

3) 信息熵函数。从信息学的角度来说,聚焦图像边缘锐化,细节清晰,包含的信息更多。图像越清晰,灰度值变化越大,信息熵越大,包含的信息量越大。故可以通过信息熵函数评价图像的聚焦程度。

4) 统计学评价函数。利用小范围内像素灰度方差作为评价结果,图像越清晰,包含的灰度变化越多,方差值越大,图像越模糊,方差值越小。

上述聚焦评价函数大多从自动对焦研究领域应用到变焦测量研究领域[12],两者不同之处在于:自动对焦不需要研究每个像素点的聚焦程度,其专注于大范围内聚焦的好坏,只需要一个聚焦评价值即可判断最佳的成像位置,而变焦测量需要计算出每一个像素点的聚焦评价值,并判断每个像素点的最佳成像位置。

3.2 聚焦评价函数

聚焦评价函数有几十种,也有文献对各种评价函数的性能进行对比研究[13],但基本上是从大视场SFF的角度进行比较,与本文研究的变焦显微三维测量情况不同,因为SFF中单幅图像的焦深比后者大得多,单幅图像中有比较大的区域范围处于有效焦深范围内,而变焦显微三维测量中焦深只有微米量级,单幅图像中只有在物方焦平面与被测物体表面相截的微米量级区域内图像清晰,其他点则呈现出不同程度的模糊。也就是说,一幅图像中清晰区域类似于物体在高度方向等高线,清晰的像素非常少,因此聚焦评价函数受到的干扰大,在SFF中性能表现好的聚焦评价函数在变焦显微三维测量场合不一定效果好,因此需要根据具体情况选择聚焦评价函数。

进行聚焦评价时,首先需要考虑的是采用单点像素值进行聚焦评价,还是在每个像素点处取一个小区域,利用单点像素的邻域像素,获取更多的信息进行聚焦评价。

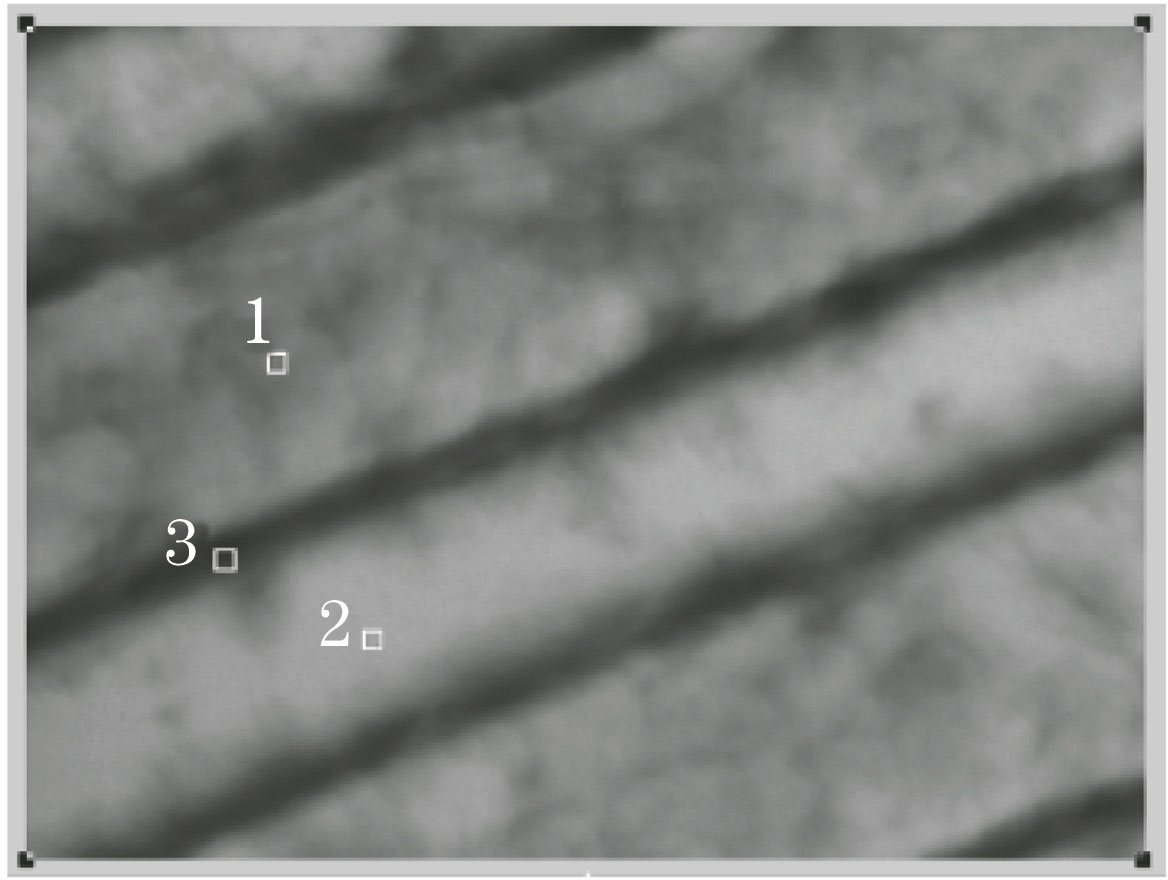

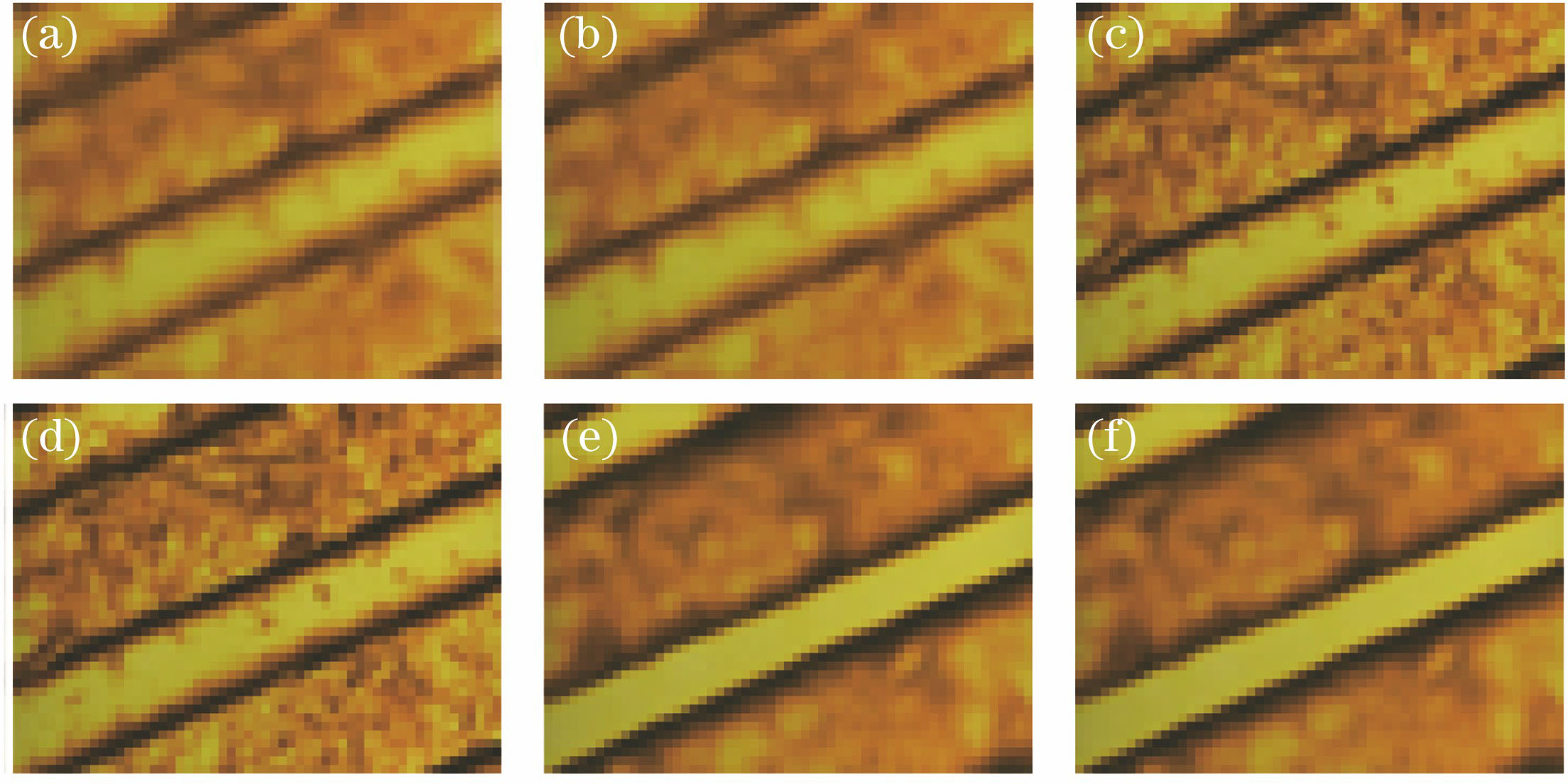

图 3. 变焦显微实验图像与三个测试点

Fig. 3. An experimental image obtained using focus variation microscopy and three testing points

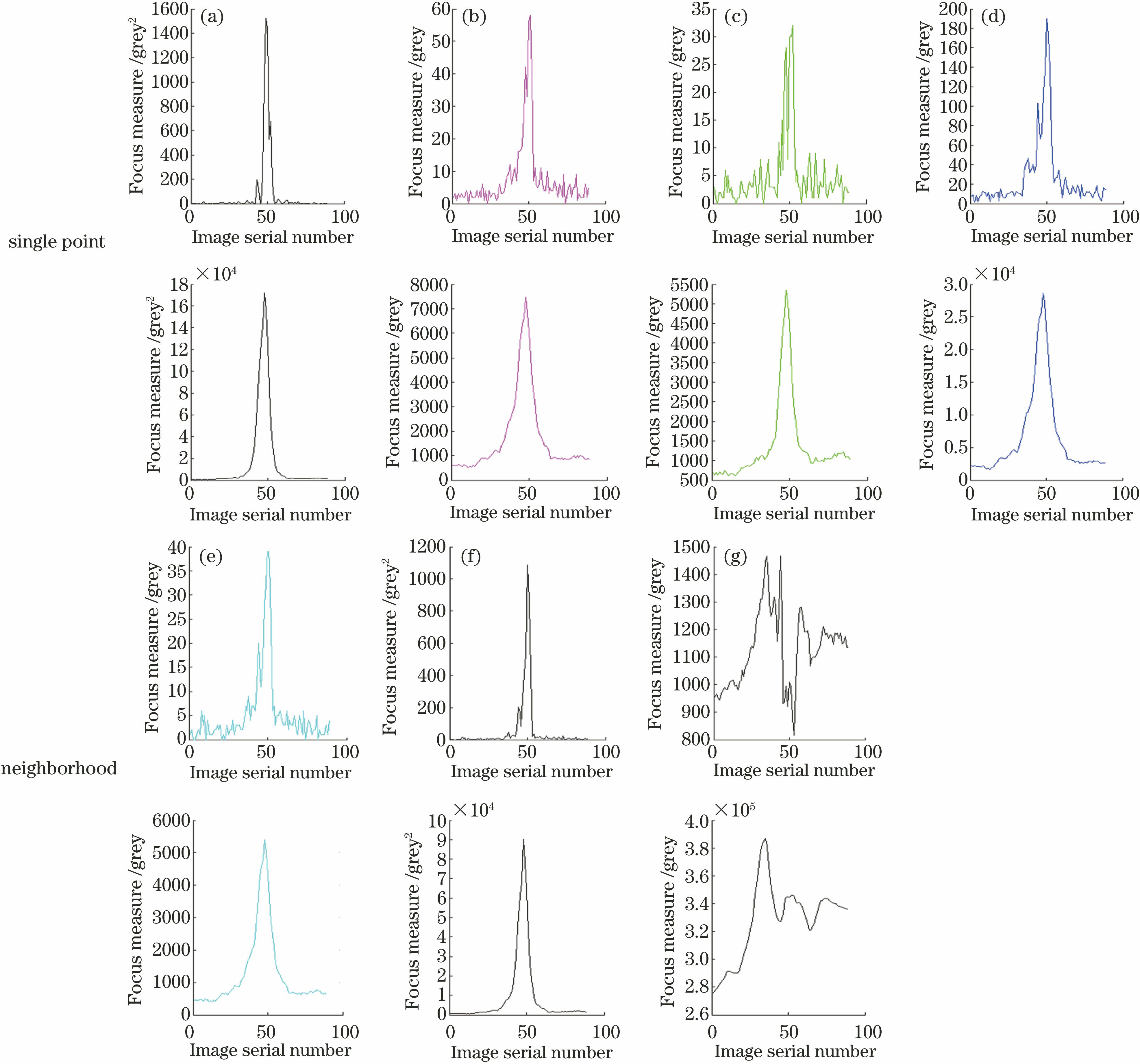

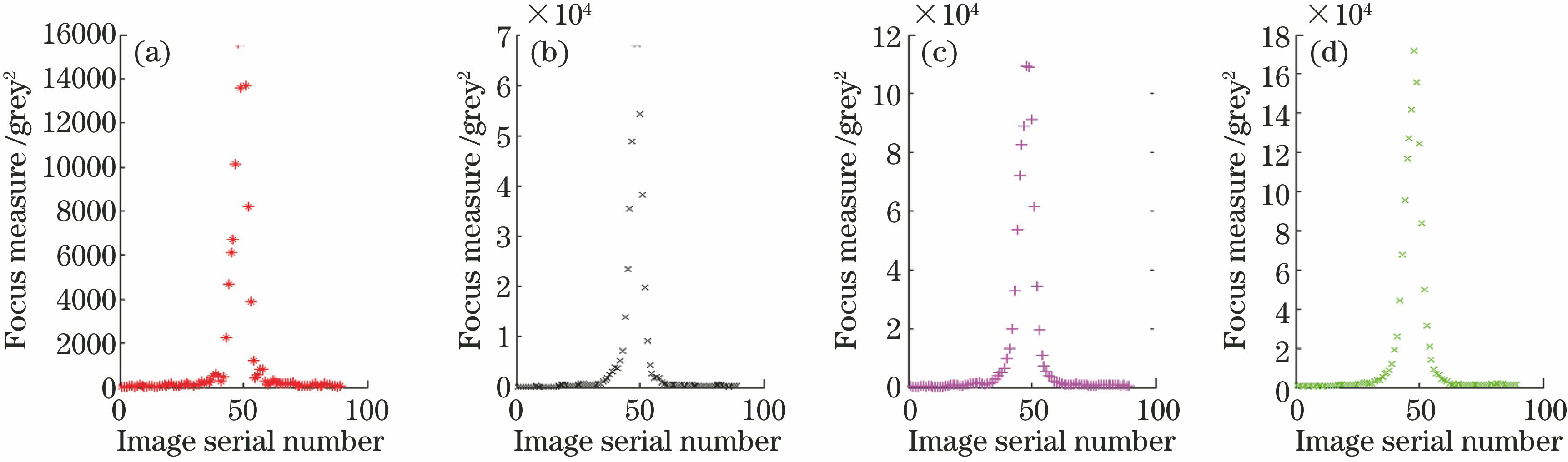

需要注意的是,邻域不宜过大,以免干扰单个像素的灰度值。为了确定应该选择多大的邻域进行聚焦评价,本文利用Brenner算子分别测试了邻域大小为5、9、13、17的聚焦评价情况,结果如

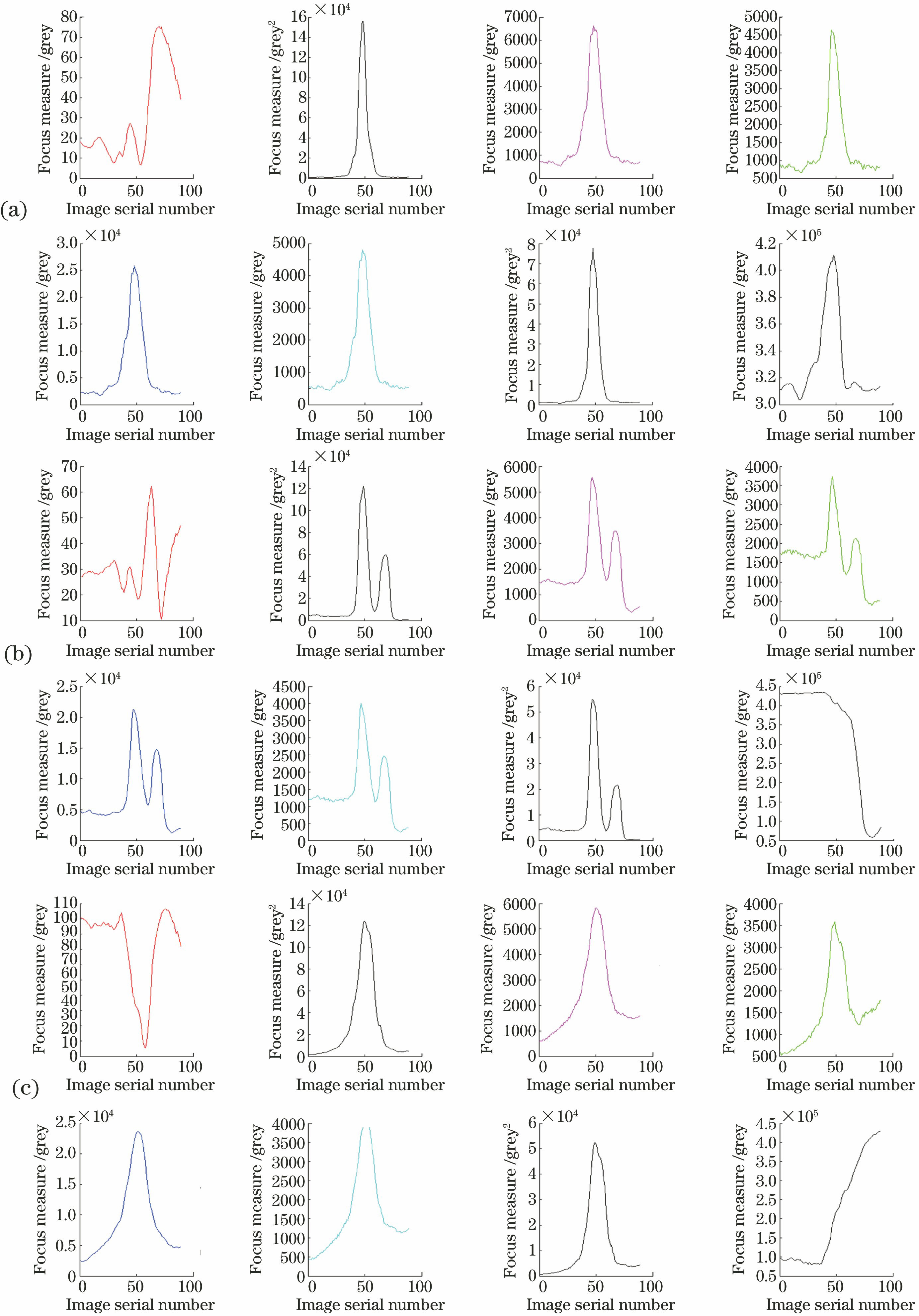

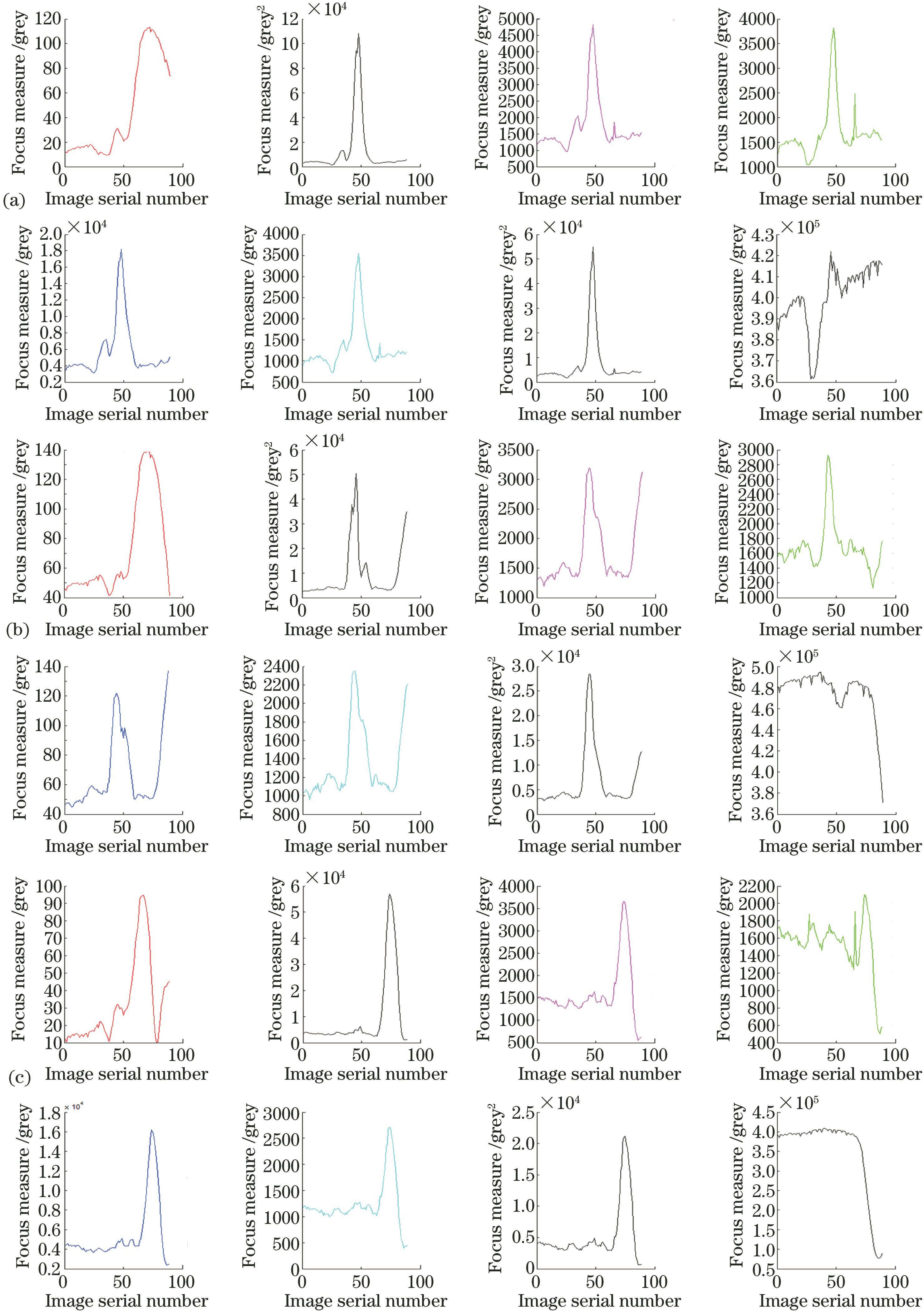

选择好聚焦评价区域大小后,需要选择合适的聚焦评价函数。聚焦评价函数要对图像上所有点都具有较好的评价结果。针对拍摄的图像,选取三个具有代表性的点,

图 4. 利用单点和邻域信息,不同算子时得到的聚焦曲线图。(a) Brenner算子;(b) Roberts算子;(c) Laplace算子;(d) Tenengrad算子;(e) SMD算子;(f)梯度平方;(g)八方向Sobel算子

Fig. 4. Focus curves obtained from single point information and neighborhood information with different operators. (a) Brenner operator; (b) Roberts operator; (c) Laplace operator; (d) Tenengrad operator; (e) SMD operator; (f) gradient square; (g) Sobel operator in eight directions

表 1. 采用单点和邻域信息进行聚焦评价每幅图像消耗的时间

Table 1. Time consumed per image during focus evaluation by using single point and neighborhood information

| ||||||||||||||||||||||||||

图 5. 利用不同大小的邻域得到的聚焦散点图。(a) 5;(b) 9;(c)13;(d) 17

Fig. 5. Focus scatter plots with different sizes of neighborhood. (a) 5; (b) 9; (c)13; (d) 17

图 6. 不同亮度点的聚焦评价结果。(a) (380,280);(b) (700,390);(c) (608,218)

Fig. 6. Focusing evaluation results of points with different brightness. (a) (380,280); (b) (700,390); (c) (608,218)

表 2. 采用不同大小的邻域进行聚焦评价每幅图像消耗的时间

Table 2. Time consumed per image during focus evaluation with different sizes of neighborhood

|

计算得到的三个待测点的聚焦评价曲线如

为了观察聚焦评价函数对图像较亮区域的反应特性,在图像上选取亮度较大的三个点,坐标为(765,115)、(363,1095)和(829,68),得到的聚焦评价曲线如

图 7. 三个较亮点的聚焦评价结果。(a) (765,115);(b) (363,1095);(c) (829,68)

Fig. 7. Focusing evaluation results of three brighter points. (a) (765,115); (b) (363,1095); (c) (829,68)

3.3 极值搜索

得到被测物点在图像序列每幅图像中的聚焦值后,即可得到该点的聚焦散点图,下一步需要准确找出对应物点聚焦值的最大值,以及所在图像的序列号,并求得该点的焦点相对位移量和光照参数(可能要插值),然后通过图像融合算法提取被测表面每个点成像最清晰的像素,置于一幅图像上,得到一幅每个点都很清晰的超景深融合图像,即扩展显微物镜的景深,其对应的焦点位移量构成的三维坐标点云图就是表面轮廓三维测量结果。

3.3.1 聚焦值最大值搜索方法

搜索聚焦评价值的最大值常用的策略有遍历搜索法、曲线拟合法、Fibonacci搜索法、黄金分割法和爬山算法等。

1) 遍历搜索法。遍历搜索法直接比较每幅图像聚焦评价函数的大小,取聚焦评价函数值最大时所在的位置为聚焦点,原理简单,运算速度快,但聚焦点的精度取决于图像拍摄时每次的步进位移量和拍摄的图像张数。

2) 曲线拟合法。典型的拟合方法有二次多项式拟合和高斯拟合,通过对离散点进行曲线拟合后得到极值点。

3) Fibonacci搜索法。该方法在二分查找的基础上根据斐波那契数列进行分割,通过确定聚焦位置所在部分,不断缩小查找区间,以寻找到最佳聚焦位置。

4) 黄金分割法。该方法为Fibonacci搜索法的特例,每次都取区间长度的0.618处的点和两端点处的值进行比较,以此缩短搜索区间,找到极大值点。

5) 爬山算法[14-15]。爬山算法通过上下坡确定最大值点,只能适用于具有单峰性的聚焦评价函数。首先要确定搜索方向

6) 随机抽样一致性(RANSAC)算法[16]。RANSAC算法常用于包含异常数据的样本数据集,对随机抽取的一定数目样本进行多项式拟合,求出数据集的数学模型,迭代多次后得到多个数学模型,然后选取对所有样本点误差最小的数学模型,作为最终拟合结果。

3.3.2 方法比较与分析

以(380,280)、(700,390)、(608,218)、(363,1095)和(719,1197)5个坐标点为例,比较几种搜索法的效果,结果如

表 3. 多种极值搜索方法得到结果的比较

Table 3. Comparison of results obtained by different extremum searching methods

|

3.4 多聚焦图像融合

多聚焦图像是指成像条件相同,而镜头聚焦目标不同的多幅图像。只有当物体处于焦点位置时才能得到清晰的像,在显微成像中,随着放大倍数的增大,景深会相应减小,只有那些在聚焦平面及其附近的结构才可见,因此即便是结构简单的、三维深度相对平坦的物体也不可能在一幅图像中完全聚焦清晰。由于被测微观复杂物体表面高度不同,所以在获取的同一幅图像中只有部分点清晰,而其他点呈现出不同程度的模糊。为了获取一幅物体所有点都是清晰的图像,需要改变物体与光学传感器的距离,拍摄一序列图像,把每幅图像上清晰的部分提取出来,进行图像融合。多聚焦图像融合主要通过空间域图像融合和频率域图像融合实现。

3.4.1 空间域图像融合方法

基于空间域的显微图像融合法就是在空间域基于像素、区域特征或图像块对多幅图像进行融合处理[17-21],常用的方法有:

1) 基于像素点的显微图像融合方法。直接取每个像素点灰度值为最大时所处的图像序列层的灰度值作为融合图像中该点的灰度值,因为聚焦时该像素点应具有最大的亮度。此外,还可以直接取每个像素点在图像序列中灰度值的平均值作为融合图像中该点的灰度值。该方法简单直观,适合实时处理,但没有考虑像素点邻域像素的情况,融合后图像的对比度很差,简单叠加使得合成图像的信噪比降低,对噪声十分敏感,精度不高;而且当融合图像的灰度差异很大时,会出现明显的拼接痕迹。

2) 基于区域特征的显微图像融合方法。以某一像素为中心取固定大小的窗口作为评价单位,通过计算窗口内灰度值之和,取灰度值之和最大的图像序列号所对应的图像中像素点的灰度值作为融合后图像的像素值。另外,分别计算窗口内的灰度方差算子、Sobel算子、Tenengard算子、Laplace算子、Brenner算子、Roberts算子等的值作为不同的特征值,然后逐像素比较该像素在不同的图像序列中所在窗口内的特征值,选取窗口特征值中较大的那个像素的灰度值作为最后的融合图像对应位置处的灰度值,最终得到融合图像。

3) 基于图像块的显微图像融合方法。首先对源图像进行分块,分别计算图像序列中对应图像块的清晰度指标,选取清晰度指标大的图像块作为融合图像中相应位置的图像块。该方法与基于区域特征的图像融合方法相比,计算量小,但要根据具体图像序列和应用场景选择适当的分块大小,如果分块数过少,则子块同时包含了模糊和清晰的部分,拼接后的融合图像中也会出现模糊部分;如果分块过多,运算量会加大。同时,分块融合在拼接时,子块边界处可能存在拼接痕迹,后期需进行边界处理,使拼接处平滑。

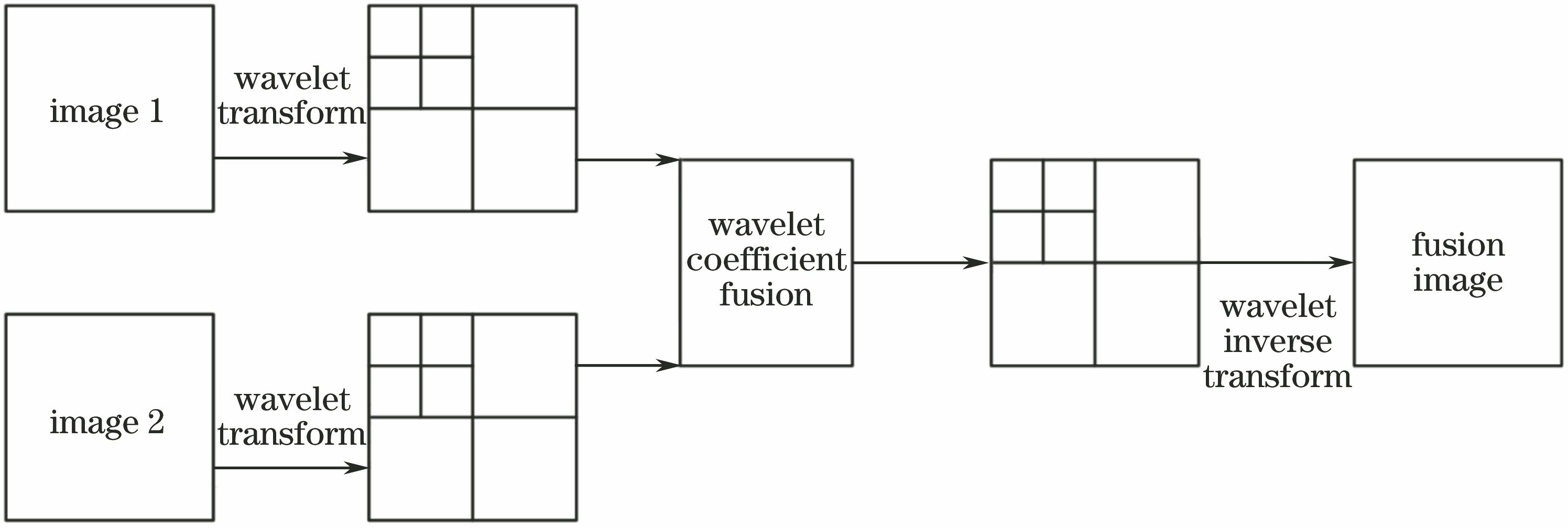

3.4.2 频率域图像融合方法

基于频率域的显微图像融合方法主要有基于金字塔分解的方法和基于小波变换的方法。基于金字塔分解的方法通过对图像进行塔式分解,在不同的分解水平上选取融合准则后进行图像融合,再在不同的分解层次上通过塔式反变换进行图像重建,得到融合后的图像,常见的塔式算子有Laplacian金字塔、梯度金字塔、Gaussian金字塔和形态学金字塔等[22-23]。小波变换方法采用多尺度分析代替塔型分解,在时域和频域均具有良好的局域特性,能形成可调的时频窗,较好地保留了图像的高频信息,可以聚焦到图像的任意细节[24]。

基于小波变换的图像融合方法如

设函数

经过平移和伸缩后可生成函数族

式中:

式中:

采用小波进行图像融合时,一般使用离散小波。常用2的幂次对图像行列坐标(

对于任意函数

即每个小波变换系数都是通过

图像的小波变换就是一个滤波和重采样过程,选定合适的低通滤波器和高通滤波器后,先沿行方向进行低通和高通滤波,将图像分解为概貌和细节两部分,并进行2∶1采样,再沿列方向进行低通和高通滤波,并进行2∶1采样。假定二维尺度函数可分离,在小波变换的每一分解层上,图像均被4等分为GG、GH、HG、HH4个频带,在下一层中仅对低频分量GG进行分解,与GG、GH、HG和HH频带对应的分别为原图像概貌、垂直方向细节、水平方向细节和对角线方向细节。

图像重构是在每一分解层上先对列进行增频采样,利用重构低通滤波器和高通滤波器与各行卷积,再对行进行增频采样,利用重构低通滤波器和高通滤波器与每一列进行卷积,得到的图像阵列就是小波图像重构的结果。

小波融合过程中要选择合适的融合规则、小波基函数及分解层数。本文选取的融合规则是:在低频区域采用平均值处理方法,在高频区域采用取最大绝对值方法。因为对于图像序列,低频区域数据值很相近,而高频区域却有明显差别。绝对值大的小波变换系数表示此区域具有强烈的亮度变化。小波基函数采用db1(1阶Daubechies小波)小波基函数,分解层数采用四阶分解。

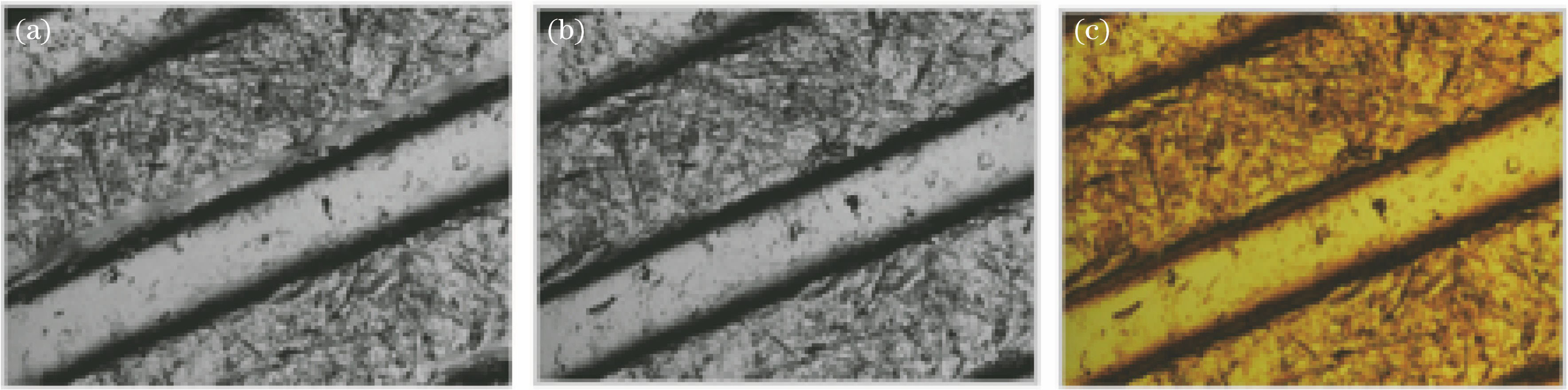

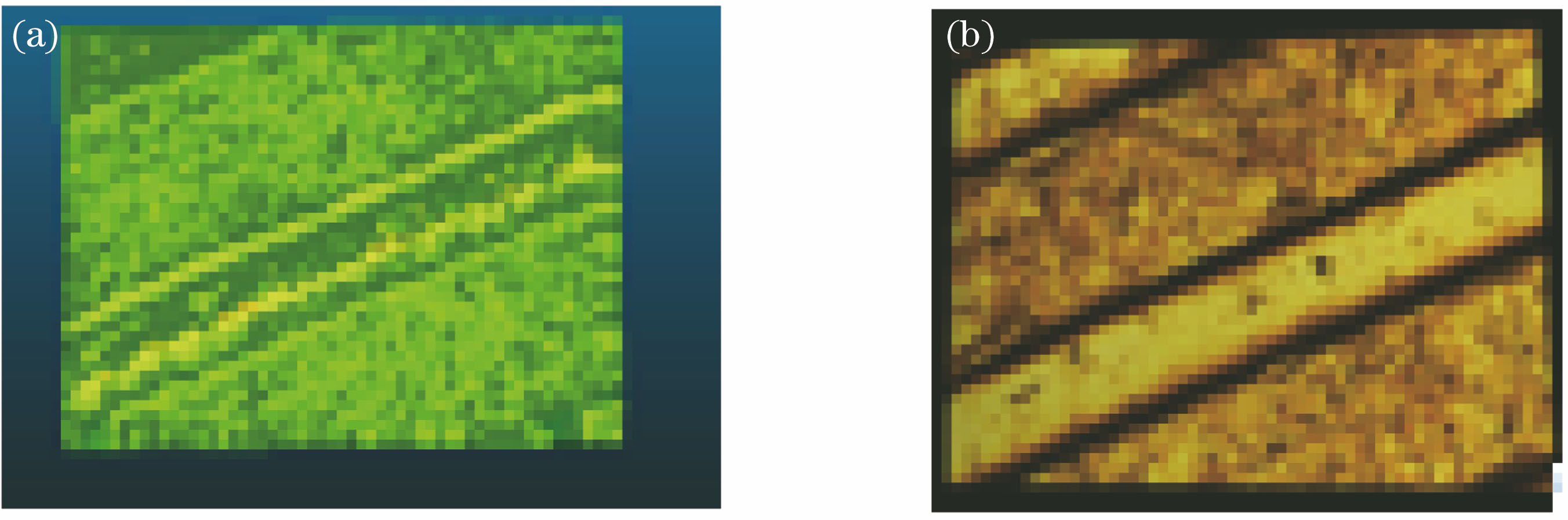

图 9. 图像融合结果比较。(a)空域区域特征图像融合;(b)频域小波图像融合;(c)频域小波彩色图像融合

Fig. 9. Comparison of image fusion results. (a) Image fusion based on spatial regional characteristics; (b) image fusion with frequency domain wavelet; (c) color image fusion with frequency domain wavelet

5 实验验证

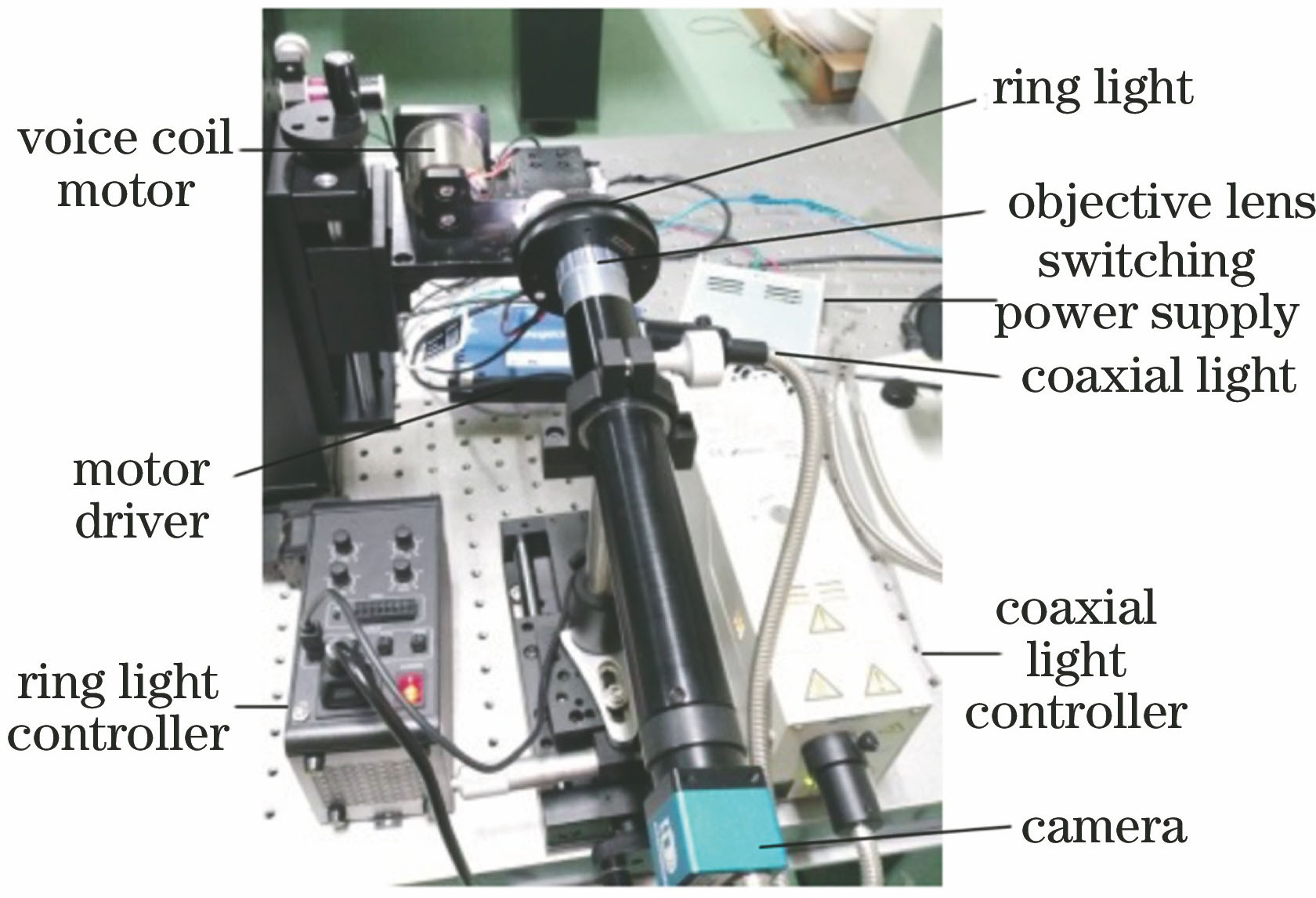

搭建的实验装置如

实验中,通过移动被测物体来改变物体与成像透镜之间的距离,编程控制CCD摄像机,使其在物体每移动一定的距离时采集一幅图像,当物体的移动距离覆盖了被测高度时,停止采集,从而获取一图像序列。实验前,为了避免获取到无用的图像,首先观察CCD摄像机采集到的图像,把物体移动到成像大致清晰的地方,此时物体处于物镜的焦点附近,然后再控制音圈电机不断移动被测物体,同时利用CCD摄像机每隔一定距离采集一张图像。如

图 11. 硬币表面成像序列图。(a)第1张图;(b)第2张图;(c)第30张图;(d)第31张图;(e)第80张图;(f)第81张图

Fig. 11. Image sequence diagrams of coin surface. (a) 1st image; (b) 2nd image; (c) 30th image; (d) 31st image; (e) 80th image; (f) 81st image

图 12. 硬币表面浮雕三维测量结果。(a)三维点云图;(b)彩色三维重构图

Fig. 12. 3D measurement results of coin surface relief. (a) 3D point cloud; (b) 3D color reconstruction image

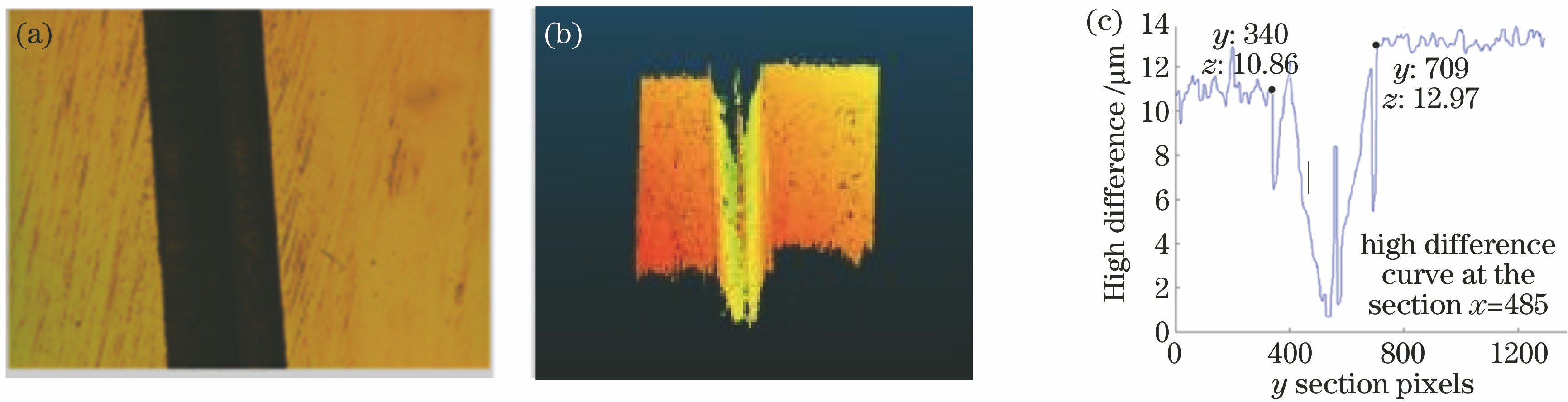

为了验证测量精度,把厚度为1.11 mm和1.13 mm的量块紧挨着放置在一个基准平板上,形成一个高度为30 μm的台阶,如

图 13. 标准台阶测量结果。(a)图像序列中的一幅图像;(b)三维点云数据;(c)某一截面的点云分布

Fig. 13. A gauge step measurement result. (a) One of images in image sequence; (b) 3D point cloud data; (c) point cloud distribution of a section

6 结论

鉴于显微光学成像系统具有有限的成像景深,采用物方焦平面移动扫描,图像层叠融合技术扩展光学系统景深,可以实现显微系统超景深三维真彩色测量,在诸多领域具有广泛的应用市场。这种变焦超景深扩展技术主要用于复杂结构物体(如生物)超大景深成像与真彩色可视化和具有超大景深复杂轮廓物体的三维精密测量。对于前者,主要用途是超大景深成像,其效果取决于聚焦评价函数的确定、焦点搜索算法和图像融合方法;对于后者,还需要精密扫描移动机构。如果扫描移动机构有直线度误差,为了获得高精度结果,在进行聚焦点搜索之前必须对扫描图像序列进行配准。考虑到工业显微光学系统在有限的对焦移动范围内,导轨直线度误差较小,图像配准这一步往往可以省略。本文未讨论图像序列配准,可参阅文献[ 25-27]。

[2] Raleigh B K. Focus variation-new advance in optical 3D metrology for micro machining applications[J]. Commercial Micro Manufacturing, 2010, 6(2): 1-7.

[3] Bos E J C. Aspects of probing on the micro scale[J]. Proceedings of SPIE, 2010, 7544: 754418.

[4] Nayar SK. Shape from focus system[C]. IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 1992: 302- 308.

[6] Nayar S K, Nakagawa Y. Shape from focus[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1994, 16(8): 824-831.

[8] DanzlR, HelmliF, SchererS. Focus variation-a new technology for high resolution optical 3D surface metrology[C]∥International Conference of the Slovenian Society for Non-Destructive Testing, 2009: 484- 491.

[10] 李敏. 显微视觉系统中自动聚焦算法的研究及微动平台的控制[D]. 秦皇岛: 燕山大学, 2016.

LiM. Theresearch of auto focusing algorithm and the control of micro platform based on the micro vision system[D]. Qinghuangdao: Yanshan University, 2016.

[26] Lakshmi C HS, Bhagat JP, KarS. Image registration in shifted focus[C]∥IEEE Second International Conference on Image Information Processing, 2013: 319- 322.

史艳琼, 尹秋霞, 卢荣胜. 变焦显微成像三维测量算法性能分析[J]. 激光与光电子学进展, 2019, 56(7): 071202. Yanqiong Shi, Qiuxia Ying, Rongsheng Lu. Performance Analysis of Three-Dimensional Measurement Algorithm with Focus Variation Microscopic Imaging[J]. Laser & Optoelectronics Progress, 2019, 56(7): 071202.