结合稠密轨迹与视频显著性特征的人体动作识别  下载: 1003次

下载: 1003次

Human-Body Action Recognition Based on Dense Trajectories and Video Saliency

1 兰州交通大学电子与信息工程学院, 甘肃 兰州 730070

2 甘肃省人工智能与图形图像工程研究中心, 甘肃 兰州 730070

3 甘肃省轨道交通装备系统动力学与可靠性重点实验室, 甘肃 兰州 730070

图 & 表

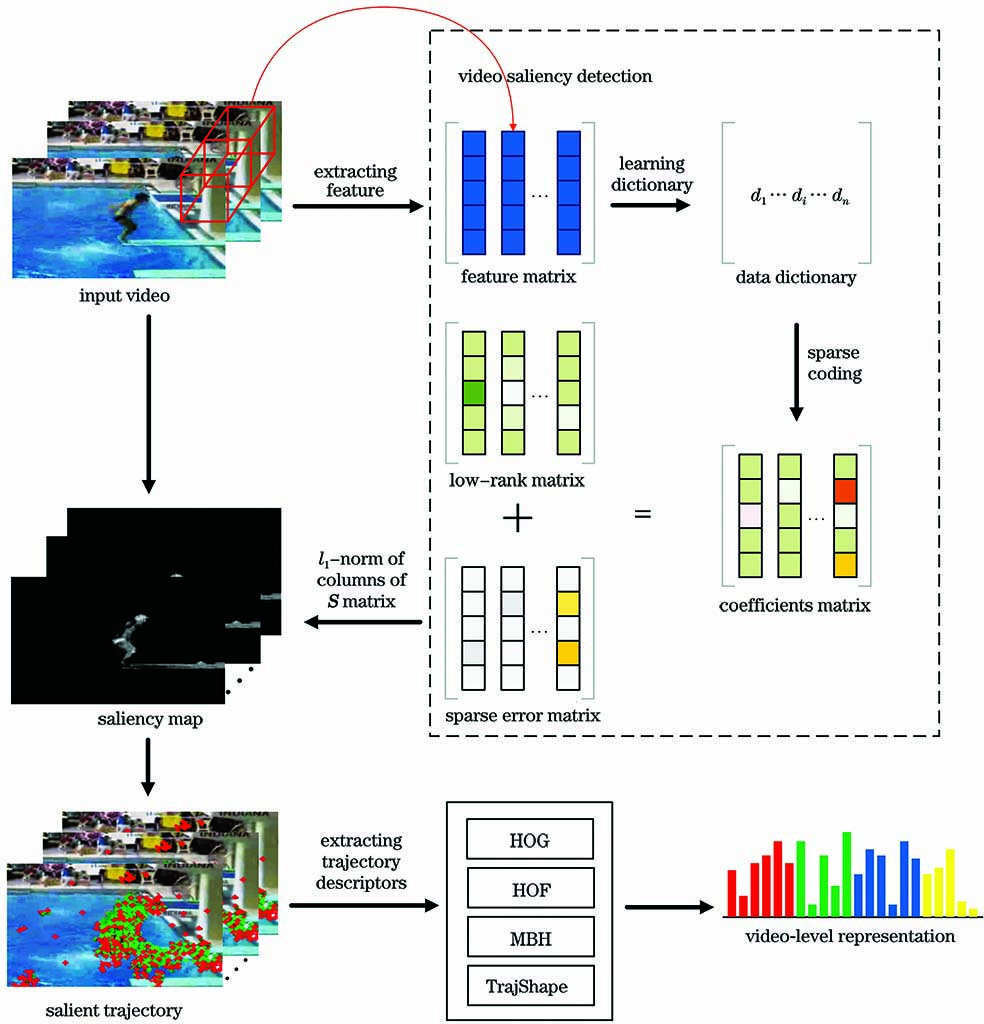

图 1. 基于显著性的动作识别算法框架图

Fig. 1. Saliency-based action recognition algorithm framework

下载图片 查看原文

图 2. 稠密轨迹算法原理图

Fig. 2. Dense trajectory algorithm framework

下载图片 查看原文

图 3. 动作样本帧实例(UCF Sports/YouTube)。(a)UCF Sports数据集;(b)YouTube数据集

Fig. 3. Sample frames from UCF Sports and YouTube. (a) UCF Sports; (b) YouTube

下载图片 查看原文

图 4. 显著性区域检测参数的估计

Fig. 4. Estimation of saliency detection parameters

下载图片 查看原文

图 5. 本文方法与稠密轨迹方法的可视化比较。(a)UCF Sports数据集;(b)YouTube数据集

Fig. 5. Comparison of the DT and our method. (a) UCF Sports; (b) YouTube

下载图片 查看原文

图 6. 本文方法与稠密轨迹方法对每个动作类识别率的比较。(a)UCF Sports数据集;(b)YouTube数据集

Fig. 6. Accuracy comparison of each class by DT and our method. (a) UCF Sports; (b) YouTube

下载图片 查看原文

表 1实验环境

Table1. Experimental environment

| Experimental environment | Detail information |

|---|

| OS | Ubuntu14.04 | | CPU | Intel(R) i7-8700 @3.20 GHz | | GPU | Nvidia GeForce GTX 1060 3 GB | | RAM | 16 GB | | Compiler | Matlab2016 |

|

查看原文

表 2本文方法与传统稠密轨迹方法平均识别准确率的比较

Table2. Comparison of mean accuracy by DT and our method unit: %

| Datasets | DT | S-Traj |

|---|

| UCF Sports | 88.2 | 90.3 | | YouTube | 84.1 | 89.6 |

|

查看原文

表 3本文方法与当前先进算法实验结果的对比

Table3. Results comparison of our method and the state-of-the-art method unit: %

| UCF Sports | YouTube |

|---|

| Method | Mean accuracy | Method | Mean accuracy | | Wang et al[6] | 89.10 | Wang et al[6] | 85.40 | | Yi et al[13] | 90.08 | Yang et al[22] | 88.00 | | Somasundaram et al[14] | 87.30 | Peng et al[23] | 87.60 | | Li et al[15] | 93.40 | Guo et al[24] | 89.50 | | Cho et al[21] | 89.70 | Duan et al[25] | 90.00 | | Our method | 90.30 | Our method | 89.60 |

|

查看原文

高德勇, 康自兵, 王松, 王阳萍. 结合稠密轨迹与视频显著性特征的人体动作识别[J]. 激光与光电子学进展, 2020, 57(24): 241003. Deyong Gao, Zibing Kang, Song Wang, Yangping Wang. Human-Body Action Recognition Based on Dense Trajectories and Video Saliency[J]. Laser & Optoelectronics Progress, 2020, 57(24): 241003.

下载: 1003次

下载: 1003次