基于离散余弦变换和深度网络的地貌图像分类  下载: 1068次

下载: 1068次

1 引言

随着技术的进步,无人机(UAV)被广泛地应用于**侦察、地质勘探、目标跟踪、交通监控等领域。无人机地貌图像有丰富的空间、纹理特征,还包含了大量场景语义信息,由于场景的构成复杂且地物覆盖类别众多,图像中包含不同尺度的物体,大到大型建筑物,小到路上行人;此外地貌图像还具有密集性,在一个小范围内会包含各种不同的物体。因此,无人机地貌图像具有场景复杂、纹理信息丰富、大范围、宽视角的特点。无人机飞行环境复杂多样,快速有效的地貌分类技术成为无人机执行飞行任务的安全保障。

近年来,深度学习被引入到图像分类中,Hinton等[1]提出用深度学习思想对图像进行识别处理。其中卷积神经网络(CNN)在图像分类中具有较好的分类效果[2]。文献[ 3]提出了基于深度学习的高分辨率影像分类方法,利用深度学习模型挖掘遥感影像的空间分布规律,将深度学习知识引入到高分辨率遥感影像分类问题中。方旭等[4]获得了更为精细的高分类影像的边缘分类结果,将Mean-shift分割和全CNN相结合,减少了影像特征图自身特征丢失,提高了影像的分类精度。文献[ 5]提出了一种联合显著性采样和多层CNN的方法,利用显著性采样获取图像块样本集然后将其输入CNN中进行训练。

深度网络需要通过训练提高网络的分类性能,但是训练时间会受到各种因素的影响,例如图像维数越大,网络的训练时间越长[6]。为了缩短训练时间,研究者采取缩小网络和减少训练图像的方法[7],但是这会直接影响到网络的性能,不利于图像的特征学习。Agarwal等[8]采用主成分分析(PCA)对数据进行除冗余降维处理,并提出采用离散余弦变换(DCT)通过选择DCT系数构造特征向量进行图像的识别,缩短了训练和识别的时间,取得了不错的识别效果[9-11]。文献[ 12]中提出了基于DCT的稀疏自动编码器模型,在手写字体库上取得了不错的分类率。但是基于DCT的稀疏自动编码器模型比较简单,只在场景单一、内容简单的图像上具有不错的分类效果。

综上所述,与传统图像分类方法相比,CNN对图像具有较好的特征表达能力,在图像分类方面具有较高的准确率,因此选用CNN进行特征提取。但是在训练时,运用CNN模型存在输入高维图像会大大增加训练时间、影响深层次特征的学习以及参数过多导致调参困难等问题。

针对以上问题,提出一种基于DCT和深度网络的地貌图像分类方法。为了在不损失原始输入信息的前提下降低输入数据的冗余信息,本文根据DCT能量集中的特点提出了系数判别法,保留最能表达图像信息的系数。并根据DCT系数的特点以及无人机地貌图像的特点对传统的CNN模型进行改进,构建了DCT-CNN模型,最后将提取的特征输入到支持向量机(SVM)分类器中完成图像分类。

2 基本原理

2.1 DCT

DCT是一种实数域变换,其变换核是实数余弦函数。一幅图像经过DCT后,图像的可视信息主要集中在DCT的一小部分系数中,即图像的低频部分。对于一幅

其中:

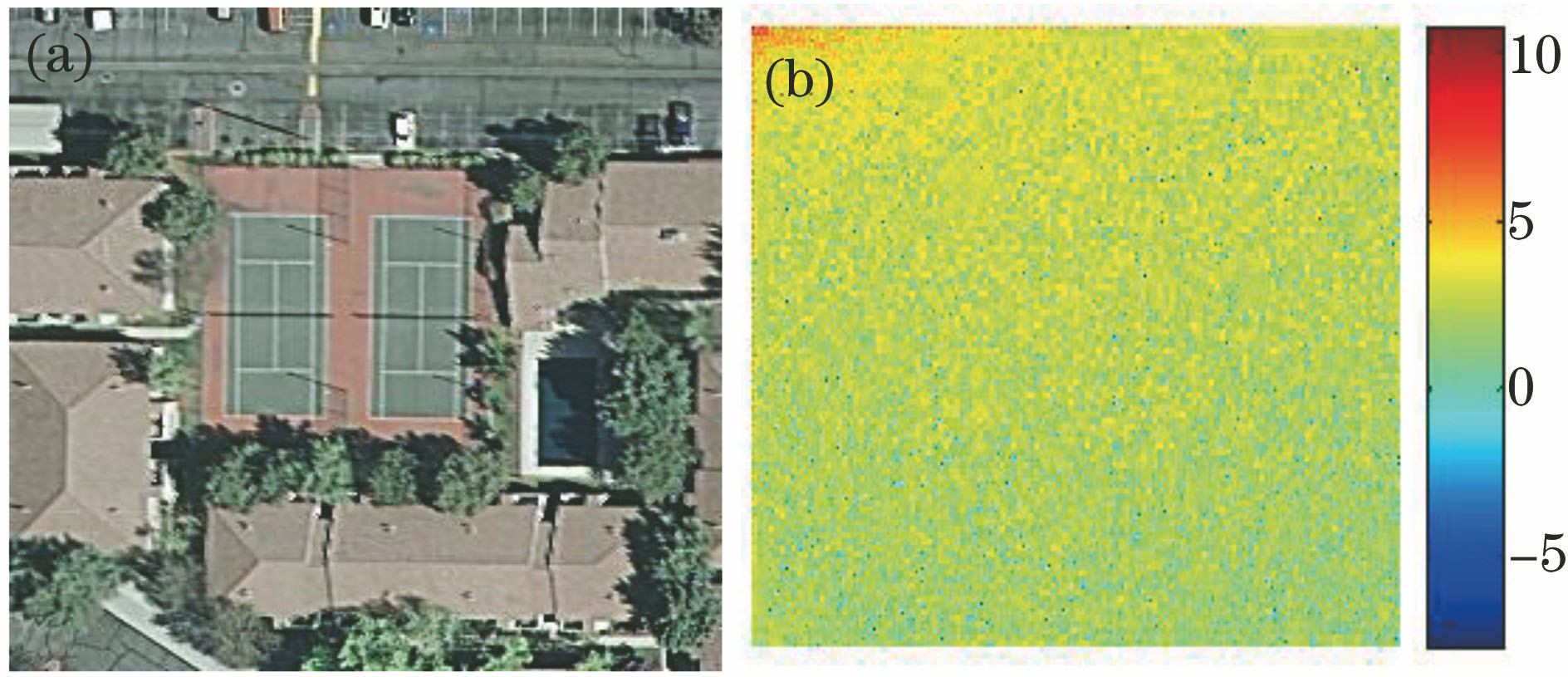

图像经过DCT处理是从时域的表达变换到频域。变换的前后能量不发生变化,但是能量的分布发生了改变,图像的大部分能量聚集在低频系数中,如

图 1. (a)原图像与(b) DCT后的能量分布

Fig. 1. (a) Original image and (b) energy distribution after DCT

2.2 CNN

CNN是一种特殊的深层前馈神经网络,其结构一般由输入层、多个卷积层、多个池化层、全连接层以及输出层组成,如

CNN通过卷积操作对图像进行逐层的特征提取,并且利用权值共享的思想在卷积操作时大大减少了网络的训练参数,降低了网络的复杂度。卷积过程就是用一个可学习的卷积核或滤波器去卷积一个输入的图像,加上偏置然后通过激活函数得到卷积特征图。公式表示为:

式中

卷积后的特征图个数增加,根据图像的局部相关性原理,通过池化层对卷积后得到的特征图进行下采样,降低了图像的维度,避免了维数灾难。公式表示为:

式中

3 基于DCT和深度网络的无人机地貌图像分类

无人机地貌图像场景复杂、纹理信息丰富,在图像分类时只需要利用图像中的主要目标特征信息。DCT具有能量集中的特点,能去除数据冗余信息,保留最能表达图像特征的信息。图像经过DCT后将其能量的大部分集中在频率域的一个小范围,包含图像中主要的视觉信息,可以根据实际需要选择和提取图像特征。DCT原理简单、计算复杂度低,可以对地貌图像进行初级的处理,获得原有图像在变换域上具有良好不变性和区分性的描述,避免了对多层特征提取方法中滤波器的学习。CNN是通过卷积运算由浅层到深层提取图像不同层次的特征,对图像具有较好的特征表达能力。针对无人机地貌图像场景复杂、信息丰富的特点,以及CNN模型层数较多、结构复杂和训练花费时间较长的问题,将基于DCT能量集中的优势引入到基于CNN的特征学习中,结合两者优点构建了DCT-CNN模型。

3.1 DCT系数的选择

一幅图像经过DCT后,图像的大部分能量聚集在低频DCT系数中,所以低频系数比高频系数更重要,但是完全把高频系数丢弃就会损失较多的图像细节信息。在DCT系数选择时为了不丢失太多的细节信息,并保留最能表达图像特征的系数,研究采用保留矩阵左上角10个低频系数以及保留具有较高能量信息的中高频系数,提出了系数判别法,并利用其对中高频系数进行选择。该方法具体步骤为:

1)对图像进行8×8分块,然后对每个子块分别进行DCT;

2) DCT后的系数矩阵,按照ZigZag扫描的方式保留矩阵左上角的10个低频系数;

3)对剩余的54个系数采用系数判别法进行系数选择,首先求每一个子块的平均值,并设定平均值为每块的系数阈值,然后对每个子块中剩余的54个系数进行选择,如果系数小于阈值则该系数置0,大于阈值则保留该系数;

4)最后把每幅图像筛选的DCT系数进行整合。

图像经过DCT后能量主要分布在左上角,右下角的能量分布比较低。

3.2 DCT-CNN模型

由于CNN模型层数较多、结构复杂,将高维的图像直接输入CNN模型中进行训练,会使模型的训练时间较长、训练参数增加,另外还会导致深层的特征不容易被学习,从而丢失特征信息。在不损失输入数据信息的前提下,降低输入数据的冗余信息,可以减少参数的数量并缩短网络的训练时间。将DCT作为深度网络的第一层,图像经过DCT后得到和原图像相同维度的DCT系数,为了减少数据冗余,选择少量的DCT系数输入到深度网络中进行网络训练。为了提高无人机地貌图像的分类准确率,对传统CNN结构进行改进,最后将得到的深层特征输入到SVM分类器中完成图像分类。DCT-CNN模型结构如

为了减少网络训练时间,并且在降低网络计算复杂度的前提下提高无人机地貌图像分类的准确率,研究构建了一个14层用于无人机地貌图像分类的DCT-CNN网络结构,包括一个输入层、5个卷积层、3个池化层,4个线性修正单元层(ReLU层)和一个输出层。为了提取高层语义特征并减少网络的计算量,将采集到的无人机地貌图像大小统一缩放到128 pixel×128 pixel,构建的DCT-CNN网络结构参数如

图 3. 三维频谱图。 (a)原图像DCT系数频谱图;(b)系数选择后的频谱图

Fig. 3. Three-dimensional spectrum diagram. (a) DCT coefficient spectrum of original image; (b) spectrum after the coefficient selection

表 1. DCT-CNN网络结构的各层参数

Table 1. Layer parameters of DCT-CNN network structure

|

卷积过程要针对具体图像设计卷积核大小,如果卷积核的尺寸过大,会增加网络运算量;如果尺寸过小,则不能提取到完整的特征。此外,卷积核个数过少会使特征提取不充分从而导致分类准确率低;数量过多会增加计算量,使卷积时间较长,从而大大增加运行时间。

基于以上分析,为了提取高层语义特征并减少网络的计算量,DCT-CNN模型中的5层卷积层为5-3-7-7-1结构,采用5层卷积层可以提取到较好的图像特征,获得较完整的特征表达。第一层卷积核的大小是5×5,控制卷积核尺寸,有效地减少参数的数目,既能提取到深层特征表达,又能保证运算量不会大幅度增加;第二层的卷积核大小是3×3,用以控制参数数目,降低网络运算的复杂度;第三层和第4层的卷积核大小是7×7,虽然卷积核尺寸较大会增加网络运算量,但是得到的特征比较完整、准确;最后一层卷积核大小是1×1,可以与任何层直接相连,相当于一层全连接层,直接输入到分类器中得到分类结果。

DCT-CNN模型中的池化层采用了平均池化和最大值池化两种方法,总共有三层池化层,前三层卷积层后面都有一层池化层,用于数据降维、去冗余信息,最后两层卷积层输出的特征维度为1,不需要经过池化层处理。第一层池化层采用平均池化,因为平均池化能保留整体数据的特征和突出背景的信息;后两层池化采用最大值池化,因为最大值池化能更好地保留纹理上的特征,能提取重要、突出的特征,舍弃其他弱的某类特征。

DCT-CNN模型中增加了零填充(zero padding),为了更好地对图像进行特征学习,根据不同情况对特征图进行0填充,之后再进行卷积、池化过程。在该网络结构中,每一层卷积层后接一层激活函数层,给网络加入非线性的因素,使得CNN更好地解决复杂的问题,网络中采用的是线性修正单元(ReLU)激活函数,因为ReLU函数原理近似于人脑神经元在接触外界信号时的工作状态,可以拟合更多的非线性过程,其公式为:

设每张输入特征图的尺寸为

在训练过程中,使用梯度下降法对网络参数进行更新,参数更新规则如下:

式中

为了提高无人机地貌图像的分类准确率,DCT-CNN模型中最后一层采用SVM分类器。由于SVM在解决非线性及高维分类问题时表现出特有的优势[14],具有较好的分类性能,通过特征学习得到图像深层次的特征向量,将其输入到SVM分类器中,完成图像分类。

3.3 DCT-CNN模型的算法流程

图 5. 基于DCT和深度网络的地貌图像分类算法流程图

Fig. 5. Flow chart of landform image classification algorithm based on DCT and deep network

算法步骤如下:

1)首先对图像进行8×8分块,然后对每个子块分别进行DCT;

2)DCT后的系数矩阵,按照ZigZag扫描的方式保留矩阵左上角的10个低频系数;

3)对剩余的54个系数采用系数判别法进行系数选择,首先求每一个子块的平均值,并设定平均值为每块的系数阈值,然后对每个子块中剩余的54个系数进行选择,如果系数小于阈值则该系数置0,大于阈值则保留该系数;

4)把每幅图像筛选的DCT系数进行整合;

5)将训练集的DCT系数输入到改进的DCT-CNN模型中训练,采用(7)、(8)式进行网络参数更新,直到损失函数收敛于一个较小的值,训练结束;

6)输入测试集,利用训练好的模型对测试图像进行逐层学习,通过(3)式计算得到卷积特征图,通过(4)式得到下采样后的特征图,最后将得到的一维特征向量输入到SVM分类器中进行分类,得到图像分类结果。

4 仿真实验

4.1 实验数据

实验数据采用UC Merced LU数据库和采集到的无人机着陆地貌图像。UC Merced LU共有21类,每类100幅图像,从该数据库中每类随机选取80张图像作为训练集,其余20张图像作为测试集,实验设置与文献[

5]、[15]相同。无人机着陆地貌数据库总共有8类7800幅图像,每类图像的数量为500~800,从该数据库中每类随机选取400张图像作为训练集,100张图像作为测试集。两个数据库的地貌图像都具有场景复杂、内容丰富的特点,所以图像类别的判断取决于整幅图像的特征,两个数据库的部分示例图像如

图 6. 数据库示例图像。 (a) UC Merced LU数据库;(b)无人机着陆地貌数据库

Fig. 6. Example images in database. (a) UC Merced LU database; (b) UAV landing landform database

4.2 实验结果与分析

实验采用

实验中两个数据库内的图像像素不相同,首先将所有数据库图像统一缩放到128 pixel×128 pixel,然后采用所构建的DCT-CNN网络结构进行图像训练和分类。图像经过DCT后,大部分能量聚集在低频DCT系数中,所以低频系数比高频系数更重要,但是完全把高频系数丢弃就会损失太多的图像细节信息。在DCT系数选择时为了不丢失太多的细节信息,保留最能表达图像特征的系数,研究采用保留左上角10个低频系数以及具有较高能量信息的中高频系数,提出了系数判别法对中高频系数进行选择。为了验证系数判别法的有效性以及DCT-CNN方法是否能提取丰富的特征信息并减少训练时间,在UC Merced LU、无人机着陆地貌数据库上进行实验,其中,SVM分类器中惩罚系数

DCT在分块时,如果子块的尺寸越大,算法的复杂度会增加,相反如果子块的尺寸过小,分成的子块较多,在系数选择时会丢失部分重要的特征信息,因此选择分块大小为8×8。DCT预处理对图像分类准确率的影响结果如

表 2. 不同方法对UC Merced LU数据库的分类影响

Table 2. Effect of different methods on classification of UC Merced LU database

|

表 3. 不同方法对无人机着陆地貌数据库的分类影响

Table 3. Effect of different methods on classification of UVA landing landform database

|

从

4.3 所提方法与其他已有方法的比较

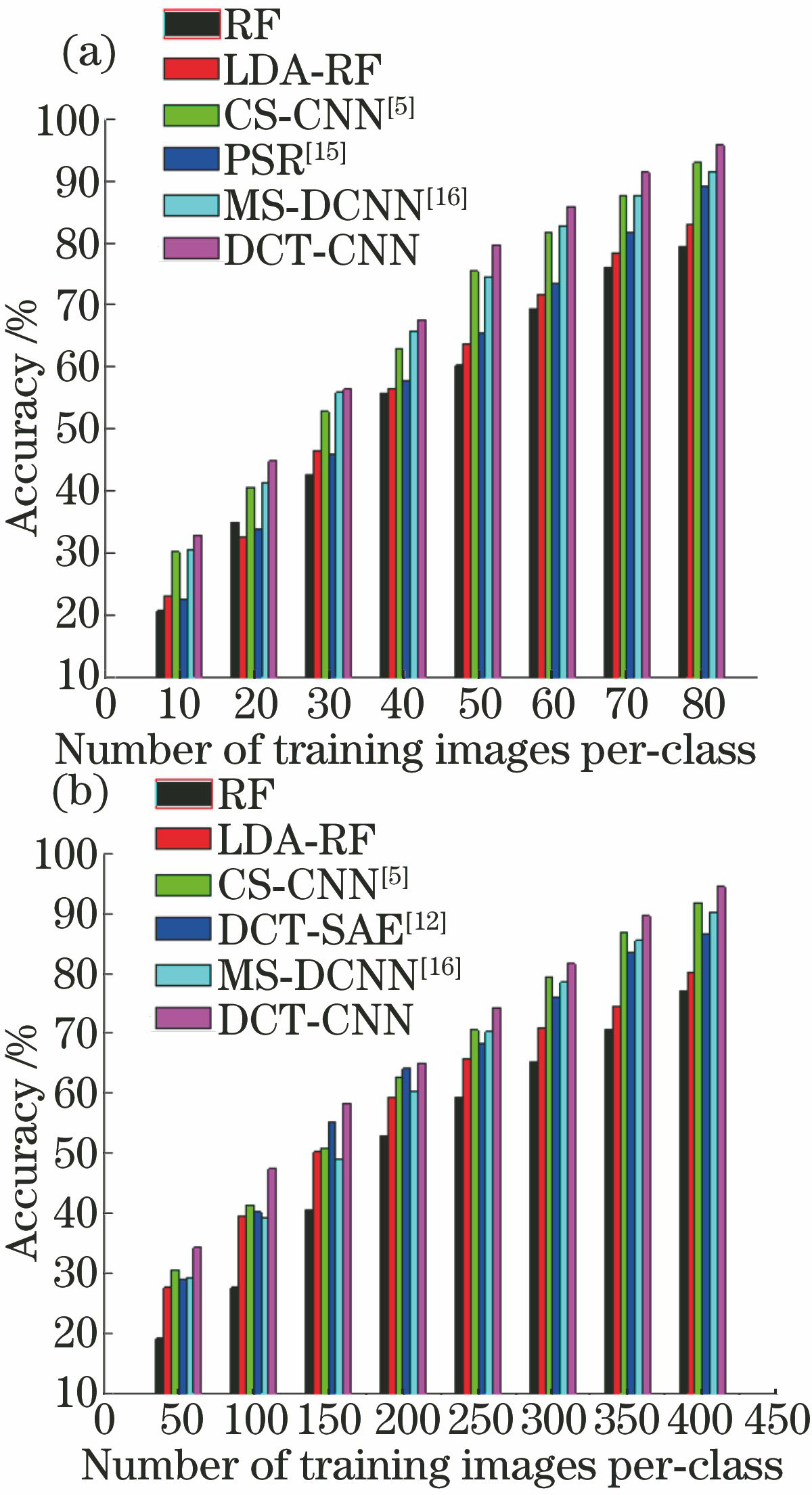

为了验证所提方法的有效性,分别采用联合显著性卷积神经网络(CS-CNN)、离散余弦变换-稀疏自动编码器(DCT-SAE)、空间关系金字塔(PSR)、多尺度卷积神经网络(MS-DCNN)以及经典方法随机森林(RF)法、线性判别分析-随机森林(LDA-RF)法与所提DCT-CNN方法对标准UC Merced LU数据库和采集的无人机着陆地貌数据库进行分类,分类效果见

可以看出,基于深度网络的算法(CS-CNN、MS-DCNN、DCT-SAE和DCT-CNN)可以学习到高层次的语义特征,具有较好的特征表达,分类准确度高于中层语义和底层特征的PSR、RF和LDA-RF方法。

表 4. 不同方法对UC Merced LU数据库的分类准确率比较

Table 4. Comparison of the classification accuracy of different methods for UC Merced LU database

|

表 5. 不同方法对无人机着陆地貌数据库的分类准确率比较

Table 5. Comparison of the classification accuracy of different methods for UAV landing landform database

|

所提方法与传统方法相比准确率有大幅度的提高,在UC Merced LU数据库上,实验方法与文献[ 5]、[15-16]中的无人机地貌分类方法相比,分类准确率有不同程度的提高。在无人机着陆地貌数据库上DCT-CNN方法的分类准确率最高达到94.38%,与文献[ 12]中的DCT-SAE模型相比,DCT-CNN模型层数较多,结构复杂,且分类准确率有很大提升,比DCT-SAE方法的准确率提高了7.89%。因此,DCT-CNN模型在解决场景复杂、内容丰富的无人机地貌图像方面具有较好的分类效果,能减少离散错分样本数量。

DCT-CNN网络有5层卷积层,复杂度为

图 7. 训练样本数量不同时各分类方法的分类性能。(a) UC Merced LU数据库; (b)无人机着陆地貌数据库

Fig. 7. Classification performance of each method when the number of training samples is different. (a) UC Merced LU database; (b) UAV landing landform database

为了验证所提方法在地貌分类中的实际应用效果,给出了无人机着陆地貌数据库的分类混淆矩阵结果,如

图 8. 无人机着陆地貌数据库图像分类混淆矩阵

Fig. 8. Image classification confusion matrix for UAV landing landform database

5 结论

提出了一种基于DCT和深度网络的无人机地貌图像分类方法,针对无人机地貌图像场景复杂、信息丰富且需要较准确的高层语义特征表达等特点,以及CNN模型层数较多、训练花费时间较长等问题,结合CNN和DCT优点构建了DCT-CNN学习网络。根据DCT能量集中的特点提出了DCT系数判别法,在不损失原始输入信息的前提下降低输入数据的冗余信息。为了提高分类准确率,对传统CNN结构进行改进,构建了14层的学习网络。针对改进方法进行实验,将结果和其他基于CNN的无人机地貌图像分类方法进行对比。改进方法提取到的特征能有效地反映出图像信息,具有较高的图像分类准确率,且在训练时间上耗时最少,改进方法可以利用视觉导航系统实现无人机着陆地貌的识别和分类,降低无人机对于外界信息和其他机载设备的依赖性,提高无人机着陆的自主性和准确性。

[2] SzegedyC, LiuW, Jia YQ, et al. Going deeper with convolutions[C]. IEEE Conference on Computer Vision and Pattern Recognition, 2015: 1- 9.

SzegedyC, LiuW, Jia YQ, et al. Going deeper with convolutions[C]. IEEE Conference on Computer Vision and Pattern Recognition, 2015: 1- 9.

[3] 刘大伟, 韩玲, 韩晓勇. 基于深度学习的高分辨率遥感影像分类研究[J]. 光学学报, 2016, 36(4): 0428001.

刘大伟, 韩玲, 韩晓勇. 基于深度学习的高分辨率遥感影像分类研究[J]. 光学学报, 2016, 36(4): 0428001.

[4] 方旭, 王光辉, 杨化超, 等. 结合均值漂移分割与全卷积神经网络的高分遥感影像分类[J]. 激光与光电子学进展, 2018, 55(2): 022802.

方旭, 王光辉, 杨化超, 等. 结合均值漂移分割与全卷积神经网络的高分遥感影像分类[J]. 激光与光电子学进展, 2018, 55(2): 022802.

[5] 何小飞, 邹峥嵘, 陶超, 等. 联合显著性和多层卷积神经网络的高分影像场景分类[J]. 测绘学报, 2016, 45(9): 1073-1080.

何小飞, 邹峥嵘, 陶超, 等. 联合显著性和多层卷积神经网络的高分影像场景分类[J]. 测绘学报, 2016, 45(9): 1073-1080.

He X F, Zou Z R, Tao C, et al. Combined saliency with multi-convolutional neural network for high resolution remote sensing scene classification[J]. Acta Geodaetica et Cartographica Sinica, 2016, 45(9): 1073-1080.

[6] Le QV, RanzatoM, MongaR, et al. Building high-level features using large scale unsupervised learning[C]. IEEE International Conference on Acoustics, Speech and Signal Processing, 2013: 8595- 8598.

Le QV, RanzatoM, MongaR, et al. Building high-level features using large scale unsupervised learning[C]. IEEE International Conference on Acoustics, Speech and Signal Processing, 2013: 8595- 8598.

[8] AgarwalA, El-GhazawiT, El-AskaryH, et al. Efficient hierarchical-PCA dimension reduction for hyperspectral imagery[C]. IEEE International Symposium on Signal Processing and Information Technology, 2008: 353- 356.

AgarwalA, El-GhazawiT, El-AskaryH, et al. Efficient hierarchical-PCA dimension reduction for hyperspectral imagery[C]. IEEE International Symposium on Signal Processing and Information Technology, 2008: 353- 356.

[9] Pan ZJ, Rust AG, BolouriH. Image redundancy reduction for neural network classification using discrete cosine transforms[C]. IEEE-INNS-ENNS International Joint Conference on Neural Networks, 2000, 3: 3149- 3155.

Pan ZJ, Rust AG, BolouriH. Image redundancy reduction for neural network classification using discrete cosine transforms[C]. IEEE-INNS-ENNS International Joint Conference on Neural Networks, 2000, 3: 3149- 3155.

[11] 孙继平, 刘剑桥. 基于离散余弦变换低频分量特征及学习向量量化的煤岩识别方法[J]. 工矿自动化, 2015, 41(11): 1-6.

孙继平, 刘剑桥. 基于离散余弦变换低频分量特征及学习向量量化的煤岩识别方法[J]. 工矿自动化, 2015, 41(11): 1-6.

Sun J P, Liu J Q. Coal and rock recognition method based on low frequency component characteristics of discrete cosine transform and learning vector quantization[J]. Industry & Mine Automation, 2015, 41(11): 1-6.

[12] Zou XY, Xu XM, Qing CM, et al. High speed deep networks based on Discrete Cosine Transformation[C]. IEEE International Conference on Image Processing, 2014: 5921- 5925.

Zou XY, Xu XM, Qing CM, et al. High speed deep networks based on Discrete Cosine Transformation[C]. IEEE International Conference on Image Processing, 2014: 5921- 5925.

[13] 严珍珍, 刘建军. 基于离散余弦变换的图像压缩编码方法及改进[J]. 计算机技术与发展, 2016( 1): 147- 149.

严珍珍, 刘建军. 基于离散余弦变换的图像压缩编码方法及改进[J]. 计算机技术与发展, 2016( 1): 147- 149.

Yan ZZ, Liu JJ. Improved image compression coding method based on discrete cosine transform[J]. Computer Technology and Development, 2016( 1): 147- 149.

Yan ZZ, Liu JJ. Improved image compression coding method based on discrete cosine transform[J]. Computer Technology and Development, 2016( 1): 147- 149.

[14] Dai CN. SVM visual classification based on weighted feature of genetic algorithm[C]. IEEE Sixth International Conference on Intelligent Systems Design and Engineering Applications, 2015: 786- 789.

Dai CN. SVM visual classification based on weighted feature of genetic algorithm[C]. IEEE Sixth International Conference on Intelligent Systems Design and Engineering Applications, 2015: 786- 789.

[16] 许夙晖, 慕晓冬, 赵鹏, 等. 利用多尺度特征与深度网络对遥感影像进行场景分类[J]. 测绘学报, 2016, 45(7): 834-840.

许夙晖, 慕晓冬, 赵鹏, 等. 利用多尺度特征与深度网络对遥感影像进行场景分类[J]. 测绘学报, 2016, 45(7): 834-840.

Xu S H, Mu X D, Zhao P, et al. Scene classification of remote sensing image based on multi-scale feature and deep neural network[J]. Acta Geodaetica et Cartographica Sinica, 2016, 45(7): 834-840.

Article Outline

刘芳, 路丽霞, 黄光伟, 王洪娟, 王鑫. 基于离散余弦变换和深度网络的地貌图像分类[J]. 光学学报, 2018, 38(6): 0620001. Fang Liu, Lixia Lu, Guangwei Huang, Hongjuan Wang, Xin Wang. Landform Image Classification Based on Discrete Cosine Transformation and Deep Network[J]. Acta Optica Sinica, 2018, 38(6): 0620001.