基于AR-WLD和分块相似度加权的遮挡表情识别  下载: 892次

下载: 892次

1 引言

近年来,表情识别作为情感认知最自然直观的方式,在智能化人机交互中具有广阔的应用前景,已然成为计算机视觉和模式识别领域的研究热点[1-4]。目前受控环境下的人脸表情识别日趋成熟,但在自然环境下,现有算法的识别性能远未达到实用要求,其中面部遮挡(包括自然环境中的眼镜、口罩、围巾以及随机遮挡等)是阻碍稳健人脸表情识别研究发展的重要因素之一[5]。伴随着图像处理、模式识别和计算机技术的推陈出新,提出了很多针对遮挡的算法,而对遮挡区域重构是处理这一类问题中常用的方法。Saito等[6]提出将存在遮挡的人脸投影到训练集的特征脸空间中,再通过其线性拟合重构被遮挡的人脸。Park等[7]在经典的主成分分析[8]重构基础上融合误差补偿算法,有效重构了面部遮挡区域。重构的方法虽然能够在一定程度上改善图像的质量,但也存在着弊端:1) 遮挡区域的检测和重构只能尽量缩小误差而无法消除误差;2) 重构过程中很可能会引入噪声,对判别结果造成影响;3) 重构还会增加算法的时间开销。Ghiasi等[9]利用面部特征点对齐的方法进行遮挡条件下的辨别,该方法由于需要将遮挡数据加入到训练过程中,因此难以应对现实中不可预测的遮挡情况。Zhang等[10]利用蒙特卡罗算法从训练图像中提取一组基于Gabor的部分面部模板,并将这些模板转换为模板匹配距离特征,由于遮挡部位只占随机模板的一部分,故所产生的特征向量对遮挡稳健。Dapogny等[11]利用随机森林对人脸的随机局部子空间进行训练,利用分层自动编码器得出的置信度对输出的局部预测结果进行加权,从而改善遮挡对识别的影响。Zhi等[12]提出基于图形保留的稀疏非负矩阵分解算法,以完成遮挡表情图像的分类判别,其可以进行无、有监督的特征降维,改善识别效果。Liu等[13]为了解决在遮挡情况下,表情关键信息缺失的问题,提出局部韦伯描述子直方图和决策层融合的表情判别方法。

由于遮挡会造成部分信息的缺失和引入干扰噪声,导致表情判别准确率下降,需要通过设计稳健的特征提取算法和分类方法来减少遮挡对判别的影响。研究表明:相比于直接提取人脸整体信息的全局特征,局部特征因更侧重于描述人脸图像的细节变化以及对局部遮挡不敏感而越来越多地应用在表情判别中。典型的局部描述子有尺度不变特性变换(SIFT)、局部二值模式(LBP)[14]和局部梯度编码(LGC)[15]等。有效的局部描述子是保证表情判别精度的关键,研究人员不断提出了新的局部描述子。韦伯局部特征是由Chen等[16]根据韦伯定律提出的一种能够有效刻画灰度细节变化的局部特征。与LBP、LGC及其他局部描述子相比,韦伯局部描述子(WLD)特征独有的优点体现在:通过计算其差分激励,不仅判别图像中当前像素和邻域像素之间灰度值的变化,而且反映了这个变化量相对于当前像素的灰度值的比例;而利用其方向信息计算图像的梯度方向,能够直观地反映图像纹理变化的方向信息。近年来,不少研究者将WLD算法应用在人脸检测[16]和识别[17]上,通过实验验证了其对光照变化、噪声信息及小面积局部遮挡的稳健性。由于WLD在进行纹理特征描述时,邻域大小固定为中心像素点的方形区域,不可扩展,缺乏对不同尺度的纹理描述能力,因此当图像存在较大面积遮挡时,WLD算法的判别能力会急剧下降[17]。受到文献[ 18]和[19]的启发,本文提出非对称邻域韦伯局部描述子(AR-WLD),将WLD进行多尺度分析,邻域范围扩展到不同尺度,旨在更为充分地考虑邻域内像素点的灰度值变化和方向信息,增强算子对遮挡的稳健性和判别力。

进一步考虑面部不同区域包含的判别信息量不同,对分类结果的贡献度不同,为了减少遮挡区域对分类决策的干扰,本文提出一种距离相似度加权的表情判别方法。先对表情图像进行不重叠分块,利用AR-WLD获取不同区域的纹理描述特征;再计算待测样本与训练集样本对应子块的欧氏距离,从而得到相似度矩阵;引入信息熵[20]衡量不同子块包含的不确定信息,依据信息量大小定义距离相似度的权重;通过分块相似度加权,实现待测表情的判别。

2 AR-WLD

2.1 WLD

韦伯定律表明刺激的增量阈值与原始刺激之间的比值是一个常量,其反映了人类对图像的感知不仅依赖于刺激的变化,还与原始刺激强度有关。受此启发,文献[ 16]提出WLD特征,并引入两个比率来表示差分激励和方向,以此描述图像特征。

1) 差分激励

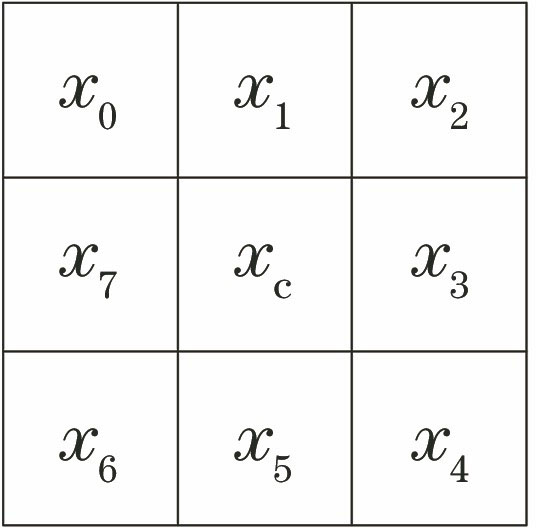

传统的WLD特征采用3×3的方形邻域,如

式中

2) 方向

WLD中的方向即为中心像素点的梯度方向,其计算式为

式中

3) WLD直方图

为了使WLD特征更具有判别性,通常将差分激励和方向用一维直方图联合表征。先将差分激励按主方向进行编排得到

2.2 AR-WLD

基本的WLD算子主要采用3×3的窗口单元,它仅能覆盖有限的区域范围,为了适应不同尺度的需求,将3×3邻域扩展为不同半径的方形邻域,如

AR-WLD特征将邻域窗口划分为9个子块,每个子块对应一个强度值,则AR-WLD特征的差分激励与方向的计算方式与基于3×3邻域的WLD特征相同。

3 基于分块相似度加权的遮挡表情判别方法

遮挡区域的处理对实现稳健的表情识别具有重要意义。传统的匹配方法是直接将待测图像的描述特征与训练样本集中的样本进行相似度比对,获取分类结果,而忽略面部不同区域对识别结果的贡献度差异。为了降低遮挡区域对表情判别的影响,建立一个更加稳健的表情识别系统,将人脸图片以非重叠的方式分成多块,每块均进行单独处理,利用AR-WLD获取局部纹理特征,每一个子块的信息熵决定子块的贡献度;在分类阶段,算法主要依靠较少遮挡或者没有遮挡的区域进行识别,获取最终的表情判别结果。

图 3. 不同邻域大小的差励图

Fig. 3. Differential excitation images under different neighborhood sizes

3.1 不同子块相似度的度量

对表情图像进行分块后,分别计算待测样本

式中

3.2 基于信息熵权值的确定

信息熵表明了图像所包含信息量的大小,信息熵值越大,包含的信息量越多;反之,熵值越小,则信息量越少。利用信息熵求各子块权重的步骤如下:

1) 利用3×3的滑动窗口求出待测样本的信息熵图,信息熵

式中

2) 将信息熵图进行非重叠分块,计算每个子块的信息熵权重

式中

3) 待测样本

4) 依据最小距离相似度得到待测表情的判别结果为

4 实验结果与分析

4.1 遮挡图像模拟

为了验证本文方法对遮挡表情识别的有效性,采用JAFFE和CK人脸表情库进行相关实验验证。由于这两个库中的人脸图像均在无遮挡条件下采集,因此对人脸图像进行了遮挡模拟,主要分为:1) 眼镜和口罩遮挡;2) 随机遮挡块(大小不同且遮挡位置随机);3) 不同类型的障碍物遮挡(遮挡位置随机),如杯子、花、书、纸币以及卡通图片。部分遮挡样本如

图 4. 部分遮挡模拟样本。(a) JAFFE库;(b) CK库

Fig. 4. Partial occluded simulation samples. (a) JAFFE database; (b) CK database

4.2 实验描述

JAFFE库是由10名日本女性的7种基本表情(生气、厌恶、恐惧、高兴、悲伤、惊讶及中性)图像构成,每人每种表情包括3~4幅图像,总共213幅。实验选取每人每种表情的2~3幅图像作为训练样本,余下的作为测试样本。CK库由210个对象的6种表情(生气、厌恶、恐惧、高兴、悲伤及惊讶)序列构成,每个表情序列都是从平静的状态开始,情绪逐渐增强,最后达到最夸张的状态。选用表情序列中最夸张的图像作为实验样本,从21个对象中选取6种表情,每人每种表情选4幅(其中,任选2幅作训练,余下2幅作测试),共400幅。先利用Viola-Jones人脸检测算法检测并提取人脸区域,然后将人脸图像归一化为96 pixel×96 pixel。在JAFFE库和CK库上分别对测试样本进行

4.3 实验结果分析

4.3.1 本文算法

AR-WLD特征的邻域大小可扩展,邻域过小会对噪声敏感,而邻域过大又会降低特征的判别能力,同时随着邻域大小的增加,分类时间也会随之增加。为了确定最佳邻域,在不同随机块遮挡类型上,针对不同邻域大小进行相关实验,如

图 5. 不同邻域大小的识别率对比。(a) JAFFE库;(b) CK库

Fig. 5. Comparison of recognition rate of different neighborhood sizes. (a) JAFFE database; (b) CK database

由

4.3.2 不同算法的性能比较

本文算法与基本的WLD特征及几种常用的局部特征提取算法进行了实验对比。为了保证实验的公平性,除特征提取方法外,其他实验条件均相同。

图 6. 不同特征提取算法识别率对比。(a) JAFFE库;(b) CK库;(c) JAFFE库;(d) CK库

Fig. 6. Comparison of recognition rate of different feature extraction algorithms. (a) JAFFE database; (b) CK database; (c) JAFFE database; (d) CK database

图 7. 不同遮挡表情识别方法识别率对比。(a) JAFFE库;(b) CK库;(c) JAFFE库;(d) CK库

Fig. 7. Comparison of recognition rate of different occluded expression recognition methods. (a) JAFFE database; (b) CK database; (c) JAFFE database; (d) CK database

为了进一步验证本文算法对遮挡问题的有效性和稳健性,与文献[

5]、[10]和[13]中的算法进行识别率对比。为了保证实验在相同环境下进行,选用相同的样本进行实验对比,并省去了文献[

5]预处理过程中的高斯滤波过程,实验结果如

文献[ 5]主要针对人脸图像的关键部位提取特征,当这些关键部位存在遮挡时,算法性能会大大降低。而本文算法是对整幅图像进行特征提取,能够有效降低遮挡对识别的影响。相比文献[ 10],本文算法不需要进行模板匹配,大大降低了时间和运算复杂度。文献[ 13]对各子块的判别结果采用多数投票法决定最终的分类,而本文采用分块相似度加权的方法进行判别,相比于前者,可以获得更多判别表情类别的鉴别信息,大大降低误判的可能性。

为了验证本文方法对表情识别的有效性,将本文方法与其他优秀的表情识别方法在无遮挡条件下进行了识别率对比,结果如

表 1. 本文算法与其他表情识别方法的识别率对比

Table 1. Comparison of recognition rate of different expression recognition methods

| |||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||||

5 结论

针对在遮挡情况下,传统的WLD在表征局部纹理信息上的不足,提出了AR-WLD特征提取算法。AR-WLD的特征更为全面地考虑邻域内不同尺度内的像素点间的灰度变化关系,可以获取多尺度下的局部纹理特征。为了进一步提高特征之间相似度表征的判别能力,降低遮挡区域对判别的干扰,通过对待测表情进行非重叠分块,引入信息熵来度量不同子块的贡献度,利用相似度加权的方法,获取分类结果。实验结果表明:AR-WLD在大遮挡情况下有效地改善了WLD的局部表征能力和判别力,分块相似度加权的分类方法实现了对遮挡的稳健性,大大降低误判的可能性。

[1] 李雅倩, 李颖杰, 李海滨, 等. 融合全局与局部多样性特征的人脸表情识别[J]. 光学学报, 2014, 34(5): 0515001.

[4] 胡敏, 江河, 王晓华, 等. 基于几何和纹理特征的表情层级分类方法[J]. 电子学报, 2017, 45(1): 164-172.

Hu M, Jiang H, Wang X H, et al. A hierarchical classification method of expressions based on geometric and texture features[J]. Acta Electronica Sinica, 2017, 45(1): 164-172.

[5] 王晓华, 李瑞静, 胡敏, 等. 融合局部特征的面部遮挡表情识别[J]. 中国图象图形学报, 2016, 21(11): 1473-1482.

Wang X H, Li R J, Hu M, et al. Occluded facial expression recognition based on the fusion of local features[J]. Journal of Image and Graphics, 2016, 21(11): 1473-1482.

[6] SaitoY, KenmochiY, KotaniK. Estimation of eyeglassless facial images using principal component analysis[C]// Conference on Image Processing, 1999, 4: 197- 201.

[8] 陈曌, 侯园园, 徐建程. 主元分析相位提取算法的符号确定及误差分析[J]. 中国激光, 2016, 43(1): 0108002.

[9] GhiasiG, Fowlkes CC. Occlusion coherence: localizing occluded faces with a hierarchical deformable part model[C]// Proceedings of IEEE Conference on Computer Vision and Pattern Recognition, 2014: 1899- 1906.

[13] Liu SS, ZhangY, Liu KP. Facial expression recognition under partial occlusion based on Weber local descriptor histogram and decision fusion[C]// Proceedings of the 33rd Chinese Control Conference, 2014: 4664- 4668.

[14] 赵高鹏, 沈玉鹏, 王建宇. 基于核循环结构的自适应特征融合目标跟踪[J]. 光学学报, 2017, 37(8): 0815001.

Zhao G P, Shen Y P, Wang J Y. Adaptive feature fusion object tracking based on circulant structure with Kernel[J]. Acta Optica Sinica, 2017, 54(8): 0815001.

[17] GongD, LiS, XiangY. Face recognition using the Weber local descriptor[C]// Proceedings of the first Asian Conference on Pattern Recognition, 2011: 589- 592.

[18] Naika C LS, Das PK, Nair SB. Asymmetric region local binary pattern operator for person-dependent facial expression recognition[C]// Proceedings of 2012 International Conference on Computing, Communication and Applications, 2012: 1- 5.

[19] 胡敏, 程轶红, 王晓华, 等. 基于非对称局部梯度编码的人脸表情识别[J]. 中国图象图形学报, 2015, 20(10): 1313-1321.

Hu M, Cheng Y H, Wang X H, et al. Facial expression recognition based on asymmetric region local gradient coding[J]. Journal of Image and Graphics, 2015, 20(10): 1313-1321.

[20] 夏军, 裴东, 王全州, 等. 融合Gabor特征的局部自适应三值微分模式的人脸识别[J]. 激光与光电子学进展, 2016, 53(11): 111004.

[21] Tan XY, Chen SC, LiJ, et al. Learning non-metric partial similarity based on maximal margin criterion[C]// Proceedings of 2006 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2006: 138- 145.

[22] Lv YD, Feng ZY, XuC. Facial expression recognition via deep learning[C]// Proceedings of International Conference on Smart Computing, 2014: 303- 308.

Article Outline

王晓华, 陈影, 胡敏, 任福继. 基于AR-WLD和分块相似度加权的遮挡表情识别[J]. 激光与光电子学进展, 2018, 55(4): 041013. Xiaohua Wang, Ying Chen, Min Hu, Fuji Ren. Occluded Facial Expression Recognition Based on Asymmetric Region Weber Local Descriptor and Block Similarity Weighting[J]. Laser & Optoelectronics Progress, 2018, 55(4): 041013.