不同重建深度的微图像阵列生成

1 引言

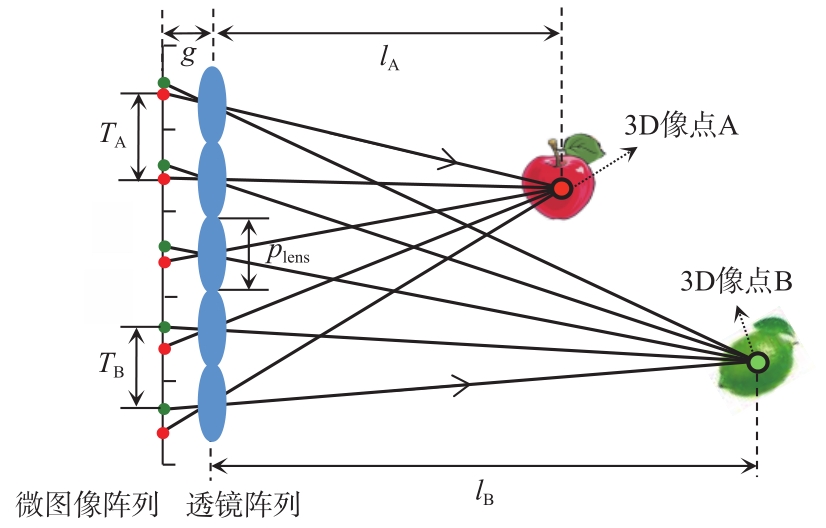

集成成像技术是目前最热门的裸眼真三维显示技术之一,它避免了立体视疲劳问题,可以实现全视差、连续视点的真三维立体成像且无需佩戴眼镜等辅助设备[1-6]。集成成像可以分为记录和再现两个过程。在记录过程中,3D信息被透镜阵列采集,并被编码为微图像阵列;在再现过程中,3D信息从微图像阵列解码,并重建3D图像。微图像阵列包含3D图像的位置和角度信息,以产生正确的深度线索,缓解辐辏调节冲突。

自1908年首次提出集成成像技术以来[7],已经出现了多种生成微图像阵列的方法,计算机生成集成成像技术引起了人们的关注[8-10]。Halle提出了一种多视图渲染算法,该算法从多个角度渲染静态场景,并且来自同一视点的每组光线都使用透视投影模型进行渲染[11-12]。Jung和Koch提出了一种基于图像渲染和深度补偿插值的光场图像高效渲染方法[13]。Deng等人介绍了一种稀疏相机阵列生成微图像阵列的方法,可以将其视为两步微图像阵列生成[14-15]。Ji等人专注于倾斜的微图像阵列生成方法,以减少摩尔纹的影响[16]。Li等人引入一种多正字视锥体组合的实时计算机生成集成成像方法,充分利用了图形处理单元的可编程性来提高计算效率[17]。Sang等人提出了一种基于逆向光线追踪的高效计算机生成方法,可以认为这是实时和交互式计算机生成集成成像的一种有效途径[18]。为了在交互基础上生成高质量的3D图像,Sang等人还提出了一种基于路径追踪蒙特卡罗方法和递归卷积神经网络的微图像阵列生成方法[19]。在计算机集成成像微图像阵列生成过程中,设置的相机阵列参数需与3D物体尺寸以及系统景深相匹配,因此针对于不同的3D显示系统参数,需要重新生成对应的微图像阵列,势必会增加图像生成的复杂度。

本文分析了集成成像技术中3D像点重建深度与同名点视差的内在联系,结合图像元节距与同名点视差以及3D深度的关联关系,提出了一种基于图像元缩放变换的不同重建深度微图像阵列生成方法。对于不同的显示系统,无需对目标三维场景进行重新采集,通过简单的图像元节距调整,等效改变同名点像素的视差值,从而改变了光场的采样间隔,使得新节距下的微图像阵列可适配不同景深的集成成像显示系统,提升了微图像阵列的实用性。

2 集成成像立体深度与同名点关系

在集成成像记录过程中,3D场景中某一物点被多个透镜元记录在其覆盖的图像元中形成同名点,所有透镜元记录的图像组成了微图像阵列。在集成成像再现时,同名点间的视差值反应了3D物点的深度信息,如

图 1. 集成成像显示过程中3D像点与同名点视差的关系

Fig. 1. Relationship between 3D image point and parallax of homonymous points in integral imaging display

当系统参数一定时(以g=13.2 mm、plens=14.7 mm为例),3D像点的重建深度随同名点视差的变化曲线如

图 2. 3D像点的重建深度随同名点视差的变化曲线图

Fig. 2. Variation curve of reconstruction depth of 3D image point with parallax of homonymous points

由

图 3. 3D像点重建深度与同名点视差的关系

Fig. 3. Relationship between reconstruction depth of image point and parallax of homonymous points

3 不同深度的微图像阵列生成

根据以上分析容易发现,在系统参数(plens,g)一定时,3D像点的重建深度与同名点视差具有非线性的负相关关系,可以通过改变同名点视差值反过来改变3D像点的重建深度。然而集成成像显示系统具有有限的景深,当超出系统可以承载的景深范围时,重构的3D像点会弥散得模糊不清。因此在视差调节时,还需要考虑到3D像点重建深度范围。如

式中,l0为透镜阵列到中心深度平面的距离,可由高斯成像公式推导,具体为

基于上述分析,本文提出了一种基于图像元缩放变换的不同重建深度微图像阵列生成方法以适配不同景深范围的集成成像显示系统。由于同名点视差与图像元节距具有正相关关系,可以对图像元进行缩放变换得到新的同名点视差T ':

其中,η为图像元缩放比例并由

考虑实际透镜和像素配置时深度为离散值,在对图像元进行缩放变换时,ηT需对应像素尺寸的整数倍,因此

其中:[*]表示四舍五入取整,px表示显示面板像素尺寸的大小。

根据

3D像点重建深度随图像元缩放比例的增大而减小,如

图 5. 不同图像元缩放比例的3D像点重建深度

Fig. 5. 3D image reconstruction by elemental image array with different scalings

虽然图像元缩放比例η的变化值很小,但重建深度的变化却很大,如

轴向放大率α与原有图像深度l、g及图像元缩放比例η有关,而原有图像深度l限制在系统景深范围之内,(η-1)l的变化值较小,可以用中心深度平面处的轴向放大率近似为整个3D图像的轴向放大率,因此轴向放大率α可近似为:

3D图像垂直于透镜光轴方向的垂轴放大率为β:

由

在如

4 实验验证

我们利用3Ds Max软件搭建了3D场景及拍摄相机阵列,如

获取的微图像阵列A如

表 1. 基于深度的计算机集成成像再现实验的参数列表

Table 1. Parameter list of the depth-based computer integral imaging reconstruction

|

为了验证本文所提方法的正确性,选择基于深度的计算机再现方式进行3D再现,实验参数如

5 结论

本文分析了集成成像技术中3D像点重建深度与同名点视差的内在联系,提出一种基于图像元缩放变换的不同重建深度微图像阵列生成方法。该方法针对不同景深范围的集成成像显示系统,无需重新进行集成成像拍摄,仅通过对微图像阵列进行简单的节距变换处理就可以改变重建3D图像的深度,使微图像阵列可以与不同景深的显示系统相适配,增加了微图像阵列的实用性。通过基于深度的计算机再现实验证实了3个不同重建深度范围的3D图像重建,验证了所提方法和理论推导的正确性。本方法可以在一次集成成像拍摄的情况下,实现不同深度的3D图像再现以适配显示系统的3D景深,最大化发挥系统景深性能。

[1] 王琼华, 邓欢. 集成成像3D拍摄与显示方法[J]. 液晶与显示, 2014, 29(2): 153-158.

[6] 桑新柱, 于迅博, 陈铎, 等. 三维光显示技术研究进展[J]. 激光与光电子学进展, 2017, 54(5): 050006.

[7] LIPPMANN G. La photographie integrale[J]. Comptes-Rendus de l'Académie des Sciences, 1908, 146: 446-451.

[10] 何伟, 李强, 郭兆达, 等. 基于回返器和反射偏振片的分辨率增强集成成像3D显示器[J]. 液晶与显示, 2022, 37(5): 555-561.

[11] HALLEM W. Multiple viewpoint rendering for three-dimensional displays[D]. Massachusetts: Massachusetts Institute of Technology, 1997: 243-254.

Article Outline

杨翠妮, 李姣姣, 郭兆达, 邓欢. 不同重建深度的微图像阵列生成[J]. 液晶与显示, 2023, 38(6): 835. Cui-ni YANG, Jiao-jiao LI, Zhao-da GUO, Huan DENG. Generation of elemental image arrays for different reconstruction depths[J]. Chinese Journal of Liquid Crystals and Displays, 2023, 38(6): 835.