基于多判断和加权最小二乘优化的NSCT红外和可见图像融合

1 引言

图像融合技术可以将一个或多个传感器获得的同一个场景的多个图像进行融合,获得一个更丰富、更全面,从而能准确描述场景的综合图像。因此,融合技术在现代应用和计算机视觉中发挥着越来越重要的作用[1-4]。红外传感器得到的图像可以根据辐射差异将目标与其背景区分开来,在全天候和全天/夜条件下都能很好地工作。而可见图像以符合人类视觉系统的方式提供具有高空间分辨率和清晰度的纹理细节,与其他融合对象相比,更具有普遍性和互补性,目前已广泛应用于目标识别、检测、图像增强、监视和遥感等领域[5-8]。

基于多尺度分解(MST)图像融合方法是目前完成红外与可见光图像融合任务最有力和最常用的工具[9]。基于多尺度变换融合方案的关键在于多尺度分解方法和融合规则的选择。常用的MST方法包括拉普拉斯金字塔变换(LP)、小波变换(WT)、轮廓波变换(CT)、非下采样轮廓波变换(NSCT)、基于边缘保持滤波器的分解方法以及其他多尺度分解方法[10-15]等。然而,LP、WT只能捕获有限数量的边缘方向信息,不能正确有效地表示直线和曲线的不连续性。CT虽然具有多分辨率、多方向性和各向异性等性质[16],但是由于对图像进行上采样和下采样,缺乏平移不变性,在融合结果中容易产生吉布斯现象。NSCT作为CT的平移不变性版本,在变换域表现出更好的性能。相对于其他MST方法,NSCT具有多尺度、多方向的性质,还具有平移不变性质,变换后能量更加集中[17-18]。

除了MST方法的选择,不同子带的融合规则也是影响融合性能的另一个因素。基于单像素的融合规则的最常见的方法是“绝对最大选择”、“像素平均”方案。简单的平均或者取大可能会导致图像对比度降低,引入噪声且使重构图像不够自然[19]。基于窗口的融合规则根据当前像素的活动水平合并不同子带的系数,并通过考虑窗口中像素之间的关系来度量活动水平。目前通常使用单一特征来描述图像的属性。然而,单个特征通常是对图像的部分描述,不能获得全面的信息。常用的活动水平度量包括绝对值取大、修正拉普拉斯算子和(SML)、空间频率(SF)、熵、对比度、局部区域能量、局部区域方差、局部对比度、局域梯度等[20]。基于区域最具代表性的方法是基于显著区域的方法[1,3,8]。它可以提取图像的视觉显著区域,符合人眼视觉特性,但是针对复杂的红外图像一方面仍没有特别好的方法,另一方面都是对低频子带提取,然后通过平均或者加权平均来处理,虽然从全局出发,但是可能效果不如基于窗口的方法。

为了解决基于MST的方法所面临的这些问题,更好地提取图像信息,在NSCT领域提出了一种新的融合方案。与传统方法相比,本文所提出的方法在设计融合规则时考虑了局部结构、对比度信息、清晰度信息和亮度信息等底层特征重要性,对于不同子带的融合方案,选择多个互补的低层特征来设计。为了获取更多的视觉细节和边缘信息,采用一种加权最小二乘(WLS)优化方案来融合细节层。实验结果表明,该算法具有适应性强的优点,改善了传统方法的一些缺陷。

2 相关工作

2.1 非下采样轮廓波变换

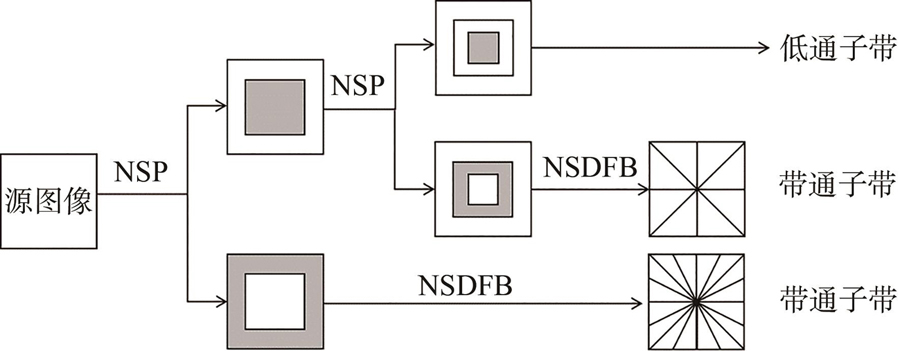

NSCT是在CT的基础上产生的。NSCT由非下采样金字塔滤波器组(NSPFB)和非下采样方向滤波器组(NSDFB)构成[10]。简单来说,NSCT过程首先使用NSPFB分解源图像得到低频和高频系数,接着采用NSDFB分解NSPFB每个阶段的高频子带,NSCT通过在多尺度分解滤波器和方向滤波器中执行上采样,而不是对图像信号执行采样操作,经过N级NSCT分解后的原图像最终可以得到

NSDFB中所有滤波器都是由单个的扇形滤波器得到的,每下一层的新方向滤波器都是对上一层扇形滤波器

式中:

2.2 加权最小二乘拟合

受文献[22]优化框架的启发,Ma等人提出了一种改进的加权最小二乘拟合(WLS)优化方案来融合细节层[23]。通过WLS代价函数来获得第j级理想融合细节层

其中:

其中

本文采用多判断规则得到细节层

图 3. 不同子带WLS和绝对值取大WLS融合结果

Fig. 3. Fusion results of different subbands WLS and absolute value of large WLS

从

3 针对不同子带提出的融合方案

基于多判断和加权最小二乘优化的NSCT红外和可见图像融合方法的框架示意图如

3.1 低频子带融合

低频子带是原始图像的平滑版本,它代表图像的轮廓。当分解层数较高时,低频子带主要包含原始图像的大部分信号能量和少量细节。为了更好地保留低频能量,获取少量结构细节信息,选择局部平方熵P(x,y)和SML相互补充,如

其中:

初始融合决策图通过选择最大组合方案获得,即选择具有最大活动度量的系数,如

为了使合成MSD中的相邻系数属于同一源图像以克服噪声的影响,保证融合图像的均匀性,在7×7窗口中使用多数滤波操作,通过一致性验证生成最终的融合决策图

3.2 高频子带融合

高通子带融合的关键是增强每个源图像的细节特征。为了提高高通子带图像的信息量,构建了一个新的活动水平度量NAM2,如

式中,

其中:

当获得NAM2时,可根据

对得到的权重图加权求和获得第j级近似融合细节层

接下来,为了进一步提取更多细节信息,通过以下WLS代价函数来获得第j级理想融合细节层

将

4 实验结果与分析

本文从两个方面来验证所提方法的有效性。一是验证多判断相互补充的有效性,可以提取更多信息。采用控制变量的方法,在经过NSCT分解后,通过与高频、低频单一活动水平度量的对比得到的评价指标数值结果来验证本文高频、低频子带多判断策略的有效性。二是验证高频子带在经过多判断策略后再通过最小二乘优化后的最终方法的有效性和适应性。在光照均匀性和目标类别条件下选择4组不同类型特点的红外和可见光图像进行实验验证,选择5种基于MST的具有代表性的融合算法进行比较。实验结果评价选择基于人眼视觉的主观评价和客观评价两种方式来对融合图像进行有效评价。

本文所有图像来自http://www.imagefusion.org/和https://figshare.com/articles/TNO_Image_Fusion_Data set/1008029数据库。所有实验都建立在matlab2016a平台上,NSCT选择“vk”滤波器组,塔式滤波器选择“9-7”,分解层数为4层,方向分解数分别为4、4、8、8,

4.1 实验验证1

4.1.1 低频子带策略验证

实验所需源图像如

表 2. 高频选择“绝对值最大”原则及低频选择不同方法对“Camp”和“House”的实验结果

Table 2. Experimental results of “Camp” and “House” using different methods for high-frequency selection and “maximum absolute value” principle and low-frequency selection

|

4.1.2 高频子带策略验证

图 5. 本文融合方法在不同参数

Fig. 5. Objective evaluation results of the fusion method in this paper under different parameters

在低频子带融合都选择本文策略方法的前提下,高频选择PC、SML、方差、阈值能量与本文高频多判断方法对比,实验数据值如

图 6. 低频选择“本文低频”原则,高频选择不同方法对“Camp”和“House”的实验结果。纵坐标代表数值,横坐标1、2、3、4、5代表使用方法依次是高频选择PC、SML、方差、阈值能量和本文高频多判断的方法。

Fig. 6. Principle of “low frequency of this article” is selected for low frequency,and the experimental results of “Camp” and “House” by different methods are selected for high frequency. The ordinate represents the numerical value,and the abscissa 1,2,3,4,5 represents the used method in order of high-frequency selection PC,SML,variance,threshold energy and the method of high-frequency multi-judgment in this paper.

从

4.2 实验验证2

4.2.1 主观评价

如

图 7. 不同融合算法对“Camp”和“House”的处理结果

Fig. 7. Processing results of “Camp” and “House” by different fusion algorithms

图 8. 不同融合算法对“Ship”和“Jeep”的处理结果

Fig. 8. Processing results of “Ship” and “Jeep” by different fusion algorithms

如

对于第一个场景,采用DWT_WSML方法的人物目标显著,但是图像左下角的景物失真明显,细节描述能力不够。NSCT_SML和NSCT_PC方法的人物目标显著,图像中的树木、道路等可以较好地显示。但是屋顶的目标物边缘轮廓以及栅栏细节模糊。

对于第二个场景,基于DWT_WSML的方法目标任务虽然有显著提升,但是人物轮廓模糊,建筑物亮度信息提取不够,地面细节方面提取较差,甚至出现光晕。基于NSCT_PC方法的建筑物视觉效果好,纹理细节清晰,但是目标人物不显著。综合两个场景,本文方法得到的结果是最清晰的,图像的灰度对比度高,边缘、轮廓和纹理等线条丰富清晰。

为进一步判断本文方法的适应性和通用性,选择光照均匀和不均匀的海上和陆地目标进一步验证,如

第三个场景是白天拍摄的海平面上的游船。采用DWT_WSML方法的整体视觉效果有所提升,但是周围的海平面也比较模糊,船杆模糊而且不显著,而且在对轮船窗口的融合方面,DWT_WSML和NSCT_SML方法没有好的提取。NSCT_PC方法虽然对窗口有好的提取,但是纹理不是很清晰。

第四个场景是夜晚拍摄的值班士兵和吉普车。可见图像的光照不均匀、整体灰度低;红外图像的目标人物、汽车和房屋显著,细节很模糊。采用DWT_WSML方法的对比度高、目标显著,而且对天空噪声有很好的消除,但是对房屋窗口局部纹理提取效果很差。而NSCT_SML和NSCT_PC虽然对窗口有提取但是窗口纹理模糊,而且在房屋边缘出现少量光晕现象。

因此,综合4种不同类型和特点的场景,从主观融合结果上看,本文方法的目标显著、背景清晰、视觉效果好而且适应性强。为了避免人眼直接观察导致的误差影响到融合图像的评价,本文还需要使用客观条件指标来对融合图像进行评判。

4.2.2 客观评价

为了进一步定量比较各种融合方法,本节给出了融合结果的客观评估。采用平均梯度(Average Gradient,AG)、信息熵(Information Entropy,IE)、空间频率(Spatial Frequency,SF)、互信息(Mutual Information,MI)作为评价指标[2]。具体计算公式如下所示,4个指标都是值越大表示融合结果越好。

(1)平均梯度

平均梯度(AG)衡量图像中的梯度变化,即表征图像的边缘精细程度,因此可以表示图像的清晰程度,其定义如

(2)信息熵

信息熵(IE)用来度量图像中所包含信息量的多少,是衡量图像信息丰富度的重要标准,其定义为:

其中L表示灰度级的数量,pl表示融合图像中相应灰度级的归一化直方图。

(3)空间频率

空间频率(SF)是一种基于梯度的图像质量指数,即水平和垂直梯度,分别称为空间行频率(RF)和列频率(CF)。SF度量可以有效地测量图像的梯度分布,从而揭示图像的细节和纹理。其定义为:

(4)互信息

互信息(MI)用于度量融合图像与源图像之间的相似性,反映融合图像从源图像中获得信息量的多少,MI的定义如下:

其中:

如

表 3. 不同算法对“Camp”和“House”的客观评价结果

Table 3. Objective evaluation results of “Camp” and “House” by different algorithms

|

表 4. 不同算法对“Ship”和“Jeep”的客观评价结果

Table 4. Objective evaluation results of “Ship” and “Jeep” by different algorithms

|

图 9. 不同算法对“Camp”、“House”、“Ship”和“Jeep”的客观质量评价结果。

Fig. 9. Objective quality evaluation results of different algorithms for “Camp”,“House”,“Ship” and “Jeep”.

5 结论

为了克服传统融合方法和单一特征融合目标信息不够突出,细节、纹理缺失严重的问题,进一步提高目标和背景之间的对比度,抑制噪声,增强目标信息的辨识率,同时尽可能完整地保留可见光图像中的细节纹理,本文提出了一种基于多判断和加权最小二乘优化的NSCT红外和可见图像融合融合方法。针对低频、高频子带,选择多个底层特征相互补充的方式,可以在突出目标的同使获得更多细节信息,通过WLS优化和一致性检测的方式来提取更多的边缘纹理信息和减少噪声等无关细节。实验结果表明,本文所提出的方法在主观上的能量保持、细节保留、图像对比度上保留了更多的目标信息和细节信息,视觉效果也更好。在4个客观评价指标平均梯度(AG)、信息熵(IE)、空间频率(SF)、互信息(MI)中,在保证MI指标比较好的前提下,其他3个指标都处于最好的状态,尤其对光照均匀的“Camp”图像,AG和SF为3.076 4和6.641 3,与最好的数值相比,提高了6.9%和4.8%,从而验证了本文所提方法具有较好的有效性和适应性。

[2] ZHAN L C, ZHUANG Y, HUANG L D. Infrared and visible images fusion method based on discrete wavelet transform[J]. Journal of Computers, 2017, 28(2): 57-71.

[3] 郭玲, 杨斌. 基于视觉显著性的红外与可见光图像融合[J]. 计算机科学, 2015, 42(S1): 211-214,235.

GUO L, YANG B. Fusion of infrared and visible images based on visual saliency[J]. Computer Science, 2015, 42(S1): 211-214, 235.

[5] 汪廷. 红外图像与可见光图像融合研究与应用[D]. 西安: 西安理工大学, 2019. 10.23919/chicc.2019.8865405

[7] 孙雨涵. 基于图像视觉显著特征与局部结构一致化处理的图像融合方法研究[D]. 衡阳: 南华大学, 2019.

SUNY H. Research on image fusion method based on visual salient feature and local structure consistency[D]. Hengyang: University of South China, 2019. (in Chinese)

[8] 杨艳春, 高晓宇, 党建武, 等. 基于WEMD和生成对抗网络重建的红外与可见光图像融合[J]. 光学 精密工程, 2022, 30(3): 320-330.

[10] 杨彬, 黄润才, 王从澳. 基于改进的NSCT红外可见光图像融合算法[J]. 计算机与现代化, 2021(6): 48-53.

[11] 郭盼, 何文超, 梁龙凯, 等. 基于导向滤波器的医学图像融合方法[J]. 液晶与显示, 2019, 34(6): 605-612.

[17] 林剑萍, 廖一鹏. 结合分数阶显著性检测及量子烟花算法的NSST域图像融合[J]. 光学 精密工程, 2021, 29(6): 1406-1419.

[19] 丁贵鹏, 陶钢, 李英超, 等. 基于非下采样轮廓波变换与引导滤波器的红外及可见光图像融合[J]. 兵工学报, 2021, 42(9): 1911-1922.

Article Outline

王贤涛, 赵金宇. 基于多判断和加权最小二乘优化的NSCT红外和可见图像融合[J]. 液晶与显示, 2023, 38(2): 204. XIAN-tao WANG, JIN-yu ZHAO. Fusion of NSCT infrared and visible images based on multi-judgment and WLS optimization[J]. Chinese Journal of Liquid Crystals and Displays, 2023, 38(2): 204.