基于实时局部建图的激光雷达长周期定位方法

1 引言

依托于simultaneous localization and mapping(SLAM)技术的发展,物流配送、automated guided vehicle(AGV)、清扫机器人及园区接驳车等无人驾驶的轮式机器人应用广泛[1]。此类机器人主要依靠激光雷达和视觉SLAM定位技术长期运行,但是周围环境会随时间的推移发生较大或较小的变化,如周围移动的车辆和行人[2]、临时出现或消失的货物、因季节变化而改变的树木轮廓和施工造成的建筑物改变等环境变化。这些改变会导致机器人出现定位精度降低,甚至丢失等问题,如何在变化的环境中进行长期、精确、鲁棒的定位被称为SLAM的长生命周期问题[3]。

解决长生命周期问题的关键是提高对历史位置重识别的鲁棒性,可分为基于规则的方法和基于深度学习的方法。基于规则的方法通过设定参考帧与匹配帧之间的相似规则定位。文献[4]、[5]使用邻域搜索计算帧间距离判断是否回环,但基于特征匹配或基于帧间距离的方法需要环境不发生变化,限制较多。文献[6]、[7]为了提高定位精度且具有更好的鲁棒性,将点云视角及坐标进行转换,手动构建具有旋转不变性的全局空间描述子,提高了位置重识别的精度,同时该方法在具有动态物体时也能取得较好的精度。文献[8]、[9]在使用基于规则的方法检测到环境变化后,对预构建的地图进行局部替换,以保证预构建地图与周围环境的实时匹配。基于深度学习的方法通过学习参考帧和匹配帧获得定位结果。文献[10]、[11]、[12]、[13]将已构建的地图、实时采集的点云帧和采集轨迹输入端到端的网络中学习其特征描述符,再与地图中的描述符进行比较,从而进行定位。文献[14]、[15]采用相机语义信息辅助激光雷达进行定位。虽然深度学习的方法在具有动态物体和静态结构发生改变时具有较高的定位精度但是深度学习的方法需要对预构建地图和点云进行训练,且定位时间相比于上述基于规则的方法更长。

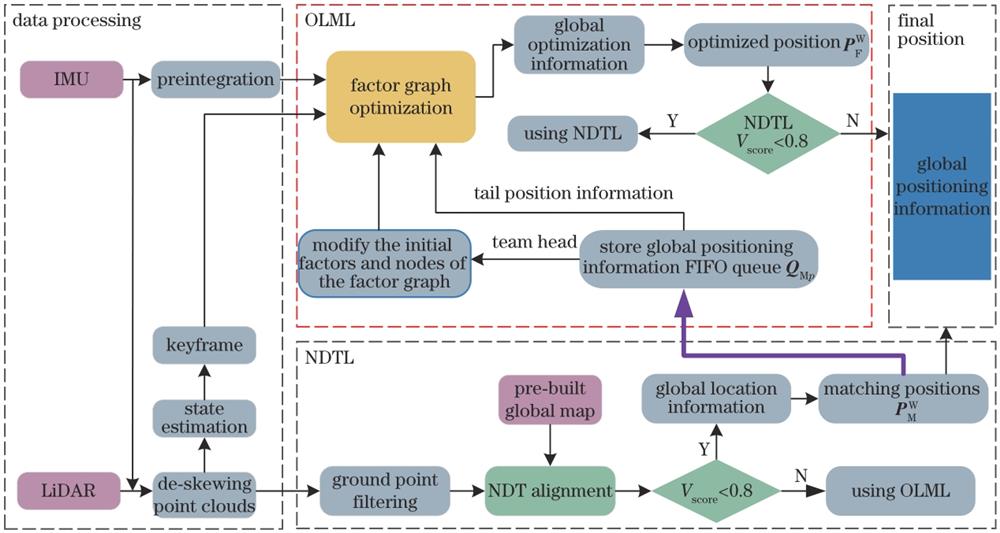

为了应对环境结构较预构建地图发生变化时产生的定位丢失和精度降低问题,本文提出一种利用激光雷达和惯性测量单元(IMU)实时构建局部地图融合normal distribution transform(NDT)定位的长周期鲁棒定位方法OL-NDT,OL-NDT由normal distributions transform localization(NDTL)和online mapping and localization(OLML)两部分组成。OLML与NDTL独立运行且相互补充,NDTL定位丢失时采用OLML输出的优化位姿作为定位结果输出,NDTL定位成功时将NDTL的定位输出位姿作为测量信息因子输入OLML的因子图中对OLML的全局位姿进行优化,该方法可有效修正OLML局部地图在世界坐标系的位姿,提高了定位精度,减少了因环境结构改变产生的定位丢失。

2 OL-NDT框架概述

OL-NDT采用激光雷达作为感知的主要传感器,虽然相机可以获得纹理信息,但是白天到晚上的光线变化和季节的变化会对相机的定位产生影响,造成定位丢失等问题[16-17],采用激光雷达作为主要传感器可以避免上述问题。

OL-NDT主要由OLML和NDTL构成,该框架的结构如

OLML引入滑动时间窗的概念,只对时间窗

在NDTL定位成功且输出位姿

2.1 NDTL

NDTL将运动补偿和地面点滤除后的激光雷达实时采集点云作为匹配帧、全局地图作为参考帧,进行NDT配准,获得当前定位。基于点云地图的NDT扫描匹配是自动驾驶和机器人领域的主流算法之一[18],NDT对环境的轻微变化具有适应性,在环境中存在较少的高动态和低动态物体且没有遮挡时仍然可以获得精准定位[19-20]。NDTL首先对预构建的全局地图进行体素划分,并计算混合高斯分布概率密度函数,其次将处理后的点云帧通过旋转矩阵变换计算对应体素内的概率密度函数得到似然函数,最后利用高斯牛顿优化算法计算最大似然对应的旋转矩阵。将似然函数的对数记为得分值

2.2 OLML

OLML是基于稀疏图优化的激光雷达和IMU结合的局部SLAM,通过OLML构建的地图称为局部地图,用

OLML前端对运动补偿后的点云帧进行面、线特征提取,通过特征匹配构建点云地图,局部地图的后端优化由因子图完成,如

2.2.1 激光雷达关键帧因子

设定激光雷达一帧扫描需要的时间为

两帧点云之间姿态变化大于阈值时为关键帧,设定两帧点云之间角度阈值为5°,距离阈值为0.5 m。该两帧可连续或非连续,初始帧直接设定为关键帧。OLML采取扫描帧到关键帧间地图的匹配方式,首先从运动补偿后的点云中提取边特征和平面特征,其次与关键帧间地图进行匹配获得当前位姿,计算当前点云帧与上一个关键帧的相对变化,当超过设定阈值时则判定当前点云帧为关键帧,并将其作为节点加入因子图中。

2.2.2 惯性测量单元预积分因子

IMU加速度计和陀螺仪分别测量对应方向上的线运动和角运动,IMU的真实值会受零偏和系统噪声影响,IMU在

式中:

由IMU获得时刻

定义IMU在

将

3 实验与分析

3.1 数据集说明

为了验证OL-NDT的定位精度和鲁棒性,采用长周期数据集MulRan[23]进行实验。该数据集是64线Ouster激光雷达、IMU、GPS和超声波雷达组合构建的城市环境多模态数据集。MulRan数据集多次重复经过同一个地方,具有较长的时间跨度和明显的空间结构变化,可以有效验证算法定位精度和重识别情况,同时该数据集提供了真值可以进行轨迹对比。该数据集包含Riverside、KAIST、DCC和Sejong city等4个不同地点在不同时间采集的数据,本实验采用KAIST和DCC数据。KAIST和DCC数据时间序列和长度信息如

表 1. 数据集详细信息

Table 1. Dataset details

| |||||||||||||||||||||||

为了验证OL-NDT在较短未知路段的定位精度,用旋风智能车平台在北京联合大学校园采集了校园数据集,下文简称为BUU数据。BUU数据由velodyne16线激光雷达和瑞芬TL740D IMU采集数据组成,在2023年1月15日和2023年2月16日采集了2组序列,分别记为BUU01和BUU02。

3.2 大范围静态结构变化定位实验分析

本实验采用DCC01构建的全局地图作为预构建地图,DCC02与DCC03作为测试数据集验证所提方法在大范围静态结构变化下的鲁棒性和定位精度。DCC数据相对KAIST较小但是结构复杂,有广场、狭窄道路、山和十字路口,且在某些环境下静态结构有较大的变化。

图 3. DCC数据静态结构永久变化示例。(a)DCC01正在施工;(b)DCC02已施工完成

Fig. 3. An example of a permanent structural change in DCC. (a) Construction in progress in DCC01; (b) construction completed in DCC02

图 4. 轨迹对比。(a)DCC02的轨迹形状与方向;(b)OL-NDT和NDT与真值的轨迹对比,框A,NDT定位丢失位置;(c)NDT与OL-NDT的绝对误差对比

Fig. 4. Trajectory comparison. (a) The shape and direction of the DCC02 trajectory; (b) comparison of OL-NDT and NDT trajectories with ground truth, box A, lost location of NDT; (c) absolute error comparison of NDT and OL-NDT

图 5. OLML定位示意图。(a)OL-NDT定位轨迹和局部地图与全局地图的位置关系;(b)局部放大图

Fig. 5. OLML positioning schematic. (a) OL-NDT trajectory and the positional relationship between local map and global map; (b) partial enlarged map

3.3 定位精度对比实验分析

本实验采用KAIST02构建的全局地图作为预构建地图,KASIT01与KASIT03作为测试数据集验证所提方法在环境发生变化时的定位精度。KAIST中没有静态结构变化大的场景,3个不同的时间序列KASIT01、KASIT02、KASIT03中有许多短期的静态结构变化(路边停留的车辆和暂留的行人)和动态障碍物(路上行驶的大小不一的车辆)。

图 6. KAIST数据静态结构短期变化示例。(a)KAIST01路边停车情况;(b)KAIST02路边停车情况;(c)KAIST03路边停车情况

Fig. 6. An example of a short-term structural change in KAIST. (a) On-street parking situation of KAIST01; (b) on-street parking situation of KAIST02; (c) on-street parking situation of KAIST03

将OL-NDT与LIO、NDT方法在KAIST01和KAIST02数据集上进行定位精度对比实验。LIO、NDT与所提算法在KAIST01和KAIST02数据集皆完成了全路段定位(由

表 2. KAIST01和KAIST03 数据上平均绝对误差和累计误差与总路程比

Table 2. MAE and A/L on KAIST01 and KAIST03

| |||||||||||||||||||||||||||

3.4 短暂未知路段定位实验分析

本实验采用BUU01构建的全局地图作为预构建地图,BUU02作为测试数据集验证所提方法在无地图未知路段定位的可靠性和准确性。

图 7. 北京联合大学校园数据示意图。(a)校园数据鸟瞰图;(b)校园数据全局地图,框E为无地图的场景

Fig. 7. Schematic of the campus data of Beijing Union University. (a) Aerial view of campus data; (b) global map of campus data, box E shows the a scene without a map

实验设计行驶轨迹从全局地图中的右上角已知区域出发,到未知区域E后,再次进入到已知区域。

图 8. 未知区域定位结果示意图。(a)OL-NDT定位轨迹和局部地图与全局地图的位置关系;(b)全局地图未知区域E的放大图;(c)局部地图未知区域E的放大图

Fig. 8. Schematic of the result of the no-map position.(a) OL-NDT trajectory and local map relations with global map; (b) an enlarged view of the no-map region E of the global map. (c) an enlarged view of the no-map region E of the local map

图 9. 未知区域下定位得分

Fig. 9. Comparison of localization score

4 结论

提出结合NDTL和OLML的可长期鲁棒定位的定位方法OL-NDT。OL-NDT在MulRan数据集上表现出在具有动态障碍物变化和静态结构变化下仍具有精确定位的能力,在变化环境中仍可长期、鲁棒运行,累计误差占比较LIO和NDT算法分别降低了1.06个百分点和0.83个百分点。在北京联合大学的校园数据上,在地图缺失的未知区域的定位轨迹可与全局地图匹配。

所提方法在部分位置发生变化时可进行精确定位,但若运行环境结构变化较多,无法由NDTL定位修正OLML的输出位姿时,则需要在检测到地图匹配环境发生变化后,将其对应的变化更新在初始的全局地图上,所以后续的工作将在检测到环境变化后对全局地图进行高效、精准的地图更新。

[1] Xu X B, Zhang L, Yang J A, et al. A review of multi-sensor fusion SLAM systems based on 3D LIDAR[J]. Remote Sensing, 2022, 14(12): 2835.

[2] 徐陈, 周怡君, 罗晨. 动态场景下基于光流和实例分割的视觉SLAM方法[J]. 光学学报, 2022, 42(14): 1415002.

[3] ShiX S, LiD J, ZhaoP P, et al. Are we ready for service robots? the OpenLORIS-scene datasets for lifelong SLAM[C]∥2020 IEEE International Conference on Robotics and Automation (ICRA), May 31-August 31, 2020, Paris, France. New York: IEEE Press, 2020: 3139-3145.

[4] ShanT X, EnglotB, MeyersD, et al. LIO-SAM: tightly-coupled lidar inertial odometry via smoothing and mapping[C]∥2020 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), October 24-January 24, 2021, Las Vegas, NV, USA. New York: IEEE Press, 2021: 5135-5142.

[5] HessW, KohlerD, RappH, et al. Real-time loop closure in 2D LIDAR SLAM[C]∥2016 IEEE International Conference on Robotics and Automation (ICRA), May 16-21, 2016, Stockholm, Sweden. New York: IEEE Press, 2016: 1271-1278.

[6] Kim G, Choi S, Kim A. Scan context: structural place recognition robust to rotation and lateral variations in urban environments[J]. IEEE Transactions on Robotics, 2022, 38(3): 1856-1874.

[7] 常耀辉, 陈年生, 饶蕾, 等. 动态环境下具有旋转和平移不变性的激光雷达点云描述子[J]. 光学学报, 2022, 42(24): 2401007.

[8] DingW D, HouS H, GaoH, et al. LiDAR inertial odometry aided robust LiDAR localization system in changing city scenes[C]∥2020 IEEE International Conference on Robotics and Automation (ICRA), May 31-August 31, 2020, Paris, France. New York: IEEE Press, 2020: 4322-4328.

[9] ZhaoM, GuoX, SongL, et al. A general framework for lifelong localization and mapping in changing environment[C]∥2021 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), September 27-October 1, 2021, Prague, Czech Republic. New York: IEEE Press, 2021: 3305-3312.

[10] LuW X, ZhouY, WanG W, et al. L3-net: towards learning based LiDAR localization for autonomous driving[C]∥2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), June 15-20, 2019, Long Beach, CA, USA. New York: IEEE Press, 2020: 6382-6391.

[11] WiesmannL, MarcuzziR, StachnissC, et al. Retriever: point cloud retrieval in compressed 3D maps[C]∥2022 International Conference on Robotics and Automation (ICRA), May 23-27, 2022, Philadelphia, PA, USA. New York: IEEE Press, 2022: 10925-10932.

[12] Luo L, Cao S Y, Han B, et al. BVMatch: lidar-based place recognition using bird’s-eye view images[J]. IEEE Robotics and Automation Letters, 2021, 6(3): 6076-6083.

[13] VidanapathiranaK, RamezaniM, MoghadamP, et al. LoGG3D-net: locally guided global descriptor learning for 3D place recognition[C]∥2022 International Conference on Robotics and Automation (ICRA), May 23-27, 2022, Philadelphia, PA, USA. New York: IEEE Press, 2022: 2215-2221.

[14] 任丽军, 刘元盛, 钟科娣. 基于改进PFPN的语义地图构建方法研究[J]. 激光与光电子学进展, 2022, 59(4): 0428002.

[15] 蒋林, 刘奇, 雷斌, 等. 激光与视觉融合识别并构建语义地图改善定位性能[J]. 中国激光, 2022, 49(18): 1810003.

[17] Kazerouni I A, Fitzgerald L, Dooly G, et al. A survey of state-of-the-art on visual SLAM[J]. Expert Systems With Applications, 2022, 205: 117734.

[18] Javanmardi E, Javanmardi M, Gu Y L, et al. Pre-estimating self-localization error of NDT-based map-matching from map only[J]. IEEE Transactions on Intelligent Transportation Systems, 2021, 22(12): 7652-7666.

[19] AkaiN, MoralesL Y, TakeuchiE, et al. Robust localization using 3D NDT scan matching with experimentally determined uncertainty and road marker matching[C]∥2017 IEEE Intelligent Vehicles Symposium (IV), June 11-14, 2017, Los Angeles, CA, USA. New York: IEEE Press, 2017: 1356-1363.

[20] Zhong K D, Liu Y S, Yang J S, et al. A factor graph optimization mapping based on normaldistributions transform[J]. Turkish Journal of Electrical Engineering and Computer Sciences, 2022, 30(3): 1127-1141.

[22] Forster C, Carlone L, Dellaert F, et al. On-manifold preintegration for real-time visual: inertial odometry[J]. IEEE Transactions on Robotics, 2017, 33(1): 1-21.

[23] KimG, ParkY S, ChoY, et al. MulRan: multimodal range dataset for urban place recognition[C]∥2020 IEEE International Conference on Robotics and Automation (ICRA), May 31-August 31, 2020, Paris, France. New York: IEEE Press, 2020: 6246-6253.

Article Outline

齐含, 刘元盛, 张军, 满恂钰, 张志铭. 基于实时局部建图的激光雷达长周期定位方法[J]. 激光与光电子学进展, 2024, 61(4): 0428001. Han Qi, Yuansheng Liu, Jun Zhang, Xunyu Man, Zhiming Zhang. Long-Period Localization Method for LiDAR Based on Local Mapping[J]. Laser & Optoelectronics Progress, 2024, 61(4): 0428001.