多传感器融合的激光雷达点云矫正与定位方法【增强内容出版】

1 引言

近些年来,随着社会智能化的不断进步,机器人、自动驾驶等领域都取得了长足的发展[1]。智能体的进一步应用和推广都需要在无任何人工的操控下,在复杂、多变的室内外场景下执行任务。而精准地感知自身的位置和周围场景是执行各种任务的必要条件,同时定位与建图(SLAM)技术正是当下智能体定位技术的核心。SLAM技术指:承载特定传感器的主体在不知道外界环境的任何信息的情况下,对自己本身位姿进行估计,并且能够建立环境信息。对于SLAM技术,传感器是系统获取环境信息的最重要工具[2]。激光雷达以激光束作为信息载体,可以提供高精度的环境深度信息,同时具有很高的角分辨率、速度分辨率和距离分辨率,在机器人定位领域存在大量应用[3]。但是激光雷达在动态环境下存在点云畸变的问题,并且里程计误差会在匹配过程中随距离增加不断累积,造成定位精度降低。

目前,国内外学者针对如上问题已经进行了相关研究。文献[4]中的方法利用匀速模型计算一帧点云中各激光点的具体位姿,该方法在复杂运动场景中无法起到较好的效果。文献[5]提出了一种基于激光扫描角度固定模型的改进方法,该方法利用激光数据的时间间隔估算点云位姿,但是利用的二次插值假设依然过于简单,无法适应复杂运动环境。文献[6]利用相干调频连续波激光雷达技术对点云畸变进行补偿,但对激光的线宽、线性调频脉冲的频率范围等条件要求相对较高。文献[7]提出具有旋转和平移不变性的描述子,利用非线性优化直接补偿畸变造成的定位误差,但算法对计算实时性要求较高。

以上研究表明利用数学模型解决点云畸变问题的效果有限,利用优化等其他方式,使用条件相对苛刻。研究人员开始考虑利用多传感器的方式解决畸变问题。Shan等[8]考虑到惯性测量单元(IMU)的可用性,在IMU不可用时利用匀速模型进行点云位姿估计,在IMU可用时利用其获得运动线性加速度,优化匀速模型消除畸变。但是IMU本身也存在误差累积的问题,算法效果并不理想。文献[9]利用多传感器辅助激光雷达进行自补偿和自校正,提高了激光雷达自身的定位精度。文献[10]利用视觉里程计消除点云畸变,但在高速运动场景下不能保证计算的准确性。文献[11]提出一种基于无迹卡尔曼滤波(UKF)算法的点云补偿方案,利用雷达位姿和IMU位姿融合进行畸变去除,该方案需要大量的计算工作,当环境特征结构不清晰或者发生变化时,无法有效消除累积误差。

综上,学界的研究表明,利用激光雷达一种传感器,模拟运动模型的方案无法适应复杂运动场景,很难消除点云畸变,需要利用多传感器融合解决此问题;同时需要减少复杂计算,保证系统整体在复杂动态场景下的鲁棒性和定位准确性。

为了解决上述问题,本文提出一种融合惯性测量单元数据和轮速计数据的激光雷达点云畸变矫正和定位方法。针对运动状态中时刻发生的点云畸变,利用IMU和轮速计分别具有较高的角速度测量精度和较高的局部位移测量精度的特点,准确矫正激光雷达因运动产生的点云畸变,并将矫正过程中计算的位姿作为雷达里程计迭代计算的初值,减小计算复杂度,提高系统整体的定位精度与实时性。

2 激光雷达点云畸变失真与补偿原理

2.1 激光雷达点云畸变原理

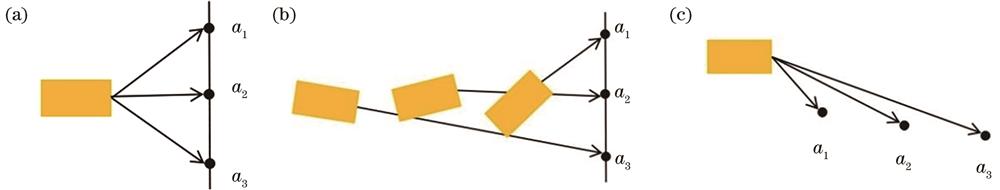

激光雷达由内部电机驱动,每一帧激光雷达点云数据都由一定数量的激光束所获得的数据信息封装组成,默认一帧数据获得的时刻是相同的,但实际上,这些数据并不是瞬时获得的。当激光扫描伴随着空间运动时,一帧数据中的每个数据被认为皆处于同一坐标系下,但实际上,它们被获取时的移动坐标系各不相同,这会造成各点间坐标系的转换错误,导致点云出现畸变,这种畸变会在雷达运动过程中不断发生。如

图 1. 激光雷达点云畸变产生示意图。(a)初始时刻雷达扫描情况;(b)运动状态的雷达扫描情况;(c)失真的点云坐标情况

Fig. 1. Schematic of LiDAR point cloud distortion generation. (a) LiDAR scanning at initial time; (b) LiDAR scanning at motion state; (c) point cloud coordinates with distortion

2.2 激光雷达点云畸变失真补偿原理

激光雷达每旋转一周封装一帧数据,每一帧数据中有许多的雷达点云数据。对于畸变补偿,需要将一帧数据中的所有点云数据都投影到初始时刻的点云数据所处的坐标系下。每个激光点的坐标矩阵可表达为

式中:

式中:

式中:

第

式中:

一帧雷达数据具有初始时刻和终止时刻两个时间节点,可以通过预积分的方法计算两个时刻间的IMU数据的相对位姿,之后利用插值,计算出雷达对应时刻的旋转量。对于里程计信息,计算两个时刻间的平移变化后,再通过插值计算对应时刻的平移量。对于IMU数据,求解旋转的过程可以表示为

式中:

式中:

因为IMU和轮速计的更新频率相对较高,可以利用插值的方式对其与激光雷达数据的时刻进行对齐。假设激光数据在

式中:

式中:

式中:

3 基于点云畸变失真补偿的激光雷达里程计改进方法

利用IMU和轮速计在局部角速度和局部位移上的精度优势,将它们计算得到的位姿作为激光里程计迭代计算的初值,可以减少迭代次数并补偿激光里程计本身存在的累积误差,以达到降低计算复杂度、提高定位精度的目的[14-15]。将需要匹配的两对点云位姿矩阵集合记为

对于每一个空间栅格,均值和方差分别为

式中:

式中:

式中:

对于每次迭代的初始位姿

4 分析与讨论

为了验证所提方法的有效性和可行性,利用公开数据集与实地室内退化环境进行实验验证,并分析实验结果。

4.1 激光雷达点云畸变去除验证

为了验证所提方法对点云畸变去除的效果,需要在静态环境中完成实验。机器人在静态环境中做周期性的旋转和平移运动,使得采集到的坐标也呈周期性,用以定量比较。在静止条件下,将获得的无畸变的点云坐标作为真值;在运动条件下点云会不断发生畸变,记录所提算法修正后的点云坐标,对其与LOAM方法和F-LOAM方法的畸变去除情况进行定量对比。LOAM算法在畸变去除环节采用简单的匀速模型对畸变点云进行补偿,F-LOAM算法在此基础上进行改进,在位姿解算环节再进行一次点云畸变去除的工作,获得了相对更好的畸变去除效果,但两者均没有采用多传感器的方案进行畸变补偿。三种方法的实验结果如

图 3. 激光雷达点云畸变修正结果。(a)x方向坐标修正情况;(b)y方向坐标修正情况

Fig. 3. Schematic of correction results of LiDAR point cloud distortion. (a) Diagram of correction of x-direction coordinates; (b) diagram of correction of y-direction coordinates

表 1. 三种算法在两个方向上的误差结果对比

Table 1. Comparison of error results in two directions of the three algorithms

|

由

图 4. 走廊环境下不同点云畸变矫正方法的点云视图。(a)未进行畸变补偿的点云视图;(b)LOAM方法;(c)F-LOAM方法;(d)所提方法

Fig. 4. Point cloud views of different point cloud distortion correction methods in corridor environment. (a) Point cloud view without distortion compensation; (b) LOAM method; (c) F-LOAM method; (d) proposed method

图 5. 楼宇环境下不同点云畸变矫正方法的点云视图。(a)未进行畸变补偿的点云视图;(b)LOAM方法;(c)F-LOAM方法;(d)所提方法

Fig. 5. Point cloud views of different point cloud distortion correction methods in building environment. (a) Point cloud view without distortion compensation; (b) LOAM method; (c) F-LOAM method; (d) proposed method

从

从

4.2 数据集验证

KITTI数据集由德国卡尔斯鲁厄理工学院和丰田美国技术研究院联合创办,该数据集用于评测激光里程计等算法在车载环境下的性能。实验平台的传感器组成包括64线激光雷达和组合导航系统。组合导航系统可以输出惯性导航单元和载波相位差分定位系统(RTK)组合导航后的结果[18],本文以此数据(GNSS)作为真值进行对比。

对所提方法与传统方法LOAM和F-LOAM进行定量对比。除了在畸变去除环节不同,两种方法并没有在里程计迭代计算环节代入更优初值以减小计算复杂度、消除累积误差。几种算法的对比实验均在内存为16G的英伟达Jetson TX2工控机上进行。

图 7. 三轴方向误差对比。(a)x轴方向;(b)y轴方向;(c)z轴方向

Fig. 7. Comparison of errors in three axes. (a) Along the x axis; (b) along the y axis; (c) along the z axis

表 2. 三种算法在KITTI数据集上的定位结果对比

Table 2. Comparison of positioning results of three algorithms on KITTI dataset

|

4.3 真实场景验证

自测数据集的采集场地选在露天走廊。以turtlebot2机器人作为实验平台的主要移动平台,其搭载有NVIDIA Jetson TX2高性能计算平台开发板、RoboSense速腾16线激光雷达、SBG消费级IMU六轴传感器、blicube系列的RTK定位设备等相关组件,为实验提供真值用以对比。实验对比了所提算法和LOAM、F-LOAM方案的定位精度,结果如

图 8. 算法间的轨迹在实际场景下的对比

Fig. 8. Comparison of trajectory between algorithms in the actual scene

进一步地,

表 3. 三种算法在实际场景下的定位结果对比

Table 3. Comparison of positioning results of the three algorithms in actual scene

|

5 结论

提出一种融合IMU数据和轮速计数据的激光雷达点云矫正和定位方法。利用IMU和轮速计具有较高的线性加速度精度和二次积分在局部的较高精度的特点,矫正激光雷达因运动产生的点云畸变。同时,计算出的雷达位姿为激光里程计提供相对最优初值,减少激光里程计的迭代计算次数,降低计算复杂度,并补偿激光里程计随距离增加累积的定位误差,解决在复杂环境下定位精度低的问题。实验结果表明:在KITTI数据集上,所提方法比LOAM算法和F-LOAM算法的定位均方根误差分别降低了81.11%和21.54%,计算平均耗时分别降低了7.3%和2.0%;在露天走廊采集的自测数据集上,所提方法比LOAM算法和F-LOAM算法的定位均方根误差分别降低了52.76%和24.29%,计算平均耗时分别降低了4.8%和2.4%。所提方法不涉及闭环检测和建图功能,增添闭环检测模块进行全局修正可以进一步提升定位精度,增添建图功能可以进行路径规划和基于地图的位置匹配,以适应更广泛的室内场景。

[1] Zhang J, Singh S. Laser-visual-inertial odometry and mapping with high robustness and low drift[J]. Journal of Field Robotics, 2018, 35(8): 1242-1264.

[2] Lopac N, Jurdana I, Brnelić A, et al. Application of laser systems for detection and ranging in the modern road transportation and maritime sector[J]. Sensors, 2022, 22(16): 5946.

[3] MiliotoA, VizzoI, BehleyJ, et al. RangeNet: fast and accurate LiDAR semantic segmentation[C]∥2019 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), November 3-8, 2019, Macau, China. New York: IEEE Press, 2020: 4213-4220.

[4] HongS, KoH, KimJ. VICP: velocity updating iterative closest point algorithm[C]∥2010 IEEE International Conference on Robotics and Automation, May 3-7, 2010, Anchorage, AK, USA. New York: IEEE Press, 2010: 1893-1898.

[5] BezetO, CherfaouiV. Time error correction for laser range scanner data[C]∥2006 9th International Conference on Information Fusion, July 10-13, 2006, Florence, Italy. New York: IEEE Press, 2007.

[6] 蔡新雨, 孙建锋, 卢智勇, 等. 相干调频连续波激光雷达畸变补偿技术研究[J]. 中国激光, 2020, 47(9): 0910003.

[7] 常耀辉, 陈年生, 饶蕾, 等. 动态环境下具有旋转和平移不变性的激光雷达点云描述子[J]. 光学学报, 2022, 42(24): 2401007.

[8] ShanT X, EnglotB. LeGO-LOAM: lightweight and ground-optimized lidar odometry and mapping on variable terrain[C]∥2018 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), October 1-5, 2018, Madrid, Spain. New York: IEEE Press, 2019: 4758-4765.

[9] 李小路, 周依尔, 毕腾飞, 等. 轻量型感知激光雷达关键技术发展综述[J]. 中国激光, 2022, 49(19): 1910002.

[10] Zhang Y. LILO: a novel lidar–IMU SLAM system with loop optimization[J]. IEEE Transactions on Aerospace and Electronic Systems, 2022, 58(4): 2649-2659.

[11] ZhangB, ZhangX Y, WeiB C, et al. A point cloud distortion removing and mapping algorithm based on lidar and IMU UKF fusion[C]∥2019 IEEE/ASME International Conference on Advanced Intelligent Mechatronics (AIM), July 8-12, 2019, Hong Kong, China. New York: IEEE Press, 2019: 966-971.

[12] Zhang J, Singh S. Low-drift and real-time lidar odometry and mapping[J]. Autonomous Robots, 2017, 41(2): 401-416.

[13] 张磊, 徐孝彬, 曹晨飞, 等. 基于动态特征剔除的图像与点云融合的机器人位姿估计方法[J]. 中国激光, 2022, 49(6): 0610001.

[14] Wu Q X, Meng Q Y, Tian Y Y, et al. A method of calibration for the distortion of LiDAR integrating IMU and odometer[J]. Sensors, 2022, 22(17): 6716.

[15] Tang J, Chen Y W, Niu X J, et al. LiDAR scan matching aided inertial navigation system in GNSS-denied environments[J]. Sensors, 2015, 15(7): 16710-16728.

[16] BiberP, StrasserW. The normal distributions transform: a new approach to laser scan matching[C]∥Proceedings 2003 IEEE/RSJ International Conference on Intelligent Robots and Systems, October 27-31, 2003, Las Vegas, NV, USA. New York: IEEE Press, 2004: 2743-2748.

[17] ShanT X, EnglotB, MeyersD, et al. LIO-SAM: tightly-coupled lidar inertial odometry via smoothing and mapping[C]∥2020 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS), October 24-January 24, 2021, Las Vegas, NV, USA. New York: IEEE Press, 2021: 5135-5142.

[18] Li Y H, Yang S Z, Xiu X C, et al. A spatiotemporal calibration algorithm for IMU-LiDAR navigation system based on similarity of motion trajectories[J]. Sensors, 2022, 22(19): 7637.

Article Outline

蒲文浩, 刘锡祥, 陈昊, 徐浩, 刘烨. 多传感器融合的激光雷达点云矫正与定位方法[J]. 激光与光电子学进展, 2023, 60(24): 2428003. Wenhao Pu, Xixiang Liu, Hao Chen, Hao Xu, Ye Liu. LiDAR Point Cloud Correction and Location Based on Multisensor Fusion[J]. Laser & Optoelectronics Progress, 2023, 60(24): 2428003.