基于对称亮度映射和虚拟多曝光融合的非均匀光照图像增强

1 引言

图像增强[1-2]是将待处理图像的细节、边缘、颜色饱和度、对比度等特征进行突出或加强,改善图像质量,方便人眼观察或计算机分析与处理,是进行图像预处理的常见手段。在现实生活中,光照条件是影响成像质量的主要因素之一。图像整体或局部区域过暗或过亮,均不利于人眼视觉观察或机器视觉处理。非均匀光照图像增强技术就是要将原来非均匀光照条件下的图像恢复成正常光照条件下的图像,恢复图像过暗或过亮区域的细节信息,扩大图像中不同物体的特征差异,进而提高这些特征的可辨识度。目前,常用且具有代表性的非均匀光照图像增强方法大致可分为基于Retinex理论的方法、基于图像融合的方法和基于深度学习的方法。基于Retinex理论的方法将输入图像分解为两幅子图[3],即带有图像细节信息的反射分量和决定图像动态范围的光照分量。如NPE(Naturalness Preserved Enhancement)[4]方法使用滤波器将图像分解为反射分量和光照分量,并使用对数变换进行亮度分量的增强,但增强后的图像常常会存在伪影的问题;SRIE(Simultaneous Reflectance and Illumination Estimation)[5]方法则使用一种加权变分模型来同时估计输入图像的反射分量和光照分量,虽弥补了在对数域上过于放大暗部区域的问题,但也导致最终非均匀光照图像增强的效果不明显。在基于图像融合的方法中,一项十分困难的工作便是如何基于单张输入图像获得同一场景的不同曝光度下的图像。为此,Ying等人[6-7]提出了基于相机响应模型的方法,通过参数优化虚拟生成最优曝光比下的图像,并与原图像进行加权融合,然而该方法没有处理图像的过曝区域,图像亮区细节会失真。文献[8]根据该相机响应模型提出了一种增强非均匀光照图像的改进算法,对图像亮区也进行了增强处理,但所用亮度映射函数没有归一化,映射结果会存在欠曝或过曝像素,导致部分细节信息的丢失。基于深度学习的方法[9]的性能在一定程度上取决于数据集大小,数据集越大则训练所得神经网络模型泛化能力越强。随着数据集的增长,神经网络模型不仅需要训练更多参数,而且训练数据量也会增加,因此需要高性能计算机用于训练,而采用较小的数据集进行训练则容易出现模型过拟合现象。

为了克服以上方法的不足,针对非均匀光照增强任务,本文提出一种基于对称亮度映射和虚拟多曝光融合的图像增强方法,不依赖于图像数据集,借助相机响应模型及图像信息熵和平均梯度最大化原则估计最优曝光比,并设计对称的亮度映射函数对单张输入图像进行增强曝光和减弱曝光处理,虚拟生成一个具有不同曝光比的图像序列,最后通过带细节提升的多曝光融合方法重构得到一幅动态范围高、对比度强、细节清晰、可视化质量好的图像。

2 相机响应模型

图像的成像过程可用相机响应模型来解释,相机响应函数是描述相机响应模型的具体方式之一。设函数

设

再设函数

因此,CRF与BMF两函数之间的转换关系可表示为:

可见,BMF也可作为相机响应模型的一种具体表示形式,目前已有多种方法用于估计BMF。虽然真实场景下图像的曝光量难以得到,但当BMF已知时,利用

显然,可以直接设置多个不同的曝光比生成一系列图像,但考虑计算效率,一般希望使用尽可能少的虚拟曝光图像,这就需要选用适当的图像质量评价指标作为度量确定最优的曝光比。文献[6-7]及文献[8]均采用图像信息熵这一单一质量评价指标来优化曝光比,依据增强后图像较暗或较亮像素的信息熵大小来确定最优曝光比。这种方法存在一定的局限性,因为信息熵不能反映图像的结构化信息,尤其在非均匀光照条件下图像过暗区或过亮区的局部结构化信息可能丢失。因此,为了实现更好的增强效果,本文在信息熵的基础上加入了平均梯度评价指标来共同优化曝光比,即产生虚拟曝光图像的最优曝光比由增强后图像的信息熵和平均梯度大小共同决定。另外,上述方法所用亮度映射函数没有归一化,虚拟曝光结果图像会存在欠曝或过曝像素,从而导致部分图像细节信息的丢失,且文献[8]要分别对暗区和亮区像素估计不同的最优曝光比,计算比较繁琐,因此,本文进一步改进了亮度映射函数设计方法,提出使用对称亮度映射函数,只需一次估计最优曝光比即可实现对非均匀光照图像进行虚拟增强曝光和减弱曝光,且保持与原图像亮度顺序的一致性,不会出现欠曝或过曝现象。最后,为凸显图像细节,再采用带细节提升的多曝光融合方法重构图像即可实现非均匀光照图像增强效果。

3 非均匀光照图像增强方法

3.1 方法流程

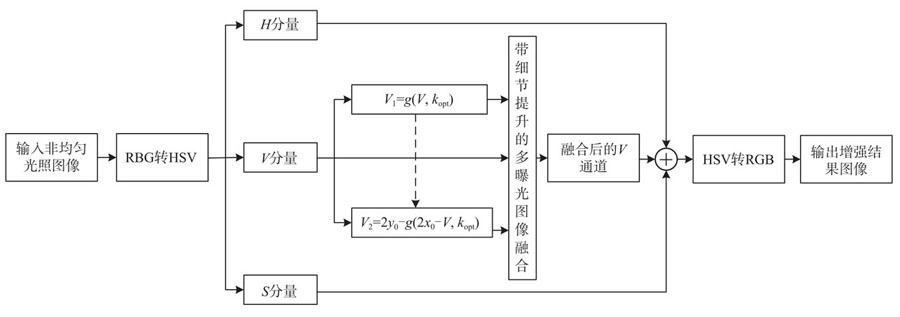

本文提出的基于对称亮度映射和虚拟多曝光融合的非均匀光照图像增强方法的流程图如

首先,为了更好地保持图像的颜色信息,将输入的单张非均匀光照彩色图像由RGB颜色空间转换到HSV颜色空间,分离出图像的色调分量图像

3.2 基于图像信息熵和平均梯度的最佳曝光比估计

图像信息熵[12]和平均梯度[13]是衡量图像质量的两个常用无参考指标。

图像信息熵一般用来度量图像信息量,其值越大说明图像中包含的信息越多,计算公式如

式中

图像的平均梯度代表了图像微小细节反差变化的速率,可以用来表示图像的清晰度,其值越大说明图像的结构化信息越多,图像越清晰,计算公式如

式中

对于非均匀光照图像,为了实现更好的增强效果,一般先只针对曝光不足或曝光过高的像素集合来估计最优曝光比,再利用此最优曝光比作用于图像中所有像素实现虚拟曝光增强或虚拟曝光减弱效果。

本文方法在估计最优曝光比时,使用图像信息熵和平均梯度最大化原则:使经亮度映射函数作用后的虚拟曝光图像中对应原始图像中曝光不足或曝光过高的像素集合所能蕴含的信息量和清晰度达到最优。该优化问题可以表示为:

其中,

获得仅包含曝光不足的像素灰度值集合

式中

3.3 对称亮度映射函数

由于非均匀光照图像存在曝光不足和曝光过度两种情形,如果使用统一的曝光比直接对非均匀光照图像进行曝光补偿等增强处理,无法使所有像素曝光良好。因此需要选择合适的亮度映射函数对曝光不足区域做增强曝光处理,生成增强曝光图像,提高原图像中的局部亮度偏低像素的灰度值;对亮度过高区域做减弱曝光处理,生成减弱曝光图像,降低原图像中的局部亮度偏高像素的灰度值。

以

(1)为防止映射后图像相邻像素之间的亮度值差异消失,函数必须是严格单调的,即对任意

(2)为防止映射后像素亮度值截断导致信息丢失,要保证归一化输入图像的每个像素亮度值仍被映射至归一化区间

(3)曝光比k控制着曝光效果。当

当生成增强曝光图像时,文献[4-6]中方法所采用的亮度映射函数为:

其中

为了利用该函数的效果优势并弥补其不足,本文以分段的形式定义一种改进的亮度映射函数:

为保证函数连续,须满足

这里

当

由

根据函数点对称性质可知,当想要较好地拉升图像亮区像素的亮度值,增强图像亮区像素的对比度时,可直接选择使用该亮度映射函数关于点

当

3.4 带细节提升的虚拟多曝光融合

对非均匀光照图像,在增强图像对比度的同时,还希望尽可能地凸显图像细节。因此,本文最终图像增强结果采用带细节提升的多曝光融合方法[6]将图像

具体而言,首先要将曝光序列中的任一图像分解为不同尺度下的基础层和细节层,这里用3个不同尺度的高斯卷积核分别对待处理图像进行滤波,即:

式中

然后,取最小尺度的高斯核卷积得到的基础层作为后续融合的基础层图像,即第

式中

接着,采用将像素显著性和空间一致性相结合的方法计算

(1)利用

用

式中

(2)通过比较不同的

式中

(3)利用引导滤波能保持像素空间一致性的优点来改善初始权重图

式中

然后,将

最后,将融合后的基础层

4 实验结果及分析

为了验证文本方法对非均匀光照图像增强的可行性与有效性,选取DICM[14]、LIME-data[15]、NPE-data[4]及其扩展集NPE-ex1、NPE-ex2、NPE-ex3以及VV[16]等7个公开数据集进行了对比实验,实验后进行了图像质量的主客观评价。对比方法包括经典的方法NPE[4]和SRIE[5]、基于图像融合的方法YING-EF(Exposure Fusion)[7]和VMEF(Virtual Multi-Exposure Fusion)[8]、基于深度学习的方法LightenNet[17],其中对比方法的参数设置保持原论文设置不变。

4.1 实验结果客观评价

为了客观评价本文方法,采用图像信息熵、平均梯度、图像对比度、颜色一致性作为客观指标来衡量方法性能。图像对比度代表了图像亮区暗区拉伸的对比程度,其值越大说明图像的灰度反差越大,图像的动态范围越高,其计算公式如

其中,

其中,

客观评价指标的实验结果如

表 1. 不同方法在各数据集上的图像信息熵

Table 1. Image information entropy of different methods on each dataset

|

表 2. 不同方法在各数据集上的平均梯度

Table 2. Average gradients of different methods on each dataset

|

表 3. 不同方法在各数据集上的图像对比度

Table 3. Image contrast of different methods on each dataset

|

表 4. 不同方法在各数据集上的颜色一致性

Table 4. Color consistency of different methods on each dataset

|

结果表明,NPE、SRIE、YING-EF和LightenNet方法的增强效果比较接近,均处于较低水平;VMEF方法略高于NPE、SRIE、YING-EF和LightenNet方法;而本文方法在图像信息熵、平均梯度、图像对比度、颜色一致性等客观评价指标上均表现为最高,在7个公开数据集上相应评价指标的整体平均值分别达到了7.644,9.209,450.683,0.962,与对比方法相比均有显著提升。

4.2 实验结果主观评价

为了能够真实地反映本文方法对非均匀光照图像增强的直观效果,从实验结果中挑选了两幅具有代表性的图像及其细节放大图(红色方框标出),如

图 4. 非均匀光照图像增强结果对比(示例1)

Fig. 4. Comparison of image enhancement results for non-uniform illumination image(Example 1)

图 5. 非均匀光照图像增强结果对比(示例2)

Fig. 5. Comparison of image enhancement results for non-uniform illumination image(Example 2)

图 6. 非均匀光照图像增强结果对比(示例3)

Fig. 6. Comparison of image enhancement results for non-uniform illumination image(Example 3)

5 结论

为解决非均匀光照图像出现的各种问题,如对比度低、细节不清晰、可视化效果差等,本文提出了一种基于对称亮度映射和虚拟多曝光融合的非均匀光照图像增强方法,通过两条对称的亮度映射函数曲线分别对非均匀光照图像的欠曝光区域做增强曝光处理,对过曝光区域做减弱曝光处理,然后使用带细节提升的多曝光融合方法对原图像、减弱曝光图像和增强曝光图像组成的曝光序列进行融合得到最终的增强图像。在7个公共数据集上的实验表明,本文方法取得的图像信息熵、平均梯度、图像对比度、颜色一致性4种客观评价指标均值分别为7.644,9.209,450.683,0.962,均优于对比方法,获得了动态范围高、对比度强、细节清晰和可视化效果好的增强结果。

[1] 王浩, 张叶, 沈宏海, 等. 图像增强算法综述[J]. 中国光学, 2017, 10(4): 438-448.

[2] 陈莹, 朱明. 多子直方图均衡微光图像增强及FPGA实现[J]. 中国光学, 2014, 7(2): 225-233.

[3] LAND E H. The Retinex theory of color vision[J]. Scientific American, 1977, 237(6): 108-128.

[8] 徐望明, 刘召, 伍世虔, 等. 基于虚拟多曝光融合的不均匀光照图像增强方法[J]. 华中科技大学学报(自然科学版), 2020, 48(8): 79-84,90.

XU W M, LIU Z, WU S Q, et al. Non-uniform illumination image enhancement method based on virtual multi-exposure fusion[J]. Journal of Huazhong University of Science and Technology (Natural Science Edition), 2020, 48(8): 79-84, 90.

[9] 王兴瑞, 朴燕, 王雨墨. 复合残差网络在低照度图像增强中的技术研究[J]. 液晶与显示, 2022, 37(4): 508-518.

[12] 杨作廷, 阮萍, 翟波. 基于图像熵的高动态范围场景的自动曝光算法[J]. 光子学报, 2013, 42(6): 742-746.

[13] 王绍权. 低照度视频图像增强技术研究[D]. 兰州: 兰州交通大学, 2020.

WANGS Q. Research on low illumination video image enhancement technology[D]. Lanzhou: Lanzhou Jiaotong University, 2020. (in Chinese)

Article Outline

黄子蒙, 徐望明, 但愿. 基于对称亮度映射和虚拟多曝光融合的非均匀光照图像增强[J]. 液晶与显示, 2022, 37(12): 1580. Zi-meng HUANG, Wang-ming XU, Yuan DAN. Non-uniform illumination image enhancement via symmetric brightness mapping and virtual multi-exposure fusion[J]. Chinese Journal of Liquid Crystals and Displays, 2022, 37(12): 1580.