自适应特征融合的多尺度核相关滤波目标跟踪  下载: 1360次

下载: 1360次

1 引言

目标跟踪是计算机视觉领域一个重要且富有挑战性的研究课题,在智能监控、自动驾驶、人机交互和精确制导等领域具有非常广泛的应用[1]。在过去的几十年中,国内外学者对目标跟踪进行了广泛而深入的研究[2-3],并取得了丰硕成果。但在实际应用中,受到场景光照变化、目标形变、尺度变化或遮挡等不利因素影响,实现稳健的目标跟踪仍然面临着非常严峻的挑战[4]。

相关滤波在频域的快速计算可使目标跟踪的速度达到每秒数百帧,因此其成为当前目标跟踪研究领域的热点之一。Bolme等[5]提出了最小输出误差平方和滤波(MOSSE)算法,首次将相关滤波方法应用到了目标跟踪领域。在MOSSE算法基础上,Henriques 等[6]提出了循环结构核(CSK)算法,通过循环移位方式完成样本密集采样,解决了分类器无法获取大量训练样本的问题。随后,Henriques 等[7]又提出了核相关滤波(KCF)算法,将单通道灰度特征扩展到多通道梯度方向直方图(HOG)特征,提高了算法的跟踪精度和适应性。Danelljan等[8]将三维三原色(RGB)特征映射为11 维颜色名(CN)特征,也取得了较好的跟踪效果。

上述方法利用单一特征构建目标外观模型,在复杂场景中目标的区分度差并且容易受到干扰。针对此问题:Bertinetto等[9]提出了Staple算法,将HOG特征和颜色直方图特征进行融合,以提升算法性能;李聪等[10]将RGB颜色空间映射到Lab颜色空间,再与HOG特征进行融合,完成目标跟踪;沈秋等[11]将HOG特征、CN特征和局部二值模式(LBP)特征与灰度特征进行串联,选择其中最大响应所对应的位置作为跟踪结果;赵高鹏等[12]通过计算灰度特征和LBP特征响应的峰值旁瓣比,将这2种特征进行融合。此外,Qi等[13-14]提出将深度卷积神经网络获取的特征应用于相关滤波目标跟踪中,也取得了改善效果,但是特征提取的计算开销较大,很难满足目标跟踪的实时性要求。

为了处理相关滤波目标跟踪中的尺度变化问题:Danelljan等[15]设计了一个三维的位置-尺度相关滤波器,用于适应目标的尺度变化;Li等[16]在上一帧目标位置进行不同尺度的采样,并将其中最大响应所对应的尺度作为当前目标尺度;Zhang等[17]通过计算当前帧和前一帧目标位置的置信度来评估相邻两帧之间的尺度变化。这些方法虽然能够适应一定程度的目标尺度变化,但并未有效解决目标跟踪过程中的尺度变化问题。

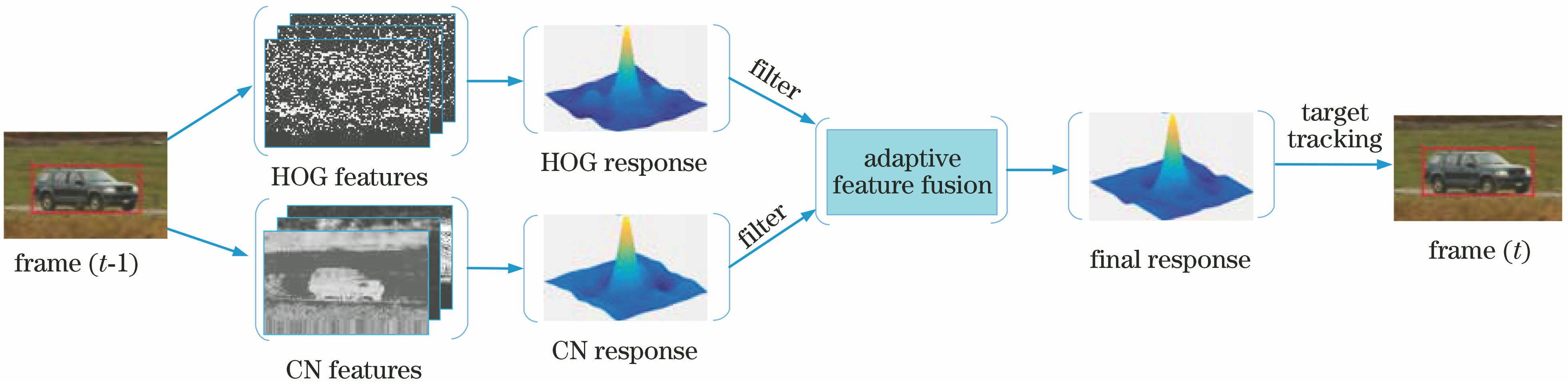

针对上述问题,本文在KCF 算法基础上,提出一种自适应特征融合的多尺度核相关滤波目标跟踪算法。该算法利用目标候选区域的HOG特征和CN特征分别训练2个核相关滤波器,并采用自适应加权的融合策略将这2个滤波器的响应结果进行融合,得到目标中心位置;然后构建尺度金字塔,并采用贝叶斯估计的方法确定目标的最优尺度;最后依据目标跟踪的置信度来更新跟踪模型,从而实现对目标的稳定跟踪。

2 核相关滤波目标跟踪原理

核相关滤波目标跟踪通过训练样本寻找一个分类器函数f(xi,w)=<w,xi>,使其在某种决策条件下的损失最小,其中xi为训练样本,w为该分类器函数的待求参数,<·,·>为内积运算。将训练样本和它对应标签的误差平方和作为损失函数,可以得到w的求解形式为

式中:xi和yi分别为第i(i=1,2,…,n)个训练样本及其所对应的标签,n为训练样本的个数;λ为防止分类器过拟合的正则化系数;‖·‖为范数。对(1)式求偏导数,并令其为0,可以得到(1)式的一般解为

式中:X是由训练样本组成的样本矩阵,每行代表一个样本xi;I为与XTX同维数的单位矩阵;y为每个训练样本xi所对应的标签yi的集合。对于核相关滤波目标跟踪,由于它的样本矩阵X是由初始目标样本x经过循环移位得到的,因此X具有循环结构,利用循环矩阵的离散傅里叶变换(DFT)性质,(2)式在频域中的表达形式为

式中:

式中:

式中:

3 自适应特征融合的多尺度目标跟踪

3.1 自适应特征融合

3.1.1 特征选择

在目标跟踪中,特征的选择及其区分度对目标跟踪的结果具有重要影响。HOG 特征通过计算图像局部区域的方向梯度进行目标表达,可以有效地描述目标的轮廓和形状信息,并在一定程度上保持了几何和光照不变性。KCF算法[7]通过采用多通道的HOG特征,能够较好地适应光照变化、平面内旋转等情况。

颜色特征则是从全局角度对目标进行描述,具有旋转不变性,同时不易受到目标尺度或形状变化的影响。CN特征是颜色特征的一种,它通过概率映射方式,将图像从原始的三维RGB空间转换到11维的颜色特征空间。相对于其他颜色特征,CN特征具有更好的目标描述能力[8]。

虽然相对于灰度特征,采用HOG特征和CN特征都能够在一定程度上提高相关滤波的跟踪性能,但是受单一特征对目标描述的局限性在复杂场景中目标的部分特性发生变化时单一场景不能对目标进行有效的描述,进而会影响目标跟踪质量。由于HOG特征和CN特征分别从不同的角度对目标进行抽象和特征提取,同时HOG特征具有较好的几何和光照不变性,而CN特征则对目标尺度和形状变化不敏感,两者具有较强的互补性,因此本文将这2种特征进行融合,以提升目标跟踪的性能。

3.1.2 融合方法

在相关滤波中,峰值旁瓣比RPS代表一个相关滤波响应(CFR)的峰值尖锐度,通常用于衡量目标跟踪的置信度[5]。对于相关滤波响应,在峰值位置x处的RPS可表示为

式中:max

式中:

通过以上分析,本文将RPS和CCFR作为目标跟踪的置信度评价指标,构造一个二元函数f(RPS,CCFR)作为目标跟踪的置信度评价函数,其定义式为

式中:ρ∈[0,1],为RPS与CCFR之间的权重调节系数;ε为0.01,用于避免分母为0。

先利用HOG特征和CN特征训练2个核相关滤波器,然后分别提取目标候选区域的HOG特征和CN特征,并计算二者的核相关滤波响应,对这2个响应进行高斯滤波,以剔除异常响应值,最后计算它们滤波后的置信度fHOG和fCN,计算式分别为

式中:RPS,HOG和RPS,CN分别为HOG特征和CN特征所对应的相关滤波响应的RPS值;CCFR,HOG和CCFR,CN分别为HOG特征和CN特征在相邻两帧之间的CCFR值。最后将这2个置信度作为特征融合的权重因子,可得到融合后的相关滤波响应为

式中:

3.2 多尺度估计

为了解决相关滤波目标跟踪中的尺度变化问题,文献[ 16-18]分别提出3种不同的解决方案,但是均未考虑相邻两帧之间尺度的变化规律。在目标跟踪中,相邻两帧的时间间隔通常只有20 ms甚至更短,因此相邻两帧之间目标的尺度变化是微小且是连续的,可以将这种变化近似为一种高斯分布[20-21],即目标在当前帧的尺度变化st服从高斯分布,以它在前一帧中的尺度st-1为均值,σ为方差。

由此获得相邻两帧之间尺度变化的先验分布,接下来可以寻找一个似然函数p(

式中:p(st|

当给定一个目标的尺度时,利用核相关滤波器可以求出此尺度下跟踪候选区域与目标的最大相似度,该最大相似度可以表示目标在该尺度下的概率。通过构建尺度金字塔来完成对目标尺度变化的极大似然估计,即以目标在当前帧的估计位置为中心,将前一帧的目标尺度st-1作为基准尺度,进行多尺度采样,则有

式中:m为多尺度采样的子层数;sm为多尺度采样的每个子层的尺度;M为尺度金字塔的层数;d为相邻2层之间的变化量。通过提取多尺度样本的HOG特征,构建一个尺度滤波器,完成对目标尺度的极大似然估计,然后通过(12)式得到每层尺度的最大后验概率,将具有最大后验概率的尺度sm作为当前帧目标尺度st的最优估计。

3.3 更新策略

在目标跟踪中,由于目标所处的场景及目标自身都不可避免地会发生变化,如果固定采用在起始帧获得的跟踪模型,则不能准确地描述变化后的状态,因此在跟踪过程中必须对跟踪模型进行动态更新,以保证跟踪的稳健性。但是如果跟踪模型的更新频率过快,则容易将噪声引入到跟踪模型中,反之,则不能描述跟踪过程的动态变化。因此,跟踪模型的更新策略将直接影响目标跟踪的性能。根据特征融合部分的分析,采用融合后相关滤波响应的RPS值和CCFR值作为目标跟踪的置信度评价指标,同样地,定义特征融合后的置信度为

式中:RPS,final为特征融合后的相关滤波响应的RPS值;CCFR,final为特征融合后的相关滤波响应在相邻两帧之间的CCFR值。RPS,final和CCFR,final的计算方法与(6)式和(7)式给出的计算方法一致,通过特征融合后的相关滤波响应得到。当ffinal值较小时,表示目标跟踪的置信度较低,说明此时目标外观发生了较大变化或者发生了跟踪漂移,不能更新跟踪模型;反之,当ffinal值较大时,则认为此时目标跟踪的置信度较高,可以更新跟踪模型。本文设置一个置信度阈值fth,用于判断是否对当前帧的跟踪模型进行更新;另外,为了使更新策略更可靠,在进行模型更新时还参考了历史帧信息,即如果连续多帧目标跟踪的置信度ffinal都大于设定的阈值fth,则利用当前帧信息来更新跟踪模型,否则不更新。在核相关滤波目标跟踪中,有2个参数需要在频域进行更新[7],一个是对偶矩阵参数

式中:

3.4 算法流程

本文所提算法的具体实现流程如下。

1) 初始化。利用在起始帧中给出的目标位置和尺度分别初始化HOG特征和CN特征的核相关滤波器,获得它们的对偶矩阵参数

2) 位置估计。分别在当前帧中提取目标候选区域的HOG特征和CN特征,计算它们的核相关滤波响应

3) 尺度估计。以当前帧估计的目标位置为中心,根据前一帧目标尺度st-1,按照(13)式进行多尺度采样,并提取它们的HOG特征,构建尺度相关滤波器,进行目标尺度变化的极大似然估计,然后根据相邻两帧之间尺度变化的先验分布,完成对当前帧目标尺度的最大后验概率估计。

4) 模型更新。根据(14)式计算特征融合后相关滤波响应的置信度ffinal,如果当前帧及其历史帧的ffinal值都大于fth,则分别按照(15)和(16)式更新2个核相关滤波器的跟踪模型,否则不更新。

5) 保存跟踪结果,并判断跟踪是否完成。未完成则继续执行步骤2)。

4 实验结果与分析

4.1 实验环境及参数设置

用于完成本文所提算法的计算机硬件配置如下:CPU型号为Intel(R) Core(TM) i5-2500,主频为3.30 GHz,内存为8 GB;算法的软件开发平台为MATLAB R2016b。本文选取OTB50公开测试集[22]中的51组视频序列进行跟踪性能测试,按照目标跟踪中常见的挑战因素将该测试集中的视频序列属性分为11类,具体包括光照变化(IV)、目标形变(DEF)、尺度变化(SV)、遮挡(OCC)、运动模糊(MB)、快速运动(FM)、平面旋转(IPR)、非平面旋转(OPR)、目标消失(OV)、背景杂乱(BC)和低分辨率(LR),测试集中的每个视频序列都至少包含1种上述属性。

本文将文献[ 22]中给出的中心位置误差ECL、距离精度Pd和重叠精度Po这3种评价指标作为目标跟踪结果的评判依据。ECL为跟踪到的目标中心位置(xt,yt)与真实的目标中心位置(xg,yg)之间的欧氏距离:

Pd评价指标是指ECL小于某一阈值的帧数占该视频序列全部帧数的百分比。Po评价指标则是指跟踪到的目标区域Rt与真实的目标区域Rg之间的重叠率So大于某阈值的帧数占该视频序列全部帧数的百分比,其中So可表示为

式中:

基于以上3种评价指标,采用一次性通过评估(OPE)的测试方法进行目标跟踪性能测试。首先给出目标在视频序列起始帧中的位置和尺度,然后在后续的每帧中由目标跟踪算法确定目标的位置和尺度。这是一种直观的测试方法,也是贴合实际应用的一种测试方法。本文进行Pd指标评价时的ECL阈值设置为20 pixel,进行Po指标评价时的So阈值设置为0.5。

本文所提算法中的具体参数设置如下:用于对相关滤波响应进行高斯滤波的模板尺寸为3×3;尺度估计的金字塔层数M=17,变化步长d=0.025;目标跟踪的置信度阈值fth=6,参考历史帧的数量为3,更新率η=0.01;其余参数设置与KCF算法一致。另外,用于对RPS和CCFR的权重进行调节的参数ρ在本文中设置为0.5。

本文在(8)式中通过RPS和CCFR定义了目标跟踪的置信度评价函数,他们之间的权重调节系数ρ∈[0,1],其中RPS代表当前帧的相关滤波响应的峰值尖锐度,RPS值越大表示相关滤波响应的峰值越尖锐,说明目标跟踪的可靠度越高;CCFR则代表相邻两帧的相关滤波响应的相似程度,CCFR值越大,表示相邻两帧的相关滤波响应的相似程度越高,说明目标跟踪的稳定性越高。RPS和CCFR分别从不同的角度反映了目标跟踪的置信度情况,其中RPS代表当前帧的可靠度,CCFR则代表连续帧的稳定性。ρ值增大,说明CCFR在目标跟踪置信度评价中的权重增加。如果ρ>0.5,则表示CCFR在目标跟踪的置信度评价中占据主导因素,反之,则表示RPS在目标跟踪的置信度评价中占据主导因素。在OTB测试集中,选用ECL阈值为20 pixel时的Pd值作为目标跟踪结果的评价指标,获得参数ρ与目标跟踪性能之间的关系,如

图 2. 权重调节系数ρ与目标跟踪性能之间的关系

Fig. 2. Relationship between weight adjustment ρ and the target tracking performance

4.2 特征融合性能

为了验证本文提出的自适应权重融合策略的跟踪性能,在OTB50测试集中进行3种算法的对比实验。3种算法分别如下:本文提出的使用HOG特征和CN特征进行自适应特征融合的算法(所提算法),以及分别仅采用HOG特征和CN特征的proposed_HOG算法和proposed_CN算法。proposed_HOG算法和proposed_CN算法仅采用单一特征进行目标跟踪,其余参数设置均与所提算法一致。3种算法的对比实验结果如

图 3. 3种目标跟踪算法的距离精度曲线和重叠精度曲线。(a)距离精度;(b)重叠精度

Fig. 3. Distance precision curves and overlap precision curves of three target tracking algorithms. (a) Distance precision; (b) overlap precision

4.3 尺度估计性能

为了验证本文算法的性能,选取OTB50测试集中4组有代表性的存在尺度变化的视频序列Blurcar2、Dog1、Doll、Carscale进行测试。实验首先以起始帧的目标尺寸为基准,然后在后续帧中将估计的目标尺寸与起始帧的目标尺寸进行比较,得到估计的目标尺度变化,最后再与真实的目标尺度变化进行比较。在4组视频中,视频序列Blurcar2的目标尺度变化范围较小,在0.5与3.5之间;视频序列Dog1和Doll的目标尺度变化范围较大,相当于起始帧有15倍和18倍;视频序列Carscale的目标尺度变化范围最大,相当于起始帧有30多倍。

图 4. 所提算法对4组视频序列进行估计的目标尺度与真实的目标尺度对比。(a) Blurcar2;(b) Dog1;(c)Doll;(d) Carscale

Fig. 4. Comparisons of estimated scale by the proposed algorithm and actual scale on four sequences.(a) Blurcar2; (b) Dog1; (c) Doll; (d) Carscale

表 1. 所提算法对4组存在尺度变化的视频序列的目标跟踪结果

Table 1. Tracking results of the proposed algorithm on four scale variation sequences

|

4.4 综合跟踪性能

4.4.1 定量分析

为了定量评估所提算法的跟踪性能,利用OTB50数据集中的51组视频序列对比33种算法,这些算法包括所提算法、KCF算法[7]、CN算法[8]和DSST算法[17],另外还包括在OTB50数据集中表现出色的29种算法,如Struck算法、TLD算法、SCM算法、ASLA算法、VTD算法、VTS算法、CXT算法和CT算法等。

在OPE测试方法下,计算这些算法的评价指标Pd和Po,对比实验结果如

图 5. 不同目标跟踪算法的距离精度曲线和重叠精度曲线。(a)距离精度;(b) 重叠精度

Fig. 5. Distance precision curves and overlap precision curves of different target tracking algorithms. (a) Distance precision; (b) overlap precision

为了更全面地评价所提算法的性能,在OTB50数据集中,利用

表 2. 排名前10的算法对11种不同属性的评价指标Pd

Table 2. Pd scores of the top ten algorithms on eleven attributes

|

4.4.2 定性分析

为了更直观地评估所提算法的跟踪性能,选择在定量分析中排名前5的算法对6组具有不同属性的视频序列David(IV)、Basketball(DEF)、Carscale(SV)、Jogging1(OCC)、Trellis(OPR)和Soccer(BC)分别进行定性分析,结果如

表 3. 排名前10的算法对11种不同属性的评价指标Po

Table 3. Po of the top ten algorithms on eleven attributes

|

图 6. 5种算法对视频序列David的目标跟踪结果对比

Fig. 6. Comparison of tracking results among five algorithms on David sequence

图 7. 5种算法对视频序列Basketball的目标跟踪结果对比

Fig. 7. Comparison of tracking results among five algorithms on Basketball sequence

图 8. 5种算法对视频序列Carscale的目标跟踪结果对比

Fig. 8. Comparison of tracking results among five algorithms on Carscale sequence

图 9. 5种算法对视频序列Jogging1的目标跟踪结果对比

Fig. 9. Comparison of tracking results among five algorithms on Jogging1 sequence

图 10. 5种算法对视频序列Trellis的目标跟踪结果对比

Fig. 10. Comparison of tracking results among five algorithms on Trellis sequence

图 11. 5种算法对视频序列Soccer的目标跟踪结果对比

Fig. 11. Comparison of tracking results among five algorithms on Trellis sequence

从

从

从

从

从

从

5 结论

本文在核相关滤波基础上,提出了一种自适应特征融合的多尺度目标跟踪算法。首先采用一种自适应权重的融合策略,将HOG特征和CN特征的核相关滤波输出响应进行融合,用于完成目标跟踪过程中的位置估计;然后以此为中心进行多尺度采样,构建尺度相关滤波器,同时结合相邻两帧的目标尺度变化规律,实现了对目标尺度变化的精确估计;最后根据目标跟踪的置信度,完成对跟踪模型的稳定更新。实验表明,本文算法较好地解决了目标跟踪过程中的光照变化、目标形变、尺度变化和遮挡等问题,有效提高了目标跟踪的成功率,整体性能优于对比算法。同时,在实验中发现,如果在跟踪过程中出现了目标的快速运动情况,由于本文算法暂时没有考虑目标的运动信息,进行目标跟踪时容易出现跟踪漂移甚至失败的情况,因此,如何进一步改进本文算法的特征融合策略,把目标的运动信息特征也进行融合,是下一步研究的重点。

[1] Yilmaz A, Javed O, Shah M. Object tracking: a survey[J]. ACM Computing Surveys, 2006, 38(4): 13.

[3] 卢湖川, 李佩霞, 王栋. 目标跟踪算法综述[J]. 模式识别与人工智能, 2018, 31(1): 61-76.

Lu H C, Li P X, Wang D. Visual object tracking:a survey[J]. Pattern Recognition and Artificial Intelligence, 2018, 31(1): 61-76.

[4] 罗海波, 许凌云, 惠斌, 等. 基于深度学习的目标跟踪方法研究现状与展望[J]. 红外与激光工程, 2017, 46(5): 0502002.

[5] BolmeD, Beveridge JR, Draper BA, et al. Visual object tracking using adaptive correlation filters[C]∥2010 IEEE Computer Society Conference on Computer Vision and Pattern Recognition, June 13-18, 2010, San Francisco, CA, USA. New York: IEEE, 2010: 2544- 2550.

[6] Henriques JF, CaseiroR, MartinsP, et al. Exploiting the circulant structure of tracking-by-detection with kernels[M] ∥Fitzgibbon A, Lazebnik S, Perona P, et al. Computer vision-ECCV 2012. Lecture notes in computer science. Berlin, Heidelberg: Springer, 2012, 7575: 702- 715.

[7] Henriques J F, Caseiro R, Martins P, et al. High-speed tracking with kernelized correlation filters[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(3): 583-596.

[8] DanelljanM, Khan FS, FelsbergM, et al. Adaptive color attributes for real-time visual tracking[C]∥2014 IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2014, Columbus, OH, USA. New York: IEEE, 2014: 1090- 1097.

[9] BertinettoL, ValmadreJ, GolodetzS, et al. Staple: complementary learners for real-time tracking[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 1401- 1409.

[10] 李聪, 鹿存跃, 赵珣, 等. 特征融合的尺度自适应相关滤波跟踪算法[J]. 光学学报, 2018, 38(5): 0515001.

[11] 沈秋, 严小乐, 刘霖枫, 等. 基于自适应特征选择的多尺度相关滤波跟踪[J]. 光学学报, 2017, 37(5): 0515001.

[12] 赵高鹏, 沈玉鹏, 王建宇. 基于核循环结构的自适应特征融合目标跟踪[J]. 光学学报, 2017, 37(8): 0815001.

[13] Qi YK, Zhang SP, QinL, et al. Hedged deep tracking[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 4303- 4311.

[14] 王鑫, 侯志强, 余旺盛, 等. 基于多层卷积特征融合的目标尺度自适应稳健跟踪[J]. 光学学报, 2017, 37(11): 1115005.

[15] DanelljanM, HägerG, Khan FS, et al.Accurate scale estimation for robust visual tracking[C]∥Proceedings of the British Machine Vision Conference 2014, September 1-5, 2014, Nottingham.UK: BMVA Press, 2014.

[16] LiY, Zhu JK. A scale adaptive kernel correlation filter tracker with feature integration[M] ∥Agapito L, Bronstein M, Rother C. Computer vision-ECCV 2014 Workshops. Lecture notes in computer science. Cham: Springer, 2015, 8926: 254- 265.

[17] Zhang KH, ZhangL, Liu QS, et al. Fast visual tracking via dense spatio-temporal context learning[M] ∥Fleet D, Pajdla T, Schiele B, et al. Computervision-ECCV 2014. Lecture notes in computer science. Cham: Springer, 2014, 8693: 127- 141.

[18] Wang MM, LiuY, Huang ZY. Large margin object tracking with circulant feature maps[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 4800- 4808.

[19] LiuT, WangG, Yang QX. Real-time part-based visual tracking via adaptive correlation filters[C]∥2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 7-12, 2015, Boston, MA, USA. New York: IEEE, 2015: 4902- 4912.

[20] BibiA, GhanemB. Multi-template scale-adaptive kernelized correlation filters[C]∥2015 IEEE International Conference on Computer Vision Workshop (ICCVW), December 7-13, 2015, Santiago, Chile. New York: IEEE, 2015: 613- 620.

[21] Ma J K, Luo H B, Hui B, et al. Robust scale adaptive tracking by combining correlation filters with sequential Monte Carlo[J]. Sensors, 2017, 17(3): 512.

[22] WuY, LimJ, Yang MH. Online object tracking: a benchmark[C]∥Proceedings of IEEE Conference on Computer Vision and Pattern Recognition, June 23-28, 2013, Portland, Oregon. New York: IEEE, 2013: 2411- 2418.

Article Outline

陈法领, 丁庆海, 常铮, 陈宏宇, 罗海波, 惠斌, 刘云鹏. 自适应特征融合的多尺度核相关滤波目标跟踪[J]. 光学学报, 2020, 40(3): 0315001. Faling Chen, Qinghai Ding, Zheng Chang, Hongyu Chen, Haibo Luo, Bin Hui, Yunpeng Liu. Multi-Scale Kernel Correlation Filter Algorithm for Visual Tracking Based on the Fusion of Adaptive Features[J]. Acta Optica Sinica, 2020, 40(3): 0315001.