利用残差密集网络的高光谱图像分类  下载: 1230次

下载: 1230次

1 引言

高光谱图像能够获取地面目标近似连续的波段信息,极大提高了地物的区分能力,在矿物勘探、精细农业、**建设等领域发挥了重要作用[1]。高光谱图像分类是利用高光谱图像中包含的丰富信息,为每个像素赋以唯一的类别标识,是高光谱图像应用的重要方面。然而,高光谱图像中存在同物异谱及同谱异物现象,导致图像数据结构呈高度非线性,相邻波段及相邻像元之间具有较强的相关性;同时高光谱图像中训练样本往往数量有限,容易发生维数灾难。因此,如何提取具有较强可分性的判别性特征是高光谱图像分类的关键。

机器学习中的支持向量机(SVM)方法,能够有效处理高维数据,解决维数灾难问题,一直是高光谱图像分类的经典方法。该方法能够有效处理非线性数据,极大提高了高光谱图像的分类精度。然而,SVM方法没有考虑邻域像元之间的相关性,并且需要复杂的调参过程。

近年来,凭借强大的自动学习特征的能力,深度学习被广泛应用于图像识别、目标检测等领域,在高光谱图像分类方面也取得了优异的效果。自编码器(SAE)和深度置信网络(DBN)是最早用于高光谱图像分类的深度学习模型[2-4],然而,这两种模型都要求将三维数据变换为一维输入向量,损失了空间信息,而且需要大量的模型参数。卷积神经网络(CNN)[5-6]能够通过处理像元的邻域,提取空间-光谱特征,进一步提高了高光谱图像分类的精度。

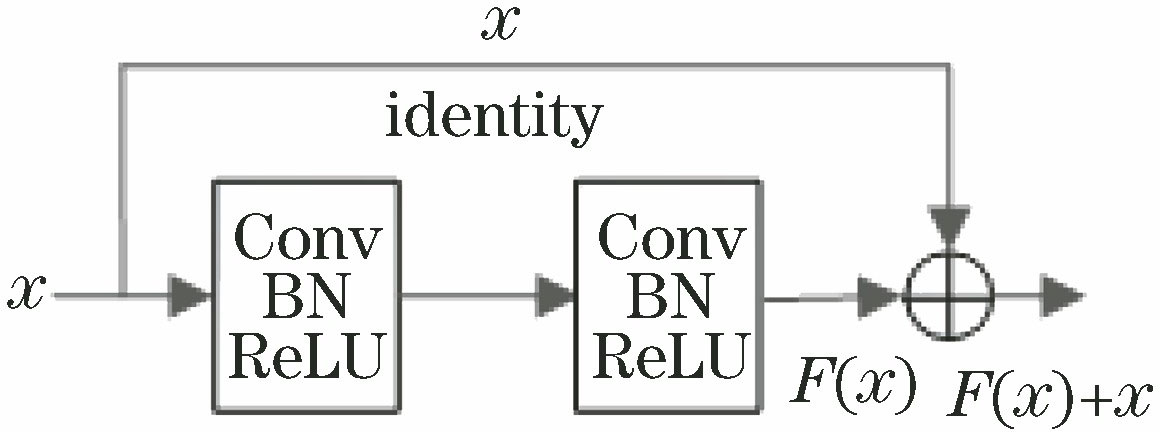

然而随着模型层数的增加,CNN训练过程中会出现梯度消失的现象,导致分类精度下降。残差网络(ResNet)[7-8]在CNN结构中加入恒等映射,在残差单元的输入和输出之间添加短连接,能够在增加模型层数的同时有效解决梯度消失问题,防止过拟合。ResNet已经被广泛应用于图像处理领域,如超分辨率重建[9]、目标检测[10]、图像识别等,近年来,其在高光谱图像分类应用中也取得了良好的效果。钟健等[11]提出了一种半监督残差梯型网络(Semi-RLNet),将传统梯型网络中的全连接网络结构改为ResNet结构,实现了ResNet与SAE的有效结合。Song等[12]以多个含有不同卷积核数量的ResNet为基本单元,对各个残差单元进行池化操作,连接不同单元的池化层,能够实现高光谱图像不同层次特征的融合。Zhong等[13]构建了包含三维卷积层的残差网络单元,为充分利用残差单元的特征提取能力,利用包含不同尺寸卷积核的残差单元分别提取图像中的光谱特征和空间特征,不仅有效保留了图像中的光谱信息和空间信息,还解决了由深层网络结构导致的精度下降问题。然而,ResNet没有充分利用残差单元中每一个卷积层输出的信息,也忽略了任意两个卷积层之间的联系,同时层层相加的模式也不利于网络中信息的传递。

Huang等[14]提出了密集网络(DenseNet)模型,DenseNet能够以连接模式连接密集单元中的任意两个卷积层,实现了特征重利用及信息传递。Wang等[15]将DenseNet用于高光谱图像分类,不仅提高了分类精度,还缩短了训练时间。然而,DenseNet只考虑了密集单元内部不同层之间的联系,没有充分利用不同单元提取的所有分层特征。Zhang等[16]提出了用于图像超分辨率重建的残差密集网络(ResDenNet),将ResNet与DenseNet结合,再将网络模型中不同单元提取的浅层特征与深层特征结合,取得了更好的效果。ResDenNet包括浅层特征提取、残差密集单元(RDB)、密集特征融合三部分,首先对原始图像进行卷积操作提取浅层特征,将浅层特征作为残差密集单元的输入;残差密集单元包含密集连接和局部特征融合,其输出与下一个单元内的各个卷积层直接相关,实现了单元之间的信息连续传递;随后,密集特征融合实现了浅层特征和各个单元提取的不同分层特征之间的全局特征融合,局部特征融合及全局特征融合均以短连接的方式实现,最终的融合特征用于图像重建。而考虑到高光谱图像复杂的光谱-空间结构,充分利用不同单元提取的分层特征,将浅层特征与深层特征结合能够提供丰富的图像细节信息,有利于图像分类。根据高光谱图像数据的特点,本文设计了适用于高光谱图像分类的残差密集网络模型。与SVM、CNN、ResNet及DenseNet等方法在三组高光谱数据上进行对比实验,结果表明,本文方法能够有效提高高光谱图像分类的精度,增强分类方法的稳定性。

2 基本原理

2.1 残差网络

设残差单元的输入为

2.2 密集网络

式中:

2.3 残差密集网络

设第

式中:

由于单元的输入与卷积层之间采用连接模式,有必要在单元的最后对特征图进行压缩,因此采用1×1卷积控制特征图的数量,可以表示为

式中:

通过将单元的输出与输入相加实现了局部残差学习,进一步保留了大量图像细节信息,提高了残差密集单元的特征提取能力。

2.4 高光谱图像残差密集网络分类方法

除残差密集单元内部的1×1卷积层之外,其余卷积层中卷积核尺寸均设置为3×3,而且卷积层之后均伴随着非线性激活层,能够提高模型提取非线性特征的能力。模型的优化函数采用适合非凸优化问题的Adam函数[17]。对于原始数据的邻域大小,实验证明,较大的邻域能够取得较好的效果,但是相应的训练时间会增加,因此综合考虑设置邻域大小为9×9[18]。

图 4. 高光谱图像分类残差密集网络模型示意图

Fig. 4. Illustration of residual dense network model for hyperspectral image classification

3 实验结果与分析

3.1 实验数据

为了验证本文方法的合理性和有效性,采用高光谱图像数据Indian Pines数据(IN)、University of Pavia数据(UP)及Salinas数据(SA)进行验证实验。实验在计算机上基于Ubuntu系统,利用Python编程语言自主编程实现,配置为Intel Core i7-4720HQ @2.6 GHz、Nvidia GeForce GTX 965 M和16 GB内存。Indian Pines数据是由美国AVIRIS成像光谱仪获取的印第安纳州西北部某林区的图像,图像大小为145 pixel×145 pixel,去除水汽吸收波段后共200个波段,波长范围为0.4~2.45 μm,空间分辨率为20 m。图像中共有16类地物,在实验中剔除真实样本数量较少的类别,仅保留9类地物[19],实验中训练样本和测试样本的数量如

表 1. Indian Pines数据样本数量

Table 1. Numbers of Indian Pines data samples

|

表 2. University of Pavia数据样本数量

Table 2. Numbers of University of Pavia data samples

|

3.2 参数选择

ResDenNet主要由卷积层、池化层等组成,多个参数对网络模型的性能有着很大的影响,包括学习率、卷积核数量、批尺寸等,需要对网络参数进行选择和确定。先分别设置学习率为0.001、0.01和0.1,实验发现最优学习率为0.001。然后分别采用卷积核数量为8、16、24、32、40的网络模型进行分类实验。

表 3. Salinas数据样本数量

Table 3. Numbers of Salinas data samples

|

图 5. 不同卷积核数量的模型分类精度

Fig. 5. Classification accuracies of models with different kernel numbers

其次设置训练过程中批尺寸为16、24、32、50、64,

3.3 实验结果与分析

为了评价本文方法的合理性和有效性,将本文方法与典型分类方法进行对比,如SVM、CNN、ResNet和DenseNet。其中,SVM核函数采用径向基函数(RBF)函数,并采用交叉验证的方法确定核参数

利用Indian Pines数据和University of Pavia数据训练的模型对Salinas数据直接进行分类处理,进行10次独立实验,其结果如

表 4. 实验数据分类精度(平均值±方差)

Table 4. Classification accuracies (mean value±variance) of experimental datasets

|

表 5. Salinas数据分类精度(平均值±方差)

Table 5. Classification accuracies (mean value±variance) of Salinas dataset

|

图 8. University of Pavia数据分类结果图

Fig. 8. Classification maps of University of Pavia dataset

最后利用不同数量的训练样本参与模型训练,检验模型在小样本情况下的分类精度。分别设置3组数据的训练样本数量为50、100、150和200,

表 6. 不同方法训练测试时间

Table 6. Training and testing time for different methodss

|

图 10. 不同训练样本数量的模型分类精度

Fig. 10. Classification accuracies for different training sample numbers

4 结论

为了充分利用网络模型不同单元提取的分层特征,设计了适用于高光谱图像分类的ResDenNet模型。ResDenNet结合了残差网络和密集网络,能够充分利用模型中不同单元提取的所有分层特征,不仅通过短连接和密集连接克服了梯度消失问题,还充分提取了图像中的细节信息,增强了特征重利用和信息连续传递。

分析了不同网络参数对分类精度的影响,选出适合不同网络模型的较好参数,对比了不同网络模型的训练测试时间,以及本文方法在不同数量的训练样本条件下的分类精度。实验表明,本文方法能够有效提高分类精度,增强分类方法的稳定性。ResNet和DenseNet充分利用CNN的特征提取能力,为高光谱图像分类提供了有力的工具,后续研究可以考虑将ResNet和DenseNet与半监督方法结合,利用少量的训练样本取得较高的分类精度。

[4] 黄鸿, 何凯, 郑新磊, 等. 基于深度学习的高光谱图像空-谱联合特征提取[J]. 激光与光电子学进展, 2017, 54(10): 101001.

[6] 闫苗, 赵红东, 李宇海, 等. 基于卷积神经网络的高光谱遥感地物多分类识别[J]. 激光与光电子学进展, 2019, 56(2): 021702.

[7] He KM, Zhang XY, Ren SQ, et al. Deep residual learning for image recognition[C]∥2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 27-30, 2016, Las Vegas, NV, USA. New York: IEEE, 2016: 770- 778.

[8] 陆永帅, 李元祥, 刘波, 等. 基于深度残差网络的高光谱遥感数据霾监测[J]. 光学学报, 2017, 37(11): 1128001.

[9] WangC, LiuY, BaiX, et al. Deep residual convolutional neural network for hyperspectral image super-resolution[M] ∥Zhao Y, Kong X, Taubman D. Image and graphics. ICIG 2017. Lecture notes in computer science. Cham: Springer, 2017, 10668: 370- 380.

[10] 张超, 陈莹. 残差网络下基于困难样本挖掘的目标检测[J]. 激光与光电子学进展, 2018, 55(10): 101003.

[11] 钟健. 基于深度神经网络的遥感图像半监督学习方法研究[D]. 沈阳: 沈阳航空航天大学, 2018: 38- 47.

ZhongJ. Research on semi-supervised learning method of remote sensing image based on deep neural network[D]. Shenyang: Shenyang Aerospace University, 2018: 38- 47.

[14] HuangG, Liu Z, van der Maaten L, et al. Densely connected convolutional networks[C]∥2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), July 21-26, 2017, Honolulu, HI, USA. New York: IEEE, 2017: 2261- 2269.

[16] Zhang YL, Tian YP, KongY, et al. Residual dense network for image super-resolution[C]∥2018 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), June 18-23, 2018, Salt Lake City, UT, USA. New York: IEEE, 2018: 2472- 2481.

[17] Kingma DP, Ba J. Adam: a method for stochastic optimization[J/OL]. ( 2017-01-30)[2019-01-05]. https:∥arxiv.org/abs/1412. 6980.

Article Outline

魏祥坡, 余旭初, 谭熊, 刘冰. 利用残差密集网络的高光谱图像分类[J]. 激光与光电子学进展, 2019, 56(15): 151006. Xiangpo Wei, Xuchu Yu, Xiong Tan, Bing Liu. Hyperspectral Image Classification Based on Residual Dense Network[J]. Laser & Optoelectronics Progress, 2019, 56(15): 151006.