大型工程结构静动态变形摄像测量方法与应用(特邀)创刊六十周年特邀

1 引言

变形测量是大型工程建设与运维的基础性、常规性任务,是实验力学、结构健康监测学科最重要的内容之一。对于桥梁、隧道、大坝、边坡等大型工程结构,其服役渐进损伤是导致结构破坏甚至造成安全事故的主要因素,细微的表面静动态变形是结构损伤的主要外在表现,如高铁桥墩亚毫米级变形监测、地铁隧道毫米级收敛变形监测、特大拱桥毫米级拱轴线测量、三峡水电站大坝、“天眼”工程球面等关键节点的缺陷检测等。上述大尺度结构测量的尺度与精度之比为5~7个数量级,现有测量方法难以精准高效经济地实现,迫切需要建立新的测量方法和技术。

目前用于大型工程结构变形测量的传感器主要分为接触式(如线性可调差动变压器[1]、加速度计[2-3]、应力传感器[4]、倾角仪[5-6]、连通管[7]、光纤传感器[8-9]等)和非接触式(如全球卫星导航系统[10]、激光多普勒振动仪[11-12]、全站仪[13]、激光雷达[14]、微波雷达[15-16]以及视觉传感器[17-24]等)。接触式传感器需直接安装在目标结构的测量点处收集数据,但在实际工程应用中,出于安全性和现场实施条件的限制,难以布设在结构上。在非接触式传感器中:全球卫星导航系统易于安装,适用于长期变形监测,但其动态响应和精度通常较低且无法适用于如隧道等闭塞的环境中;激光多普勒振动仪能够实时测量并快速响应结构的动态变化,但其对大气湍流、温度等环境因素较为敏感;微波雷达需要人工识别目标在待测结构上的具体位置并估算转换因子,在测量时会遇到相位缠绕问题,降低位移估计的精度;全站仪不适用于长期的位移监测,其经常作为参考传感器用来评估其他类型传感器的性能。

摄像测量技术[25]具有非接触性、高精度和快速的特点,该技术利用摄像机、照相机等对动态、静态景物或物体进行拍摄得到序列或单帧数字图像,再应用数字图像处理分析等技术结合各种目标三维(3D)信息的求解和分析算法,对目标结构参数或运动参数进行测量和估计,主要包括两个方面:一是二维图像与对应三维空间物体之间的关系;二是从单幅和多幅图像中高精度自动提取、匹配图像目标。随着计算机技术、光学传感器、图像处理算法的持续进步,摄像测量技术的准确性和效率得到了显著提升,其从复杂的图像数据中提取精确信息变得更加可行和高效,如位移[18-21,23,26]、挠度[22,24]、几何参数[27]等。在实际应用中,摄像测量技术不仅可用于常规的监测任务,还可在极端或危险环境中发挥作用,例如在高风险区域进行地质灾害监测或在难以接近的位置监测结构的稳定性,通过实时监测和分析结构的微小变化,可以及时发现潜在的结构问题,在问题发展成严重损害前进行维修或加固,提高结构的安全性和可靠性。

2 摄像测量系统

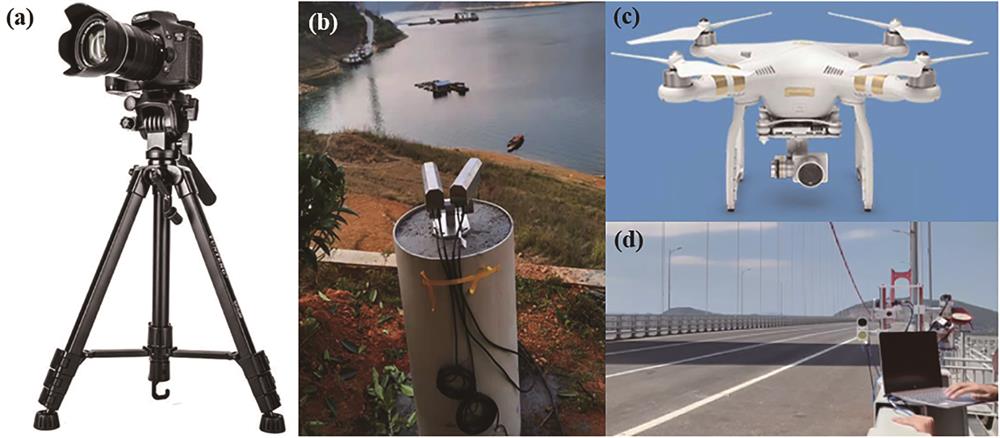

摄像测量系统主要分为单相机系统和多相机系统,其硬件组成主要包括相机、镜头、标志物、测量平台、处理器等组件(

![摄像测量系统。(a)相机[22];(b)处理系统[21];(c)软件平台[22]](/richHtml/lop/2024/61/1/0112001/img_01.jpg)

图 1. 摄像测量系统。(a)相机[22];(b)处理系统[21];(c)软件平台[22]

Fig. 1. System of videometrics. (a) Camera[22]; (b) processing unit[21]; (c) software platform[22]

图 2. 摄像测量系统相机平台。(a)三脚架;(b)固定墩;(c)无人机;(d)随动平台

Fig. 2. Platforms of videometrics. (a) Tripods; (b) fixed piers; (c) unmanned aerial vehicle; (d) unstable platforms

单相机系统是最常用的摄像测量系统,但由于相机视场与测量精度之间的固有矛盾,限制了单相机系统在结构全场变形测量的应用。多相机系统利用多个相机测站(测站数量≥2)对结构成像,各相机测站间紧密配合作业,并且通过关联各相机测站的图像数据,可以克服因视场和精度固有矛盾带来的测量误差,可以有效地应用于结构全场精密测量。以两个相机组成的多相机系统为例,双目立体视觉测量系统[

![双相机摄像测量系统示意图。(a)双目立体视觉;(b)主副双相机[35];(c)串联双相机测站[22]](/richHtml/lop/2024/61/1/0112001/img_03.jpg)

图 3. 双相机摄像测量系统示意图。(a)双目立体视觉;(b)主副双相机[35];(c)串联双相机测站[22]

Fig. 3. Schematic of dual-camera videometrics system. (a) Binocular stereo vision; (b) main camera with sub-camera[35]; (c) serial camera[22]

针对大型结构大尺度高精度测量要求,双相机系统同样有视场与精度(空间分辨率)之间的矛盾。因此,研究人员进一步提出了多相机组网(相机数量≥3)测量系统,该系统可以同时捕捉场景在不同视角或多个时间点的图像,以覆盖整个场景中的待测结构,从而实现更精确和全面的结构变形捕捉和分析。邵新星等[36]利用多相机全周变形测量系统成功实现了火箭舱段内表面柱坐标系下360°全周变形测量,如

![多相机网络示意图。(a)多相机全周变形测量[37];(b)并联相机网络[20];(c)串联相机网络[21]](/richHtml/lop/2024/61/1/0112001/img_04.jpg)

图 4. 多相机网络示意图。(a)多相机全周变形测量[37];(b)并联相机网络[20];(c)串联相机网络[21]

Fig. 4. Schematic of multi-camera network. (a) Multi-camera panoramic deformation measurement[37]; (b) parallel camera network[20]; (c) serial camera network[21]

3 摄像测量系统关键算法

摄像测量系统的关键算法主要包括图像采集、相机标定、特征提取与跟踪、变形计算等。图像采集利用相机系统采集目标物体的图像数据;相机标定用于获取内部参数(如焦距、主点、畸变系数)和外部参数(如相机相对于世界坐标系的平移向量和旋转矩阵),并将二维图像数据转换为实际的三维空间数据;特征提取与跟踪用于提取并跟踪结构中的关键模板或特征点(角点、边缘、纹理区域);变形计算是将从图像捕获的像素位移转换为实际的物理位移的过程。本节将以多相机系统(相机数量≥2)为主,分别介绍这几种算法在大型工程结构变形测量中的应用。

3.1 图像采集

图像采集是摄像测量系统的基础,分为同步采集与异步采集:同步采集是指在采集过程中,各相机系统之间通过外部触发信号或时钟信号实现同步采图,各相机系统之间有严格的时序关系;异步采集是指各相机系统之间没有严格的时序关系,采集设备可以根据自身的触发逻辑或内部时钟自主进行图像采集。

多相机系统要求各相机之间同步触发,以获取各相机在不同视角下对目标的成像情况。同步触发方式分为硬触发和软触发:硬触发通过将外部信号源(如专用触发器或传感器)与相机的触发输入接口相连,通过外部硬件信号来触发相机的采集动作,由于硬触发直接控制相机的触发动作,因此可以提供高精确性和同步性,适用于需要高精度同步的应用,如高速摄影、精密测量和实时控制;软触发的触发精度受到相机和主控制单元之间通信的限制,其需要通过软件命令传递给相机,因此可能存在传输延迟,其适用于对触发精度要求相对较低的应用,例如静态测量、准静态测量等。对于桥梁等对动态性要求较高的场景,本团队[20-21,24]利用硬触发方式控制相机采集,同步性在微秒量级;对于隧道、基坑等准静态场景,本团队[22]利用无线局域网实现软触发,同步性在毫秒量级。

3.2 相机标定

为了从图像中获取结构变形信息,需要构建世界坐标系和像素坐标系之间的转换关系,常用的转换关系有全投影矩阵、平面单应矩阵和尺度因子。全投影矩阵常用张氏标定法[38]求解,其包含内参数矩阵(包含畸变系数)和外参数矩阵,可用于精确测量结构的位移响应[39];平面单应矩阵可以简化标定流程,且不受相机视线与成像面的夹角影响,常用于结构面内二维测量,在求解时需要知道图像和结构平面至少4对对应点;尺度因子法可通过已知尺寸的物体在图像中的像素大小与实际尺寸之比获得,可以用于结构一维变形测量[40-43](如桥梁挠度、路基沉降等),是一种简单、实用的标定方法。在工程应用中,利用尺度因子需要注意相机的光轴与结构平面法线夹角是否为零,如不为零则需修正后才可以用于变形计算[44]。

对于多相机系统来说,为保证各相机测站采集的图像数据的关联性,在对单个相机测站完成标定后,还需要构建各相机测站之间的空间位置关系。例如:双目立体视觉测量系统需要利用对极约束的性质,计算左右两个相机之间的外部参数;主副双相机测量系统需要先依据位置关系确定主相机和副相机之间的空间变换矩阵,然后才可以补偿由于相机运动所引起的误差。多相机系统依据成像视场可分为有公共视场的多相机系统标定和无公共视场的多相机系统标定。有公共视场的多相机系统标定,在完成内参标定后,可利用共面约束的方法完成多个相机之间外参标定,最后可将多个相机系统的外参标定结果转换到同一个全局坐标系下即可。例如文献[45]中利用一块大标定板来统一各个相机的坐标,实现多个相机的联合标定。无公共相机的多相机系统标定法主要有三类:第一类利用大范围高精度测量设备,例如经纬仪[46]、激光跟踪仪[47]等,通过建立全局坐标系统一所有局部标定数据;第二类利用全场相机[48]、光学平面镜[49]等方式构造相机间的公共视场,将无公共视场问题转换为有公共视场的相机标定问题;第三类建立不同视场内标志物之间的固连约束关系,通过固连约束关系传递得到非相邻相机间的位姿关系,例如基于ChArUco平板的多相机系统标定[50]、基于组合棋盘格标定板的多相机系统标定[51]等。本团队针对所提出的串联相机网络系统和并联相机网络系统,根据现场工程环境,采用如下方法进行标定:

1)串联相机网络标定

不同于其他多相机系统,串联相机网络设站过程中,相机的光轴几乎垂直于测量点的运动平面,因此在相机网络中,看向不同方向的每个双头相机成像模型都可近似用线性模型简化[

2)并联相机网络标定

并联相机网络设站过程中,多个相机之间没有重叠的公共视场[

3.3 特征提取与跟踪

特征提取是通过提取图像中的特征信息,捕捉与目标相关的特征,以便于目标跟踪算法在其他图像帧中重新找到这些特征。常用的图像特征主要有边缘特征、特征点、形状特征、灰度特征、颜色特征等。例如:常用的边缘检测算法有Zernike算子[52]、Roberts算子、Sobel算子[53]、Log算子、Canny算子[54-55]和广义霍夫算法[56]等;常用的特征点及描述子有Harris角点[57]、Shi-Tomasi角点[58]、尺度不变特征转换(SIFT)[59]、加速鲁棒特征检测(SURF)[60]、BRIEF[61]、BRISK[62]和FREAK[63]等。

目标跟踪旨在通过选定的图像特征,对被测结构或其标志物进行定位跟踪,以实现特征在图像序列或视频中每一帧位置的准确捕捉,从而分析其在某一时间段内的运动轨迹。常用的目标跟踪算法主要有模板匹配法、特征匹配法和光流法。

1)模板匹配法

基于区域的模板匹配法通过在源图像中滑动模板图像,每次移动一个像素,对每个位置的源图像区域与模板进行比较,在每个滑动位置上,计算模板图像与源图像区域之间的相似度。在相似度图中寻找最高(或最低,取决于匹配准则)的值,这个位置代表了源图像中与模板最相似的区域。现有的相关性标准或相似性度量通常分为两大类[64]:一是互相关(CC)标准,包括CC、归一化互相关(NCC)和零归一化互相关(ZNCC);二是平方差和相关(SSD)标准,包括SSD、归一化平方差和(NSSD)和零归一化平方差和(ZNSSD)等。

基于区域的模板匹配法得到结果为整像素位移,为了提高位移测量的精度,在实际应用中需要利用优化算法,以求出亚像素级别的精度。比较常用的亚像素提取算法有亚像素插值[65]、灰度插值[66]、相关系数曲线拟合、相位相关插值、空间梯度和有限元等方法。如

2)特征匹配法

利用特征匹配进行追踪的过程主要包括三个关键步骤:特征提取、匹配和异常点剔除。特征匹配法能够有效地处理视角变化、光照条件的变动以及其他导致图像变形的因素,提高图像识别和配准的准确性。在特征匹配的过程中,由于各种原因,如图像噪声、特征点检测和描述的不准确性,以及场景中的多样性,特征匹配过程中难免会出现一些错误匹配,因此也需要对异常匹配点进行剔除,常用于异常匹配剔除方法有基于单应性矩阵变换的随机抽样一致(RANSAC)法[67]和最小平方中值(LMS)法[68]。

特征匹配追踪可应用于无人工标记的被测结构,即利用结构本身的自然特征进行追踪,其优点在于能够利用结构表面的自然纹理来识别和追踪特征点。例如:Khuc等[69]利用SIFT特征点和描述子,成功实现了桥梁在列车荷载下的位移监测;Dong等[44]利用SURF特征点和描述子,实现了动态位移监测(

![特征提取与匹配[44]。(a)特征提取;(b)特征匹配](/richHtml/lop/2024/61/1/0112001/img_06.jpg)

图 6. 特征提取与匹配[44]。(a)特征提取;(b)特征匹配

Fig. 6. Feature extraction and matching[44]. (a) Feature extraction; (b) feature matching

3)光流算法

光流法主要分为全场光流法和稀疏光流法。全场光流法用于估计整个图像场景中每个像素点的运动,涉及对整个图像的分析,可以提供更全面的运动信息。全场光流法主要有Lucas-Kanade光流法[44]、Horn-Schunck法[71]、块匹配法[72]、Farneback法[73]、基于相位的光流法[74]和基于深度学习的光流法[75-77]等。例如:Guo等[78]利用Lucas-Kanade光流法实现了高架桥的实时、动态位移测量;Dong等[79]采用基于深度学习的光流法和高斯加权平均实现结构的多点位移监测。与全场光流法不同,稀疏光流法不是计算图像中每个像素的运动,而是选择性地跟踪一些显著的、容易追踪的点,如角点、特征点等。文献[80]利用Harris 角点实现了人行天桥在低风速下振动频率的监测;Dong等[44]利用Shi-Tomasi角点、SIFT特征点以及SURF特征点进行位移监测,证明其可以用于结构健康监测和模态识别,特别是固有频率和模态振型的识别。稀疏光流法对计算资源的要求较低,适用于实时应用和计算能力受限的场景。与全场光流法相比,稀疏光流法提供的运动信息更为集中,但可能无法全面反映整个场景的运动情况。

3.4 变形计算

由3.2节可知,通过利用不同方法对相机系统进行标定可以获得不同的测量结果。利用全参数矩阵可以求取结构高精度变形;平面单应性矩阵可以实现面内二维变形测量;尺度因子可用于仅需要计算一维变形的场景。本节将介绍摄像测量的几种模式,即单相机测量、双相机三维测量、相机网络测量。

3.4.1 单相机测量

在得到相机内外参矩阵和尺度因子后,通过结构中特征点的匹配与跟踪,即可完成对结构的面内一维、二维变形量的测量。由于结构尺寸较大,相机测量视场相应较大,使用单个小尺寸的棋盘格难以实施标定。因此,对于单相机来说,通常利用以下几种方法获得结构精确的测量结果。

1)利用尺度因子计算结构的实际位移,该方法要求相机的主轴垂直于结构表面平面或感兴趣的两个运动方向。在结构位移测量中:如果测量任务仅限于一维位移(如桥梁竖向挠度、路基沉降),且图像中存在已知结构的尺寸信息,可直接利用尺度因子求出实际位移;如果测量任务为二维位移,则需要同时标定两个方向的尺度因子。

2)利用平面单应矩阵计算结构的实际位移。平面单应矩阵是一种用于将二维(2D)图像平面与2D结构表面平面相联系的转换度量,常用于2D平面测量。在进行校准时,至少需要四组2D到2D的点对应关系,即结构表面平面上点的结构坐标和它们在图像平面上的投影图像的坐标。通过这些点对应关系,可以计算出平面单应矩阵,从而建立起图像平面和结构表面平面之间的几何关系,并且采用单应矩阵得到的测量结果不受光轴与结构平面的夹角的影响。

3.4.2 双相机三维测量

在完成左右相机标定并获取立体视觉系统的参数和视差图后,根据三角测量原理就可以计算得到三维点的坐标及深度信息。与单相机测量在大型结构中面临的问题一样,在大视场条件下,双相机系统也将无法使用传统的平面标定法进行标定。为了在大视场条件下标定三维系统,可以在利用张氏标定法完成相机内参标定后,若场景中的特征点布满整个视场且分布均匀,可使用对极几何原理标定立体视觉参数。考虑到户外测量环境通常不存在或仅有数量有限的可利用空间点,可以使用无人机携带参考标记[81]在视场中飞行增加空间点的数量。两相机同时捕捉无人机飞行过程的图像,并使用特征点检测算法确定参考标记的图像坐标,进而可根据对极几何关系确定立体视觉的外部参数。最后,利用光束平差法对内部参数、外部参数以及参考点的 3D 坐标进行联合优化。

与单相机面内测量相比,双相机三维测量可以得到三个方向的位移,因此会得到更加详细的测量结果。例如:邱志成等[82]利用双目立体视觉系统实现了振动测量;Long等[83]利用双目立体视觉系统实现了对桥梁结构的健康监测和状态评估;Liu等[84]分析了相机运动对双目立体视觉系统测量精度的影响,且利用双目立体视觉系统实现了飞机机翼的高精度变形测量[85]。

3.4.3 相机网络测量

单相机测量系统与双相机测量系统的分辨率都主要受到测量视场和成像分辨率的限制,且测量过程中易受到相机平台自身运动所引起的误差。为了解决目前大型工程结构测量中所面临的问题,本团队提出了串联相机网络测量系统和并联相机网络测量系统。

1)串联相机网络。如

![串联相机网络[87]。(a)示意图;(b)结构变形前后测量单元变化示意图](/richHtml/lop/2024/61/1/0112001/img_07.jpg)

图 7. 串联相机网络[87]。(a)示意图;(b)结构变形前后测量单元变化示意图

Fig. 7. Serial camera network[87]. (a) Schematic; (b) schematic of the change of measurement units before and after structural deformation

式中:右上标为双头相机编号,右下标为合作标志编号;h为合作标志在相机图像中的竖直位移量;k为图像对标志的放大倍数;∆y为合作标志或双头相机处的路基沉降量;d是双头相机与合作标志间的距离;θCi为编号为 Ci的双头相机单元的俯仰角变化量。h可由相应标志点图像坐标的变化得到,d、k具体数值可通过标定得到,∆y、θ为监测量。

2)并联相机网络。该系统具有平台晃动/运动自修正的能力,其工作流程如

式中:

4 摄像测量技术在结构健康监测领域的应用

本节从摄像测量技术在快速测量和长期监测两个领域出发,分别介绍了目前摄像测量技术在实际现场工程中的应用。大型工程结构的快速测量和长期监测是在不同时间尺度上进行的两种不同类型的活动:快速测量是在特定时间点或短时间内对结构快速检测,旨在获取结构的当前状态和性能,并通常在特定的施工阶段、维护期间或特定事件发生后进行,对系统的便捷性和效率要求较高;长期监测是在较长时间范围内对结果进行持续的监测,通常跨越几个月到几年甚至更长的时间,旨在对结构的长期行为和性能进行跟踪和分析,对系统的稳定性和鲁棒性要求较高。

4.1 长期监测

长期监测对于系统的稳定性要求更高。特别是在实际现场工程中,由外界环境变化所引起的温度波动、大气湍流、相机运动、光照条件的变化以及遮挡造成的光照不均匀等,常常导致图像质量降低、噪声增加和匹配精度下降,这就要求用于大型工程结构长期监测的摄像测量系统具有良好的系统稳定性和算法适用性。

目前已经有多种技术手段用于补偿长期监测过程中因环境所导致的测量误差,如:利用自适应滤波、幸运成像、波前斜率压缩感知、构建误差模型等技术可以减轻大气湍流的影响;利用方向编码匹配(OCM)、上采样互相关(UCC)、深度学习等技术可以在一定程度消除光照变化、遮挡所引起的测量误差;利用运动补偿方法弥补由于相机运动所导致的误差[88]。Luo等[89]基于光学湍流误差可以通过正态随机分布拟合的特征,构建自适应滤波器用于减小在高温环境下光学湍流所引起的误差,并验证了该方法在减少测量误差方面的有效性,可以获取大桥的真实振动响应频率和列车经过时的桥梁振动主频。之后,该团队[90]也综合研究了热空气引起的形变和位移误差的特性,并建立了热空气误差模型,通过在高温天气下进行的桥梁位移测量实验,量化了热空气引起的测量误差。Feng等[91]采用UCC和OCM两种模板匹配方法,结合亚像素提取技术,实现了结构的实时多点位移测量,并验证了基于OCM的方法在面对光照变化、部分遮挡、背景扰动等误差源时可靠性更高。Jeong等[92]提出将基于深度学习的目标跟踪算法用于结构位移监测,利用DaSiamRPN(Distractor-Aware Siamese Region Proposal Network)来解决环境干扰所引起的误差问题,并通过室内和室外实验验证了该方法在光照变化、遮挡和大雾等环境下的可行性。Wang等[23]提出了一种基于自适应边缘点匹配(SEPM)的新型亚像素精细化技术用于结构位移测量,通过室内外测试验证了SEPM的精度和鲁棒性。Lee等[35]利用双相机系统进行运动补偿,主相机用于测量结构位移,副相机测量相机系统自身的运动,从而估计并补偿由运动引起的误差,并验证了该系统可以用于室外铁路桥的连续长期监测。

在现场工程应用中,观测平台普遍不稳定。相机有两种类型的自运动,即由风或车辆交通引起的振动以及由附近的施工活动引起的静态或准静态运动。相机的自运动沿着六个自由度(6-DOF),包括三个平移

4.2 快速检测

快速检测通常使用各种传感器和测量技术,如激光扫描仪、摄像测量、振动传感器等,以获取结构的几何形状、变形、振动等信息。其目的是快速评估结构的当前状态、性能和安全性,以便进行必要的维修、调整或采取适当的措施。由于对时效性要求较高,用于快速测量的摄像测量系统一般多采用自然特征和可方便部署的测量系统。目前已经多篇文献报道了利用自然特征实现大型结构的变形测量,例如:Guo等[78]利用Lucas-Kanade光流法来完成位移的实时测量,无需预先在结构上安装任何预先设计的目标面板,即可快速完成位移提取;Cai等[93]提出了一种在不附加任何目标的情况下,以亚像素精度自适应估计结构运动的新方法,该方法可以同时估计相机和结构运动信息;Lee等[94]提出了一种激光雷达与相机相结合的非目标位移测量方法,利用激光扫描仪(LiDAR)获得的点云,可以确定相机与全尺度结构感兴趣区域(ROI)之间的相对位置(即距离和角度),从而将图像信息转换为物理空间的位移,还可以补偿因结构表面与位移方向不重合所引起的面外测量误差;Shao等[95]利用深度学习方法进行的关键点检测、匹配和跟踪,可以实现三维微小振动位移测量。

随着无人机技术的进步,无人机(UAV)平台可以配备先进的传感器和相机系统,如LiDAR和高分辨率相机,能够以更高的精度和分辨率从多角度获取更全面的结构测量数据。UAV在结构健康监测方面的应用正在增加,通过定期采集UAV数据,可以实现结构较长时间间隔内的监测和趋势分析,以便检测结构的变形、位移和形态变化,并评估结构的稳定性和安全性。例如:Yoon等[96]使用UAV搭载相机来计算结构相对位移,之后估计相机六自由度运动,恢复结构的绝对位移,成功用于铁路桥的绝对位移响应测量;Ribeiro等[97]用无人机测量结构垂直方向的面内相对位移,并融合惯性测量单元(IMU)测量数据恢复结构的绝对位移,在室外钢筋混凝土结构上验证了该方法的有效性;Zhuge等[98]提出了一种利用多无人机系统测量桥梁挠度的方法,该方法利用投影在结构平面上的激光光斑的共线性来消除无人机的运动,并计算出待测位置相对于桥墩的竖向位移;Xu等[99]利用无人机搭载相机,并基于图像三维重建方法,实现了桥梁几何形状高效重建和测量。此外,由本团队正在研发的基于移动平台的动联相机网络在实现快速巡检的同时,也可以补偿相机平台运动引起的误差,有望成为新一代快速检测新技术、新方法。

4.3 影响因素

基于摄像测量系统的大型工程结构在实际应用中受到多个因素的影响,这些因素主要有系统硬件、环境、算法等。系统硬件误差主要来源于相机传感器类型和标志物的选取,例如由相机硬件限制所产生的卷帘快门效应和时间混叠效应。卷帘快门效应在记录快速移动的物体时可能会产生失真,时间混叠效应不利于相机系统捕捉更高频率的结构响应;人工标志可以提高像素提取与跟踪的精度,增加系统的稳定性;自然特征易受到外界环境的影响,导致目标提取算法误差增大甚至失效。各种外部环境因素(如温度变化、环境振动引起的相机晃动、光照变化以及遮挡引起的光照突变等)都会对图像质量和匹配精度产生负面影响,导致噪声的增加并降低匹配准确性。以模板匹配算法为例,算法的准确性通常受限于图像质量。在室外环境中,光照变化、部分目标遮挡、阴影和背景干扰等因素会导致图像质量下降,从而影响模板匹配的结果。特别是在低光照条件下或存在阴影时,摄像测量系统的性能会受到限制,目前已有多种算法[23,89-90,92]用来消除环境对测量结果的影响。此外,相机平台运动(由风、交通、邻近施工等引起)也会引起测量误差,目前最常用的方式是将相机放置于固定墩上并将其视作不动点,但在长期监测中很难保证相机平台的严格稳定不动。相关文献[20-21,88,96,98]提出了多种相机晃动校正方法,例如Yoneyama等[100]提出了一种校正相机运动影响的方法,其使用透视变换方程描述了相机移动前后图像之间的关系,并通过未变形区域来确定方程的未知系数,之后利用透视变换来消除相机移动的影响。在测量大跨度桥梁位移时,可以假设背景中的参考物体(例如建筑物角点结构)处于静止状态,通过从桥梁位移中减去参考物体的位移,来消除相机运动的影响。

大型工程结构的测量一般是在室外或野外进行,为确保获得高质量的图像数据,对相机和环境有一定特殊的要求。目前由野外环境的不确定性所引起的测量误差,已经成为限制摄像测量技术用于大型工程结构长期、稳定、高效、高精度监测的主要因素。通过改善相机硬件设施、提升计算机视觉算法的鲁棒性以及研究各种误差剔除与补偿技术可以有效提升未来摄像测量技术的工程适用性。

5 结束语

本文从摄像测量系统基本组成出发,介绍了单相机、多相机摄像测量系统,介绍了常用的图像采集、相机标定、特征提取与跟踪、变形计算等方法,论述了目前摄像测量技术在长期监测和快速检测领域的相关应用,以及影响摄像测量系统稳定性的主要因素。尽管大型工程结构变形摄像测量技术展现出广阔的应用前景,但其在实际应用中仍面临若干挑战,基于摄像测量的结构健康监测系统能够长期稳定应用的案例相对较少。在实验室中,由于环境条件可控,图像采集系统能稳定地获取高质量的图像或视频,并通过后期处理获得准确的监测结果。在实际的现场监测中,系统面临更多复杂的挑战,如安装条件的限制、环境振动、测量距离、图像采集和传输速率等问题。此外,测量系统还需适应温度波动、光线不均匀变化和遮挡等因素,确保长期稳定且实时的监测,并能实时处理图像数据,输出准确可靠的位移信息。对于以上问题,本团队提出的串联和并联相机网络系统,不受严格稳定测量平台的限制,可将系统直接布置于施工影响区域或变形体上,形式灵活且可规避光照、振动等部分外部干扰,大幅扩展了摄像测量的工程适应性和使用场景,同时可以为大型工程结构提供时间和空间两个维度上的多点实时动态测量数据,有望成为一种广泛使用的大型工程结构变形新选择。

未来摄像测量技术发展的重点一是如何创新多相机网络构型满足不同大型工程结构大尺度高精度测量需求,二是如何发展移动平台变形测量方法实现超长路桥隧高效快速精准巡测。随着技术的发展,未来的大型结构变形测量将更加依赖于先进的精密传感器技术,为智慧城市、数字孪生提供感知手段和数据灵魂。未来研究还需要关注系统的自适应能力,如何利用各种技术手段消除外界各种环境影响,增加系统的长期适用性和稳定性,并实现更高程度的自动化和远程监测,是影响摄像测量应用的关键因素。

[1] K V S , Roy B K. Online implementation of an adaptive calibration technique for displacement measurement using LVDT[J]. Applied Soft Computing, 2017, 53: 19-26.

[2] Gomez F, Park J W, Spencer B F,. Reference-free structural dynamic displacement estimation method[J]. Structural Control and Health Monitoring, 2018, 25(8): e2209.

[3] Park J W, Sim S H, Jung H J. Displacement estimation using multimetric data fusion[J]. IEEE/ASME Transactions on Mechatronics, 2013, 18(6): 1675-1682.

[4] Zhang Q, Fu X, Ren L. Deflection estimation of beam structures based on the measured strain mode shape[J]. Smart Materials and Structures, 2021, 30(10): 105003.

[5] Sigurdardottir D H, Stearns J, Glisic B. Error in the determination of the deformed shape of prismatic beams using the double integration of curvature[J]. Smart Materials and Structures, 2017, 26(7): 075002.

[6] Zhang W, Sun L M, Sun S W. Bridge-deflection estimation through inclinometer data considering structural damages[J]. Journal of Bridge Engineering, 2017, 22(2): 04016117.

[7] Zhou J Y, Sun Z, Wei B, et al. Deflection-based multilevel structural condition assessment of long-span prestressed concrete girder bridges using a connected pipe system[J]. Measurement, 2021, 169: 108352.

[8] Bonopera M, Chang K C, Chen C C, et al. Fiber Bragg grating–differential settlement measurement system for bridge displacement monitoring: case study[J]. Journal of Bridge Engineering, 2019, 24(10): 05019011.

[9] Lee Z K, Bonopera M, Hsu C C, et al. Long-term deflection monitoring of a box girder bridge with an optical-fiber, liquid-level system[J]. Structures, 2022, 44: 904-919.

[10] Xiong C B, Wang M, Chen W. Data analysis and dynamic characteristic investigation of large-scale civil structures monitored by RTK-GNSS based on a hybrid filtering algorithm[J]. Journal of Civil Structural Health Monitoring, 2022, 12(4): 857-874.

[11] Nassif H H, Gindy M, Davis J. Comparison of laser Doppler vibrometer with contact sensors for monitoring bridge deflection and vibration[J]. NDT & E International, 2005, 38(3): 213-218.

[12] Reu P L, Rohe D P, Jacobs L D. Comparison of DIC and LDV for practical vibration and modal measurements[J]. Mechanical Systems and Signal Processing, 2017, 86: 2-16.

[13] Zhou J G, Xiao H L, Jiang W W, et al. Automatic subway tunnel displacement monitoring using robotic total station[J]. Measurement, 2020, 151: 107251.

[14] Lee J, Kim R E. Noncontact dynamic displacements measurements for structural identification using a multi-channel Lidar[J]. Structural Control and Health Monitoring, 2022, 29(11): e3100.

[15] Zhang G W, Wu Y L, Zhao W J, et al. Radar-based multipoint displacement measurements of a 1200-m-long suspension bridge[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2020, 167: 71-84.

[16] Rodrigues D V Q, Zuo D L, Li C Z. Wind-induced displacement analysis for a traffic light structure based on a low-cost Doppler radar array[J]. IEEE Transactions on Instrumentation and Measurement, 1969, 70: 6503909.

[17] Yu Q F, Guan B L, Shang Y, et al. Flexible camera series network for deformation measurement of large scale structures[J]. Smart Structures and Systems, 2019, 24: 587.

[18] Song Q S, Wu J R, Wang H L, et al. Computer vision-based illumination-robust and multi-point simultaneous structural displacement measuring method[J]. Mechanical Systems and Signal Processing, 2022, 170: 108822.

[19] Shang Y, Yu Q F, Yang Z, et al. Displacement and deformation measurement for large structures by camera network[J]. Optics and Lasers in Engineering, 2014, 54: 247-254.

[20] Yu Q F, Yin Y H, Zhang Y Q, et al. Displacement measurement of large structures using nonoverlapping field of view multi-camera systems under six degrees of freedom ego-motion[J]. Computer-Aided Civil and Infrastructure Engineering, 2023, 38(11): 1483-1503.

[21] Hu B, Chen W J, Zhang Y Q, et al. Vision-based multi-point real-time monitoring of dynamic displacement of large-span cable-stayed bridges[J]. Mechanical Systems and Signal Processing, 2023, 204: 110790.

[22] Yin Y H, Yu Q F, Zhang Y Q, et al. Deflection monitoring of immersed tunnel element during floating transportation and installation based on series camera network[J]. Optics and Lasers in Engineering, 2024, 172: 107857.

[23] Wang M M, Xu F Y, Xu Y, et al. A robust subpixel refinement technique using self-adaptive edge points matching for vision-based structural displacement measurement[J]. Computer-Aided Civil and Infrastructure Engineering, 2023, 38(5): 562-579.

[24] Yin Y H, Yu Q F, Hu B, et al. A vision monitoring system for multipoint deflection of large-span bridge based on camera networking[J]. Computer-Aided Civil and Infrastructure Engineering, 2023, 38(13): 1879-1891.

[25] YuQ, ShangY. Videometrics: principles and researches[M]. Beijing: Science Press, 2009.

[26] 胡烁陶, 孙晖, 王敏诚, 等. 空间结构形变的多视点高精度测量方法[J]. 激光与光电子学进展, 2022, 59(19): 1912004.

[27] 周威, 杜馨瑜, 薛宪堂, 等. 高速铁路接触网几何参数立体视觉测量系统[J]. 光学学报, 2023, 43(5): 0512001.

[28] Zhuang Y Z, Chen W M, Jin T, et al. A review of computer vision-based structural deformation monitoring in field environments[J]. Sensors, 2022, 22(10): 3789.

[29] 彭聪, 缪卫东, 曾聪. 基于机器视觉的轻型梁三维振动测量方法[J]. 北京航空航天大学学报, 2021, 47(2): 207-212.

Peng C, Miao W D, Zeng C. Three-dimensional vibration measurement method for lightweight beam based on machine vision[J]. Journal of Beijing University of Aeronautics and Astronautics, 2021, 47(2): 207-212.

[30] Yang M, Liu W F, Liu Z H, et al. Binocular vision-based method used for determining the static and dynamic parameters of the long-stroke shakers in low-frequency vibration calibration[J]. IEEE Transactions on Industrial Electronics, 2023, 70(8): 8537-8545.

[31] Shao Y D, Li L, Li J, et al. Computer vision based target-free 3D vibration displacement measurement of structures[J]. Engineering Structures, 2021, 246: 113040.

[32] 左承林, 马军, 岳廷瑞, 等. 基于双目立体视觉的直升机旋翼桨叶位移变形测量方法[J]. 实验流体力学, 2020, 34(1): 87-95.

Zuo C L, Ma J, Yue T R, et al. Displacement and deformation measurements of helicopter rotor blades based on binocular stereo vision[J]. Journal of Experiments in Fluid Mechanics, 2020, 34(1): 87-95.

[33] Su Z L, Lu L, Yang F J, et al. Geometry constrained correlation adjustment for stereo reconstruction in 3D optical deformation measurements[J]. Optics Express, 2020, 28(8): 12219-12232.

[34] Hu Q J, Feng Z Y, He L P, et al. Accuracy improvement of binocular vision measurement system for slope deformation monitoring[J]. Sensors, 2020, 20(7): 1994.

[35] Lee J, Lee K C, Jeong S, et al. Long-term displacement measurement of full-scale bridges using camera ego-motion compensation[J]. Mechanical Systems and Signal Processing, 2020, 140: 106651.

[36] Shao X X, Zhou J F, Yuan F, et al. Real-time panoramic-deformation measurement of cabin structure of launch vehicle based on camera network[J]. Scientia Sinica Technologica, 2022, 52(12): 1849-1858.

[37] 邵新星, 员方, 魏康, 等. 大型结构高精度三维动态变形测量应用进展[J]. 激光与光电子学进展, 2023, 60(8): 0811013.

[38] Zhang Z. A flexible new technique for camera calibration[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2000, 22(11): 1330-1334.

[39] Dong C Z, Catbas F N. A non-target structural displacement measurement method using advanced feature matching strategy[J]. Advances in Structural Engineering, 2019, 22(16): 3461-3472.

[40] Ye X W, Jin T, Ang P P, et al. Computer vision-based monitoring of the 3-D structural deformation of an ancient structure induced by shield tunneling construction[J]. Structural Control and Health Monitoring, 2021, 28(4): e2702.

[41] Feng D M, Feng M Q. Experimental validation of cost-effective vision-based structural health monitoring[J]. Mechanical Systems and Signal Processing, 2017, 88: 199-211.

[42] Song Y Z, Bowen C R, Kim A H, et al. Virtual visual sensors and their application in structural health monitoring[J]. Structural Health Monitoring, 2014, 13(3): 251-264.

[43] Ye X W, Ni Y Q, Wai T T, et al. A vision-based system for dynamic displacement measurement of long-span bridges: algorithm and verification[J]. Smart Structures and Systems, 2013, 12(3/4): 363-379.

[44] Dong C Z, Celik O, Catbas F N. Marker-free monitoring of the grandstand structures and modal identification using computer vision methods[J]. Structural Health Monitoring, 2019, 18(5/6): 1491-1509.

[45] 肖一帆, 胡伟. 基于多相机系统的高精度标定[J]. 激光与光电子学进展, 2023, 60(20): 2015003.

[46] Lu R S, Li Y F. A global calibration method for large-scale multi-sensor visual measurement systems[J]. Sensors and Actuators A: Physical, 2004, 116(3): 384-393.

[47] Lu Y K, Liu W, Zhang Y, et al. An error analysis and optimization method for combined measurement with binocular vision[J]. Chinese Journal of Aeronautics, 2021, 34(10): 282-292.

[48] Miyata S, Saito H, Takahashi K, et al. Extrinsic camera calibration without visible corresponding points using omnidirectional cameras[J]. IEEE Transactions on Circuits and Systems for Video Technology, 2018, 28(9): 2210-2219.

[49] TakahashiK, NobuharaS, MatsuyamaT. A new mirror-based extrinsic camera calibration using an orthogonality constraint[C]∥2012 IEEE Conference on Computer Vision and Pattern Recognition, June 16-21, 2012, Providence, RI, USA. New York: IEEE Press, 2012: 1051-1058.

[50] 赵子良, 张宗华, 高楠, 等. 基于ChArUco平板的多目相机标定[J]. 应用光学, 2021, 42(5): 848-852.

[51] StraußT, ZieglerJ, BeckJ. Calibrating multiple cameras with non-overlapping views using coded checkerboard targets[C]∥17th International IEEE Conference on Intelligent Transportation Systems (ITSC), October 8-11, 2014, Qingdao, China. New York: IEEE Press, 2014: 2623-2628.

[52] Ghosal S, Mehrotra R. Orthogonal moment operators for subpixel edge detection[J]. Pattern Recognition, 1993, 26(2): 295-306.

[53] Sobel I. Neighborhood coding of binary images for fast contour following and general binary array processing[J]. Computer Graphics and Image Processing, 1978, 8(1): 127-135.

[54] Canny J. A computational approach to edge detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1986, 8(6): 679-698.

[55] 娄群, 吕钧澔, 文立华, 等. 基于亚像素边缘检测的高精度相机标定方法[J]. 光学学报, 2022, 42(20): 2012002.

[56] Ballard D H. Generalizing the Hough transform to detect arbitrary shapes[J]. Pattern Recognition, 1981, 13(2): 111-122.

[57] LiY S, ShiW, LiuA L. A Harris corner detection algorithm for multispectral images based on the correlation[C]∥6th International Conference on Wireless, Mobile and Multi-Media (ICWMMN 2015), November 20-23, 2015, Beijing. London: IET, 2015: 161-165.

[58] Bansal M, Kumar M, Kumar M, et al. An efficient technique for object recognition using Shi-Tomasi corner detection algorithm[J]. Soft Computing, 2021, 25(6): 4423-4432.

[59] KrižajJ, ŠtrucV, PavešićN. Adaptation of SIFT features for robust face recognition[M]∥Campilho A, Kamel M. Image analysis and recognition. Lecture notes in computer science. Heidelberg: Springer, 2010, 6111: 394-404.

[61] Mohammad S, Morris T. Binary robust independent elementary feature features for texture segmentation[J]. Advanced Science Letters, 2017, 23(6): 5178-5182.

[62] Yang S Q, Li B, Zeng K. SBRISK: speed-up binary robust invariant scalable keypoints[J]. Journal of Real-Time Image Processing, 2016, 12(3): 583-591.

[63] AlahiA, OrtizR, VandergheynstP. FREAK: fast retina keypoint[C]∥2012 IEEE Conference on Computer Vision and Pattern Recognition, June 16-21, 2012, Providence, RI, USA. New York: IEEE Press, 2012: 510-517.

[64] Feng D M, Feng M Q. Computer vision for SHM of civil infrastructure: from dynamic response measurement to damage detection-a review[J]. Engineering Structures, 2018, 156: 105-117.

[65] Pan B, Qian K M, Xie H M, et al. Two-dimensional digital image correlation for in-plane displacement and strain measurement: a review[J]. Measurement Science and Technology, 2009, 20(6): 062001.

[66] 李舒航, 高旭, 刘兆武, 等. 基于灰度插值的条纹图像位移亚像素检测算法[J]. 光学学报, 2021, 41(10): 1012002.

[67] Ma S H, Guo P K, You H R, et al. An image matching optimization algorithm based on pixel shift clustering RANSAC[J]. Information Sciences, 2021, 562: 452-474.

[68] TrimecheM, TicoM, GabboujM. Dense optical flow field estimation using recursive LMS filtering[C]∥2006 14th European Signal Processing Conference, September 4-8, 2006, Florence, Italy. New York: IEEE Press, 2006.

[69] Khuc T, Catbas F N. Computer vision-based displacement and vibration monitoring without using physical target on structures[J]. Structure and Infrastructure Engineering, 2017, 13(4): 505-516.

[70] Hu Q J, He S S, Wang S L, et al. A high-speed target-free vision-based sensor for bus rapid transit viaduct vibration measurements using CMT and ORB algorithms[J]. Sensors, 2017, 17(6): 1305.

[71] Horn B K P, Schunck B G. Determining optical flow[J]. Artificial Intelligence, 1981, 17(1/2/3): 185-203.

[72] Liu B, Zaccarin A. New fast algorithms for the estimation of block motion vectors[J]. IEEE Transactions on Circuits and Systems for Video Technology, 1993, 3(2): 148-157.

[73] FarnebäckG. Two-frame motion estimation based on polynomial expansion[M]∥ Bigun J, Gustavsson T. Image analysis. Lecture notes in computer science. Heidelberg: Springer, 2003, 2749: 363-370.

[74] Collier S, Dare T. Informed pixel pushing: a new method of large-motion handling for phase-based optical flow[J]. Measurement, 2023, 213: 112711.

[75] Zhang Z, Wang J, Zhao H J, et al. Applicability of deep learning optical flow estimation for PIV methods[J]. Flow Measurement and Instrumentation, 2023, 93: 102398.

[76] SavianS, ElahiM, TilloT. Benchmarking the imbalanced behavior of deep learning based optical flow estimators[C]∥2019 15th International Conference on Signal-Image Technology & Internet-Based Systems (SITIS), November 26-29, 2019, Sorrento, Italy. New York: IEEE Press, 2019: 151-158.

[77] RenZ, YanJ C, NiB B, et al. Unsupervised deep learning for optical flow estimation[C]∥Proceedings of the Thirty-First AAAI Conference on Artificial Intelligence, February 4-9, 2017, San Francisco, California, USA. Virigina: AAAI Press, 2017: 1495-1501.

[78] Guo J, Zhu C A. Dynamic displacement measurement of large-scale structures based on the Lucas-Kanade template tracking algorithm[J]. Mechanical Systems and Signal Processing, 2016, 66/67: 425-436.

[79] Dong C Z, Celik O, Catbas F N, et al. Structural displacement monitoring using deep learning-based full field optical flow methods[J]. Structure and Infrastructure Engineering, 2020, 16(1): 51-71.

[80] Hoskere V, Park J W, Yoon H, et al. Vision-based modal survey of civil infrastructure using unmanned aerial vehicles[J]. Journal of Structural Engineering, 2019, 145(7): 04019062.

[81] Feng W W, Zhang S Q, Liu H B, et al. Unmanned aerial vehicle-aided stereo camera calibration for outdoor applications[J]. Optical Engineering, 2020, 59(1): 014110.

[82] 邱志成, 汪先锋. 基于双目视觉的振动测量及控制[J]. 振动·测试与诊断, 2018, 38(1): 51-58, 205.

Qiu Z C, Wang X F. Vibration measurement and control based on binocular vision[J]. Journal of Vibration, Measurement & Diagnosis, 2018, 38(1): 51-58, 205.

[83] LongX H, ZhanW W, GuiX L. Research on displacement monitoring method of heavy load bridge structure based on stereo vision[C]∥2020 IEEE International Conference on Industrial Application of Artificial Intelligence (IAAI), December 25-27, 2020, Harbin, China. New York: IEEE Press, 2020: 432-437.

[84] Liu Y, Ge Z D, Yuan Y T, et al. Study of the error caused by camera movement for the stereo-vision system[J]. Applied Sciences, 2021, 11(20): 9384.

[85] Liu Y, Ge Z D, Yuan Y T, et al. Wing deformation measurement using the stereo-vision methods in the presence of camera movements[J]. Aerospace Science and Technology, 2021, 119: 107161.

[86] 张跃强, 陈铭杰, 胡彪, 等. 基于相机组网的测量误差传递机理及抑制方法[J]. 光学学报, 2023, 43(21): 2112002.

[87] Yu Q F, Jiang G W, Shang Y, et al. A displacement-relay videometric method for surface subsidence surveillance in unstable areas[J]. Science China Technological Sciences, 2015, 58(6): 1105-1111.

[88] 陈文均, 尹义贺, 张跃强, 等. 基于垂直双相机的微动平台位姿修正方法研究[J]. 光学学报, 2021, 41(23): 2315001.

[89] Luo L X, Feng M Q, Wu J P. A comprehensive alleviation technique for optical-turbulence-induced errors in vision-based displacement measurement[J]. Structural Control and Health Monitoring, 2020, 27(3): e2496.

[90] Luo L X, Feng M Q, Wu J P, et al. Modeling and detection of heat haze in computer vision based displacement measurement[J]. Measurement, 2021, 182: 109772.

[91] Feng D M, Feng M Q. Vision-based multipoint displacement measurement for structural health monitoring[J]. Structural Control and Health Monitoring, 2016, 23(5): 876-890.

[92] Jeong J H, Jo H. Real-time generic target tracking for structural displacement monitoring under environmental uncertainties via deep learning[J]. Structural Control and Health Monitoring, 2022, 29(3): e2902.

[93] Cai E J, Zhang Y, Lu X Z, et al. A target-free video structural motion estimation method based on multi-path optimization[J]. Mechanical Systems and Signal Processing, 2023, 198: 110452.

[94] Lee S, Kim H, Sim S H. Nontarget-based displacement measurement using LiDAR and camera[J]. Automation in Construction, 2022, 142: 104493.

[95] Shao Y D, Li L, Li J, et al. Target-free 3D tiny structural vibration measurement based on deep learning and motion magnification[J]. Journal of Sound and Vibration, 2022, 538: 117244.

[96] Yoon H, Shin J, Spencer B F. Structural displacement measurement using an unmanned aerial system[J]. Computer-Aided Civil and Infrastructure Engineering, 2018, 33(3): 183-192.

[97] Ribeiro D, Santos R, Cabral R, et al. Non-contact structural displacement measurement using Unmanned Aerial Vehicles and video-based systems[J]. Mechanical Systems and Signal Processing, 2021, 160: 107869.

[98] Zhuge S, Xu X P, Zhong L J, et al. Noncontact deflection measurement for bridge through a multi-UAVs system[J]. Computer-Aided Civil and Infrastructure Engineering, 2022, 37(6): 746-761.

[99] Xu Y, Zhang J. UAV-based bridge geometric shape measurement using automatic bridge component detection and distributed multi-view reconstruction[J]. Automation in Construction, 2022, 140: 104376.

[100] Yoneyama S, Ueda H. Bridge deflection measurement using digital image correlation with camera movement correction[J]. Materials Transactions, 2012, 53: 285-290.

Article Outline

于起峰, 张强, 陈文均, 尹义贺, 陈铭杰, 雷雨, 刘立豪, 刘肖琳, 张跃强, 胡彪, 丁晓华. 大型工程结构静动态变形摄像测量方法与应用(特邀)[J]. 激光与光电子学进展, 2024, 61(1): 0112001. Qifeng Yu, Qiang Zhang, Wenjun Chen, Yihe Yin, Mingjie Chen, Yu Lei, Lihao Liu, Xiaolin Liu, Yueqiang Zhang, Biao Hu, Xiaohua Ding. Videometrics Methods and Applications of Static and Dynamic Deformation of Large-Scale Structures (Invited)[J]. Laser & Optoelectronics Progress, 2024, 61(1): 0112001.

![亚像素特征点提取与跟踪[21]](/richHtml/lop/2024/61/1/0112001/img_05.jpg)

![并联相机网络工作流程[20]](/richHtml/lop/2024/61/1/0112001/img_08.jpg)